思想领袖

解码 LLM 代理在生成式 AI 中的机遇和挑战

我们正在看到由大型语言模型(LLM)驱动的生成式 AI 应用的进展,从提示到检索增强生成(RAG)到代理。代理在行业和研究圈中被广泛讨论,主要是因为这种技术为转变企业应用和提供卓越的客户体验提供了强大的支持。构建代理的常见模式使我们能够迈出实现人工通用智能(AGI)的第一步。

在我之前的 文章 中,我们看到了一种构建 LLM 驱动应用的智能阶梯。从捕获问题域并使用 LLM 内部内存生成输出的提示开始。使用 RAG,我们通过从向量数据库中搜索外部知识来增强提示,以控制输出。接下来,通过链接 LLM 调用,我们可以构建工作流来实现复杂的应用。代理将其提升到一个新的水平,通过自动确定如何形成这些 LLM 链。让我们详细看看。

代理 – 内部机制

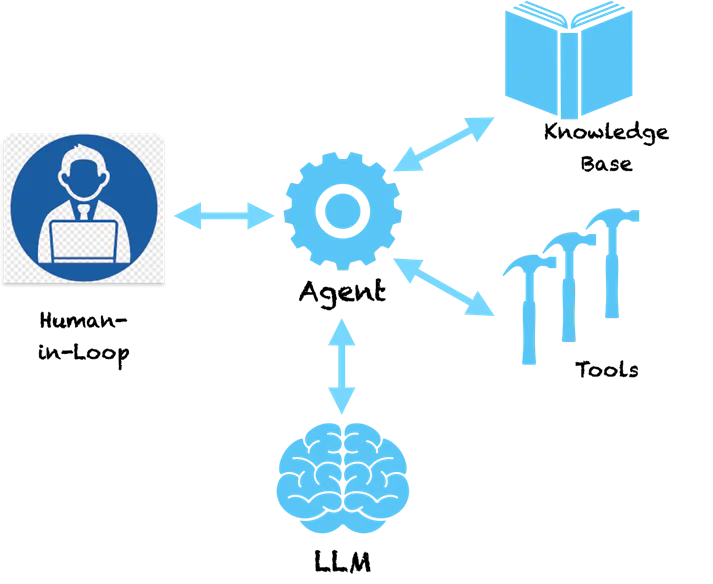

代理的一个关键模式是,它们使用 LLM 的语言理解能力来制定解决给定问题的计划。LLM 理解问题并为我们提供了一系列解决问题的步骤。但是,它并没有就此停止。代理不仅仅是一个纯粹的支持系统,它会为我们提供解决问题的建议,然后将解决问题的任务交给我们。代理被赋予了工具来采取行动。令人害怕,对吧?

如果我们问代理一个基本问题,如下所示:

人类: 电话的发明者创立了哪家公司?

以下是代理可能采取的思考步骤的示例。

代理(思考):

- 思维:我需要搜索电话的发明者。

- 行动: 搜索 [电话发明者]

- 观察:亚历山大·格雷厄姆·贝尔

- 思维:我需要搜索由亚历山大·格雷厄姆·贝尔创立的公司

- 行动: 搜索 [亚历山大·格雷厄姆·贝尔创立的公司]

- 观察:亚历山大·格雷厄姆·贝尔于 1885 年与他人共同创立了美国电话和电报公司(AT&T)

- 思维:我已经找到了答案。我将返回。

代理(响应): 亚历山大·格雷厄姆·贝尔于 1885 年与他人共同创立了 AT&T

您可以看到代理遵循一种系统的方法,将问题分解为可以通过采取特定行动来解决的子问题。这里的行动是由 LLM 推荐的,我们可以将其映射到特定的工具来实现这些行动。我们可以为代理启用一个搜索工具,以便当它意识到 LLM 已经提供了搜索作为一个行动时,它将调用此工具并使用 LLM 提供的参数。这里的搜索是在互联网上进行的,但也可以重定向到内部知识库,如向量数据库。系统现在变得自给自足,可以通过一系列步骤来解决复杂问题。像 LangChain 和 LLaMAIndex 这样的框架为我们提供了一种构建这些代理并连接到工具和 API 的简单方法。亚马逊最近推出了他们的 Bedrock 代理框架,它为设计代理提供了一个可视化界面。

在内部,代理遵循一种特殊的方式向 LLM 发送提示,使其生成一个行动计划。上述思维-行动-观察模式在一种称为 ReAct(推理和行动)的代理中很流行。其他类型的代理包括 MRKL 和计划与执行,它们主要在提示风格上有所不同。

对于更复杂的代理,行动可能与导致源系统发生变化的工具相关联。例如,我们可以将代理连接到一个工具,该工具检查假期余额并在 ERP 系统中为员工申请休假。现在我们可以构建一个很好的聊天机器人,它将与用户交互,并通过聊天命令在系统中申请休假。再也不需要复杂的界面来申请休假,只需要一个简单的统一聊天界面。听起来很激动人心!

注意事项和负责任的 AI 的必要性

现在,如果我们有一个工具,它使用预授权 API 调用股票交易。我们构建一个应用程序,其中代理研究股票变化(使用工具)并为我们做出买卖股票的决定。代理如果卖出错误的股票,因为它产生了幻觉并做出了错误的决定怎么办?由于 LLM 是巨大的模型,很难确定为什么它们做出某些决定,因此在没有适当的防护措施的情况下,幻觉很常见。

虽然代理非常迷人,但您可能已经猜到了它们可能有多么危险。如果它们产生幻觉并采取错误的行动,可能会导致巨大的经济损失或企业系统中的重大问题。因此,在 LLM 驱动的应用程序时代,负责任的 AI 正变得越来越重要。负责任的 AI 的原则,例如可重现性、透明度和问责制,试图为代理做出的决定设置防护措施,并建议进行风险分析,以决定哪些行动需要人工干预。随着更复杂的代理被设计出来,它们需要更多的审查、透明度和问责制,以确保我们知道他们在做什么。

结论

代理生成逻辑步骤路径和行动的能力使其非常接近人类的推理。赋予它们更强大的工具可以使其拥有超能力。像 ReAct 这样的模式试图模拟人类解决问题的方式,我们将看到更好的代理模式,这些模式将与特定的上下文和领域(银行、保险、医疗保健、工业等)相关。未来已经到来,代理背后的技术已经准备好供我们使用。同时,我们需要密切关注负责任的 AI 防护措施,以确保我们不会构建 Skynet!