Trí tuệ nhân tạo

Tạo Paraphrase Sử Dụng Học Luyện Lâu – Thought Leaders

Khi viết hoặc nói, chúng ta đã từng thắc mắc liệu có cách nào tốt hơn để truyền đạt một ý tưởng đến người khác. Từ nào nên sử dụng? Cấu trúc ý tưởng như thế nào? Họ sẽ phản ứng như thế nào? Tại Phrasee, chúng tôi dành nhiều thời gian để suy nghĩ về ngôn ngữ – những gì hoạt động và những gì không.

Hãy tưởng tượng bạn đang viết dòng tiêu đề cho một chiến dịch email sẽ được gửi đến 10 triệu người trong danh sách của bạn, quảng cáo 20% giảm giá cho một chiếc laptop mới.

Bạn sẽ chọn dòng nào:

- Bạn có thể giảm thêm 20% cho đơn hàng tiếp theo

- Chuẩn bị sẵn – giảm thêm 20%

Mặc dù chúng truyền đạt cùng một thông tin, nhưng một trong số chúng đã đạt được tỷ lệ mở cao hơn gần 15% so với cái còn lại (và tôi cá rằng bạn không thể đánh bại mô hình của chúng trong việc dự đoán cái nào ?). Mặc dù ngôn ngữ thường có thể được kiểm tra thông qua A/B testing hoặc multi-armed bandits, nhưng việc tạo paraphrase tự động vẫn là một vấn đề nghiên cứu đầy thách thức.

Hai câu được coi là paraphrase của nhau nếu chúng chia sẻ cùng một ý nghĩa và có thể được sử dụng thay thế cho nhau. Một điều quan trọng khác thường bị bỏ qua là liệu một câu được tạo bởi máy có hay không.

Không giống như học có giám sát, các tác nhân Học Luyện Lâu (RL) học thông qua tương tác với môi trường của chúng và quan sát phần thưởng mà chúng nhận được như một kết quả. Sự khác biệt tinh vi này có những ý nghĩa lớn về cách các thuật toán hoạt động và cách các mô hình được đào tạo. Deep Reinforcement Learning sử dụng mạng nơ-ron như một hàm xấp xỉ để cho phép tác nhân học cách vượt qua con người trong các môi trường phức tạp như Go, Atari, và StarCraft II.

Mặc dù thành công này, học luyện lâu chưa được áp dụng rộng rãi cho các vấn đề thực tế, bao gồm cả Xử lý Ngôn ngữ Tự nhiên (NLP).

Là một phần của luận văn thạc sĩ về Khoa học Dữ liệu của tôi, chúng tôi chứng minh cách Deep RL có thể được sử dụng để vượt qua các phương pháp học có giám sát trong việc tạo paraphrase tự động cho văn bản đầu vào. Vấn đề tạo paraphrase tốt nhất có thể được xem là tìm chuỗi từ mà tối đa hóa sự tương đồng ngữ nghĩa giữa các câu đồng thời duy trì tính lưu loát trong đầu ra. Các tác nhân RL rất phù hợp để tìm tập hợp các hành động tốt nhất để đạt được phần thưởng dự kiến tối đa trong các môi trường điều khiển.

Không giống như hầu hết các vấn đề trong học máy, vấn đề lớn nhất trong hầu hết các ứng dụng Tạo Ngôn ngữ Tự nhiên (NLG) không nằm ở mô hình mà nằm ở đánh giá. Mặc dù đánh giá của con người hiện được coi là tiêu chuẩn vàng trong đánh giá NLG, nhưng nó có những nhược điểm đáng kể, bao gồm tốn kém, mất thời gian, khó điều chỉnh và thiếu khả năng tái tạo trên các thí nghiệm và tập dữ liệu (Han, 2016). Do đó, các nhà nghiên cứu đã lâu tìm kiếm các thước đo tự động đơn giản, tổng quát và phản ánh đánh giá của con người (Papineni et al., 2002).

Các phương pháp đánh giá tự động phổ biến nhất trong việc đánh giá chú thích hình ảnh được tạo bởi máy được tóm tắt dưới đây với ưu và nhược điểm:

Tạo Paraphrase Sử Dụng Học Luyện Lâu

Chúng tôi đã phát triển một hệ thống tên là ParaPhrasee, tạo ra các paraphrase chất lượng cao. Hệ thống bao gồm nhiều bước để áp dụng học luyện lâu một cách hiệu quả về tính toán. Tóm tắt cấp cao của đường ống được hiển thị dưới đây với chi tiết hơn trong luận văn.

Tập Dữ Liệu

Có một số tập dữ liệu paraphrase có sẵn được sử dụng trong nghiên cứu, bao gồm: Microsoft Paraphrase corpus, Cuộc thi Tương Đồng Ngữ Nghĩa của ACL, Quora Duplicate Questions và Twitter Shared Links. Chúng tôi đã chọn MS-COCO vì kích thước, sự sạch sẽ và sử dụng nó làm điểm chuẩn cho hai bài báo tạo paraphrase đáng chú ý. MS-COCO chứa 120k hình ảnh của các cảnh thông thường với 5 chú thích hình ảnh cho mỗi hình ảnh được cung cấp bởi 5 người chú thích khác nhau.

Mặc dù nó chủ yếu được thiết kế cho nghiên cứu thị giác máy tính, nhưng các chú thích hình ảnh có xu hướng có sự tương đồng ngữ nghĩa cao và là các paraphrase thú vị. Vì các chú thích hình ảnh được cung cấp bởi những người khác nhau, chúng có xu hướng có sự khác biệt nhỏ về chi tiết được cung cấp trong cảnh, do đó các câu được tạo ra có xu hướng tưởng tượng ra các chi tiết.

Mô Hình Giám Sát

Mặc dù học luyện lâu đã được cải thiện đáng kể về hiệu quả mẫu, thời gian đào tạo và các phương pháp hay nhất, nhưng đào tạo các mô hình RL từ đầu vẫn còn chậm và không ổn định (Arulkumaran et al., 2017). Do đó, thay vì đào tạo từ đầu, chúng tôi trước tiên đào tạo một mô hình giám sát và sau đó tinh chỉnh nó bằng RL.

Chúng tôi sử dụng khuôn khổ mô hình Encoder-Decoder và đánh giá hiệu suất của một số mô hình giám sát cơ bản. Khi tinh chỉnh mô hình bằng RL, chúng tôi chỉ tinh chỉnh mạng giải mã và coi mạng mã hóa là tĩnh. Do đó, chúng tôi xem xét hai khuôn khổ chính:

- Đào tạo mô hình giám sát từ đầu bằng cách sử dụng mã hóa-giải mã tiêu chuẩn/vanilla với GRUs

- Sử dụng các mô hình nhúng câu được đào tạo trước cho mã hóa, bao gồm: nhúng từ được nhóm (GloVe), InferSent và BERT

Các mô hình giám sát có xu hướng hoạt động khá tương tự trên các mô hình với BERT và mã hóa-giải mã vanilla đạt được hiệu suất tốt nhất.

Mặc dù hiệu suất có xu hướng hợp lý, nhưng có ba nguồn lỗi phổ biến: lặp lại, tạo ra các mảnh câu và tưởng tượng. Đây là những vấn đề chính mà việc sử dụng RL nhằm giải quyết.

Mô Hình Học Luyện Lâu

Triển khai các thuật toán RL rất thách thức, đặc biệt là khi bạn không biết liệu vấn đề có thể được giải quyết hay không. Có thể có vấn đề trong việc triển khai môi trường của bạn, tác nhân của bạn, siêu tham số của bạn, hàm phần thưởng của bạn hoặc sự kết hợp của tất cả những điều trên! Những vấn đề này trở nên trầm trọng hơn khi thực hiện học luyện lâu sâu vì bạn có thêm sự phức tạp của việc gỡ lỗi mạng nơ-ron.

Giống như tất cả việc gỡ lỗi, điều quan trọng là bắt đầu từ đơn giản. Chúng tôi đã triển khai các biến thể của hai môi trường RL đồ chơi được hiểu rõ (CartPole và FrozenLake) để kiểm tra các thuật toán RL và tìm một chiến lược lặp lại để chuyển kiến thức từ mô hình giám sát.

Chúng tôi đã tìm thấy rằng việc sử dụng thuật toán Actor-Critic vượt trội so với REINFORCE trong các môi trường này. Về việc chuyển kiến thức sang mô hình actor-critic, chúng tôi đã tìm thấy rằng việc khởi tạo trọng số của diễn viên bằng mô hình giám sát được đào tạo và trước đào tạo nhà phê bình đã đạt được hiệu suất tốt nhất. Chúng tôi đã tìm thấy nó khó khăn để tổng quát hóa các phương pháp khuếch tán chính sách tinh vi sang các môi trường mới vì chúng giới thiệu nhiều siêu tham số mới đòi hỏi phải điều chỉnh để hoạt động.

Hỗ trợ bởi những thông tin này, chúng tôi sau đó phát triển một cách tiếp cận cho nhiệm vụ tạo paraphrase. Chúng tôi trước tiên cần tạo một môi trường.

Môi trường cho phép chúng tôi dễ dàng kiểm tra tác động của việc sử dụng các thước đo đánh giá khác nhau làm hàm phần thưởng.

Chúng tôi sau đó định nghĩa tác nhân, vì nó có nhiều lợi thế, chúng tôi sử dụng kiến trúc actor-critic. Diễn viên được sử dụng để chọn từ tiếp theo trong chuỗi và có trọng số của nó được khởi tạo bằng mô hình giám sát. Nhà phê bình cung cấp một ước tính về phần thưởng dự kiến mà một trạng thái có thể nhận được để giúp diễn viên học.

Thiết Kế Hàm Phần Thuở

Thành phần quan trọng nhất của việc thiết kế một hệ thống RL là hàm phần thưởng vì đây là điều mà tác nhân RL đang cố gắng tối ưu hóa. Nếu hàm phần thưởng không chính xác, thì kết quả sẽ bị ảnh hưởng ngay cả khi mọi phần khác của hệ thống hoạt động!

Một ví dụ kinh điển về điều này là CoastRunners nơi các nhà nghiên cứu của OpenAI đặt hàm phần thưởng là tối đa hóa điểm số tổng thể thay vì giành chiến thắng trong cuộc đua. Kết quả của điều này là tác nhân đã khám phá ra một vòng lặp nơi nó có thể nhận được điểm số cao nhất bằng cách kích hoạt tăng tốc mà không bao giờ hoàn thành cuộc đua.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Cho rằng việc đánh giá chất lượng của paraphrase là một vấn đề chưa được giải quyết, việc thiết kế một hàm phần thưởng tự động nắm bắt được mục tiêu này thậm chí còn khó hơn. Hầu hết các khía cạnh của ngôn ngữ không phân chia tốt thành các chỉ số tuyến tính và phụ thuộc vào nhiệm vụ (Novikova et al., 2017).

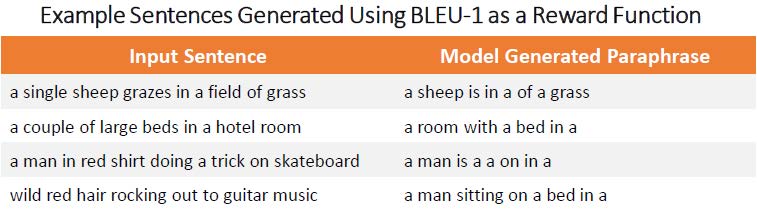

Tác nhân RL thường khám phá ra một chiến lược thú vị để tối đa hóa phần thưởng, khai thác các điểm yếu trong thước đo đánh giá thay vì tạo ra văn bản chất lượng cao. Điều này thường dẫn đến hiệu suất kém trên các chỉ số mà tác nhân không trực tiếp tối ưu hóa.

Chúng tôi xem xét ba cách tiếp cận chính:

- Độ Overlap Của Từ

Các chỉ số đánh giá NLP phổ biến coi xét tỷ lệ độ overlap của từ giữa paraphrase được tạo ra và câu đánh giá. Sự chồng chéo càng lớn, phần thưởng càng lớn. Thách thức với các cách tiếp cận cấp từ là tác nhân bao gồm quá nhiều từ kết nối như “a là trên của” và không có biện pháp về tính lưu loát. Điều này dẫn đến việc tạo ra các paraphrase chất lượng rất thấp.

- Tương Đồng Cấp Câu Và Tính Lưu Loát

Các thuộc tính chính của một paraphrase được tạo ra là nó phải lưu loát và tương đồng ngữ nghĩa với câu đầu vào. Do đó, chúng tôi cố gắng đánh giá riêng biệt và sau đó kết hợp các chỉ số. Đối với sự tương đồng ngữ nghĩa, chúng tôi sử dụng sự tương đồng cosine giữa các nhúng câu từ các mô hình được đào tạo trước như BERT. Đối với tính lưu loát, chúng tôi sử dụng một điểm số dựa trên tính bối rối của một câu từ GPT-2. Sự tương đồng cosine và điểm số lưu loát càng lớn, phần thưởng càng lớn.

Chúng tôi đã thử nhiều sự kết hợp khác nhau của các mô hình nhúng câu và mô hình lưu loát và mặc dù hiệu suất là hợp lý, nhưng vấn đề chính mà tác nhân gặp phải là không đủ để cân bằng sự tương đồng ngữ nghĩa với tính lưu loát. Đối với hầu hết các cấu hình, tác nhân ưu tiên tính lưu loát, dẫn đến việc loại bỏ chi tiết và hầu hết các thực thể được đặt “ở giữa” một thứ gì đó hoặc được di chuyển “trên một bàn” hoặc “bên đường”.

Học luyện lâu đa mục tiêu là một câu hỏi nghiên cứu mở và rất thách thức trong trường hợp này.

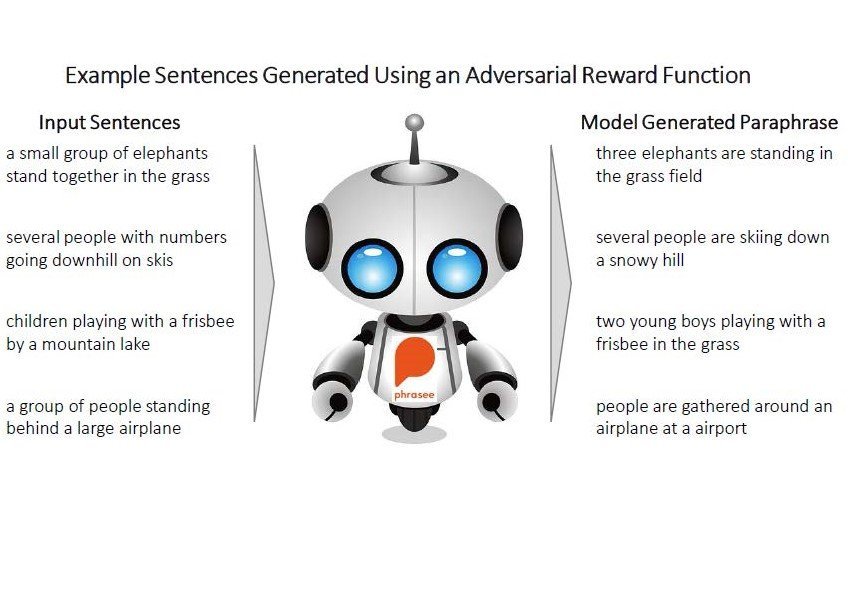

- Sử Dụng Mô Hình Đối Thủ Là Hàm Phần Thuở

Cho rằng con người được coi là tiêu chuẩn vàng trong đánh giá, chúng tôi đào tạo một mô hình riêng biệt gọi là mô hình phân biệt để dự đoán liệu hai câu có phải là paraphrase của nhau hay không (tương tự như cách một người đánh giá). Mục tiêu của mô hình RL sau đó là thuyết phục mô hình này rằng câu được tạo ra là một paraphrase của câu đầu vào. Mô hình phân biệt tạo ra một điểm số về khả năng hai câu có thể là paraphrase của nhau, được sử dụng làm phần thưởng để đào tạo tác nhân.

Mỗi 5.000 lần đoán, mô hình phân biệt được thông báo về paraphrase nào đến từ tập dữ liệu và paraphrase nào được tạo ra để nó có thể cải thiện các dự đoán trong tương lai. Quá trình này tiếp tục trong nhiều vòng với tác nhân cố gắng đánh lừa mô hình phân biệt và mô hình phân biệt cố gắng phân biệt giữa các paraphrase được tạo ra và các paraphrase đánh giá từ tập dữ liệu.

Sau nhiều vòng đào tạo, tác nhân tạo ra các paraphrase vượt trội so với các mô hình giám sát và các hàm phần thưởng khác.

Kết Luận Và Giới Hạn

Các phương pháp đối thủ (bao gồm tự chơi cho các trò chơi) cung cấp một cách tiếp cận rất hứa hẹn cho việc đào tạo các thuật toán RL để vượt qua hiệu suất của con người trên một số nhiệm vụ mà không cần định nghĩa một hàm phần thưởng rõ ràng.

Mặc dù RL đã có thể vượt qua học có giám sát trong trường hợp này, nhưng số lượng thêm về sự phức tạp trong mã, tính toán và phức tạp không đáng để đạt được lợi ích về hiệu suất cho hầu hết các ứng dụng. RL tốt nhất nên được dành cho những tình huống mà học có giám sát không thể được áp dụng dễ dàng và một hàm phần thưởng dễ dàng được định nghĩa (như các trò chơi Atari). Các cách tiếp cận và thuật toán trưởng thành hơn trong học có giám sát và tín hiệu lỗi mạnh hơn dẫn đến đào tạo nhanh hơn và ổn định hơn.

Một yếu tố khác cần xem xét là, giống như các cách tiếp cận nơ-ron khác, tác nhân có thể thất bại một cách đáng kể trong các trường hợp mà đầu vào khác với những gì nó đã từng thấy trước đó, đòi hỏi một lớp kiểm tra hợp lý bổ sung cho các ứng dụng sản xuất.

Sự bùng nổ của sự quan tâm đến các cách tiếp cận RL và tiến bộ trong cơ sở hạ tầng tính toán trong những năm gần đây sẽ mở ra những cơ hội lớn để áp dụng RL trong ngành công nghiệp, đặc biệt là trong NLP.