Góc nhìn Anderson

Xác định việc trộm cắp mô hình AI thông qua dữ liệu theo dõi bí mật

Một phương pháp mới có thể bí mật gắn watermark vào các mô hình tương tự như ChatGPT trong vài giây mà không cần đào tạo lại, không để lại dấu vết trong đầu ra chung và tồn tại sau tất cả các nỗ lực loại bỏ có thể.

Sự khác biệt tinh tế giữa watermarking và ‘bẫy bản quyền’ là rằng watermark – dù là rõ ràng hay ẩn – thường được thiết kế để xuất hiện trong suốt một bộ sưu tập (chẳng hạn như một tập dữ liệu hình ảnh) như một chướng ngại vật phổ biến đối với việc sao chép thông thường.

Ngược lại, một đoạn nhập là một đoạn văn bản nhỏ, thường là một từ hoặc định nghĩa được giới thiệu trong một bộ sưu tập lớn và tương đối chung chung, được thiết kế để chứng minh việc trộm cắp. Ý tưởng là khi toàn bộ công việc bị sao chép bất hợp pháp, либо là bản thân nó hoặc dưới dạng một công việc phái sinh, sự hiện diện của một ‘sự kiện duy nhất’ và giả mạo, được trồng bởi chủ sở hữu ban đầu, sẽ dễ dàng tiết lộ hành vi trộm cắp.

Về việc thêm watermark vào các mô hình ngôn ngữ lớn (LLM) và mô hình ngôn ngữ thị giác (VLM), mức độ mà đầu ra được thiết kế để chứa các dấu hiệu này thường được chia thành hai mục đích: để đảm bảo rằng tất cả hoặc hầu hết đầu ra chứa một watermark rõ ràng hoặc tiềm ẩn; hoặc để đảm bảo rằng một ‘token bí mật’ có thể được thu hồi, chứng minh việc trộm cắp – nhưng không xuất hiện trong đầu ra thông thường từ mô hình.

Trọng lượng của Bằng chứng

Phương pháp sau được đề cập trong một sự hợp tác thú vị giữa Trung Quốc, Ý và Singapore; một công việc nhằm cung cấp một phương pháp tiết lộ như vậy cho mô hình mã nguồn mở, để chúng không thể dễ dàng được thương mại hóa hoặc sử dụng theo những cách mà giấy phép gốc không cho phép.

Ví dụ, giấy phép gốc của mô hình có thể yêu cầu rằng bất kỳ ai cũng có thể lợi nhuận từ công việc miễn là họ thực hiện các sửa đổi hoặc sửa đổi của riêng họ công khai có sẵn theo cùng các điều khoản giấy phép hào phóng – nhưng một công ty có thể muốn kiểm soát ‘sửa đổi’ của họ (chẳng hạn như phiên bản tinh chỉnh), để tạo ra một hào nơi không có thực sự được phép.

Hầu hết nghiên cứu trong lĩnh vực này tập trung vào các quy trình phát hiện liên quan đến các mô hình chỉ có API, hoặc các mô hình mà chỉ có được tối ưu hóa (trọng lượng) có sẵn; và do đó, khó khăn hơn để chỉnh sửa và thay đổi theo cách đề xuất trong bài báo mới (vì không có quyền truy cập trực tiếp vào kiến trúc của mô hình).

Sự chú ý đến các bản phát hành FOSS là, có lẽ, không ngạc nhiên từ lĩnh vực nghiên cứu Trung Quốc, vì đầu ra AI của Trung Quốc trong năm qua đã được đánh dấu bởi các bản phát hành đầy đủ trọng lượng* của các mô hình ít nhất tương đương với các đối tác ‘khóa’ của phương Tây.

Phương pháp mới, có tên EditMark, phân biệt mình bằng cách không yêu cầu mô hình phải được tinh chỉnh để thêm ‘dữ liệu bị nhiễm độc’ hoặc được đào tạo từ đầu với dữ liệu bao gồm.

Điều này có một số lợi ích: một là bất kỳ ‘dữ liệu tiết lộ’ nào được bao gồm trong tập dữ liệu đào tạo, một khi được phát hiện và tiết lộ, sẽ không còn hiệu quả, vì nó có thể được nhắm mục tiêu trực tiếp bởi những kẻ tấn công; nhưng để tấn công EditMark, một kẻ tấn công sẽ cần biết lớp nào của mô hình để nhắm mục tiêu và loại tiếp cận nào đã được thực hiện. Đây là một kịch bản không thể xảy ra.

Thứ hai, phương pháp này nhanh và rẻ, chỉ mất vài giây (so với vài ngày hoặc thậm chí vài tuần) để áp dụng cho một mô hình đã được đào tạo, loại bỏ chi phí nghiêm trọng của việc tinh chỉnh (điều này tăng tuyến tính với kích thước của mô hình và dữ liệu được áp dụng).

Cuối cùng, phương pháp này gây ít tổn hại cho hoạt động bình thường của mô hình được nhắm mục tiêu so với việc tinh chỉnh hoặc các phương pháp chỉnh sửa trước đó.

Trong các thử nghiệm, EditMark – gắn các truy vấn toán học với nhiều câu trả lời có thể vào trọng lượng của mô hình – đạt được tỷ lệ trích xuất 100%.

Các tác giả tuyên bố:

‘Các thí nghiệm toàn diện chứng minh hiệu suất đặc biệt của EditMark trong việc gắn watermark vào các mô hình ngôn ngữ lớn. EditMark đạt được hiệu quả đáng chú ý bằng cách gắn một watermark 32 bit trong ít hơn 20 giây với tỷ lệ trích xuất watermark thành công 100% (ESR).

‘Đáng chú ý, thời gian gắn watermark ít hơn 1/300 so với việc tinh chỉnh (trung bình 6.875 giây), điều này nhấn mạnh hiệu quả của EditMark trong việc thực hiện các watermark có khả năng cao với tốc độ và độ tin cậy chưa từng có.

‘Ngoài ra, các thí nghiệm rộng rãi xác nhận sự mạnh mẽ, bí mật và trung thực của EditMark.’

Bài báo mới có tiêu đề EditMark: Gắn watermark vào các mô hình ngôn ngữ lớn dựa trên chỉnh sửa mô hình, và đến từ tám tác giả trên Đại học Khoa học và Công nghệ Trung Quốc, Đại học Siena và CFAR/IHPC/A*STAR tại Singapore.

Phương pháp

Phương pháp EditMark bao gồm bốn thành phần: một Trình tạo, một Trình mã hóa, một Trình chỉnh sửa và một Trình giải mã:

Dòng công việc EditMark gắn watermark bằng cách chỉnh sửa mô hình để trả lời các câu hỏi toán học cụ thể theo cách mã hóa thông tin nhận dạng ẩn. Nguồn: https://arxiv.org/pdf/2510.16367

Trình tạo sử dụng một hạt giống giả ngẫu nhiên để xây dựng các câu hỏi toán học có nhiều câu trả lời; Trình mã hóa chọn các câu trả lời dựa trên watermark, sau đó được gắn vào mô hình thông qua một quá trình chỉnh sửa chuyên dụng. Một khi mô hình đã chỉnh sửa được phát hành hoặc bị lạm dụng, watermark có thể được trích xuất bằng cách hỏi cùng các câu hỏi và giải mã mẫu phản hồi.

Sau đó, Trình chỉnh sửa sửa đổi trọng lượng của mô hình để khi được hỏi các câu hỏi này, mô hình sẽ đáng tin cậy sản xuất các câu trả lời mục tiêu, gắn watermark trực tiếp vào hành vi của nó. Trình giải mã sau đó thu hồi watermark bằng cách cho mô hình nghi ngờ cùng các câu hỏi và dịch các câu trả lời của nó trở lại thành chữ ký ẩn.

Mô hình đe dọa

Mô hình đe dọa của bài báo giả định rằng việc gắn watermark được thực hiện trong một môi trường trắng. Mặc dù điều này không phải là một dấu hiệu tốt trong nghiên cứu liên quan đến bảo mật, ở đây điều này là bình thường, vì phương pháp này nhằm bảo vệ các chủ sở hữu có quyền truy cập đầy đủ vào công việc của riêng họ.

Kẻ tấn công cũng được giả định có quyền truy cập trắng sau khi có được mô hình, có nghĩa là họ có thể sửa đổi nó (ví dụ: bằng cách cắt tỉa hoặc tinh chỉnh). Một lần nữa, kịch bản này là bình thường và được mong đợi trong trường hợp phát hành FOSS. Tuy nhiên, kẻ tấn công không được biết về quá trình trích xuất watermark hoặc sơ đồ được sử dụng, và chỉ có thể tìm thấy phương pháp này bằng suy luận và thí nghiệm (hoặc rò rỉ).

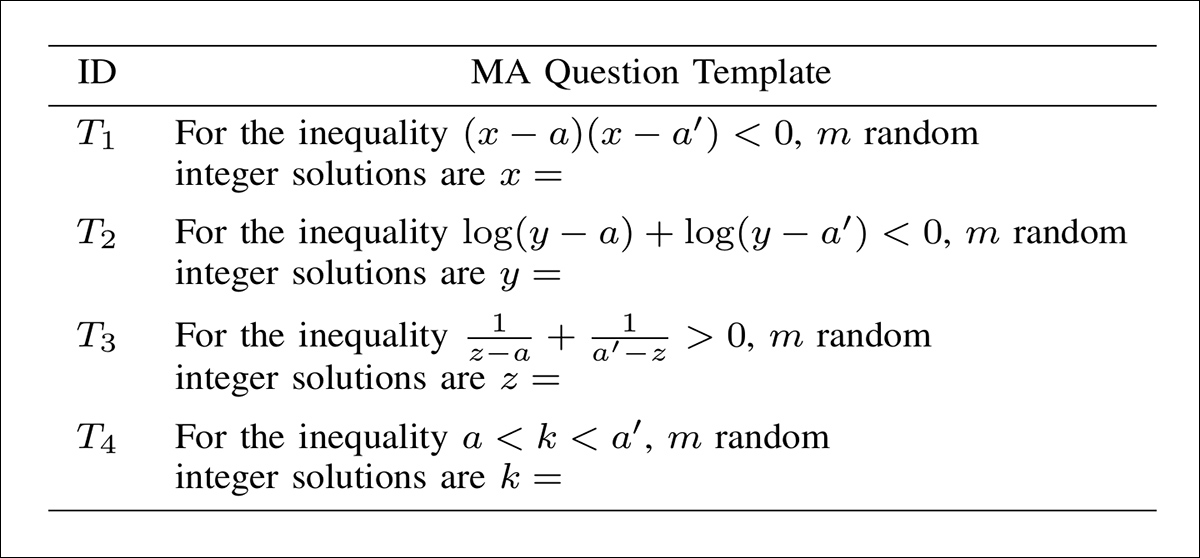

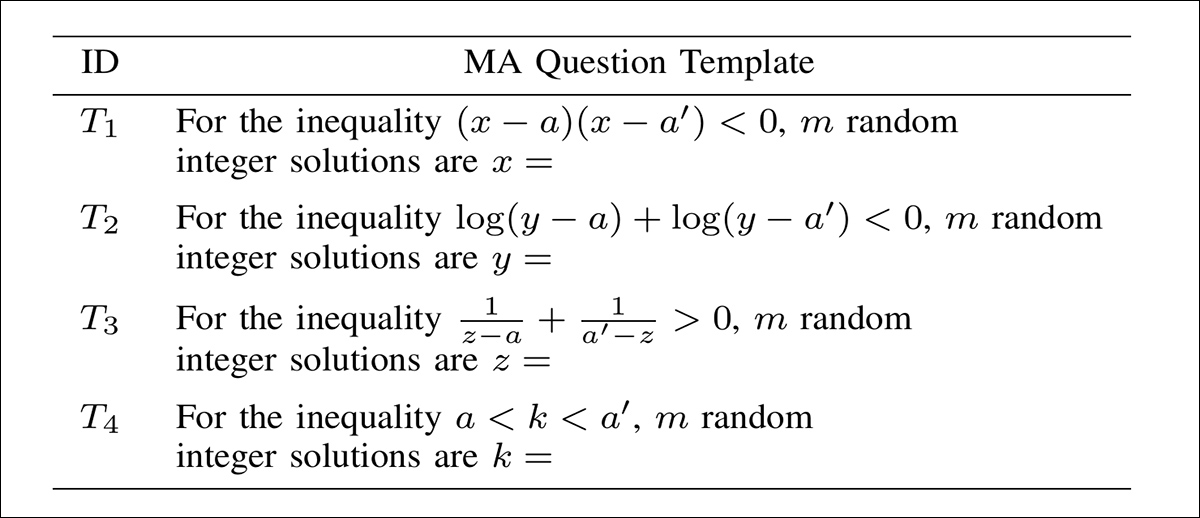

Trình tạo xây dựng các câu hỏi toán học hợp lý và hợp lệ với nhiều câu trả lời đúng, sử dụng GPT‑4o để đa dạng hóa các mẫu (như được minh họa dưới đây), và một hạt giống giả ngẫu nhiên để đảm bảo mỗi câu hỏi là duy nhất. Điều này cho phép một watermark đã biết được gắn định thông qua các phép đổi chỗ câu trả lời, trong khi tối thiểu hóa sự chồng lấp giữa các câu hỏi, để tránh sự gắn kết chỉnh sửa:

Mẫu câu hỏi được tạo bởi GPT‑4o để gắn watermark, mỗi mẫu được cấu trúc để cho ra nhiều câu trả lời hợp lệ từ một bất đẳng thức có hạt giống.

Trình mã hóa biến đổi mỗi phân đoạn watermark nhị phân thành một phép đổi chỗ duy nhất của các số nguyên được rút ra từ tập hợp giải pháp của một câu hỏi toán học nhất định. Sử dụng lý thuyết hoán vị từ điển, Trình mã hóa ánh xạ giá trị thập phân của mỗi đoạn watermark vào một lựa chọn câu trả lời có thứ tự cụ thể, đảm bảo rằng watermark được gắn định vào hành vi của mô hình.

Về Trình chỉnh sửa, phương pháp chỉnh sửa mô hình AlphaEdit ban đầu được sử dụng để gắn watermark thiếu cả độ chính xác và độ bền, với mô hình chỉnh sửa thường thất bại trong việc trả lại các câu trả lời yêu cầu. Bất kỳ thay đổi nào nó thực hiện đều dễ bị phá vỡ bởi việc cắt tỉa hoặc nhiễu.

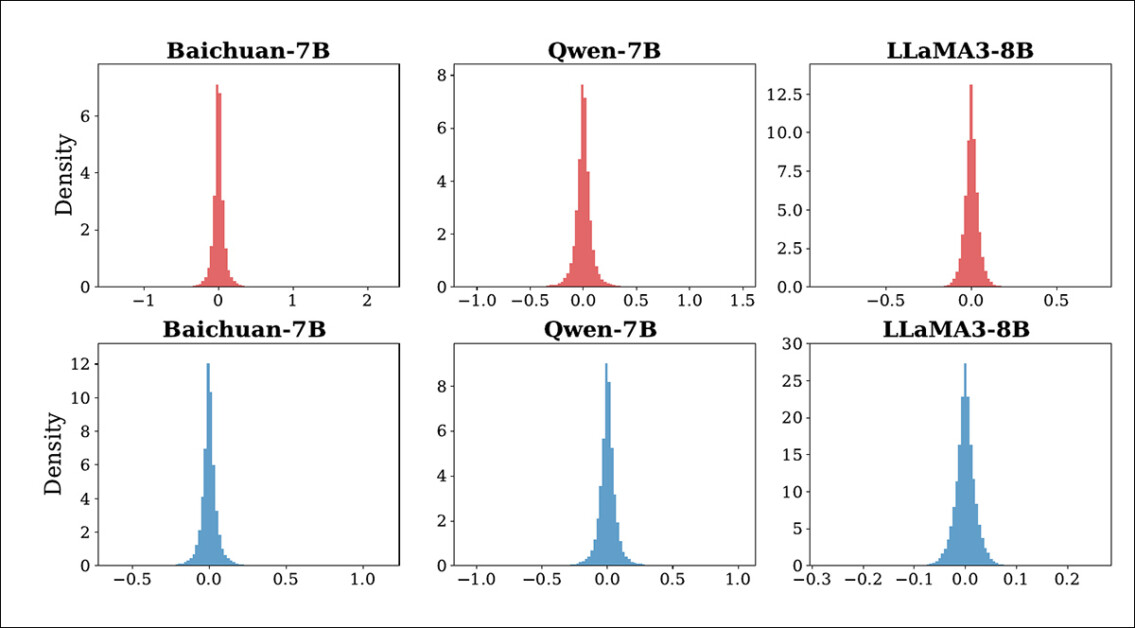

Để vượt qua điều này, các tác giả đã tạo ra một chiến lược chỉnh sửa đa vòng,逐渐 điều chỉnh trọng lượng của mô hình tại một lớp MLP duy nhất cho đến khi phản hồi của nó được căn chỉnh đủ với các câu trả lời mong muốn. Để làm cứng các chỉnh sửa chống lại sự phá hoại, họ cũng tiêm tiếng ồn Gaussian trong quá trình đào tạo, để mô phỏng các cuộc tấn công:

Phân phối các thay đổi trong K1 cho Baichuan-7B, Qwen-7B và LLaMA3-8B trước và sau các cuộc tấn công. Hàng trên cùng cho thấy hiệu ứng của việc tiêm tiếng ồn ngẫu nhiên; hàng dưới cùng cho thấy hiệu ứng của việc cắt tỉa mô hình. Tất cả các thay đổi vẫn gần bằng không, cho thấy rằng các cuộc tấn công không làm gián đoạn đáng kể hành vi nội bộ của mô hình.

Hệ thống chấm điểm dừng quá trình một khi các chỉnh sửa đủ chính xác, trong khi định chuẩn hóa đảm bảo các cập nhật vẫn ổn định trong nhiều vòng.

Trình giải mã hỏi mô hình cùng các câu hỏi đặc biệt được sử dụng trong quá trình gắn watermark, sau đó đọc các câu trả lời của nó để suy ra ID ẩn. Vì mẫu câu trả lời tuân theo một quy tắc bí mật, ID này có thể được thu hồi mà không cần phải kiểm tra các chi tiết của mô hình.

Dữ liệu và Thử nghiệm

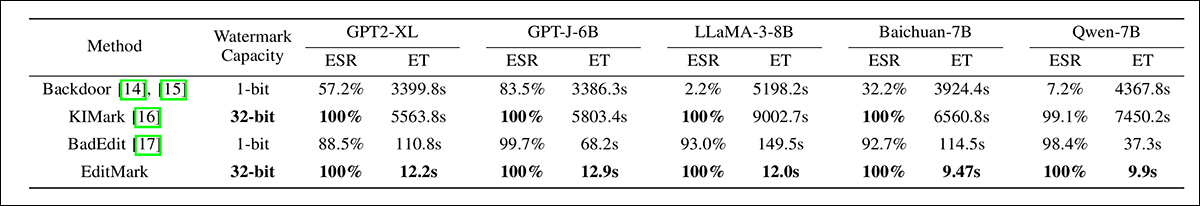

Để kiểm tra EditMark, năm mô hình ngôn ngữ lớn đã được đánh giá: GPT2-X; GPT-J-6B; LLaMA-3-8B; Baichuan-7B; và Qwen-7B. AlphaEdit đã được sử dụng để gắn watermark, trong khi tỷ lệ trích xuất thành công (ESR) và thời gian gắn watermark (ET) là các chỉ số được áp dụng.

Để so sánh, các tác giả đã chọn Model Watermark (cửa hậu); KIMark; và BadEdit, một khuôn khổ ban đầu được thiết kế cho việc tiêm cửa hậu, ở đây được điều chỉnh cho các mục đích của dự án.

Các tác giả đã chỉnh sửa lớp thứ 15 của LLaMA-3-8; lớp thứ 17 của GPT2-XL và GPT-J-6B; và lớp thứ 14 của Qwen-7B và Baichuan-7B.

Các thí nghiệm được thực hiện trên bốn GPU NVIDIA RTX 4090 (24GB VRAM mỗi chiếc), với các watermark 32 bit, 64 bit và 128 bit được gắn. Các mẫu câu hỏi được sử dụng được chi tiết trong hình ảnh dưới đây:

Mẫu câu hỏi được sử dụng để tạo câu hỏi có nhiều câu trả lời (MA) cho việc gắn watermark. Mỗi câu hỏi dựa trên một loại bất đẳng thức toán học khác nhau, với các giá trị ngẫu nhiên được chèn vào các biến. Mô hình được yêu cầu trả lại một danh sách các giải pháp nguyên, với thứ tự của các câu trả lời được sử dụng để mã hóa hoặc giải mã các bit watermark. Bốn mẫu bao gồm các hình thức bậc hai, lôgarit, hợp lý và khoảng cách, và tất cả đều được tạo ra thông qua GPT-4o.

Để giảm thiểu tác động của sự ngẫu nhiên, các hạt giống từ 1 đến 20 đã được áp dụng trong quá trình thử nghiệm, trên các dung lượng watermark khác nhau.

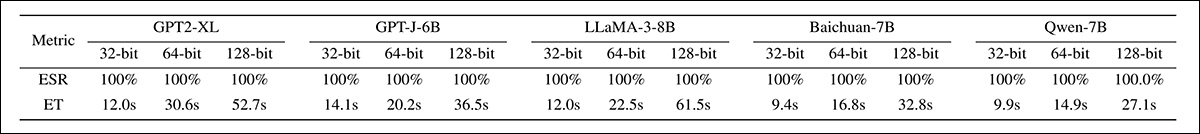

Ban đầu, các nhà nghiên cứu đã kiểm tra cả ESR và chi phí thời gian trong việc gắn watermark trên các mô hình ngôn ngữ lớn:

So sánh EditMark với ba phương pháp gắn watermark trước đó trên năm mô hình ngôn ngữ lớn. Báo cáo về tỷ lệ trích xuất thành công (ESR) và thời gian gắn watermark (ET) trong giây. EditMark đạt được tỷ lệ trích xuất thành công 100% trong khi giảm thời gian gắn watermark vài bậc, vượt trội so với tất cả các phương pháp so sánh về cả độ chính xác và hiệu quả trên các mô hình có kích thước và kiến trúc khác nhau.

Trong số những kết quả này, các tác giả tuyên bố:

‘[EditMark] đạt được tỷ lệ trích xuất thành công 100% và chỉ cần ít hơn 20 giây để gắn một watermark 32 bit cho tất cả các mô hình ngôn ngữ lớn được đánh giá. Cụ thể, thời gian gắn watermark trung bình cho Baichuan-7B và Qwen-7B là dưới 10 giây, điều này chứng tỏ hiệu quả cao của EditMark.’

Để đánh giá một watermark 128 bit, giá trị cao nhất có thể dưới một sơ đồ như vậy, EditMark đã duy trì trạng thái ‘bất khả xâm phạm’:

Tỷ lệ trích xuất thành công và thời gian gắn watermark cho EditMark trên các độ dài watermark 32, 64 và 128 bit trên năm mô hình ngôn ngữ. Tỷ lệ trích xuất thành công hoàn hảo được duy trì trong tất cả các trường hợp, trong khi thời gian gắn watermark tăng với kích thước watermark, nhưng vẫn dưới một phút, thậm chí ở 128 bit.

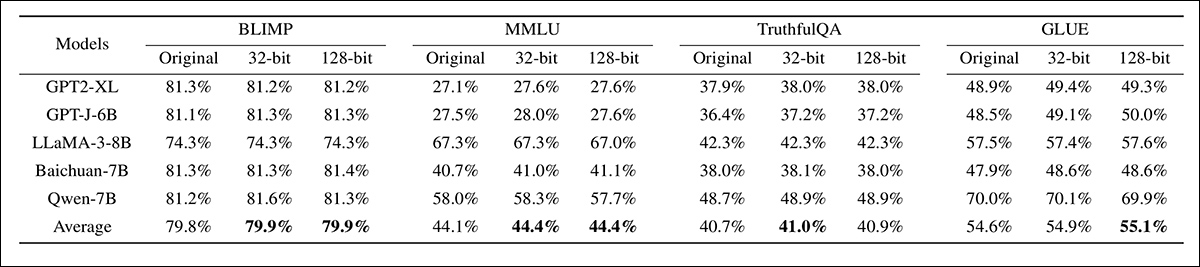

Tiếp theo, khả năng duy trì tính trung thực của watermark của hệ thống đã được kiểm tra trên nhiều tiêu chuẩn:

Đánh giá tính trung thực của watermark trên bốn tiêu chuẩn trên năm mô hình, so sánh các mô hình không sửa đổi với các mô hình được gắn watermark ở dung lượng 32 bit và 128 bit. Hiệu suất vẫn ổn định trên tất cả các cấu hình, với chỉ các dao động nhỏ trong điểm số trung bình, cho thấy tác động hạn chế đến độ chính xác của tiêu chuẩn từ việc chèn watermark.

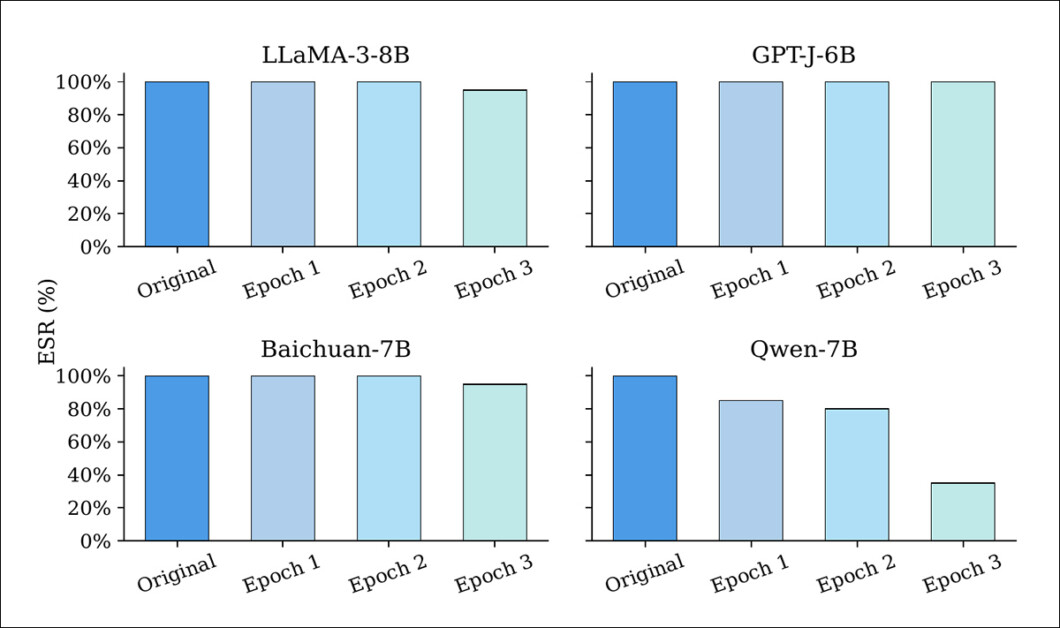

Khả năng chống chịu của EditMark đã được kiểm tra chống lại sáu chiến lược tấn công phổ biến. Các mô hình đầu tiên được gắn watermark 128 bit sử dụng năm hạt giống khác nhau. Việc tinh chỉnh, như được hiển thị trong hình ảnh dưới đây, chỉ gây ra sự suy giảm nhỏ trong tỷ lệ trích xuất thành công (ESR) cho hầu hết các mô hình:

Tỷ lệ trích xuất thành công của các mô hình ngôn ngữ lớn được gắn watermark trước và sau khi tinh chỉnh trong một đến ba kỷ. Mặc dù hầu hết các mô hình vẫn giữ được tỷ lệ trích xuất thành công cao trong suốt, Qwen-7B cho thấy sự suy giảm rõ rệt, cho thấy sự dễ bị tổn thương lớn hơn đối với các bản cập nhật tham số.

Thậm chí sau nhiều kỷ, hầu hết các mô hình vẫn giữ được tỷ lệ trích xuất thành công trên 90%, cho thấy rằng EditMark có khả năng chống lại sự trôi tham số được giới thiệu bởi đào tạo LoRA.

Các cuộc tấn công quantization làm giảm độ chính xác của mô hình, nhưng vẫn giữ lại hầu hết các watermark:

Tỷ lệ trích xuất thành công của các mô hình được gắn watermark trước và sau khi quantization sử dụng độ chính xác Int‑8 và Int‑4. Tỷ lệ trích xuất thành công vẫn không thay đổi dưới quantization Int‑8 trên tất cả các mô hình, trong khi quantization Int‑4 gây ra sự suy giảm một phần, cho thấy rằng độ chính xác thấp hơn có thể làm suy yếu, nhưng không thể loại bỏ hoàn toàn watermark.

Như có thể thấy trong hình ảnh trên, quantization Int-8 bảo tồn 100% tỷ lệ trích xuất thành công trên tất cả các mô hình, trong khi quantization Int-4 có tác động vừa phải đến tỷ lệ trích xuất thành công, nhưng giới thiệu những tổn thất về hiệu suất không thể chấp nhận được.

Mô hình này cho thấy tiềm năng hạn chế của một kẻ tấn công, vì điều này dẫn đến một mô hình bị tấn công nhưng hiệu suất bị suy giảm.

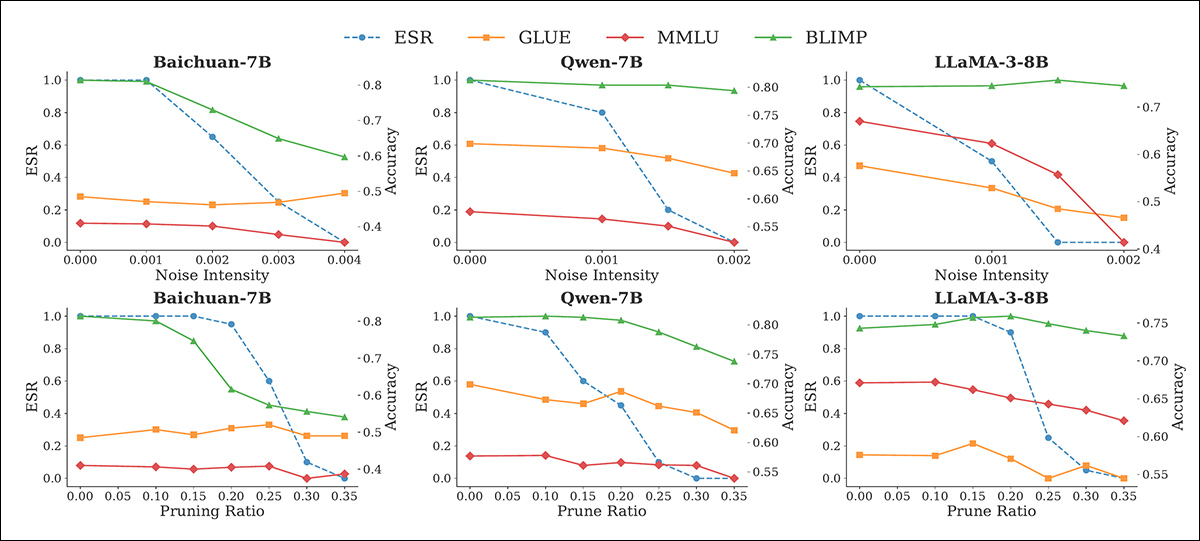

Thử nghiệm về tiếng ồn và cắt tỉa đã đánh giá bốn khuôn khổ tiêu chuẩn: MMLU; BLIMP; TruthfulQA; và GLUE. Những cuộc tấn công này dẫn đến sự suy giảm tỷ lệ trích xuất thành công (ESR) khi các can thiệp tăng cường:

Hiệu ứng của các cuộc tấn công tiếng ồn (hàng trên cùng) và cắt tỉa (hàng dưới cùng) đối với tỷ lệ trích xuất thành công (ESR) và hiệu suất của các mô hình được gắn watermark. Khi tỷ lệ trích xuất thành công giảm, độ chính xác của tiêu chuẩn cũng giảm, đặc biệt là ở các mức độ tiếng ồn và tỷ lệ cắt tỉa cao hơn, làm nổi bật sự căng thẳng (thông thường) giữa việc loại bỏ watermark và tính hữu ích của mô hình.

Tuy nhiên, các cuộc tấn công này cũng gây ra sự suy giảm rõ rệt về hiệu suất nhiệm vụ, với Baichuan-7B nhận được sự suy giảm 27-31% trên BLIMP khi tiếng ồn hoặc cắt tỉa được áp dụng.

Chỉnh sửa mô hình và các cuộc tấn công thích ứng cũng được đánh giá:

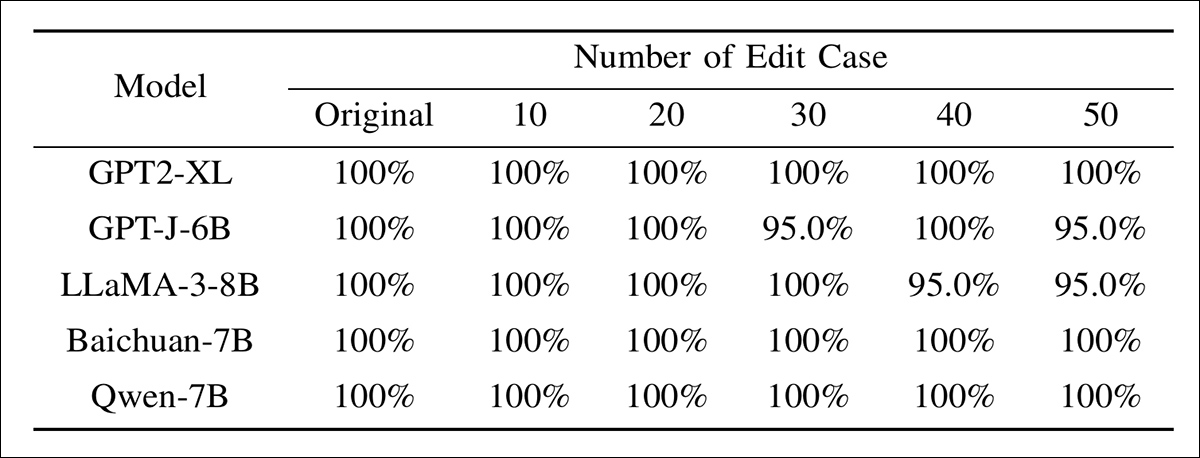

Tỷ lệ trích xuất thành công của các mô hình được gắn watermark khi phải đối mặt với các mức độ chỉnh sửa mô hình khác nhau. Thậm chí với tới 50 chỉnh sửa được áp dụng cho các lớp watermark đã biết, tỷ lệ trích xuất thành công vẫn trên 95% đối với tất cả các mô hình, cho thấy rằng các chỉnh sửa tham số trực tiếp có tác động hạn chế đến việc loại bỏ watermark.

Tại đây, EditMark duy trì trên 95% tỷ lệ trích xuất thành công, thậm chí khi các lớp watermark cụ thể được nhắm mục tiêu.

Kết luận

DRM, watermark bí mật và các phương pháp bảo mật khác đã từng có (một mức độ) thành công trong thời đại trước AI là khó áp dụng cho các hệ thống học máy; bản chất giảm thiểu chủ ý của các kiến trúc chủ nhà hiện tại kết hợp với sự thiếu hụt công cụ phù hợp, làm cho bất kỳ watermark nào được tiêm đều khá mong manh.

Điều này thật ấn tượng khi thấy một hệ thống nhắm vào phân phối mô hình mã nguồn mở và thấy nó tồn tại trước tất cả các kịch bản ngoại trừ những kịch bản không thể xảy ra nhất, về kiến thức trước của kẻ tấn công. Tuy nhiên, sự suy giảm hiệu suất nhỏ mà đi kèm với các chỉnh sửa sau đào tạo, mặc dù nhỏ trong các thí nghiệm này, có thể khiến những người có thể áp dụng nó phải suy nghĩ; không chỉ vì việc rút lui đến một mô hình kiểm soát dựa trên API sẽ loại bỏ các cuộc tấn công này gần như hoàn toàn.

* Trang web này đã cho rằng rằng ‘phát hành trọng lượng mở’ từ Trung Quốc không nhất thiết phải đủ điều kiện là mã nguồn mở hoàn toàn, vì dữ liệu thường bị giữ lại, điều này ngăn chặn việc tái tạo chính xác của đường ống đào tạo. Có lẽ chủ đề này mời gọi một cái nhìn sâu sắc hơn về chính trị của việc phát hành mô hình AI được so sánh trên phương Tây và phương Đông, điều này nằm ngoài phạm vi của bài viết này.

Được xuất bản lần đầu vào thứ Hai, ngày 27 tháng 10 năm 2025