Trí tuệ nhân tạo

Cải thiện hiệu suất học máy thông qua kỹ thuật thay đổi kích thước hình ảnh dựa trên CNN

Các nhà nghiên cứu tại Google Research đã đề xuất một phương pháp mới để cải thiện hiệu quả và độ chính xác của quy trình đào tạo thị giác máy tính dựa trên hình ảnh bằng cách cải thiện cách hình ảnh trong tập dữ liệu được thu nhỏ tại giai đoạn tiền xử lý.

Trong bài báo Học cách thay đổi kích thước hình ảnh cho các nhiệm vụ thị giác máy tính, các nhà nghiên cứu Hossein Talebi và Peyman Milanfar đã sử dụng một mạng nơ-ron tích chập (CNN) để tạo ra một kiến trúc thay đổi kích thước hình ảnh mới, mang lại sự cải thiện đáng kể trong kết quả nhận dạng trên bốn tập dữ liệu thị giác máy tính phổ biến.

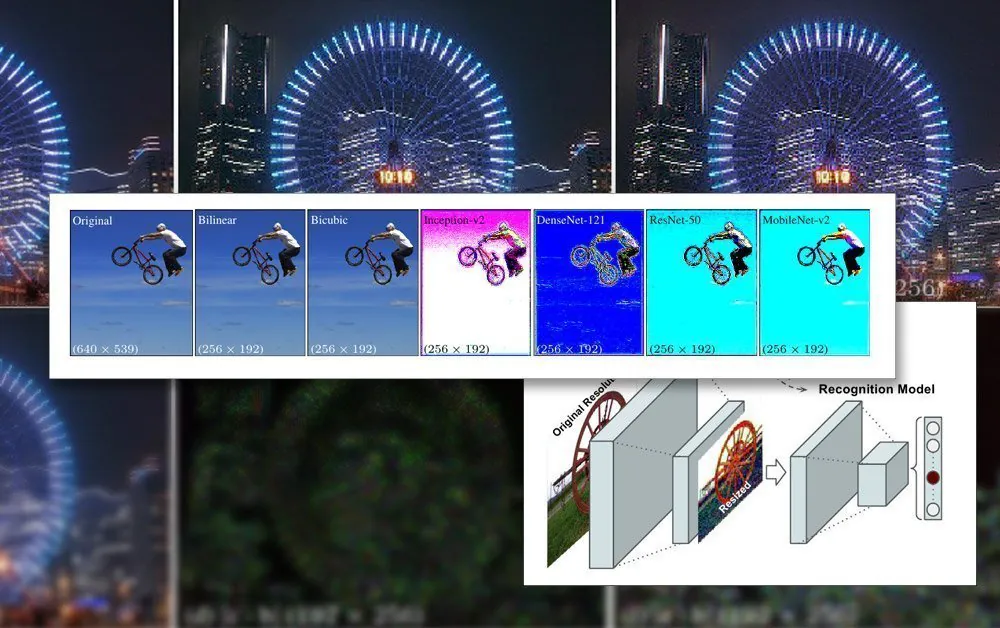

Khung khổ chung được đề xuất cho nhận dạng và thay đổi kích thước. Source: https://arxiv.org/pdf/2103.09950.pdf

Bài báo này nhận thấy rằng các phương pháp thay đổi kích thước hiện đang được sử dụng trong các đường ống học máy tự động đã lỗi thời hàng thập kỷ và thường chỉ sử dụng các phương pháp thay đổi kích thước cơ bản như bilinear, bicubic và nearest neighbor thay đổi kích thước – những phương pháp này xử lý tất cả các pixel một cách không phân biệt.

Ngược lại, phương pháp được đề xuất bổ sung dữ liệu hình ảnh thông qua một CNN và kết hợp đầu vào đó vào hình ảnh đã thay đổi kích thước sẽ đi qua kiến trúc của mô hình.

Giới hạn hình ảnh trong đào tạo AI

Để đào tạo một mô hình xử lý hình ảnh, một khung học máy sẽ bao gồm một giai đoạn tiền xử lý, nơi một loạt hình ảnh với các kích thước, không gian màu và độ phân giải khác nhau (sẽ góp phần tạo nên tập dữ liệu đào tạo) được cắt và thay đổi kích thước thành các kích thước nhất quán và định dạng ổn định.

Nói chung, điều này sẽ liên quan đến một số thỏa hiệp dựa trên định dạng PNG, nơi một sự cân bằng giữa thời gian xử lý/tài nguyên, kích thước tệp và chất lượng hình ảnh sẽ được thiết lập.

Trong hầu hết các trường hợp, kích thước cuối cùng của hình ảnh đã xử lý rất nhỏ. Dưới đây là một ví dụ về hình ảnh có độ phân giải 80×80, tại đó một số tập dữ liệu deepfakes đầu tiên được tạo ra:

Vì khuôn mặt (và các đối tượng khác) hiếm khi phù hợp với tỷ lệ khung hình vuông yêu cầu, các thanh đen có thể cần được thêm (hoặc không gian bị浪 phí) để đồng nhất hóa hình ảnh, giảm thêm dữ liệu hình ảnh thực sự có thể sử dụng:

Tại đây, khuôn mặt đã được trích xuất từ một khu vực hình ảnh lớn hơn cho đến khi nó được cắt nhỏ một cách tiết kiệm nhất có thể để bao gồm toàn bộ khu vực khuôn mặt. Tuy nhiên, như đã thấy ở bên phải, một lượng lớn khu vực còn lại sẽ không được sử dụng trong quá trình đào tạo, thêm trọng lượng lớn hơn vào tầm quan trọng của chất lượng hình ảnh của dữ liệu đã thay đổi kích thước.

Khi khả năng của GPU đã được cải thiện trong những năm gần đây, với thế hệ card mới của NVIDIA được trang bị lượng VRAM (bộ nhớ video ngẫu nhiên) ngày càng tăng, kích thước hình ảnh trung bình đang bắt đầu tăng, mặc dù 224×224 pixel vẫn là khá tiêu chuẩn (ví dụ, đó là kích thước của tập dữ liệu ResNet-50).

Một hình ảnh không được thay đổi kích thước 224×244 pixel.

Đổ bộ vào VRAM

Lý do tại sao hình ảnh phải có cùng kích thước là vì giảm gradient, phương pháp mà mô hình cải thiện theo thời gian, yêu cầu dữ liệu đào tạo thống nhất.

Lý do tại sao hình ảnh phải nhỏ như vậy là vì chúng phải được tải (đầy đủ giải nén) vào VRAM trong quá trình đào tạo thành các lô nhỏ, thường là từ 6-24 hình ảnh mỗi lô. Quá ít hình ảnh mỗi lô, và không có đủ vật liệu nhóm để tổng quát hóa tốt, ngoài việc kéo dài thời gian đào tạo; quá nhiều, và mô hình có thể không thể thu được các đặc điểm và chi tiết cần thiết (xem bên dưới).

Phần “tải trực tiếp” của kiến trúc đào tạo này được gọi là không gian tiềm ẩn. Đây là nơi các tính năng được trích xuất lặp lại từ cùng một dữ liệu (tức là cùng một hình ảnh) cho đến khi mô hình đã hội tụ đến một trạng thái mà nó đã có tất cả kiến thức tổng quát hóa cần thiết để thực hiện các phép biến đổi trên dữ liệu không nhìn thấy sau này của cùng một loại.

Quá trình này thường mất vài ngày, mặc dù nó có thể mất thậm chí một tháng hoặc hơn của quá trình suy nghĩ liên tục và không ngừng với khối lượng lớn 24/7 để đạt được sự tổng quát hóa hữu ích. Sự tăng lên của kích thước VRAM chỉ hữu ích đến một mức độ nhất định, vì ngay cả những sự gia tăng nhỏ về độ phân giải hình ảnh cũng có thể có ảnh hưởng đến khả năng xử lý, và các ảnh hưởng đến độ chính xác có thể không luôn thuận lợi.

Sử dụng khả năng VRAM lớn hơn để chứa các lô lớn hơn cũng là một điều phúc lợi hỗn hợp, vì tốc độ đào tạo lớn hơn có được từ điều này có khả năng bị bù lại bởi các kết quả kém chính xác hơn.

Do đó, vì kiến trúc đào tạo bị hạn chế như vậy, bất cứ điều gì có thể mang lại sự cải thiện trong các hạn chế hiện có của đường ống là một thành tựu đáng kể.

Làm thế nào để việc thu nhỏ vượt trội giúp đỡ

Chất lượng cuối cùng của một hình ảnh sẽ được bao gồm trong một tập dữ liệu đào tạo đã được chứng minh là có ảnh hưởng cải thiện đến kết quả đào tạo, đặc biệt là trong các nhiệm vụ nhận dạng đối tượng. Vào năm 2018, các nhà nghiên cứu từ Viện Max Planck về Hệ thống Thông minh cho rằng việc lựa chọn phương pháp lấy mẫu lại có ảnh hưởng đáng kể đến hiệu suất đào tạo và kết quả.

Ngoài ra, công việc trước đây của Google (đồng viết bởi các tác giả của bài báo mới) đã tìm thấy rằng độ chính xác phân loại có thể được cải thiện bằng cách giữ kiểm soát các hiện象 nén trong hình ảnh của tập dữ liệu.

Mô hình CNN được tích hợp vào bộ thay đổi kích thước mới kết hợp việc thay đổi kích thước bilinear với một tính năng “kết nối bỏ qua” có thể kết hợp đầu ra từ mạng đã được đào tạo vào hình ảnh đã thay đổi kích thước.

Không giống như một kiến trúc mã hóa/đ码 hóa điển hình, đề xuất mới có thể hoạt động không chỉ như một nút thắt trướcFeed, mà còn như một nút thắt ngược cho việc thay đổi kích thước lên đến bất kỳ kích thước mục tiêu và/hoặc tỷ lệ nào. Ngoài ra, phương pháp lấy mẫu lại “tiêu chuẩn” có thể được thay thế bằng bất kỳ phương pháp truyền thống nào khác, chẳng hạn như Lanczos.

Chi tiết tần số cao

Phương pháp mới tạo ra hình ảnh dường như “nướng” các tính năng chính (sẽ được quá trình đào tạo nhận ra cuối cùng) trực tiếp vào hình ảnh nguồn. Về mặt thẩm mỹ, kết quả không chính thống:

Phương pháp mới được áp dụng trên bốn mạng – Inception V2; DenseNet-121; ResNet-50; và MobileNet-V2. Kết quả của phương pháp thu nhỏ hình ảnh của Google Research tạo ra hình ảnh với sự tích tụ pixel rõ ràng, dự đoán các tính năng chính sẽ được phân biệt trong quá trình đào tạo.

Các nhà nghiên cứu lưu ý rằng những thí nghiệm ban đầu này được tối ưu hóa độc quyền cho các nhiệm vụ nhận dạng hình ảnh, và rằng trong các thử nghiệm, bộ “thay đổi kích thước đã học” của họ có thể đạt được tỷ lệ lỗi cải thiện trong các nhiệm vụ đó. Các nhà nghiên cứu dự định trong tương lai sẽ áp dụng phương pháp này cho các loại ứng dụng thị giác máy tính dựa trên hình ảnh khác.