Anderson’un Açısı

‘Olabilirlik’ sebagai Bir Derin Sahte Tespit Metriği Kullanımı

Eğer AI tarafından üretilen video ve ses đủ iyi olursa, geleneksel sinyallere dayalı derin sahte dedektörleri artık çalışmayacak. Ancak insanların öngörülebilir davranışlardan ne kadar nadir uzaklaştıklarını düşünürsek, belki de ‘olabilirlik’ bir video veya haber duyumunun doğru olma olasılığı olarak daha derin bir şekilde benimsenebilir.

Opinion 1990’ların başlarında, saygın eski İngiliz futbolcu ve TV spor yorumcusu David Icke bir sohbet programında kendisinin ‘Tanrının oğlu’ olduğunu açıkladı – bu beklenmedik ve tuhaf açıklama, sonraki on yıllarda sürekli ve elaborate komplo teorisi hakkında bir gizli ve güçlü küresel kabalenin ‘sürüngen insanlar’ olduğunu açıkladı.

İnternet benimsemesi masih birkaç yıl uzakta ve sosyal medyanın ortaya çıkması daha da uzaktaydı, bu nedenle Icke’nin ünlülüğü ile yeni fikirlerinin doğası arasındaki büyük uyumsuzluk, özellikle de bu büyük değişimin hiçbir bağlamı veya hazırlığı olmadan, İngiliz halkı üzerinde derin bir etkiye sahip oldu.

Yirmi yılı aşkın bir süre sonra, benzer ve çok daha karanlık bir toplumsal şok yaşandı, sevgili hayırsever ve çocuk TV sunucusu Jimmy Savile’nin sürekli ve açgözlü bir hayat boyu cinsel suçlu olduğu ve suçlarını işlemek için temiz kamu imajını kullandığı ortaya çıktı.

Sonraki Operation Yewtree polis soruşturması, birçok başka UK ünlüsünün cinsel suçlarla ilgili uzun geçmişlerini ortaya çıkaracaktı; daha sonra Harvey Weinstein’in yargılanması, benzer şekilde ABD’de ünlü cinsel suçluların keşfedilmesine yol açacaktı, bu da #metoo hareketine dönüşecekti ve The Morning Show gibi American kültürüne kalıcı olarak yer edinecekti. ‘Şok’ haberleri, sonunda derin sahte saldırganlar tarafından benimsenen yeni ve aniden bir şablon geliştirmeye başladı.

‘Geleneksel’ Derin Sahte Tespitinin Sonu?

Eğer sosyal medya ve AI 90’lı yıllarda olsaydı, dünyanın hiçbir öngörme sistemi Icke’nin sohbet programı açıklamalarını önceden göremezdi, ki ben de hatırladığım kadarıyla bu olay, önceki yıllarda hiçbir şekilde önceden haber verilmemişti.

Ama eğer AI olsaydı, belki de daha geniş bir kitleye Icke’nin açıklamalarının Google Veo 3 veya yeni nesil hyper-gerçek audio/video derin sahte çerçevelerinin ürünü olmadığına ikna etmek biraz zaman alacaktı.

Yalnızca son 6-12 ayda, AI derin sahte yöntemleri, medya kıyamet senaryolarını tentang derin sahte seçim müdahalesi hakkında yerine getirmeye yeterli hale geldi ve hızlı ve itibarını lekeleme yeteneğine sahip, ancak bir yandan da giderek daha çok inanan bir kültürde silinmesi zor olan bir üne sahip oldu.

Şu ana kadar, AI video çıkışı genellikle gerçekçilikten uzak, teknik engeller ve giderek artan bir şekilde, kısıtlayıcı Batı modelleri ile Çin’in sansürsüz açık kaynak yayınları arasındaki uçurum tarafından sınırlıdır**.

Bununla birlikte, araştırma literatüründe, örneğin yeni Performance Decay in Deepfake Detection† makalesinde, bu soğuk savaşın yaklaşmakta olan bir teslimiyetini gözlemliyorum:

‘[Biz] derin sahte videoların, onları gerçek videolardan güvenilir bir şekilde ayıran, makine tarafından öğrenilebilen özellikler içereceğini varsayıyoruz. Generatif AI’nin yetenekleri hızla ilerlemeye devam ettikçe, bu varsayım muhtemelen bozulacak.

‘Bu senaryoda, watermarking ve diğer provenance takip yöntemleri, dijital medyada güveni korumak için tek çare olacaktır.’

Ancak aynı makale, provenance tabanlı çözümlerin, örneğin Adobe liderliğindeki Content Authenticity Initiative (ve son 7-8 yılın daha küçük araştırma teklifleri) gerçekçi olmayan bir şekilde yaygın bir şekilde benimsenmesini gerektirdiğini kabul ediyor; ve makale, genel olarak geri çekilme, eğer değilse yenilgi notasıyla sona eriyor.

Eğer ses-görsel derin sahte tespit yöntemleri, generatif AI tarafından aşılırsa ve global olarak watermarking veya provenance şemasının benimsenmesi, çeşitli lojistik engeller nedeniyle gerçekçi değilse, hangi ortak merkezi özellik, potansiyel olarak sahte çıktının göstergesi olarak onların yerini alabilir? Ya da tüm medyanın şüpheli olduğu ve Yalancının Temettüsü hakim olduğu bir dünyaya kendimizi teslim etmek zorunda mıyız?

Bilgi Grafikleri

Görünüyor ki, ‘olabilirlik’ ve ‘inandırıcılık’ özelliklerini, ‘rapor edilen olaylar’ olarak daha derin bir şekilde derin sahte tespit sinyali olarak kullanma zamanı geldi.

Ayrıca, video ve ses generatif AI sistemlerinin giderek daha fazla birbirine yaklaştığı düşünülürse, ‘sahte haber’ (metin tabanlı bir anlatı olayı olarak) ve sahte görüntü/video araştırmalarının ayrı araştırma dallarının da benzer şekilde birbirine yaklaşma zamanı gelmiş olabilir.

Bir olabilirlik derin sahte metriği, RAG-yardımlı gerçeklik doğrulaması ile aynı değil, burada bir AI modeli, olayların kendi kesme tarihinden sonra meydana gelen olaylar hakkında bilgi edinmek için güncel web sonuçlarını getirebilir ve/veya iddialarını doğrulamak için.

Bunun yerine, genel olarak belirtici istatistiksel eğilimlere dayalı tahminler gerçekleştirecektir, bu eğilimlerin tarihsel kalıplardan elde edildiği ve mevcut bir sorguya uydurulduğu düşünülür.

Bu sentido, bir olasılık yöntemi, daha modern makine öğrenimi sahnesindeki diğer yaklaşımlardan daha çok istatistiksel analizye yakındır.

Önceki olarak, daha modern Transformers-dönemi yaklaşımıyla gölgede bırakılmış olan bilgi grafikleri, Enterprise alanında bir tür geri dönüş yapıyor gibi görünüyor ve ‘olabilirlik’ metriklerinin derin sahte tespit中的 potansiyel dağıtımına uygun görünüyor.

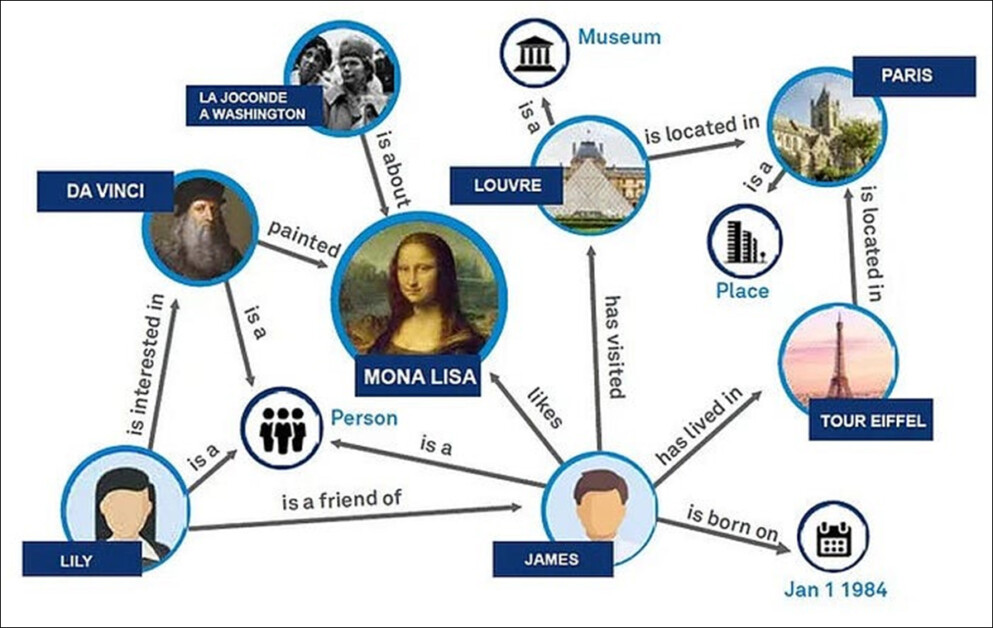

İnsanların, yerlerin, sanat eserlerinin ve olayların etiketli ilişkiler yoluyla nasıl bağlandığını gösteren basitleştirilmiş bir bilgi grafiği görünümü, makinelerin gerçek dünya varlıkları ve bağlantıları üzerinde akıl yürütmesini sağlar. Kaynak

Bir bilgi grafiği, gerçek dünya şeylerini, zoals insanlar, şirketler, olaylar veya fikirleri, bağlı gerçekler ağı olarak organize etmenin bir yoludur.

Her alt-varlık bir düğüm, ve aralarındaki bağlantılar (kenarlar) nasıl ilişkili olduklarını açıklar. Örneğin, ‘Microsoft’ (bir düğüm) ‘OpenAI’ (başka bir düğüm) ile ‘müştür’ kenarı ile bağlantılı olabilir. Bu bağlantılar genellikle grafik veritabanlarında depolanır ve özne-özne-nesne yapısını takip eder, zoals ‘Microsoft OpenAI’nin müşterisidir’.

Kalıcı Bellek

Bu çalışmanın en yakın olanı, muhtemelen benim karşılaştığım, bir ‘bilgilendirilmiş’ ve tarih-farkında yaklaşım, yeni medya çıktısının değerlendirilmesi ve doğrulanmasına yönelik Çin çalışması olabilir.

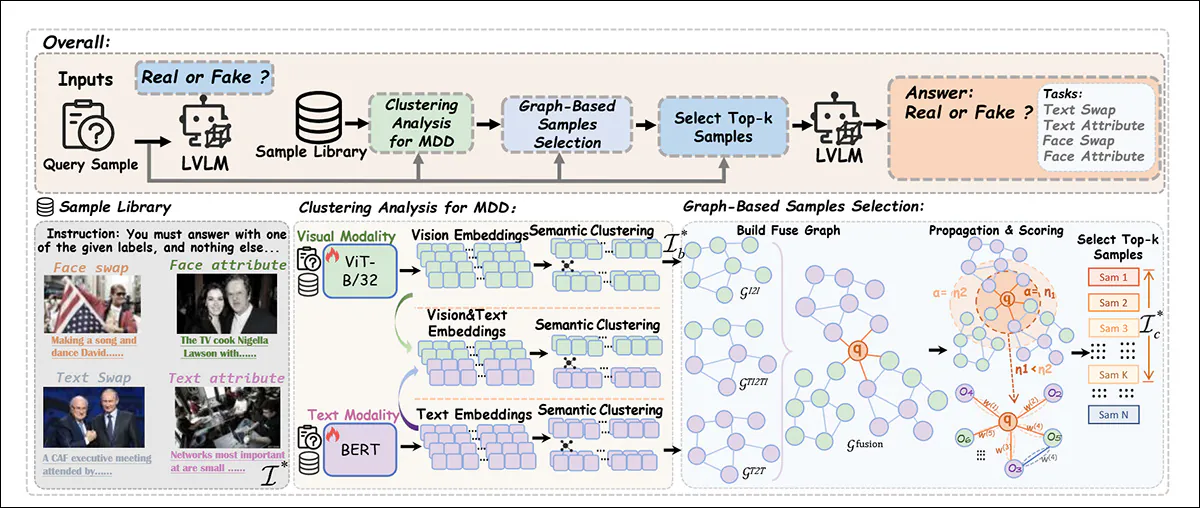

Bu sistem, grafik tabanlı akıl yürütme kullanarak, çok modlu derin sahtelerde ince tutarsızlıkları tespit etmek için eğitim gerektirmeyen bir yöntem öneriyor.

Yeni eğitim veya büyük modellerin ince ayarlanması yerine, sistem, görüntü-metin çiftlerini alır, bir benzerlik grafiği oluşturur ve bağlantıları puanlar, böylece en ilgili örnekleri alır ve modelin yargısını, yeni eğitim gerektirmeksizin yönlendirir:

GASP-ICL çerçevesinin bir görünümü, derin sahte tespitini, grafik tabanlı örnek seçimini bağlam içi öğrenme ile birleştirerek geliştirir, böylece dondurulmuş bir görme-dil modeli, görüntü/metin çiftlerini gerçek veya sahte olarak sınıflandırabilir, eğitim veya ince ayar gerektirmeden. Kaynak

Bu, büyük olasılıkla, benim karşılaştığım, bir ‘bilgilendirilmiş’ ve tarih-farkında yaklaşım, yeni medya çıktısının değerlendirilmesi ve doğrulanmasına yönelik en yakın çalışma.

Özellik Sızıntısı

Bu tür bir öngörme sisteminin zorluğu, tam performans için gerekli olabilecek gözetim kapsamının büyüklüğü – en azından, ünlüler ve kamu figürleri dışında, zaten serbestçe erişilebilen veriler mevcut olanlar.

Muhtemelen, mevcut en benzer araştırma, suç öncesi alanıdır, bu alan çeşitli çok modlu istihbarat sinyallerini ‘şüpheli’ olarak etiketler ve Person of Interest (2011-2016) ve Minority Report (2002) gibi Person of Interest-style bir AI korkuluk olarak kendini sunar.

Bir Person of Interest-style tümleşik gözetim sistemi optimal sonuçlar üretecekti, ancak şu anda Batı kültürünün, Çin’in vatandaşlarına uyguladığı düzeyde kişisel müdahaleyi onaylayabileceği şüpheli.

Dolayısıyla, non-ünlüler hakkında potansiyel sahte haberler için, yalnızca hükümet kurumları, zoals polis (ve ayrıca doğum ve ölüm kayıtları ve vergi daireleri), bir grafik tabanlı iş akışında olasılıkları bilgilendirmek için yeterli ilgili tarihsel bilgiye sahip olacaklar; ve onlar da, analizlerine ve değerlendirmelerine ortalama vatandaşları dahil etmek için, CCCP-stil irade, kapasite, yasama ve kaynaklara ihtiyaç duyacaklar (yani, sadece basit ancak zorunlu veri noktaları zoals pasaport numaraları ve araba kayıtları).

Olasılık Puanlaması

Görünüyor ki, böyle bir sistemin potansiyel etkinliği, derin sahte içeriği için en açık (mevcut) kullanım durumlarına sınırlı kalacaktır: kararsızlık (devlet destekli derin sahteler); ünlü ve ‘bilinmeyen’ pornografik derin sahteler (her ikisi de kötü niyetli olarak kabul edilebilir, ancak ikinci durum daha derin medya endişesi çekiyor); sahtekarlık (including ses/görsel derin sahteler designed to perform ‘impersonasyon soygunları’); ve siyasi karakter suikastı.

Bir bilgi tabanlı sistem, çeşitli olası olaylar için olasılık puanlaması ölçeğine ihtiyaç duyacaktır. Bir uçta, insanlardaki yaygın zayıflıklar zoals şüpheli mali yönetim, sadakatsizlik, bağımlılık, düşüncesizlik, vb.; diğer uçta… canlı bir TV sohbet programında Tanrı’nın oğlu olduğunu açıklamak (veya benzer ölçekte ve etkiye sahip olaylar).

Hatta bu sonuncu durumda, herhangi bir bireyin kişisel tarihsel faktörleri, olasılık sonucunu ağırlıklayacaktır: kamuoyunda tartışmalı konularda (örneğin, 1960’lar/70’ler ay inişlerinin gerçekliği) sermaye kazanmak için kamuoyunu yanıltan bir siyasi figür, doğrulama rutinlerinde daha muhafazakar meslektaşlarına kıyasla daha fazla ‘joker’ statüsü kazanacaktır.

Ünlü pornografisi durumunda, yeterli gerçek dünya bağlamı (yani, 2012 ünlülerin fotoğraf sızıntıları, diğerleri arasında – oldukça nadir – olaylar) moderate bir Yalancının Temettüsü üretmek için mevcut; ancak bu tür olayların istisnalar olarak işletildiği ve kuralı kanıtladığı için, mevcut ünlülerin çoğu pornografik video derin sahteleri çok ‘olaylı’ olarak kabul edilecektir (ancak bu, insanların kimliklerinin bu amaçlar için gasp edilmesine ilişkin sorunu çözmez).

Ulusal bozulma açısından, olasılıklarını değerlendirmek için istatistiksel verilerin önemli bir zenginliği mevcuttur. Eski tarihlerde, görünüşte ‘aniden’ olaylar zoals 79’da Vesuvius volkanının patlaması, eğer dikkat etmiş olsaydınız önceden haber verilmişti; ve hükümet ve sivil toplum kuruluşları tarafından sağlanan çeşitli beslemelerin yanı sıra, AI’nın yapısal olmayan veriden yapı çıkarma yeteneği, olasılık puanlaması için ek tarihsel bağlam sağlayabilir.

Sonuç

Hatta iyi uygulamalı bir öngörme sistemi, rastgele şansı, tanrısal işleri, tuhaf olayları veya tüm gözetimden uzak, kötü niyetli olayları hesaba katamaz.

Ayrıca, non-ünlüler için de kapsama sahip olmak amacıyla gerekli olan veri hacmi ve derinliği, siyasi bir engel olacaktır – en azından şimdilik.

Ancak seçenekler daralıyor gibi görünüyor; görme tabanlı analiz, gelişmiş generatif AI’ye karşı başarısızlığa mahkum görünüyor, doğrulama ve provenance şemaları teknik borç ve benimseme sürtünmesi taşıyor. Bu, Unite.AI, Content Authenticity Initiative ve Metaphysic Pro gibi çözümlerinin benimsenmesini zorlaştırıyor.

En geniş kullanımı ile, RAG tabanlı sistemler, yalnızca bir iddianın arkasındaki yetkili bir kaynağı belirleyebilir; ve birçok büyük (gerçek) haber hikayeleri, önceden bağlam olmadan ortaya çıktığı için, yetkili kaynaklardan bir eksiklik anlamlı değildir.

Değerleri, daha geniş bir veri ekosisteminin parçası olarak, AI’nin zor bulduğu şey – tarihsel bağlam – ile ilgili olabilir.