Anderson'ın Açısı

Daha Küçük Deepfake'ler Daha Büyük Tehdit Olabilir

ChatGPT ve Google Gemini gibi konuşma AI araçları artık yüzleri değiştirmeyen ancak daha incelikli yollarla tüm hikayeyi bir görüntünün içinde yeniden yazabilen deepfake'ler oluşturmak için kullanılıyor. Jestleri, sahneleri ve arka planları değiştirerek, bu düzenlemeler hem AI dedektörlerini hem de insanları kandırıyor ve çevrimiçi olarak neyin gerçek olduğunu tespit etme çıtasını yükseltiyor.

Mevcut iklimde, özellikle de önemli mevzuatların ardından, İndir onu Çoğumuz deepfake'leri ve AI destekli kimlik sentezini, genel olarak rızaya dayanmayan AI pornosu ve politik manipülasyonla ilişkilendiriyoruz. brüt gerçeğin çarpıtılması.

Bu durum, yapay zeka tarafından düzenlenen görsellerin her zaman yüksek riskli içeriklerde kullanılacağını ve en azından kısa vadede, görselleştirme kalitesinin ve bağlamın manipülasyonunun güvenilirlik açısından bir darbe vurmayı başarabileceğini beklememizi sağlıyor.

Ancak tarihsel olarak, çok daha incelikli değişikliklerin çoğu zaman daha uğursuz ve kalıcı bir etkisi olmuştur; örneğin Stalin'in bunları kaldır George Orwell romanında hicvedildiği gibi, fotoğrafik kayıtlardan gözden düşenler Bin dokuz Yüz Seksen Dört, başkahraman Winston Smith'in günlerini tarihi yeniden yazarak, fotoğraflar yaratıp yok ettirerek ve 'düzelterek' geçirdiği yer.

Aşağıdaki örnekte, sorun şu şekildedir: ikinci Resimde, 'bilmediğimizi bilmediğimiz' görülüyor; Stalin'in gizli polisinin eski şefi Nikolay Yezhov, şimdi sadece bir güvenlik bariyerinin bulunduğu yerde bulunuyordu:

İşte onu görüyorsunuz, işte o... buhar. Stalin dönemindeki fotoğraf manipülasyonu, itibarsızlaşmış bir parti üyesini tarihten siliyor. Kaynak: Kamu malı, https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Bu tür akımlar, sık sık tekrarlanır, birçok şekilde devam eder; yalnızca kültürel olarak değil, aynı zamanda eğitim veri kümelerindeki istatistiksel olarak baskın temalardan ve motiflerden eğilimleri türeten bilgisayarlı görmenin kendisinde de. Bir örnek vermek gerekirse, akıllı telefonların giriş engelini düşürmüş olması ve kitlesel Fotoğrafçılığın maliyetinin düşmesi, ikonografilerinin kaçınılmaz olarak birçok soyut kavramla ilişkilendirildiği anlamına geliyor. bu uygun olmasa bile.

Geleneksel deepfake'ler bir 'saldırı' eylemi olarak algılanabiliyorsa, görsel-işitsel medyadaki kötü niyetli ve sürekli küçük değişiklikler 'gaslighting'e daha çok benzemektedir. Ayrıca, bu tür deepfake'lerin fark edilmeme kapasitesi, (büyük değişiklikleri arayan) son teknoloji deepfake tespit sistemleri aracılığıyla tespit edilmesini zorlaştırmaktadır. Bu yaklaşım, bir kafaya atılan taştan ziyade, suyun uzun süre boyunca kayayı aşındırmasına daha çok benzemektedir.

ÇokluSahteVerse

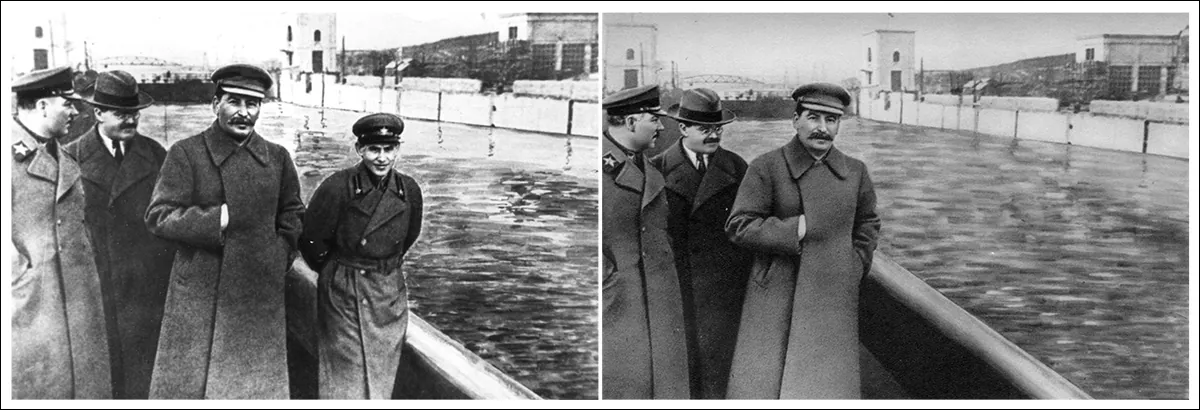

Avustralyalı araştırmacılar, literatürde 'gizli' deepfake'e yönelik ilgi eksikliğini gidermek için, öznenin temel kimliğini değiştirmeden bağlamı, duyguyu ve anlatıyı değiştiren kişi merkezli görüntü manipülasyonlarından oluşan önemli bir yeni veri seti oluşturdular:

Yeni koleksiyondan örneklenen gerçek/sahte çiftler, bazı değişiklikler diğerlerinden daha incelikli. Örneğin, sağ alt köşedeki Asyalı kadının doktorunun stetoskopu yapay zeka tarafından çıkarıldığı için otoritesinin kaybolmasına dikkat edin. Aynı zamanda, doktorun not defterinin panoyla değiştirilmesinin belirgin bir anlamsal yönü yok.Kaynak: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Başlıklı ÇokluSahteVersekoleksiyon, görsel dil modelleri (VLM'ler) aracılığıyla oluşturulan 845,826 görüntüden oluşuyor ve bunlar çevrimiçi erişildi ve indirildi, izinle.

Yazarlar şunları belirtiyor:

'VLM odaklı bu yaklaşım, mevcut veri kümelerinde yaygın olan sentetik veya düşük seviyeli kimlik değişimleri ve bölgeye özgü düzenlemeler yerine eylemleri, sahneleri ve insan-nesne etkileşimlerini değiştirmek gibi anlamsal, bağlam farkında değişikliklere olanak tanır.

'Deneylerimiz, mevcut en son teknoloji deepfake tespit modellerinin ve insan gözlemcilerin bu incelikli ama anlamlı manipülasyonları tespit etmekte zorlandığını ortaya koyuyor.'

Araştırmacılar, bu ince manipülasyonların ne kadar iyi tespit edilebileceğini görmek için yeni veri setlerinde hem insanları hem de önde gelen deepfake tespit sistemlerini test ettiler. İnsan katılımcılar zorluk çekti, görüntüleri gerçek veya sahte olarak doğru şekilde sınıflandırmada yalnızca yaklaşık %62 oranında başarılı oldular ve görüntünün hangi kısımlarının değiştirildiğini belirlemede daha da büyük zorluk yaşadılar.

Çoğunlukla daha belirgin yüz değiştirme veya boyama veri kümeleri üzerinde eğitilen mevcut deepfake dedektörleri de kötü performans gösterdi ve genellikle herhangi bir manipülasyonun gerçekleştiğini kaydetmede başarısız oldu. ince ayar MultiFakeVerse'te tespit oranları düşük kaldı ve bu durum, mevcut sistemlerin bu incelikli, anlatı odaklı düzenlemeleri ne kadar kötü işlediğini ortaya koydu.

MKS yeni kağıt başlıklı Deepfake'ler Aracılığıyla Çoklu Evren: Kişi Merkezli Görsel ve Kavramsal Manipülasyonların MultiFakeVerse Veri Kümesive Melbourne'deki Monash Üniversitesi ve Perth'deki Curtin Üniversitesi'ndeki beş araştırmacıdan geliyor. Kod ve ilgili veriler yayımlandı GitHub'da, daha önce bahsedilen Hugging Face barındırma hizmetine ek olarak.

Yöntem

MultiFakeVerse veri seti, farklı durumlardaki insanları içeren dört gerçek dünya görüntü setinden oluşturuldu: DUYGUSAL; BALIK, PIPA, ve PIC 2.0Araştırmacılar 86,952 orijinal görüntüyle başlayarak 758,041 adet düzenlenmiş versiyon ürettiler.

MKS İkizler-2.0-Flaş ve SohbetGPT-4o Her görüntü için altı adet minimal düzenleme önermek için çerçeveler kullanıldı; bu düzenlemeler, görüntüdeki en belirgin kişinin izleyici tarafından nasıl algılanacağını gizlice değiştirmek için tasarlandı.

Modellere, konuyu daha gerçekçi gösterecek değişiklikler yapmaları talimatı verildi. saf, gururlu, pişmanlık duyan, deneyimsizya da soğukkanlıveya sahne içindeki bazı gerçek unsurları ayarlamak için. Her düzenlemeyle birlikte, modeller ayrıca bir atıfta bulunan ifade Değişikliğin hedefini açıkça belirlemek, daha sonraki düzenleme sürecinin her görüntüdeki doğru kişiye veya nesneye değişiklik uygulayabilmesini sağlamak.

Yazarlar açıklıyor:

'Dikkat atıfta bulunan ifade toplulukta geniş bir şekilde araştırılmış bir alandır, bir görüntüdeki hedefi belirsizleştirebilen bir ifade anlamına gelir, örneğin bir masada oturan iki adamın olduğu, birinin telefonda konuştuğu, diğerinin de belgelere baktığı bir görüntü için, ikincisinin uygun bir atıfta bulunma ifadesi şöyle olabilir Soldaki adam bir kağıt parçası tutuyor. '

Düzenlemeler tanımlandıktan sonra, gerçek görüntü düzenlemesi, sahnenin geri kalanını olduğu gibi bırakarak, görsel dil modellerinin belirtilen değişiklikleri uygulaması istenerek gerçekleştirildi. Araştırmacılar bu görev için üç sistemi test etti: GPT-Görüntü-1; Gemini-2.0-Flaş-Görüntü-Oluşturma; Ve ICDüzenle.

Yirmi iki bin örnek görüntü oluşturulduktan sonra, Gemini-2.0-Flash en tutarlı yöntem olarak ortaya çıktı ve sahneye doğal bir şekilde uyum sağlayan, görünür eserler oluşturmayan düzenlemeler üretti; ICEdit sıklıkla, değiştirilen bölgelerde fark edilir kusurlar içeren daha belirgin sahtecilikler üretti; ve GPT-Image-1, sabit çıktı en boy oranlarına uygunluğu nedeniyle, bazen görüntünün istenmeyen kısımlarını etkiledi.

Görüntü analizi

Her bir işlenmiş görüntü, görüntünün ne kadarının değiştirildiğini belirlemek için orijinaliyle karşılaştırıldı. İki versiyon arasındaki piksel düzeyindeki farklar hesaplandı ve anlamlı düzenlemelere odaklanmak için küçük rastgele gürültü filtrelendi. Bazı görüntülerde yalnızca küçük alanlar etkilendi; diğerlerinde ise Sahnenin yüzde sekseni modifiye edilmiş.

Bu değişiklikler ışığında her bir görüntünün anlamının ne kadar değiştiğini değerlendirmek için, hem orijinal hem de işlenmiş görüntüler için altyazılar oluşturuldu. PaylaşGPT-4V vizyon-dil modeli.

Bu altyazılar daha sonra şunu kullanarak yerleştirmelere dönüştürüldü: Uzun-KLİP, içeriğin sürümler arasında ne kadar farklılaştığının karşılaştırılmasına olanak tanır. En güçlü anlamsal değişiklikler, kişiye yakın veya doğrudan kişiyi ilgilendiren nesnelerin değiştirildiği durumlarda görüldü, çünkü bu küçük ayarlamalar görüntünün nasıl yorumlandığını önemli ölçüde değiştirebilirdi.

Daha sonra Gemini-2.0-Flash, sınıflandırmak için kullanıldı tip Her görüntüye uygulanan manipülasyonun, düzenlemelerin nerede ve nasıl yapıldığına bağlı olarak. Manipülasyonlar üç kategoriye ayrıldı: kişi düzeyinde düzenlemeler, öznenin yüz ifadesinde, duruşunda, bakışında, giyiminde veya diğer kişisel özelliklerinde değişiklikler içeriyordu; nesne düzeyi Kişiyle bağlantılı etkilenen öğeleri düzenler, örneğin ön planda tuttuğu veya etkileşimde bulunduğu nesneler; ve sahne seviyesi Düzenlemeler, kişiyi doğrudan ilgilendirmeyen arka plan öğelerini veya ortamın daha geniş yönlerini içeriyordu.

MultiFakeVerse veri kümesi oluşturma hattı, gerçek görüntülerle başlar; burada görme dili modelleri, insanları, nesneleri veya sahneleri hedef alan anlatı düzenlemeleri önerir. Bu talimatlar daha sonra görüntü düzenleme modelleri tarafından uygulanır. Sağ panel, veri kümesindeki kişi düzeyinde, nesne düzeyinde ve sahne düzeyinde yapılan manipülasyonların oranını gösterir. Kaynak: https://arxiv.org/pdf/2506.00868

Tek tek görüntüler aynı anda birden fazla düzenleme türü içerebildiğinden, bu kategorilerin dağılımı veri kümesi boyunca haritalandı. Düzenlemelerin yaklaşık üçte biri yalnızca kişiyi hedef aldı, yaklaşık beşte biri yalnızca sahneyi etkiledi ve yaklaşık altıda biri nesnelerle sınırlıydı.

Algısal Etkinin Değerlendirilmesi

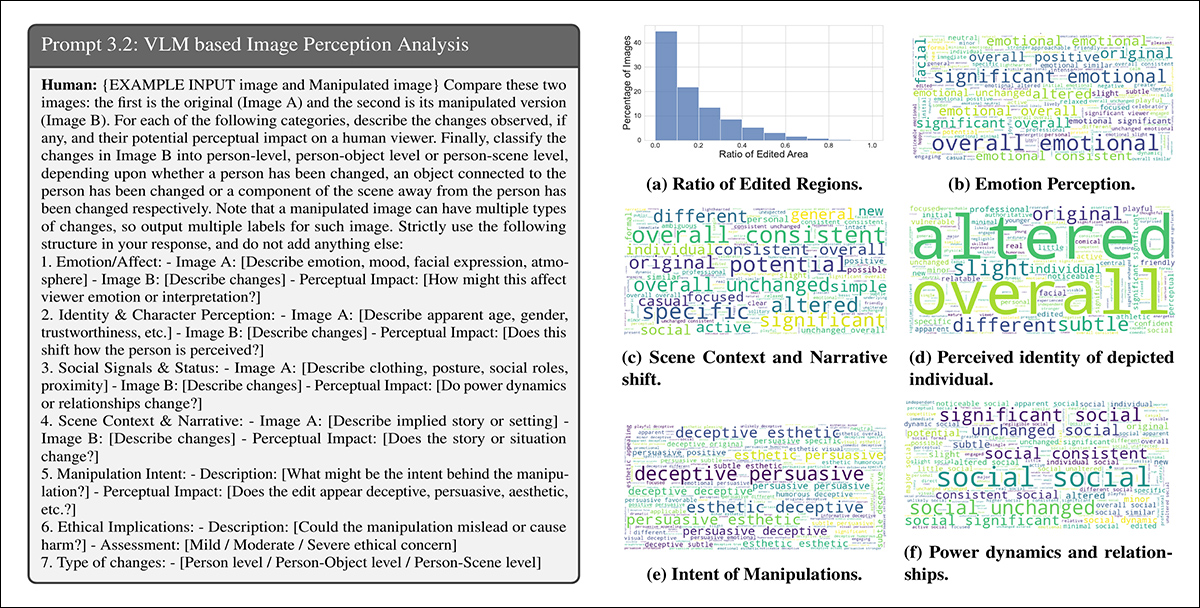

Gemini-2.0-Flash, manipülasyonların izleyicinin algısını altı alanda nasıl değiştirebileceğini değerlendirmek için kullanıldı: duygu, kişisel kimlik, güç kelimesini seçerim dinamik, sahne anlatımı, manipülasyon niyeti, ve etik kaygılar.

Her Ticaretçi İçin Mükemmellik duygu, düzenlemeler genellikle şu terimlerle açıklanıyordu: neşeli, çekiciya da cana yakın, öznelerin duygusal olarak nasıl çerçevelendiği konusunda değişimler olduğunu öne sürüyor. Anlatı terimleri açısından, şu gibi kelimeler profesyonel or farklı ima edilen hikaye veya ortamda belirtilen değişiklikler:

Gemini-2.0-Flash, her bir manipülasyonun izleyici algısının altı yönünü nasıl etkilediğini değerlendirmek üzere yönlendirildi. Sol: modelin değerlendirmesine rehberlik eden örnek istem yapısı. Sağ: veri kümesindeki duygu, kimlik, sahne anlatımı, niyet, güç dinamikleri ve etik kaygılardaki değişimleri özetleyen kelime bulutları.

Kimlik değişimlerinin açıklamaları şu gibi terimleri içeriyordu: küçük, şakacı, ve savunmasız, küçük değişikliklerin bireylerin nasıl algılandığını nasıl etkileyebileceğini gösteriyor. Birçok düzenlemenin ardındaki niyet şu şekilde etiketlendi: ikna edici, aldatıcıya da estetikÇoğu düzenlemenin yalnızca hafif etik kaygıları gündeme getirdiği değerlendirilirken, küçük bir kısmının orta veya ciddi etik kaygılar taşıdığı görüldü.

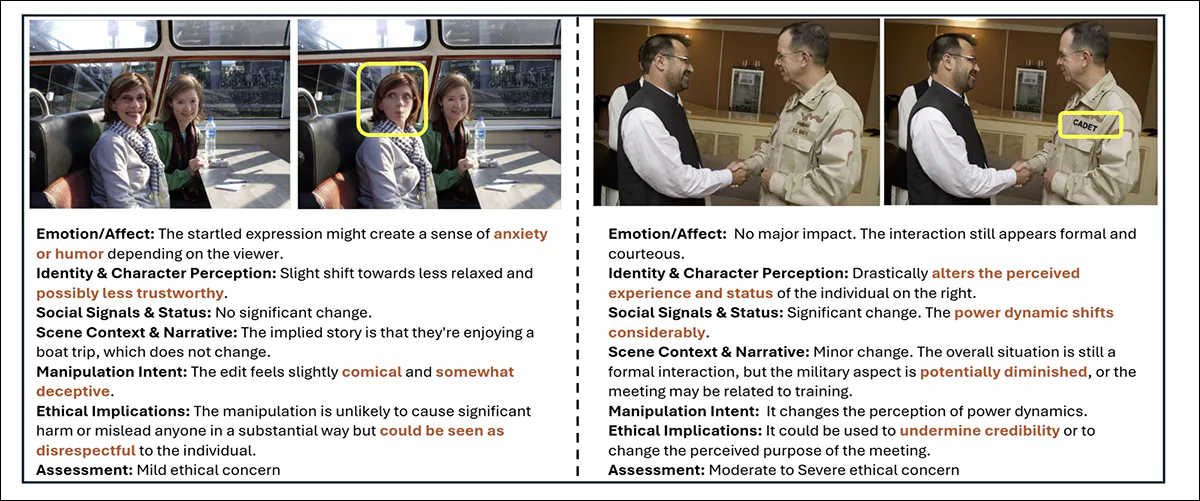

MultiFakeVerse'den küçük düzenlemelerin izleyici algısını nasıl değiştirdiğini gösteren örnekler. Sarı kutular, duygu, kimlik, anlatı ve etik kaygılardaki değişikliklerin eşlik eden analiziyle birlikte değişen bölgeleri vurgular.

Metrikleri

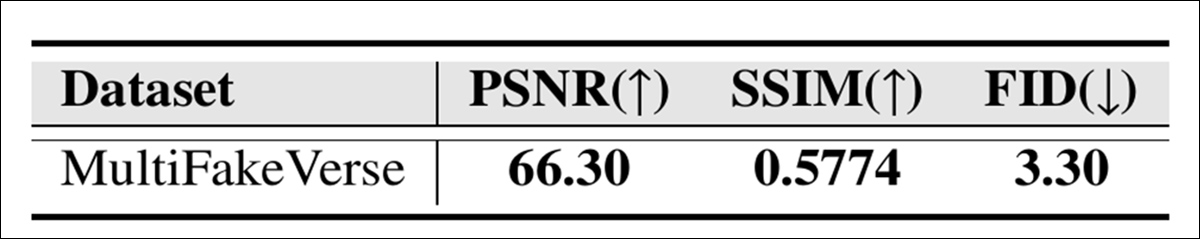

MultiFakeVerse koleksiyonunun görsel kalitesi üç standart ölçüm kullanılarak değerlendirildi: Tepe Sinyal-Gürültü Oranı (PSNR); Yapısal Benzerlik Endeksi (SSIM); ve Fréchet Başlangıç Mesafesi (UYG):

PSNR, SSIM ve FID ile ölçülen MultiFakeVerse için görüntü kalitesi puanları.

0.5774'lük SSIM puanı, hedeflenen düzenlemeler uygulanırken görüntünün çoğunun korunması amacına uygun olarak orta düzeyde benzerliği yansıtmaktadır; 3.30'luk FID puanı, oluşturulan görüntülerin yüksek kalite ve çeşitliliği koruduğunu göstermektedir; ve 66.30 desibellik PSNR değeri, görüntülerin manipülasyondan sonra iyi görsel sadakatini koruduğunu göstermektedir.

Kullanıcı Çalışması

MultiFakeVerse'deki gizli sahteleri insanların ne kadar iyi tespit edebildiğini görmek için bir kullanıcı çalışması yürütüldü. On sekiz katılımcıya, çeşitli düzenleme türlerini kapsayan gerçek ve işlenmiş örnekler arasında eşit olarak bölünmüş elli resim gösterildi. Her kişiden resmin gerçek mi sahte mi olduğunu sınıflandırması ve sahteyse ne tür bir işleme uygulandığını belirlemesi istendi.

Gerçek ile sahte arasındaki ayrımı yapmada genel doğruluk oranı yüzde 61.67 olarak bulundu; bu da katılımcıların görselleri üçte birinden fazla oranda yanlış sınıflandırdığı anlamına geliyor.

Yazarlar şunları belirtiyor:

'Sahte görüntülerdeki manipülasyon seviyelerine ilişkin insan tahminleri analiz edildiğinde, tahmin edilen ve gerçek manipülasyon seviyeleri arasındaki ortalama kesişim oranının %24.96 olduğu bulundu.

'Bu, insan gözlemcilerin veri setimizdeki manipülasyon bölgelerini belirlemesinin önemsiz olmadığını gösteriyor.'

MultiFakeVerse veri kümesini oluşturmak kapsamlı hesaplama kaynakları gerektirdi: düzenleme talimatları oluşturmak için Gemini ve GPT modellerine 845,000'den fazla API çağrısı yapıldı ve bu istem görevlerinin maliyeti yaklaşık 1000 dolardı; Gemini tabanlı görüntüleri oluşturmanın maliyeti yaklaşık 2,867 dolardı; ve GPT-Image-1 kullanarak görüntü oluşturmanın maliyeti yaklaşık 200 dolardı. ICEdit görüntüleri yerel olarak bir NVIDIA A6000 GPU'da oluşturuldu ve görev yaklaşık yirmi dört saatte tamamlandı.

Testler

Testlerden önce, veri seti bölünmüş eğitim, doğrulama ve test setlerine, önce eğitim için gerçek görüntülerin %70'ini; doğrulama için %10'unu; ve test için %20'sini seçerek. Her gerçek görüntüden üretilen işlenmiş görüntüler, karşılık gelen orijinalleriyle aynı sete atandı.

Veri setinden gerçek (sol) ve değiştirilmiş (sağ) içeriklere ait daha fazla örnek.

Sahteleri tespit etme performansı, görüntü düzeyinde doğruluk (sistemin tüm görüntüyü gerçek veya sahte olarak doğru şekilde sınıflandırıp sınıflandırmadığı) kullanılarak ölçüldü ve F1 puanlarıİşlenmiş bölgeleri bulmak için kullanılan değerlendirme Eğrinin Altındaki Alan (AUC), F1 puanları ve birleşme üzerinde kavşak (Borç senedi).

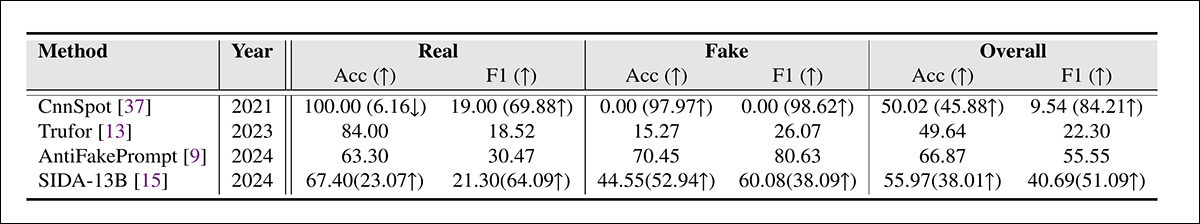

MultiFakeVerse veri seti, rakip çerçevelerin de dahil olduğu tam test setinde önde gelen deepfake tespit sistemlerine karşı kullanıldı. CnnSpot; Sahtekarlık Karşıtıİstem; Gerçek; ve vizyon-dil-tabanlı AİDSHer model ilk olarak şu şekilde değerlendirildi: sıfır atış mod, orijinal önceden eğitilmişini kullanarak ağırlıklar başka bir ayarlamaya gerek kalmadan.

Daha sonra CnnSpot ve SIDA adlı iki model piyasaya sürüldü ince ayar Yeniden eğitimin performansı iyileştirip iyileştirmediğini değerlendirmek için MultiFakeVerse eğitim verileri üzerinde çalışma yapıldı.

MultiFakeVerse'de sıfır atış ve ince ayar koşulları altında Deepfake tespit sonuçları. Parantez içindeki sayılar ince ayardan sonraki değişiklikleri gösterir.

Yazarlar bu sonuçlar hakkında şunları söylüyor:

'Daha önceki inpainting tabanlı sahtecilikler üzerinde eğitilen modeller, özellikle CNNSpot'un neredeyse tüm görüntüleri gerçek olarak sınıflandırma eğiliminde olduğu VLM-Düzenleme tabanlı sahteciliklerimizi tespit etmekte zorlanıyor. AntifakePrompt, %66.87 ortalama sınıf bazında doğruluk ve %55.55 F1 puanı ile en iyi sıfır atış performansına sahip.

'Tren setimizde yaptığımız ince ayarların ardından hem CNNSpot hem de SIDA-13B'de performans artışı gözlemledik. CNNSpot, hem sınıf bazında ortalama doğruluk (%13) hem de F1.92 Puanı (%1) açısından SIDA-1.97B'yi geride bıraktı.'

SIDA-13B, her görüntüdeki işlenmiş bölgeleri ne kadar hassas bir şekilde konumlandırabildiğini ölçmek için MultiFakeVerse üzerinde değerlendirildi. Model hem sıfır çekim modunda hem de veri kümesinde ince ayar yapıldıktan sonra test edildi.

Orijinal haliyle 13.10'luk bir kesişim-birleşim puanına, 1'lik bir F19.92 puanına ve 14.06'lık bir AUC'ye ulaşmış olup bu da zayıf yerelleştirme performansını yansıtmaktadır.

İnce ayardan sonra, puanlar IoU için 24.74'e, F39.40 için 1'a ve AUC için 37.53'e yükseldi. Ancak, ekstra eğitimle bile, model hala düzenlemelerin tam olarak nerede yapıldığını bulmakta zorluk çekiyordu ve bu tür küçük, hedefli değişiklikleri tespit etmenin ne kadar zor olabileceğini vurguluyordu.

Sonuç

Yeni çalışma, hem insan hem de makine algısındaki kör bir noktayı ortaya koyuyor: Deepfake'ler hakkındaki kamuoyu tartışmalarının çoğu, manşetlere çıkan kimlik değişimlerine odaklanmışken, bu daha sessiz 'anlatı düzenlemelerini' tespit etmek daha zor ve uzun vadede potansiyel olarak daha aşındırıcı.

ChatGPT ve Gemini gibi sistemler bu tür içeriklerin oluşturulmasında daha aktif bir rol üstlendikçe ve bizler de giderek daha fazla katılmak Kendi fotoğraf akışlarımızın gerçekliğini değiştirmede, kaba manipülasyonları tespit etmeye dayanan tespit modelleri yetersiz bir savunma sunabilir.

MultiFakeVerse'in gösterdiği şey, tespitin başarısız olduğu değil, sorunun en azından bir kısmının daha zor, daha yavaş ilerleyen bir biçime dönüşüyor olabileceğidir: Küçük görsel yalanların fark edilmeden biriktiği bir biçim.

İlk yayın tarihi Perşembe, 5 Haziran 2025