Yapay Zekâ

Vertex AI’ye Giriş

Yapay Zeka manzarasının hızla evrimleşmesi nedeniyle, teknoloji liderlerinin karşılaştığı en büyük zorluklardan biri, “deneysel” olmaktan “kurumsal hazır” olmaya geçmektir. Tüketici sohbet botları ve etkileşimli bir platform, kamu hayal gücünü desteklemeye yardımcı olsa da, şirketler yalnızca bir sohbet arayüzü ile başarılı olamaz. Rekabetin daha önce hiç olmadığı kadar agresif olduğu bir dönemde, şirketlerin güçlü, ölçeklenebilir ve güvenli bir ekosisteme ihtiyacı vardır ve Google, Vertex AI ile bunu sunmaya çalışıyor, Google Cloud’un birleşik Yapay Zeka ve Makine Öğrenimi platformu.

Vertex AI, modern bulut altyapısı ile Generative AI tümleştirmesi için kendini sağlamlaştırmaya çalışıyor, ham temel modeller ile üretim sınıfı uygulamaları arasında köprü oluşturan kapsamlı bir özellik seti sunuyor. Vertex AI, büyük dil modellerinin (LLM’ler) yalnızca bir sarmalayıcı değil, Generative AI’ı modern bulut altyapısının birinci sınıf bir vatandaşı olarak gören birleşik bir Makine Öğrenimi ve Yapay Zeka (ML/AI) ekosistemidir.

Vertex AI’nin kalbinde Model Garden yer alır, 200’den fazla küratörlü temel modeli sunan bir merkezi pazar yeri, bunlar arasında çok modal dev Gemini 2.5 Pro da bulunmaktadır ve bu, 2 milyon tokenlik bir bağlam penceresine sahiptir. Bu makalede, Vertex AI’nin mimarisini inceleyeceğiz, Model Garden’in endüstri için “Uygulama Mağazası” olarak nasıl hizmet ettiğini keşfedeceğiz ve bu platformu bir sonraki nesil kurumsal yazılımın omurgası yapan teknik sütunlara bakacağız.

Çekirdek Mimarisi: Birleştirilmiş Bir Platform

Vertex AI, bağlı olmayan bir araç koleksiyonu değil, veri ve AI ekosisteminin parçalanmasını günümüze kadar Makine Öğrenimi’nin musibeti olan veri, araçlar ve ekipleri köprüleyecek şekilde tasarlanmış birleşik bir platformdur. Geleneksel olarak, AI geliştirme, izole ortamlarda gerçekleşir ve bazen veriler, birden fazla depoda dağılmış ve hapsolmuştur. Örneğin, şirketler müşteri verilerini SQL depolarında saklayabilirken, yapılandırılmamış belgeler bir Veri Gölü’ne dökülür. Veriler bölünmüş olduğunda, AI yalnızca “kısmi bir gerçeklik” görür, bu da sonuçların yanlı olmasından veya yüksek hallucination oranlarından kaynaklanabilir çünkü girişimcinin tam bağlamına sahip değildir.

Vertex AI, BigQuery ve Cloud Storage’daki ham veri alımı ile üretim izleme arasındaki tüm yaşam döngüsünü entegre etmeye çalışır, temelde bu silolar arasında “bağlantılı doku” olarak hizmet eder. Vertex AI, Cloud Storage ve BigQuery ile yerli olarak entegre olur, böylece AI modellerinin karmaşık Extraction, Transformation ve Load管道ları olmadan verileri almasına olanak tanır.

Temel: Google’ın AI Hiper Bilgisayarı

Vertex AI’nin GenAI katmanı, Vertex AI üzerinde Google’ın AI Hiper Bilgisayar mimarisinin üzerine kurulmuştur, bu, aşağıdaki bileşenlerden oluşan birleşik bir süper bilgisayar sistemi:

TPU v5p ve v5e (Tensor İşleme Birimleri)

Google’ın Tensor İşleme Birimleri, derin öğrenimin tanımını yapan matris çarpımı için özel olarak tasarlanmış ASIC’lerdir (Uygulama-Spesifik Entegre Devreler).

- TPU v5p (Performans): Bu, büyük ölçekli eğitim için bayrak gemisi hızlandırıcıdır. Her TPU v5p podu, Google’ın en yüksek bant genişliğine sahip Inter-Chip Interconnect (ICI) ile 8,960 çipe ölçeklenebilir ve 4,800 Gbps’dir. Bir teknoloji lideri için bu, 2.8 kat daha hızlı eğitim anlamına gelir. bir GPT-3 boyutundaki model (175B parametre) için önceki nesle kıyasla, piyasaya sürme süresini dramatik olarak azaltır.

- TPU v5e (Verimlilik): “Maliyet-optimizasyonlu” performansı için tasarlanan v5e, orta ölçekli eğitim ve yüksek hacimli çıkarım için iş atıdır. Bu, 2.5 kat daha iyi fiyat-performans sağlar, böylece büyük bir bütçe olmadan 7/24 çıkarım çalıştırmak isteyen şirketler için ideal bir seçim olur.

NVIDIA H100/A100 GPU’lar için Esneklik

TPU’lar özelleşmişken, birçok geliştirme ekibi NVIDIA CUDA ekosistemine güveniyor. Vertex AI, NVIDIA’nın son donanımına birinci sınıf destek sağlar:

- NVIDIA H100 (Hopper): En büyük açık kaynaklı modelleri (Llama 3.1 405B gibi) ince ayarlamak için gereken büyük bellek bant genişliğine ideal.

- Jupiter Ağları: “Ağ Tıkanıklığı”nı önlemek için Google, veri merkezinde Jupiter veri merkezi ağı kumaşını kullanır. Bu, verilerin GPU’lar arasında yıldırım hızında hareket etmesini sağlar, RDMA (Uzaktan Doğrudan Bellek Erişimi) için CPU yükünü atlar ve dağıtılmış düğümler boyunca neredeyse yerel performansı sağlar.

Dinamik Orkestrasyon

Vertex AI’deki en kritik teknik değişim Dinamik Orkestrasyon‘dur. Miras ortamda, bir GPU düğümü 3 haftalık bir eğitim çalıştırması sırasında başarısız olursa, tüm iş possibly çökebilir.

- Otomatik Esneklik: Vertex AI, genellikle Google Kubernetes Engine (GKE) tarafından desteklenmektedir, “kendini iyileştirme” düğümlerine sahiptir. Donanım arızası tespit edildiğinde, platform otomatik olarak iş yükünü sağlıklı bir düğüme taşır.

- Dinamik İş Yükü Zamanlayıcısı: Bu araç, ekiplerin aciliyete göre kapasite talep etmesine olanak tanır. Esnek Başlangıç (daha ucuz, kapasite mevcut olduğunda başlar) veya Misyon-Kritik Sürümler için Garanti Kapasite seçeneğine sahip olabilirsiniz.

- Sunucusuz Eğitim: Altyapı yönetimini sıfıra indirmek isteyen ekipler için Vertex AI Sunucusuz Eğitim, kodunuzu ve verilerinizi sunmanıza ve platformun küme, işi çalıştırma ve kümeyi yok etme işlemlerini gerçekleştirerek yalnızca kullanılan hesaplama saniyeleri için ücretlendirme yapmasına olanak tanır.

Üç Giriş Noktası: Keşif, Deneysel Çalışma ve Otomasyon

Farklı teknik kişilere – veri bilimcilerden uygulama geliştiricilerine – hitap etmek için Vertex AI, üç temel giriş noktası sunar:

- Model Garden: Keşif için Pazar.

- Vertex AI Studio: Deneysel Çalışma için Oyun Alanı.

- Vertex AI Agent Builder: Otomasyon için Fabrika.

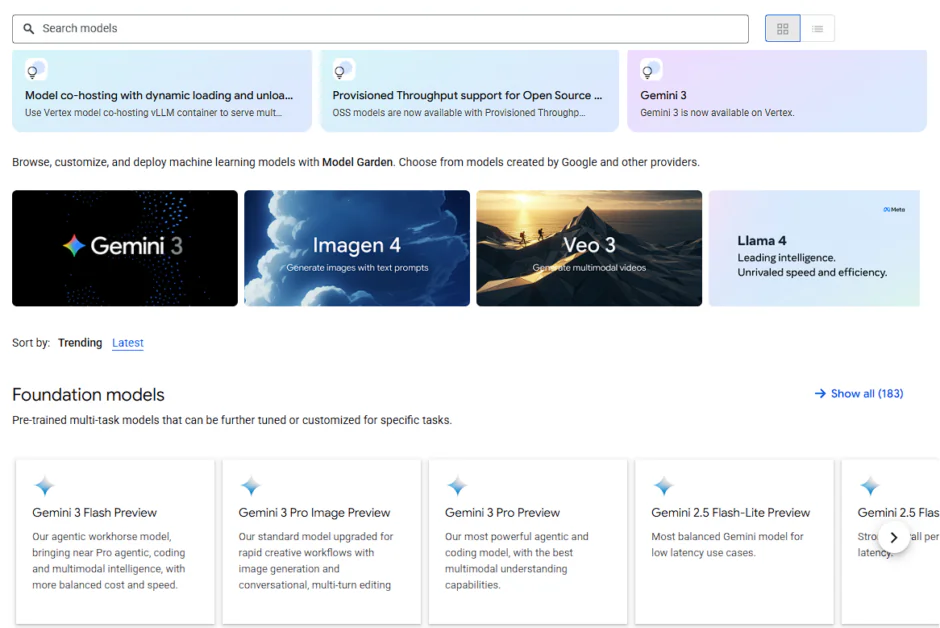

Model Garden: Keşif için Pazar

Google Cloud’un Vertex AI Model Garden, çeşitli iş ihtiyaçları için multimodal (görme, metin, kod) dahil olmak üzere geniş bir yelpazede birinci taraf, açık kaynaklı ve üçüncü taraf AI modellerini keşfetmek, test etmek, özelleştirmek ve dağıtmak için Google Cloud içinde merkezi bir platformdur. Bu, akıcı MLOps için Vertex AI araçlarıyla sorunsuz entegrasyon sunar.

Model Garden, 200’den fazla modelini üç ayrı kategoriye ayırır, bu da mimarların performansı, maliyeti ve kontrolü dengelemesine olanak tanır:

- İlk Parti (Google) Modelleri: Bunlar, Vertex AI içinde bulunan bayrak gemisi multimodal modellerdir ve Google, bunları çeşitli boyutlarda sunar, karmaşık akıl yürütmeden düşük gecikme ve yüksek hacime kadar, böylece geliştiricilerin modellerini kullanım durumlarına göre optimize etmesine olanak tanır.

- Üçüncü Parti (Ticari) Modeller: Stratejik ortaklıklar aracılığıyla Vertex AI, “Model-as-a-Service” (MaaS) erişimi sunar, bu da beş farklı AI sağlayıcısı için ayrı ayrı faturalandırma ve güvenlik kimlik bilgilerini yönetmek yerine, tüm bunları mevcut Google Cloud projesi aracılığıyla, birleşik API formatı kullanarak erişmenize olanak tanır.

- Açık Kaynaklı ve Açık Ağırlıklı Modeller: Bu kategori, Meta’nın Llama 3.2, Mistral ve Google’ın kendi Gemma‘sini içerir. Bu modeller, verileri en üst düzeyde izole etmek için kendi Sanal Özel Bulut (VPC) içinde modelleri self-dağıtmak isteyen organizasyonlar için idealdir.

Birleştirilmemiş bir ortamda, bir açık kaynaklı modeli (Llama gibi) dağıtmak, PyTorch ortamını kurmak, CUDA sürücülerini yapılandırmak ve bir Flask veya FastAPI sarmalayıcıyı yönetmek anlamına gelir.

Model Garden, bu “Munging” aşamasını Birleştirilmiş Yönetilen Uç Noktalar aracılığıyla ortadan kaldırır:

- Tek Tıklama Dağıtımı: Birçok model için “Dağıt”ı tıklamak, gerekli TPU/GPU kaynaklarını otomatik olarak sağlar, modeli üretim için hazır bir kaba sarar ve bir REST API uç noktası sağlar.

- Hugging Face Entegrasyonu: Vertex AI, geliştiricilerin modelleri doğrudan Hugging Face Hub’dan Vertex uç noktasına dağıtmalarına olanak tanır, böylece kullanılabilir zeka miktarını neredeyse sınırsız şekilde artırır.

- Özel Hizmet Bağlantısı (PSC): Yüksek düzenlenmiş endüstriler için, modeller Özel Hizmet Bağlantısı kullanarak dağıtılabilir, bu da model uç noktasının hiçbir zaman kamu internetine maruz kalmamasını sağlar – veri trafiğini şirket ağı içinde tutarak.

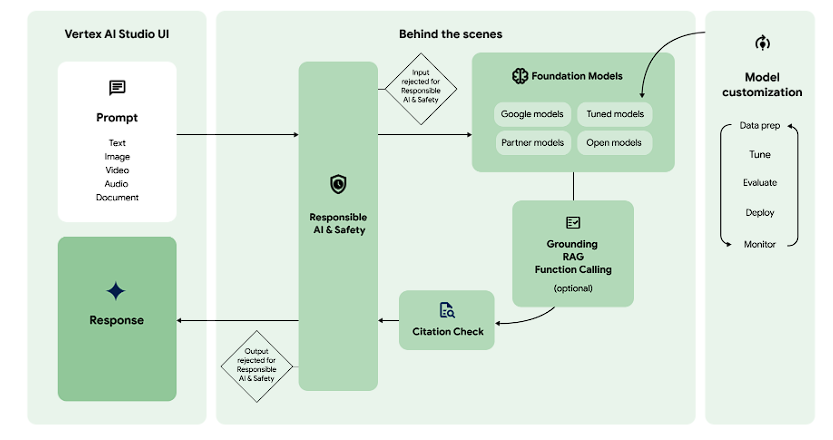

Vertex AI Studio: Deneysel Çalışma için Oyun Alanı

Model Garden’in seçim ile ilgili olması mentre, Vertex AI Studio hassasiyet ile ilgilidir. Vertex AI Studio, geleneksel yazılım dünyasında karşılaştığınız derleyiciler ve hata ayıklayıcılar ile karşılaştırılabilir. Vertex AI Studio, ham modellerin bir dizi.prompt mühendisliği, multimodal test ve gelişmiş hiperparametre ayarlaması yoluyla özel iş araçlarına dönüştüğü çalışma alanıdır.

Çoklu Modal Prototip: Metin Ötesi

Stüdyonun öne çıkan özelliklerinden biri, çok modallığa yönelik yerli desteğidir. Diğer platformlar metin dışı veri ile çalışmak için karmaşık kodlama gerektirirken, Vertex AI Studio, Gemini 2.5 akıl yürütme yeteneklerini test etmek için doğrudan arayüze dosyaları bırakmanıza olanak tanır.

- Video Zekası: 45 dakikalık bir teknik ana konuşmayı yükleyerek modelden “belirli bir API’nin her mention edildiği zamanı belirleyin ve zaman damgalı bir özet sağlayın” gibi bir talepte bulunabilirsiniz.

- Belge Analizi: Model, yalnızca metni okumak yerine, 1.000 sayfalık bir PDF’nin görsel düzenini analiz edebilir, grafikler, tablolar ve çevreleyen metin arasındaki ilişkiyi anlamlandırabilir.

- Kod İcrası: Studio artık kod icrasını desteklemektedir. Model, bir kompleks matematik problemi çözmeyi veya bir CSV analizini talep ettiğinde, model güvenli bir kumanda ortamında Python kodu yazabilir ve yürütebilir, böylece doğrulanmış bir cevap sağlar.

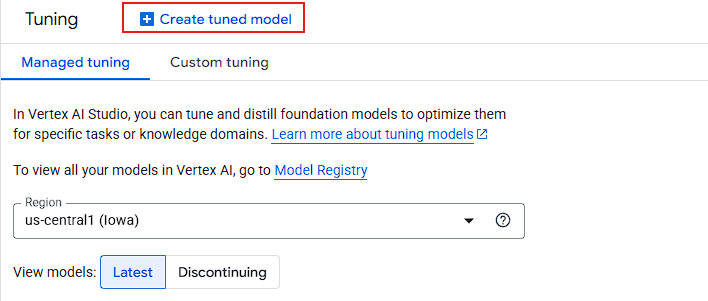

Gelişmiş Özelleştirme: Ayarlanma Pathway

İki tıklamayla (Zero-shot veya Few-shot) tavana ulaştığında, Vertex AI Studio, ağır silahları sağlar: Model Ayarlaması.

- Gözetimli İnce Ayar: Geliştiriciler, “Prompt/Cevap” çiftleri (ideal olarak 100+ örnek) içeren bir veri seti sağlar. Bu, modelin belirli bir marka sesini, çıktı formatını (özel JSON gibi) veya alan spesifik jargonunu benimsemesini sağlar.

- Context Caching: Şirketler, büyük, statik veri setleri (yasal bir kütüphane veya bir kod tabanı gibi) ile ilgilenirken, Studio Context Caching‘e olanak tanır. Bu, bir milyon tokenlik veri setini modelin belleğine önceden yüklemenize, sonraki sorgular için gecikme ve maliyetleri dramatik olarak azaltmanıza olanak tanır.

- Distilasyon (Öğretmen-Öğrenci): Bu, yüksek düzeyde bir mimari hamledir. Büyük bir modeli (Gemini 2.5 Pro) kullanarak daha küçük, daha hızlı bir modeli (Gemini 2.0 Flash) “eğitebilirsiniz”. Sonuç, “Pro” düzeyinde performans gösteren ancak “Flash” hızında ve maliyetinde çalışan bir modeldir.

Vertex AI Agent Builder: Otomasyon için Fabrika

Vertex AI Agent Builder, temel modelleri kurumsal veri ve dış API’lerle birleştirmek için geliştiricilere olanak tanıyan bir yüksek düzeyli orkestrasyon çerçevesidir.

“Gerçekliğin” Mimarisi: Grounding ve RAG

Kurumsal AI için birincil teknik engel halüsinasyon‘dur. Agent Builder, gelişmiş bir Grounding motoru ile bunu çözer.

- Google Arama ile Grounding: Gerçek zamanlı dünya bilgisine ihtiyaç duyan sorgular için (örneğin, “New York’ta current mortgage oranları nelerdir?”), ajan Google Arama yapabilir, gerçekleri çıkarabilir ve kaynaklarını alıntılayabilir.

- Vertex AI Arama (RAG-as-a-Service): Geliştiriciler, Vertex AI Search kullanarak kendi belgelerini (PDF’ler, HTML, BigQuery) endeksleyebilir. Bu, “chunking,” “embedding” ve “retrieval” adımlarını otomatik olarak işler, böylece ajanın yalnızca “Gerçekliğin Kaynağı”na dayalı olarak cevap verdiğinden emin olunur.

- Vertex AI RAG Motoru: Yüksek ölçekli, özel uygulamalar için bu yönetilen hizmet, vektör tabanlı ve anahtar kelime tabanlı sonuçların birleştirilmesine (RAG) olanak tanır, böylece standard LLM çıkışlarının doğruluğunu %30’a kadar artırır.

Çoklu Ajan Orkestrasyonu (A2A Protokolü)

Gelişmiş kurumsal iş akışları genellikle birden fazla uzmanlaşmış ajanın birlikte çalışmasını gerektirir. Vertex AI, Ajan-a-Ajan (A2A) Protokolü‘nü tanır, bu da:

- “Seyahat Ajanı”‘nın “Finans Ajanı” ile konuşmasına olanak tanır, böylece uçuş rezervasyonu şirket bütçesinde yapılır.

- Çoklu Ortaklık: Açık bir protokol kullandığı için, Vertex AI’de oluşturulan ajanlar LangChain veya CrewAI gibi diğer çerçevelerde oluşturulanlarla iletişim kurabilir.

Geliştirici Yığını: ADK ve Ajan Motoru

“Teknoloji platformu” kitlesi için, Ajan Builder iki ayrı yolu sunar:

- Kod Olmayan Konsol: Hızlı prototip oluşturma ve iş kullanıcı yapılandırması için görsel bir sürükle ve bırak arayüzü.

- Ajan Geliştirme Kiti (ADK): Mühendisler için kod-öncelikli bir Python aracı seti. Bu, “Prompt-as-Code,” versiyon kontrol entegrasyonu ve Vertex AI Ajan Motoru‘na dağıtmaya olanak tanır – otomatik olarak oturum kalıcılığı, ölçekleme ve durum yönetimini işleyen yönetilen bir çalışma zamanı.

Sonuç: “Ne Olursa Olsun”dan “Nelerin Sonrası”na

Gösterişli bir AI demo’sundan üretim sınıfı kurumsal uygulamaya geçiş, dijital dönüşüm projeleri için uzun süredir “ölüm vadisi” olarak kaldı. İncelediğimiz gibi, Vertex AI, özellikle bu boşluğu kapatmak için tasarlandı. Veri, altyapı ve model orkestrasyonunun parçalanmış silolarını birleştirmek yoluyla, Google Cloud, Large Language Modellerinin ham gücünden AI yaşam döngüsünün operasyonel olgunluğuna doğru konversationı taşıdı.