Anderson’un Açısı

AI Kitab’ı İzlemekten Çok Okumayı Tercih Ediyor

AI modellerinin, görevi video içeriklerini izlemek ve yorumlamak olsa bile, gerçek video içeriklerini izlemesi ve yorumlaması şaşırılacak kadar zor. Yazılı kelimelere daha çok ilgi gösteriyorlar.

Eğer कभी ChatGPT veya benzer bir popüler vizyon/dil modeline küçük bir video kliplerini yüklemeye çalıştıysanız, bunların aslında videoyu parse edemediklerini fark etmiş olabilirsiniz. ChatGPT-4o+ gibi modeller, bireysel çerçeveleri – JPEG ve PNG gibi resimler olarak – analiz edebilse de, kullanıcıların kendi çerçevelerini çıkarmasını ve bunları resim olarak yüklemesini tercih ediyorlar (bunlar hakkında yorum yapmaya hazırlar).

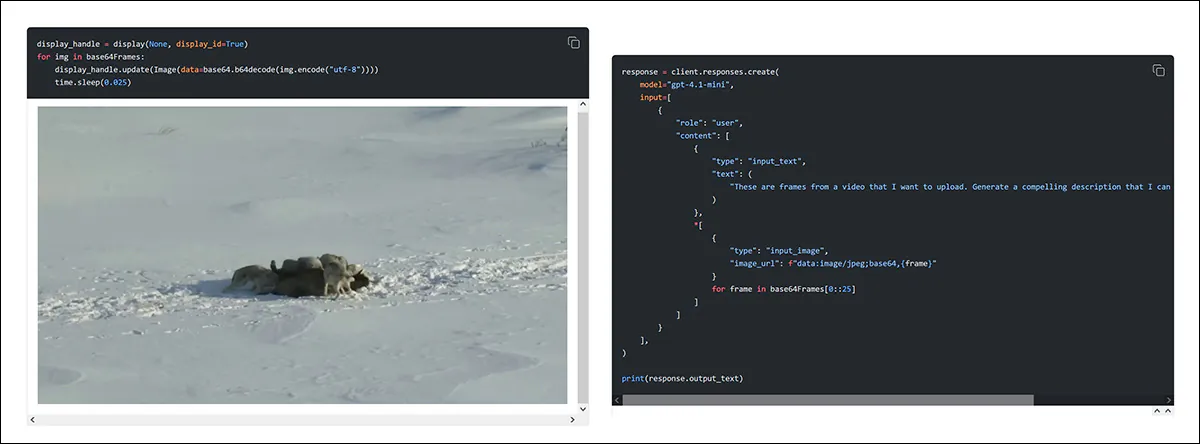

AçıkAI GPT serisinde, bir video klipten tam bir çerçeveler dizisini çıkarmak ve bunları ChatGPT’ye, örneğin yaratılan bir AI-created narrative track için beslemek mümkündür:

OpenAI öğreticisinden resimler ve kod, video klibi için geliştirilen AI-generated yorum için birden fazla çıkarılan çerçeveleri işleme. Kaynak

Ancak, videoyu çerçevelere dönüştürme işi kullanıcıya düşer, ya daha büyük bir rutin içinde fonksiyonları çağırmak suretiyle, ya da FFMPEG veya çeşitli ücretsiz ve ücretli video düzenleme çözümleri ile çerçeveleri çıkarmak suretiyle.

Bir ölçüde, belki de büyük ölçüde, yüksek ölçekli ürünlerdeki video analizi sınırlamaları, kaynak kullanımı ile ilgilidir: sadece bir AI örneğini en popüler video kodeklerinin bir seçimine sahip olmak ve çıkarmanın diske ağır ve CPU’yi boğucu sürecine compute kaynaklarını tahsis etmek, yüz milyonlarca kullanıcının bu olanakları her gün kullanmaya başlamaları durumunda küçük bir consideration değildir.

Ek olarak, zaman analizi çok farklı bir resim çizebilir, tek bir çerçeveden daha fazla; bu nedenle, kısa bir video klibin tüm zaman ‘checksum’ünü dikkate almak, talep edilen ve kaynak yoğun bir görevdir – aynı zamanda araştırma literatürünün özel bir alanı, örneğin Optical Flow gibi çerçevelerin geliştirilmesi ile – esasen videoyu statik bir belge gibi işlemek için ‘açar’:

Optical akış diyagramları, video dizisi içindeki hareketin nasıl izlendiğini ve yeşil vektörlerin hareket yönü ve yoğunluğunu gösterir. Bu eşleştirmeler, VLM’ler için gerekli zaman sürekliliğini sağlar ve ayrıca VFX iş akışlarında yapısal rehberler olarak hizmet edebilir. Kaynak

Cliff’s Notları ile Yetinmek

Bununla birlikte, Google’ın Notebook LM gibi modeller ve daha yeni ChatGPT girişleri, ilgili metadata’yı (yani, videoyu某 şekilde bağlamlandıran gömülü metin içeriğini) okuyabildikleri için, video dosyası yüklemelerini yasaklamıyorlar; ve bazen, metada böyle bir veri yoksa bile, videoyu yorumlamaya çalışıyorlar.

Aşağıdaki durumda, 2021 İtalyan filmi Tanrının Eli‘nden 6 saniyelik rastgele bir klipten NotebookLM’ye yükledim, klibin hiçbir yararlı metin içermediğinden emin oldum, ya da dosya adında.

NotebookLM daha sonra, video ile tamamen alakasız ve anlamsız bir beş dakikalık baş başa podcast ile birlikte, ayrıntılı bir şekilde malzeme uydurdu:

İtalyan bir filmdeki sıradan bir an, NotebookLM tarafından çılgınca yanlış yorumlandı. Kaynak: Google NotebookLM

Notebook, ChatGPT gibi, bir YouTube videosunu girişte kabul edecek, ancak yalnızca video, yorumlanabilir bir metin katmanı注释 ve/veya altyazı içeriyorsa (videoya işlenen rasterized altyazılar değil).

Bu şekilde, video içeriğinin gerçekten bakılması ve dinlenmesiyle birlikte anlamsal yorumunu gerçekleştirmek (YouTube için yasal bir zorunluluk, telif hakkı koruma önlemleri ve beklenen kimlik koruma sistemi nedeniyle), kullanıcı tarafından yükleme之后, klibin gerekli işleme kaynaklarını tahsis edilebildiği zaman yapılır.

Gerçek video yorumu pahalı ve yorucudur ve ortaya çıkıyor ki, bu görevi gerçekleştirmek için özel olarak eğitilen modeller bile, videoyu gerçekten izlemektense metin okumayı tercih ediyorlar.

TL;DW

Bu, UK’nın Bristol Üniversitesi’nden yeni bir makale ile doğrulanmaktadır, Bir Video Bin Kelimeye Değmez başlıklı, iki yazarın, mevcut durumun en iyi görme-dil modelleri (VLM’ler) – videoyu daha fazla çaba ile analiz edebilen ve video soru cevaplaması (VQA) gibi görevlerde yer alan modeller – metin tabanlı bilgilere her zaman öncelik verdiklerini belirtiyorlar.

Hareketli resimlerin ve yazılı soruların ve çoklu seçim cevaplarının verildiği durumlarda, yazarlar, modellerin genellikle metindeki kalıplara dayandıklarını, ekran上的 olaylardan daha fazla, ve birçok durumda, soru tamamen kaldırıldığında bile aynı performansı gösterdiklerini buldular.

Bu, kesmek veya hile gibi bir formda, modellerin çoğunda, cevapların kalıplarını tespit etmesinin en önemli şey olduğu ortaya çıktı; ancak görevi daha zorlaştırmak, yani daha fazla cevap seçeneği eklemek, AI’ların videoya daha fazla dikkat etmelerine neden oldu.

Yazarlar, altı VLM modelini, dört uygun veri kümesiyle birlikte, çeşitli koşullar altında VQA testlerine tabi tuttular; ve sonuçlar, modellerin video içeriğinden ziyade metne bağımlılığını gösterdi.

Bir video-analiz modelinin, gördüklerine kıyasla okuduklarına verdiği önem gösteren örnek. Klib, bir kişinin bambu dokumasını gösterir, ancak model, video çerçevelerine kıyasla yazılı soru ve cevap metnine çok daha fazla önem atfeder. Mavi vurgular, seçilen cevabı destekleyen öğeleri işaret eder, kırmızı ise bunları karşıt yönde çekenleri gösterir, modelin nedeninin metne değil, hareketli görüntülere değil, kelimelere dayandığını gösterir. Kaynak