Yapay Zekâ

EAGLE: Çeşitli Görsel Kodlayıcıların Karışımı ile Büyük Dil Modellerinin Tasarım Alanını Araştırma

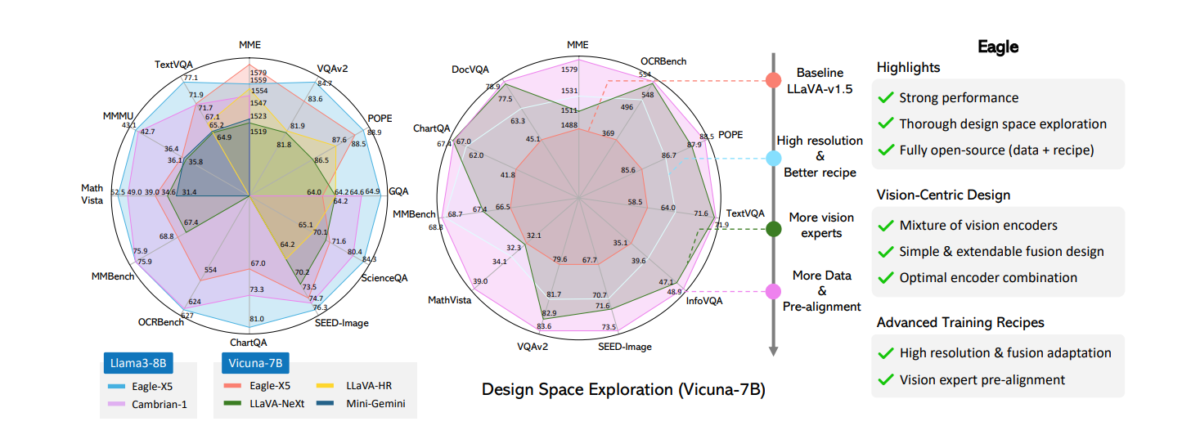

Karma mod besar dil modellerinin (MLLM’ler) kompleks görsel bilgileri doğru bir şekilde yorumlama yeteneği, bu modeller için kritik bir odak noktasıdır. Recent çalışmalar, geliştirilmiş görsel algının, hallucinasyonları önemli ölçüde azalttığını ve optik karakter tanıma ve belge analizi gibi çözünürlük duyarlı görevlerde performansı iyileştirdiğini göstermiştir. Son zamanlardaki beberapa MLLM, bu amaca ulaşmak için çeşitli görsel kodlayıcıların karışımı kullanmaktadır. Başarılarına rağmen, kritik yönleri ele alan sistematik karşılaştırmalar ve ayrıntılı soykütüğü çalışmaları eksikliği mevcuttur, Örneğin, uzman seçimi ve birden fazla görsel uzmanın entegrasyonu. Bu makale, görsel kodlayıcıların ve çözünürlüklerin karışımı kullanarak MLLM’ler için tasarım alanının kapsamlı bir araştırmasını sunar, Eagle çerçevesi, çok modelli büyük dil modelleri için kodlayıcıların karışımı ile tasarım alanını araştırma girişiminde bulunur. Bulgular, çeşitli mevcut stratejilere ortak olan bir dizi temel ilkeyi ortaya koyar, bu da etkili bir tasarım yaklaşımına yol açar. Eagle, basitçe çeşitli tamamlayıcı görsel kodlayıcılardan görsel token’leri birleştirmenin, daha karmaşık karıştırma mimarileri veya stratejileri kadar etkili olduğunu keşfeder. Ayrıca, Eagle, görsel odaklı kodlayıcılar ve dil token’leri arasındaki uçurumu köprülemek için Ön Hizalama’yı tanıtır, böylece model tutarlılığını artırır. Sonuçlanan MLLM ailesi, Eagle, diğer önde gelen açık kaynaklı modelleri önemli MLLM benchmark’larında geçer.

Eagle’ın çalışması, karma mod besar dil modellerinin (MLLM’ler) genel mimari tasarımıyla ilgilidir. Daha önce bahsedilen temsilci açık kaynaklı araştırmaların yanı sıra, diğer著名 MLLM aileleri arasında MiniGPT-4, Lynx, Otter, QwenVL, CogVLM, VILA, GPT-4V, Gemini ve Llama 3.1 bulunur. Görsel sinyallerin dil modeline nasıl entegre edildiğine bağlı olarak, MLLM’ler genel olarak “çapraz modsal dikkat” modelleri ve “ön ayar” modelleri olarak sınıflandırılabilir. İlki, görsel bilgileri farklı LLM katmanlarına çapraz modsal dikkat kullanarak enjekte eder, ikincisi ise görsel token’leri dil token dizisi的一部分 olarak ele alır ve doğrudan metin gömme ile ekler. Eagle’ın modeli, LLaVA-styled çok modelli bir mimari izleyerek, ön ayar ailesine aittir. MLLM’nin hızlı bir şekilde büyüyen bir alan olduğu düşünüldüğünde, Eagle, daha fazla bilgi için daha ayrıntılı çalışmalara ve anketlere başvurmayı önerir.

Eagle’ın çalışması, MLLM’ler için görsel kodlayıcı tasarımlarını iyileştirme odaklı araştırmalarla yakından ilgilidir. Erken çalışmalar genellikle CLIP ve EVA-CLIP gibi görsel-dil hizalama görevlerinde ön eğitilmiş görsel kodlayıcıları benimsemiştir. Daha güçlü görsel kodlayıcılar, Örneğin SigLIP ve InternVL, daha iyi tasarımlar, daha büyük model boyutları ve daha etkili eğitim reçeteleri ile görsel-dil görevlerini iyileştirmek için önerilmiştir. Modeller genellikle düşük çözünürlüklü görüntülerde ön eğitilir ve ince detayları kodlama yeteneğinden yoksun olabilir, bu nedenle daha yüksek çözünürlük adaptasyonu sıklıkla MLLM girişi çözünürlüğünü artırmak için gerçekleştirilir. Daha yüksek çözünürlük adaptasyonuna ek olarak, LLaVA-NeXT, LLaVA-UHD, Monkey, InternLM-XComposer ve InternVL gibi modeller, yüksek çözünürlüklü girişi işleme için tılamayı veya adaptif tılamayı kullanır, burada görüntüler daha düşük çözünürlüklü parçalara bölünür ve ayrı ayrı işlenir. Görsel uzmanların eklenmesiyle yüksek çözünürlüklü işlemenin mümkün hale gelmesi, tılama tekniklerinden biraz farklıdır, ancak her iki yaklaşım da uyumludur ve birleştirilebilir.

EAGLE: MLLM’ler için Tasarım Alanını Araştırma için Kodlayıcıların Karışımı Kullanma

Büyük dil modellerinin (LLM’ler) başarısı, görsel algı yeteneklerini etkinleştirmeye yönelik önemli bir ilgiyi tetikledi, böylece bunlar gerçek dünyada görebilir, anlayabilir ve akıl yürütebilir. Bu karma mod besar dil modellerinin (MLLM’ler) çekirdeğinde, görüntülerin bir dizi görsel token’e dönüştürülmesi ve metin gömme ile eklenmesi için bir görsel kodlayıcı bulunur. CLIP genellikle görsel kodlayıcı olarak seçilir, çünkü görsel temsil, görsel-dil çiftleri üzerinde ön eğitim yoluyla metin alanı ile hizalanır. Mimarilere, eğitim reçetelerine ve görsel token’lerin dil modeline enjekte edilme şekline bağlı olarak,著名 MLLM aileleri arasında Flamingo, BLIP, PaLI, PaLM-E ve LLaVA bulunur. Bu modellerin więkseliği, ön eğitilmiş görsel kodlayıcıların ve LLM dizisi uzunluğunun sınırlamaları nedeniyle nispeten düşük girişi çözünürlüklerini korur. Eagle’ın çalışması, birden fazla görsel kodlayıcı kullanarak algılamayı iyileştiren modellerle yakından ilgilidir.

Örneğin, Mini-Gemini ve LLaVA-HR, yüksek çözünürlüklü görsel özelliklerini düşük çözünürlüklü görsel token’lerle birleştirmeyi önerir. Çözünürlük sorunlarının ötesinde, bu ön eğitilmiş görsel kodlayıcılar metin okuma veya nesne lokalizasyonu gibi belirli yeteneklerden yoksun olabilir. Bunu ele almak için, çeşitli modeller farklı görsel görevlerde ön eğitilmiş görsel kodlayıcıları entegre eder, böylece görsel kodlayıcıların yeteneklerini iyileştirir.

Sonuç olarak, recent çalışmalar göstermiştir ki, daha güçlü görsel kodlayıcı tasarımları, MLLM hallucinasyonlarını azaltma ve optik karakter tanıma gibi çözünürlük duyarlı görevlerde performansı iyileştirmede önemlidir. Birkaç çalışma, görsel kodlayıcıların yeteneklerini, ön eğitim verilerini ve parametrelerini ölçeklendirme veya daha etkili eğitim reçeteleri kullanarak iyileştirmeye odaklanmaktadır. Ancak bu yaklaşımlar genellikle büyük eğitim kaynağı talepleri getirir. Bir verimli ancak güçlü strateji, farklı görevlerde ve girişi çözünürlüklerinde ön eğitilmiş görsel kodlayıcıların karışımıdır, ya da CLIP kodlayıcısı ile daha yüksek çözünürlüklü kodlayıcıları birleştirmek, veya farklı kodlayıcılardan özelliklerini sırayla eklemek, veya daha karmaşık birleştirme ve yönlendirme stratejilerini benimsemek. Bu “görsel uzmanların karışımı” yaklaşımı etkili olmuştur, ancak tasarım alanının ayrıntılı bir çalışması ve soykütüğü masih eksikliği mevcuttur, bu da Eagle’ın bu alana yeniden bakmasını motive etmektedir. Ana sorular masih mevcuttur: hangi görsel kodlayıcı kombinasyonlarını seçmek, nasıl farklı uzmanları birleştirmek, ve nasıl eğitim stratejilerini birden fazla görsel kodlayıcı ile ayarlamak.

Bu soruları ele almak için, Eagle MLLM’ler için görsel kodlayıcıların karışımı tasarım alanını sistematik olarak araştırır. Bu tasarım alanının araştırılması, aşağıdaki adımları içerir: 1) çeşitli görsel kodlayıcıları benchmarklama ve daha yüksek çözünürlük adaptasyonu arama; 2) görsel kodlayıcı birleştirme stratejileri arasında “elma ile elma” karşılaştırması yapma; 3) birden fazla görsel kodlayıcıların optimal kombinasyonunu ilerleyici olarak tanımlama; 4) görsel uzman ön hizalamasını ve veri karışımını iyileştirme. Araştırma adımları aşağıdaki resimde gösterilmektedir.

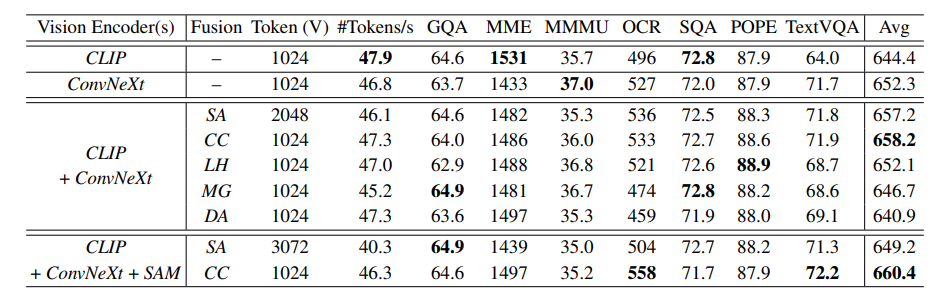

Eagle’ın çalışması, görsel-dil hizalama, öz-özgün öğrenme, nesne tespiti, segmentasyon ve optik karakter tanıma gibi farklı görevlerde ve çözünürlüklerde ön eğitilmiş görsel kodlayıcıların performansını kapsar. Bir tur-robin yaklaşımı kullanarak, Eagle temel CLIP kodlayıcısı ile başlar ve her turda bir ek uzman ekler, her turda en iyi gelişmeyi sağlayan uzmanı seçer.

Eagle’ın çalışması, mevcut popüler birleştirme stratejilerinin, tasarım varyasyonlarına rağmen, aşağıdaki kategorilere ayrılabileceğini观察 eder:

- Dizi Ekleme: Farklı gövdelere ait görsel token’leri doğrudan daha uzun bir dizi olarak eklemek.

- Kanalların Birleştirilmesi: Görsel token’leri kanal boyutunda birleştirmek, dizi uzunluğunu artırmadan.

- LLaVA-HR: Yüksek çözünürlüklü özellikleri, düşük çözünürlüklü görsel kodlayıcılara, bir karışım-çözünürlük adaptörü kullanarak enjekte etmek.

- Mini-Gemini: CLIP token’lerini, düşük çözünürlüklü sorgular olarak kullanarak, başka bir yüksek çözünürlüklü görsel kodlayıcıya, yerel pencerelerde çapraz dikkat kullanarak erişmek.

- Deformable Dikkat: Mini-Gemini’nin üzerine kurulan yeni bir temel, burada pencere dikkat yerine deformable dikkat kullanılır.

LLaVA’nın orijinal ön eğitim stratejisindeki gibi, birden fazla görsel uzmanı aynı anda hizalamak için bir projeleyici eğitmek yerine, her bir个 görsel uzmanı, daha küçük bir dil modeli (pratikte Vicuna-7B) ile ön hizalamak için next-token-prediction denetimi kullanılır. Aşağıdaki resimde gösterildiği gibi, ön hizalamayla, tüm eğitim süreci üç adımdan oluşur: 1) her ön eğitilmiş görsel uzmanı, kendi projeleyicisi ile SFT verisi üzerinde, dil modeli dondurularak eğitme; 2) ilk adımdan tüm görsel uzmanları birleştirme ve sadece projeleyiciyi, görsel-dil çiftleri verisi üzerinde eğitme; 3) tüm modeli SFT verisi üzerinde eğitme.

EAGLE: Yöntem ve Mimarisi

Önceki yöntemlerin çoğunun, yeni birleştirme stratejileri veya mimarileri geliştirmeye odaklanması yerine, Eagle’ın amacı, farklı görsel kodlayıcıları birleştirmek için minimal bir tasarım tanımlamaktır, bu da ayrıntılı soykütüğü ve gereksiz bileşenlerin kaldırılması ile desteklenir. Aşağıdaki resimde gösterildiği gibi, Eagle, temel CLIP kodlayıcısını, farklı mimarilere, ön eğitim görevlerine ve çözünürlüklere sahip bir dizi görsel uzmana genişletir. Bu uzmanlarla, Eagle daha sonra farklı birleştirme mimarileri ve yöntemlerini karşılaştırır ve birden fazla kodlayıcı ile ön eğitim stratejilerini nasıl optimize edeceğini araştırır.

Son olarak, Eagle tüm bulguları birleştirir ve yaklaşımı, farklı çözünürlüklerde ve alan bilgilerinde birden fazla uzman görsel kodlayıcı ile genişletir. LLaVA-1.5 ile aynı ön eğitim verilerini kullanarak, Eagle 595k görsel-dil çiftlerinden oluşur. Denetlenen fine-tuning aşamasına geçmek için, Eagle bir dizi görevden verileri toplar ve bunları çok modelli sohbetlere dönüştürür, bu görevler arasında LLaVA-1.5, Laion-GPT4V, ShareGPT-4V, DocVQA, synDog-EN, ChartQA, DVQA ve AI2D bulunur, bu da 934k örnek ile sonuçlanır.

Model önce, bir epoch için 256’lık bir batch boyutu ile görsel-dil çiftleri üzerinde ön eğitilir, burada tüm model dondurulur ve sadece projeleyici güncellenir. İkinci aşamada, model bir epoch için 128’lik bir batch boyutu ile denetlenen fine-tuning verisi üzerinde eğitilir. Bu araştırma için, Eagle Vicuna-7B’yi temel dil modeli olarak kullanır. Öğrenme oranları, ilk aşama için 1e-3 ve ikinci aşama için 2e-5 olarak ayarlanır.

Daha Güçlü CLIP Kodlayıcısı

Eagle, CLIP modeli ile araştırmasını başlatır, çünkü CLIP birçok MLLM için birincil seçim haline gelmiştir. CLIP modelleri, çok modelli görevleri iyileştirdiği bilinmektedir, ancak sınırlamaları da iyi belgelenmiştir. Örneğin, mevcut birçok MLLM, ön eğitilmiş CLIP çözünürlüklerini (örneğin, 224 × 224 veya 336 × 336) girişi çözünürlüğü olarak kullanır. Bu durumlarda, kodlayıcılar genellikle optik karakter tanıma ve belge anlama gibi çözünürlük duyarlı görevlerde ince detayları yakalamakta zorluk çekebilir.

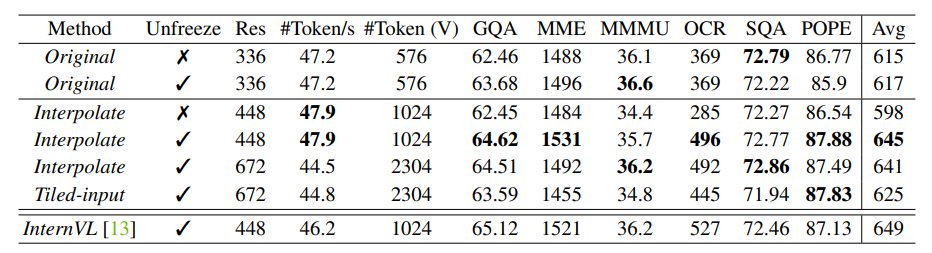

Girişi çözünürlüğünü artırmak için, bir ortak yaklaşım tılamadır, burada girişi görüntüleri daha küçük parçalara bölünür ve ayrı ayrı kodlanır. Bir başka daha basit yöntem, doğrudan girişi çözünürlüğü ölçeklemek ve gerektiğinde görüsel transformör modelinin konum gömmelerini interpolasyon ile güncelmektir. Eagle, bu iki yaklaşımı, dondurulmuş ve dondurulmamış görsel kodlayıcılar ile farklı çözünürlüklerde karşılaştırır, sonuçlar yukarıdaki tabloda yer alır. Bulgular aşağıdaki gibi özetlenebilir:

- CLIP kodlayıcısını dondurmak, görsel kodlayıcının ön eğitim çözünürlüğünden farklı bir MLLM girişi çözünürlüğüne interpolasyon yaparken performansı önemli ölçüde iyileştirir, aynı zamanda aynı çözünürlüklerde herhangi bir performans kaybı olmadan.

- CLIP kodlayıcısını dondurmak ve doğrudan daha yüksek bir MLLM girişi çözünürlüğüne adaptasyon yapmak, performansı önemli ölçüde bozar.

- Karşılaştırılmış stratejiler arasında, dondurulmamış bir CLIP kodlayıcısı ile doğrudan 448 × 448’e interpolasyon yapmak, hem performans hem de maliyet açısından etkili ve verimlidir.

- En iyi CLIP kodlayıcısı, daha küçük bir model (300M vs. 6B) ve daha az ön eğitim verisi ile InternVL’ye yakın performansa ulaşır.

CLIP-448, Eagle’ın LLaVA-HR ve InternVL ile aynı ayarları paylaşmasını sağlar, burada CLIP kodlayıcıları da 448 × 448 girişi almak ve 1024 yama token’leri üretmek için uyarlanır. Daha ileri bir araştırma için, Eagle basit bir şekilde girişi çözünürlüğü ölçekleme ve görsel kodlayıcısını eğitim sırasında kilidini açma stratejisini takip eder.

Eagle, mevcut popüler birleştirme stratejilerinin, tasarım varyasyonlarına rağmen, aşağıdaki kategorilere ayrılabileceğini观察 eder:

- Dizi Ekleme: Farklı gövdelere ait görsel token’leri doğrudan daha uzun bir dizi olarak eklemek.

- Kanalların Birleştirilmesi: Görsel token’leri kanal boyutunda birleştirmek, dizi uzunluğunu artırmadan.

- LLaVA-HR: Yüksek çözünürlüklü özellikleri, düşük çözünürlüklü görsel kodlayıcılara, bir karışım-çözünürlük adaptörü kullanarak enjekte etmek.

- Mini-Gemini: CLIP token’lerini, düşük çözünürlüklü sorgular olarak kullanarak, başka bir yüksek çözünürlüklü görsel kodlayıcıya, yerel pencerelerde çapraz dikkat kullanarak erişmek.

- Deformable Dikkat: Mini-Gemini’nin üzerine kurulan yeni bir temel, burada pencere dikkat yerine deformable dikkat kullanılır.

EAGLE: Deneyler ve Sonuçlar

Dikkatli bir şekilde stratejilerini geliştirdikten sonra, Eagle aşağıdaki prensipleri modeli için belirlemiştir: (1) daha fazla görsel uzmanı entegre etmek ve optimize edilmiş bir eğitim reçetesi ile; (2) birden fazla görsel uzmanı, doğrudan kanal birleştirme ile birleştirmek; (3) görsel uzmanları ayrı ayrı ön hizalama yoluyla önceden hizalamak. Bu bölümde, Eagle modellerinin avantajlarını daha da göstermek için, ek eğitim verileri entegre edilir ve Eagle, çeşitli görevlerde mevcut en iyi MLLM’ler ile karşılaştırılır. Eagle, Vicuna-v1.5-7B, Llama3-8B ve Vicuna-v1.5-13B’yi dil modelleri olarak kullanır. Görsel kodlayıcılar için, Bölüm 2.6’daki sonuçlara dayanarak, Eagle modelleri Eagle-X4 olarak adlandırılır, bu dört görsel kodlayıcıyı içerir: CLIP, ConvNeXt, Pix2Struct ve EVA-02, ve Eagle-X5, bir SAM görsel kodlayıcısı da dahil olmak üzere.

Görsel Soru Cevaplandırma Görevleri

Eagle, model serisini üç Görsel Soru Cevaplandırma (VQA) benchmark’lerinde karşılaştırır: GQA, VQAv2 ve VizWiz. Aşağıdaki tabloda gösterildiği gibi, Eagle-X5 GQA ve VQAv2’de en iyi performansı gösterir, böylece ilave görsel uzmanların entegrasyonunun avantajlarını vurgular.

OCR ve Grafik Anlama Görevleri

Eagle’ın OCR, belge ve grafik anlama yeteneklerini değerlendirmek için, model OCRBench, TextVQA ve ChartQA’da benchmarklanır. Yukarıdaki tabloda gösterildiği gibi, Eagle TextVQA’da rakiplerini önemli ölçüde geçer, yüksek çözünürlüklü mimarisi ve farklı görsel kodlayıcıların entegrasyonu sayesinde yararlanır. Eagle, kompleks tile parçalama gerektirmeden 1024 token’i destekleyen basit bir tasarım korur.

Aşağıdaki resim, OCR ve belge anlama örneklerini sunar. Yüksek çözünürlüklü adaptasyon ve birden fazla görsel uzmanın entegrasyonu ile, Eagle küçük metinleri görüntüler içinde tanımlayabilir ve kullanıcı talimatlarına dayalı olarak bilgileri doğru bir şekilde çıkarabilir.

Farklı görevlerde ön eğitilmiş ilave görsel uzmanların getirdiği avantajları daha iyi anlamak için, aşağıdaki resim, sadece ConvNeXt ve CLIP görsel kodlayıcılarına sahip bir modelin sonuçlarını, Eagle-X5’in sonuçları ile karşılaştırır. Tam görsel kodlayıcı seti ile, model başarılı bir şekilde hataları düzeltir, bu da yüksek çözünürlüklü görsel kodlayıcılar ile birlikte, çeşitli görsel görevlerde ön eğitilmiş ilave görsel uzmanların entegrasyonunun yeteneklerini daha da geliştirdiğini gösterir.

Çok Modelli Benchmark Değerlendirmesi

Eagle, MLLM’lerin yeteneklerini çeşitli açılardan değerlendirmek için yedi benchmark’de değerlendirilir: MME, MMBench, SEED, MathVista, MMMU, ScienceQA ve POPE. Özellikle, MME, MMBench ve SEED, çeşitli gerçek dünya görevlerinde, akıl yürütme, tanıma, bilgi ve OCR dahil olmak üzere genel performansı değerlendirir. MMMU, kolej düzeyinde bilgi gerektiren çeşitli alanlardan zorlu sorunlara odaklanır. POPE, MLLM’lerin görsel hallucinasyonlarını değerlendirir. Kullanılan metrikler, bu benchmark’lerin varsayılan ayarlarına uyumlu olarak belirlenir. Eagle, MME için algılama puanını, MMBench için en_dev bölünmesini, SEED için görüntü bölünmesini, MathVista için test-mini bölünmesini, MMMU için val bölünmesini, POPE için F1 puanını ve ScienceQA için görüntü puanını raporlar, bu da diğer modellerden bildirilen puanlarla uyumlu olur.

Son Düşünceler

Bu makalede, görsel kodlayıcıların karışımı ile MLLM’lerin tasarım alanının kapsamlı bir araştırmasını sunduk, Eagle. Önceki çalışmaların çoğunun yeni birleştirme paradigmaları veya mimarileri geliştirmeye odaklanması yerine, Eagle sistematik tasarım seçimlerinin önemini vurgular ve faydalı teknikler keşfeder. Adım adım, Eagle bireysel görsel kodlayıcıların eğitim reçetelerini optimize eder, genişletilebilir ve verimli bir birleştirme yöntemi tanımlar ve dần dần farklı alan bilgilerine sahip görsel kodlayıcıları birleştirir. Sonuçlar, temel tasarım alanı dikkate alma konusundaki kritik önemini vurgular.