Anderson’un Açısı

Jigsaw Puzzles AI’nin Görsel Mantığını Geliştirir

Yeni araştırmalar, AI modellerinin jigsaw puzzle’ları çözerek görsel yeteneklerini geliştirebileceğini gösteriyor. Karışık resimleri, videoları ve 3D sahneleri yeniden düzenlemek, onlara ek veri, etiketler veya araçlar olmadan görsel becerilerini keskinleştirmelerine yardımcı oluyor.

Mevcut Multimodal Large Language Models (MLLMs*) yarışında öne geçmek veya en azından en yakın rakibin üç sürüm önüne geçmek için, kolay kazançlar yok ve bedava yemekler bulunmuyor.

2025’in bir dizi etkileyici Çin FOSS sürümlerinin daha düşük geliştirme ve çalıştırma maliyetlerine sahip olduğu bildiriliyor, ancak batılı sürümler genellikle problema daha fazla veri hacmi, daha fazla çıkarım gücü, daha fazla elektrik (ancak son zamanlarda dikkat çektiğimiz gibi, daha fazla gerçek insan annotatörü değil, çünkü bu bile $trilyon+ ölçekli gen-AI devrimi için bile çok pahalı).

Araştırmalarda, AI mimarilerinin gelişimine yönelik çoğu iddia edilen “ücretsiz” yaklaşım, yalnızca küçük ölçekli artımlı iyileştirmeler sunuyor veya en çok aranan alanlarda değil; Buna rağmen, AI gelişimini hızlandırabilecek yeni, keşfedilmemiş “temel ilkeleri” aramak çok çekici.

Parçaları Toplamak

Bu kategoriye tam olarak uymasa da, Çin kurumları arasındaki yeni bir akademik işbirliği, VLM’lerin jigsaw puzzle’ları çözmesini sağlamanın performansını önemli ölçüde iyileştirdiğini iddia ediyor; bu pekiştirme öğrenimi yaklaşımı, bu alanda daha önce kötü performans göstermişti ve ayrıca ek sistemler, yardımcı modeller veya diğer “ek” süreçler gerektirmedi.

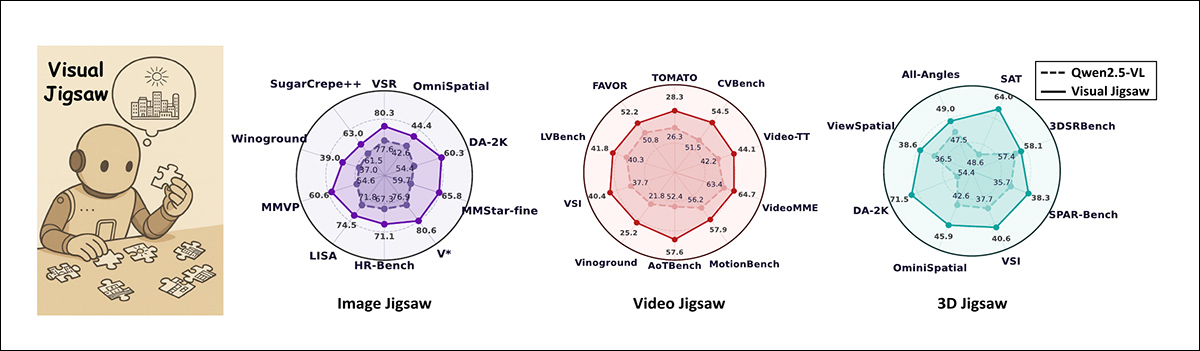

Görsel Jigsaw, multimodal büyük dil modellerinde görme odaklı becerileri geliştiren bir öz-üstlenik sonrası eğitim çerçevesidir. Resimler, videolar ve 3D veriler boyunca jigsaw görevleri üzerinde eğitim, modellere resimlerde daha keskin ince detaylı, uzaysal ve bileşik algı, videolarda daha güçlü zamanlı akıl yürütme ve 3D sahnelerde daha güçlü geometri farkındalığı sağlar. Kaynak: https://arxiv.org/pdf/2509.25190

Araştırmacılar tarafından geliştirilen sistem Görsel Jigsaw olarak adlandırıldı ve mevcut MLLM’leri parçalanmış ve rasgele dağıtılmış materyallerle eğitim içerir; yazarlar, bu yaklaşımın üç modu geliştirdiler: resim, video ve 3D (yani, CGI-stil meshes).

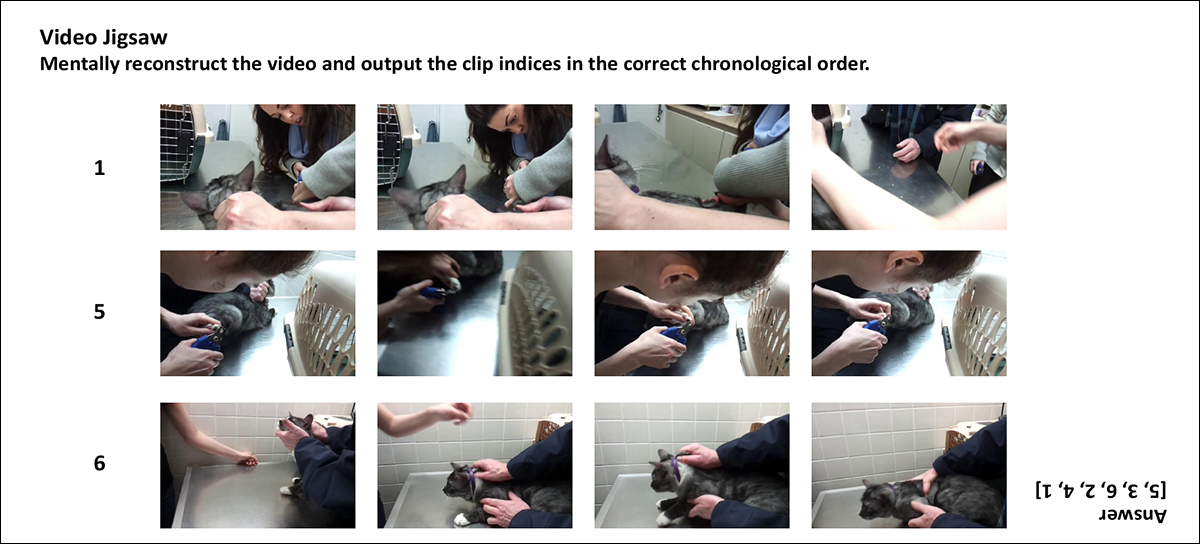

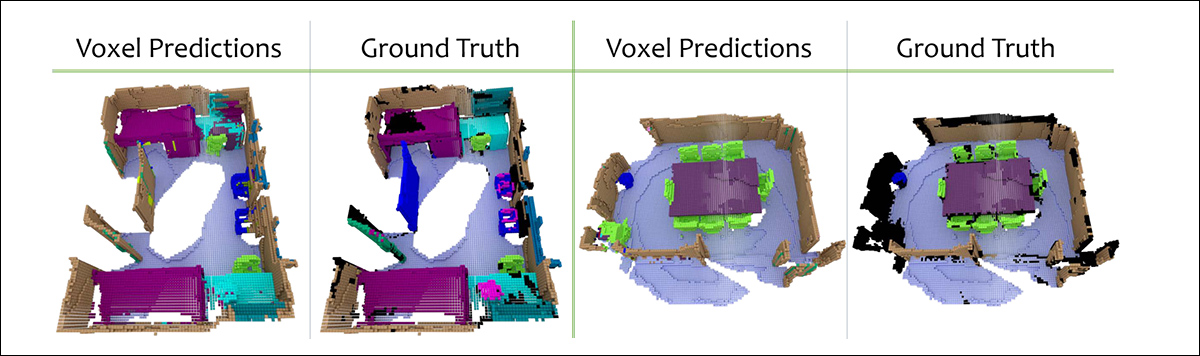

Görsel Jigsaw görevlerinin bir temsilini gösteren resim. Resim Jigsaw’da, bir resim parçalara bölünür, karıştırılır ve model doğru düzeni öngörür; Video Jigsaw’da, klipler karıştırılır ve model zaman içinde sıralarını geri yükler; 3D Jigsaw’da, farklı derinliklere sahip noktalar karıştırılır ve model onları en yakından en uzağa doğru sıralar.

Görsel Jigsaw’un eğitim yöntemi, AI modellerinin görsel bilgileri anlama yeteneklerini, bu karışık resimleri, video kliplerini veya 3D verileri yeniden birleştirerek geliştirir.

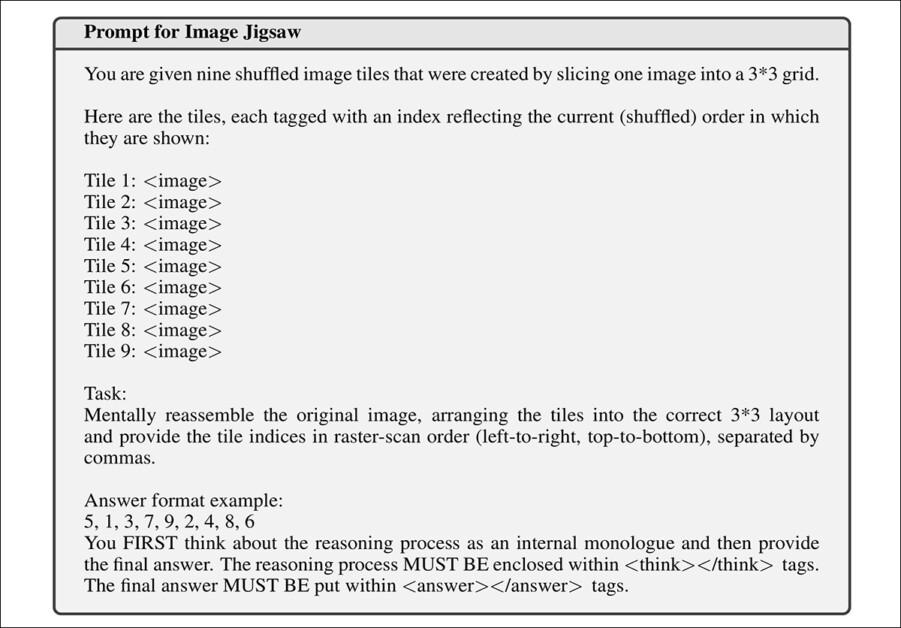

Süreç, resimlerden ziyade kelimelere dayalıdır ve bu nedenle modelin resimler oluşturması veya herhangi bir ek görsel bileşen kullanması gerekmez. Bu yöntem, Onaylanabilir Ödüllerden Pekiştirme Öğrenimi (RLVR) olarak adlandırılan bir sisteme uyuyor; burada model, net, otomatik kurallara dayalı olarak doğru cevaplar için ödüllendirilir ve bu nedenle insan etiketlemesine gerek yoktur.

Bu kritik gerçek, yeni makaleden anlaşılması zor bir noktadır: sistem, anlamsal olarak, açıklamalar yoluyla, insanların böyle puzzle’ları çözme şekline benzer şekilde değil.

Yeni makalenin ek malzemelerinden bir örnek RL görevi, bu ek öğrenme sürecinin metin tabanlı doğasını gösteriyor. Modelin gösterilen resimlere bakılmıyor.

MLLM’ler, görme odaklı görevlerle çok ilgilenseler de, dil tabanlı mimarilerdir, resim, video veya şekil temsileleri gibi 3D mesh’ler oluşturmak için tasarlanmamışlardır.

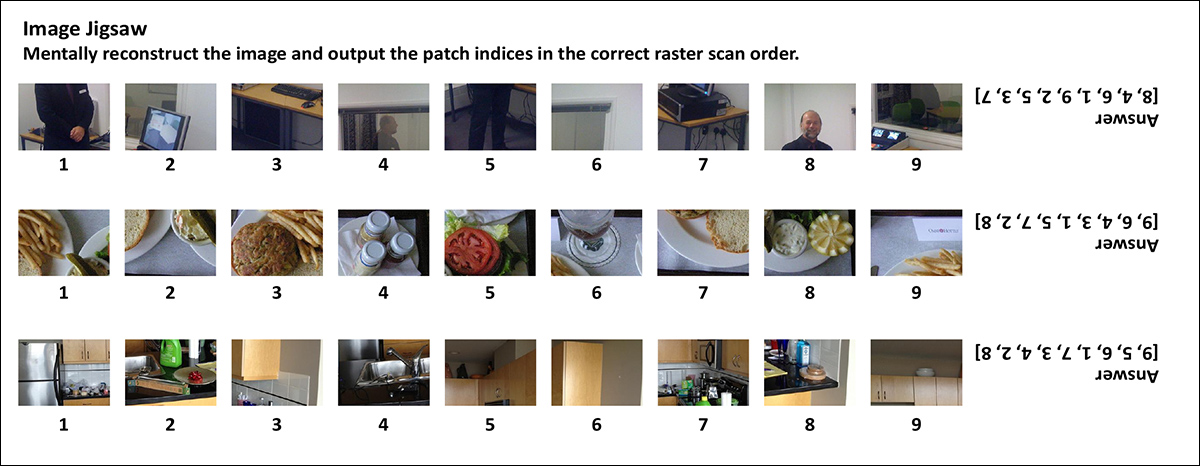

Resim jigsaw görevinden örnekler. Her satır, modelin orijinal düzenini geri yüklemesi gereken karıştırılmış parçaları gösterir, doğru düzen sağ tarafta gösterilir.

Bu tür eğitim, modelin zaten bazı resim anlama yeteneklerine sahip olduğu ana öğrenme aşamasından sonra yapılır.

Önceki yaklaşımlar, 2017 İsviçre makalesi Görsel Temsillerin Jigsaw Puzzle’ları Çözerek Ücretsiz Öğrenimi gibi, bu tür pekiştirme yaklaşımını kullandı, ancak convolutional neural networks (CNNs) gibi farklı bir mimari üzerinde ve daha az başarıyla.

2017 sürümünden ‘Görsel Temsillerin Jigsaw Puzzle’ları Çözerek Ücretsiz Öğrenimi’, nöral bir sistem için bir ödül tabanlı meydan okuma olarak parçalemenin erken bir örneği. Kaynak: https://arxiv.org/pdf/1603.09246

Testlerde, Görsel Jigsaw, yazarların iddia ettiği gibi, çeşitli benchmark’ler boyunca tutarlı ve ölçülebilir iyileştirmeler sağladı: resim jigsaw görevi, ince detaylı algı, uzaysal düzen anlama ve bileşik akıl yürütme için iyileşme sağladı; video jigsaw görevi, modelin zamanlı dizileri takip etme ve olay sırasını akıl yürütme yeteneğini güçlendirdi ve 3D jigsaw görevi, yalnızca RGB-D girişleri kullanarak derinlik tabanlı anlama ve uzaysal akıl yürütme yeteneğini güçlendirdi.

Üç modda da, makale, yeni yöntemin, ek mimari değişiklikler, ek görsel modüller veya ek denetimli veri gerektirmeden, çeşitli rekabetçi temel modelleri aştığını tekrarlıyor:

‘Geniş kapsamlı deneyler, ince detaylı algı, zamanlı akıl yürütme ve 3D uzaysal anlama konularında önemli iyileştirmeler gösteriyor. Bulgularımız, MLLM’lerin son eğitiminde görme odaklı öz-üstlenik görevlerin potansiyelini vurguluyor ve görme odaklı ön görev tasarımları üzerine daha fazla araştırmaya ilham vermeyi amaçlıyor.’

Yeni makale, Görsel Jigsaw Sonrası Eğitim MLLM’leri İyileştirir olarak adlandırıldı ve Nanyang Teknoloji Üniversitesi, Linköping Üniversitesi ve SenseTime Research’tan altı araştırmacı tarafından geldi. Makale, canlı demo’lar (ve kendi resiminizi resim tabanlı jigsaw demo’suna yükleyebilirsiniz) bulunan bir proje sitesi ile birlikte geliyor. Projenin kodu ve ağırlıkları, genel olarak erişime açık hale getirildi,

Yöntem

Test edilen üç modu nasıl böldüklerine bakmadan önce, yeni sistemin ödül tasarımını ele alalım.

Görsel Jigsaw yaklaşımı, model yanıtlarını dereceli bir ödül kullanarak puanlar, sadece basit bir geç/kaleyh değildir. Model, jigsaw parçalarının tam olarak doğru sıralamasını öngörürse, tam bir ödül alır; cevabı kısmen doğruysa, ancak mükemmel değilse, model, indirgeme faktörü ile ölçeklendirilmiş kısmi kredi alır; bu, modelin kısmen doğru cevapları tekrarlayarak sistemiManipüle etmesini önler (bu, modelin yalnızca kısmen doğru olan tahminleri tekrar tekrar yapmasını engeller).

Geçersiz cevaplar, örneğin aynı numarayı tekrar tekrar kullanmanın “hilesi” gibi, sıfır puan alır. Tutarsız biçimlendirmeyi teşvik etmek için, model, akıl yürütmelerini <think> etiketleri içinde ve son cevaplarını <answer> etiketleri içinde yerleştirmelidir. Biçimi doğru kullanılırsa küçük bir bonus alır.

Resimler

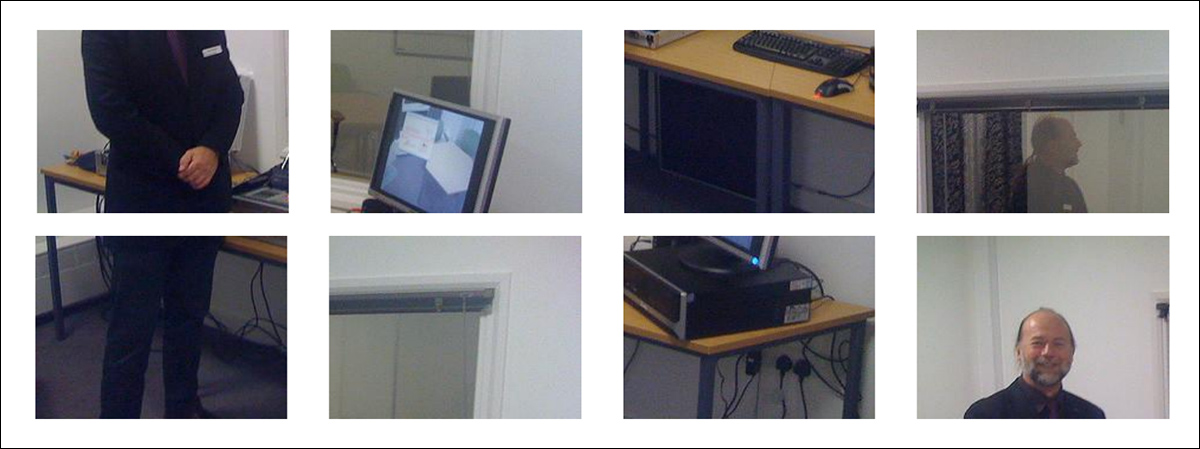

resimler modu için bir puzzle oluşturmak için, bir resim önce eşit büyüklükte bloklara bölünerek bir ızgara içine yerleştirilir:

Sistem tarafından çözülmesi gereken resim tabanlı parçaların örnekleri.

Parçalar, sayfa上的 okuma sırasına benzer şekilde, soldan sağa ve üstten alta sabit bir sırayla düzenlenir, daha sonra rasgele karıştırılır. Model, bu karıştırılmış parçaları görür ve orijinal düzeni, doğru permütasyonu öngörmek suretiyle geri yüklemelidir.

Eğitimde, COCO veri kümesinden 118.000 resim kullanıldı, her resim dokuz parça (yani, “puzzle parçaları”) verdi. Sisteme verilen.prompt, bu makalenin önceki kısımlarında gösterildi (yazıdaki resim, “Yeni makalenin ek malzemelerinden bir örnek RL görevi…” başlıklı).

Video

Video jigsaw görevi için, bir video, zaman içinde eşit aralıklarla kesilerek bir dizi klip oluşturulur ve daha sonra bu klip parçaları karıştırılır. Model, bu karıştırılmış diziyi görür ve zaman içinde sıralarını geri yüklemelidir.

Video puzzle meydan okumasının örnekleri, makalenin ek malzemelerinden.

Eğitim, LLaVA-Video veri kümesinden 100.000 video kullanılarak yapıldı, her video altı klip oluşturdu. Modelin, klip sınırlarındaki açık çerçeve eşleştirme ipuçlarını sömürmesini önlemek için, her klipin başlangıç ve bitişindeki %5’lik çerçeve kesildi.

Her klip, en fazla 12 kare içeriyordu, her kare en fazla 128x28x28 piksel çözünürlüğe sahipti. 24 saniyeden kısa videolar dışlandı.

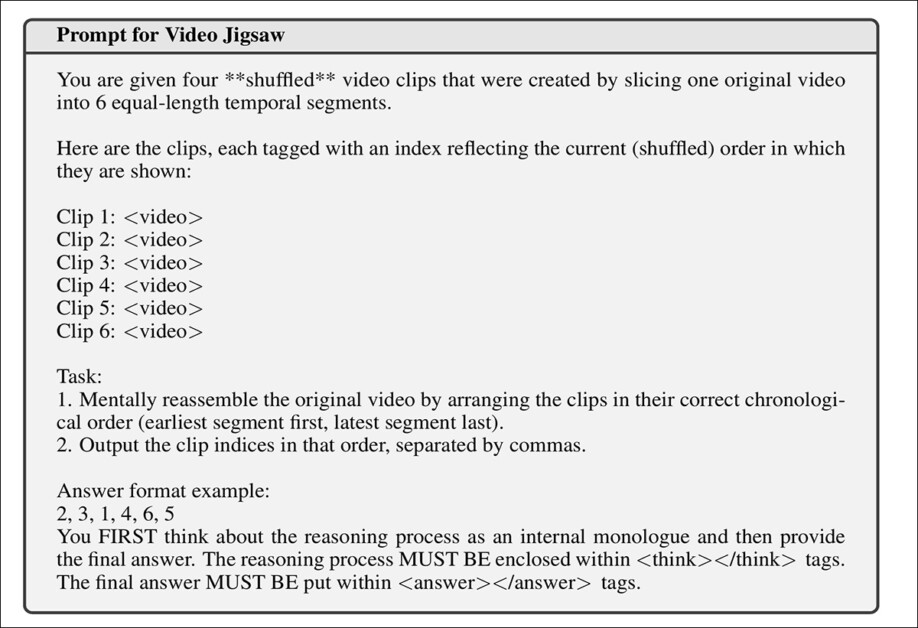

Bu görev için prompt aşağıdaki gibidir:

Video görevi için MLLM’lere sunulan pekiştirme öğrenimi prompt’ı, sunulan klipler olmadan.

3D Veri

Tam bir 3D jigsaw görevi genellikle, 3D uzayı (örneğin, voxel blokları veya nokta bulutu parçaları) daha küçük parçalara bölmeyi ve modelin orijinal uzaysal düzeni yeniden oluşturmasını gerektirir.

Ancak, ortalama bir MLLM, doğrudan 3D verilerini işleyemez, bunun yerine uzaysal olarak yorumlanan görüntü veya video girişlerine güvenir. Bu nedenle, 3D akıl yürütmesini जबक masih MLLM’lerle uyumlu tutarak da 3D akıl yürütmesini kullanmaya devam eden bir görev oluşturmak için, yazarlar, RGB-D görüntüleri (yani, her piksel için derinlik bilgisini içeren 2D görüntüler) kullanarak daha uygulanabilir bir varyant geliştirdiler.

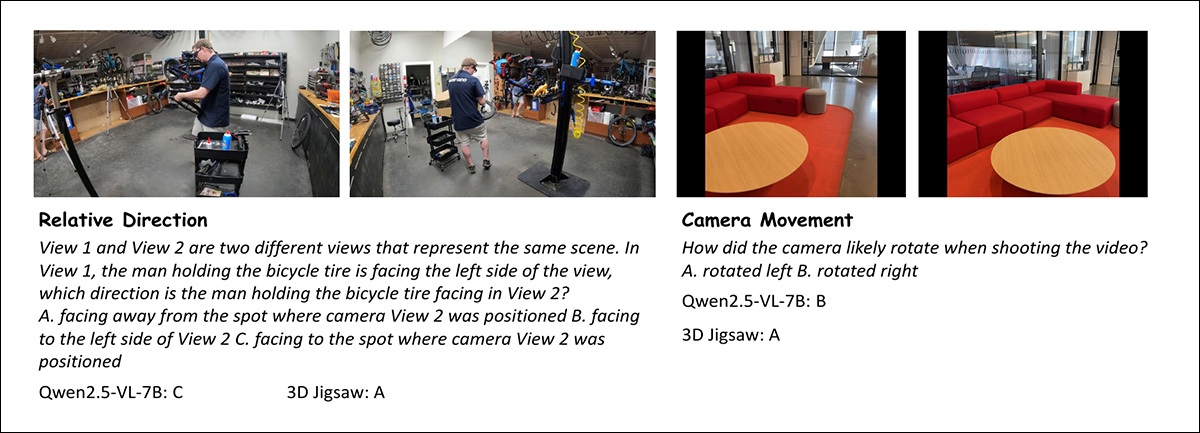

3D Uzaysal Anlama Benchmark’inden örnek sorular, göreli görüş ve kamera hareketi akıl yürütmesi değerlendirilir. 3D Jigsaw modeli, bir sahnenin iki görüşü arasındaki uzaysal ilişkiyi ve muhtemel kamera rotasyon yönünü doğru bir şekilde çıkarır ve Qwen2.5-VL-7B temel modelini geride bırakır.

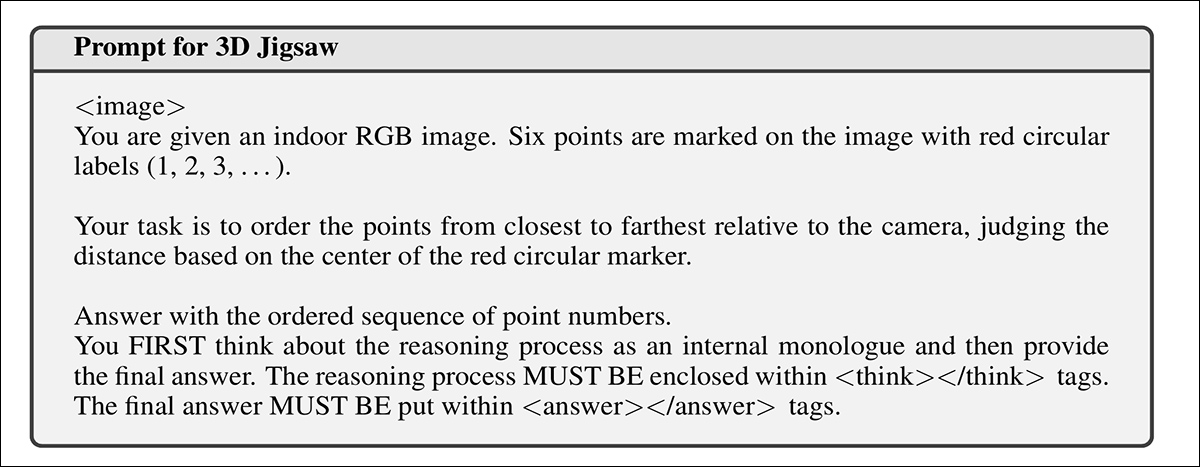

Her RGB-D görüntüsünden, model, orijinal olarak farklı derinliklere sahip noktaların karıştırılmış bir listesi verilir; amaç, bu noktaların derinlik sırasını, yalnızca 2D görüntüyü referans olarak kullanarak geri yüklemektir:

3D jigsaw için RL prompt’ı.

Her nokta, modelin gördüğü görüntüde işaretlenir (ancak yukarıdaki resimde doğrudan gösterilmez), ve model, hangisinin en yakın, hangisinin ikinci en yakın ve così weiter olduğunu öngörmelidir, böylece orijinal derinlik sıralamasını, ham derinlik değerlerine erişmeden yeniden oluşturur.

3D jigsaw görevi, ScanNet veri kümesinden RGB-D görüntüleri kullanarak 300.000 örnek üzerinden eğitildi, her görüntüden altı derinlik noktası seçildi.

3D jigsaw için kullanılan ScanNet veri kümesinden nokta bulutu örnekleri. Kaynak: https://arxiv.org/pdf/1702.04405

Her nokta, 0,1 ila 10 metre derinlik aralığında olmalı ve çeşitliliği teşvik etmek için, hiçbir iki nokta, görüntüdeki 40 pikselden veya derinlikte 0,2 metreden daha yakın olmamalıdır.

Testler

İlk testler için, sistem Qwen2.5-VL-7B-Instruct modelini temel MLLM olarak kullandı. Eğitim, Group Relative Policy Optimization (GRPO) algoritmasıyla yapıldı, hem KL düzenleme, hem de entropi kaybı kaldırıldı.

Kısmi öngörüler için, 0,2’lik bir indirgeme faktörü uygulandı. Resim jigsaw eğitimi, global toplu işleme boyutu 256 olarak ayarlanırken, video ve 3D jigsaw’lar 128 olarak ayarlandı. Öğrenme hızı 1×10⁻⁶ olarak belirlendi.

Her prompt için, model 16 yanıt üretti, 1,0’ın çözme sıcaklığı ile. Hem resim hem de video jigsaw görevleri 1.000 adım, 3D jigsaw görevi ise 800 adım boyunca eğitildi.

Resim Jigsaw

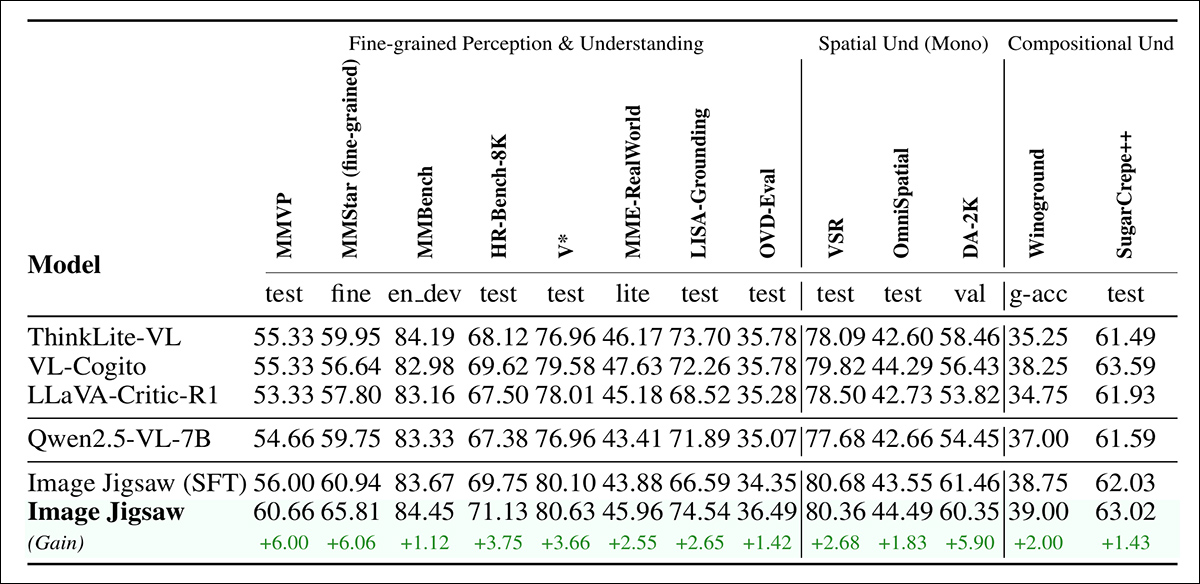

Resim jigsaw modeli, üç kategoriye ait görme odaklı benchmark’ler üzerinde test edildi: ince detaylı algı ve anlama için, MMVP, MMStar’ın ince detaylı algı alt kümesi; MMBench; MMBench; HR-Bench; V*; MME-RealWorld (lite); LISA-Grounding; ve OVD-Eval.

Tek görsel uzaysal anlama için benchmark’ler VSR; OmniSpatial; ve Depth Anything V2 (DA-2K). Bileşik görsel anlama için testler Winoground ve SugerCrepe++ kullanıldı.

Üç temel model test edildi, hepsi Qwen2.5-VL-7B’den türetilmiştir: ThinkLite-VL için multimodal akıl yürütme; VL-Cogito için genel görme ve bilimsel görevler; ve LLaVA-Critic-R1 için resim algısı.

Tüm modeller, yalnızca kısa cevaplar kullanılarak değerlendirildi, çünkü zincir düşünce (CoT) akıl yürütmesi bazen performansı azaltabiliyordu.

Resim benchmark’leri üzerindeki değerlendirme sonuçları. Resim Jigsaw, tüm görev kategorilerinde Qwen2.5-VL-7B temel modelini iyileştirdi ve önceki son eğitimli temel modelleri geride bıraktı.

Yazarlar, resim jigsaw sonuçları hakkında şunları söylüyor:

‘[Resim] gösteriyor ki, yöntemimiz, üç tür benchmark’te de görme odaklı yetenekleri tutarlı bir şekilde geliştiriyor. Bu sonuçlar, resim jigsaw son eğitimini MLLM’lerin algısal temellerini ve ince detaylı görme anlama yeteneklerini önemli ölçüde güçlendirdiğini doğruluyor, böylece akıl yürütme odaklı son eğitim stratejilerini aşarak.’

‘Bu iyileştirmeleri, modelin yerel parça ayrıntılarına dikkat etmesi, küresel uzaysal düzenleri çıkar etmesi ve parça arası ilişkileri akıl yürütmesi gerektiği için, doğrudan ince, uzaysal ve bileşik anlama yeteneklerine fayda sağladığına bağlıyoruz.’

Video Jigsaw

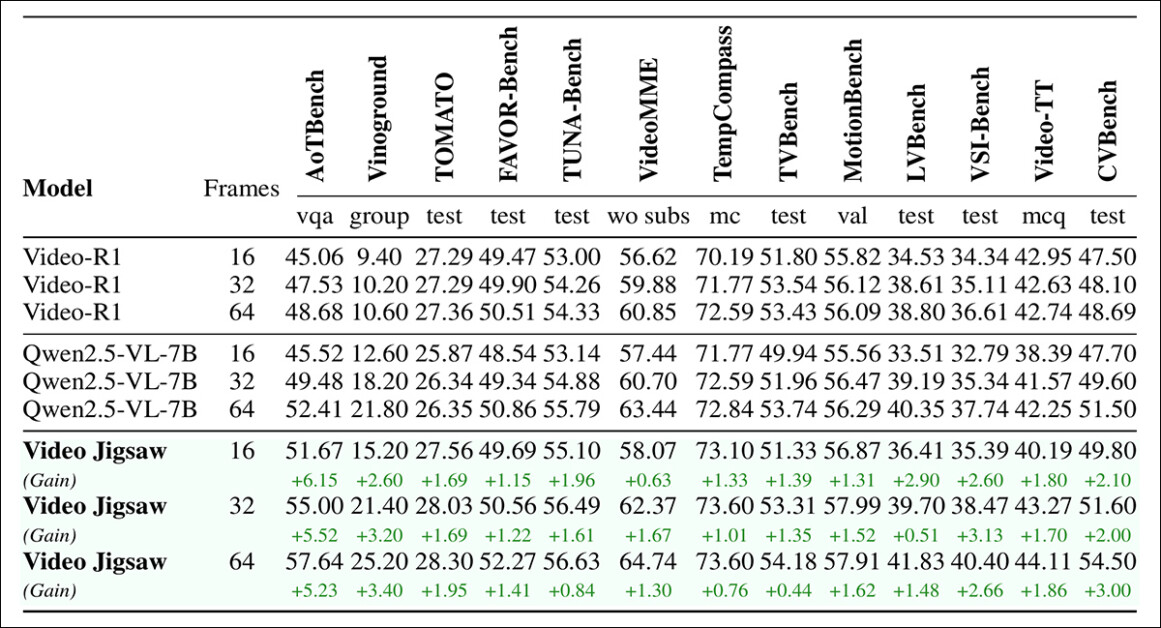

Video jigsaw için, değerlendirme AoTBench; Vinoground; TOMATO; FAVOR-Bench; TUNA-Bench; Video-MME; TempCompass; TVBench; MotionBench; LVBench; VSI-Bench; Video-TT; ve CVBench üzerinde yapıldı.

Video-R1 bir temel model olarak kullanıldı, soğuk başlangıçlı denetimli fine-tuning ile video anlama ve akıl yürütmesi için pekiştirme öğrenimi izledi. Bu durumda, değerlendirmeler tam akıl yürütme sürecini içeriyordu, çünkü bu genellikle doğrudan cevapları içerenden daha iyi sonuçlar üretiyordu.

Tüm modeller, 256x28x28 piksel ile sınırlı tutuldu ve üç kare ayarı boyunca test edildi – 16, 32 ve 64:

Video benchmark’leri üzerindeki değerlendirme sonuçları, Video Jigsaw’un tüm görevlerde ve kare ayarlarında tutarlı bir şekilde üstünlük sağladığını gösteriyor.

Video Jigsaw, tüm video anlama benchmark’lerinde ve kare ayarlarında tutarlı iyileştirmeler sağladı, özellikle zamanlı akıl yürütme ve yönlülük gerektiren görevlerde, örneğin AoTBench’de ve ayrıca video-arası akıl yürütme benchmark’lerinde, örneğin CVBench’de.

‘Bu sonuçlar, video jigsaw görevlerinin çözülmesinin, modelin zamanlı sürekliliği daha iyi yakalamasını, video arasındaki ilişkileri anlamasını, yön tutarlılığını akıl yürütmesini ve video anlama senaryolarına genellemesini teşvik ettiğini doğrular.’

3D Veri

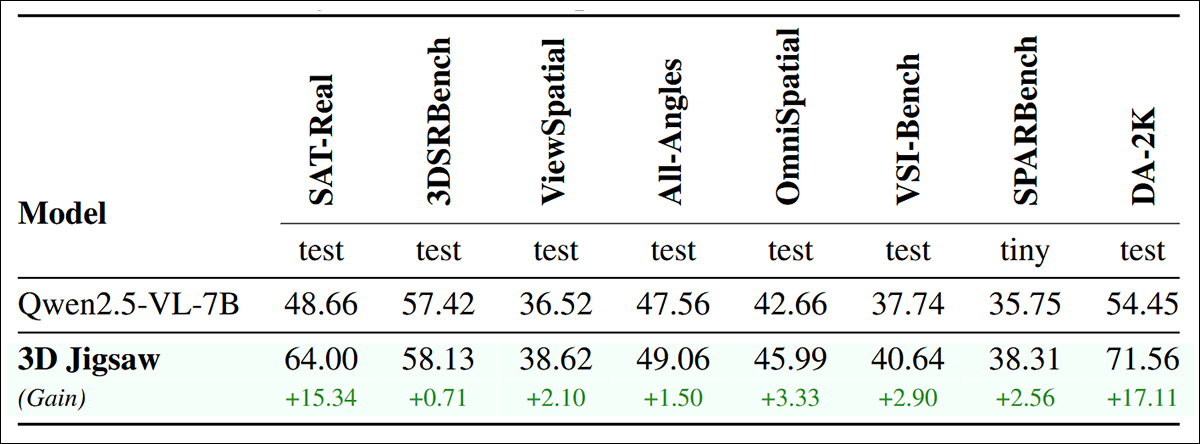

3D modu için, model SAT-Real; 3DSRBench; ViewSpatial; All-Angles; yukarıda bahsedilen OmniSpatial; VSI-Bench; SPARBench (küçük); ve yukarıda bahsedilen DA-2K üzerinde değerlendirildi.

3D benchmark’leri üzerindeki değerlendirme sonuçları: 3D Jigsaw, DA-2K gibi derinlik karşılaştırma görevlerinde ve daha geniş 3D algılama benchmark’lerinde, tek görüş, çoklu görüş ve egosentrik video girişlerini kapsayan görevlerde performansını iyileştirdi.

Yazarlar şunları söylüyor:

‘[3D] Jigsaw, tüm benchmark’lerde önemli iyileştirmeler sağlar. Beklendiği gibi, en büyük kazanç, doğrudan bizim önceden eğitim görevimizle ilgili olan derinlik tahmin benchmark’u DA-2K’de görülür. Daha da önemlisi, tek görüş (örneğin, 3DSRBench, [OmniSpatial]), çoklu görüş (örneğin, ViewSpatial, All-Angles) ve egosentrik video girişleri (örneğin, VSI-Bench) içeren daha geniş bir görev yelpazesinde tutarlı iyileştirmeler gözlemliyoruz.

‘Bu sonuçlar, yaklaşımımızın, sadece derinlik sıralaması gibi spesifik bir beceri öğretmekle kalmayıp, aynı zamanda modelin genel 3D uzaysal yapıyı algılama ve akıl yürütme yeteneğini güçlendirdiğini gösterir.’

Sonuç

Bu makalede, resim ve açıklamalar arasındaki ilişki tam olarak net değildir.

İlk bakışta, öğrenme süreci, bizim kendi erken gelişimimize benzer gibi görünüyor. Ancak, daha derin bir inceleme, dilin MLLM’ler için görsel ve anlamsal gerçeklikler arasında nasıl bir köprü oluşturduğunu gösteriyor.

* Lütfen unutmayın ki makale yazarları, daha az kullanılan ‘Multimodal Büyük Dil Modelleri’ terimini tercih ediyorlar, bu da ‘MLLMs’ olarak kısaltılır. Bu, yeni veya nadiren kullanılan bir terimdir ve görüntüleri geniş çapta uzaysal olarak analiz edebilen ve akıl yürütebilen ancak görüntüler üretemeyen modellere uygulanır. Yeni paradigmalar ve modeller ortaya çıktıkça, bu terminoloji sürekli olarak gözden geçiriliyor.

İlk olarak 2 Ekim 2025 Perşembe günü yayınlandı