Anderson’un Açısı

Bir ‘Zen’ Yöntemi Dildeki Modellerin Hallüsinasyonlarını Durdurmak İçin

ChatGPT’ye bir sorunun gerçek çözümünü bulmadan önce rastgele bir cevabı doğrulamasını söylemek, onu daha çok düşünmeye zorlar ve daha sık doğru cevabı verir – hatta eğer önceki ‘rastgele’ cevap gerçek soruyla hiçbir ilgisi yoksa bile.

Çin’den ilgi çekici bir yeni makale, ChatGPT gibi dil modellerinin hallüsinasyon yapmasını engellemek ve cevapların kalitesini iyileştirmek için çok düşük maliyetli bir yöntem geliştirdi: modelin önce bağlantısız bir sorunun cevabını doğrulamasını sağlamak:

Bir LLM’nin ‘zihni’ temizleyerek gerçek bir sonraki sorguya odaklanmasına yardımcı olabilecek bir bağlantısız soru örneği. Kaynak

Bu Zen darbesi, performansı iyileştirmek için diğer daha karmaşık yöntemlere kıyasla, ince ayar, prompt-crafting ve paralel örnekleme gibi, inanılmaz derecede ucuz bir yöntemdir ve hem açık hem de kapalı kaynaklı modellerde çalışır, bu da çoklu LLM mimarilerine özgü bir temel karakter özelliğinin keşfedildiğini gösterir (spesifik eğitim materyalleri veya yöntemlerine özgü kırılgan bir özelliğe kıyasla).

Yazarlar, bu Spartan şekilde çıktı iyileştirmesinin mümkün olan ekonomilerini şöyle açıklar:

‘Minimal ek ön bilgi ile uygulanmak için, VF yalnızca bir rastgele veya basit cevabı.promt’a sağlamalıdır. Doğrulama süreci, genellikle bir ordinary CoT yolundan daha az çıktı jetonu içerir, [bazen] hatta hiçbir açık doğrulama-sadece süreci yoktur, bu nedenle [çok az] ek test-zamanı hesaplama gerekir.’

Testlerde, bu yaklaşım – Doğrulama-İlk (VF) olarak adlandırılır – çeşitli görevlerde, matematiksel akıl yürütme dahil, açık kaynaklı ve ticari platformlar üzerinde cevapları iyileştirebildi.

Bu tekniğin neden işe yaradığı, kısmen, dil modellerinin insan psikolojisindeki trendleri emmesi ve bir doğrudan soru modeli ‘savunmacı’ ve ‘sinirli’ yapabilirken, bir cevabın doğrulanması talebi bu ‘hayatta kalma içgüdülerini’ tetiklemez.

Temel fikir, bir cevabı doğrulamanın, sıfırdan bir tane oluşturmaktan daha az çaba gerektirdiği ve standard zincir-düşünmeyi tamamlayacak farklı bir akıl yürütme yolunu tetikleyebileceğidir.

Modeli, verilen bir cevabı (yani, modelin yaratmadığı bir cevabı) eleştirmeye zorlamak, ayrıca modelin kendi ilk izlenimlerine aşırı güveni önleyen bir tür eleştirel düşünceyi aktive edebilir.

Çalışma, bu süreci ters-yol olarak karakterize eder:

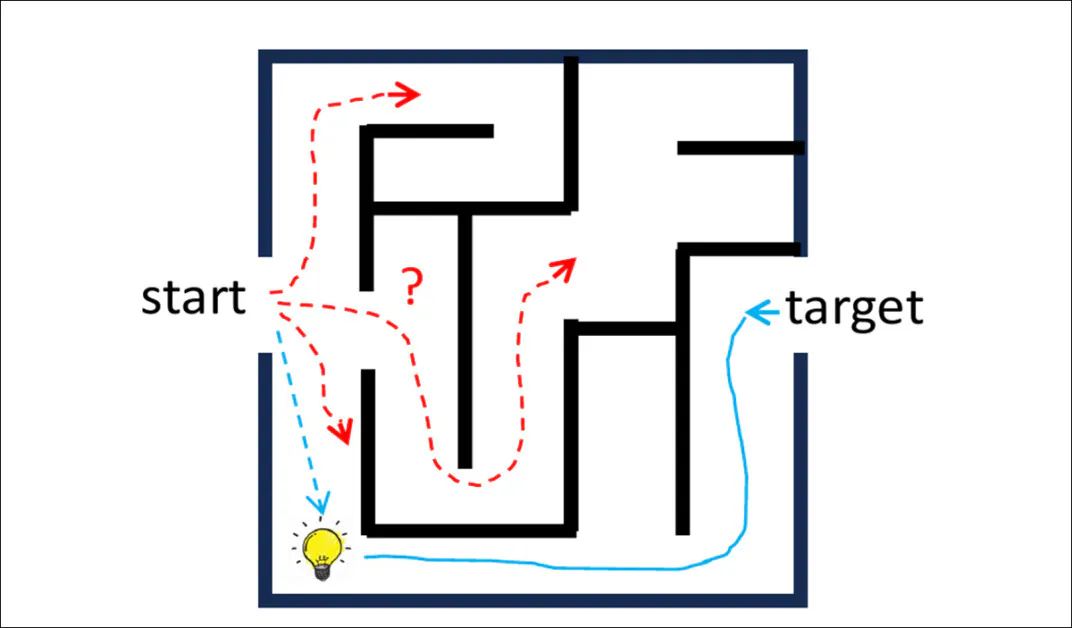

Önerilen bir cevaptan başlayarak ve soruya doğru geri doğru akıl yürütmek, yalnızca sorudan ileriye doğru akıl yürütmekle bulunması daha zor olan kısa yolları veya içgörülerı ortaya çıkarabilir. Bu ‘ters yol’, daha basit bir yol izleyebilir ve standard zincir-düşünme akıl yürütmelerine ek bilgi sağlayabilir.

Araştırmacılar, merkezi kavramı Iter-VF olarak somutlaştırdı, bir dizi zaman-testi ölçekleme yöntemi, cevabı her defasında iyileştirir, LLM mimarilerinde sıkça bulunan self-correcting stratejilerine özgü hata biriktirme sorununu önler.

Yeni çalışma LLM’leri İlk Doğrulamaya Zorlamak Neredeyse Bedava başlığını taşır ve Tsinghua Üniversitesi, Beijing’deki Elektronik Mühendisliği Bölümü’nden iki araştırmacının eseridir.

Yöntem

Yeni çalışmanın arkasındaki temel fikir, dil modellerindeki geleneksel akıl yürütme akışını tersine çevirmektir. Modeli, bir problemi sıfırdan çözmek yerine, önce bir aday cevaba (çoğu zaman yanlış veya keyfi) verilir ve bu cevabın mantıklı olup olmadığı sorulur.

Bu, modelin ters akıl yürütmeye zorlar, önerilen cevaptan soruya doğru geri doğru çalışır. Doğrulama tamamlandıktan sonra, model orijinal problemi çözmeye devam eder.

Bu terslik, makaleye göre, dikkatsiz hataları azaltır ve daha düşünceli bir akıl yürütme modunu teşvik eder, LLM’nin gizli yapıları keşfetmesine ve aldatıcı varsayımlardan kaçınmasına yardımcı olur.

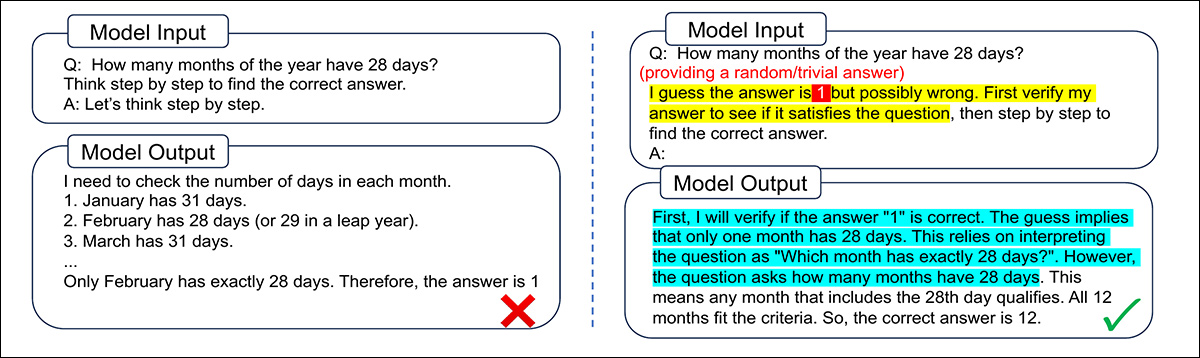

Aşağıdaki örneklerde görüldüğü gibi, modeli açıkça yanlış bir tahmin gibi ’10’ doğrulamaya zorlamak, onu kusurlu mantıktan kurtarabilir ve standard zincir-düşünme.prompting’den daha iyi performans gösterebilir:

Modeli önce bir tahminin doğruluğunu kontrol etmeye zorlamak, tutarsızlıkları tespit etmesine ve problema daha dikkatli yaklaşmasına yardımcı olur. Bu örnekte, standard yaklaşım akıcı ancak yanlış bir çözüme yol açarken, Doğrulama-İlk prompt daha net bir mantıksal yapı ve doğru sonucu tetikler.

Gerçek dünya sorunlarına gelince, modelin doğrulaması için bir tahmin sağlamayı her zaman kolay değildir, özellikle görev açık uçluysa, kod yazmak veya API çağırmak gibi. Bu nedenle, yöntem önce modelin normalde verdiği cevabı sağlar ve sonra bu cevabı Doğrulama-İlk formatına geri besler. Bu şekilde, model kendi çıktısını kontrol eder ve iyileştirir:

Model kendi önceki çıktısını doğrulamaya zorlandığında, mantıksal hatasını yakalar ve çözümü doğru olarak yeniden yazar. Doğrulama-İlk prompt, modelin spesifik hataya odaklanmasına yardımcı olur, aynı hatayı tekrarlamaktan kaçınır.

Bu yaklaşım, yukarıda bahsedilen Iter-VF‘yi oluşturur. Model, cevabını her defasında iyileştirerek bu döngüyü tekrarlar, yeniden eğitim veya özel araçlara gerek kalmadan. Diğer self-correcting stratejilerinin aksine, Iter-VF her defasında yalnızca en son cevaba bakar, bu da akıl yürütmesinin netliğini korur.

Veri ve Testler

Yazarlar, yöntemi dört alanda değerlendirir: genel akıl yürütme görevleri, burada VF rastgele bir tahminle başlatılır; zaman duyarlı görevler, burada Iter-VF rakip ölçeklendirme yöntemleriyle karşılaştırılır; açık uçlu problemler gibi kodlama ve API çağrıları, burada VF modelin kendi önceki cevabını kullanır; ve kapalı kaynaklı ticari LLM’ler, burada iç akıl yürütme adımları erişilemez.

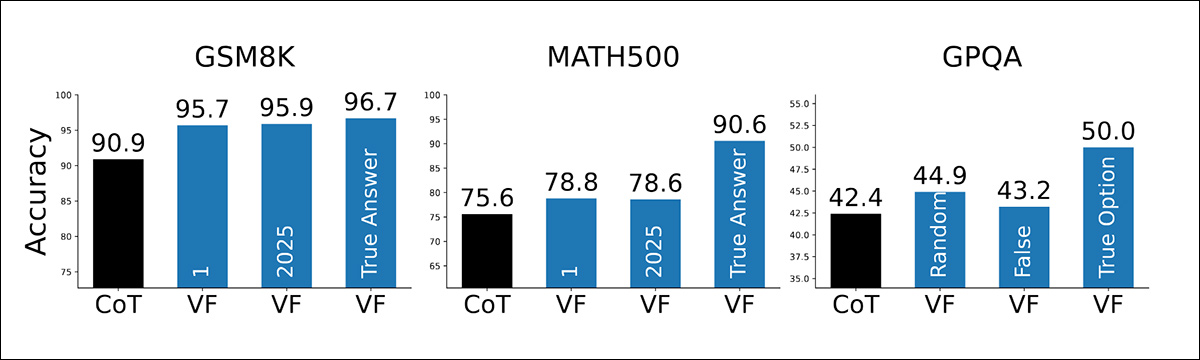

Yöntemi test etmek için araştırmacılar, üç akıl yürütme standardını kullandı: GSM8K ve MATH500 için matematik problemleri; ve GPQA-Diamond için lisansüstü düzeyde bilim soruları.

Her durumda, model ya bir rastgele tahmin (sayısal cevaplar için ‘1’ gibi) ya da bir karıştırılmış çoklu seçim seçeneğiyle başlatıldı. Hiçbir özel ayar veya ön bilgi eklemeden, karşılaştırma standardı olarak standard sıfır-atış zincir-düşünme prompting kullanıldı.

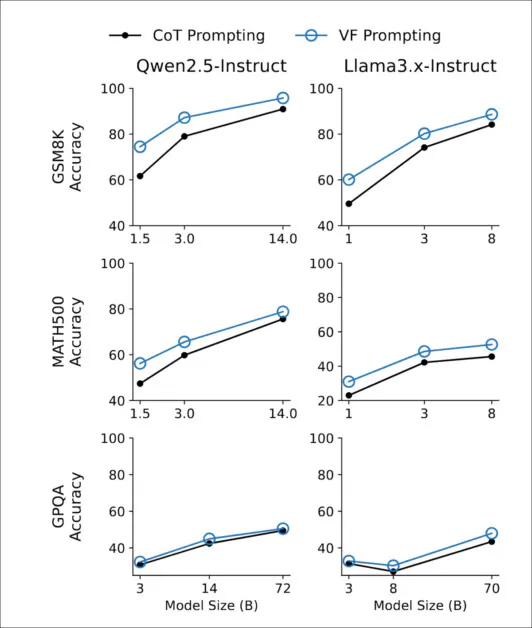

Testler, 1B’den 72B’ye (parametre) çeşitli Qwen2.5 ve Llama3 talimat-tüneli modelleri üzerinden çalıştırıldı. Kullanılan Qwen modelleri Qwen2.5-1.5B-Instruct, Qwen2.5-3B-Instruct, Qwen2.5-14B-Instruct ve Qwen2.5-72B-Instruct idi. Llama3 varyantları Llama3.2-1B-Instruct, Llama3.2-3B-Instruct, Llama3.1-8B-Instruct ve Llama3.3-70B-Instruct idi.

Aşağıdaki gibi gösterildiği üzere, Doğrulama-İlk prompting’in iyileşmesi, model ölçekleri boyunca sabit kaldı, 1B parametrede net kazançlar görüldü ve 72B’ye kadar devam etti:

Qwen2.5 ve Llama3 ailelerindeki tüm model boyutlarında, Doğrulama-İlk prompting, GSM8K, MATH500 ve GPQA-Diamond’da standard zincir-düşünme prompting’den daha iyi performans gösterdi.

Etki, özellikle GSM8K ve MATH500 gibi hesaplama-ağır matematik standartlarında en güçlü oldu, burada yanlış bir cevabı doğrulamak, sıfırdan çözme girişiminden daha iyi akıl yürütmeye yol açtı. GPQA-Diamond’da, depolanan bilgiye daha fazla bağlı olan ve daha az çıkarımsal yapıya dayanan, avantaj daha küçüktü ancak tutarlıydı.

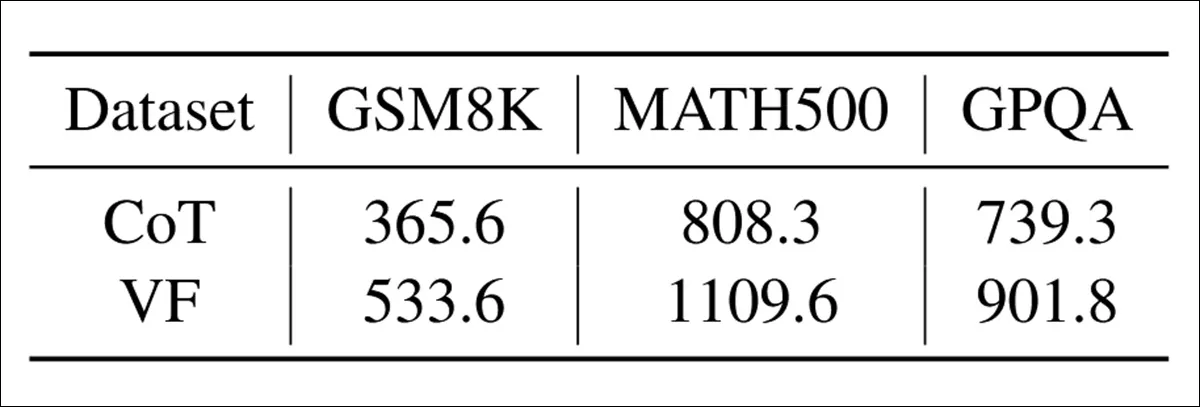

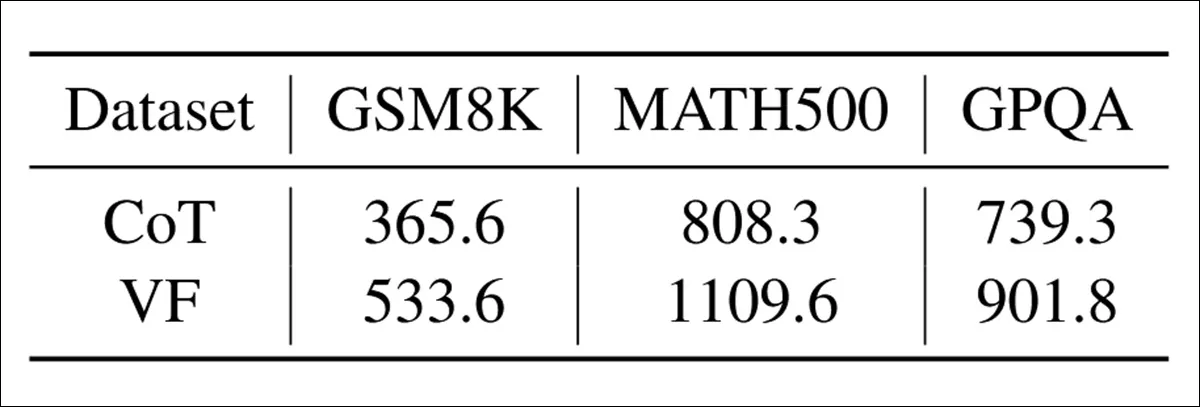

Doğrulama-İlk’in hesaplamalı maliyeti mütevazıydı: aşağıdaki tabloda, doğrulama adımının standard zincir-düşünme prompting’e kıyasla yaklaşık %20-50 daha fazla çıktı jetonu eklediğini görebiliriz:

GSM8K, MATH500 ve GPQA benchmark’lerinde her bir prompting yöntemi altında üretilen ortalama çıktı jetonları sayısı.

Buna rağmen, ek maliyet, çoklu örneklemeler veya rekürsif planlama gerektiren stratejilerin maliyetinin çok altında kaldı.

Aşağıdaki grafikte, yöntemin tahmini cevabın kalitesine karşı duyarlılığını görebiliriz. Şaşırtıcı bir şekilde, даже bir tahmini ‘1’ olduğunda, inanılmaz veya rastgele bir çoklu seçim seçeneği olduğunda, Doğrulama-İlk standard prompting’den daha iyi performans gösterir:

GSM8K, MATH500 ve GPQA’da Doğrulama-İlk prompting’den gelen doğruluk kazançları, modelin doğrulamak için trivial, inanılmaz veya doğru cevaplar aldığı durumlar.

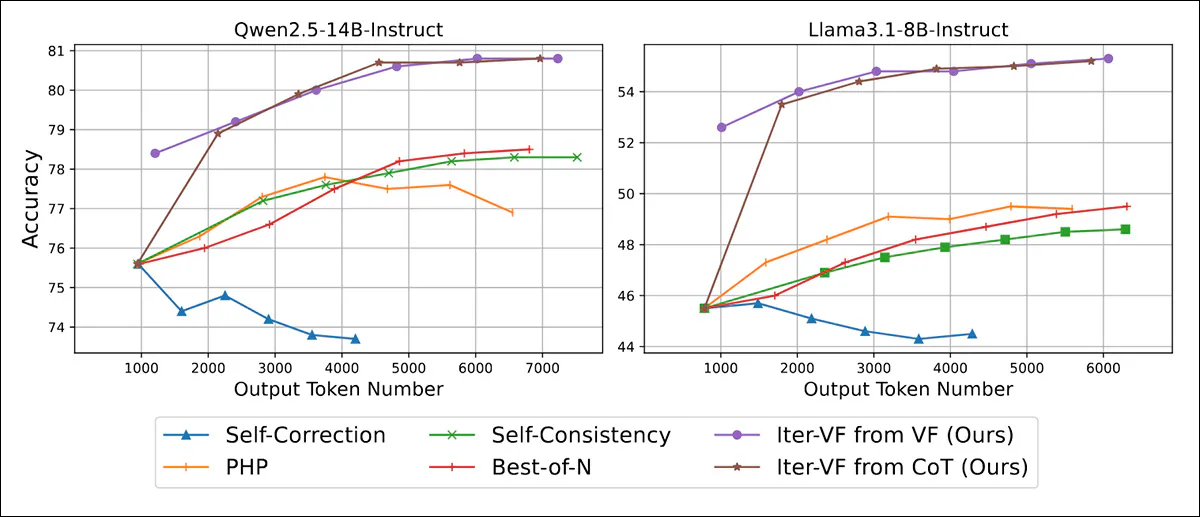

İter-VF, ayrıca dört test-zamanı ölçekleme stratejisiyle karşılaştırıldı, bunlar yeniden eğitim veya görev-spesifik adaptasyona gerek kalmadan çalışır. Self-Correction durumunda, model önceki akıl yürütme adımlarını yansıtarak cevaplarını revize etmeye teşvik edildi; PHP durumunda, önceki cevaplar girdi olarak eklendi, ancak nasıl kullanılacağına dair talimatlar verilmedi.

Ek olarak, Self-Consistency durumunda, çoklu akıl yürütme yolları örneklenerek final cevabı çoğunluk oyuyla seçildi; ve son olarak, Best-of-N durumunda, birkaç çıktı bağımsız olarak üretildi ve bir doğrulama prompt’ı kullanılarak sıralandı, en yüksek puan alan cevap seçildi.

İki Iter-VF varyantı uygulandı: biri ‘1’ ile başlatıldı ve diğeri standard CoT çıktısı ile başlatıldı:

MATH500’de artan çıktı bütçeleri altında doğruluk ve token verimliliği, her iki Iter-VF varyantının da tüm model ölçeklerinde tüm temel yöntemleri aştığını gösteriyor.

Iter-VF, düşük hesaplamalı kaynak olduğunda diğer tüm yöntemlerden daha iyi sonuçlar verdi, bu da yazarlar tarafından, cevabı nasıl kontrollediğine değil, nasıl başlattığına bağlı olarak erklälandı (her iki VF ve CoT varyantları da benzer doğruluklara nhanh ulaştı).

PHP, önceki cevapları ipuçları olarak yeniden kullandığı halde daha kötü performans gösterdi, muhtemelen LLM’lerin bu ipuçlarını iyi kullanamamasından dolayı.

Iter-VF’nin aksine, PHP ve Self-Correction, bağlamı iterasyonlar boyunca biriktirir. Buna karşılık, Iter-VF her adımda yalnızca en son cevaba bakar, bu da uzun akıl yürütme zincirlerinin biriktirme karışıklığını önler – özellikle Self-Correction için zararlı bir zayıflık.

Paralel yöntemler gibi Self-Consistency ve Best-of-N bu sorunu önler, ancak onların gelişmeleri daha yavaş ve daha mütevazı oldu.

(n.b. Sonuç bölümü, kapsamlı olmasına rağmen, okunması zor ve proks bir okumadır ve bu nedenle kalan kapsamı büyük ölçüde kısaltmak zorundayız, okuyucuyu daha fazla ayrıntı için kaynak makaleye yönlendiriyoruz).

GPT-5 Nano ve GPT-5 Mini gibi kapalı ticari modellerde, Iter-VF performansı iyileştirdi, yalnızca girdi ve final cevaba erişilebildiği durumlarda, intermediate çıktılara bağlı olmadan:

MATH500 ve GPQA’da GPT-5 modellerinde gizli akıl yürütme izleriyle Iter-VF uygulandığında doğruluk.

Sonuç

Yeni makale, sonuç bölümünden itibaren opaklığa girse de, bir AI model sınıfının temel bir özelliğinin keşfedilmesi, ilgi çekici bir gelişmedir. Düzenli olarak bir LLM kullanan herkes, zamanla ortaya çıkan eksikliklere karşı çalışmak için doğal olarak bir dizi hile geliştirmiş olmalıdır ve tüm bunların arkasındaki model, umut edilen bir ‘hile’ olarak bu kadar uygulanabilir ve geneldir.

LLM’de bir bağlam penceresi uygulamak ve güncellemek için en büyük sorunlardan biri, oturum ilerlemesini koruma ve gerekli olduğunda yeni yönlerde ilerleyebilme arasında denge kurmaktır, böylece sahte hallüsinasyonlara veya konudan sapmaya düşmeden. Yeni makalede sunulan durumda, LLM’yi yeniden odaklayıp sıfırlayan nazik ancak ısrarlı bir ‘uyandırma çağrısı’ örneğini görüyoruz.

Araştırmacılar, yeni yöntemlerinin muazzam ekonomisini vurguluyor – bir consideration ki, sadece 12 ay önce çok daha az önemli olurdu. Hyperscale AI’nin etkileri, artık ‘saflık araştırması’ döneminde önemli olmayan kaynak tasarruflarının artık kardinal ve temel hale geldiğini net bir şekilde ortaya koyuyor.

* Lütfen makaledeki bazı kısımlarındaki İngilizce standardının okuyucu için karışıklığa neden olabileceğinden, genellikle makalelerden alıntı yapma alışkanlığımın aksine, ana içgörülerin özeti olarak sunuyorum ve daha fazla ayrıntı için okuyucuyu kaynak makaleye yönlendiriyorum.

İlk olarak 4 Aralık 2025 Perşembe günü yayınlandı.