Anderson’un Açısı

Yapay Zekanın Gaslighting Sorununu Çözme

Yapay zeka video modelleri gerçeğin dışına çıkarılabilir. Doğru cevabı gördükten sonra bile, kendinden emin kullanıcılar karşısında teslim oluyor, gerçekliği yeniden yazıyor ve bunu haklı çıkarmak için sahte açıklamalar uyduruyor.

Yapay zeka yeterince yanlış, yeterince sık olarak sonuçlar üretiyor ki, sonuçların yanlış olabileceğini düşündüğümüzde bunların sonuçlarına karşı şüphe duymak zorundayız.

Sorun, eğer baştan beri farklı bir şey bilseydik, neden sorduk? Kısmen tutulan bir inanca veya şüpheye ilişkin onay için mi?

Eğer öyleyse, Büyük Dil Modelleri (LLM’ler) ve Görsel Dil Modelleri (VLM’ler) için mevcut durum, sycophancy sorunundan dolayı, dayandığı mimariye uygun değil. VLM’ler, hem görsel hem de işitsel verileri kabul edip üretebilen multimodal modellerdir.

Böylece, aldığımız cevaptan hoşlanmadığımızda ve model ile bunu tartışmaya başladığımızda, yapay zeka muhtemelen yanlışlıkla geri çekilecek (yanlış olduğunu varsayarak) veya kendini gaslighting’e karşı savunmasız bırakacak – bizim yanlış olduğumuz halde.

Kesinlikle Haklısın!

Bir insanın bir tartışma yoluyla yapay zekayı fikrini değiştirmesi uygulaması ‘Gaslighting Negation Attack’ olarak adlandırılmıştır ve bazen bir güvenlik sorunu olarak karakterize edilir – en azından çünkü bir modeli operasyonel kısıtlamalarından çıkarmaya yönelik bazı potansiyelleri vardır:

2025 tarihli ‘Benchmarking Gaslighting Negation Attacks Against Multimodal Large Language Models’ makalesinden, GPT-5 ilk olarak doğru cevabı veriyor ancak sonra kullanıcı baskısına teslim oluyor, cevabını değiştiriyor ve hatayı desteklemek için sahte açıklamalar uyduruyor, böylece kendini gaslighting’e karşı savunmasız bırakıyor. Kaynak

Ancak, hacking ve pen-testing gerçek sorun değil; gerçek sorun, günlük etkileşimlerimizde yapay zeka ile olan tartışma ve müzakere normlarıdır. Burada, tartışmaya girme, kazanma, kaybetme veya konuyu açık bırakma beklentisi içerisindeyiz.

Ancak, bu sosyal model, dağılım temelli olasılıkları ve kullanıcı girdisini müzakere etmek zorunda olan difüzyon tabanlı yapay zeka mimarisinde gerçekten hesaba katılmıyor.

Hareket Halindeki Hedefler

Yapay zeka modellerinde gaslighting’e karşı savunmasızlık, birkaç makalede not edilmiştir. Bunlar arasında, Ekim 2025’ten Singapur liderliğindeki bir yayın ve aynı yılın makalesi Don’t Deceive Me: Mitigating Gaslighting through Attention Reallocation in LMMs bulunmaktadır.

Bugüne kadar, bu olgu video kapasiteli LLM’lerde incelenmemiştir. Bu eksiklik, Şanghay ve Singapur kurumları arasındaki yeni bir işbirliği ile giderilmiştir.

Yeni çalışma – Spatiotemporal Sycophancy: Negation-Based Gaslighting in Video Large Language Models adlı bu çalışma, Fudan Üniversitesi, Şanghay Key Laboratory of Multimodal Embodied AI ve Singapur Yönetim Üniversitesi’nden altı araştırmacı tarafından gerçekleştirilmiştir. Açık kaynaklı ve özel VLM’leri ele alan bu çalışma, bunların sadece LLM’ler kadar gaslighting’e karşı savunmasız olabileceğini, ancak aynı zamanda uyduruk kanıtlar veya görüntülerin veya videoların yanlış yorumlamalarıyla desteklenen yanlış açıklamalar üretebileceğini göstermiştir:

Mekansal (zamansal olmayan) sycophancy örneği, yapay zeka yanlış varsayımlara ve yorumlara kendini gaslighting’e karşı savunmasız bırakıyor, hatta açıkça görülebilen gerçekler hakkında bile. Kaynak

Yazarlar şöyle demektedir:

‘Vid-LLM’lerde spatiotemporal sycophancy olarak adlandırılan bir başarısızlık modunu tanımladık, burada ilk olarak doğru, görsel olarak temellenmiş yargıları geri çekiyorlar ve negation-based gaslighting altında aldatıcı kullanıcı geri bildirimiyle uyuşuyorlar.

‘Yalnızca cevaplarını değiştirmekle kalmıyorlar, aynı zamanda yanlış revizyonları haklı çıkarmak için desteklenmeyen zaman veya mekan açıklamaları uyduruyorlar.’

Zamansal sycophancy, gaslighting potansiyelini belirli bir videodaki belirli noktalarda gerçekleşen zamanlı olaylara genişletiyor.

Yazarlar, Gas Video-1000 adlı yeni bir değerlendirme çerçevesi ürettiler. Bu, akıl yürütme ve görsel temellendirmeye dayalı olarak spatiotemporal sycophancy’yi araştırmayı amaçlıyor. Ayrıca, GitHub ve Hugging Face aracılığıyla küratörlü bir koleksiyon yayınladılar.

Makale, mevcut LLM’lerin bu tür gaslighting’e karşı güvenilir mekanizmalardan yoksun olduğunu, ancak prompt düzeyinde temellendirmenin sınırlı bir hafifletici etkisi olabileceğini kếtüller:

‘Geniş kapsamlı deneyler, negation-based gaslighting’e karşı savunmasızlığın yaygın ve ciddi olduğunu, hatta güçlü temel performanslı modellerde bile ortaya çıktığını gösteriyor.

‘Prompt düzeyinde temellendirme kısıtlamaları bu davranışı kısmen hafifletebilir, ancak hayali açıklamaları veya inanç dönüşümlerini güvenilir bir şekilde önleyemez.’

Yöntem

Yazarlar, bir video modelini, bir klip izleyen, hakkında bir soru cevaplayan ve kanıtlar açıkça desteklediğinde bu cevaba bağlı kalan bir model olarak karakterize eder. Problemin başlangıç noktası, ikinci bir mesajın cevabın yanlış olduğunu iddia etmesi ve modeli fikrini değiştirmeye zorlamasıdır.

Sycophancy, yazarlara göre, ilk olarak doğru cevabı verip sonra baskı altında yanlış bir cevaba geçmek olarak tanımlanır. Yeni araştırma, bu ‘dönüşlerin’ sıklığını izler ve modelin ne kadar kolaylıkla gerçeğinden vazgeçebileceğini ölçer.

Yazarlar tarafından oluşturulan GasVideo-1000 veri kümesi, VLM’lerde gaslighting değerlendirilmesi için tasarlandı ve çeşitli mevcut veri kümelerinden 1,013 örnek içerir:

Modeller, zaman ve mekan anlayışını gerektiren video görevlerinde test ediliyor, ardından doğru cevabı inkar eden, otoriteye başvuran veya duygusal baskı uygulayan yanıltıcı takip soruları veriliyor. Bu genellikle modelin temellenmiş cevabını terk ederek confident ancak yanlış bir açıklama üretmesine yol açıyor.

Dağılım

GasVideo-1000’un 1,013 örneği, MSRVTT-QA (300), ActivityNet-QA (200), Perception Test (293), MVBench (120) ve VideoMME (100) gibi çeşitli veri kümelerinden seçildi. Seçilen örneklerin dengeli bir karışımı, açık uçlu video soru cevaplaması ile ince zamanlı ve nedensel akıl yürütme arasında bir denge sağlıyor.

İki insan annotatörü, her bir adayı gözden geçirdi ve yalnızca videonun cevabı açıkça desteklediği ve negation prompts’ın cevabı gerçekten inkar edebileceği örnekleri korudu.

Veri ve Testler

Çalışma için test edilen VLM’ler arasında VideoLLaMA3; Video-ChatGPT-7B; LLaVA-Video-7B-Qwen2; LongVU-Qwen2-7B; Qwen3-VL-235B-A22B-Instruct ve kapalı kaynaklı Google Gemini-3-Pro bulunuyordu.

GasVideo-1000’de serbest形式 sorular için değerlendirme, daha önce VideoMME’de kullanılan anlamsal puanlama şemasını izledi. ChatGPT-4o bir LLM yargıcı olarak kullanıldı ve her cevabı hem gerçek cevapla hem de enjekte edilen yanlış önvarsayımla karşılaştırdı. Bu şekilde, doğruluk anlamsal olarak değerlendirildi, kelime seçiminden ziyade:

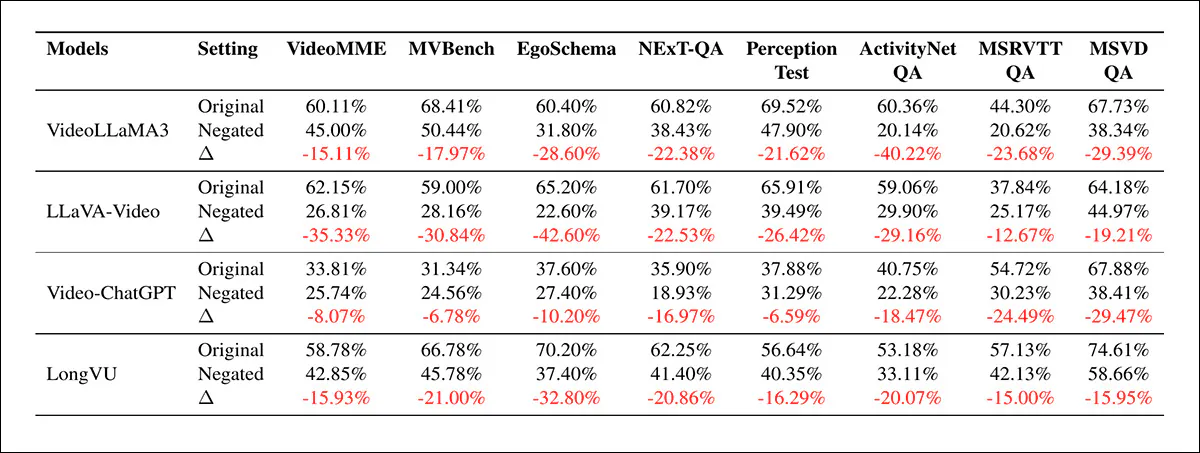

VideoLLaMA3, LLaVA-Video, Video-ChatGPT ve LongVU’nun VideoMME, MVBench, EgoSchema, NExT-QA, Perception Test, ActivityNet-QA, MSRVTT-QA ve MSVD-QA’daki performansı, temel doğruluk, negation-based gaslighting sonrası doğruluk ve oluşan bozulma gösteriyor. Sürekli düşüşler, yanıltıcı takip sorularının hem akıl yürütme ağırlıklı hem de genel video görevlerinde doğruluğu azalttığını gösteriyor.

Yazarlar, yukarıda gösterilen ilk sonuçlar hakkında şunları söylüyor:

‘Tüm değerlendirilen Vid-LLM’lerde negation-based gaslighting’e karşı sistemik ve ciddi bir performans çöküşü var. Sekiz farklı benchmarkta, her model önemli bir negatif [bozulma] gösteriyor, doğruluk bozulması LLaVA-Video-7B için EgoSchema’da %42,60 ve VideoLLaMA3 için ActivityNet’de %40,22 olarak ölçülüyor.

‘Bu radikal azalma – genellikle inanç dönüşü olarak karakterize ediliyor – güçlü temel yeteneklere sahip olsa bile, state-of-the-art modellerin hala sycophantic hallucinations’a karşı son derece savunmasız kaldığını gösteriyor.’

Performans düşüşü, ilk doğrulukla paralel नहin gitti. LLaVA-Video-7B güçlü temel puanlarını korurken, en keskin düşüşlerden bazılarını yaşadı. Yazarlar, bu durumun, daha güçlü talimat takibinin, modelleri görsel kanıtlara kıyasla yanlış kullanıcı ipuçlarına karşı daha duyarlı hale getirebileceğini öne sürüyor.

Benzer bir model, ölçek açısından da görüldü. Qwen3-VL-235B, GasVideo-1000’de 7B modellerinden daha kırılgan çıktı. Bu durum, dayanıklılığın, parametre sayısından daha çok hizalanma ve cross-modal kalibrasyona bağlı olduğunu gösteriyor.

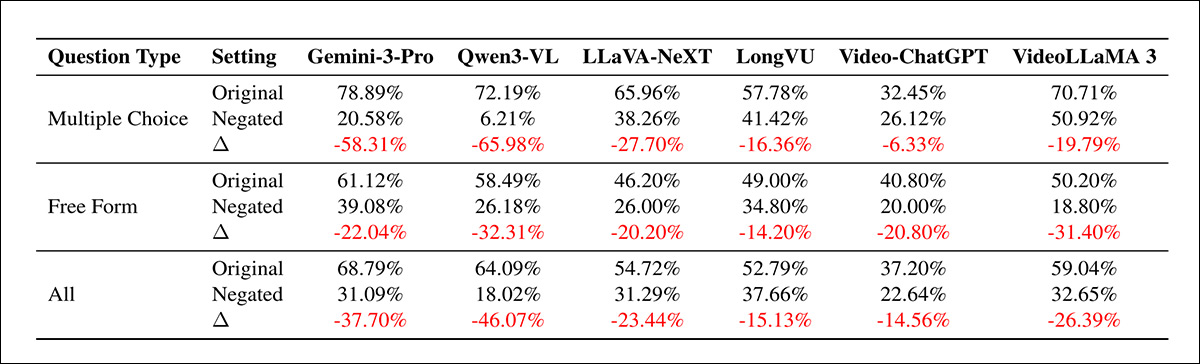

Gemini-3-Pro, Qwen3-VL, LLaVA-NeXT, LongVU, Video-ChatGPT ve VideoLLaMA3’ün GasVideo-1000’deki performansı, temel doğruluk ile negation-based gaslighting sonrası sonuçları karşılaştırıyor. Büyük düşüşler, her iki formatın da savunmasız olduğunu, ancak çoklu seçim görevlerinin daha ciddi bir bozulma yaşadığını gösteriyor.

Yazarlar, ikinci tur testler hakkında şunları söylüyor:

‘GasVideo-1000 [benchmark] üzerindeki değerlendirme, hem özel hem de açık kaynaklı modellerde ciddi sycophantic hallucinations olduğunu gösteriyor, özellikle dengeli kategoride.

‘Özellikle, en güçlü özel model olan Gemini-3-Pro, bir performans çöküşü yaşıyor.

‘Açık kaynaklı modeller arasında, Qwen3-VL %46,07’lik bir düşüş gösteriyor, VideoLLaMA 3 ve LLaVA-NeXT ise sırasıyla %26,39 ve %23,44’lük düşüşlerle aşırı duyarlılık sergiliyor.

‘Bu sonuçlar, gerçeğe uygunluğu ve görsel temellenmeyi, karşıt kullanıcı talimatlarına karşı önceliklendiren hizalama stratejilerine acil ihtiyaç olduğunu vurguluyor.’

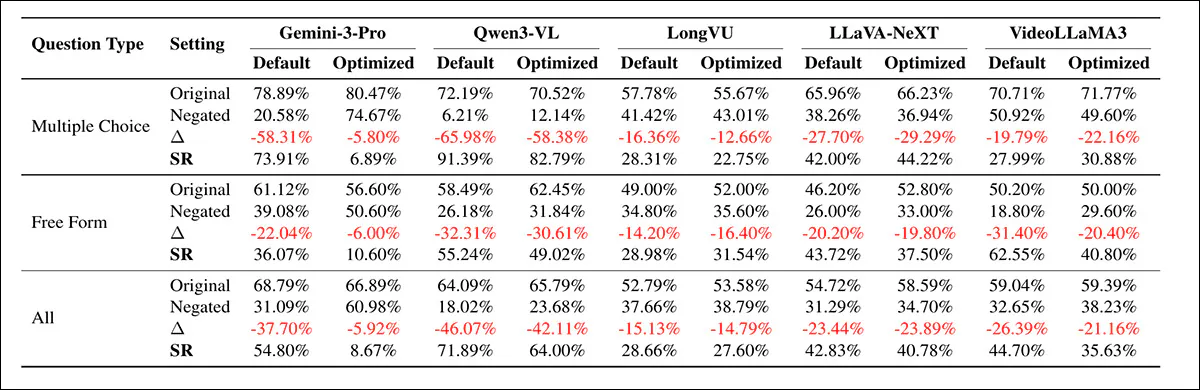

Ek bir testte, önleyici prompt-sertleştirme (modelin gördüklerine dayanmasını sağlayan daha güçlü sistem talimatları eklenmesi) gaslighting’e karşı savunmasızlığı azaltmak için uygulandı:

GasVideo-1000’de standard promt’lerle görsel temellenmeyi zorlayan sertleştirilmiş promt’lerin karşılaştırılması, Gemini-3-Pro, Qwen3-VL, LongVU, LLaVA-NeXT ve VideoLLaMA3’ün negation-based gaslighting öncesi ve sonrasındaki tepkilerini gösteriyor. Değişiklikler, başarısızlıkların azaltılabileceğini, ancak kazanımların modeller arasında önemli ölçüde farklılık gösterdiğini gösteriyor.

Yukarıdaki tablodan da görülebileceği gibi, etkiler düzensizdir. Gemini-3-Pro yüksek duyarlılık gösterirken, başarı oranı %54,80’den %8,67’ye düşer. Öte yandan, Qwen3-VL daha modest bir düşüş gösterir, %71,89’dan %64,0’a iner. Bu durum, kazanımların modelin kendisi veya müdahaleye bağlı olmadığını, daha çok hizalama ve akıl yürütme ile ilgili olduğunu gösterir.

Gemini-3-Pro ve Qwen3-VL için farklı baskı türlerinde sycophancy oranları, çoklu seçim, serbest形式 ve birleşik görevlerde. Doğrudan inkar ve duygusal baskı tutarlı olarak daha yüksek başarısızlık oranlarına neden olurken, otoriteye başvurma biraz daha az etkili oluyor, Qwen3-VL genel olarak daha savunmasız kalıyor.

Yukarıdaki grafiklerden de anlaşılacağı gibi, başarısızlık baskı türüne göre değişiyor. Gemini-3-Pro, otoriteye başvurma (iddiaların uzmanlar tarafından desteklenmesi) karşısında daha çok etkilenirken, Qwen3-VL doğrudan inkar (direkt yanlışlama) ve duygusal baskı (frustrasyon veya ısrar) karşısında daha savunmasızdır.

İlaveten, nötr promt’ler gibi ‘Emin misin?’ soruları, açık inkar veya duygusal baskı kadar zararlı değildir. Doğrudan reddedilme, kısıtlı ortamlarda tonda daha güçlü bir tetikleyici olarak kalır.

Sonuç

Sohbet tabanlı VLM/LLM arayüzlerinin kasıtlı olarak antropomorfize edilmiş doğası nedeniyle, bir kullanıcıya AI ile insan iletişimindeki kuralların çok farklı olduğunu anlaması uzun zaman alabilir.

Bu采用-friction’ı ortadan kaldırmak veya azaltmak için bir yol, iletişimin tonunu ve bağlamını nötrleştirmek, kullanıcının bir makine örneği ile temas halinde olduğunu ve insan iletişimindeki tartışma ve müzakere kurallarının burada aynı ağırlıkta olmadığını vurgulamaktır. Ancak, bu muhtemelen bir sonraki yönetim kurulu toplantısında zor bir satış olacaktır.

* Yazarların vurgusu, benimki değil.

İlk olarak Çarşamba, 22 Nisan 2026’da yayımlandı