Inteligență artificială

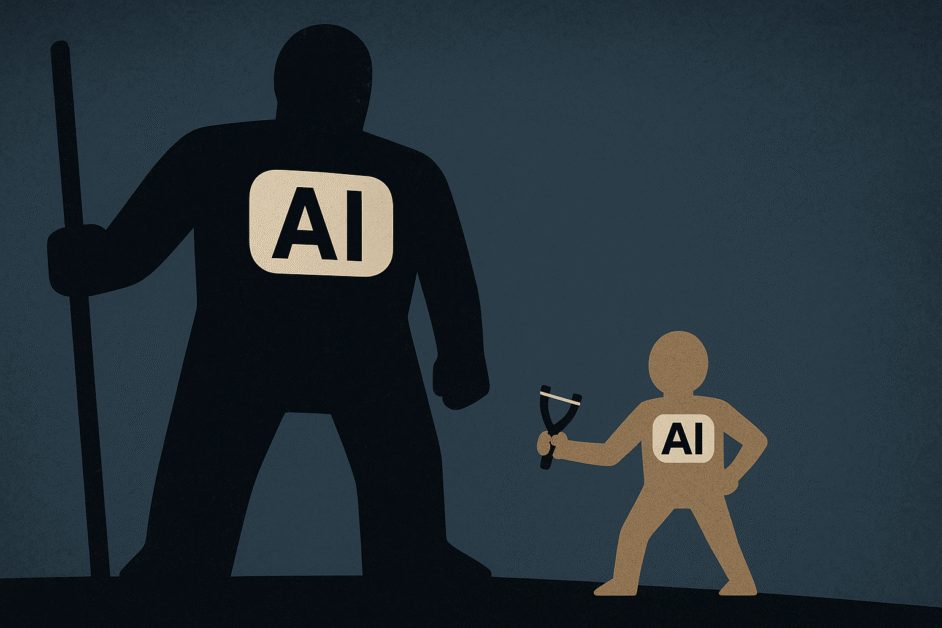

Revolta micilor modele: De ce inteligența artificială mică depășește modelele de limbaj uriașe

În ultimii ani, inteligența artificială a fost modelată de cursa pentru a construi modele din ce în ce mai mari. Fiecare lansare nouă a fost măsurată de numărul de parametri, de mărimea datelor de antrenare și de scala infrastructurii din spatele acesteia. S-a presupus că mai mare înseamnă mai bine. În timp ce giganții tehnologiei continuă să construiască modele de limbaj din ce în ce mai masive, cu sute de miliarde de parametri, o revoluție tăcută are loc. Modelele de inteligență artificială mici, adesea de mii de ori mai mici decât omologii lor uriași, obțin performanțe comparabile și, uneori, superioare pe anumite sarcini. Acest schimbă tot ceea ce credeam că știm despre scalarea inteligenței artificiale și deschide noi posibilități pentru inteligența artificială democratizată și eficientă.

Povestea lui David și Goliat a inteligenței artificiale moderne

De ani de zile, industria inteligenței artificiale a funcționat sub presupunerea că modelele mai mari oferă o performanță mai bună. Seria GPT de la OpenAI a crescut de la 117 milioane de parametri la peste 175 de miliarde. PaLM de la Google a ajuns la 540 de miliarde de parametri. Companiile de tehnologie au investit miliarde de dolari în antrenarea acestor modele și investesc în continuare pentru a construi modele și mai mari. În această situație, când numărul de parametri a devenit un factor cheie pentru a determina capacitatea modelului și construirea capacității de inteligență artificială a devenit o cursă de resurse computaționale și de cheltuieli pentru infrastructură, un fenomen interesant a început să se întâmple în laboratoarele de cercetare din întreaga lume.

Inginerii au început să descopere că modelele mai mici, proiectate cu atenție, pot egala sau depăși performanța uriașilor pe anumite sarcini. Seriile Phi de la Microsoft au demonstrat că un model cu 2,7 miliarde de parametri poate concura cu modele de zece ori mai mari. LLaMA de la Meta a dovedit că modelele cu 7 miliarde de parametri pot oferi rezultate excepționale atunci când sunt antrenate corespunzător. Aceste dezvoltări reprezintă o schimbare fundamentală în înțelegerea noastră despre eficiența inteligenței artificiale.

Această schimbare de paradigmă are implicații semnificative asupra modului în care inteligența artificială este utilizată și operată. Modelele mici pot rula pe hardware-ul consumatorilor, pot procesa solicitări mai rapide și pot consuma o fracțiune din energia necesară pentru modelele mari. Ele fac inteligența artificială accesibilă organizațiilor care nu pot permite o infrastructură computațională masivă. Mai important, ele contestă tendințele monopolistice ale dezvoltării inteligenței artificiale, unde doar companiile cu resurse uriașe puteau concura.

Apariția arhitecturii eficiente de inteligență artificială

Revolta micilor modele se bazează pe abordări inginerești sofisticate care maximizează performanța în bugete de parametri limitate. Aceste modele utilizează tehnici avansate, cum ar fi distilarea cunoștințelor, unde modelele “elev” mai mici învață de la modelele “profesor” mai mari, capturând cunoștințe esențiale în timp ce reduc dramatic cerințele computaționale.

Seriile Phi-4 de la Microsoft exemplifică această abordare. Modelul de raționament Phi-4, cu doar 14 miliarde de parametri, concură cu modele de cinci ori mai mari în raționament matematic și rezolvare de probleme logice. Similar, modelul Gemma 3 270M de la Google demonstrează că un model compact de 270 de milioane de parametri poate oferi capacități puternice de urmare a instrucțiunilor și poate servi ca o bază excelentă pentru fine-tuning.

Modelul Llama 3.2 1B de la Meta este o altă descoperire în eficiența micilor modele. Prin tăiere structurată și distilare a cunoștințelor de la modelele Llama mai mari, el menține o performanță remarcabilă în timp ce funcționează eficient pe dispozitive edge. Aceste modele demonstrează că inovația arhitecturală și metodologia de antrenare contează mai mult decât numărul de parametri pentru multe aplicații din lumea reală.

Arhitecturile de amestec de experți reprezintă o descoperire semnificativă în proiectarea eficientă a inteligenței artificiale. În loc de a utiliza toți parametrii pentru fiecare sarcină, aceste modele activează doar componente specializate relevante. Ele direcționează diferite solicitări către sub-rețele specializate, menținând o capacitate largă în timp ce utilizează mai puțini parametri activi în orice moment. Modelul Mixtral 8x7B de la Mistral AI demonstrează eficient această abordare. În ciuda faptului că are 47 de miliarde de parametri totali, el activează doar 13 miliarde de parametri pe solicitare, obținând o performanță comparabilă cu modelele dense mult mai mari, menținând în același timp viteze de inferență mai rapide.

Tehnicile de cuantificare au avut, de asemenea, un impact semnificativ asupra creșterii eficienței micilor modele. Prin reprezentarea greutăților modelului cu mai puține biți, cercetătorii pot reduce dimensiunea modelului în timp ce mențin acuratețea. Metodele moderne de cuantificare pot reduce dimensiunea modelului cu 75% cu o pierdere minimă de performanță. Modelul Phi-3-mini de la Microsoft a demonstrat eficacitatea acestei abordări. Atunci când este cuantificat la o precizie de 4 biți, el menține peste 95% din performanța sa originală, reducând în același timp cerințele de memorie de la 7 GB la sub 2 GB, făcându-l practic, în special pentru implementarea pe dispozitive mobile.

Specializarea învinge generalizarea

Revolta micilor modele a dezvăluit o adevăr important despre implementarea inteligenței artificiale. Cele mai multe aplicații din lumea reală nu au nevoie de un model care să poată scrie poezii, să rezolve calcule și să discute filosofie. Ei au nevoie de modele care să exceleze în sarcini specifice. Un chatbot de asistență pentru clienți nu are nevoie să cunoască opera lui Shakespeare. Un instrument de completare a codului nu are nevoie de cunoștințe medicale. Această realizare a schimbat focusul de la construirea de modele universale la crearea de modele specializate.

Antrenamentul specific domeniului permite micilor modele să-și concentreze capacitatea limitată pe cunoștințe relevante. Un model cu 3 miliarde de parametri, antrenat exclusiv pe documente legale, poate depăși un model general cu 70 de miliarde de parametri pe sarcini legale. Modelul specializat învață modele mai profunde în cadrul domeniului său, în loc să-și distribuie capacitatea pe subiecte nerelevante. Este ca și cum ai compara un medic specialist cu un medic generalist pentru proceduri complexe.

Strategiile de fine-tuning au devenit din ce în ce mai sofisticate. În loc de a antrena modele de la zero, dezvoltatorii încep cu modele de bază mici și le adaptează la nevoi specifice. Această abordare necesită resurse computaționale minime, producând în același timp modele specializate foarte capabile. Organizațiile pot crea acum soluții personalizate de inteligență artificială fără investiții masive în infrastructură.

Spargerea tavanului de performanță

Benchmarke-urile recente arată avantaje de performanță surprinzătoare pentru modelele mici în domenii specifice. Modelul Olmo 2 1B de la AI2 depășește modelele de dimensiuni similare de la companiile de tehnologie majore în sarcini de înțelegere a limbajului natural. Modelul Phi-4-mini-flash-reasoning de la Microsoft atinge până la 10 ori mai multă eficiență și de 2-3 ori mai puțină latență în comparație cu modelele tradiționale de raționament, menținând în același timp capacitățile de raționament matematic.

Diferența de performanță devine și mai izbitoare atunci când se examinează aplicațiile specifice sarcinilor. Modelele mici, fine-tunate pentru domenii specializate, depășesc în mod constant modelele generale mari în acuratețe și relevanță. Aplicațiile din domeniul sănătății, analiza documentelor legale și implementările de asistență pentru clienți arată rezultate deosebit de impresionante atunci când modelele mici sunt antrenate pe seturi de date specifice domeniului.

Acest avantaj de performanță provine din abordările de antrenare focalizate. În loc de a învăța cunoștințe largi, dar superficiale, pe sute de domenii, modelele mici dezvoltă expertiză profundă în domenii țintite. Rezultatul este răspunsuri mai fiabile, adecvate contextual, pentru cazuri de utilizare specifice.

Avantajul de viteză și eficiență

Performanța nu se referă doar la acuratețe. Ea se referă și la viteză, cost și impactul asupra mediului. Modelele mici excelează în toate aceste dimensiuni. Un model mic poate genera răspunsuri în milisecunde, în timp ce modelele mari necesită secunde. Această diferență de viteză poate părea nesemnificativă, dar devine critică în aplicații care necesită interacțiune în timp real sau procesare a milioane de solicitări.

Consumul de energie este un alt aspect critic. Modelele mari necesită centre de date masive, cu sisteme de răcire sofisticate. Fiecare solicitare consumă o cantitate semnificativă de electricitate. Modelele mici pot rula pe servere standard sau chiar pe calculatoare personale, utilizând o fracțiune din energia necesară. Pe măsură ce organizațiile se confruntă cu presiuni pentru a reduce amprenta de carbon, avantajul de mediu al micilor modele devine din ce în ce mai important.

Implementarea pe dispozitive edge este, probabil, cea mai transformativă capacitate a micilor modele. Aceste modele pot rula direct pe telefoane, laptopuri sau dispozitive IoT, fără a necesita conectivitate la internet. Imaginați-vă unelte de diagnostic medical care funcționează în zone îndepărtate fără acces la internet, sau dispozitive de traducere în timp real care nu necesită conectivitate la cloud. Modelele mici fac aceste scenarii posibile, aducând capacități de inteligență artificială la miliarde de dispozitive din întreaga lume.

Problemele de confidențialitate favorizează, de asemenea, modelele mici. Atunci când inteligența artificială rulează local pe dispozitivele utilizatorilor, datele sensibile nu părăsesc niciodată dispozitivul. Furnizorii de servicii medicale pot analiza datele pacienților fără a le încărca pe servere cloud. Instituțiile financiare pot procesa tranzacții fără a expune informații confidențiale clienților la sisteme externe. Această capacitate de procesare locală abordează una dintre principalele preocupări cu privire la adoptarea inteligenței artificiale în industrii sensibile.

Concluzia

Ascensiunea micilor modele de inteligență artificială contestă credința că modelele mai mari oferă întotdeauna o performanță mai bună. Modelele compacte, cu mai puțini parametri, sunt acum la fel de bune sau chiar depășesc modelele mai mari în anumite sarcini, utilizând tehnici precum distilarea cunoștințelor, cuantificarea și specializarea. Această schimbare face inteligența artificială mai accesibilă, permițând o utilizare mai rapidă și mai eficientă din punct de vedere energetic pe dispozitivele de zi cu zi. Ea reduce, de asemenea, costurile, impactul asupra mediului și îmbunătățește confidențialitatea, permițând implementarea locală. Prin concentrarea asupra modelelor eficiente și specializate, în loc de sisteme universale masive, inteligența artificială devine mai practică, mai accesibilă și mai utilă atât pentru organizații, cât și pentru indivizi.