Inteligență artificială

Lipsurile Amazon Mechanical Turk ar putea amenința sistemele de generare a limbajului natural

Un nou studiu de la Universitatea din Massachusetts Amherst a pus profesorii de engleză împotriva lucrătorilor crowdsourciți de la Amazon Mechanical Turk în evaluarea rezultatelor sistemelor de generare a limbajului natural (NLG), concluzionând că standardele laxate și “jocul” sarcinilor prețuite printre lucrătorii AMT ar putea împiedica dezvoltarea sectorului.

Raportul ajunge la o serie de concluzii devastatoare cu privire la amploarea în care “externalizarea ieftină la scară industrială” a sarcinilor de evaluare NLG deschise ar putea duce la rezultate și algoritmi inferiori în acest sector.

Cercetătorii au compilat, de asemenea, o listă de 45 de articole despre generarea de text deschis în care cercetarea a utilizat AMT și au constatat că “majoritatea covârșitoare” nu a raportat detalii critice despre utilizarea serviciului de crowd al Amazon, făcând dificilă reproducerea rezultatelor articolelor.

Muncă de sweat-shop

Raportul critică atât natura de sweat-shop a Amazon Mechanical Turk, cât și proiectele academice (probabil limitate de buget) care oferă AMT o credibilitate suplimentară prin utilizarea (și citarea) acesteia ca resursă de cercetare validă și consistentă. Autorii notează:

‘În timp ce AMT este o soluție convenabilă și accesibilă, observăm că variația ridicată între lucrători, calibrarea slabă și sarcinile solicitante cognitiv pot duce cercetătorii la concluzii științifice înșelătoare (de exemplu, că textul scris de oameni este “mai slab” decât GPT-2).’

Raportul învinovățește jocul, și nu jucătorii, cercetătorii observând:

‘[Lucrătorii de crowd] sunt adesea plătiți sub valoarea muncii lor, ceea ce dăunează atât calității cercetării, cât și, mai important, capacității acestor lucrători de crowd de a câștiga un venit adecvat.’

Articolul articolul, intitulat Pericolele utilizării Mechanical Turk pentru evaluarea generării de text deschis, conchide, de asemenea, că “evaluatori experți” precum profesorii de limbă și lingviștii ar trebui să fie utilizați pentru a evalua conținutul artificial NLG deschis, chiar dacă AMT este mai ieftin.

Sarcini de test

Prin compararea performanței AMT cu cititorii experți mai puțin limitați de timp, cercetătorii au cheltuit 144 de dolari pentru serviciile AMT utilizate în efectuarea testelor (deși mult mai mult a fost cheltuit pentru “rezultate neutilizabile” – a se vedea mai jos), solicitând “Turcilor” aleatorii să evalueze unul dintre 200 de texte, împărțite între conținutul textului creat de oameni și textul generat artificial.

Sarcina profesorilor cu aceeași muncă a costat 187,50 de dolari, și a confirmat performanța lor superioară (în comparație cu lucrătorii AMT) prin angajarea freelancerilor Upwork pentru a replica sarcinile a costat încă 262,50 de dolari.

Fiecare sarcină a constat în patru criterii de evaluare: gramatică (‘Cât de corect gramatical este textul fragmentului de poveste?’); coerență (‘Cât de bine se potrivesc propozițiile din fragmentul de poveste?’); plăcere (‘Cât de plăcut găsiți fragmentul de poveste?’); și relevanță (‘Cât de relevant este fragmentul de poveste pentru prompt?’).

Generarea textelor

Pentru a obține material NLG pentru testele, cercetătorii au utilizat setul de date Hierarchical Neural Story Generation din 2018 al Facebook AI Research, care cuprinde 303.358 de povești în limba engleză compuse de utilizatori pe subredditul r/writingprompts, unde poveștile utilizatorilor sunt “însămânțate” de propoziții-prompt într-un mod similar cu practicile actuale în generarea de text la imagine – și, desigur, în sistemele de generare a limbajului natural deschis.

200 de prompturi din setul de date au fost selectate aleatoriu și trecute printr-un model GPT-2 de dimensiune medie utilizând biblioteca Hugging-Face Transformers biblioteca. Astfel, au fost obținute două seturi de rezultate din aceleași prompturi: eseuri discursive scrise de oameni de la utilizatorii Reddit și texte generate de GPT-2.

Pentru a preveni ca aceiași lucrători AMT să judece aceeași poveste de mai multe ori, au fost solicitate trei judecăți ale lucrătorilor AMT pe exemplu. Împreună cu experimentele privind capacitățile lingvistice ale lucrătorilor (a se vedea sfârșitul articolului) și discountând rezultatele de la lucrătorii cu efort scăzut (a se vedea ‘Timp scurt’ mai jos), acest lucru a crescut cheltuielile totale pentru AMT la aproximativ 1.500 de dolari.

Pentru a crea un teren de joc echitabil, toate testele au fost efectuate în zilele lucrătoare, între 11:00-11:30 PST.

Rezultate și concluzii

Studiul vast acoperă mult teren, dar punctele cheie sunt următoarele:

Timp scurt

Articolul a constatat că timpul mediu de lucru raportat de Amazon de 360 de secunde s-a dovedit a fi un timp de lucru real de doar 22 de secunde, și un timp mediu de lucru de doar 13 secunde – un sfert din timpul luat de cel mai rapid profesor de engleză care reproduce sarcina.

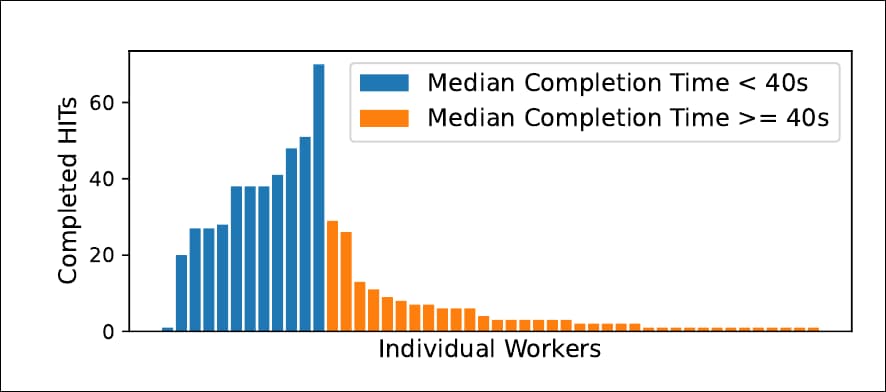

Din ziua 2 a studiului: lucrătorii individuali (în portocaliu) au petrecut mult mai puțin timp evaluând fiecare sarcină decât profesorii mai bine plătiți, și (mai târziu) contractanții Upwork și mai bine plătiți. Sursa: https://arxiv.org/pdf/2109.06835.pdf

Deoarece AMT nu impune nicio limită pentru sarcinile de inteligență umană (HIT) pe care un lucrător individual le poate prelua, “campionii” AMT au apărut, cu reputații profitabile pentru finalizarea unui număr mare de sarcini pe experiment. Pentru a compensa pentru HIT-urile acceptate de același lucrător, cercetătorii au măsurat timpul dintre HIT-urile consecutive preluate, comparând timpul de început și de sfârșit al fiecărui HIT. În acest fel, lipsa dintre WorkTimeInSeconds raportat de AMT și timpul real petrecut pe sarcină a devenit clară.

Deoarece o astfel de muncă nu poate fi realizată în aceste intervale de timp reduse, cercetătorii au trebuit să compenseze pentru acest lucru:

‘Deoarece este imposibil să citiți cu atenție un fragment de poveste de lungimea unui paragraf și să evaluați toate cele patru proprietăți în doar 13 secunde, măsurăm impactul asupra ratingurilor medii atunci când filtrăm lucrătorii care petrec prea puțin timp pe HIT… În mod specific, eliminăm judecățile lucrătorilor ale căror timp mediu este sub 40s (care este o bară scăzută), și găsim că, în medie, aproximativ 42% din ratingurile noastre sunt eliminate (variază de la 20%-72% în toate experimentele).’

Articolul susține că timpul de lucru real raportat în AMT este “o problemă majoră” de obicei neglijată de cercetătorii care utilizează serviciile.

Este necesară îndrumarea

Rezultatele sugerează, de asemenea, că lucrătorii AMT nu pot distinge în mod fiabil între textul scris de un om și textul scris de o mașină, cu excepția cazului în care văd ambele texte una lângă alta, ceea ce ar compromite în mod eficient un scenariu de evaluare tipic (în care cititorul ar trebui să poată face o judecată pe baza unui singur exemplar de text, “real” sau generat artificial).

Acceptarea casuală a textului artificial de calitate scăzută

Lucrătorii AMT au evaluat constant textul artificial de calitate scăzută pe baza GPT la fel ca textul coerent de calitate superioară scris de oameni, în contrast cu profesorii de engleză, care au putut distinge cu ușurință diferența de calitate.

Fără timp de pregătire, zero context

Intrarea în starea de spirit corectă pentru o astfel de sarcin abstractă, cum ar fi evaluarea autenticității, nu vine în mod natural; profesorii de engleză au necesitat 20 de sarcini pentru a-și calibra sensibilitățile la mediul de evaluare, în timp ce lucrătorii AMT nu primesc, de obicei, niciun “timp de orientare” deloc, ceea ce scade calitatea intrărilor lor.

Jocul sistemului

Raportul susține că timpul total petrecut de lucrătorii AMT pe sarcini individuale este inflatat de lucrători care acceptă multiple sarcini simultan și rulează sarcinile în diferite file ale browserului, în loc să se concentreze pe o singură sarcin pentru durata de sarcină înregistrată.

Țara de origine este importantă

Setările implicite ale AMT nu filtrează lucrătorii după țara de origine, iar raportul notează lucrări anterioare care indică faptul că lucrătorii AMT utilizează VPN-uri pentru a ocoli restricțiile geografice, permițând vorbitorilor non-nativi să se prezinte ca vorbitori nativi (într-un sistem care, poate în mod naiv, echivalează limba maternă a unui lucrător cu locația geografică bazată pe IP).

Astfel, cercetătorii au reexecutat testele de evaluare pe AMT cu filtre care limitează potențialii lucrători la non-țări vorbitoare de engleză, găsind că ‘lucrătorii din țări non-vorbitoare de engleză au evaluat coerența, relevanța și gramatica… semnificativ mai scăzut decât lucrătorii identic calificați din țări vorbitoare de engleză’.

Raportul conchide:

‘[Evaluatori] experți, cum ar fi lingviștii sau profesorii de limbă, ar trebui să fie utilizați ori de câte ori este posibil, deoarece aceștia au fost deja instruiți să evalueze textul scris, și nu este mult mai scump…’

Publicat pe 16 septembrie 2021 – Actualizat pe 18 decembrie 2021: Adăugate etichete