Inteligență artificială

Problema Cutiei Negre în LLM: Provocări și Soluții Emergente

Învățarea automată, o subcategorie a inteligenței artificiale, implică trei componente: algoritmi, date de antrenare și modelul rezultat. Un algoritm, esențialmente un set de proceduri, învață să identifice modele dintr-un set mare de exemple (date de antrenare). Rezultatul acestui antrenament este un model de învățare automată. De exemplu, un algoritm antrenat cu imagini de câini ar rezulta într-un model capabil să identifice câini în imagini.

Cutia Neagră în Învățarea Automată

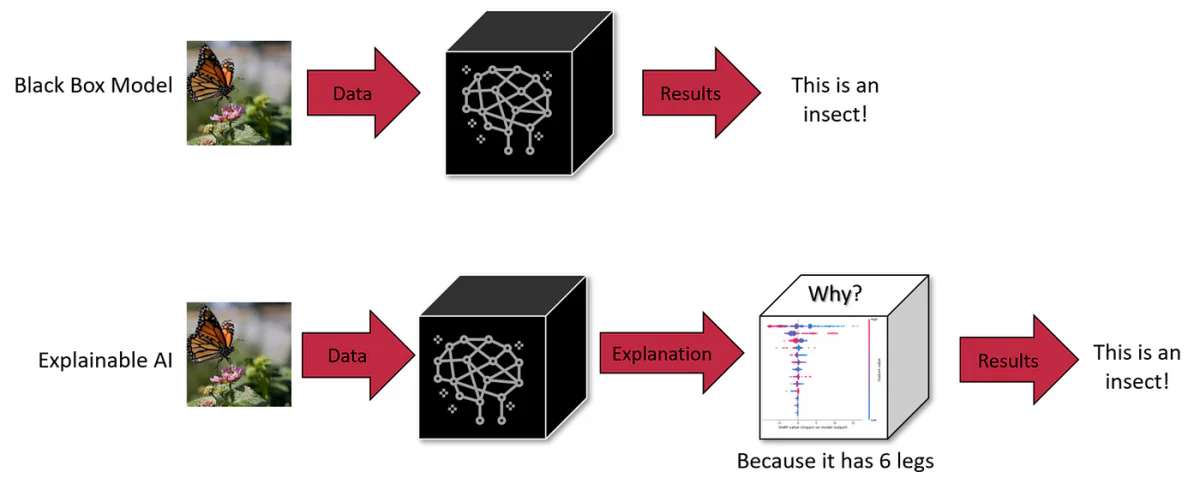

În învățarea automată, oricare dintre cele trei componente – algoritm, date de antrenare sau model – poate fi o cutie neagră. În timp ce algoritmii sunt adesea cunoscuți public, dezvoltatorii pot alege să păstreze modelul sau datele de antrenare secrete pentru a proteja proprietatea intelectuală. Această obscuritate face dificilă înțelegerea procesului de luare a deciziilor al IA.

Cutiile negre ale IA sunt sisteme ale căror mecanisme interne rămân opace sau invizibile pentru utilizatori. Utilizatorii pot introduce date și primi ieșiri, dar logica sau codul care produce ieșirea rămâne ascuns. Acesta este un caracteristic comun în multe sisteme IA, inclusiv modele generative avansate precum ChatGPT și DALL-E 3.

LLM-uri precum GPT-4 prezintă o provocare semnificativă: mecanismele lor interne sunt în mare măsură opace, făcându-le “cutii negre”. O astfel de opacitate nu este doar o puzzle tehnic; ridică preocupări reale de siguranță și etică. De exemplu, dacă nu putem înțelege cum aceste sisteme ajung la concluzii, putem să ne încredem în ele în domenii critice precum diagnosticarea medicală sau evaluarea financiară?

Explorarea Tehnicilor LIME și SHAP

Interpretabilitatea în învățarea automată (ML) și învățarea profundă (DL) ne ajută să vedem în mecanismele interne opace ale acestor modele avansate. Explicații Locale Interpretabile Model-Agnostice (LIME) și Explicații Aditive Shapley (SHAP) sunt două tehnici de interpretabilitate de acest fel.

LIME, de exemplu, descompune complexitatea prin crearea unor modele surrogate mai simple, locale, care aproximează comportamentul modelului original în jurul unui anumit intrare. Prin aceasta, LIME ajută la înțelegerea modului în care caracteristicile individuale influențează predicțiile modelelor complexe, oferind în esență o “explicație locală” pentru de ce un model a luat o anumită decizie. Este deosebit de util pentru utilizatorii non-tehnici, deoarece traduce procesul complex de luare a deciziilor al modelelor în termeni mai ușor de înțeles.

SHAP, pe de altă parte, se inspiră din teoria jocurilor, în special din conceptul de valori Shapley. Atribuie o valoare de “importanță” fiecărei caracteristici, indicând cât de mult contribuie fiecare caracteristică la diferența dintre predicția reală și predicția de bază (predicția medie pe toate intrările). Punctul forte al SHAP constă în coerența și capacitatea sa de a oferi o perspectivă globală – nu explică doar predicții individuale, ci oferă și insight-uri în modelul în ansamblu. Acest lucru este deosebit de valoros în modelele de învățare profundă, unde straturile interconectate și numeroșii parametri adesea fac procesul de predicție să pară un drum prin labirint. SHAP demistifică acest lucru prin cuantificarea contribuției fiecărei caracteristici, oferind o hartă mai clară a căilor de luare a deciziilor ale modelului.

SHAP (Source)

Ambele, LIME și SHAP, au devenit unelte esențiale în domeniul IA și ML, adresând nevoia critică de transparență și încredere. Pe măsură ce continuăm să integrăm IA mai profund în diverse sectoare, capacitatea de a interpreta și înțelege aceste modele devine nu doar o necesitate tehnică, ci și o cerință fundamentală pentru dezvoltarea etică și responsabilă a IA. Aceste tehnici reprezintă progrese semnificative în dezlegarea complexității modelelor ML și DL, transformându-le din “cutii negre” în sisteme inteligibile ale căror decizii și comportamente pot fi înțelese, încredințate și utilizate eficient.

Scalabilitatea și Complexitatea LLM-urilor

Scalabilitatea acestor modele adaugă la complexitatea lor. Luați, de exemplu, GPT-3, cu cei 175 de miliarde de parametri, și modelele mai noi care au trilioane. Fiecare parametru interacționează în moduri intricate în cadrul rețelei neuronale, contribuind la capacități emergente care nu pot fi prevăzute prin examinarea componentelor individuale. Această scalabilitate și complexitate fac aproape imposibilă înțelegerea completă a logicii interne, ridicând un obstacol în diagnosticarea prejudecăților sau comportamentelor nedorite în aceste modele.

Compromisul: Scală vs. Interpretabilitate

Reducerea scalei LLM-urilor ar putea îmbunătăți interpretabilitatea, dar la costul capacităților avansate. Scalabilitatea este ceea ce permite comportamente pe care modelele mai mici nu le pot atinge. Acest lucru prezintă un compromis inerent între scală, capacitate și interpretabilitate.

Impactul Problemei Cutiei Negre a LLM-urilor

1. Luarea Deciziilor Defectuoase

Opacitatea în procesul de luare a deciziilor al LLM-urilor, cum ar fi GPT-3 sau BERT, poate duce la prejudecăți și erori nedetectate. În domenii precum sănătatea sau justiția penală, unde deciziile au consecințe de anvergură, incapacitatea de a audita LLM-urile pentru corectitudine etică și logică este o preocupare majoră. De exemplu, un LLM de diagnostic medical care se bazează pe date învechite sau prejudecate poate face recomandări dăunătoare. Similar, LLM-urile în procesele de angajare pot perpetua involuntar prejudecățile de gen. Natura de cutie neagră nu numai că ascunde defectele, dar poate și amplifica, necesitând o abordare proactivă pentru a îmbunătăți transparența.

2. Adaptabilitate Limitată în Contexte Diverse

Lipsa de insight în mecanismele interne ale LLM-urilor restricționează adaptabilitatea lor. De exemplu, un LLM de angajare ar putea fi ineficient în evaluarea candidaților pentru un rol care valorizează abilitățile practice peste calificările academice, din cauza incapacității sale de a ajusta criteriile de evaluare. Similar, un LLM medical ar putea lupta cu diagnosticele bolilor rare din cauza dezechilibrelor de date. Această inflexibilitate subliniază nevoia de transparență pentru a recalibra LLM-urile pentru sarcini și contexte specifice.

3. Prejudecăți și Lacune de Cunoaștere

Procesarea datelor de antrenare de către LLM-uri este supusă limitărilor impuse de algoritmii și arhitecturile modelului. De exemplu, un LLM medical ar putea arăta prejudecăți demografice dacă a fost antrenat pe seturi de date dezechilibrate. De asemenea, competența unui LLM în subiecte de nișă ar putea fi înșelătoare, conducând la ieșiri incorecte și pline de încredere. Abordarea acestor prejudecăți și lacune de cunoaștere necesită mai mult decât doar date suplimentare; necesită examinarea mecanismelor de procesare ale modelului.

4. Răspundere Juridică și Etică

Natura opacă a LLM-urilor creează o zonă gri juridică în ceea ce privește răspunderea pentru orice prejudiciu cauzat de deciziile lor. Dacă un LLM într-un mediu medical oferă sfaturi defectuoase care duc la prejudicii asupra pacientului, stabilirea răspunderii devine dificilă din cauza opacității modelului. Această incertitudine juridică prezintă riscuri pentru entitățile care implementează LLM-uri în domenii sensibile, subliniind nevoia de guvernanță și transparență clară.

5. Probleme de Încredere în Aplicații Sensibile

Pentru LLM-urile utilizate în domenii critice precum sănătatea și finanțele, lipsa de transparență subminează încrederea în ele. Utilizatorii și regulatorii trebuie să se asigure că aceste modele nu conțin prejudecăți sau iau decizii pe baza unor criterii injuste. Verificarea absenței prejudecăților în LLM-uri necesită o înțelegere a procesului de luare a deciziilor, subliniind importanța explicabilității pentru implementarea etică.

6. Riscuri cu Datele Personale

LLM-urile necesită date de antrenare extinse, care pot include informații personale sensibile. Natura de cutie neagră a acestor modele ridică preocupări cu privire la modul în care aceste date sunt procesate și utilizate. De exemplu, un LLM medical antrenat pe înregistrări de pacienți ridică întrebări despre confidențialitatea și utilizarea datelor. Asigurarea că datele personale nu sunt utilizate abuziv sau exploatate necesită procese de manipulare a datelor transparente în cadrul acestor modele.

Soluții Emergente pentru Interpretabilitate

Pentru a aborda aceste provocări, se dezvoltă tehnici noi. Acestea includ metode de aproximare a contrafaptelor (CF). Prima metodă implică solicitarea unui LLM să modifice un anumit concept textual, păstrând alte concepte constante. Această abordare, deși eficientă, este intensivă din punct de vedere al resurselor la momentul inferenței.

A doua abordare implică crearea unui spațiu de încorporare dedicat, condus de un LLM în timpul antrenamentului. Acest spațiu se aliniază cu un grafic cauzal și ajută la identificarea corespondențelor care aproximează contrafaptele. Această metodă necesită mai puține resurse la momentul testării și s-a dovedit a fi eficientă în explicarea predicțiilor modelului, chiar și în LLM-urile cu miliarde de parametri.

Aceste abordări subliniază importanța explicațiilor cauzale în sistemele NLP pentru a asigura siguranța și a stabili încrederea. Aproximările contrafaptelor oferă o modalitate de a imagina cum ar fi schimbat un anumit text dacă un anumit concept din procesul său generativ ar fi fost diferit, ajutând la estimarea practică a efectelor cauzale ale conceptelor de nivel înalt asupra modelelor NLP.

Analiză Aprofundată: Metode de Explicare și Cauzalitate în LLM-uri

Unelte de Sondezare și Importanță a Caracteristicilor

Sondezarea este o tehnică utilizată pentru a descifra ce reprezentări interne din modele codifică. Poate fi supravegheată sau nesupravegheată și are ca scop determinarea dacă anumite concepte sunt codificate în anumite locuri din rețea. Deși eficientă până la un anumit punct, sondele nu reușesc să ofere explicații cauzale, așa cum subliniază Geiger et al. (2021).

Uneltele de importanță a caracteristicilor, o altă formă de metodă de explicare, se concentrează adesea pe caracteristicile de intrare, deși unele metode bazate pe gradient se extind la stări ascunse. Un exemplu este metoda Integrated Gradients, care oferă o interpretare cauzală prin explorarea intrărilor de referință (contrafactuale, CF). În ciuda utilității lor, aceste metode încă luptă să conecteze analizele lor cu concepte din lumea reală dincolo de proprietățile simple de intrare.

Metode Bazate pe Intervenții

Metodele bazate pe intervenții implică modificarea intrărilor sau reprezentărilor interne pentru a studia efectele asupra comportamentului modelului. Aceste metode pot crea stări contrafactuale pentru a estima efecte cauzale, dar adesea generează intrări sau stări de rețea neverosimile, cu excepția cazului în care sunt controlate cu atenție. Modelul Proxy Cauzal (CPM), inspirat de conceptul de învățare S, este o abordare nouă în acest domeniu, imitând comportamentul modelului explicat sub intrări contrafactuale. Cu toate acestea, nevoia de un explicator distinct pentru fiecare model este o limitare majoră.

Aproximarea Contrafaptelor

Contrafaptele sunt utilizate pe scară largă în învățarea automată pentru augmentarea datelor, implicând perturbări ale diferiților factori sau etichete. Acestea pot fi generate prin editare manuală, înlocuirea cuvintelor cheie sau rescrierea textului automată. Deși editarea manuală este precisă, este și intensivă din punct de vedere al resurselor. Metodele bazate pe cuvinte cheie au limitele lor, iar abordările generative oferă un echilibru între fluență și acoperire.

Explicații Fidele

Fidelitatea în explicații se referă la reprezentarea precisă a raționamentului subiacent al modelului. Nu există o definiție universal acceptată a fidelității, ceea ce duce la caracterizarea sa prin diverse metrice, cum ar fi Sensibilitate, Coerență, Acord de Importanță a Caracteristicilor, Robustitate și Simulabilitate. Majoritatea acestor metode se concentrează pe explicațiile la nivel de caracteristici și adesea confundă corelația cu cauzalitatea. Lucrarea noastră urmărește să ofere explicații la nivel de concept, utilizând literatura de cauzalitate pentru a propune un criteriu intuitiv: Fidelitatea Ordinată.

Am explorat complexitățile inerente ale LLM-urilor, înțelegând natura lor de “cutie neagră” și provocările semnificative pe care le ridică. De la riscurile deciziilor defectuoase în domenii sensibile, cum ar fi sănătatea și finanțele, la dilemele etice care înconjoară prejudecățile și echitatea, nevoia de transparență în LLM-uri a devenit mai evidentă ca niciodată.

Viitorul LLM-urilor și integrarea lor în viața noastră de zi cu zi și în procesele de luare a deciziilor critice depinde de capacitatea noastră de a face aceste modele nu numai mai avansate, ci și mai inteligibile și responsabile. Urmărirea explicabilității și interpretabilității nu este doar o întreprindere tehnică, ci și un aspect fundamental al construirii încrederii în sistemele de inteligență artificială. Pe măsură ce LLM-urile devin mai integrate în societate, cererea de transparență va crește, nu doar din partea practicienilor de IA, ci și a fiecărui utilizator care interacționează cu aceste sisteme.