Inteligență artificială

StyleTTS 2: Text-to-Speech la nivel uman cu modele de limbaj vorbit mari

Datorită creșterii abordărilor de sinteză a vorbirii naturale și sintetice, una dintre realizările majore pe care industria AI le-a obținut în ultimii ani este să sintetizeze eficient cadre de text-la-vorbire cu aplicații potențiale în diferite industrii, inclusiv cărți audio, asistenți virtuali, narări voice-over și multe altele, cu unele moduri de ultimă generație care oferă performanțe și eficiență la nivel uman într-o gamă largă de sarcini legate de vorbire. Cu toate acestea, în ciuda performanței puternice, există încă loc pentru îmbunătățire a sarcinilor datorită vorbirii expresive și diverse, a necesității unei cantități mari de date de antrenare pentru optimizarea cadrului text-la-vorbire zero-shot și a robusteței pentru texte în afara distribuției (OOD), ceea ce determină dezvoltatorii să lucreze la un cadru de text-la-vorbire mai robust și mai accesibil.

În acest articol, vom discuta despre StyleTTS-2, un cadru de text-la-vorbire robust și inovator care se bazează pe fundațiile cadrului StyleTTS și își propune să prezinte următorul pas către sisteme de text-la-vorbire de ultimă generație. Cadrul StyleTTS2 modelează stilurile de vorbire ca variabile aleatoare latente și utilizează un model de difuzie probabilistic pentru a sampila aceste stiluri de vorbire sau variabile aleatoare, permițând astfel cadrului StyleTTS2 să sintetizeze vorbire realistă fără a utiliza intrări audio de referință. Datorită abordării, cadrul StyleTTS2 oferă rezultate mai bune și prezintă o eficiență ridicată în comparație cu cadrele de text-la-vorbire de ultimă generație actuale, dar poate să profite și de sinteza de vorbire diversă oferită de cadrele de difuzie.

StyleTTS2 pentru sinteză de text-la-vorbire: O introducere

StyleTTS2 este un model de sinteză de text-la-vorbire inovator care reprezintă următorul pas către construirea de cadre TTS la nivel uman și se bazează pe StyleTTS, un model generativ de text-la-vorbire bazat pe stil. Cadrul StyleTTS2 modelează stilurile de vorbire ca variabile aleatoare latente și utilizează un model de difuzie probabilistic pentru a sampila aceste stiluri de vorbire sau variabile aleatoare, permițând astfel cadrului StyleTTS2 să sintetizeze vorbire realistă fără a utiliza intrări audio de referință. Modelarea stilurilor ca variabile aleatoare latente este ceea ce separă cadrul StyleTTS2 de predecesorul său, cadrul StyleTTS, și își propune să genereze cel mai potrivit stil de vorbire pentru textul de intrare fără a necesita o intrare audio de referință și poate să atingă difuzii latente eficiente, profitând de capacitățile de sinteză de vorbire diverse oferite de modelele de difuzie.

De asemenea, cadrul StyleTTS2 utilizează un model de limbaj vorbit pre-antrenat mare (SLM) ca discriminator, cum ar fi cadrul WavLM, și îl combină cu o abordare nouă de modelare a duratei diferențiale pentru a antrena cadrul de la capăt la capăt, generând astfel vorbire cu o naturalitate îmbunătățită. Datorită abordării pe care o urmează, cadrul StyleTTS2 depășește cadrele actuale de ultimă generație pentru sarcinile de generare a vorbirii și este unul dintre cele mai eficiente cadre pentru antrenarea modelelor de vorbire la scară largă în setări zero-shot pentru sarcinile de adaptare a vorbirii.

În continuare, pentru a oferi sinteză de text-la-vorbire la nivel uman, cadrul StyleTTs2 incorporează învățămintele din lucrările existente, inclusiv modelele de difuzie pentru sinteza vorbirii și modelele de limbaj vorbit mari. Modelele de difuzie sunt utilizate în mod normal pentru sarcinile de sinteză a vorbirii datorită capacităților lor de control fin al vorbirii și a capacităților de eșantionare a vorbirii diverse. Cu toate acestea, modelele de difuzie nu sunt la fel de eficiente ca cadrele GAN bazate pe non-iterative și un motiv major pentru acest lucru este necesitatea de a sampila reprezentări latente, forme de undă și mel-spectrograme iterativ până la durata țintă a vorbirii.

Pe de altă parte, lucrările recente din jurul modelelor de limbaj vorbit mari au indicat capacitatea lor de a îmbunătăți calitatea sarcinilor de generare a vorbirii și de a se adapta bine la vorbitor. Modelele de limbaj vorbit mari convertesc în mod normal textul de intrare în reprezentări cuantificate sau continue derivate din cadre de limbaj vorbit pre-antrenate pentru sarcinile de reconstruire a vorbirii. Cu toate acestea, caracteristicile acestor modele de limbaj vorbit nu sunt optimizate direct pentru sinteza vorbirii. În contrast, cadrul StyleTTS2 profitează de cunoștințele dobândite de cadrele de limbaj vorbit mari utilizând antrenamentul adversarial pentru a sintetiza caracteristicile modelelor de limbaj vorbit fără a utiliza hărți de spațiu latent și, prin urmare, învățând un spațiu latent optimizat direct pentru sinteza vorbirii.

StyleTTS2: Arhitectură și metodologie

La nivel de bază, StyleTTS2 se bazează pe predecesorul său, cadrul StyleTTS, care este un cadru de text-la-vorbire non-autoregresiv care utilizează un encoder de stil pentru a deriva un vector de stil din intrarea audio de referință, permițând astfel generarea de vorbire naturală și expresivă. Vectorul de stil utilizat în cadrul StyleTTS este incorporat direct în encoder, durată și predictor, utilizând AdaIN sau normalizarea adaptivă a instanței, permițând astfel modelului StyleTTS să genereze ieșiri de vorbire cu prosodie, durată și emoții variate.

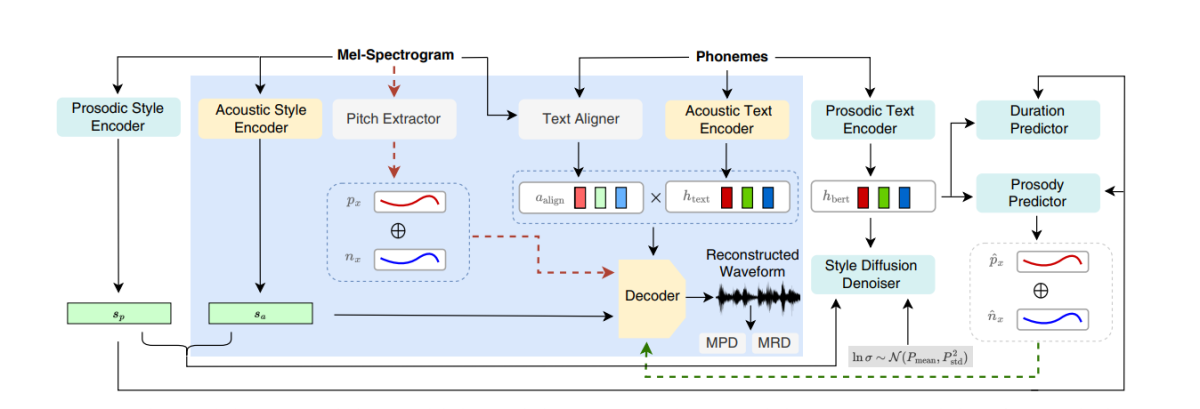

- Modele acustice sau sistem de generare a vorbirii cu un encoder de stil, un encoder de text și un decoder de vorbire.

- Un sistem de predicție text-la-vorbire care utilizează predictorii de prosodie și durată.

- Un sistem utilitar care include un aliniator de text, un extractor de pitch și un discriminator pentru scopuri de antrenare.

Datorită abordării sale, cadrul StyleTTS oferă performanțe de ultimă generație legate de sinteza de vorbire controlabilă și diversă. Cu toate acestea, această performanță are și dezavantaje, cum ar fi degradarea calității eșantioanelor, limitări expresive și dependență de aplicații de vorbire în timp real.

Îmbunătățind cadrul StyleTTS, modelul StyleTTS2 rezultă în sarcini de text-la-vorbire expresive îmbunătățite, cu o performanță mai bună în afara distribuției și o calitate la nivel uman ridicată. Cadrul StyleTTS2 utilizează un proces de antrenare de la capăt la capăt care optimizează componentele diferite cu antrenament adversarial și sinteză directă a formei de undă, în mod conjunct. În contrast cu cadrul StyleTTS, cadrul StyleTTS2 modelează stilul de vorbire ca o variabilă latentă și îl sampilează prin modele de difuzie, generând astfel eșantioane de vorbire diverse fără a utiliza o intrare audio de referință.

Antrenare de la capăt la capăt pentru interferență

În cadrul StyleTTS2, se utilizează o abordare de antrenare de la capăt la capăt pentru a optimiza diverse componente de text-la-vorbire pentru interferență fără a depinde de componente fixe. Cadrul StyleTTS2 realizează acest lucru prin modificarea decoderului pentru a genera forma de undă direct din vectorul de stil, curbele de pitch și energie și reprezentările aliniate. Apoi, cadrul îndepărtează ultimul strat de proiecție al decoderului și îl înlocuiește cu un decoder de formă de undă. Cadrul StyleTTS2 utilizează două encodere: un decoder HifiGAN bazat pentru a genera forma de undă direct și un decoder iSTFT bazat pentru a produce fază și magnitudine care sunt convertite în forme de undă pentru interferență și antrenare mai rapide.

Figura de mai sus reprezintă modelele acustice utilizate pentru pre-antrenare și antrenare conjunctă. Pentru a reduce timpul de antrenare, modulele sunt optimizate mai întâi în faza de pre-antrenare, urmată de optimizarea tuturor componentelor, cu excepția extractorului de pitch, în timpul antrenării conjuncte. Motivul pentru care antrenarea conjunctă nu optimizează extractorul de pitch este că acesta este utilizat pentru a furniza adevărul pentru curbele de pitch.

Figura de mai sus reprezintă antrenamentul adversarial al modelului de limbaj vorbit și interferența cu cadrul WavLM pre-antrenat, dar nu pre-ajustat. Procesul diferă de cel menționat mai sus, deoarece poate lua intrări de text variate, dar acumulează gradientele pentru a actualiza parametrii în fiecare lot.

Difuzie de stil

Cadrul StyleTTS2 își propune să modeleze vorbirea ca o distribuție condițională prin intermediul unei variabile latente care urmează distribuția condițională, iar această variabilă se numește stil de vorbire generalizat și reprezintă orice caracteristică a eșantionului de vorbire dincolo de conținutul fonetic, inclusiv stresul lexical, prosodia, viteza de vorbire și chiar tranzițiile de formant.

Discriminatoare de modele de limbaj vorbit

Modelele de limbaj vorbit sunt renumite pentru capacitățile lor generale de a codifica informații valoroase despre o gamă largă de aspecte semantice și acustice, iar reprezentările SLM au fost în mod tradițional capabile să imite percepțiile umane pentru a evalua calitatea vorbirii generate. Cadrul StyleTTS2 utilizează o abordare de antrenament adversarial pentru a utiliza capacitatea encodatorilor SLM de a efectua sarcini generative și angajează un cadru WavLM de 12 straturi ca discriminator. Această abordare permite cadrului să permită antrenarea pe texte în afara distribuției (OOD) care pot ajuta la îmbunătățirea performanței. Mai mult, pentru a preveni problemele de suprapunere, cadrul eșantionează texte OOD și în distribuție cu probabilitate egală.

Modelare diferențială a duratei

În mod tradițional, un predictor de durată este utilizat în cadrele de text-la-vorbire care produce durate de foneme, dar metodele de upsampling pe care le utilizează predictorii de durată blochează adesea fluxul de gradient în timpul procesului de antrenare de la capăt la capăt, iar cadrul NaturalSpeech utilizează un upsampler bazat pe atenție pentru conversia text-la-vorbire la nivel uman. Cu toate acestea, cadrul StyleTTS2 găsește această abordare instabilă în timpul antrenării adverse, deoarece StyleTTS2 se antrenează utilizând upsampling diferențial cu antrenament adversarial fără pierderi suplimentare din cauza neconcordanței lungimii din cauza deviațiilor. Deși utilizarea unei abordări de warp temporal dinamic moale poate ajuta la mitigarea acestei neconcordanțe, utilizarea sa nu numai că este computațional scumpă, dar și stabilitatea sa este o problemă atunci când se lucrează cu obiective adverse sau sarcini de reconstruire a mel-ului.

Pentru a întâmpina această limitare, cadrul StyleTTC2 propune utilizarea unei noi abordări de upsampling non-parametric fără antrenament suplimentar și capabilă să țină cont de lungimile variate ale alinierilor. Pentru fiecare fonem, cadrul StyleTTC2 modelează alinierea ca o variabilă aleatoare și indică indexul cadrelor de vorbire cu care fonemul se aliniază.

Antrenarea și evaluarea modelului

Cadrul StyleTTC2 este antrenat și experimentat pe trei seturi de date: VCTK, LibriTTS și LJSpeech. Componenta cu un singur vorbitor a cadrului StyleTTS2 este antrenată utilizând setul de date LJSpeech, care conține aproximativ 13.000 de eșantioane audio, împărțite în 12.500 de eșantioane de antrenare, 100 de eșantioane de validare și aproximativ 500 de eșantioane de testare, cu timpul de rulare total de aproximativ 24 de ore. Componenta multi-vorbitor a cadrului este antrenată pe setul de date VCTK, care constă din peste 44.000 de clipuri audio cu peste 100 de vorbitori nativi cu accente variate și este împărțit în 43.500 de eșantioane de antrenare, 100 de eșantioane de validare și aproximativ 500 de eșantioane de testare. În final, pentru a dota cadrul cu capacități de adaptare zero-shot, cadrul este antrenat pe setul de date combinat LibriTTS, care constă din clipuri audio care totalizează aproximativ 250 de ore de audio cu peste 1.150 de vorbitori individuali. Pentru a evalua performanța sa, modelul utilizează două metrice: MOS-N sau Scorul de opinie mediu al naturalității și MOS-S sau Scorul de opinie mediu al similarității.

Rezultate

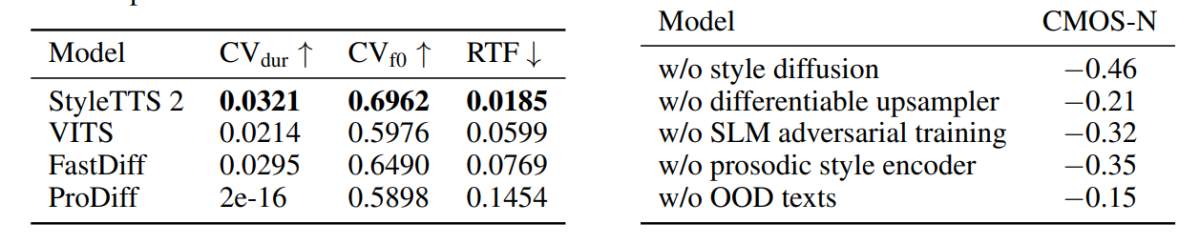

Abordarea și metodologia utilizate în cadrul StyleTTS2 sunt demonstrate în performanța sa, deoarece modelul depășește mai multe cadre TTS de ultimă generație, în special pe setul de date NaturalSpeech, și stabilește un nou standard pentru setul de date. Mai mult, cadrul StyleTTS2 depășește cadrul VITS de ultimă generație pe setul de date VCTK, iar rezultatele sunt demonstrate în figura de mai jos.

Modelul StyleTTS2 depășește, de asemenea, modelele anterioare pe setul de date LJSpeech și nu prezintă niciun grad de degradare a calității pe texte în afara distribuției (OOD), așa cum este afișat de cadrele anterioare pe aceleași metrice. Mai mult, în setarea zero-shot, modelul StyleTTC2 depășește cadrul Vall-E existent în ceea ce privește naturalitatea, deși rămâne în urmă în ceea ce privește similaritatea. Cu toate acestea, este important de remarcat că cadrul StyleTTS2 este capabil să atingă o performanță competitivă, în ciuda faptului că este antrenat doar pe 245 de ore de eșantioane audio, comparativ cu peste 60.000 de ore de antrenament pentru cadrul Vall-E, demonstrând astfel că StyleTTC2 este o alternativă eficientă din punct de vedere al datelor pentru metodele de pre-antrenare existente, cum ar fi cele utilizate în Vall-E.

În continuare, datorită lipsei de date de text audio etichetate cu emoții, cadrul StyleTTC2 utilizează modelul GPT-4 pentru a genera peste 500 de instanțe din diferite emoții pentru vizualizarea vectorilor de stil pe care cadrul îi creează utilizând procesul de difuzie.

În prima figură, stilurile emoționale în răspuns la sentimentele textului de intrare sunt ilustrate de vectorii de stil de la modelul LJSpeech, și demonstrează capacitatea cadrului StyleTTC2 de a sintetiza vorbire expresivă cu emoții variate. A doua figură prezintă clusterizări distincte pentru fiecare dintre cei cinci vorbitori individuali, demonstrând astfel o gamă largă de diversitate sursă dintr-un singur fișier audio. Figura finală demonstrează clusterul lânos al emoțiilor de la vorbitorul 1 și revelează că, în ciuda unor suprapuneri, clusterizările bazate pe emoții sunt proeminente, indicând astfel posibilitatea de a manipula tonul emoțional al unui vorbitor, indiferent de eșantionul audio de referință și de tonul său de intrare. În ciuda utilizării unei abordări bazate pe difuzie, cadrul StyleTTS2 reușește să depășească cadrele existente de ultimă generație, inclusiv VITS, ProDiff și FastDiff.

Gânduri finale

În acest articol, am discutat despre StyleTTS2, un cadru de text-la-vorbire inovator și robust care se bazează pe fundațiile cadrului StyleTTS și își propune să prezinte următorul pas către sisteme de text-la-vorbire de ultimă generație. Cadrul StyleTTS2 modelează stilurile de vorbire ca variabile aleatoare latente și utilizează un model de difuzie probabilistic pentru a sampila aceste stiluri de vorbire sau variabile aleatoare, permițând astfel cadrului StyleTTS2 să sintetizeze vorbire realistă fără a utiliza intrări audio de referință. Cadrul StyleTTS2 utilizează difuzia de stil și discriminatoarele SLM pentru a atinge performanțe la nivel uman în sarcinile de text-la-vorbire și reușește să depășească cadrele existente de ultimă generație pe o gamă largă de sarcini de vorbire.