Unghiul lui Anderson

Streaming AI Avatars Like It’s 1999

Noi cercetări prezintă o modalitate de a transmite avatare 3D realiste care apar aproape instantaneu și se clarifică în timp real, în loc de a forța utilizatorii să aștepte terminarea descărcărilor masive.

În multe feluri, cerințele uriașe de resurse ale sistemelor de generare AI și de renderizare asistate de AI au readus pregătirea pentru consumatori cu douăzeci de ani sau mai mult în urmă. Abia în 2023, o alocare de 64 GB RAM într-un laptop sau un PC de birou părea a fi o exagerare; acum, odată cu creșterea popularității RAM și/sau a deplasării CPU, 64 GB este destul de modest pentru nevoile locale de AI; și aceste elemente odată banale și accesibile ale PC-urilor continuă să crească în preț pe măsură ce corporațiile se luptă să îndeplinească cererea de servicii AI.

Scara și lăcomia AI și a proceselor și mediilor sale obișnuite depășesc în general hardware-ul de nivel consumator, și chiar rularea modelelor “slabe” locale, cum ar fi versiunile GGUF, va încorda de obicei sistemul mediu.

Chiar și serviciile de text bazat pe AI, cum ar fi ChatGPT, sunt supuse unor încărcări semnificative atât la nivelul clientului, cât și la nivelul serverului. Prin urmare, odată ce AI este însărcinat cu furnizarea de experiențe multimedia online în timp real, putem să ne așteptăm la compromisuri serioase în ceea ce privește latența și/sau calitatea – similare cu luptele internetului timpuriu cu streamingul media, și cu iconele animate “buffering” urâte ale RealPlayer și QuickTime.

Ultima dată când problemele multimedia și de rețea au creat fricțiuni în experiența utilizatorului, hardware-ul de nivel consumator încă evolua prin Legea lui Moore, devenind aproape exponențial mai bun în fiecare an, chiar și pe măsură ce sistemele de operare, rețelele și alte infrastructuri de susținere evoluau pentru a îndeplini cererea; și pentru ultimii zece ani, mai mult sau mai puțin, capacitățile tehnologiei consumatorilor au depășit cerințele multimedia (poate chiar până la punctul în care trebuia să fie declanșată o schimbare pentru a menține vânzările).

Dar acest surplus de capacitate locală poate să se încheie curând, pe măsură ce hardware-ul local devine mai puțin performant și mai scump, și pe măsură ce serviciile bazate pe AI cer resurse mai mari la nivelul serverului și local.

Obținerea unui Avantaj

În era pre-broadband, chiar înainte de apariția primului video streaming utilizabil, utilizatorii de web erau obișnuiți cu imaginile care apăreau încet, pe măsură ce JPEG-urile progresive permiteau utilizatorului să vadă imaginea care se descărca, formându-se uneori foarte lent, pe măsură ce se încărcau mai multe date locale.

Acum, pare că putem fi martorii unei experiențe similare cu avatarele Gaussian Splat aidate de AI:

Faceți clic pentru a juca. De pe site-ul proiectului ProgressiveAvatars, o comparație a avatarelor Gaussian care rulează. Sursă

Mai sus, vedem două versiuni ale unui avatar Gaussian Splat – o reprezentare umană realizată parțial printr-o tehnică de renderizare non-AI care datează de la începutul anilor 1990 și, de asemenea, prin metode mai moderne, cum ar fi modelul parametric uman FLAME și abordări de antrenare bazate pe AI:

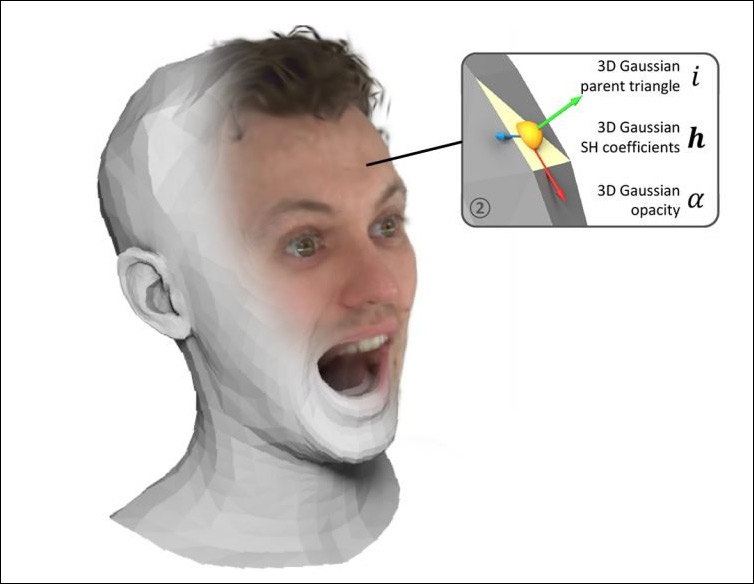

Gaussian Splatting folosește o reprezentare gaussiană a culorii și informațiilor 3D în locul unui pixel sau voxel și hărțuiește această textură ultrarealistă pe o rețea CGI mai tradițională, care la rândul său este facilitată de un ‘om parametric’, o față și/sau corp CGI, în sisteme cum ar fi FLAME și STAR. Sursă

Pe partea stângă a videoului de mai sus, putem vedea că o implementare tradițională a unui avatar Gaussian Splat arată destul de oribil pe măsură ce așteptăm ca datele să se încarce. Pe partea dreaptă, o nouă implementare din China, denumită ProgressiveAvatars, poate să se rezolve mult mai elegant pe măsură ce se încarcă datele, prezentând o imagine umană non-alarmantă de la început.

Autorii afirmă că metoda lor este prima care să “transmită” cu adevărat un avatar Gaussian și, cu siguranță, prima care să o facă în mod progresiv, unde imaginea se construiește elegant, și zonele cele mai importante – cum ar fi ochii și buzele – pot fi prioritizate, astfel încât avatarul să poată deveni conversațional chiar și atunci când este doar parțial încărcat:

Faceți clic pentru a juca. De pe site-ul proiectului ProgressiveAvatars, o ilustrare a încărcării atente.

Înainte de aceasta, o abordare “nivel de detaliu” (LOD) a fost utilizată în încercări anterioare de a slabi avatarele “GSplat”, similare cu optimizările jocurilor video, unde versiuni succesiv mai detaliate ale unei persoane sunt încărcate în funcție de faptul că acestea ocupă suficient viewport sau atenția vizualizatorului pentru a fi demn de efort.

Desigur, acest lucru implică o cantitate semnificativă de avatare “de schimb” redundante, și autorii își prezintă abordarea ca pe un sistem mai rațional. Prin implicație, o metodă de acest fel permite, de asemenea, modificări ale unei figuri GSplat (de exemplu, personalizare) fără a necesita propagarea acestor modificări printr-o serie de “gemeni” LOD.

Un Domeniu Emergent

Dacă acest lucru pare a fi o problemă de nișă, ei bine, la fel era și streamingul video, în zilele în care obținerea primelor plug-in-uri pentru a funcționa era atribuită celui mai apropiat nerd disponibil. Mai mult, potențialul reprezentărilor bazate pe AI pentru streaming depășește avatarele umane, extinzându-se la generarea orașelor, jocuri și versiuni 3D ale practic oricărui domeniu online – cum ar fi Încercarea virtuală, pentru cumpărături de îmbrăcăminte:

Faceți clic pentru a juca. De la un proiect din 2024, o privire aproximativă asupra viitorului încercării online. Alte proiecte încearcă să adauge mișcare și interactivitate – aspecte solicitante pentru a le transmite și gestiona. Sursă

La fel cum abordările bazate pe LOD au fost până acum utilizate în principal de jocuri video, multe alte considerații care au fost odată domeniul exclusiv al dezvoltării jocurilor vor fi probabil să intre în reprezentările bazate pe splat. De exemplu, majoritatea acestor prime ieșiri GSplat arată o persoană unică care face grimase și poze, sau poate vorbește; dar multe situații vor fi necesare care să prezinte multiple persoane, precum și caracteristici și ambianță ale mediului – un scenariu în care sistemele de “triage” foarte performante vor determina unde datele de transmisie trebuie să fie prioritizate, pentru a menține vizualizatorul în moment.

Articolul nou se intitulează ProgressiveAvatars: Avatare 3D Gaussian Progresive Animabile și provine de la trei cercetători de la Universitatea Științei și Tehnologiei din China, din Hefei.

Metodă

Abordarea inițială utilizează un videoclip al capului unei persoane. Pentru fiecare cadru, un model parametric standard FLAME este ajustat, astfel încât forma și expresia se schimbă în timp, în timp ce structura de bază a rețelei rămâne fixă. Deoarece topologia de bază nu se schimbă, un șablon FLAME stabil poate fi reutilizat și rafinat în loc să fie reconstruit de la zero la fiecare moment, așa cum se întâmplă în lucrările anterioare similare:

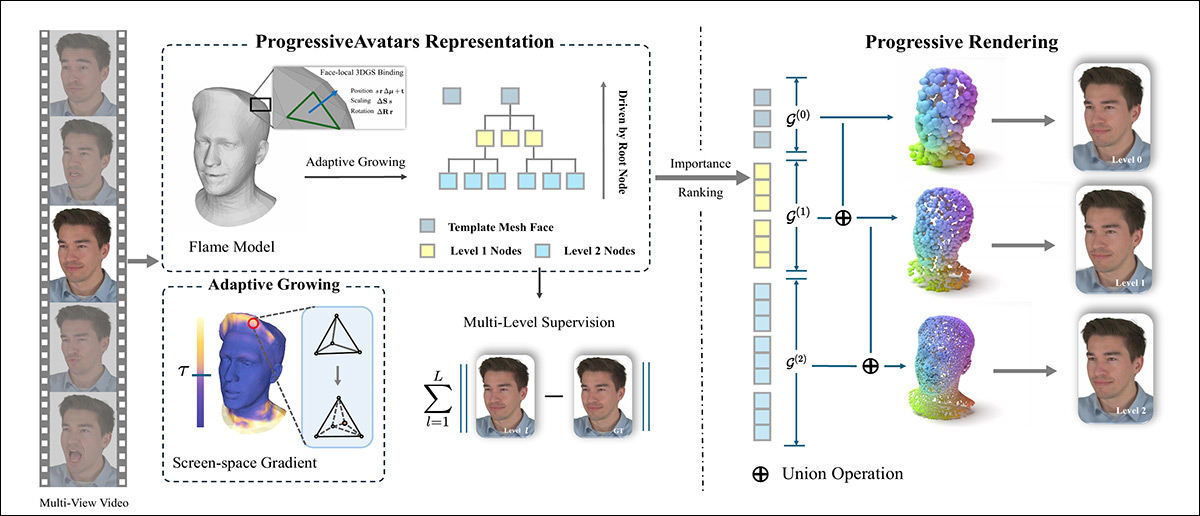

Videoclipul capului este mai întâi ajustat cu o rețea FLAME urmărită, după care gaussiene 3D sunt atașate la fiecare față și cresc ierarhic acolo unde gradientul spațiului de ecran indică lipsa de detalii. În timpul antrenamentului, această subdiviziune adaptivă construiește o reprezentare multi-nivel sub supraveghere multi-vizuală, și la inferență, scorurile de importanță per față determină care gaussiene sunt transmise mai întâi, permițând avatarului să apară rapid și să se rafineze progresiv pe măsură ce se adaugă niveluri de detalii mai mari.

Peste această structură de bază, se adaugă detalii în straturi; suprafața este subdivizată implicit într-o ierarhie, și mici gaussiene tridimensionale sunt atașate la fețele de la fiecare nivel de detaliu.

Deși straturile inițiale mai grosiere capturează forma generală a capului și mișcarea, straturile ulterioare mai fine oferă riduri, deformări subtile și textură de înaltă frecvență. Imaginile sunt apoi renderizate din aceste gaussiene utilizând un rasterizator gaussian diferențial și antrenat împotriva imaginilor de bază multi-vizuale, astfel încât avatarul să învețe să reproducă aspectul real al persoanei.

În timpul antrenamentului, această ierarhie crește automat: regiunile care necesită mai multe detalii sunt subdivizate mai departe, ghidate de semnalele spațiului de ecran, astfel încât efortul computațional să se concentreze acolo unde ochiul vizualizatorului este cel mai probabil să observe erorile.

În timpul inferenței, aceeași ierarhie permite transmiterea progresivă, în care o versiune aproximativă a unui avatar poate fi afișată mai întâi, și, pe măsură ce se încarcă straturi suplimentare, noi gaussiene pot fi adăugate fără a altera ceea ce este deja afișat, permițând un avatar de cap animabil care apare rapid și devine mai ascuțit și mai detaliat pe măsură ce sosesc mai multe date.

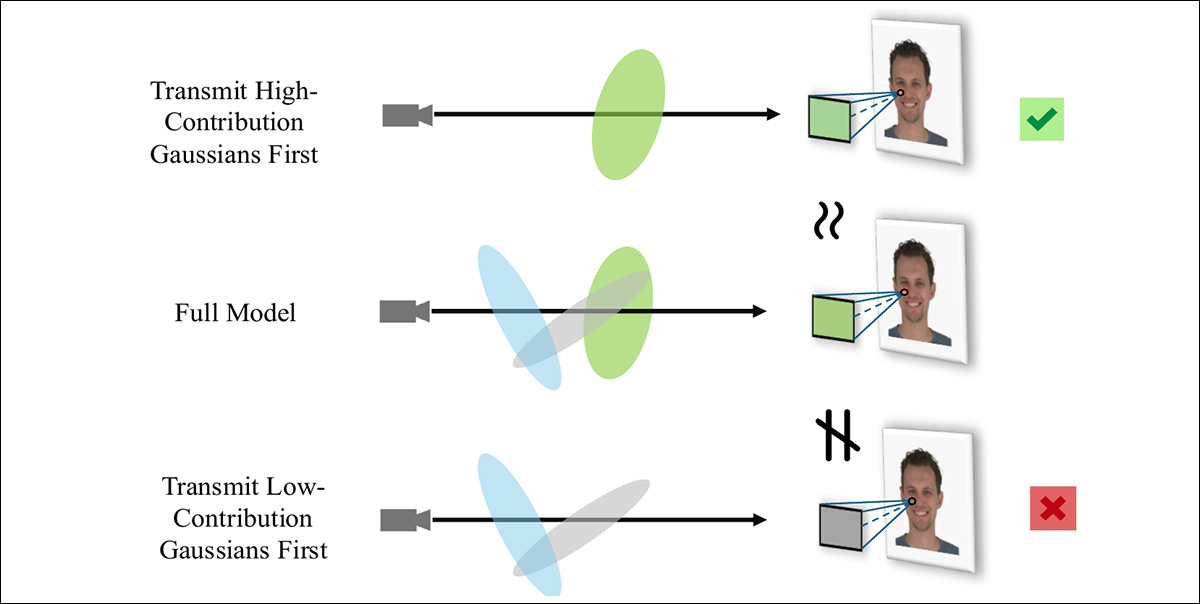

Autorii observă că întregul sistem se bazează pe prioritizarea datelor care sosesc:

Când toate gaussienele de la un anumit nivel sunt disponibile, modelul complet este renderizat cu fidelitate maximă; dar în timpul transmiterii, trimiterea gaussienelor cu contribuție cea mai mare mai întâi permite rezultate parțiale timpurii să se potrivească îndeaproape cu imaginea finală, în timp ce transmiterea gaussienelor cu contribuție scăzută mai întâi distorsionează balanța culorilor și subliniază componentele minore.

Date și Teste

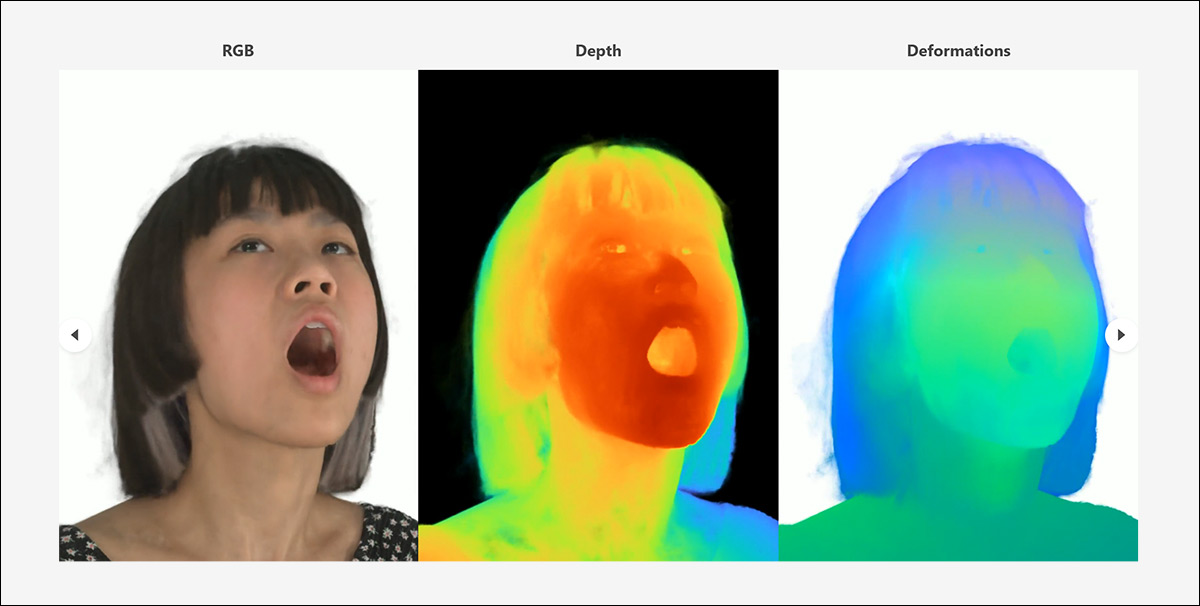

Pentru testele, noua metodă a fost evaluată pe setul de date NeRSemble, care constă în videoclipuri multi-vizuale pentru fiecare subiect acoperit, cu parametri calibrați pe toate vizualizările:

Exemple de interpretări diverse ale subiecților incluși în setul de date NeRSemble utilizat în testele pentru ProgressiveAvatars. Sursă

În conformitate cu metodologia GaussianAvatars originală, imaginile au fost redimensionate la 802x550px, s-a generat o mască de fundal, și s-a adoptat divizarea de antrenament/test originală a proiectului.

Optimizerul Adam a fost utilizat pentru actualizările parametrilor, cu o rată de învățare de 1×10-2 pentru toate coordonatele barycentrice. Antrenamentul a durat 60.000 de iterații, cu ierarhia extinsă automat la fiecare 2.000 de iterații.

Inițial, autorii au testat pentru reconstrucție și animație – sarcina de a converti videoclipuri plate într-un sistem 3D conștient (x/y/z), utilizând reprezentarea CGI canonică FLAME ca rețea de ancorare. Pentru aceasta, toate liniile de bază au fost antrenate de la zero, și cadrele rivale testate au fost GaussianAvatars menționate anterior și PointAvatar.

Pentru aceste teste, metricile utilizate au fost Raportul Semnal-Zgomot de Vârf (PSNR), Indexul de Similaritate Structurală (SSIM) și Similaritatea Perceptuală a Patches de Imagine Învățate (LPIPS):

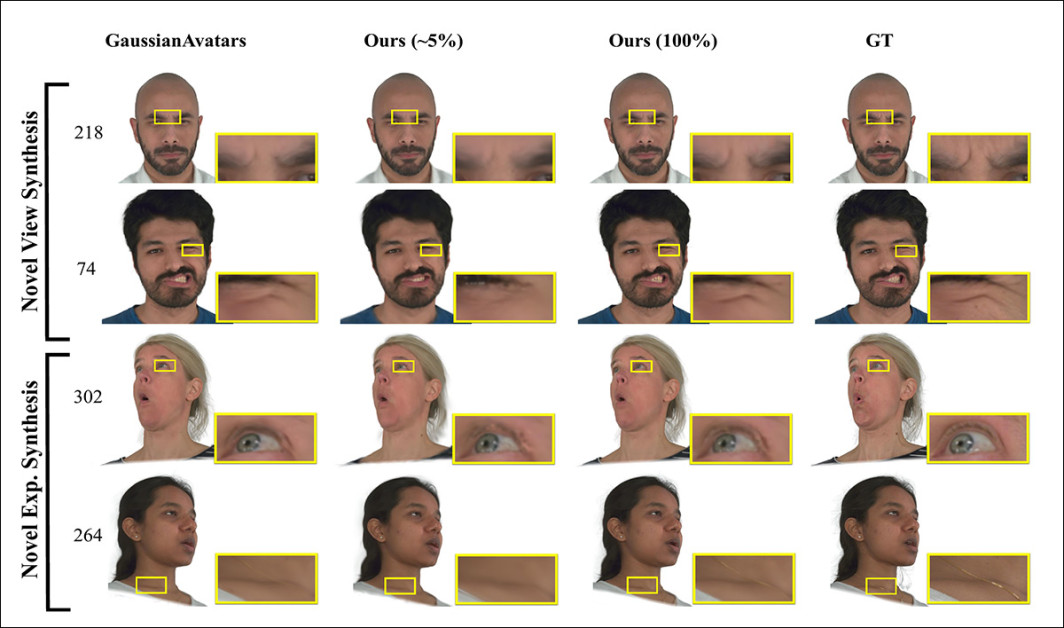

Comparație calitativă pe sinteza de vedere și expresie nouă. Liniile de bază GaussianAvatars se luptă cu detalii fine în jurul ochilor, riduri și textură a pielii, în timp ce metoda propusă păstrează deja structura facială cheie la aproximativ cinci procente din datele transmise și converge către imaginea de bază pe măsură ce se transmit mai multe gaussiene, potrivindu-se îndeaproape cu modelul complet și imaginile de referință (imaginea de bază).

În ceea ce privește aceste rezultate, autorii afirmă:

‘Metoda noastră reconstruiește detalii mai clare în mai multe regiuni, în special în jurul gâtului, umerilor și îmbrăcămintei. Aceste zone sunt relativ slab divizate în șablonul FLAME în comparație cu zonele faciale cu saliență ridicată (de exemplu, regiunea perioculară).

‘Prin urmare, metodele anterioare alocă adesea prea puține gaussiene 3D în aceste regiuni pentru a captura cu fidelitate detalii fine. În contrast, strategia noastră de creștere adaptivă crește numărul de gaussiene și rafinează ierarhia doar acolo unde este necesar, făcând alocarea insensibilă la tesselația neuniformă a lui FLAME.’

Autorii mai observă că abordarea lor este la nivelul metodelor de ultimă oră, oferind un avatar funcțional cu o aloare de bandă trivială de 5%:

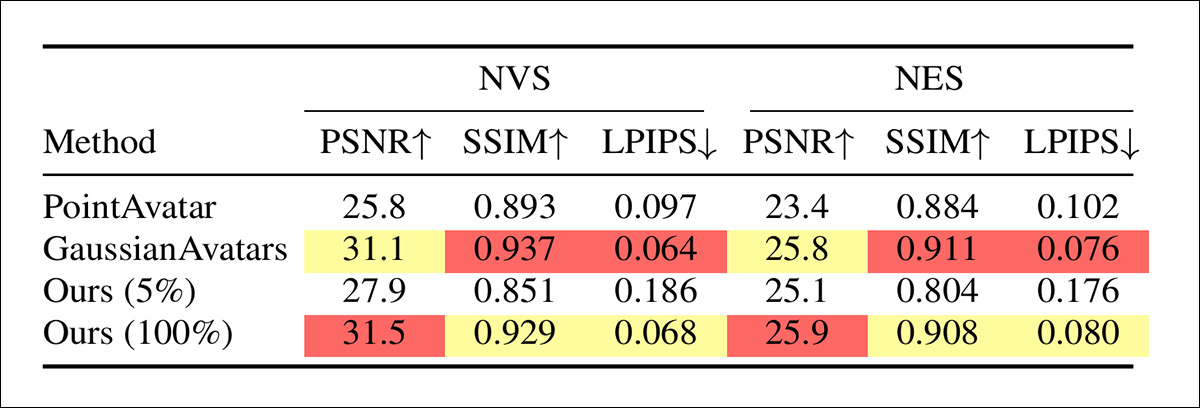

Comparație cantitativă pe sinteza de vedere nouă și sinteza de expresie nouă, utilizând PSNR, SSIM și LPIPS. La transmiterea completă, metoda propusă atinge cel mai ridicat PSNR pentru ambele sarcini și rămâne competitivă cu GaussianAvatars pe metrici perceptive, în timp ce setarea la 5% ilustrează compromisul de calitate sub constrângeri extreme de bandă.

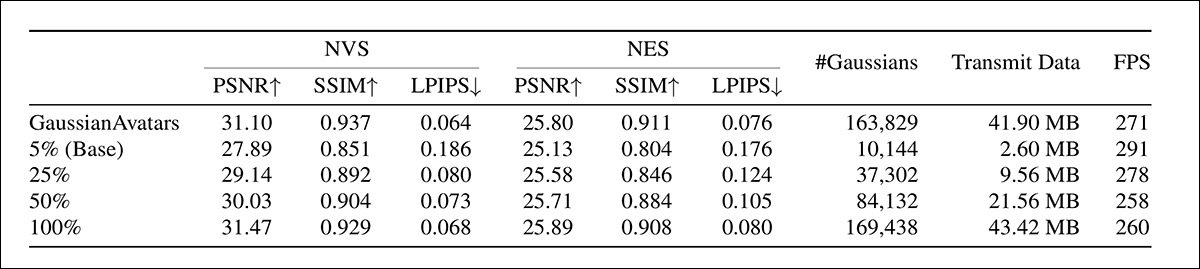

Următorul, cercetătorii au testat însăși renderizarea progresivă. Acest lucru a fost realizat pe un NVIDIA RTX 4090, cu 24Gb de VRAM, la o rezoluție de 550x802px. În acest scenariu, autorii subliniază că un buget de 25% ar utiliza toate gaussienele de la “nivelul 1”, precum și un subset de gaussiene de la “nivelul 2”, ceea ce oferă o imagine aproximativă a modului în care grupările gaussiene acumulează detalii în grupurile cu numere mai mari, și că grupurile cu numere mai mici construiesc esențialmente canvasul de bază:

Performanță sub diferite bugete de transmisie pentru sinteza de vedere nouă și sinteza de expresie nouă, arătând că calitatea se apropie sau depășește treptat GaussianAvatars pe măsură ce se transmit mai multe gaussiene și date, în timp ce se mențin vitezele de timp real pe un RTX 4090.

Autorii comentează:

‘Cu doar 2,60 MB transmise (5% buget), avatarul already atinge o calitate rezonabilă. Pe măsură ce se transmit gaussiene de nivel superior, structuri fine cum ar fi butoanele de la cămașă, dinții și părul se clarifică treptat, în timp ce se menține stabilitatea temporală.

‘La 100% transmisie, abordarea noastră atinge o calitate de renderizare comparabilă cu metodele de ultimă oră. Notabil, ratele de cadre nu scad semnificativ, probabil pentru că sarcina 3DGS nu a saturat încă GPU-ul.’

Cu toate acestea, autorii subliniază că în scenarii de realitate virtuală multi-utilizator, numărul de gaussiene 3D ar crește rapid până la punctul în care rasterizarea GPU ar deveni un blocaj. În aceste scenarii mai solicitante, abordarea propusă oferă un avantaj prin faptul că permite sistemului să facă un compromis între numărul de primitive și calitatea vizuală, reducând încărcarea fără a compromite renderul.

Deși articolul nu detaliază acest lucru, site-ul proiectului prezintă comparații de test suplimentare, care includ și proiectul MeGA hibrid de avatar Gaussian:

Faceți clic pentru a juca. Una dintre seria de videoclipuri suplimentare de pe site-ul proiectului, aceasta comparând noua abordare în ceea ce privește sinteza de vedere nouă.

Concluzie

Gaussian Splatting poate sau nu poate dura, sau poate fi amintit mai mult decât RealPlayer este acum, în ceea ce privește zorii streamingului interactiv: experiențe reprezentative 3D conștiente de AI, inclusiv video-chat, cumpărături virtuale, navigare pe trasee și diverse aplicații de divertisment. Este posibil ca tehnologii sau abordări alternative să câștige teren, sau ca GSplat să se dovedească a fi cea mai fiabilă reprezentare video AI.

Dacă nu altceva, acest articol nou și interesant anunță puțin din domeniul acesta nou, în timp ce ne amintește, poate nostalgic, de internetul sărac în bandă din trecut.

* Prin ‘3D’, nu mă refer la felul de experiență care necesită ochelari speciali, ci mai degrabă la experiențe în care conținutul multimedia are o anumită înțelegere a coordonatelor X/Y/Z.

Publicat pentru prima dată miercuri, 18 martie 2026