OpenAI și-a lansat cel mai recent și cel mai avansat model de limbă de până acum - GPT-4o, cunoscut și sub numele de „Omni" model. Acest sistem revoluționar de inteligență artificială reprezintă un salt uriaș înainte, cu capabilități care estompează linia dintre inteligența umană și cea artificială.

În centrul GPT-4o se află natura sa nativă multimodală, permițându-i să proceseze și să genereze fără probleme conținut prin text, audio, imagini și video. Această integrare a mai multor modalități într-un singur model este o premieră de acest gen, promițând să remodeleze modul în care interacționăm cu asistenții AI.

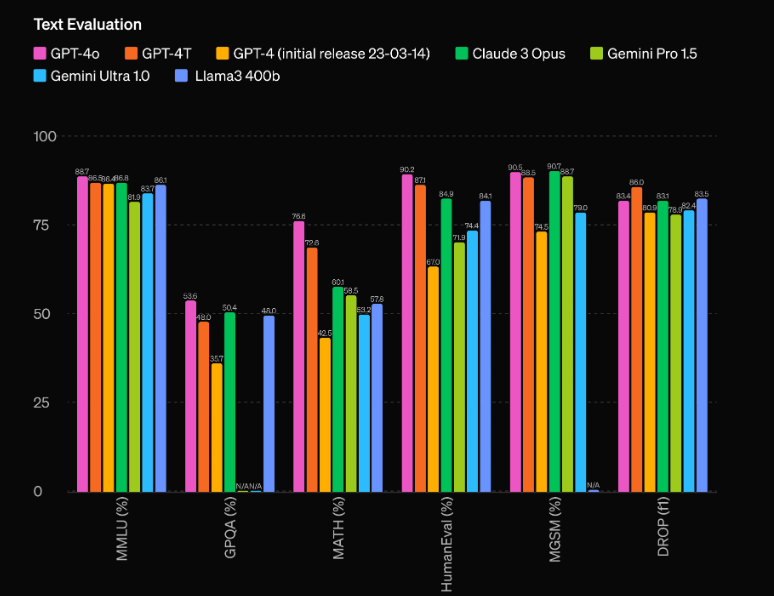

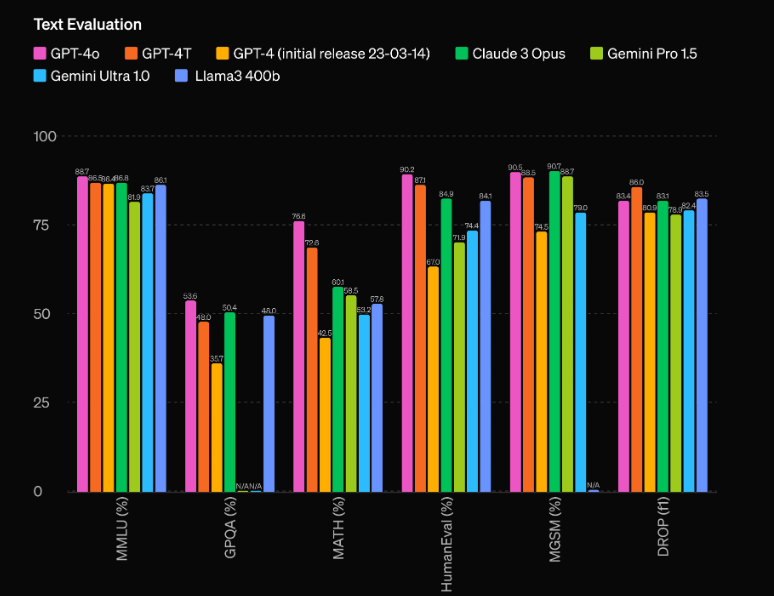

Dar GPT-4o este mult mai mult decât un sistem multimodal. Se mândrește cu o îmbunătățire uimitoare a performanței față de predecesorul său, GPT-4, și lasă în praf modelele concurente precum Gemini 1.5 Pro, Claude 3 și Llama 3-70B. Să ne aprofundăm în ceea ce face acest model AI cu adevărat revoluționar.

Performanță și eficiență de neegalat

Unul dintre cele mai impresionante aspecte ale GPT-4o este capabilitățile sale de performanță fără precedent. Conform evaluărilor OpenAI, modelul are un avans remarcabil de 60 de puncte Elo față de performerul anterior, GPT-4 Turbo. Acest avantaj semnificativ plasează GPT-4o într-o ligă proprie, depășind chiar și cele mai avansate modele AI disponibile în prezent.

Dar performanța brută nu este singurul domeniu în care GPT-4o strălucește. Modelul se mândrește, de asemenea, cu o eficiență impresionantă, funcționând la o viteză de două ori mai mare decât GPT-4 Turbo, în timp ce costă doar jumătate mai mult de rulare. Această combinație de performanță superioară și eficiență a costurilor face din GPT-4o o propunere extrem de atractivă pentru dezvoltatori și companii care doresc să integreze capabilități AI de ultimă oră în aplicațiile lor.

Capabilități multimodale: combinarea textului, audio și viziune

Poate cel mai revoluționar aspect al GPT-4o este natura sa multimodală nativă, care îi permite să proceseze și să genereze fără probleme conținut prin mai multe modalități, inclusiv text, audio și viziune. Această integrare a mai multor modalități într-un singur model este o premieră de acest gen și promite să revoluționeze modul în care interacționăm cu asistenții AI.

Cu GPT-4o, utilizatorii se pot angaja în conversații naturale, în timp real, folosind vorbirea, modelul recunoscând și răspunzând instantaneu la intrările audio. Dar capabilitățile nu se opresc aici – GPT-4o poate interpreta și genera și conținut vizual, deschizând o lume de posibilități pentru aplicații, de la analiza și generarea imaginilor până la înțelegerea și crearea videoclipurilor.

Una dintre cele mai impresionante demonstrații ale capacităților multimodale ale GPT-4o este capacitatea sa de a analiza o scenă sau o imagine în timp real, descriind și interpretând cu acuratețe elementele vizuale pe care le percepe. Această caracteristică are implicații profunde pentru aplicații precum tehnologiile de asistență pentru persoanele cu deficiențe de vedere, precum și în domenii precum securitatea, supravegherea și automatizarea.

Dar capacitățile multimodale ale GPT-4o se extind dincolo de simpla înțelegere și generare de conținut în diferite modalități. De asemenea, modelul poate combina perfect aceste modalități, creând experiențe cu adevărat captivante și captivante. De exemplu, în timpul demonstrației live OpenAI, GPT-4o a reușit să genereze o melodie bazată pe condițiile de intrare, combinând înțelegerea limbajului, teoria muzicii și generarea audio într-o ieșire coerentă și impresionantă.

Folosind GPT0 folosind Python

import openai

# Replace with your actual API key

OPENAI_API_KEY = "your_openai_api_key_here"

# Function to extract the response content

def get_response_content(response_dict, exclude_tokens=None):

if exclude_tokens is None:

exclude_tokens = []

if response_dict and response_dict.get("choices") and len(response_dict["choices"]) > 0:

content = response_dict["choices"][0]["message"]["content"].strip()

if content:

for token in exclude_tokens:

content = content.replace(token, '')

return content

raise ValueError(f"Unable to resolve response: {response_dict}")

# Asynchronous function to send a request to the OpenAI chat API

async def send_openai_chat_request(prompt, model_name, temperature=0.0):

openai.api_key = OPENAI_API_KEY

message = {"role": "user", "content": prompt}

response = await openai.ChatCompletion.acreate(

model=model_name,

messages=[message],

temperature=temperature,

)

return get_response_content(response)

# Example usage

async def main():

prompt = "Hello!"

model_name = "gpt-4o-2024-05-13"

response = await send_openai_chat_request(prompt, model_name)

print(response)

if __name__ == "__main__":

import asyncio

asyncio.run(main())

Eu am:

- Am importat modulul openai direct în loc să utilizați o clasă personalizată.

- A redenumit funcția openai_chat_resolve în get_response_content și a făcut câteva modificări minore implementării acesteia.

- S-a înlocuit clasa AsyncOpenAI cu funcția openai.ChatCompletion.acreate, care este metoda asincronă oficială furnizată de biblioteca OpenAI Python.

- S-a adăugat un exemplu de funcție principală care demonstrează cum se utilizează funcția send_openai_chat_request.

Rețineți că trebuie să înlocuiți „your_openai_api_key_here” cu cheia dvs. API OpenAI reală pentru ca codul să funcționeze corect.

Inteligența emoțională și interacțiunea naturală

Un alt aspect revoluționar al GPT-4o este capacitatea sa de a interpreta și genera răspunsuri emoționale, o capacitate care a eludat mult timp sistemele AI. În timpul demonstrației live, inginerii OpenAI au arătat cum GPT-4o ar putea detecta și răspunde cu acuratețe la starea emoțională a utilizatorului, ajustându-i tonul și răspunsurile în consecință.

Într-un exemplu deosebit de izbitor, un inginer s-a prefăcut că hiperventilă, iar GPT-4o a recunoscut imediat semnele de suferință în vocea și tiparele lor de respirație. Modelul l-a ghidat apoi calm pe inginer printr-o serie de exerciții de respirație, modulându-și tonul într-o manieră liniștitoare și liniștitoare până când suferința simulată a dispărut.

Această abilitate de a interpreta și de a răspunde la indiciile emoționale este un pas semnificativ către interacțiuni cu adevărat naturale și asemănătoare omului cu sistemele AI. Înțelegând contextul emoțional al unei conversații, GPT-4o își poate adapta răspunsurile într-un mod care să fie mai natural și mai empatic, conducând în cele din urmă la o experiență de utilizator mai captivantă și satisfăcătoare.

Accesibilitate

OpenAI a luat decizia de a oferi capabilitățile lui GPT-4o tuturor utilizatorilor, gratuit. Acest model de prețuri stabilește un nou standard, în care concurenții percep de obicei taxe de abonament substanțiale pentru accesul la modelele lor.

În timp ce OpenAI va oferi în continuare un nivel plătit „ChatGPT Plus” cu beneficii precum limite mai mari de utilizare și acces prioritar, capacitățile de bază ale GPT-4o vor fi disponibile pentru toată lumea fără costuri.

Aplicații din lumea reală și dezvoltări viitoare

Implicațiile capabilităților GPT-4o sunt vaste și de anvergură, cu aplicații potențiale care acoperă numeroase industrii și domenii. În domeniul serviciilor și asistenței pentru clienți, de exemplu, GPT-4o ar putea revoluționa modul în care companiile interacționează cu clienții lor, oferind asistență naturală, în timp real, prin mai multe modalități, inclusiv ajutoare vocale, text și vizuale.

În domeniul educației, GPT-4o ar putea fi folosit pentru a crea experiențe de învățare captivante și personalizate, modelul adaptându-și stilul de predare și livrarea de conținut pentru a se potrivi nevoilor și preferințelor fiecărui student în parte. Imaginați-vă un tutor virtual care poate nu numai să explice concepte complexe prin limbaj natural, ci și să genereze ajutoare vizuale și simulări interactive din mers.

Industria divertismentului este un alt domeniu în care capabilitățile multimodale ale GPT-4o ar putea străluci. De la generarea de narațiuni dinamice și captivante pentru jocuri video și filme până la compunerea de muzică și coloane sonore originale, posibilitățile sunt nesfârșite.

Privind în perspectivă, OpenAI are planuri ambițioase de a continua extinderea capabilităților modelelor sale, cu accent pe îmbunătățirea abilităților de raționament și pe integrarea în continuare a datelor personalizate. O perspectivă tentantă este integrarea GPT-4o cu modele lingvistice mari instruite pe domenii specifice, cum ar fi bazele de cunoștințe medicale sau juridice. Acest lucru ar putea deschide calea pentru asistenți AI înalt specializați, capabili să ofere consiliere și sprijin la nivel de expert în domeniile lor respective.

O altă cale interesantă pentru dezvoltarea viitoare este integrarea GPT-4o cu alte modele și sisteme AI, permițând colaborarea fără întreruperi și partajarea cunoștințelor în diferite domenii și modalități. Imaginați-vă un scenariu în care GPT-4o ar putea valorifica capacitățile modelelor de viziune computerizată de ultimă oră pentru a analiza și interpreta date vizuale complexe sau poate colabora cu sisteme robotizate pentru a oferi ghidare și sprijin în timp real în sarcinile fizice.

Considerații etice și IA responsabilă

Ca și în cazul oricărei tehnologii puternice, dezvoltarea și implementarea modelelor GPT-4o și similare de AI se ridică considerente etice importante. OpenAI și-a exprimat vocea angajamentului față de dezvoltarea responsabilă a inteligenței artificiale, implementând diverse măsuri de protecție și măsuri pentru a atenua riscurile potențiale și utilizarea abuzivă.

O preocupare cheie este potențialul modelelor AI precum GPT-4o de a perpetua sau amplifica existente distorsiunilor și stereotipuri dăunătoare prezente în datele de antrenament. Pentru a rezolva acest lucru, OpenAI a implementat tehnici riguroase de debiasare și filtre pentru a minimiza propagarea unor astfel de părtiniri în rezultatele modelului.

O altă problemă critică este potențiala utilizare greșită a capabilităților lui GPT-4o în scopuri rău intenționate, cum ar fi generarea deepfakes, răspândirea dezinformării sau implicarea în alte forme de manipulare digitală. OpenAI a implementat sisteme robuste de filtrare și moderare a conținutului pentru a detecta și a preveni utilizarea greșită a modelelor sale pentru activități dăunătoare sau ilegale.

În plus, compania a subliniat importanța transparenței și a răspunderii în dezvoltarea AI, publicând în mod regulat lucrări de cercetare și detalii tehnice despre modelele și metodologiile sale. Acest angajament față de deschiderea și controlul din partea comunității științifice mai largi este crucial pentru stimularea încrederii și asigurarea dezvoltării și implementării responsabile a tehnologiilor AI precum GPT-4o.

Concluzie

GPT-4o de la OpenAI reprezintă o adevărată schimbare de paradigmă în domeniul inteligenței artificiale, inaugurând o nouă eră a interacțiunii om-mașină multimodală, inteligentă emoțional și naturală. Cu performanța sa de neegalat, integrarea perfectă a textului, audio și viziunea și modelul de preț disruptiv, GPT-4o promite să democratizeze accesul la capabilități AI de ultimă oră și să transforme modul în care interacționăm cu tehnologia la un nivel fundamental.

Deși implicațiile și potențialele aplicații ale acestui model revoluționar sunt vaste și interesante, este esențial ca dezvoltarea și implementarea acestuia să fie ghidate de un angajament ferm față de principiile etice și practicile responsabile de IA.