Inteligență artificială

NeRF: Antrenarea dronelor în medii de radianță neurală

Cercetătorii de la Universitatea Stanford au conceput o nouă modalitate de antrenare a dronelor pentru a naviga în medii fotorealistice și foarte precise, prin valorificarea recentei avalanșe de interes în câmpurile de radianță neurală (NeRF).

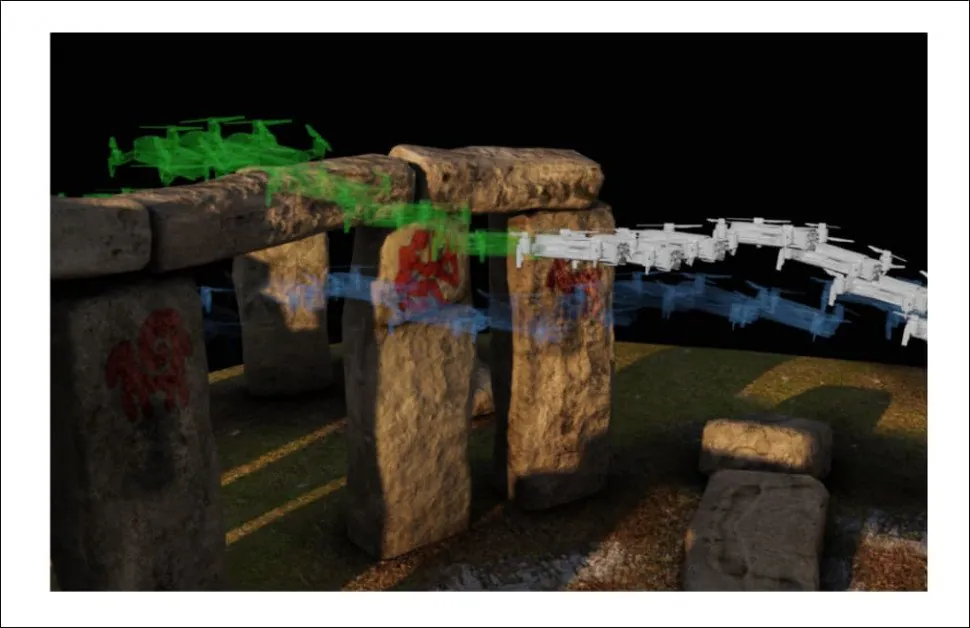

Dronelor pot fi antrenate în medii virtuale cartate direct din locații reale, fără a necesita reconstrucția specializată a scenei 3D. În imaginea de mai jos, de la proiect, a fost adăugată o perturbare a vântului ca un obstacol potențial pentru dronă, și putem vedea drona fiind deviată momentan de la traiectoria sa și compensând în ultimul moment pentru a evita un obstacol potențial. Source: https://mikh3x4.github.io/nerf-navigation/

Metoda oferă posibilitatea de antrenare interactivă a dronelor (sau a altor tipuri de obiecte) în scenarii virtuale care includ automat informații despre volum (pentru a calcula evitarea coliziunilor), textură extrasă direct din fotografii reale (pentru a ajuta la antrenarea rețelelor de recunoaștere a imaginilor dronei într-un mod mai realist) și iluminare din lumea reală (pentru a asigura o varietate de scenarii de iluminare care să fie antrenate în rețea, evitând supra-ajustarea sau supra-optimizarea față de imaginea originală a scenei).

Un obiect-canapea navighează printr-un mediu virtual complex care ar fi fost foarte dificil de cartat utilizând captura geometriei și retexurarea în fluxurile de lucru tradiționale AR/VR, dar care a fost recreat automat în NeRF dintr-un număr limitat de fotografii. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Implementările tipice NeRF nu dispun de mecanisme de traiectorie, deoarece majoritatea proiectelor NeRF din ultimele 18 luni s-au concentrat pe alte provocări, cum ar fi reluarea scenei, renderingul reflexiilor, compozitarea și dezlegarea elementelor capturate. Prin urmare, inovația principală a noului articol este de a implementa un mediu NeRF ca un spațiu navigabil, fără echipamentul extins și procedurile laborioase care ar fi necesare pentru a modela ca un mediu 3D pe baza capturii senzorilor și reconstrucției CGI.

NeRF ca VR/AR

Noul articol se intitulează Navigația robotică cu vedere într-o lume de radianță neurală și este o colaborare între trei departamente ale Universității Stanford: Aeronautică și Astronautică, Inginerie Mecanică și Informatică.

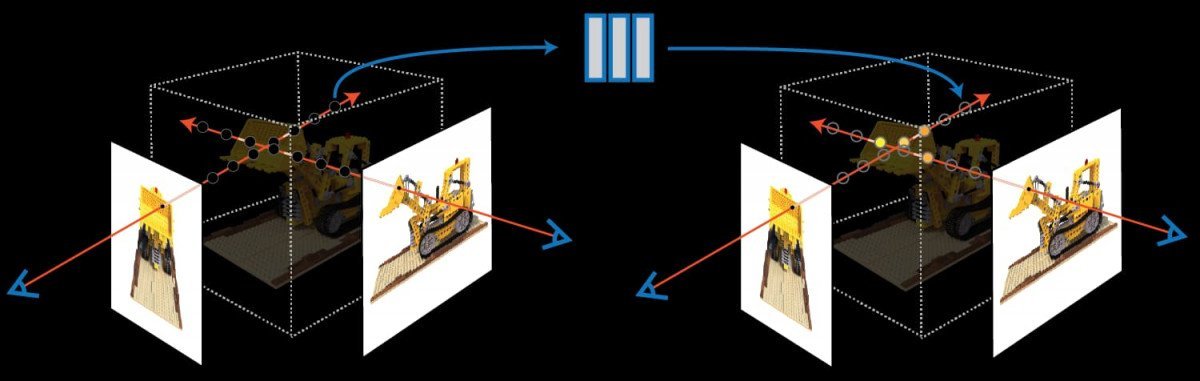

Lucrarea propune un cadru de navigație care oferă unui robot un mediu NeRF pre-antrenat, a cărui densitate de volum delimitează căi posibile pentru dispozitiv. De asemenea, include un filtru pentru a estima unde se află robotul în mediul virtual, pe baza recunoașterii imaginilor de la camera RGB a robotului. În acest fel, o dronă sau robot poate “halucina” mai precis ce poate să se aștepte să vadă într-un anumit mediu.

Optimizatorul de traiectorie al proiectului navighează printr-un model NeRF al Stonehenge, generat prin fotogrammetrie și interpretarea imaginilor (în acest caz, a modelelor de plasă) într-un mediu de radianță neurală. Planificatorul de traiectorie calculează mai multe căi posibile înainte de a stabili o traiectorie optimă peste arc.

Deoarece un mediu NeRF prezintă oculuși complet modelate, drona poate învăța să calculeze obstacolele mai ușor, deoarece rețeaua neurală din spatele NeRF poate cartografia relația dintre oculuși și modul în care sistemele de navigație bazate pe vedere ale dronei percep mediul. Pipelina automată de generare NeRF oferă o metodă relativ trivială de creare a spațiilor de antrenament hiper-reale cu doar câteva fotografii.

Cadrul de replanificare online dezvoltat pentru proiectul Stanford facilitează o conductă de navigație complet bazată pe vedere și rezilientă.

Initiativa Stanford este printre primele care consideră posibilitățile de explorare a unui spațiu NeRF în contextul unui mediu imersiv și navigabil de tip VR. Câmpurile de radianță neurală sunt o tehnologie emergentă și sunt supuse în prezent eforturilor academice multiple pentru a optimiza cerințele lor ridicate de calcul, precum și pentru a dezlega elementele capturate.

NeRF nu este (cu adevărat) CGI

Deoarece un mediu NeRF este un spațiu 3D navigabil, a devenit o tehnologie înțeleasă greșit de la apariția sa în 2020, adesea percepută ca o metodă de automatizare a creării de mesh-uri și texturi, în loc de a înlocui medii 3D familiare spectatorilor din departamentele de efecte vizuale ale Hollywood-ului și scenele fantastice ale mediilor virtuale și augmentate.

NeRF extrage informații de geometrie și textură dintr-un număr limitat de puncte de vedere ale imaginilor, calculând diferența dintre imagini ca informație volumetrică. Source: https://www.matthewtancik.com/nerf

De fapt, mediul NeRF este mai degrabă un “spațiu de render în timp real”, unde o amalgamare a informațiilor de pixel și iluminare este păstrată și navigată într-o rețea neurală activă și în funcțiune.

Cheia potențialului NeRF este că necesită doar un număr limitat de imagini pentru a recrea medii, și că mediile generate conțin toate informațiile necesare pentru o reconstrucție de înaltă fidelitate, fără a necesita serviciile modelatorilor, artiștilor texturi, specialiștilor în iluminare și a altor contribuitori la “CGI-ul tradițional”.

Segmentarea semantică

Chiar dacă NeRF constituie efectiv “Imaginile generate de calculator” (CGI), oferă o metodologie complet diferită și o pipelină foarte automatizată. În plus, NeRF poate izola și “încapsula” părți mobile ale unei scene, astfel încât acestea să poată fi adăugate, eliminate, accelerate și să funcționeze ca faceti discrete într-un mediu virtual – o capacitate care este mult dincolo de starea actuală a tehnologiei într-o interpretare “Hollywood” a ceea ce este CGI-ul.

O colaborare de la Universitatea Tehnică din Shanghai, lansată în vara anului 2021, oferă o metodă de a individua elemente mobile NeRF în faceti “lipibile” pentru o scenă. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativ, arhitectura NeRF este un fel de “cutie neagră”; în prezent, nu este posibil să extrageți un obiect dintr-un mediu NeRF și să îl manipulați direct cu unelte tradiționale bazate pe mesh-uri și imagini, deși există eforturi de cercetare care încep să facă progrese în deconstruirea matricei din spatele mediilor de render în timp real NeRF.

https://www.youtube.com/watch?v=5JjWpv9BaaE