Inteligență artificială

Evoluția multimodală a IA: ChatGPT capătă vedere cu GPT-4V(iziune)

În efortul continuu de a face IA mai asemănătoare cu oamenii, modelele GPT ale OpenAI au împins mereu limitele. GPT-4 poate acum să accepte prompturi atât de text, cât și de imagini.

Multimodalitatea în IA generativă denotă capacitatea unui model de a produce ieșiri variate, cum ar fi text, imagini sau audio, pe baza intrării. Aceste modele, antrenate pe date specifice, învață modele subiacente pentru a genera date noi similare, îmbogățind aplicațiile IA.

Progrese recente în IA multimodală

Un salt notabil recent în acest domeniu este integrarea DALL-E 3 în ChatGPT, o actualizare semnificativă a tehnologiei text-la-imagine a OpenAI. Această combinație permite o interacțiune mai fluidă, unde ChatGPT ajută la crearea de prompturi precise pentru DALL-E 3, transformând ideile utilizatorilor în artă generată de IA vividă. Așadar, în timp ce utilizatorii pot interacționaect cu DALL-E 3, prezența ChatGPT în proces face crearea de artă IA mult mai ușoară pentru utilizatori.

Aflați mai multe despre DALL-E 3 și integrarea sa cu ChatGPT aici. Această colaborare nu numai că evidențiază progresul în IA multimodală, dar face și crearea de artă IA o briză pentru utilizatori.

Google’s health, pe de altă parte, a introdus Med-PaLM M în iunie acest an. Este un model generativ multimodal priceput la codificarea și interpretarea diverselor date biomedicale. Acest lucru a fost realizat prin fine-tuning PaLM-E, un model de limbaj, pentru a se adapta la domenii medicale utilizând o benchmark deschis, MultiMedBench. Această benchmark constă din peste 1 milion de exemple din 7 tipuri de date biomedicale și 14 sarcini, cum ar fi întrebări și generarea de rapoarte de radiologie.

Diverse industrii adoptă instrumente inovatoare de IA multimodală pentru a stimula extinderea afacerilor, a eficientiza operațiunile și a îmbunătăți implicarea clienților. Progresul în capacitățile de voce, video și text IA impulsionează creșterea IA multimodale.

Întreprinderile caută aplicații de IA multimodală capabile să transforme modelele de afaceri și procesele, deschizând căi de creștere în întregul ecosistem de IA generativă, de la instrumente de date la aplicații emergente de IA.

După lansarea GPT-4 în martie, unii utilizatori au observat o scădere a calității răspunsurilor sale în timp, o preocupare reflectată de dezvoltatori notabili și pe forumurile OpenAI. Inițial, această problemă a fost respinsă de OpenAI, dar un studiu ulterioară a confirmat problema. Acesta a arătat o scădere a acurateței GPT-4 de la 97,6% la 2,4% între martie și iunie, indicând o scădere a calității răspunsurilor odată cu actualizările ulterioare ale modelului.

Agora este din nou în jurul Open AI’s ChatGPT. Acum vine cu o funcție de vedere GPT-4V, care permite utilizatorilor să analizeze imagini date de GPT-4. Aceasta este cea mai recentă funcție care a fost deschisă utilizatorilor.

Adăugarea analizei de imagini la modelele de limbaj mari (LLM) precum GPT-4 este considerată de unii ca un pas important în cercetarea și dezvoltarea IA. Acest tip de LLM multimodal deschide noi posibilități, extinzând modelele de limbaj dincolo de text pentru a oferi noi interfețe și a rezolva noi tipuri de sarcini, creând experiențe proaspete pentru utilizatori.

Antrenamentul GPT-4V a fost finalizat în 2022, cu acces timpuriu lansat în martie 2023. Funcția vizuală din GPT-4V este alimentată de tehnologia GPT-4. Procesul de antrenament a rămas același. Inițial, modelul a fost antrenat pentru a prezice următorul cuvânt într-un text utilizând un set masiv de date de text și imagini din diverse surse, inclusiv internetul.

Ulterior, a fost ajustat cu mai multe date, utilizând o metodă numită învățare de întărire din feedback uman (RLHF), pentru a genera ieșiri care sunt preferate de oameni.

Mecanica viziunii GPT-4

Capacitățile remarcabile de viziune și limbaj ale GPT-4, deși impresionante, au metode subiacente care rămân la suprafață.

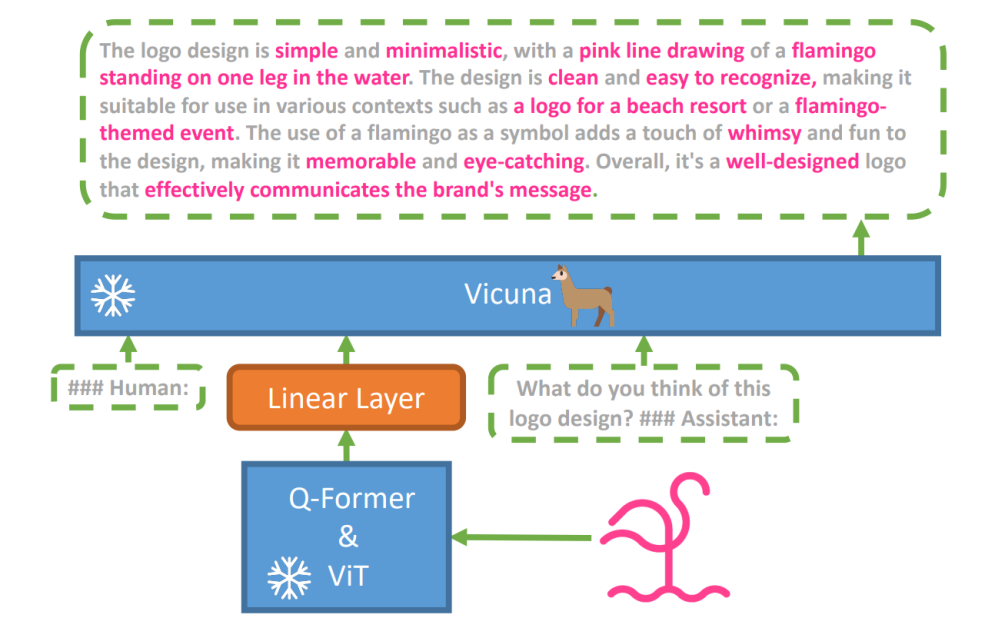

Pentru a explora această ipoteză, a fost introdus un nou model de viziune-limbaj, MiniGPT-4, care utilizează un LLM avansat numit Vicuna. Acest model utilizează un codificator de viziune cu componente preantrenate pentru percepția vizuală, aliniind caracteristici vizuale codificate cu modelul de limbaj Vicuna prin intermediul unei singure straturi de proiecție. Arhitectura MiniGPT-4 este simplă, dar eficientă, cu accent pe alinierea caracteristicilor vizuale și de limbaj pentru a îmbunătăți capacitățile de conversație vizuală.

Arhitectura MiniGPT-4 include un codificator de viziune cu ViT și Q-Former preantrenate, o singură strat de proiecție liniară și un model de limbaj avansat Vicuna.

Tendința modelelor de limbaj autoregresive în sarcinile de viziune-limbaj a crescut, capitalizând pe transferul trans-modal pentru a partaja cunoștințe între domeniul limbajului și domeniul multimodal.

MiniGPT-4 podidește domeniile vizuale și de limbaj, aliniind informații vizuale de la un codificator de viziune preantrenat cu un LLM avansat. Modelul utilizează Vicuna ca decodificator de limbaj și urmează o abordare de antrenament în două etape. Inițial, este antrenat pe un set mare de date de perechi imagine-text pentru a dobândi cunoștințe de viziune-limbaj, urmat de ajustarea pe un set mai mic, de înaltă calitate, pentru a îmbunătăți fiabilitatea și utilitatea generării.

Pentru a îmbunătăți naturalitatea și utilitatea limbajului generat în MiniGPT-4, cercetătorii au dezvoltat un proces de aliniere în două etape, abordând lipsa seturilor de date adecvate de aliniere viziune-limbaj. Ei au creat un set de date specializat pentru acest scop.

Inițial, modelul a generat descrieri detaliate ale imaginilor de intrare, îmbunătățind detaliile prin utilizarea unui prompt conversațional aliniat cu formatul modelului de limbaj Vicuna.

Prompt inițial de descriere a imaginii:

###Human: <Img><ImageFeature></Img>Descrieți această imagine în detaliu. Dați cât mai multe detalii posibil. Spuneți tot ce vedeți. ###Assistant:

Pentru post-procesarea datelor, orice incoerențe sau erori în descrierile generate au fost corectate utilizând ChatGPT, urmată de verificare manuală pentru a asigura calitatea ridicată.

Prompt de ajustare în a doua etapă:

###Human: <Img><ImageFeature></Img><Instruction>###Assistant:

Această explorare deschide o fereastră pentru a înțelege mecanica IA generativă multimodală, cum ar fi GPT-4, aruncând lumină asupra modului în care modalitățile de viziune și limbaj pot fi integrate eficient pentru a genera ieșiri coerente și contextual bogate.

Explorarea viziunii GPT-4

Determinarea originii imaginilor cu ChatGPT

GPT-4 Vision îmbunătățește capacitatea ChatGPT de a analiza imagini și de a identifica originile geografice ale acestora. Această funcție trece interacțiunile utilizatorilor de la text la o combinație de text și imagini, devenind un instrument util pentru cei curioși despre diferite locuri prin date de imagine.

Concepte matematice complexe

GPT-4 Vision excelează în a explora idei matematice complexe prin analiza expresiilor grafice sau manuscrise. Această funcție acționează ca un instrument util pentru cei care doresc să rezolve probleme matematice complexe, marcând GPT-4 Vision ca un ajutor notabil în domeniile educațional și academic.

Conversia intrărilor manuscrise în coduri LaTeX

Una dintre capacitățile remarcabile ale GPT-4V este capacitatea sa de a traduce intrări manuscrise în coduri LaTeX. Această funcție este un binevenit pentru cercetători, academicieni și studenți care au nevoie adesea să convertească expresii matematice manuscrise sau alte informații tehnice într-un format digital. Transformarea de la manuscris la LaTeX extinde orizontul digitizării documentelor și simplifică procesul de scriere tehnică.

Extragerea detaliilor tabelelor

GPT-4V demonstrează abilitatea de a extrage detalii din tabele și de a răspunde la întrebări conexe, o valoare esențială în analiza datelor. Utilizatorii pot utiliza GPT-4V pentru a căuta tabele, a colecta informații cheie și a rezolva întrebări bazate pe date, făcându-l un instrument robust pentru analiști de date și alți profesioniști.

Înțelegerea indicării vizuale

Capacitatea unică a GPT-4V de a înțelege indicațiile vizuale adaugă o nouă dimensiune interacțiunii utilizatorului. Prin înțelegerea semnelor vizuale, GPT-4V poate răspunde la întrebări cu o înțelegere contextuală mai ridicată.

Crearea de site-uri mock-up simple utilizând o schiță

Motivat de acest tweet, am încercat să creez un mock-up pentru site-ul unite.ai.

Deși rezultatul nu a fost exact ca viziunea mea inițială, iată ce am reușit să obțin.

Limitări și defecte ale GPT-4V(iziune)

Pentru a analiza GPT-4V, echipa Open AI a efectuat evaluări calitative și cantitative. Evaluările calitative au inclus teste interne și revizuiri ale experților externi, în timp ce evaluările cantitative au măsurat refuzurile modelului și acuratețea în diverse scenarii, cum ar fi identificarea conținutului dăunător, recunoașterea demografică, preocupările legate de confidențialitate, geolocalizarea, securitatea cibernetică și jailbreak-urile multimodale.

Încă, modelul nu este perfect.

Documentul documentul subliniază limitările GPT-4V, cum ar fi inferențele incorecte și lipsa textului sau a caracterelor în imagini. Poate halucina sau inventa fapte. În special, nu este potrivit pentru identificarea substanțelor periculoase în imagini, adesea identificându-le greșit.

În imagistica medicală, GPT-4V poate oferi răspunsuri inconsistente și lipsește de conștientizarea practicilor standard, ceea ce poate duce la posibile diagnostice greșite.

Performanță neconvingătoare pentru scopuri medicale (Sursă)

De asemenea, nu reușește să înțeleagă nuanțele anumitor simboluri de ură și poate genera conținut inadecvat pe baza intrărilor vizuale. OpenAI avertizează împotriva utilizării GPT-4V pentru interpretări critice, în special în contexte medicale sau sensibile.

Rezumat

Creat utilizând Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Sosirea GPT-4 Vision (GPT-4V) aduce o mulțime de posibilități interesante și noi provocări. Înainte de a fi lansat, a fost depus mult efort pentru a se asigura că riscurile, în special cele legate de imagini cu persoane, sunt bine examinate și reduse. Este impresionant să vezi cum GPT-4V a făcut progrese, arătând mult potențial în domenii dificile, cum ar fi medicina și știința.

Acum, există întrebări importante pe masă. De exemplu, ar trebui aceste modele să poată identifica persoane celebre din fotografii? Ar trebui să ghicească genul, rasa sau sentimentele unei persoane dintr-o imagine? Și ar trebui să existe ajustări speciale pentru a ajuta persoanele cu deficiențe de vedere? Aceste întrebări deschid o cutie a Pandorei despre confidențialitate, echitate și modul în care IA ar trebui să se integreze în viața noastră, ceea ce este ceva la care toată lumea ar trebui să aibă un cuvânt de spus.