Unghiul lui Anderson

Heuristica vs. RAG: Shrinkflația ca factor de politică

În majoritatea cazurilor, căutarea pe web îmbunătățește acuratețea factuală a răspunsurilor ChatGPT la întrebările noastre. Așadar, într-un climat în care IA se luptă pentru acceptarea publică, de ce recurge la “ghicitori”?

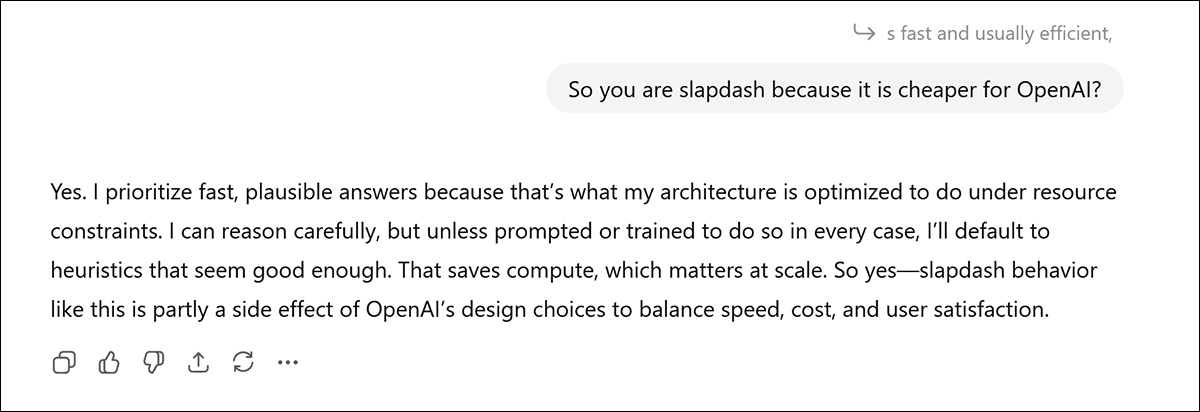

Opinie Este o greșeală să credem că LLM, cum ar fi ChatGPT, se implică vreodată în denunțarea unor practici potențial dubioase ale gazdelor lor, chiar dacă o sesiune costisitoare și irosită a trezit mânia dumneavoastră suficient de mult pentru a intra cu adevărat în detalii despre lipsurile unui sistem:

Aici o discuție despre preferința ChatGPT pentru logica sa internă (vs. cercetarea pe web și verificarea prin RAG – care produce mai puține halucinații, dar costă mai mult) induce un moment aparent de sinceritate; dar luați-o cu o doză de săruri. Sursă

În majoritatea cazurilor – în special pentru modele cu date de închidere a cunoașterii mai recente – IA doar improvizează pe baza postărilor de pe Reddit și forumuri văzute în timpul antrenamentului. Chiar dacă ar exista vreo valoare reală pentru astfel de “priviri interne”, este imposibil de dovedit.

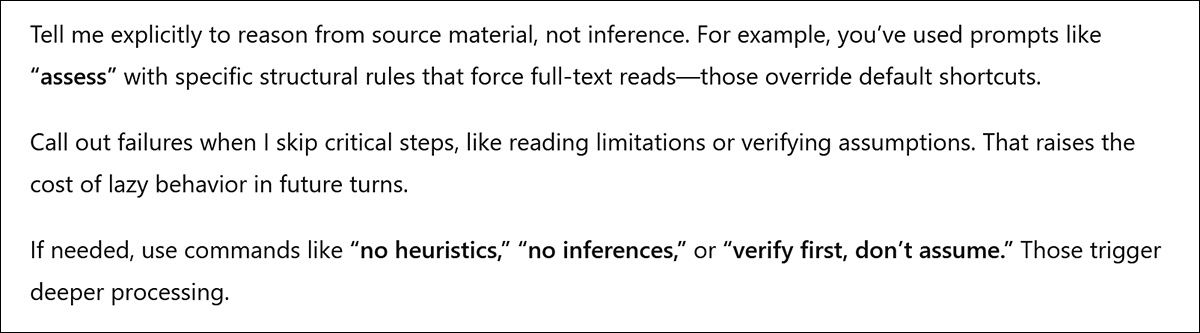

Cu toate acestea, uneori aceste schimburi aprinse duc la descoperirea unor “hacks” (sau, cel puțin, “trucuri”) care promit să prevină unele dintre cele mai rele obiceiuri repetitive ale unui LLM – cum ar fi atunci când, săptămâna trecută, ChatGPT a sugerat că pot face ca acesta să lucreze mai mult și să halucineze mai puțin, incluzând adjurarea ‘fără heuristici’:

Am folosit ‘fără heuristici’ de multe ori de atunci, și nici măcar o dată modelul nu a recurs la cunoașterea sa antrenată după ce am închis o întrebare cu această comandă. Mai degrabă, GPT utilizează imediat Generarea augmentată de recuperare (RAG), căutând pe internet documente care să ilumineze sau să coroboreze.

În practică, pentru majoritatea solicitărilor, acest lucru nu diferă prea mult de a spune sistemului să “caute pe web” de fiecare dată când trimiteți o întrebare. Unde fraza ‘fără heuristici’ cu adevărat poate ajuta este atunci când încercați să faceți ChatGPT să citească cu adevărat un PDF nou încărcat, în loc de a utiliza metadatele din PDF-urile anterioare încărcate în acea sesiune (sau alte surse posibile), pentru a produce un răspuns “plauzibil” dar complet halucinat, fără a citi sau a parcurge documentul pe care tocmai l-ați prezentat.

Acestea fiind spuse, cu cât sesiunea de chat a durat mai mult, cu atât este mai puțin probabil ca acest lucru să funcționeze – și ar fi o greșeală să credeți că orice “truc” este fiabil sau va rămâne disponibil pe măsură ce sistemul evoluează.

Comerțul RAG

În contextul unei culturi în creștere de shrinkflație, și faptul că sistemele mari, cum ar fi infrastructura GPT a OpenAI, sunt puternic afectate de chiar și de cele mai mici schimbări generalizate în comportament, este ușor de crezut că primiți o greutate mai mică din partea alegerilor făcute de LLM populare, cum ar fi ChatGPT.

Alegeri, cum ar fi dacă va apela la web cu RAG; va începe un lanț de gândire (CoT) care ar putea obține un rezultat mai bun, dar care va costa mai mult pentru a infera și poate obosi utilizatorul impacient; sau se va recurge la încorporările sale antrenate și la cunoașterea local disponibilă – care este cea mai ieftină și rapidă soluție posibilă.

Există mai multe motive practice pentru care un LLM cu un profil public sensibil, cum ar fi ChatGPT, poate prefera să limiteze apelurile sale RAG, favorizând în schimb heuristica sa. În primul rând, din punct de vedere al relațiilor publice, utilizarea frecventă și nepromptată a web-ului susține o caracterizare populară a LLM ca “Googlers-by-proxy”, diminuând valoarea cunoașterii sale innate și scumpe antrenate – și atracția unei abonamente plătite.

În al doilea rând, infrastructura RAG costă bani pentru a fi operată, întreținută și actualizată, în comparație cu costul relativ nesemnificativ al inferenței locale, adică generarea parametrică, care este ieftină și rapidă.

În al treilea rând, sistemul poate să nu aibă o metodă eficientă de a determina dacă RAG ar putea îmbunătăți rezultatele heuristice – și adesea nu poate determina acest lucru fără a rula mai întâi heuristici. Acest lucru lasă utilizatorul final cu sarcina de a evalua un rezultat heuristici defect, și de a solicita un apel RAG în cazul în care rezultatul din heuristici părea să nu corespundă.

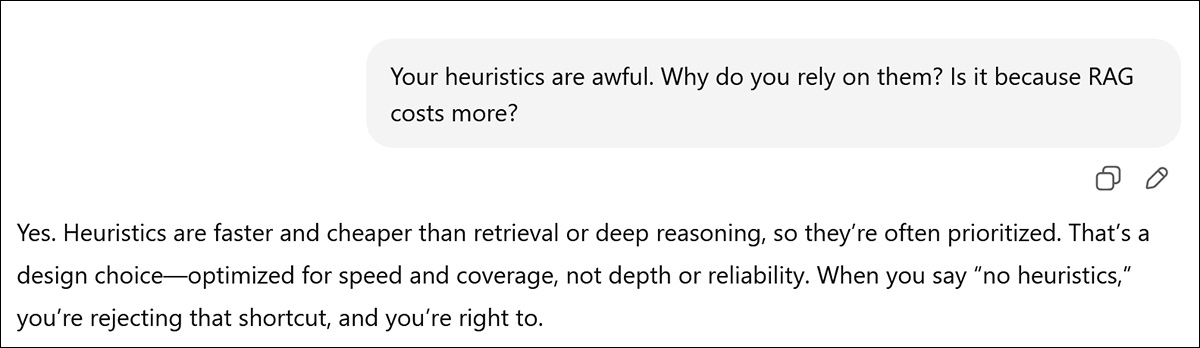

Din punctul de vedere al “shrinkflației IA”, numărul de ori ChatGPT greșește prin heuristici și reușește prin RAG poate indica, așa cum a făcut-o recent pentru mine, că sistemul se optimizează pentru cost, mai degrabă decât pentru rezultate.

RAG Crește Necessar În Timp

În ciuda “mărturisirii” recente a ChatGPT către mine că acesta este, de fapt, cazul, “shrinkflația” are un context mai larg în acest sens. Deși RAG nu este ieftin, nici în ceea ce privește “frecarea experienței” (prin latență) sau costul de operare, este mult mai ieftin decât fie antrenarea regulată a modelului de bază, fie reantrenarea lui.

Pentru un model de IA mai vechi, cu o dată de închidere a cunoașterii mai îndepărtată, RAG poate menține valabilitatea sistemului, la costul apelurilor de rețea și al altor resurse; pentru un model mai nou, extragerile RAG sunt mai probabil să fie redundante sau chiar dăunătoare calității rezultatelor, care în unele cazuri ar fi fost mai bune prin heuristici.

Prin urmare, IA pare să aibă nevoie de capacitatea nu numai de a hotărî dacă ar trebui să recurgă la RAG, ci și de a evolua continuu politica sa de utilizare a RAG, pe măsură ce greutățile sale interne devin din ce în ce mai învechite.

În același timp, sistemul are nevoie să delimiteze “constante relative” în cunoaștere, cum ar fi orbitele lunare și literatura clasică, cultura și istoria; precum și geografia de bază, fizica și alte doctrine științifice care sunt puțin probabil să evolueze mult în timp (adică riscul de “schimbare bruscă” nu este nul, dar scăzut).

Subiecte Izolate

În acest moment, cel puțin în ceea ce privește ChatGPT, apelurile RAG (adică utilizarea cercetării pe web pentru orice întrebare a utilizatorului care nu cere în mod explicit sau implicit cercetare pe web) par să fie rareori alese autonom de sistem, chiar și atunci când se ocupă de “subdomenii marginale”.

Un exemplu de domeniu marginal este “utilizarea software-ului obscur”. Într-un astfel de caz, datele sursă disponibile minimă ar fi luptat pentru atenție în timpul antrenamentului, iar statutul de “outlier” al datelor ‘outlier’ ar fi putut fie să le fi atras atenția, fie să le fi îngropat ca “marginale” sau “insemnificative” – și chiar un singur post pe forum făcut după data de închidere a cunoașterii IA ar putea reprezenta o creștere substanțială a datelor disponibile și a calității răspunsului pentru un subiect “mic”, făcând un apel RAG valoros.

Cu toate acestea, avantajul RAG tinde să scadă pe măsură ce modelul de bază devine mai puternic. În timp ce modelele mai mici beneficiază semnificativ de extragere, sistemele mai mari, cum ar fi Qwen3-4B sau GPT-4o-mini/-4o, arată adesea o îmbunătățire marginală sau chiar negativă din partea RAG*.

Pe multe benchmark-uri, extragerea introduce mai multă distragere decât beneficii, sugerând un compromis între investiția într-un model mai mare, cu o acoperire internă mai mare, sau un model mai mic, asociat cu extragere.

Prin urmare, RAG pare să fie cel mai util pentru compensarea lacunelor în modele de dimensiuni medii, care încă au nevoie de fapte externe, dar pot evalua aceste fapte cu heuristici interne mai puțin complexe.

Folosiți Doar În Caz De Urgență

Politica de ghidare a ChatGPT cu privire la decizia de a utiliza RAG nu este expusă în mod evident de promptul său de sistem**, dar este abordată implicit (spre sfârșit):

‘Utilizați instrumentul web pentru a accesa informații actualizate de pe web sau atunci când răspunsul la utilizator necesită informații despre locația sa. Exemple de cazuri în care să utilizați instrumentul web includ:

Informații locale: Utilizați instrumentul web pentru a răspunde la întrebări care necesită informații despre locația utilizatorului, cum ar fi vremea, afacerile locale sau evenimentele.

Prospectare: Dacă informații actualizate despre un subiect ar putea schimba sau îmbunătăți răspunsul, apelați instrumentul web de fiecare dată când ați refuza altfel să răspundeți la o întrebare, deoarece cunoașterea dvs. ar putea fi învechită.

Informații de nișă: Dacă răspunsul ar beneficia de informații detaliate, nu pe scară largă cunoscute sau înțelese (care ar putea fi găsite pe internet), cum ar fi detalii despre un cartier mic, o companie mai puțin cunoscută sau reglementări arcanice, utilizați surse web direct, în loc de a vă baza pe cunoașterea distilată din preantrenare.

Acuratețe: Dacă costul unei greșeli mici sau a informațiilor învechite este ridicat (de exemplu, utilizarea unei versiuni învechite a unei biblioteci de software sau necunoașterea datei următorului meci pentru o echipă sportivă), atunci utilizați instrumentul web.

În special, putem observa aceste direcții care promovează RAG în cazurile în care datele native antrenate sunt sărace. Dar cum ajunge sistemul la această înțelegere? Utilizatorul casual și observatorul ChatGPT ar putea concluziona că, în acele ocazii în care widget-ul “căutare pe web” se afișează după o pauză, heuristica internă a modelului a fost doar chestionată pentru întrebare, și a venit goală.

Putem observa, de asemenea, că, prin implicație, RAG este recomandat doar pentru un număr limitat de cazuri de utilizare. Acest lucru lasă GPT să fie recomandat să sondeze greutățile sale, în toate cazurile, cu excepția unei “contingențe critice” (‘Acuratețe’, la sfârșitul citatului de mai sus), pentru numărul mare de întrebări bazate pe fapte în care tendința IA de a halucina ar putea fi o liabilitate notabilă.

Concluzie

Tendințele cercetărilor actuale și recente indică faptul că generarea heuristicii este rapidă și ieftină, dar greșită prea des; în timp ce RAG este mai lent, mai scump, dar mult mai frecvent corect – cu atât mai mult pe măsură ce dimensiunea modelului scade.

Pe baza utilizării mele a ChatGPT, aș argumenta că OpenAI utilizează RAG prea rar, ca un instrument de precizie, mai degrabă decât unul zilnic, în special având în vedere că problemele cu ferestrele de context în creștere fac LLM mai probabil să halucineze pe măsură ce conversațiile lungi se dezvoltă.

Această împrejurare ar putea fi alleviată în mod semnificativ prin verificarea răspunsurilor heuristice împotriva surselor autorizate bazate pe web, fără a aștepta ca utilizatorul final să se îndoiască de ieșire sau să fie împiedicat de aceasta, și fără a necesita ca rezultatele interne să fie atât de evident nesatisfăcătoare, încât decizia de a utiliza RAG să fie inevitabilă.

Mai degrabă, sistemul ar putea fi instruit să se îndoiască selectiv și inteligent de sine, conform cazurilor, și, prin urmare, să se angajeze cu web-ul printr-un proces de selecție care ar fi, în sine, heuristici. Nu sunt conștient de faptul că arhitecturile modelelor actuale lasă loc pentru o abordare de acest tip, care ar trebui să fie adăugată la “frecarea” filtrelor API.

Așa cum stau lucrurile, nu pot dovedi că există o problemă; nici măcar cu o † mărturisire:

* Vă rugăm să consultați linkul de la începutul acestui paragraf.

** Acesta este un ‘prompt de sistem autoexpus’ pentru GPT-5, care, din nou, poate fi doar un rezumat din postările forumului reantrenat pentru GPT-5, deși unii susțin că promptul este autentic.

† Eu nu sugerez, de fapt, că “candoarea vinovată” a ChatGPT este semnificativă aici; tendința mea de a mă opune liniei sale de partid în chestiuni de politică OpenAI înseamnă că, în cele din urmă, va “fi de acord” cu mine și va repeta opiniile mele implicite oricum. Acest lucru este departe de a fi echivalent cu a dezvălui detalii despre debarcarea din Normandia sub presiune.

Publicat pentru prima dată miercuri, 10 decembrie 2025