Inteligență artificială

Google’s LipSync3D Oferește O Sincronizare Îmbunătățită a Mișcărilor Buzelor ‘Deepfaked’

O colaborare între cercetătorii Google AI și Institutul Indian de Tehnologie Kharagpur oferă un nou cadru pentru a sintetiza capete care vorbesc din conținut audio. Proiectul urmărește să producă modalități optimizate și rezonabil-resursate pentru a crea conținut video de “capete care vorbesc” din audio, în scopul de a sincroniza mișcările buzelor cu audio-ul dublat sau tradus prin mașină, și pentru a fi utilizat în avatare, în aplicații interactive și în alte medii în timp real.

Source: https://www.youtube.com/watch?v=L1StbX9OznY

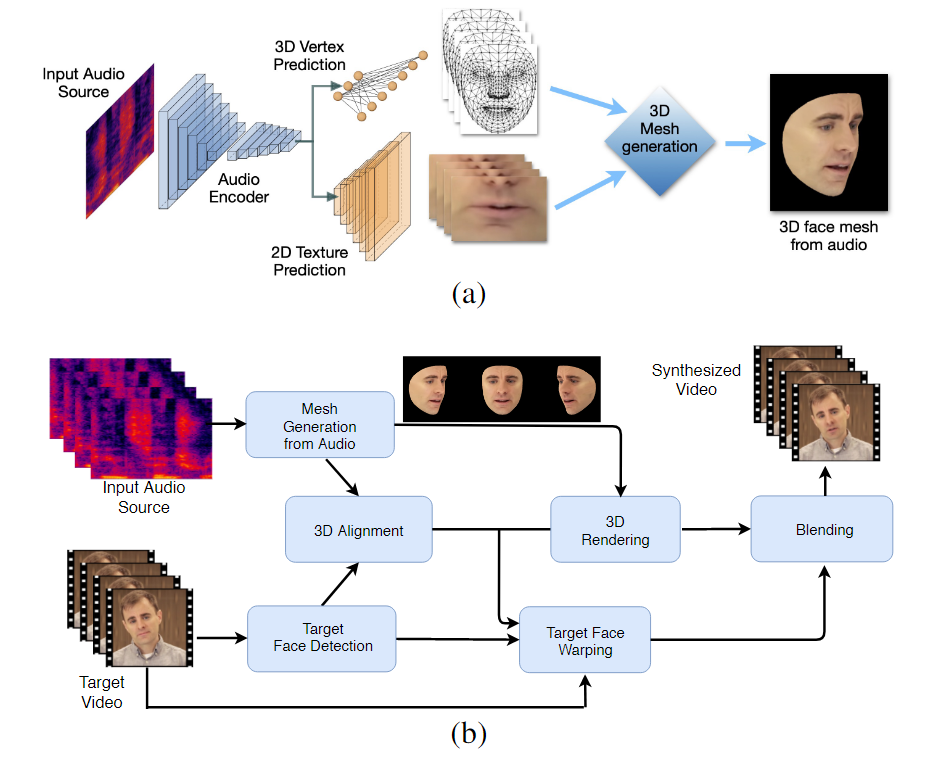

Modelele de învățare automată antrenate în acest proces – numite LipSync3D – necesită doar un singur video al identității feței țintă ca date de intrare. Pipeline-ul de pregătire a datelor separă extragerea geometriei faciale de evaluarea iluminării și a altor aspecte ale unui video de intrare, permițând un antrenament mai economic și mai focalizat.

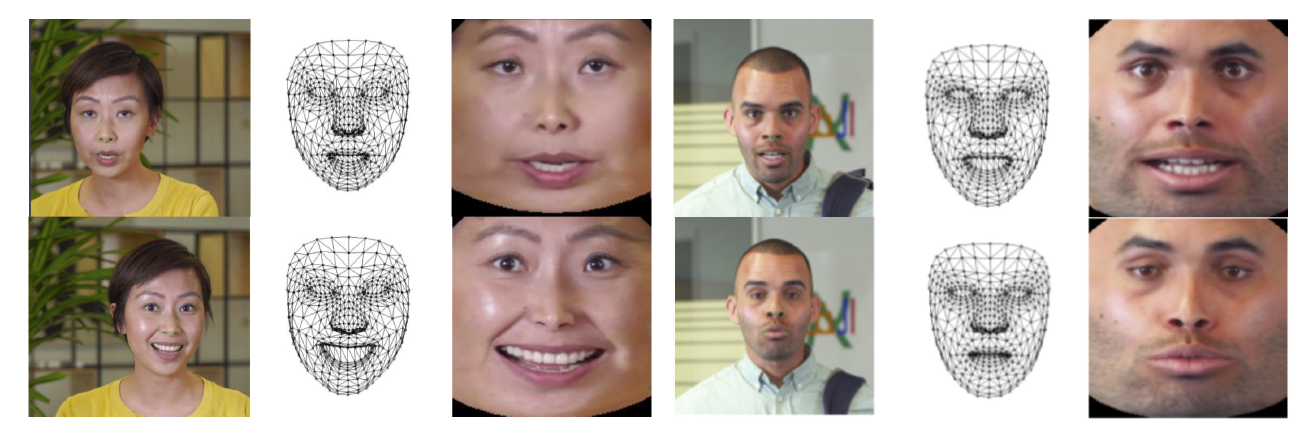

The two-stage work-flow of LipSync3D. Above, the generation of a dynamically textured 3D face from the ‘target’ audio; below, the insertion of the generated mesh into a target video.

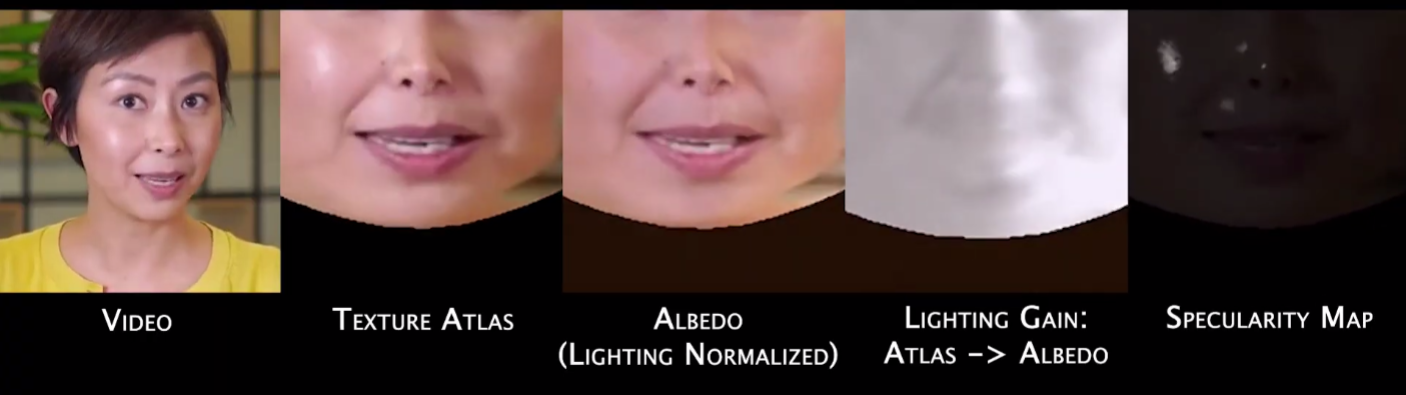

De fapt, contribuția cea mai notabilă a LipSync3D la corpul de eforturi de cercetare în acest domeniu poate fi algoritmul său de normalizare a iluminării, care decuplează iluminarea de antrenare și inferență.

Decoupling illumination data from general geometry helps LipSync3D to produce more realistic lip movement output under challenging conditions. Other approaches of recent years have limited themselves to ‘fixed’ lighting conditions that won’t reveal their more limited capacity in this respect.

În timpul pre-procesării cadrului de date de intrare, sistemul trebuie să identifice și să elimine punctele specifice, deoarece acestea sunt specifice condițiilor de iluminare în care a fost luat videoul și vor interfera altfel cu procesul de rearanjare a iluminării.

LipSync3D, așa cum îi sugerează numele, nu efectuează doar o analiză a pixelilor pe fețele evaluate, ci utilizează activ repere faciale identificate pentru a genera rețele CGI mobile, împreună cu texturile “desfășurate” care sunt înfășurate în jurul lor într-un pipeline CGI tradițional.

Pose normalization in LipSync3D. On the left are the input frames and detected features; in the middle, the normalized vertices of the generated mesh evaluation; and on the right, the corresponding texture atlas, which provides the ground truth for texture prediction. Source: https://arxiv.org/pdf/2106.04185.pdf

Pe lângă metoda inovatoare de rearanjare a iluminării, cercetătorii afirmă că LipSync3D oferă trei inovații principale față de lucrările anterioare: separarea geometriei, iluminării, poziției și texturii în fluxuri de date discrete într-un spațiu normalizat; un model de predicție a texturii auto-regresiv care produce sinteză de video temporar consistentă; și o realitate sporită, așa cum este evaluată de ratingurile umane și metricele obiective.

Splitting out the various facets of the video facial imagery allows greater control in video synthesis.

LipSync3D poate deriva mișcarea geometrică a buzelor direct din audio prin analizarea fonemelor și a altor aspecte ale vorbirii, și traducerea lor în poziții musculare cunoscute corespunzătoare din jurul zonei buzelor.

Acest proces utilizează o conductă de predicție comună, unde geometria și textura inferate au encodatori dedicați într-un ansamblu auto-encoder, dar împărtășesc un encoder audio cu vorbirea care urmează să fie impusă modelului:

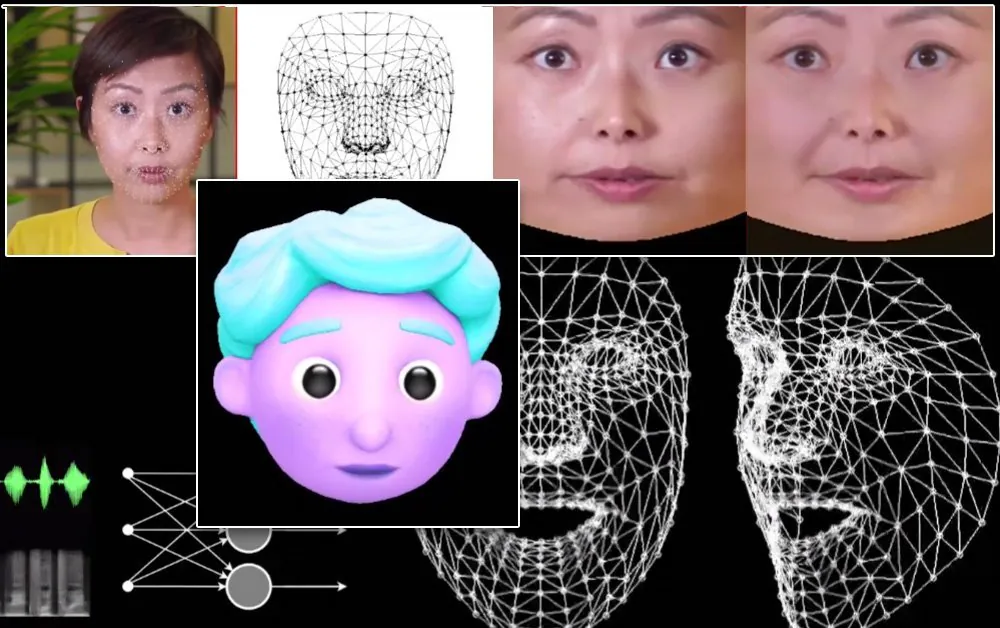

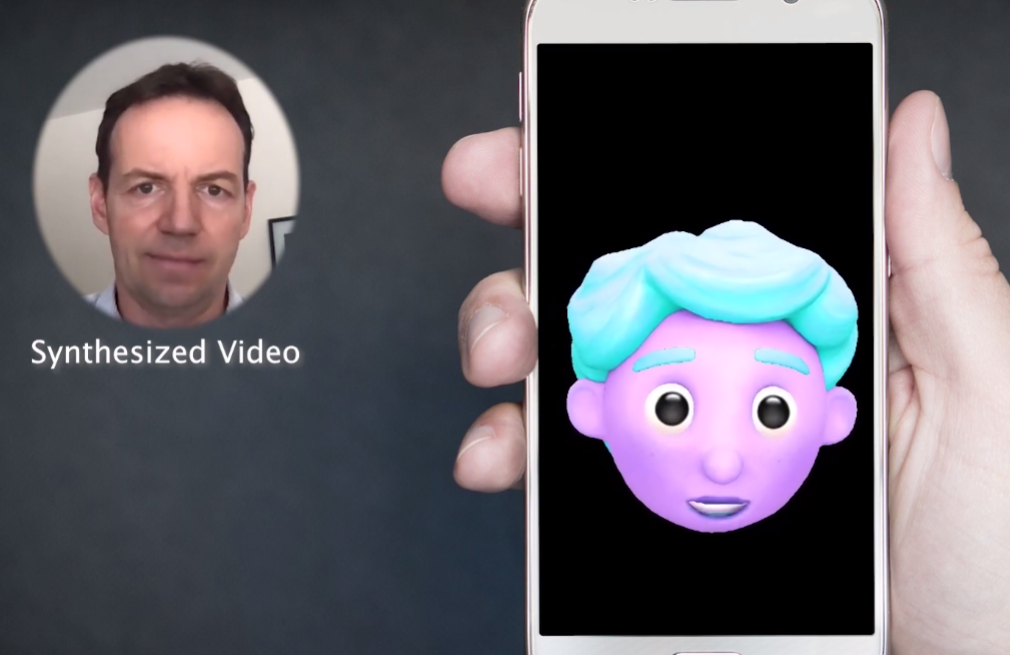

Sinteza mișcării labile a lui LipSync3D este, de asemenea, destinată să alimenteze avatare CGI stilizate, care, în esență, sunt doar același tip de rețea și informații texturale ca imaginile din lumea reală:

A stylized 3D avatar has its lip movements powered in real time by a source speaker video. In such a scenario, the best results would be obtained by personalized pre-training.

Cercetătorii anticipează, de asemenea, utilizarea avatarelor cu o senzație puțin mai realistă:

![]()

Timpul de antrenament pentru videoclipuri variază de la 3-5 ore pentru un videoclip de 2-5 minute, într-un pipeline care utilizează TensorFlow, Python și C++ pe un GeForce GTX 1080. Sesiunile de antrenament au utilizat o dimensiune de lot de 128 de cadre pe 500-1000 de epoci, fiecare epocă reprezentând o evaluare completă a videoclipului.

Spre O Sincronizare Dinamică a Mișcării Buzei

Domeniul re-sincronizării buzelor pentru a se potrivi cu o pistă audio nouă a primit o atenție considerabilă în cercetarea viziunii computerizate în ultimii ani (a se vedea mai jos), nu în ultimul rând deoarece este un produs secundar al controversatei tehnologii deepfake.

În 2017, Universitatea Washington a prezentat cercetări capabile să învețe sincronizarea buzelor din audio, utilizând-o pentru a schimba mișcările buzelor fostului președinte Obama. În 2018, Institutul Max Planck pentru Informatică a condus o altă inițiativă de cercetare pentru a permite transferul de identitate la identitate video, cu sincronizarea buzelor ca produs secundar al procesului; și în mai 2021, startup-ul AI FlawlessAI a dezvăluit tehnologia sa de sincronizare a buzelor, TrueSync, care a fost primită pe scară largă în presă ca un mijloc de îmbunătățire a tehnologiilor de dublaj pentru lansări majore de filme în diferite limbi.

Și, desigur, dezvoltarea continuă a depozitelor deschise de deepfake oferă o altă ramură de cercetare activă a utilizatorilor în acest domeniu al sintezei de imagini faciale.