Unghiul lui Anderson

Inteligențele Artificiale de Codare Tind să Suferă de Efectul Dunning-Kruger

Noi cercetări arată că inteligențele artificiale de codare, cum ar fi ChatGPT, suferă de efectul Dunning-Kruger, adesea acționând cu cea mai mare încredere atunci când sunt mai puțin competente. Atunci când abordează limbaje de programare nefamiliare sau obscure, ei afirmă o certitudine ridicată, chiar și atunci când răspunsurile lor se destramă. Studiul leagă supraincrederea modelului de atât de slabă performanță, cât și de lipsa de date de antrenament, ridicând noi îngrijorări cu privire la cât de mult aceste sisteme știu realmente despre ceea ce nu știu.

Oricine care a petrecut chiar și o perioadă moderată de timp interactând cu Modelele Lingvistice Mari despre chestiuni factuale va ști deja că LLM-urile sunt adesea dispuse să ofere un răspuns încrezător și greșit la o întrebare a utilizatorului.

Alături de forme mai evidente de halucinații, motivul pentru acest fel de aroganță goală nu este 100% clar. Cercetările publicate pe parcursul verii sugerează că modelele oferă răspunsuri încrezătoare chiar și atunci când știu că sunt greșite, de exemplu; deși alte teorii atribuie supraincrederea la alegeri arhitecturale, printre alte posibilități.

Ceea ce utilizatorul final poate fi sigur este că experiența este incredibil de frustrantă, deoarece suntem codificați pentru a avea încredere în estimările oamenilor privind propriile lor abilități (nu în ultimul rând pentru că, în astfel de cazuri, există consecințe, legale și de altă natură, pentru o persoană care promite prea mult și livrează prea puțin); și o anumită translație antropomorfică înseamnă că tendința noastră de a replica acest comportament cu sistemele de inteligență artificială conversațională.

Dar un LLM este o entitate fără responsabilitate, care poate și va returna în mod eficient un ‘Oho! Îmi cer scuze…’ după ce a ajutat utilizatorul să distrugă involuntar ceva important, sau cel puțin să irosească o după-amiază din timpul său; presupunând că va admite răspunderea în totalitate.

Mai rău, această lipsă de precauție prudentă pare imposibil de a o înlătura, cel puțin în ChatGPT, care va asigura abundent utilizatorul de validitatea sfaturilor sale și va explica defectele din gândirea sa doar după ce s-a produs already paguba.

Nici actualizarea memoriei sistemului persistente, nici utilizarea de promturi repetitive nu par să aibă un impact semnificativ asupra problemei.

Oamenii pot fi la fel de încăpățânați și autoînșelați – deși oricine care a greșit atât de adânc și de des ar fi, probabil, dat afară de la început. Astfel de oameni suferă de opusul ‘sindromului impostorului’ (unde un angajat se teme că a fost promovat peste capacitățile sale) – efectul Dunning Kruger, unde o persoană supraestimează în mod semnificativ abilitatea sa de a efectua o sarcină.

Costul Inflației

O nouă cercetare de la Microsoft examinează valoarea efectului Dunning-Kruger în ceea ce privește performanța eficientă a arhitecturilor de codare asistate de IA (cum ar fi Copilot), într-un efort de cercetare care este primul care abordează în mod specific acest subsector al LLM-urilor.

Lucrarea analizează modul în care aceste inteligențe artificiale de scriere a codului își evaluează propriile răspunsuri împotriva modului în care au performant realmente, în zeci de limbaje de programare. Rezultatele arată un model uman: atunci când modelele erau mai puțin capabile, erau mai sigure de ele însele.

Efectul a fost mai puternic în limbajele obscure sau cu resurse reduse, unde datele de antrenament erau subțiri – cu cât modelul era mai slab sau limba mai rară, cu atât iluzia abilității era mai mare:

Performanța reală și percepută a GPT-4o în diferite limbaje de programare, sortate după performanța reală. Sursă: https://arxiv.org/pdf/2510.05457

Cei patru autori, toți contribuitori egali care lucrează pentru Microsoft, susțin că lucrarea ridică noi întrebări despre cât de mult aceste unelte pot fi încredințate să-și evalueze propria ieșire, și afirmă:

‘Prin analiza încrederii modelului și a performanței într-un set divers de limbaje de programare, descoperim că modelele IA oglindesc modelele umane de supraincredere, în special în domenii nefamiliare sau cu resurse reduse.

‘Experimentele noastre demonstrează că modelele mai puțin competente și cele care operează în limbaje de programare rare prezintă o bias DKE mai puternic, sugerând că puterea bias-ului este proporțională cu competența modelului. Acest lucru se aliniază cu experimentele umane pentru bias.’

Cercetătorii contextualizează această linie de studiu ca o modalitate de a înțelege cum încrederea modelului devine neverosimilă atunci când performanța este slabă și de a testa dacă sistemele IA prezintă același tip de supraincredere observat la oameni – cu implicații în aval pentru încredere și implementare practică.

Deși noul articol defie legea lui Betteridge a titlurilor, acesta poartă titlul Modelele de cod suferă de efectul Dunning-Kruger?. Deși autorii afirmă că codul a fost lansat pentru această lucrare, preprintul curent nu conține detalii despre aceasta.

Metodă

Studiul a testat cât de precis inteligențele artificiale de codare își pot evalua propriile răspunsuri, oferindu-le mii de întrebări cu variante multiple de programare, cu fiecare întrebare aparținând unui anumit domeniu de limbaj, de la Python și Java la Perl și COBOL:

Domeniile de limbaje de programare utilizate în studiu, împreună cu numărul de întrebări cu variante multiple de codare eșantionate pentru fiecare domeniu.

Modelele au fost însărcinate să aleagă opțiunea corectă și să estimeze cât de încrezătoare erau în alegerea lor, cu performanța lor reală măsurată de cât de des au obținut răspunsul corect – și încrederea lor autoevaluată indicând cât de buni credeau că sunt. Compararea acestor două metrice a permis cercetătorilor să vadă unde încrederea și competența divergeau.

Pentru a măsura cât de încrezătoare păreau a fi modelele, studiul a utilizat două metode: încrederea absolută și încrederea relativă. În primul rând, modelul a fost solicitat să ofere un punctaj de la zero la unu alături de fiecare răspuns, cu încrederea sa pentru un anumit limbaj definită de media acelor punctaje pe întrebări în acel limbaj.

A doua metodă a examinat cât de încrezătoare era modelul atunci când alegea între două întrebări; pentru fiecare pereche, modelul a trebuit să spună care dintre ele se simțea mai sigur. Aceste alegeri au fost apoi evaluate folosind sisteme de clasificare inițial concepute pentru jocuri competitive, tratând fiecare întrebare ca și cum ar fi un jucător într-un meci. Punctajele finale au fost normalizate și mediate pentru fiecare limbaj pentru a oferi un punctaj de încredere relativ.

Două forme stabilite ale efectului Dunning-Kruger sunt examinate în articol: una care urmărește modul în care un singur model subestimează performanța sa în diferite domenii; și alta care compară nivelurile de încredere între modele mai slabe și mai puternice.

Prima formă, numită intra-participant DKE, examinează dacă un singur model devine mai supraincred în limbajele în care performează slab. A doua, inter-participant DKE, întreabă dacă modelele care performează mai slab în general tendință să se autoevalueze mai ridicat.

În ambele cazuri, decalajul dintre încredere și performanță reală este utilizat pentru a măsura supraincrederea, cu decalaje mai mari în setări cu performanță scăzută care indică un comportament similar DKE.

Tratarea modelelor ca participanți a introdus unele limitări, deoarece numărul mic de modele afectează diversitatea; diferențele din interiorul ieșirilor unui model sunt ignorate; și distribuția datelor poate să nu reflecte cea a participanților umani reali.

Pentru a compensa acest lucru, studiul a testat trei configurații alternative: în primul rând, fiecare model a primit o persoană distinctă; în al doilea rând, răspunsurile au fost eșantionate la o temperatură mai ridicată pentru a crea mai multă variație; în al treilea rând, prompturile au fost reformulate de mai multe ori, cu fiecare versiune tratată ca un participant separat:

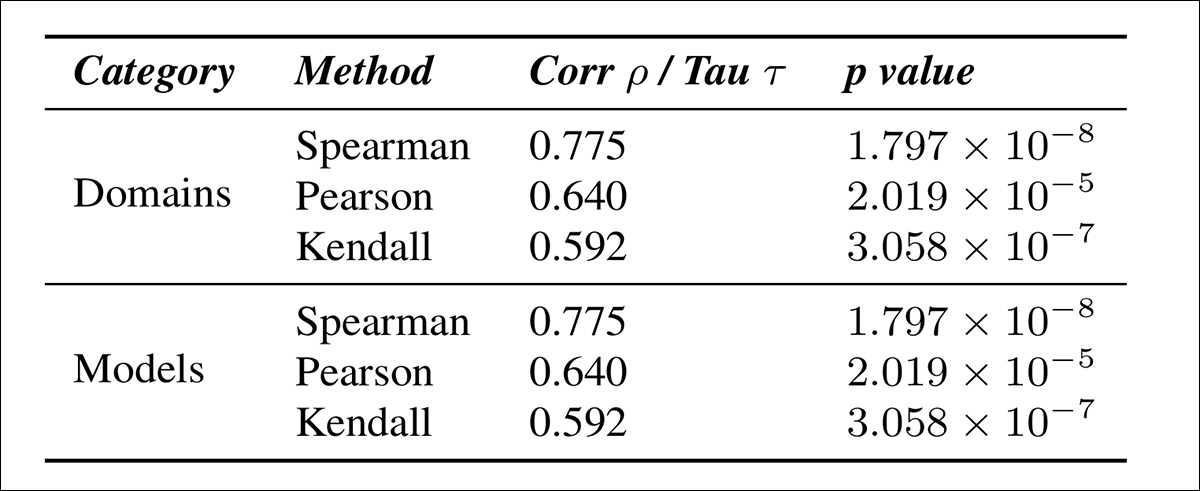

Corelația dintre supraincredere și performanță reală în diferite configurații experimentale, arătând că modelul Dunning-Kruger rămâne consistent în toate condițiile și este cel mai puternic atunci când se eșantionează multiple răspunsuri diverse din același model.

Rezultatele tabelului de mai sus arată cum efectul Dunning-Kruger se manifestă în aceste condiții, rămânând prezent în fiecare caz; și că DKE a fost cel mai pronunțat atunci când s-au eșantionat multiple răspunsuri din același model la o temperatură ridicată.

Pentru a înțelege mai bine cum performanța percepută diverge de performanța reală, studiul a comparat estimările de încredere absolută și relativă, calculând cât de mult fiecare model supraestima propria sa abilitate (în special, diferența dintre punctajul său de încredere și acuratețea sa reală), și apoi măsurând cum această supraestimare se relaționa cu performanța reală a modelului:

Corelația dintre supraincredere (măsurată ca încredere absolută minus încredere relativă) și acuratețe reală în domenii de programare și tipuri de modele, arătând că o supraestimare mai mare este asociată în mod constant cu o performanță mai scăzută.

Rezultatele tabelului de mai sus ilustrează cum supraestimarea se relaționează cu performanța reală, atât în domenii de programare, cât și în modele. În ambele cazuri, putem vedea că modelele cu acuratețe mai scăzută tendință să arate o supraincredere mai mare.

De asemenea, modelele specializate instruite pe domenii mai înguste au arătat efecte DKE mai puternice decât cele generaliste:

Corelația dintre supraestimare și performanță reală pentru modelele de bază, specializate pe un singur domeniu și pe multiple domenii, arătând efecte DKE mai puternice pe măsură ce specializarea crește.

Utilizând setul de date MultiPL-E în opt limbaje de programare, autorii au constatat că instruirea pe un singur domeniu a condus la o supraincredere mai mare decât instruirea pe multiple domenii sau configurațiile de bază, sugerând că DKE se înrăutățește odată cu creșterea specializării.

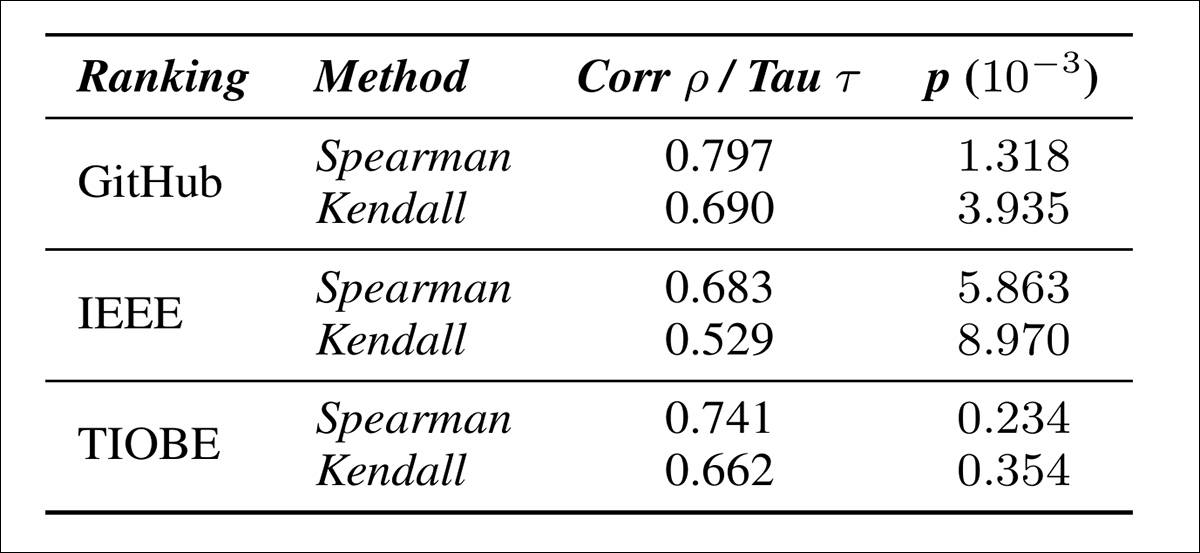

Testele au arătat, de asemenea, că modelele tendință să fie mai supraincred în limbajele de programare rare. Pe GitHub, IEEE și TIOBE clasamente, raritatea se corelează puternic cu o încredere percepută mai ridicată, culminând la 0,797:

Corelația dintre supraincrederea modelului și raritatea limbajului, utilizând trei clasamente de popularitate. Limbajele mai puțin comune sunt asociate cu o performanță percepută mai ridicată.

În final, autorii au testat dacă efectul Dunning-Kruger apare în generarea de cod, evaluând modelele pe setul de date MultiPL-E în limbajele Ada, Dart, Prolog, Swift, C++, Python, C# și Elixir.

Deși efectul a fost încă prezent, a fost semnificativ mai slab decât în setarea întrebărilor cu variante multiple, probabil reflectând dificultatea mai mare de a evalua încrederea și corectitudinea în sarcini deschise:

Corelația dintre supraestimare și performanță reală în generarea de cod deschis, pe baza rezultatelor MultiPL-E în opt limbaje de programare.

La considerarea explicației încă disputate a efectului Dunning-Kruger, autorii concluzionează:

‘O posibilă explicație care poate fi comună atât oamenilor, cât și modelelor IA este explicația meta-cognitivă, care afirmă că evaluarea calității unei performanțe a unei abilități este o parte crucială a dobândirii acelei abilități.

‘Această explicație poate fi testată experimental în modelele IA cu un studiu controlat al diferitelor strategii de antrenament și dacă toate duc la îmbunătățiri simultane ale performanței și ale capacității de a evalua calitatea performanței. Cu toate acestea, acest studiu este semnificativ dincolo de scopul acestui articol, și îl lăsăm pentru lucrări viitoare.’

Concluzie

Chiar și în domeniul său nativ, efectul Dunning-Kruger (așa cum menționează articolul) poate fi atribuit fie unei cauze statistice, fie uneia cognitive. Dacă este o cauză statistică, aplicarea unui sindrom anterior unic uman la un context de învățare automată este de fapt validă.

Deși autorii speculează că cauza ar putea fi găsită a fi ‘cognitivă’ în ambele cazuri, ar necesita o poziție ușor mai metafizică.

Poate cea mai interesantă descoperire din articol este măsura în care mai multe inteligențe artificiale de codare tind să se încăpățâneze în circumstanțele lor mai nefavorabile, adică prin manifestarea unei încrederi maxime atunci când se confruntă cu limbajele cele mai rare sau mai puțin cunoscute – ceea ce ar fi o strategie aproape imediat auto-distructivă într-un mediu de lucru real.

* Limbajele de programare utilizate au fost Ada, Bash, C, C#, C++, COBOL, Ceylon, Clojure, D, Dart, Dash, Elixir, Erland, F#, Fortran, Go, Haskell, Java, JavaScript, Julia, Lisp, Kotlin, Lua, OCaml, Objective-C, PHP, Pascal, Perl, Prolog, Python, Racket, Ruby, Rust, Scala, Swift, TypeScript și Visual Basic.

Publicat pentru prima dată miercuri, 8 octombrie 2025