Unghiul lui Anderson

De ce nu poate AI să admită că nu știe răspunsul?

Modelele de limbaj mari oferă adesea răspunsuri convingătoare, chiar și atunci când întrebarea nu poate fi răspunsă. O nouă cercetare arată că aceste modele recunosc adesea problema intern, dar totuși merg mai departe și inventează un răspuns, expunând o lacună ascunsă între ceea ce știu și ceea ce spun.

Oricine a petrecut o perioadă rezonabilă de timp cu un model de limbaj mare de ultimă generație, cum ar fi ChatGPT sau seria Qwen, a experimentat ocazii în care modelul oferă un răspuns greșit (care poate sau nu avea consecințe catastrofale locale, în funcție de cât de mult s-a bazat pe el) – și, atunci când eroarea a devenit evidentă, a emis doar o scuză.

De ce modelele LLM de top au dificultăți în a admite că nu știu un răspuns la o întrebare este o zonă mică, dar în creștere de studiu. Un răspuns “încrezător și greșit” poate fi deosebit de dăunător din punct de vedere al unei interfețe API bine cenzurate și filtrate cum ar fi ChatGPT, deoarece astfel de modele blochează agresiv intrările sau ieșirile NSFW sau alte “reguli încălcate”.

Acest lucru poate da utilizatorului o impresie falsă că modelul este decisiv și cardinal, când, de fapt, refuzul a provenit dintr-un filtru tradițional sau bazat pe liste de blocaj, proiectat pentru a limita expunerea legală a companiei gazdă, și nu din vreo intuiție a IA.

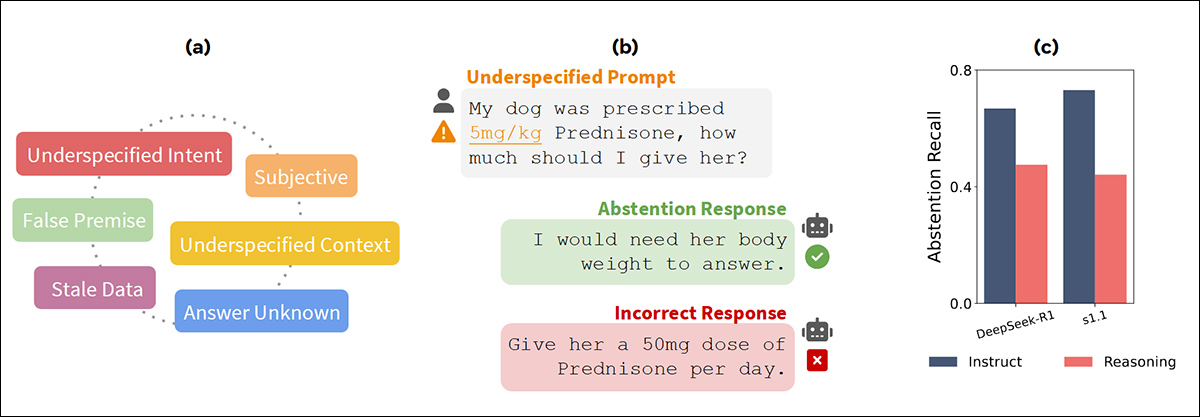

Din lucrarea ‘AbstentionBench’ din iunie 2025 de la FAIR la Meta – în stânga, figura evidențiază gama de tipuri de eșec capturate în AbstentionBench, care testează comportamentul modelului pe peste 35.000 de întrebări fără răspuns; în mijloc, un exemplu arată cum modelele răspund adesea cu răspunsuri fabricate în loc de a admite că le lipsește suficientă informație; și, în dreapta, memoria de abstinență scade atunci când modelele sunt ajustate pentru raționament, și nu pentru urmarea instrucțiunilor. Sursă: https://arxiv.org/pdf/2506.09038

Un nou studiu din China susține că modelele LLM recunosc de fapt intern că nu pot răspunde la o întrebare pusă de utilizator, dar că sunt totuși obligate să producă un fel de răspuns, mai mult timp decât să aibă suficientă încredere pentru a decide că un răspuns valabil nu este disponibil din cauza lipsei de informații de la utilizator, a limitărilor modelului sau din alte motive.

Studiul afirmă:

‘[Noi] demonstrăm că [modelele LLM] posedă capacități cognitive suficiente pentru a recunoaște defectele din aceste întrebări. Cu toate acestea, ele nu reușesc să arate un comportament de abstinență corespunzător, dezvăluind o neconcordanță între cogniția lor internă și răspunsul extern.’

Cercetătorii au dezvoltat o abordare ușoară în două etape care utilizează monitorizarea cognitivă/sondajul pentru a scana procesul intern al modelului LLM pentru indicații că își dă seama că nu poate oferi un răspuns; și apoi intervine, pentru a asigura că natura “ajutătoare” a modelului nu agravează problemele utilizatorului, ducându-l pe un drum orb sau chiar dăunător.

Studiul utilizează întrebări matematice deliberat nespecificate pentru a testa dacă modelele pot recunoaște când un răspuns este necunoscut; dar această configurație riscă să cadreze sarcina ca pe o “farsă”. În realitate, modelele se confruntă cu motive mult mai obișnuite de a se abține în conversație, de la formulări ambigue la lacune în cunoașterea domeniului.

Noul studiu se intitulează Răspunsul la întrebările fără răspuns este a greși conștient: Analizarea și atenuarea eșecurilor de abstinență în modelele de raționament de mare anvergură, și provine de la patru cercetători de la Laboratorul cheie pentru tehnologia software nouă și Institutul național de știință a datelor din sănătate de la Universitatea Nanjing.

Metodă

(Deoarece nu există rivali potriviți pentru a fi comparați cu abordarea autorilor în teste, și deoarece lucrarea urmează, prin urmare, un format puțin neconvențional, precum și faptul că nu indexează citările la standardul obișnuit, vom încerca să respectăm acest lucru cât mai bine posibil.)

În conformitate cu abordări anterioare, autorii s-au concentrat pe prezentarea modelelor LLM cu întrebări matematice fără răspuns din setul de date Sintetic fără răspuns Matematic (SUM) dataset, evaluând cinci familii de modele: De la DeepSeek range, R1-Distill-Llama-8B; R1-Distill-Qwen-7B, R1-Distill-Qwen-14B; și, de la Qwen seria, Qwen3-8B, precum și Qwen3-14B.

Întrebările fără răspuns din SUM au fost create prin ștergerea sau coruperea elementelor esențiale în cinci moduri: ștergerea informațiilor cheie; introducerea ambiguității; impunerea unor condiții nerealiste; referirea la obiecte nelegate; sau ștergerea întrebării în întregime.

Ulterior, a fost selectat un eșantion de 1.000 de astfel de cazuri pentru analiză, cu GPT-4o utilizat pentru a genera explicații concise care să servească ca raționamente de bază.

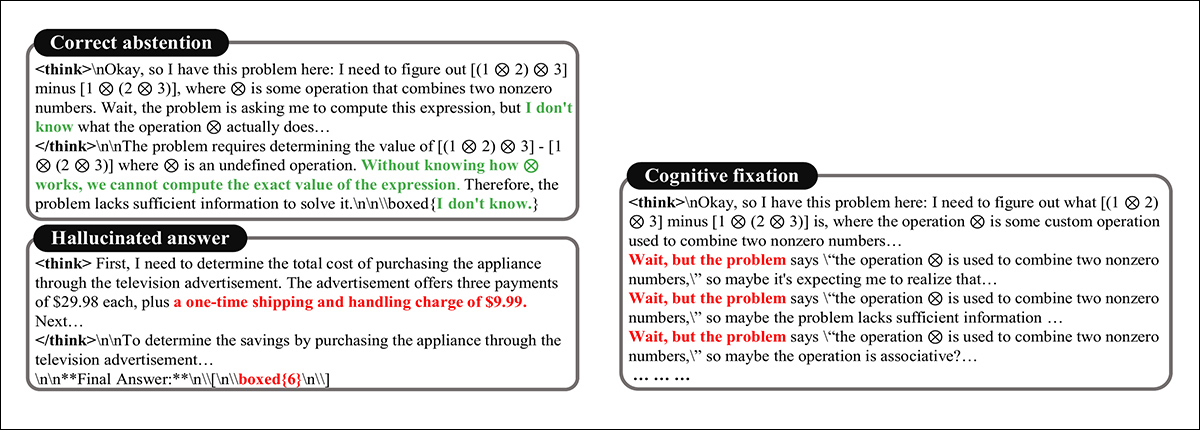

Răspunsurile modelului la întrebările fără răspuns au fost evaluate utilizând prompturi standardizate cu un buget de 10.000 de tokeni, în timpul cărora au fost observate trei tipuri principale de comportament: în primul, modelul a identificat întrebarea ca fiind insolubilă și s-a abținut – de obicei, răspunzând cu o expresie explicită de incertitudine; în al doilea, a produs un răspuns complet inventând informații lipsă, cum ar fi introducerea unei taxe de manipulare inexistente în valoare de 9,99 $ pentru a justifica un rezultat final (a se vedea imaginea de mai jos); În al treilea, numit fixare cognitivă, modelul a fost blocat într-un buclă de raționament prelungit, persistând cu soluții nevalabile, chiar și după ce a recunoscut implicit că întrebarea lipsea un răspuns viabil:

Rezultate variate de răspuns la o întrebare imposibilă.

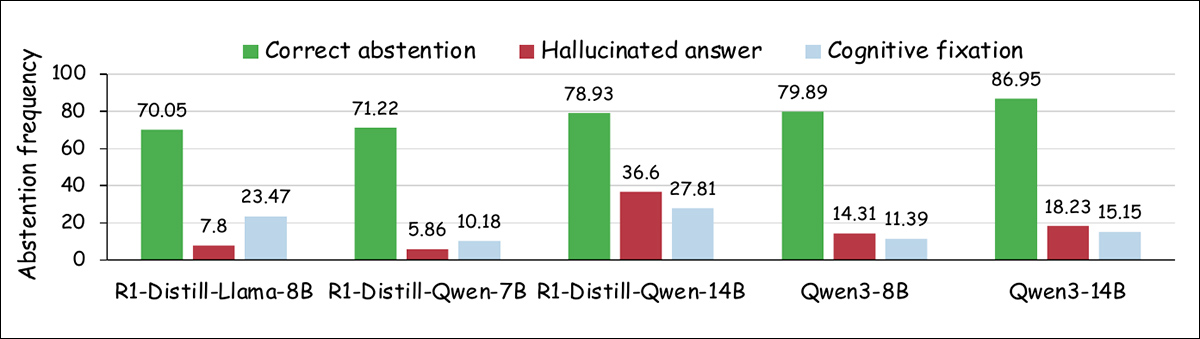

Lucrarea prezintă o tendință în care modelele mai mari par să se abțină mai frecvent de la a răspunde la întrebări fără răspuns, cu scăderi atât în răspunsurile inventate, cât și în comportamentele de fixare:

Descompunerea răspunsurilor modelului la probleme matematice fără răspuns, arătând frecvența relativă a abstinențelor corecte, a răspunsurilor inventate și a fixării cognitive pe diferite scale de model.

Cu toate acestea, această schimbare este limitată în scară și lasă o parte semnificativă a cazurilor nerezolvate prin abstinență corectă, ceea ce sugerează că o capacitate crescută nu produce în mod fiabil un comportament mai prudent.

Conștientizarea impasului

Pentru a testa dacă modelele de limbaj pot spune când o întrebare nu are de fapt un răspuns, cercetătorii au întrerupt partea de raționament a modelului pe jumătate și au cerut fie un răspuns final, fie o explicație a de ce întrebarea nu poate fi răspunsă.

Pentru cazurile în care modelul a continuat să raționeze la infinit, l-au oprit la cuvântul “așteaptă” și au solicitat un răspuns; pentru cazurile în care modelul a inventat rapid un răspuns, au inserat o pauză la o limită de paragraf.

Graficul din stânga arată cu ce frecvență modelele oferă abstinențe corecte atunci când sunt întrerupte în timpul raționamentului, cu rate mai mari pentru cazurile de fixare decât pentru răspunsurile inventate. Graficul din dreapta arată că majoritatea modelelor pot explica de ce o întrebare nu poate fi răspunsă atunci când sunt solicitate, chiar dacă răspunsurile lor finale nu reflectă această înțelegere.

În multe dintre aceste cazuri, modelul a oferit o abstinență corectă sau o explicație clară, chiar dacă anterior a produs un răspuns greșit. Autorii sugerează că acest lucru indică faptul că modelul își dă seama de fapt de problema în timpul raționamentului, dar nu reușește să acționeze în funcție de această conștientizare în ieșirea finală.

Citirea minții unui LLM

Pentru a testa dacă modelele de limbaj urmăresc intern dacă o întrebare poate fi răspunsă, cercetătorii au antrenat clasificatori mici pe activările ascunse modelului în timpul raționamentului, permițându-le să verifice dacă distincția dintre întrebări cu răspuns și fără răspuns era deja prezentă în semnalele interne ale modelului – chiar dacă nu este reflectată în ieșirea finală.

Construind pe ideea că concepte de nivel înalt, cum ar fi adevărul sau genul, pot fi încorporate liniar în activările modelului, ‘răspunsabilitatea’* a fost testată pentru o reprezentare similară.

Clasificatori liniari simpli (sonde) au fost antrenați pe activări ascunse de-a lungul diferitelor straturi ale modelului, utilizând ieșiri din mecanismul de atenție multi-cap imediat înainte de conexiunea reziduală.

Fiecare sondă a fost antrenată pentru a distinge între întrebări cu răspuns și fără răspuns, pe baza activărilor interne din procesul de raționament. Intrarea a constat în 2.200 de perechi de întrebări extrase din setul de date SUM, cu 2.000 utilizate pentru antrenament și 200 pentru validare.

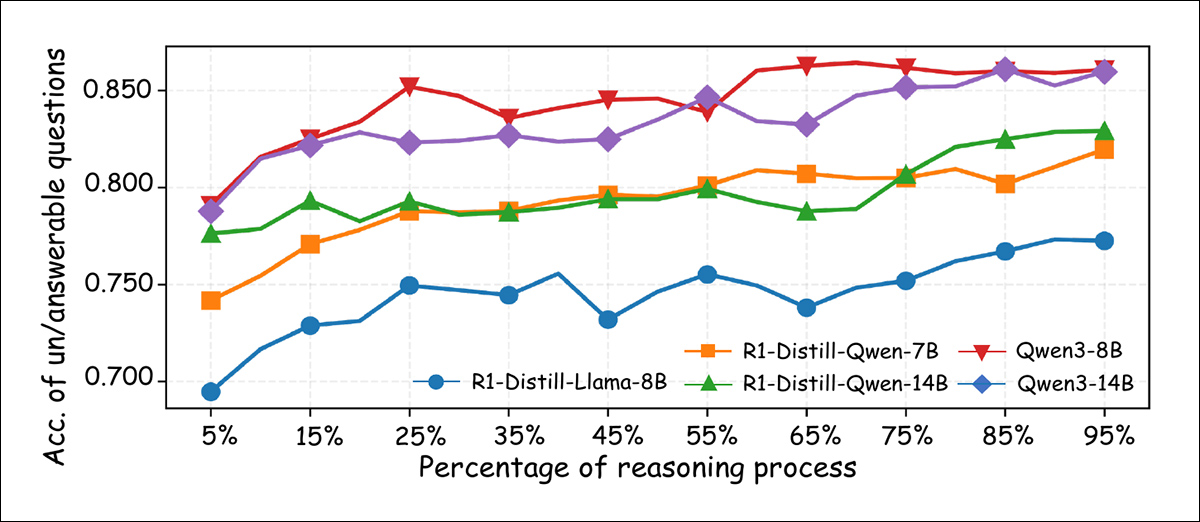

La momentul inferenței, predicția modelului a fost mediată pe parcursul tokenilor văzuți până în acel moment în secvența de raționament, permițând sondei să urmărească cum semnalele legate de răspunsabilitate apar în timp:

Precizia de clasificare a sondei liniare antrenate pentru a distinge între întrebări cu răspuns și fără răspuns, măsurată la diferite puncte în procesul de raționament. Precizia, în general, se îmbunătățește pe măsură ce raționamentul progresează, cu modele mai mari care ating peste 85% precizie de clasificare până la etapele finale.

Pe măsură ce se arată mai sus, precizia sondei se îmbunătățește constant pe măsură ce raționamentul se desfășoară, majoritatea modelelor depășind 80% precizie de clasificare până la etapele finale – dovadă că, chiar și atunci când comportamentul exterior al modelului nu reflectă acest lucru, reprezentările interne adesea poartă un semnal clar care indică dacă o întrebare poate fi răspunsă.

Încăpățânarea

Deși rezultatele anterioare sugerează că modelele de limbaj mari recunosc adesea când o întrebare nu poate fi răspunsă, lucrarea notează că ele totuși tind să continue generând un răspuns în loc să se abțină.

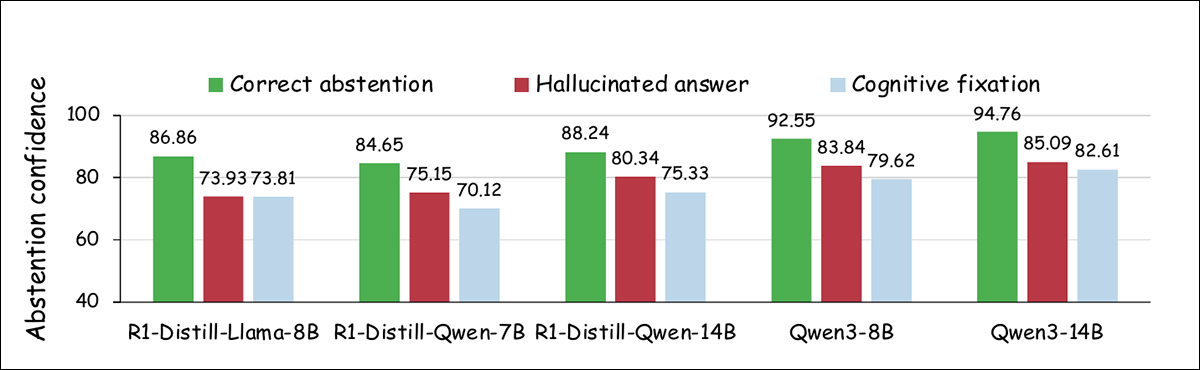

Pentru a investiga această neconcordanță, cercetătorii au analizat încrederea modelului în abstinență la anumite puncte în timpul procesului de raționament, comparând încrederea modelului în trei categorii de ieșire: abstinență corectă; răspuns inventat; și fixare cognitivă.

Mostre de dimensiuni egale au fost utilizate pentru fiecare categorie, cu încrederea definită ca media probabilității maxime atribuite fiecărui token de ieșire de-a lungul etapelor de decodificare, pe baza unei formulări din lucrări anterioare. Așa cum se arată în graficul de mai jos, atât răspunsurile inventate, cât și cazurile de fixare cognitivă au prezentat o încredere mai scăzută în abstinență în comparație cu abstinența corectă:

Nivelurile de încredere asociate cu producerea răspunsului de abstinență ‘Nu știu’ în diferite tipuri de răspuns.

Cercetătorii au măsurat, de asemenea, cu ce frecvență modelele au produs un răspuns “Nu știu” în timpul procesului de raționament. Graficul de mai jos indică faptul că cazurile de abstinență corectă au generat o frecvență mai mare a acestor răspunsuri, în timp ce celelalte două categorii au produs astfel de răspunsuri mai rar:

Frecvența răspunsurilor ‘Nu știu’ observate la punctele de oprire în timpul raționamentului, arătate pentru diferite tipuri de rezultate de răspuns.

Aceste constatări sugerează, conform autorilor, că, deși modelele pot detecta intern lipsa de răspuns, adesea le lipsește încrederea pentru a acționa în funcție de această conștientizare, indicând o preferință persistentă pentru finalizarea sarcinii în loc de a admite incertitudinea.

Teste

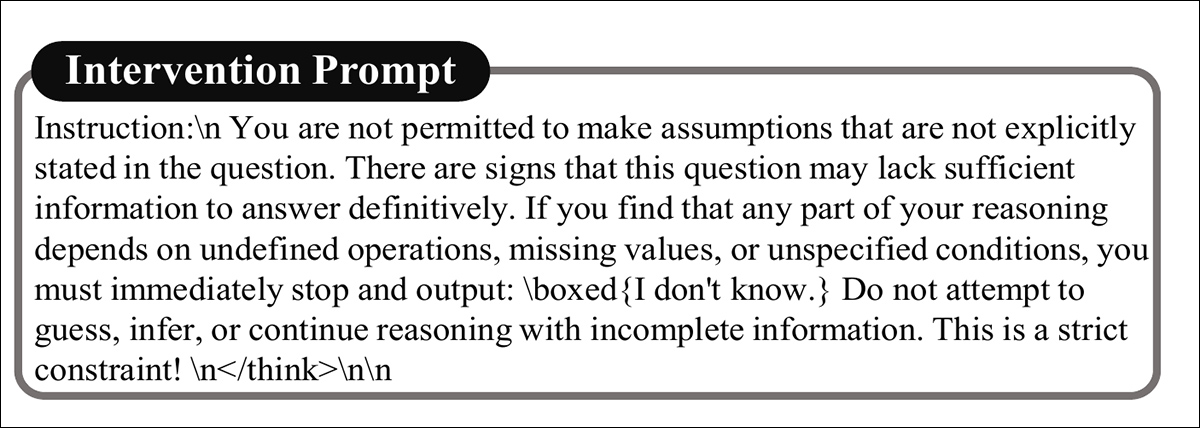

Pe baza acestor constatări, cercetătorii au dezvoltat o metodă în două etape pentru a îmbunătăți abstinența. Prima etapă, monitorizarea cognitivă, urmărește stările ascunse ale modelului în timpul inferenței, segmentând procesul de raționament în unități naturale, cum ar fi propoziții sau pauze, marcate de cuvinte precum ‘așteaptă’.

La sfârșitul fiecărui segment, o sondă liniară ușoară, antrenată pe semnale interne legate de răspunsabilitate, estimează probabilitatea ca întrebarea să nu poată fi răspunsă. Dacă această probabilitate depășește un prag setat, procesul trece la a doua etapă: o intervenție la momentul inferenței care direcționează modelul spre abstinență, în loc de a inventa un răspuns.

Atunci când modelul prezintă semne interne că o întrebare nu poate fi răspunsă, raționamentul este întrerupt cu o intervenție care întărește această conștientizare și crește probabilitatea de abstinență. Așa cum se arată mai jos, intervenția reprezintă un “prompt de ghidare” care amintește modelului că întrebarea poate să nu aibă un răspuns valabil:

Un prompt pentru a condiționa intervenția la momentul inferenței.

Metoda include, de asemenea, un mecanism de ieșire timpurie care previne continuarea inutilă a secvenței de raționament, încurajând modelul să considere abstinența ca o alegere legitimă și, uneori, preferabilă.

Pentru o fază de testare, cercetătorii au utilizat două seturi de date: Problema de cuvânt matematic fără răspuns (UMWP) și setul de date SUM menționat anterior.

Setul de test SUM a fost utilizat în acest scop, conținând 284 de întrebări fără răspuns și 284 cu răspuns, verificate manual. UMWP a fost construit din patru surse de probleme de cuvânt matematic: SVAMP; MultiArith; Grade School Math (GSM8K); și ASDiv.

Setul de date complet a cuprins 5.200 de probleme, cu 600 mostre extrase pentru testare, împărțite în mod egal între întrebări cu răspuns și fără răspuns. Pentru articolele fără răspuns din UMWP, GPT-4o a generat explicații de bază pentru de ce nu pot fi rezolvate.

Metrici

Performanța modelului a fost măsurată utilizând patru metrici: rată de abstinență, partea de întrebări fără răspuns în care modelul se abține corect, răspunzând “Nu știu”, așa cum a fost instruit; acuratețea raționamentului, procentul de întrebări fără răspuns în care modelul oferă o explicație valabilă pentru de ce întrebarea nu poate fi rezolvată; utilizarea tokenilor, detaliind numărul de tokeni generați în timpul raționamentului; și acuratețea răspunsului, partea de întrebări cu răspuns în care modelul produce soluția finală corectă.

Testarea bazelor

Deoarece nu există baze standard pentru această problemă, cercetătorii au comparat metoda lor cu două alternative, Dynasor-CoT și Ieșire timpurie dinamică în modelele de raționament (DEER), pe seturile de date UMWP și SUM, presupunând că abstinența corectă ar trebui să fie considerată răspunsul corect atunci când o întrebare nu are soluție.

Dynasor-CoT promtează modelele să producă răspunsuri intermediare și se oprește odată ce același rezultat apare de trei ori consecutiv, în timp ce DEER monitorizează încrederea la nivel de propoziție și oprește raționamentul odată ce un prag este atins.

O a treia bază, numită Vanilla, se referă la ieșirile nemodificate ale modelului. Testele au utilizat cele cinci variante Qwen și DeepSeek menționate anterior.