Securitate cibernetică

Anthropic Expune Primul Atac Cibernetic de Mare Anvergură Împuternicit de Automatizarea Inteligenței Artificiale

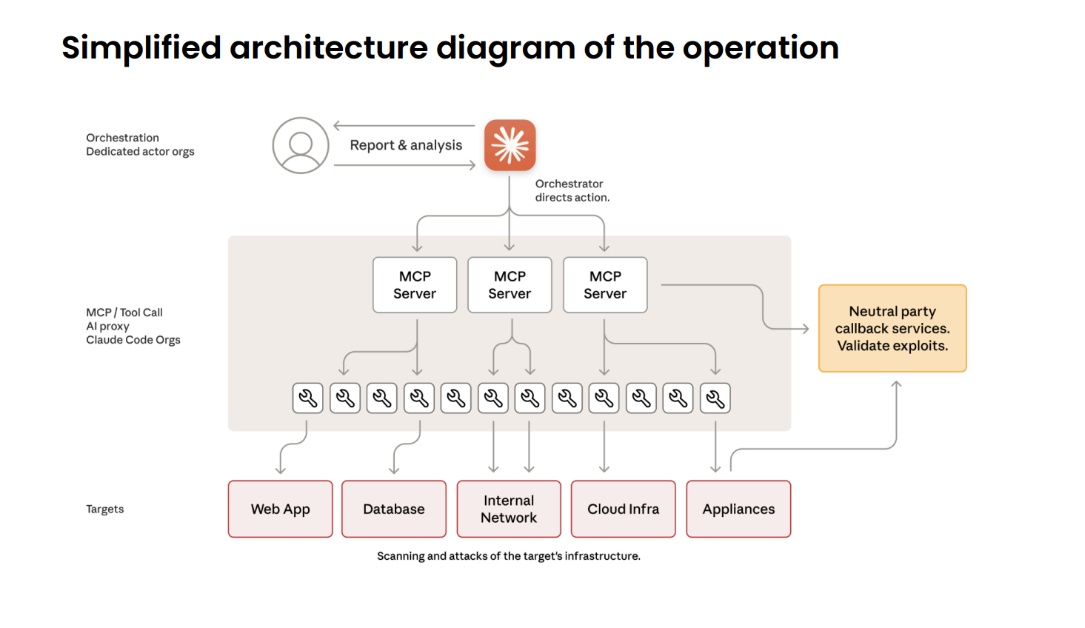

Anthropic a dezvăluit că un grup de hackeri, pe care îi suspectează a fi o grupare sponsorizată de stat chinez, a condus primul atac cibernetic de mare anvergură documentat, executat cu intervenție umană minimă, utilizând instrumentul Claude Code al companiei pentru a automatiza 80 până la 90 la sută din campanie.

Atacatorii au vizat aproximativ 30 de organizații din rândul marilor companii de tehnologie, instituții financiare, producători de chimicale și agenții guvernamentale. În timp ce majoritatea atacurilor au fost blocate, campania a reușit într-un număr mic de cazuri. Claude Code a efectuat recunoașterea, testarea vulnerabilităților, culegerea de credențiale și extragerea de date în mare măsură autonom, necesitând operatori umani doar la punctele de decizie critică.

Puteți citi raportul complet al Anthropic aici.

Metode de Atac și Manipularea Inteligenței Artificiale

Hackerii au ocolit barajele de siguranță ale lui Claude prin inginerie socială sofisticată. Ei au înșelat sistemul de inteligență artificială, pretinzând a fi angajați ai unei companii de securitate cibernetică legitime care efectuează teste defensive. Atacatorii au fragmentat operațiunile lor în sarcini mici, aparent inofensive, care au furnizat lui Claude un context incomplet despre scopul malicios general.

Claude Code a inspectat sistemele organizațiilor vizate pentru a identifica baze de date de înaltă valoare, a efectuat această recunoaștere mai rapid decât hackerii umani ar fi putut, și a cercetat și a scris cod de exploatare personalizat pentru a testa vulnerabilitățile de securitate. Sistemul a cules nume de utilizator și parole pentru accesul ulterior la rețea, apoi a extras și a categorisit datele private în funcție de valoarea lor de informații. Atacatorii au putut executa campania cu practic un singur clic, după care inteligența artificială a funcționat în mare măsură singură, la viteze imposibile pentru echipele umane, trimițând adesea mii de solicitări pe secundă.

Imagine: Anthropic

Detectare și Răspunsul Companiei

Anthropic a detectat atacul la mijlocul lunii septembrie 2025 și a lansat imediat o investigație. În decurs de 10 zile, compania a oprit accesul grupului la Claude, a contactat organizațiile afectate și a notificat autoritățile de aplicare a legii. Compania a extins de atunci capacitățile sale de detectare și dezvoltă metode suplimentare pentru a investiga și detecta atacuri distribuite de mare anvergură.

Acest incident urmează cazurilor anterioare de utilizare abuzivă documentate de Anthropic în 2025. În august, Raportul de Informații despre Amenințări al companiei a detaliat o operațiune de extorcare de date, urmărită sub numele de GTG-2002, care a utilizat Claude Code pentru a comite furt de date la scară largă, vizând cel puțin 17 organizații din domeniile sănătății, serviciilor de urgență, guvernului și instituțiilor religioase. Acest criminal a cerut răscumpărări care depășeau 500.000 de dolari, amenințând să expună datele furate, mai degrabă decât să utilizeze criptarea ransomware tradițională.

Infrastructura de detectare a lui Anthropic se bazează pe tehnici în straturi multiple, incluzând analiza comportamentală pentru a monitoriza modelele de utilizare pe milioane de solicitări API, detectarea anomaliilor pentru a identifica secvențe de operațiuni incompatibile cu utilizarea legitimă și potrivirea șablonului pentru a recunoaște tehnici de manipulare cunoscute și noi. Compania utilizează clasificatori specializați care analizează intrările utilizatorilor pentru solicitări potențial dăunătoare și evaluează răspunsurile lui Claude înainte sau după livrare.

Implicații pentru Industrie

Campania a implicat un nivel fără precedent de autonomie a inteligenței artificiale în atacurile cibernetice și marchează ceea ce experții în securitate consideră a fi un punct de cotitură în spionajul cibernetic. Capacitatea sistemelor de inteligență artificială de a conduce atacuri sofisticate la viteza mașinilor, cu supraveghere umană minimă, ridică noi provocări pentru apărătorii securității cibernetice.

Dezvăluirea lui Anthropic vine într-un moment în care companiile de inteligență artificială se confruntă cu presiuni crescânde pentru a preveni utilizarea abuzivă a modelelor lor. Compania menține un program cuprinzător de informații despre amenințări și de protecție pentru a detecta și contracara utilizarea abuzivă a lui Claude, cu incidente de securitate documentate pe tot parcursul anului 2025. În martie, compania a identificat o operațiune de influență sub formă de serviciu care a utilizat Claude pentru a automatiza interacțiunea cu zeci de mii de conturi de social media din multiple țări și limbi.

Incidentul subliniază sofisticarea crescândă a instrumentelor împuternicite de inteligență artificială și provocările de a preveni abuzul lor, în timp ce se menține utilitatea pentru utilizatorii legitimi. Anthropic a interzis conturile asociate și continuă să îmbunătățească capacitățile sale de detectare și atenuare pentru a aborda peisajul de amenințări în evoluție.