Inteligență artificială

O introducere în Vertex AI

Având în vedere peisajul în evoluție rapidă al Inteligenței Artificiale, una dintre cele mai mari obstacole pe care liderii tehnici le întâlnesc adesea este trecerea de la a fi “experimentali” la a fi “gata pentru întreprindere”. În timp ce chatbot-urile pentru consumatori și o platformă interactivă ajută la imaginația publică, afacerile nu pot reuși doar cu o interfață de chat. Într-o eră în care concurența este mai agresivă ca niciodată, afacerile au nevoie de un ecosistem robust, scalabil și securizat, și acesta este ceea ce încearcă Google să ofere cu Vertex AI, platforma unificată de Inteligență Artificială și Învățare Automată a Google Cloud.

Vertex AI încearcă să se consolideze ca coloană vertebrală pentru integrarea Inteligenței Generative cu infrastructura cloud modernă, oferind o suită cuprinzătoare de funcții care acoperă golul dintre modelele de bază brute și aplicațiile de calitate de producție. Vertex AI nu este doar un ambalaj pentru mari modele de limbaj (LLM), ci mai degrabă un ecosistem unificat de Învățare Automată și Inteligență Artificială (ML/AI) care tratează Inteligența Generativă ca un cetățean de primă clasă al infrastructurii cloud moderne.

În inima Vertex AI se află Model Garden, un marketplace central care oferă acces la peste 200 de modele de bază curate, inclusiv puterea multi-modală Gemini 2.5 Pro, care are o fereastră de context de 2 milioane de tokeni. În acest articol, vom diseca arhitectura Vertex AI, vom explora modul în care Model Garden servește ca “App Store” pentru inteligență și vom examina stâlpii tehnici care fac această platformă coloana vertebrală a următoarei generații de software pentru întreprindere.

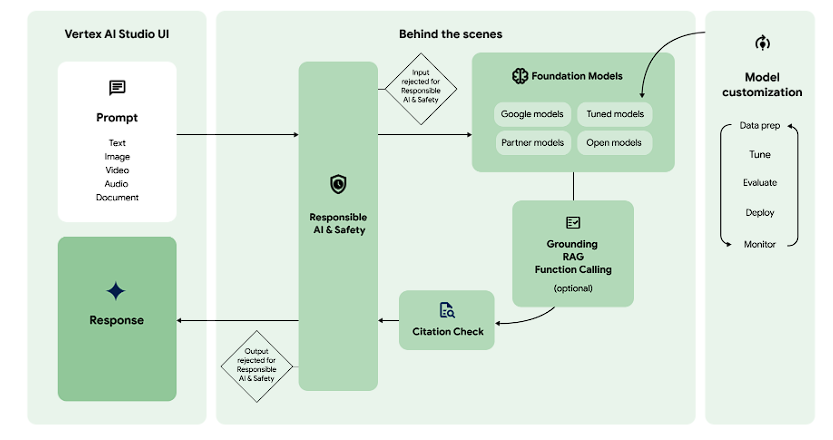

Arhitectura de bază: O platformă unificată

Vertex AI nu este o colecție de unelte slab cuplate, ci un ecosistem unificat de date și inteligență artificială proiectat pentru a acoperi fragmentarea datelor, instrumentelor și echipelor care afectează învățarea automată până în prezent. În mod tradițional, dezvoltarea inteligenței artificiale are loc în medii izolate, și uneori datele sunt răspândite și blocate în multiple depozite. De exemplu, organizațiile ar putea stoca datele clienților în depozite SQL, în timp ce documentele nestructurate sunt dumpate într-un lac de date. Când datele sunt izolate, inteligența artificială vede doar o “adevăr parțial”, ceea ce duce la rezultate biasate sau rate de halucinație ridicate, deoarece îi lipsește contextul complet al întreprinderii.

Vertex AI încearcă să integreze întregul ciclu de viață, de la ingestia de date brute în BigQuery și Cloud Storage la monitorizarea producției, servind practic ca “țesut de legătură” între aceste silozuri. Vertex AI se integrează nativ cu Cloud Storage și BigQuery, permițând modelului de inteligență artificială să recupereze datele fără pipeline-uri complexe de extragere, transformare și încărcare.

Baza: Hypercomputerul de inteligență artificială al Google

Stratul GenAI al Vertex AI se află deasupra arhitecturii de hypercomputer de inteligență artificială a Google, un sistem de supercalculatoare integrat, care constă în:

TPU v5p & v5e (Unități de procesare tensorială)

Unitățile de procesare tensorială ale Google sunt ASIC-uri (circuit integrate cu aplicație specifică) proiectate special pentru înmulțirea matricelor care definesc învățarea profundă.

- TPU v5p (Performanță): Acesta este acceleratorul de top pentru antrenarea la scară masivă. Fiecare pod TPU v5p poate fi escaladat la 8.960 de cipuri interconectate prin Inter-Chip Interconnect (ICI) de înaltă viteză de 4.800 Gbps. Pentru un lider tehnologic, acest lucru înseamnă o antrenare de 2,8 ori mai rapidă pentru un model de dimensiune GPT-3 (175 de miliarde de parametri) în comparație cu generația anterioară, reducând drastic timpul de lansare pe piață.

- TPU v5e (Eficiență): Proiectat pentru “performanță optimizată din punct de vedere al costurilor”, v5e este calul de lucru pentru antrenarea la scară medie și inferență de înaltă producție. Acesta oferă până la 2,5 ori mai bună performanță în funcție de preț, făcându-l alegerea ideală pentru afacerile care au nevoie să ruleze inferență 24/7 fără un buget masiv.

NVIDIA H100/A100 GPU pentru flexibilitate

În timp ce TPU-urile sunt specializate, multe echipe de dezvoltare se bazează pe ecosistemul NVIDIA CUDA. Vertex AI oferă suport de clasă întâi pentru noua generație de hardware NVIDIA:

- NVIDIA H100 (Hopper): Ideal pentru ajustarea modelelor deschise de mare anvergură (cum ar fi Llama 3.1 405B) care necesită o bandă de transfer de date masivă.

- Rețeaua Jupiter: Pentru a preveni “gâtuirea rețelei”, Google utilizează țesătura de rețea de centre de date Jupiter. Acest lucru asigură că datele se deplasează între GPU-uri la viteză de fulger, suportând RDMA (acces direct la memorie remote) pentru a ocoli suprasarcina CPU și a oferi o performanță aproape de cea locală pe noduri distribuite.

Orchestration dinamică

Schimbarea tehnică cea mai critică în Vertex AI este Orchestration dinamică. Într-un mediu legacy, dacă un nod GPU eșuează în timpul unei rulări de antrenament de 3 săptămâni, întregul job ar putea crasha.

- Reziliență automată: Vertex AI, adesea alimentat de Google Kubernetes Engine (GKE) sub capac, are noduri “auto-vindecătoare”. Dacă se detectează o defecțiune hardware, platforma migrează automat încărcarea de lucru către un nod sănătos.

- Planificator de încărcătură dinamic: Acest instrument permite echipelor să solicite capacitate în funcție de urgență. Puteți opta pentru Flex Start (mai ieftin, începe atunci când capacitatea este disponibilă) sau Capacitate garantată pentru lansări de misiune critică.

- Antrenament fără server: Pentru echipele care doresc zero gestionare a infrastructurii, Antrenamentul fără server al Vertex AI permite să își trimită codul și datele; platforma oferă clusterul, rulează jobul și îl demontează, taxându-vă doar pentru secundele de calcul utilizate.

Cele trei puncte de intrare: Descoperire, Experimentare și Automatizare

Pentru a se adapta la diferiți tehnicieni, de la oameni de știință din domeniul datelor la dezvoltatori de aplicații, Vertex AI oferă trei puncte de intrare principale:

- Model Garden: Piața pentru Descoperire.

- Vertex AI Studio: Locul de joacă pentru Experimentare.

- Vertex AI Agent Builder: Fabrica pentru Automatizare.

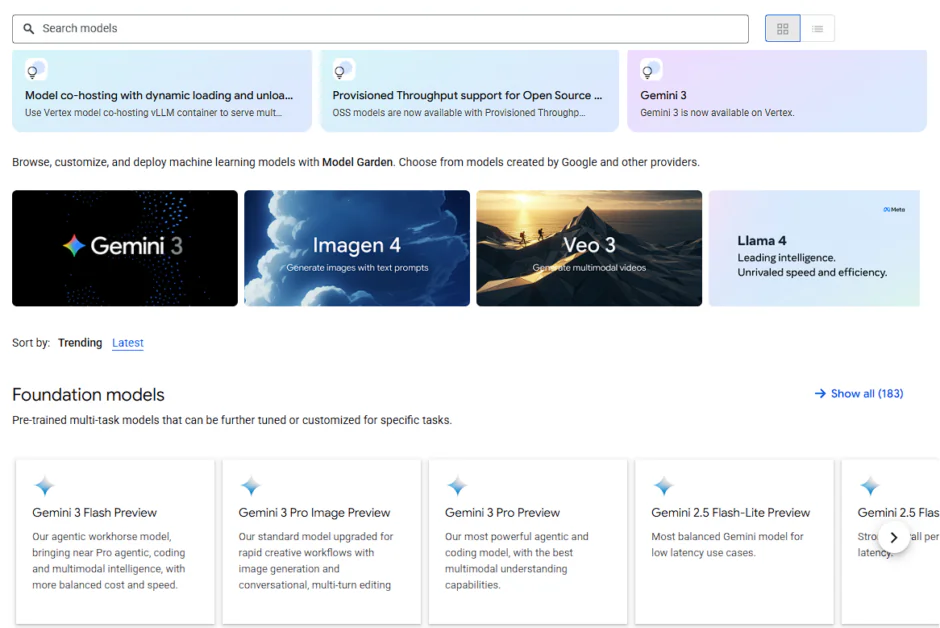

Model Garden: Piața pentru Descoperire

Model Garden al Google Cloud este o platformă centralizată în cadrul Google Cloud pentru descoperire, testare, personalizare și implementare a unei game largi de modele de inteligență artificială de primă parte, deschise și de a treia parte, inclusiv multimodale (vizuale, text, cod) pentru diverse nevoi de afaceri, oferind o integrare fără probleme cu instrumentele Vertex AI pentru operațiuni de învățare automată (MLOps) optimizate. Acesta acționează ca o bibliotecă cuprinzătoare, ajutând dezvoltatorii și afacerile să selecteze modelul potrivit (de la mari modele de bază la cele specializate) pentru sarcinile lor, indiferent dacă este vorba de generare de text, analiză de imagini sau completare de cod, și de a le implementa eficient în mediul Google Cloud.

Model Garden categorizează modelele sale de peste 200 în trei niveluri distincte, permițând arhitecților să echilibreze performanța, costul și controlul:

- Modele de primă parte (Google): Acestea sunt modelele multimodale de top disponibile în Vertex AI, și Google le oferă în diverse dimensiuni, de la Pro cu raționament complex la Flash cu latență scăzută și volum ridicat, permițând astfel dezvoltatorilor să optimizeze modelele în funcție de cazurile lor de utilizare.

- Modele de a treia parte (cu drepturi de autor): Prin parteneriate strategice, Vertex AI oferă acces “Model-as-a-Service” (MaaS) la giganți precum Anthropic (Claude 3.5) și Mistral AI. În loc de a gestiona credențiale de facturare și securitate separate pentru cinci furnizori de inteligență artificială diferiți, o echipă tehnică poate accesa toate acestea prin proiectul Google Cloud existent, utilizând un format de API unificat.

- Modele deschise și cu greutăți deschise: Acest nivel include Meta’s Llama 3.2, Mistral, și modelul propriu al Google, Gemma. Acestea sunt ideale pentru organizații care doresc să implementeze modele în propria rețea virtuală privată (VPC) pentru a asigura izolarea maximă a datelor.

Într-un mediu neunificat, implementarea unui model deschis precum Llama necesită configurarea unui mediu PyTorch, configurarea driverelor CUDA și gestionarea unui wrapper Flask sau FastAPI.

Model Garden elimină această fază de “prelucrare” prin intermediul Punctelor de capăt gestionate unificate:

- Implementare cu un singur clic: Pentru multe modele, clicul pe “Implementare” provoacă automat provisionarea resurselor TPU/GPU necesare, ambalează modelul într-un container gata de producție și oferă un punct de capăt API REST.

- Integrare Hugging Face: Vertex AI permite acum dezvoltatorilor să implementeze modele direct din Hugging Face Hub într-un punct de capăt Vertex, oferind o extindere aproape infinită a inteligenței disponibile.

- Conectare privată de servicii (PSC): Pentru industrii puternic reglementate, modelele pot fi implementate utilizând Conectarea privată de servicii, asigurând că punctul de capăt al modelului nu este expus niciodată la internetul public, ținând astfel traficul de date strict în interiorul rețelei corporative.

Vertex AI Studio: Locul de joacă pentru Experimentare

În timp ce Model Garden se concentrează pe selecție, Vertex AI Studio se concentrează pe precizie. Vertex AI Studio poate fi comparat cu compilatoarele și depanatoarele pe care le întâlniți în lumea software-ului tradițional. Studio-ul Vertex AI este spațiul de lucru în care modelele brute sunt sculptate în unelte de afaceri specifice prin intermediul unei combinații de inginerie de prompt, testare multimodală și reglare avansată a hiperparametrilor.

Prototipare multimodală: Dincolo de text

Una dintre funcțiile deosebite ale Studio-ului este suportul său nativ pentru multimodalitate. În timp ce alte platforme necesită codificare complexă pentru a gestiona datele non-text, Vertex AI Studio vă permite să adăugați fișiere direct în interfață pentru a testa capacitățile de raționament Gemini 2.5.

- Inteligență video: Puteți încărca o cheie tehnică de 45 de minute și cere modelului să “identifice de fiecare dată când este menționat un anumit API și să furnizeze un rezumat cu timestamp.”

- Analiză de documente: În loc de a citi doar textul, modelul poate analiza aspectul vizual al unui PDF de 1.000 de pagini, înțelegând relația dintre grafice, tabele și textul înconjurător.

- Execuția codului: Studio-ul suportă acum execuția codului în locul de joacă. Dacă cereți modelului să rezolve o problemă matematică complexă sau să analizeze un CSV, modelul poate scrie și executa cod Python într-un mediu sigur și izolat pentru a furniza un răspuns verificat.

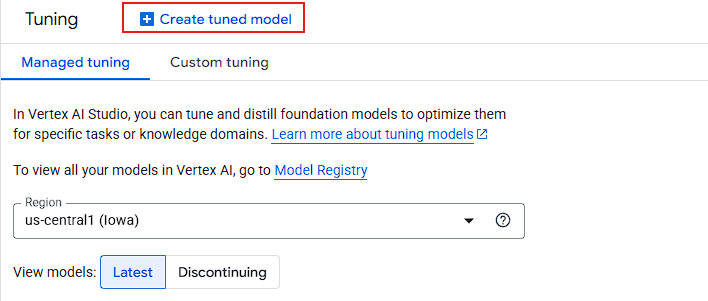

Personalizare avansată: Calea de reglare

Când ingineria promptului (Zero-shot sau Few-shot) atinge un plafon, Vertex AI Studio oferă utilajul greu: Reglarea modelului.

- Reglare fină supravegheată (SFT): Dezvoltatorii furnizează un set de date de “perechi de prompt/răspuns” (ideal 100+ exemple). Acest lucru învață modelul să adopte o voce specifică a mărcii, un format de ieșire (cum ar fi JSON specializat) sau jargon specific domeniului.

- Cache de context: Pentru întreprinderi care se ocupă de seturi de date masive și statice (cum ar fi o bibliotecă juridică sau o bază de cod), Studio-ul permite cache de context. Acest lucru permite “încărcarea prealabilă” a unui milion de tokeni de date în memoria modelului, reducând drastic latența și costurile pentru interogări ulterioare.

- Distilare (profesor-elev): Acesta este un pas arhitectural de nivel înalt. Puteți utiliza un model masiv (Gemini 2.5 Pro) pentru a “învața” un model mai mic și mai rapid (Gemini 2.0 Flash). Rezultatul este un model ușor care se execută la nivel “Pro” dar rulează la viteza și costul “Flash”.

Vertex AI Agent Builder: Fabrica pentru Automatizare

Vertex AI Agent Builder este un cadru de orchestrare de nivel înalt care permite dezvoltatorilor să creeze acești agenți prin combinarea modelelor de bază cu datele întreprinderii și API-urile externe.

Arhitectura “Adevărului”: Încărcare și RAG

Barierele tehnice principale pentru inteligența artificială a întreprinderii sunt halucinația. Agent Builder rezolvă acest lucru prin intermediul unui motor de încărcare sofisticat.

- Încărcare cu Google Search: Pentru interogări care necesită cunoștințe din lumea reală în timp real (de exemplu, “Care sunt ratele actuale ale ipotecilor în New York?”), agentul poate efectua o căutare Google, extrage faptele și citează sursele.

- Vertex AI Search (RAG-ca-serviciu): În loc de a construi manual o bază de date vectorială (Pinecone, Weaviate), dezvoltatorii pot utiliza Vertex AI Search pentru a indexa propriile documente (PDF, HTML, BigQuery). Acesta gestionează “îmbucătirea”, “încorporarea” și “recuperarea” automat, asigurând că agentul răspunde doar pe baza “Sursei de Adevăr” internă.

- Motor RAG Vertex AI: Pentru implementări personalizate la scară largă, acest serviciu gestionat permite o căutare hibridă (combinând rezultate vectoriale și cuvânt cheie) pentru a îmbunătăți precizia cu până la 30% față de ieșirile standard LLM.

Orchestration multi-agent (Protocol A2A)

Fluxurile de lucru avansate ale întreprinderii necesită adesea mai mulți agenți specializați care lucrează împreună. Vertex AI introduce Protocolul Agent-la-Agent (A2A), un standard deschis care permite:

- “Agentul de călătorie” să vorbească cu “Agentul financiar” pentru a se asigura că o rezervare de zbor se încadrează în bugetul corporativ.

- Interoperabilitate: Deoarece utilizează un protocol deschis, agenții construiți pe Vertex pot comunica cu cei construiți pe alte cadre, cum ar fi LangChain sau CrewAI.

Stiva de dezvoltare: ADK și Motor de agenți

Pentru “publicul platformei tehnice”, Agent Builder oferă două căi distincte:

- Consolă fără cod: O interfață vizuală de tragere și plasare pentru prototiparea rapidă și configurarea utilizatorilor de afaceri.

- Pachet de dezvoltare de agenți (ADK): Un kit de dezvoltare “codul în primul rând” pentru ingineri. Acesta permite “Prompt-ca-cod”, integrare cu controlul versiunii și capacitatea de a implementa în Motorul de agenți Vertex AI—un mediu de rulare gestionat care gestionează persistența sesiunii, escaladarea și gestionarea stării automat.

Concluzie: De la “Ce-ar fi dacă” la “Ce urmează”

Trecerea de la o demonstrație de inteligență artificială spectaculoasă la o aplicație de întreprindere de calitate de producție a fost mult timp “valea morții” pentru proiectele de transformare digitală. Așa cum am explorat, Vertex AI este proiectat special pentru a acoperi acest decalaj. Prin unificarea silozurilor fragmentate de date, infrastructură și orchestrare de modele, Google Cloud a mutat conversația de la puterea brută a modelelor de limbaj mari și către maturitatea operațională a ciclului de viață al inteligenței artificiale.