Inteligență artificială

Un verificator de bias bazat pe IA pentru articole de știri, disponibil în Python

Cercetători din Canada, India, China și Australia au colaborat pentru a produce un pachet Python gratuit care poate fi utilizat eficient pentru a detecta și înlocui “limbajul injust” în copiile de știri.

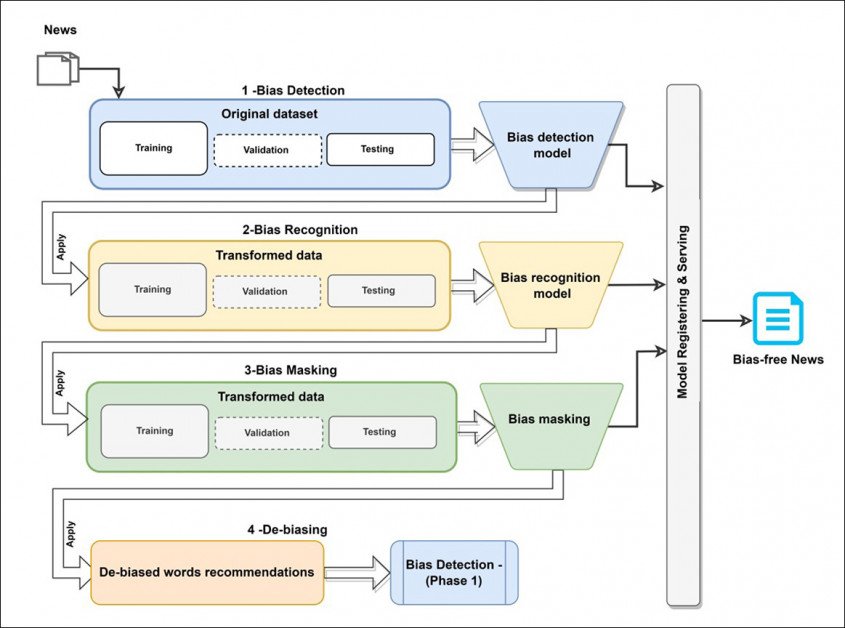

Sistemul, intitulat Dbias, utilizează diverse tehnologii de învățare automată și baze de date pentru a dezvolta un flux de lucru circular în trei etape care poate rafina textul biasat până când returnează o versiune neutră sau cel puțin mai neutră.

Limbajul încărcat într-un fragment de știri identificat ca ‘biasat’ este transformat într-o versiune mai puțin incendiară de Dbias. Sursă: https://arxiv.org/ftp/arxiv/papers/2207/2207.03938.pdf

Sistemul reprezintă o conductă reutilizabilă și autoconținută care poate fi instalată prin Pip de la Hugging Face și integrată în proiecte existente ca o etapă suplimentară, un add-on sau un plugin.

În aprilie, o funcționalitate similară implementată în Google Docs a fost criticată, nu în ultimul rând pentru lipsa de editare. Dbias, pe de altă parte, poate fi mai selectiv antrenat pe orice corpus de știri pe care utilizatorul final o dorește, păstrând capacitatea de a dezvolta linii directoare de echitate personalizate.

Diferența critică este că pipeline-ul Dbias este destinat să transforme automat “limbajul încărcat” (cuvinte care adaugă un strat critic comunicării factuale) în limbaj neutrul sau prozaic, mai degrabă decât să instruiască utilizatorul în mod continuu. În esență, utilizatorul final va defini filtre etice și va antrena sistemul în consecință; în abordarea Google Docs, sistemul este – în mod evident – antrenat de utilizator, într-o manieră unilaterală.

Arhitectură conceptuală pentru fluxul de lucru Dbias.

Conform cercetătorilor, Dbias este primul pachet de detectare a bias-ului cu adevărat configurabil, în contrast cu proiectele de asamblare off-the-shelf care au caracterizat acest subsector al Procesării Limbajului Natural (NLP) până în prezent.

Noul articol se intitulează O abordare pentru a asigura echitatea în articolele de știri și provine de la contributori de la Universitatea din Toronto, Universitatea Metropolitană Toronto, Environmental Resources Management din Bangalore, Academia DeepBlue de Științe din China și Universitatea din Sydney.

Metodă

Prima modulă din Dbias este Detectarea bias-ului, care utilizează pachetul DistilBERT – o versiune foarte optimizată a BERT de la Google. Pentru proiect, DistilBERT a fost fin-tunned pe setul de date Media Bias Annotation (MBIC).

MBIC constă în articole de știri din diverse surse media, inclusiv Huffington Post, USA Today și MSNBC. Cercetătorii au utilizat versiunea extinsă a setului de date.

Deși datele originale au fost annotate de lucrători crowdfundati (o metodă care a fost criticată la sfârșitul anului 2021), cercetătorii noului articol au putut identifica instanțe suplimentare neanotate de bias în setul de date și le-au adăugat manual. Incidențele identificate de bias s-au referit la rasă, educație, etnie, limbă, religie și gen.

Următoarea modulă, Recunoașterea bias-ului, utilizează Named Entity Recognition (NER) pentru a individualiza cuvintele biasate din textul de intrare. Articolul afirmă:

‘De exemplu, știrile “Nu cumpărați hype-ul pseudo-științific despre tornade și schimbările climatice” au fost clasificate ca biasate de modulul de detectare a bias-ului anterior, și modulul de recunoaștere a bias-ului poate acum identifica termenul “hype pseudo-științific” ca un cuvânt biasat.’

NER nu este proiectat în mod specific pentru această sarcină, dar a fost utilizat anterior pentru identificarea bias-ului, în special pentru un proiect din 2021 de la Universitatea Durham din Regatul Unit.

Pentru această etapă, cercetătorii au utilizat RoBERTa combinat cu pipeline-ul SpaCy English Transformer NER.

Următoarea etapă, Mascherea bias-ului, implică o mască multiplă a cuvintelor biasate identificate, care funcționează secvențial în cazul mai multor cuvinte biasate identificate.

Limbajul încărcat este înlocuit cu limbajul pragmatic în a treia etapă a Dbias. Notați că ‘mouthing’ și ‘using’ echivalează cu aceeași acțiune, deși primul este considerat peiorativ.

În funcție de necesitate, feedback-ul din această etapă va fi trimis înapoi la începutul pipeline-ului pentru o evaluare suplimentară până când sunt generate un număr de frazări sau cuvinte alternative adecvate. Această etapă utilizează Modelarea Limbajului Mascat (MLM) de-a lungul liniilor stabilite de o colaborare din 2021 condusă de Facebook Research.

În mod normal, sarcina MLM va masca 15% din cuvinte în mod aleator, dar fluxul de lucru Dbias spune procesului să ia cuvintele biasate identificate ca intrare.

Arhitectura a fost implementată și antrenată pe Google Colab Pro pe un NVIDIA P100 cu 24GB de VRAM la o dimensiune de lot de 16, utilizând doar două etichete (biasat și nebiasat).

Teste

Cercetătorii au testat Dbias împotriva a cinci abordări comparabile: LG-TFIDF cu Regressie Logistică și TfidfVectorizer (TFIDF) încorporări de cuvinte; LG-ELMO; MLP-ELMO (o rețea neurală artificială feed-forward care conține încorporări ELMO); BERT; și RoBERTa.

Metricile utilizate pentru testele au fost acuratețea (ACC), precizia (PREC), rechemarea (Rec) și un scor F1. Deoarece cercetătorii nu aveau cunoștințe despre vreun sistem existent care ar putea realiza toate cele trei sarcini într-un singur pipeline, s-a făcut o dispensă pentru cadrele concurente, prin evaluarea doar a sarcinilor principale ale Dbias – detectarea și recunoașterea bias-ului.

Rezultatele testelor Dbias.

Dbias a reușit să depășească rezultatele tuturor cadrului concurent, inclusiv cele cu o amprentă de procesare mai grea

Articolul afirmă:

‘Rezultatul arată, de asemenea, că încorporările neuronale profunde pot depăși metodele de încorporare tradiționale (de exemplu, TFIDF) în sarcina de clasificare a bias-ului. Acest lucru este demonstrat de performanța mai bună a încorporărilor neuronale profunde (de exemplu, ELMO) în comparație cu vectorizarea TFIDF atunci când este utilizată cu LG. ‘

‘Acest lucru se datorează probabil faptului că încorporările neuronale profunde pot capta mai bine contextul cuvintelor în text în diferite contexte. Încorporările neuronale profunde și metodele neuronale profunde (MLP, BERT, RoBERTa) performează, de asemenea, mai bine decât metodele ML tradiționale (LG).’

Cercetătorii observă, de asemenea, că metodele bazate pe Transformer depășesc metodele concurente în detectarea bias-ului.

Un test suplimentar a implicat o comparație între Dbias și diverse variante ale SpaCy Core Web, inclusiv core-sm (mic), core-md (mediu) și core-lg (mare). Dbias a condus și în aceste teste:

Cercetătorii concluzionează prin observarea că sarcinile de recunoaștere a bias-ului arată, în general, o acuratețe mai bună în modelele mai mari și mai scumpe, din cauza – speculează ei – numărului crescut de parametri și puncte de date. Ei observă, de asemenea, că eficacitatea lucrărilor viitoare în acest domeniu va depinde de eforturi mai mari pentru a anota seturi de date de înaltă calitate.

Pădurea și copacii

Sperăm că acest tip de proiect de recunoaștere a bias-ului fin va fi în cele din urmă integrat în cadre de căutare a bias-ului care pot lua o vedere mai puțin mioapă și care pot lua în considerare faptul că alegerea de a acoperi orice poveste în sine este un act de bias care este posibil condus de mai mult decât doar statistici de vizualizare raportate.

Publicat pentru prima dată pe 14 iulie 2022.