Inteligență artificială

Modificarea Emoțiilor în Imagini Video cu Ajutorul Inteligenței Artificiale

Cercetători din Grecia și Regatul Unit au dezvoltat o abordare inovatoare de învățare profundă pentru a schimba expresiile și starea de spirit aparentă a oamenilor în imagini video, în timp ce păstrează fidelitatea mișcărilor buzelor față de sunetul original într-un mod în care încercările anterioare nu au putut să o egaleze.

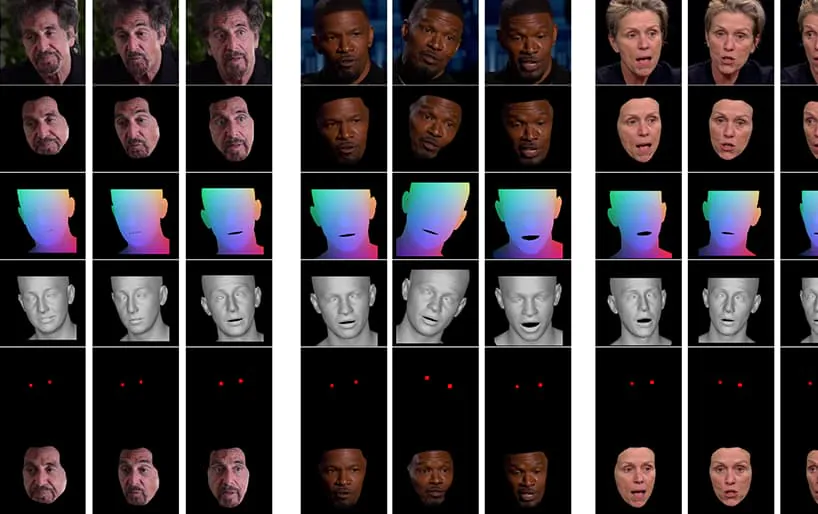

Din videoclipul care însoțește articolul (încorporat la sfârșitul acestui articol), o scurtă secvență cu actorul Al Pacino având expresia sa subtil modificată de NED, pe baza unor concepte semantice de nivel înalt care definesc expresii faciale individuale și emoțiile asociate. Metoda ‘Reference-Driven’ de pe partea dreaptă ia emoțiile interpretate ale unui videoclip sursă și le aplică întregii secvențe de videoclip. Sursa: https://www.youtube.com/watch?v=Li6W8pRDMJQ

Acest domeniu particular se încadrează în categoria în creștere a emoțiilor deepfaked, unde identitatea vorbitorului original este păstrată, dar expresiile și micro-expresiile sale sunt modificate. Pe măsură ce această tehnologie de inteligență artificială se maturizează, ea oferă posibilitatea producțiilor de film și televiziune de a face modificări subtile ale expresiilor actorilor – dar deschide și o categorie nouă de ‘video deepfaked cu emoții modificate’.

Schimbarea Fețelor

Expresiile faciale ale unor persoane publice, cum ar fi politicienii, sunt atent curate; în 2016, expresiile faciale ale lui Hillary Clinton au fost supuse unei atente scrutinizări din partea mass-mediei pentru impactul lor potențial negativ asupra perspectivei electorale; expresiile faciale, se pare, sunt și un subiect de interes pentru FBI; și ele sunt un indicator critic în interviurile de angajare, făcând ca perspectiva unei filtre ‘control expresie’ live să fie un dezvoltare dorită pentru cei care caută un loc de muncă și încearcă să treacă prin pre-selecția pe Zoom.

Un studiu din 2005 din Regatul Unit a afirmat că apariția facială influențează deciziile de vot, în timp ce o caracteristică din 2019 a Washington Post a examinat utilizarea clipurilor video ‘în afara contextului’, care este în prezent cea mai apropiată lucruri pe care susținătorii știrilor false le pot face pentru a schimba modul în care o persoană publică pare să se comporte, să răspundă sau să se simtă.

Spre Manipularea Neurală a Expresiilor

În acest moment, stadiul actual al manipulării afectului facial este destul de rudimentar, deoarece implică abordarea disentanglementului conceptelor de nivel înalt (cum ar fi trist, furios, fericit, zâmbind) din conținutul video real. Deși arhitecturile tradiționale de deepfake par să obțină acest disentanglement foarte bine, reflectarea emoțiilor pe diferite identități necesită ca două seturi de antrenare cu fețe să conțină expresii corespunzătoare pentru fiecare identitate.

Exemple tipice de imagini cu fețe în seturile de date utilizate pentru a antrena deepfake-uri. În prezent, puteți modifica expresia facială a unei persoane doar prin crearea unor căi de expresie la expresie specifice identității într-o rețea neurală de deepfake. Software-ul de deepfake din 2017 nu are o înțelegere intrinsică, semantică a unui ‘zâmbet’ – el doar asociază și potrivește schimbări percepute în geometria facială între cei doi subiecți.

Ce este de dorit și nu a fost încă realizat perfect este să recunoaștem cum subiectul B (de exemplu) zâmbește și pur și simplu să creăm un ‘comutator de zâmbet’ în arhitectură, fără a trebui să o asociem cu o imagine echivalentă a subiectului A zâmbind.

Articolul nou se intitulează Neural Emotion Director: Control semantic al expresiilor faciale în videoclipuri ‘in-the-wild’ care păstrează sunetul și provine de la cercetători de la Școala de Inginerie Electrică și Informatică de la Universitatea Tehnică Națională din Atena, Institutul de Informatică de la Fundația pentru Cercetare și Tehnologie Hellas (FORTH) și Colegiul de Inginerie, Matematică și Științe Fizice de la Universitatea din Exeter din Regatul Unit.

Echipa a dezvoltat un cadru numit Neural Emotion Director (NED), care incorporează o rețea de traducere a emoțiilor bazată pe 3D, 3D-Based Emotion Manipulator.

NED ia o secvență primită de parametri de expresie și o traduce într-un domeniu țintă. Este antrenat pe date neordonate, ceea ce înseamnă că nu este necesar să se antreneze pe seturi de date în care fiecare identitate are expresii faciale corespunzătoare.

Videoclipul, prezentat la sfârșitul acestui articol, rulează printr-o serie de teste în care NED impune o stare emoțională aparentă pe imagini video din setul de date YouTube.

Autorii afirmă că NED este prima metodă video pentru ‘regizarea’ actorilor în situații imprevizibile și neprevăzute și au făcut codul disponibil pe pagina proiectului NED.

Metodă și Arhitectură

Sistemul este antrenat pe două seturi mari de date video care au fost annotate cu etichete ’emoție’.

Ieșirea este posibilă datorită unui renderer de fețe video care renderizează emoția dorită în video folosind tehnici tradiționale de sinteză a imaginilor faciale, incluzând segmentarea feței, alinierea reperelor faciale și amestecarea, unde doar zona facială este sintetizată și apoi impusă peste imaginea originală.

Arhitectura pipeline-ului Neural Emotion Detector (NED). Sursa: https://arxiv.org/pdf/2112.00585.pdf

Inițial, sistemul obține recuperarea facială 3D și impune alinierea reperelor faciale pe cadrul de intrare pentru a identifica expresia. După aceea, acești parametri de expresie recuperați sunt trimiși către 3D-Based Emotion Manipulator, și un vector de stil calculat prin intermediul unei etichete semantice (cum ar fi ‘fericit’) sau printr-un fișier de referință.

Un fișier de referință este un videoclip care prezintă o expresie/emotie recunoscută, care este apoi impusă asupra întregului videoclip țintă, înlocuind expresia originală.

Etapele pipeline-ului de transfer al emoțiilor, cu actori diferiți eșantionați din videoclipuri YouTube.

Forma finală generată a feței 3D este apoi concatenată cu coordonatele feței medii normalizate (NMFC) și imaginile ochilor (punctele roșii din imaginea de mai sus), și trimisă renderer-ului neural, care efectuează manipularea finală.

Rezultate

Cercetătorii au efectuat studii extinse, incluzând studii ale utilizatorilor și ablației, pentru a evalua eficacitatea metodei față de lucrările anterioare și au constatat că, în majoritatea categoriilor, NED depășește stadiul actual al tehnicii în acest subsector al manipulării faciale neurale.

Autorii articolului prevăd că implementările ulterioare ale acestei lucrări și unelte de natură similară vor fi utile în primul rând în industriile de televiziune și cinematografie, afirmând:

‘Metoda noastră deschide o mulțime de noi posibilități pentru aplicații utile ale tehnologiilor de render neural, de la post-producția de film și jocuri video la avatare afective foto-reale.’

Acesta este un lucru timpuriu în domeniu, dar unul dintre primele care încearcă reînregistrarea facială cu videoclipuri și nu cu imagini statice. Deși videoclipurile sunt, în esență, multe imagini statice care rulează foarte repede, există considerații temporale care fac aplicarea anterioară a transferului de emoții mai puțin eficientă. În videoclipul care însoțește articolul și exemplele din articol, autorii includ comparații vizuale ale ieșirii NED față de alte metode recente comparabile.

Mai multe comparații detaliate și multe alte exemple ale NED pot fi găsite în videoclipul complet de mai jos:

3 decembrie 2021, 18:30 GMT+2 – La cererea unuia dintre autorii articolului, s-au făcut corecții cu privire la ‘fișierul de referință’, pe care l-am menționat greșit ca fiind o fotografie statică (când, de fapt, este un clip video). De asemenea, s-a făcut o modificare a numelui Institutului de Informatică de la Fundația pentru Cercetare și Tehnologie.

3 decembrie 2021, 20:50 GMT+2 – O a doua solicitare de la unul dintre autorii articolului pentru o amendament suplimentar asupra numelui instituției menționate mai sus.