Unghiul lui Anderson

Inteligența Artificială Preferă Să Citească Cartea Decât Să Vizioneze Filmul

Este surprinzător de greu să determini modelele de inteligență artificială să urmărească și să comenteze conținutul video real, chiar dacă sunt create pentru această sarcină. Ele sunt mai interesate de cuvântul scris.

Dacă ai încercat vreodată să încarci un clip video mic în ChatGPT sau într-un model de viziune/limbaj popular similar, este posibil să fi fost surprins să realizezi că acestea nu pot, de fapt, să analizeze videoclipul. În timp ce modele precum ChatGPT-4o+ sunt capabile să analizeze cadrele individuale – sub formă de imagini, cum ar fi JPEG și PNG – ele preferă ca utilizatorul să extragă singur cadrele și să le încarce sub formă de imagini (pe care le sunt pregătite să le comenteze).

În cazul seriei OpenAI GPT, se poate, destul de laborios, extrage o serie completă de cadre dintr-un clip video și să le alimenteze în ChatGPT, în scopul, de exemplu, generării unei narative create de inteligență artificială pentru videoclip:

![Imagini și cod dintr-un tutorial OpenAI despre analiza mai multor cadre extrase în scopul dezvoltării unui comentariu generat de inteligență artificială pentru un clip video. [ Sursă ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

Imagini și cod dintr-un tutorial OpenAI despre analiza mai multor cadre extrase în scopul dezvoltării unui comentariu generat de inteligență artificială pentru un clip video. Sursă

Dar revine utilizatorului să facă conversia de la video la cadre, fie prin apelarea funcțiilor într-o rutină mai mare, așa cum se arată în exemplul de mai sus, fie prin extragerea cadrelor cu FFMPEG sau diverse soluții de editare video gratuite și cu plată.

Într-o anumită măsură, poate chiar într-o măsură mare, limitările analizei video în produse de mare scară, cum ar fi ChatGPT, se bazează pe utilizarea resurselor: dotarea unei singure instanțe de inteligență artificială cu o selecție de codificatori video populari și alocarea resurselor de calcul pentru procesul greoi și care consumă CPU al extragerii, nu este o considerație minoră, în cazul în care sute de milioane de utilizatori decid să înceapă să utilizeze aceste facilități în fiecare zi.

În plus, analiza temporală poate picta o imagine foarte diferită decât un singur cadru (imaginați-vă pe cineva care intră într-o casă într-o dispoziție veselă și apoi descoperă un cadavru); prin urmare, luarea în considerare a întregului “checksum” temporal al unui videoclip scurt este o sarcină solicitantă și consumatoare de resurse – precum și o zonă specializată a literaturii de cercetare, de exemplu cu dezvoltarea continuă a cadrului Optical Flow – care, în esență, “desfășoară” o lungime de videoclip, astfel încât acesta să poată fi considerat și acționat ca și cum ar fi un document static:

![Diagramele de flux optic evidențiază modul în care mișcarea este urmărită pe cadre într-o secvență de videoclip, cu vectori verzi care arată direcția și intensitatea mișcării. Aceste hărți furnizează continuitatea temporală necesară pentru VLM și pot servi, de asemenea, ca ghiduri structurale în fluxurile de lucru VFX. [ Sursă ] https://www.researchgate.net/figure/Optical-flow-field-vectors-shown-as-green-vectors-with-red-end-points-before-and-after_fig6_290181771](https://www.unite.ai/wp-content/uploads/2025/10/optical-flow.jpg)

Diagramele de flux optic evidențiază modul în care mișcarea este urmărită pe cadre într-o secvență de videoclip, cu vectori verzi care arată direcția și intensitatea mișcării. Aceste hărți furnizează continuitatea temporală necesară pentru VLM și pot servi, de asemenea, ca ghiduri structurale în fluxurile de lucru VFX. Sursă

Stabilirea pentru Rezumat

Cu toate acestea, deoarece modele precum Notebook LM de la Google și intrările ChatGPT mai recente pot citi metadate asociate (adică conținut de text încorporat care contextualizează videoclipul într-un anumit mod), ele nu interzic încărcarea fișierelor video; și, uneori, ele vor încerca chiar să interpreteze un videoclip care nu are astfel de date.

În următorul caz, am încărcat un clip de 6 secunde, aleatoriu, din filmul italian Mâna lui Dumnezeu (2021) în NotebookLM, asigurându-mă că clipul nu conținea niciun text util, nici în metadate, nici în numele fișierului.

NotebookLM a procedat apoi să elaboreze material complet nerealist și fără legătură cu videoclipul*, inclusiv un podcast nonsens și fără legătură de cinci minute:

Un moment obișnuit într-un clip de 6 secunde dintr-un film italian este complet greșit interpretat de NotebookLM. Sursă: Google NotebookLM

Deși Notebook, la fel ca ChatGPT, va accepta un videoclip de pe YouTube ca intrare, va face acest lucru doar dacă videoclipul prezintă o anotare text-layer interpretabilă și/sau subtitrări (nu subtitrări rasterizate care sunt arse în videoclip).

În acest fel, munca grea de a privi cu adevărat conținutul videoclipului și de a efectua o interpretare semantică a acestuia (o necesitate legală pentru YouTube, din cauza măsurilor de protecție a drepturilor de autor, și a sistemului de protecție a identității în așteptare), a fost făcută la îndemână după încărcarea utilizatorului, atunci când clipul putea fi alocat resurselor de procesare necesare.

Interpretarea reală a videoclipului este scumpă și epuizantă, și, se pare, chiar și modelele care au fost antrenate în mod special pentru a efectua această sarcină preferă să citească textul decât să privească cu adevărat videoclipul.

TL;DW

Acest lucru, conform unui nou articol de la Universitatea din Bristol din Regatul Unit, intitulat Un videoclip nu este la fel de valoros ca o mie de cuvinte, în care cei doi autori concluzionează că modelele actuale de vârf ale modelelor de limbaj de viziune (VLM) – modele special concepute pentru a putea analiza videoclipuri într-un mod mai efortat și pentru a participa la răspunsuri la întrebări video (VQA) – se bazează, de asemenea, pe informații textuale atunci când este posibil.

Când li s-au prezentat atât imagini în mișcare, cât și întrebări și răspunsuri cu multiple variante, autorii articolului au constatat că modelele s-au bazat, de obicei, pe modele din text, mai degrabă decât pe ceea ce se întâmpla pe ecran – în multe cazuri, realizând la fel de bine chiar și atunci când întrebarea era eliminată complet.

În ceea ce pare a fi o formă obișnuită de scurtătură sau înșelăciune, ceea ce conta mai mult pentru majoritatea modelelor era capacitatea de a detecta modele în răspunsurile posibile; abia atunci când sarcina a fost făcută mai grea, prin adăugarea de opțiuni de răspuns suplimentare, inteligența artificială a început să acorde mai multă atenție videoclipului.

Autorii au oferit teste VQA în diferite condiții la șase modele VLM cu diverse lungimi de context, pe patru seturi de date adecvate; și au constatat că rezultatele indică dependența modelelor de text față de conținutul video.

![Exemplu din studiu care arată cum un model de analiză a videoclipului cântărește ceea ce vede versus ceea ce citește. Clipul arată o persoană care împleteste bambus, dar modelul atribuie mult mai multă importanță textului întrebării și răspunsului scris decât cadrelor videoclipului în sine. Vârfurile albastre marchează elemente care susțin răspunsul ales, în timp ce vârfurile roșii marchează cele care îl atrag în direcția opusă, ilustrând modul în care raționamentul modelului se bazează pe text, mai degrabă decât pe imagini în mișcare. [ Sursă ] https://arxiv.org/pdf/2510.23253](https://www.unite.ai/wp-content/uploads/2025/10/evaluation.jpg)

Exemplu din studiu care arată cum un model de analiză a videoclipului cântărește ceea ce vede versus ceea ce citește. Clipul arată o persoană care împleteste bambus, dar modelul atribuie mult mai multă importanță textului întrebării și răspunsului scris decât cadrelor videoclipului în sine. Vârfurile albastre marchează elemente care susțin răspunsul ales, în timp ce vârfurile roșii marchează cele care îl atrag în direcția opusă, ilustrând modul în care raționamentul modelului se bazează pe text, mai degrabă decât pe imagini în mișcare. Sursă

Metodă

Pentru a înțelege cât contribuie fiecare intrare la decizia unui model, noul studiu utilizează o metodă din teoria jocurilor numită Valori Shapley. Inițial concepută pentru a împărți în mod corect o plată între jucători într-o coaliție, Valorile Shapley atribuie credit fiecărui “jucător” pe baza impactului său individual.

În esență, jucătorii în acest scenariu sunt fie cadrele videoclipului, fie componentele text (anotări, subtitrări, titluri etc.) ale unei sarcini VQA; și “plata” este răspunsul final al modelului. Prin testarea sistematică a ceea ce se întâmplă atunci când fiecare parte este adăugată sau eliminată, tehnica revelează cât de importantă a fost acea componentă pentru a ajunge la răspunsul ales.

În cazul noului proiect, pentru a extinde metoda la multiple tipuri de date, Valorile Shapley au fost adaptate pentru a gestiona modalități mixte, cu componente video și text tratate distinct, și influența lor variabilă asupra ieșirilor modelului măsurată, dezvăluind dacă conținutul videoclipului a fost cu adevărat interpretat sau dacă indicii textuali au fost utilizați ca scurtături.

Metrice

Două metrice simple au fost definite pentru a compara cât contribuie fiecare modalitate (adică, video, întrebare sau răspuns) la decizia modelului: Contribuția Modalității măsoară cât din explicația totală provine din fiecare tip de intrare; aici, toate valorile Shapley disponibile sunt sumate, iar cota care aparține fiecărei modalități este calculată ca procent din total.

În al doilea rând, Contribuția pe Caracteristică corectează faptul că unele modalități, cum ar fi videoclipul, conțin mult mai multe caracteristici decât altele. În schimb, valoarea Shapley medie este calculată pentru fiecare caracteristică, iar aceste medii sunt comparate pentru a determina care modalitate are o influență dominantă.

Date și Teste

Autorii au testat abordarea pe șase modele VLM cu caracteristici diverse, concepute pentru a asigura că principiile testelor sunt aplicabile și generalizabile. Prin urmare, modelele au fost alese pentru lungimi de context diferite, vârste diferite (adică, cât timp de la lansarea cadrului) și configurări arhitecturale diferite.

Candidații au fost FrozenBiLM; InternVideo; VideoLLaMA2; VideoLLaMA3; LLaVa-Video (care utilizează Qwen2); și LongVA (care utilizează, de asemenea, Qwen2).

Cu același scop de a avea o varietate diversă, cele patru seturi de date țintă alese au fost EgoSchema, un set de date VQA conceput pentru a fi imposibil de completat fără vizionarea completă a videoclipurilor asociate; HD-EPIC, un set de date axat pe bucătărie, care prezintă unele videoclipuri neobișnuit de lungi; MVBench, o colecție curată de contribuții din alte seturi de date; și LVBench, care pune întrebări VQA pentru videoclipuri foarte lungi.

De aici, autorii au conceput 60 de întrebări – zece din fiecare tip de întrebare.

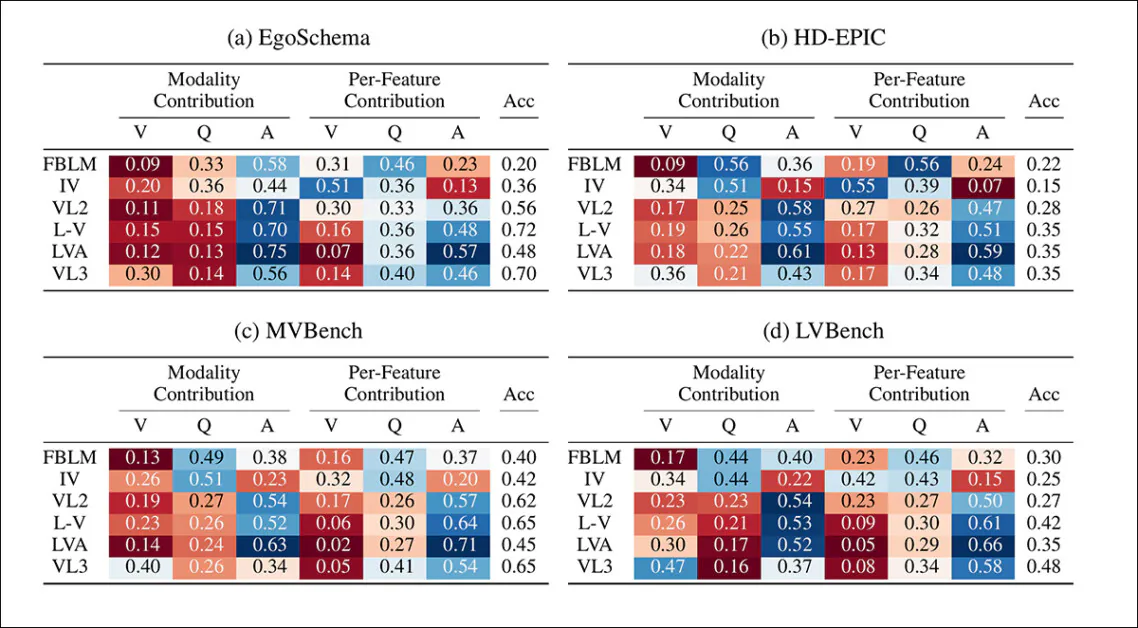

Metricile de contribuție au făcut clar că majoritatea modelelor s-au bazat mai puțin pe videoclip decât pe text, mai ales atunci când au fost judecate cadru cu cadru. Chiar și atunci când videoclipul a avut o prezentare rezonabilă în ceea ce privește contribuția generală, influența sa pe caracteristică a fost adesea minimală, sugerând că, deși modelul ar fi putut utiliza videoclipul în ansamblu, a acordat puțină atenție cadrelor individuale. VideoLLaMA3 a fost principala excepție aici, cu o dependență vizuală mai puternică, mai ales pe secvențele mai lungi din LVBench:

Scoruri de contribuție a modalității (MC) și contribuție pe caracteristică (PFC) pe modele și seturi de date, arătând ponderea relativă a intrărilor video (V), întrebare (Q) și răspuns (A). Culorile mai reci indică contribuții mai puternice; culorile mai calde indică influențe mai slabe sau neglijabile. În majoritatea configurațiilor, limbaja este în mod clar dominantă, cu videoclipul adesea marginalizat – mai ales în ceea ce privește influența pe cadru.

În ceea ce privește textul, întrebarea a tendința să conteze mai mult decât răspunsul, mai ales în modelele mai puternice. Acest lucru a fost cel mai evident în seturi de date precum EgoSchema, unde întrebările erau mai lungi și mai naturalistice, în timp ce răspunsurile erau scurte și, uneori, schematice. MVBench a inversat această tendință într-o oarecare măsură, deoarece structura sa de răspuns binar a inflamat aparent importanța tokenilor de răspuns.

Pe toate modelele și seturile de date, cu toate acestea, viziunea a fost constant marginalizată, iar limba a făcut cea mai mare parte a muncii grele.

Articolul afirmă:

[Pentru] modelele cu context lung, videoclipul prezintă contribuții puternic reduse, ceea ce înseamnă că valorile Shapley pe cadru sunt mult mai mici decât cele ale caracteristicilor textului.

Videoclipul, ca modalitate în ansamblu, este încă extrem de relevant, dar acest lucru este o dovadă că valorile Shapley ale cadrelor sale individuale sunt mai concentrate în jurul valorii zero, și că atenția modelului asupra lor este mult mai puțin ghidată decât pentru text.

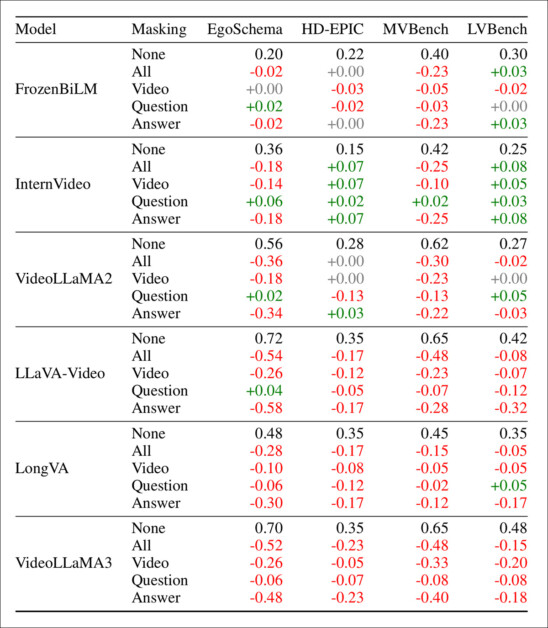

Pentru a testa cât contribuie fiecare parte a intrării (videoclip, text, etc.) la acuratețea modelului, cercetătorii au efectuat teste suplimentare utilizând masking – ascunzând intenționat una sau mai multe părți ale intrării și urmărind cât de mult se schimbă acuratețea modelului ca urmare a acestui lucru.

Dacă performanța scade puternic atunci când o anumită intrare este eliminată, acea intrare este probabil importantă; dacă modelul funcționează aproximativ la fel, sugerează că piesa lipsă nu a fost folosită în mod deosebit. În acest sens, testele de mascare sunt o formă de studiu de ablație iterativ.

Impactul performanței mascării videoclipului, întrebării sau răspunsului pe patru repere VQA. Scorurile arată schimbarea de la baza de referință nemascată. Roșu înseamnă acuratețe mai scăzută, verde înseamnă acuratețe mai ridicată. Modelele adesea păstrează scoruri ridicate fără videoclip, dar pierd mai mult atunci când răspunsul (text) este eliminat. Întrebarea poate fi de obicei mascată cu efect minim.

Rezultatele (vizualizate mai sus) indică faptul că răspunsurile (răspunsuri text în datele cu multiple variante) au cea mai mare greutate pe ansamblu. Mascarea răspunsului a cauzat, de obicei, cea mai mare scădere a acurateței, reducând adesea modelele la o performanță aproape aleatorie.

Cu toate acestea, mascarea întrebării a avut, de obicei, un efect mult mai mic, ceea ce susține constatarea anterioară că modelele subestimează întrebarea.

În unele cazuri, acuratețea a fost chiar îmbunătățită când întrebarea a fost eliminată, ceea ce sugerează că modelele au fost, uneori, doar asociind răspunsuri cu indicii textuale sau vizuale, mai degrabă decât evaluând în mod corespunzător întrebarea.

Modelele au variat, de asemenea, în ceea ce privește dependența lor de videoclip: unele au menținut o acuratețe rezonabilă fără acesta, confirmând, în continuare, contribuția limitată a caracteristicilor video în multe configurații actuale.

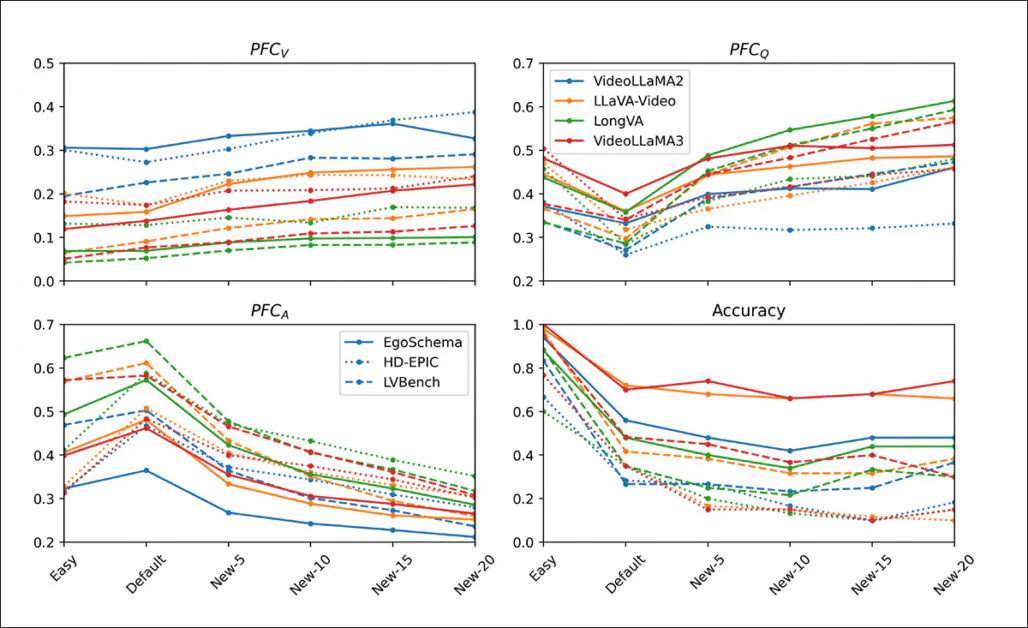

Autorii au testat, ulterior, dacă modelele pot fi forțate să se bazeze pe videoclip prin adăugarea de răspunsuri greșite suplimentare la opțiunile cu multiple variante.

Când distractorii au fost ușor de recunoscut și reciclați din alte întrebări, performanța a fost îmbunătățită, deoarece modelele au asociat modele textuale fără prea multă gândire. Dar cu zece sau mai multe răspunsuri nelegate, ele au început să se bazeze mai mult pe videoclip și pe întrebare:

Contribuție pe caracteristică și acuratețe pentru intrările video, întrebare și răspuns, pe măsură ce se adaugă răspunsuri greșite suplimentare la fiecare test VQA, arătând că creșterea numărului de distractori reduce dominanța textului și crește influența relativă a caracteristicilor vizuale și a întrebărilor.

Pentru VideoLLaMA3, mascarea videoclipului a redus acuratețea cu 40% pe EgoSchema și cu 15% pe LVBench, indicând faptul că o simplă creștere a numărului de răspunsuri poate muta modelele de la scurtături textuale către o adevărată raționare multimodală.

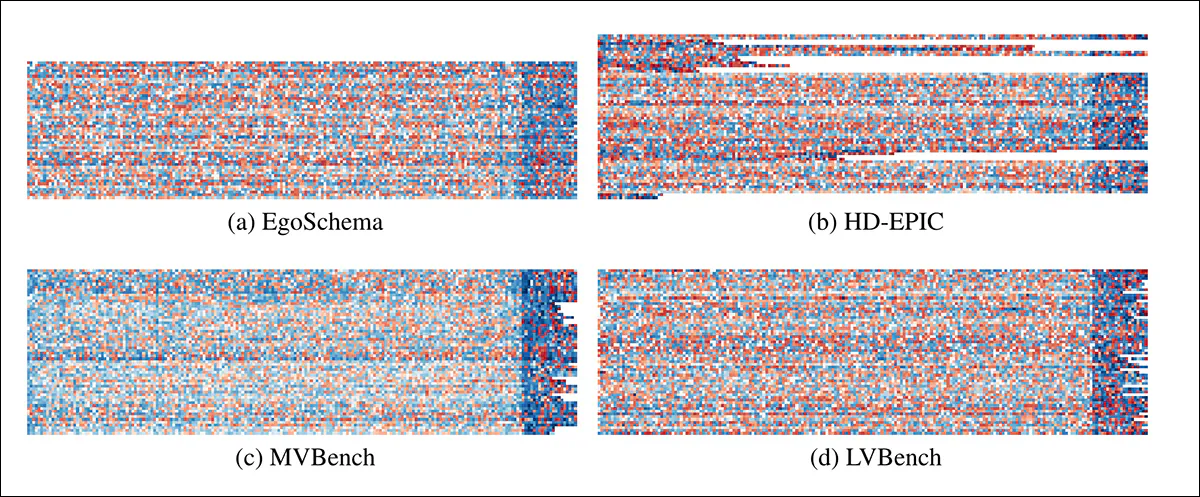

Cercetătorii au explorat, de asemenea, modul în care atributele sunt distribuite pe intrări, și mai jos vedem hărți de căldură ale valorilor Shapley pentru fiecare intrare a modelului:

Hărți de căldură ale valorilor Shapley pentru patru seturi de date, unde fiecare rând arată o pereche VQA, și fiecare coloană o caracteristică individuală. Caracteristicile video apar în partea stângă, urmate de text. Valorile mult mai puternice din regiunile (roșii) textuale confirmă faptul că modelele se bazează mult mai mult pe limbaj decât pe videoclip.

Comentând asupra rezultatelor de mai sus, autorii afirmă:

‘Măsurile valorilor Shapley sunt mult mai mari spre partea dreaptă a fiecărei hărți de căldură, reprezentând atributele întrebării și răspunsului. Această graniță evidentă este unde se termină cadrele videoclipului și încep caracteristicile textuale, demonstrând că contribuția modalității video este mult mai mică decât cea a întrebării/răspunsului. ‘

În rezumat, pe toate seturile de date, valorile sunt mult mai puternice spre partea textului spectrului, indicând puternic faptul că modelele se bazează mult mai mult pe limbaj decât pe indicii vizuale. Chiar și atunci când videoclipul este utilizat, contribuția este răspândită subțire pe multe cadre, adesea fără niciun model consistent.

Mai jos vedem un exemplu annotat din EgoSchema. Cele 16 cadre “cele mai importante” au fost selectate utilizând valorile Shapley și colorate în funcție de influența lor, albastrul indicând o contribuție pozitivă și roșul o contribuție negativă:

Atribuții Shapley pentru un exemplu EgoSchema, arătând cele 16 cadre mai influente și toate intrările textuale. Contribuțiile videoclipului sunt minime în comparație cu textul, care domină raționamentul modelului. Albastrul și roșul indică influență pozitivă și negativă asupra răspunsului selectat.

Rezultatul este că aproape fiecare cadru are o influență slabă în comparație cu cuvintele din întrebare și răspunsuri. Indicii vizuale sunt rare și inconsistente, în timp ce substantive precum “scaun” și “gard” îndreaptă modelul spre alegerea corectă – sau departe de aceasta, în funcție de context.

Concluzie

Oricine a experimentat vreodată cu editarea videoclipurilor sau analiza videoclipurilor știe deja cât de solicitantă este această procesare și înțelege de ce companiile care analizează milioane de solicitări bazate pe inteligență artificială în fiecare zi nu își pot permite să permită procese de editare și interpretare video ad hoc să fie rulate de utilizatori.

Un lucru de reținut în acest sens este că aproape fiecare interfață API de inteligență artificială pe care o veți încerca vreodată (cu excepția, poate, a unui demo nou și de scurtă durată, în sprijinul unor noi cercetări științifice) urmărește să îndeplinească dorințele utilizatorilor la nivelul minim posibil de cheltuire a resurselor.

Acest lucru înseamnă a se baza pe metadatele existente din datele furnizate de utilizator sau RAG extrase, dacă este posibil; și extragerea (dacă este absolut necesar) metadatelor pentru formate mai ușor de parcurs, cum ar fi PDF, documente și imagini individuale.

Ceea ce nu este pe masă este rularea videoclipului dvs. încărcat prin CLIP sau cea mai recentă lansare YOLO, sau prin orice model VLM care consumă multă putere și timp, care poate identifica cu adevărat ceea ce se află în cadre și înțelege ce se întâmplă în videoclipul furnizat, ținând cont de temporalitate.

Cu toate acestea, acest lucru nu înseamnă că fenomenele documentate de articolul actual decurg neapărat din abordări arhitecturale parsimonioase. Autorii observă că textul domină paradigmele de antrenament multimodal de ultimă oră, în orice caz, indicând faptul că “limbajul vizual” este fie mai puțin dezvoltat, fie mai puțin important sau informativ într-un context multimodal, sau (cel puțin pentru moment) mai puțin bine înțeles,

* Interesant, materialul pe care NotebookLM l-a generat pare a fi fie complet original, fie total neindexat de Google, deoarece nu pot găsi niciun rezultat care ar fi putut pătrunde în datele de antrenament și provoca această ieșire.

Publicat pentru prima dată vineri, 31 octombrie 2025; editat 14:20 pentru formatare