Inteligență artificială

Matting de imagine AI care înțelege scenele

În documentarul suplimentar care însoțește lansarea DVD a filmului Alien3 (1992) din 2003, legenda efectelor vizuale Richard Edlund și-a amintit cu groază de “lupta de sumo” a extragerii fotochimice a matricelor care a dominat lucrările de efecte vizuale între sfârșitul anilor 1930 și sfârșitul anilor 1980. Edlund a descris natura aleatorie a procesului ca “luptă de sumo”, în comparație cu tehnicile digitale de ecran albastru/verde care au preluat controlul la începutul anilor 1990 (și el a revenit la metafora de atunci).

Extragerea unui element din prim-plan (cum ar fi o persoană sau un model de navă spațială) dintr-un fundal, astfel încât imaginea decupată să poată fi compusă într-un fundal, a fost inițial realizată prin filmarea obiectului din prim-plan împotriva unui fundal uniform albastru sau verde.

Procese de extragere fotochimică laborioase pentru un shot VFX de la ILM pentru ‘Return of the Jedi’ (1983). Sursă: https://www.youtube.com/watch?v=qwMLOjqPmbQ

În filmarea rezultată, culoarea fundalului ar fi fost ulterior izolată chimic și utilizată ca șablon pentru a reînregistra obiectul din prim-plan (sau persoana) într-o imprimantă optică ca un obiect “plutitor” într-o celulă de film transparentă.

Procesul a fost cunoscut sub numele de suprapunere de separare a culorilor (CSO) – deși acest termen va deveni ulterior mai asociat cu efectele video “Chromakey” crude din producțiile de televiziune cu buget redus din anii 1970 și 1980, care au fost realizate cu mijloace analogice și nu chimice sau digitale.

O demonstrație a suprapunerii de separare a culorilor în 1970 pentru emisiunea britanică de copii ‘Blue Peter’. Sursă: https://www.bbc.co.uk/archive/blue_peter_noakes_CSO/zwb9vwx

În orice caz, indiferent dacă este vorba de elemente de film sau de video, ulterior, filmarea extrasă putea fi inserată în orice altă filmare.

Deși procesul de vapor de sodiu al Disney, mult mai scump și proprietar (care a fost ghidat pe baza culorii galbene, în special, și a fost utilizat și utilizat pentru filmul de groază al lui Alfred Hitchcock din 1963, Păsările), a oferit o definiție și o matrice mai bună, extragerea fotochimică a rămas o procedură laborioasă și neverosimilă.

Procesul de extragere cu vapor de sodiu proprietar al Disney a necesitat fundaluri aproape de capătul spectrului către galben. Aici, Angela Lansbury este suspendată pe sârmă în timpul producției unei secvențe VFX pentru ‘Bedknobs and Broomsticks’ (1971). Sursă

Dincolo de mattingul digital

În anii 1990, revoluția digitală a eliminat chimicalele, dar nu și nevoia de ecrane verzi. A devenit posibil să se înlăture fundalul verde (sau orice altă culoare) prin căutarea pixelilor dintr-un interval de toleranță al acelei culori, în software-ul de editare a pixelilor, cum ar fi Photoshop, și o nouă generație de suite de compoziție video care puteau să izoleze automat fundalurile colorate. Practic peste noapte, șaizeci de ani din industria imprimării optice au fost consacrați istoriei.

Ultimele zece ani de cercetare a viziunii calculate accelerate de GPU au adus extragerea matricelor într-o a treia eră, solicitând cercetătorilor dezvoltarea unor sisteme care pot extrage matrice de înaltă calitate fără nevoia de ecrane verzi. La Arxiv singur, articolele legate de inovațiile în extragerea foreground-ului pe baza învățării automate sunt o caracteristică săptămânală.

Punerea noastră în imagine

Acest loc de interes academic și industrial în extragerea cu ajutorul inteligenței artificiale a avut deja un impact asupra spațiului consumator: implementări crude, dar funcționale, ne sunt familiare tuturor sub forma Zoom și Skype care pot înlocui fundalurile noastre de cameră cu insule tropicale, etc., în apeluri video.

Cu toate acestea, cele mai bune matrice încă necesită un ecran verde, așa cum a notat Zoom miercuri.

Stânga, un bărbat în fața unui ecran verde, cu părul extras bine prin funcția Virtual Background a Zoom. Dreapta, o femeie în fața unei scene domestice normale, cu părul extras algoritmic, mai puțin precis și cu cerințe de calcul mai mari. Sursă: https://support.zoom.us/hc/en-us/articles/210707503-Changing-your-Virtual-Background-image

Un articol ulterioară de pe platforma de suport Zoom avertizează că extragerea non-ecran verde necesită și o putere de calcul mai mare în dispozitivul de captură.

Nevoia de a tăia

Îmbunătățirile calității, portabilității și economiei de resurse pentru sistemele de extragere a matricelor “în sălbăticie” (adică izolarea oamenilor fără nevoia de ecrane verzi) sunt relevante pentru multe sectoare și activități, mai mult decât doar filtrele de videoconferință.

Pentru dezvoltarea seturilor de date, recunoașterea feței, a capului și a corpului oferă posibilitatea de a asigura că elementele de fundal nefaste nu sunt antrenate în modelele de viziune computerizată ale subiecților umani; o izolare mai precisă ar îmbunătăți semnificativ tehnicile de segmentare semantică proiectate pentru a distinge și asimila domenii (de exemplu, ‘pisică’, ‘persoană’, ‘barcă’), și va îmbunătăți VAE și transformer-bazate sisteme de sinteză de imagini, cum ar fi noul DALL-E 2 de la OpenAI; și algoritmii de extragere mai buni ar reduce nevoia de rotoscopie manuală scumpă în pipeline-urile VFX costisitoare.

Într-adevăr, ascendența metodologiilor multimodale (de obicei text/imagini), în care un domeniu, cum ar fi “pisică”, este codificat atât ca imagine, cât și cu referințe text asociate, face deja progrese în procesarea imaginilor. Un exemplu recent este arhitectura Text2Live, care utilizează antrenament multimodal (text/imagini) pentru a crea videoclipuri cu, printre alte posibilități, lebădă de sticlă și girafă de cristal.

Matting de imagine cu inteligență artificială care înțelege scenele

O parte semnificativă a cercetării în mattingul automat pe baza inteligenței artificiale s-a concentrat pe recunoașterea granițelor și evaluarea grupărilor de pixeli dintr-o imagine sau cadru de film. Cu toate acestea, o nouă cercetare din China oferă o conductă de extragere care îmbunătățește delimitarea și calitatea matricelor prin utilizarea descrierilor textuale ale unei scene (o abordare multimodală care a câștigat teren în sectorul cercetării viziunii computerizate în ultimii 3-4 ani), susținând că a îmbunătățit metodele anterioare în mai multe moduri.

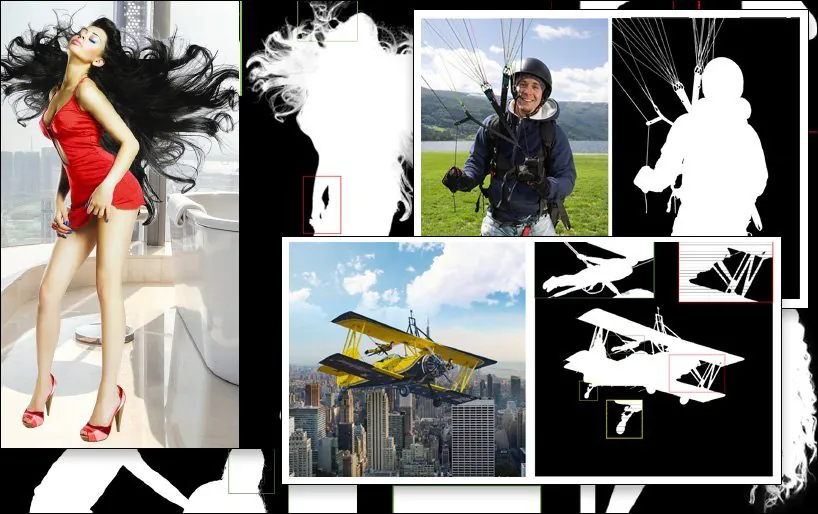

Un exemplu de extragere SPG-IM (ultima imagine, dreapta jos), comparat cu metodele anterioare. Sursă: https://arxiv.org/pdf/2204.09276.pdf

Provocarea pentru subsectorul cercetării de extragere este de a produce fluxuri de lucru care să necesite un minim de intervenție și anotare manuală – ideal, deloc. Pe lângă implicațiile de cost, cercetătorii noului articol observă că anotările și segmentările manuale efectuate de lucrătorii din mulțime din diverse culturi pot face ca imaginile să fie etichetate sau chiar segmentate în moduri diferite, ceea ce duce la algoritmi inconstienți și nesatisfăcători.

Un exemplu în acest sens este interpretarea subiectivă a ceea ce definește un “obiect din prim-plan”:

Din noul articol: metodele anterioare LFM și MODNet (‘GT’ semnifică Adevărul din spate, un rezultat ‘ideal’ adesea realizat manual sau prin metode nealgoritmice), au abordări diferite și variabil eficiente asupra definiției conținutului din prim-plan, în timp ce noua metodă SPG-IM delimitează mai eficient ‘conținutul apropiat’ prin contextul scenei.

Pentru a aborda acest lucru, cercetătorii au dezvoltat o conductă de două etape numită Matting de imagine ghidat de percepția situațională (SPG-IM). Arhitectura cu două etape de codificare/decodificare cuprinde Distilarea percepției situaționale (SPD) și Matting ghidat de percepția situațională (SPGM).

Mai întâi, SPD preantrenează transformările vizuale-textuale, generând titluri adecvate pentru imaginile asociate. După aceea, predicția măștii din prim-plan este activată prin conectarea conductei la o nouă tehnică de predicție a salienței.

Apoi, SPGM produce o matrice alpha estimată pe baza intrării de imagine RGB brută și a măștii generate în modulul anterior.

Obiectivul este ghidarea percepției situaționale, în care sistemul are o înțelegere contextuală a ceea ce reprezintă imaginea, permițându-i să abordeze – de exemplu – provocarea extragerii părului complex dintr-un fundal împotriva caracteristicilor cunoscute ale unei astfel de sarcini specifice.

În exemplul de mai jos, SPG-IM înțelege că firele sunt intrinseci unui ‘parapant’, unde MODNet nu reușește să păstreze și să definească aceste detalii. La fel și mai sus, structura completă a aparatului de joacă este pierdută arbitrar în MODNet.

Noul articol se intitulează Matting de imagine ghidat de percepția situațională și provine de la cercetători de la Institutul de Cercetare OPPO, PicUp.ai și Xmotors.

Matrice inteligente automate

SPG-IM oferă, de asemenea, o rețea de rafinare a transformării focale adaptive (AFT) care poate prelucra detalii locale și context global separat, facilitând “matrice inteligente”.

Înțelegerea contextului scenei, în acest caz ‘fată cu cal’, poate face extragerea din prim-plan mai ușoară decât metodele anterioare.

Articolul afirmă:

‘Credem că reprezentările vizuale din sarcina vizual-textuală, de exemplu, captionarea imaginilor, se concentrează pe semnale mai comprehensive semantic între a) obiect-obiect și b) obiect-mediu ambiant pentru a genera descrieri care pot acoperi atât informațiile globale, cât și detaliile locale. În plus, comparativ cu anotarea pixelilor scumpă a matricelor de imagine, etichetele textuale pot fi colectate în masă la un cost foarte mic.’

Arhitectura SPD a conductei este antrenată împreună cu decodificatorul textual bazat pe transformatori al Universității din Michigan, VirTex, care învață reprezentări vizuale din captionări semantic dense.

VirTex antrenează împreună o rețea ConvNet și Transformers prin perechi de imagine-captions și transferă insight-urile obținute către sarcinile de viziune downstream, cum ar fi detectarea obiectelor. Sursă: https://arxiv.org/pdf/2006.06666.pdf

Printre alte teste și studii de ablație, cercetătorii au testat SPG-IM împotriva metodelor bazate pe trimap de ultimă generație, Deep Image Matting (DIM), IndexNet, Context-Aware Image Matting (CAM), Guided Contextual Attention (GCA), FBA și Semantic Image Mapping (SIM).

Alte cadre anterioare testate au inclus abordări fără trimap LFM, HAttMatting și MODNet. Pentru o comparație corectă, metodele de test au fost adaptate pe baza metodologiilor diferite; unde codul nu a fost disponibil, tehnicile articolului au fost reproduse din arhitectura descrisă.

Noul articol afirmă:

‘Modelul nostru SPG-IM depășește toate metodele concurente fără trimap ([LFM], [HAttMatting] și [MODNet]) cu o marjă largă. În același timp, modelul nostru arată o superioritate remarcabilă față de metodele bazate pe trimap și ghidate de masca de ultimă generație în ceea ce privește toți cei patru parametri de pe seturile de date publice (adică Composition-1K, Distinction-646 și Human-2K), și benchmark-ul nostru Multi-Object-1K.’

Și continuă:

‘Se poate observa în mod evident că metoda noastră păstrează detalii fine (de exemplu, site-urile vârfurilor de păr, texturile transparente și marginile) fără ghidarea trimap-ului. Mai mult, comparativ cu celelalte modele concurente fără trimap, SPG-IM nostru poate păstra o mai bună integritate semantică globală.’

Publicat pentru prima dată pe 24 aprilie 2022.