Kunstig intelligens

Mangler i Amazon Mechanical Turk kan true norske naturligspråksgenereringssystemer

En ny studie fra University of Massachusetts Amherst har sammenlignet engelsklærere med crowdsourced-arbeidere på Amazon Mechanical Turk i vurdering av utdata fra naturligspråksgenereringssystemer (NLG), og konkluderte med at lave standarder og “gaming” av prisbelønnede oppgaver blant AMT-arbeidere kan hindre utviklingen av sektoren.

Rapporten kommer til en rekke kritiske konklusjoner om omfanget av den “industrielle” billige outsourcingen av åpne NLG-evalueringoppgaver kan føre til dårlige resultater og algoritmer i denne sektoren.

Forskerne har også samlet en liste over 45 artikler om åpen tekstgenerering der forskningen har benyttet AMT, og fant at “den overveldende majoriteten” ikke rapporterte kritiske detaljer om bruken av Amazons crowdservice, noe som gjør det vanskelig å gjenta funnene i artiklene.

Svette-shop-arbeid

Rapporten retter kritikk mot både svette-shop-naturen til Amazon Mechanical Turk og de (sannsynligvis budsjett-begrensede) akademiske prosjektene som gir AMT ytterligere kredibilitet ved å bruke (og sitere) det som en gyldig og konsekvent forskningsressurs. Forfatterne bemerker:

‘Selv om AMT er en praktisk og billig løsning, observerer vi at høy variasjon mellom arbeidere, dårlig kalibrering og kognitivt krevende oppgaver kan føre forskere til å trekke misvisende vitenskapelige konklusjoner (f.eks. at menneskeskrevet tekst er “verre” enn GPT-2s).’

Rapporten skylder spillet og ikke spillerne, med forskerne observerer:

‘[Crowd] arbeidere blir ofte underbetalt for sin arbeid, noe som skader både kvaliteten på forskningen og, viktigere, evnen til disse crowd-arbeiderne til å tjene en adequat inntekt.’

Den artikkelen, tittel Farene ved å bruke Mechanical Turk til å evaluere åpen tekstgenerering, konkluderer videre med at ‘ekspertvurderere’ som språklærere og lingvister burde brukes til å evaluere åpen kunstig NLG-innhold, selv om AMT er billigere.

Testoppgaver

I sammenligning av AMTs ytelse mot mindre tid-begrensede, ekspertlesere, forskerne brukte 144 dollar på AMT-tjenestene som faktisk ble brukt i sammenligningstestene (selv om mye mer ble brukt på “ikke-brukbare” resultater – se nedenfor), og krevde tilfeldige “Turks” til å evaluere en av 200 tekster, fordelt mellom menneskeskapt tekstinnhold og kunstig generert tekst.

Å gi profesjonelle lærere samme arbeid kostet 187,50 dollar, og bekreftet deres overlegne ytelse (i sammenligning med AMT-arbeidere) ved å ansette Upwork-frilansere til å gjenta oppgavene kostet ytterligere 262,50 dollar.

Hver oppgave bestod av fire vurderingskriterier: grammatikk (‘Hvor grammatisk korrekt er tekstens historiefragment?’); kohesjon (‘Hvor godt passer setningene i historiefragmentet sammen?’); likbarhet (‘Hvor morsom finner du historiefragmentet?’); og relevans (‘Hvor relevant er historiefragmentet til prompten?’).

Generering av tekst

For å få NLG-materiale for testene, brukte forskerne Facebook AI Researchs 2018 Hierarchical Neural Story Generation dataset, som består av 303 358 engelske historier komponert av brukere på den svært populære (15 millioner+ brukere) r/writingprompts subreddit, hvor abonnenters historier er “sådd” med enkeltsetninger “prompts” på en lignende måte som nåværende praksis i tekst-til-bilde-generering – og, naturligvis, i åpen naturligspråksgenerering systemer.

200 prompts fra datasett ble tilfeldig valgt og sendt gjennom en medium-størrelse GPT-2-modell ved hjelp av Hugging-Face Transformers bibliotek. Dermed ble to sett med resultater fått fra samme promptene: menneskeskrevne diskursive essayer fra Reddit-brukere, og GPT-2-genererte tekster.

For å forhindre at samme AMT-arbeidere dømte samme historie flere ganger, ble tre AMT-arbeiderdommer søkt per eksempel. Sammen med eksperimenter om engelsk språkferdighetene til arbeiderne (se slutten av artikkelen) og diskontering av resultater fra lav-innsats arbeidere (se ‘Kort tid’ nedenfor), økte dette den totale utgiften til AMT til rundt 1 500 dollar.

For å skape en jevn spillplass, ble alle tester utført på hverdager mellom 11.00-11.30 PST.

Resultater og konklusjoner

Studien dekker mye ground, men hovedpoengene er som følger:

Kort tid

Artikkelen fant at en offisiell Amazon-rapportert gjennomsnittlig oppgavetid på 360 sekunder ble redusert til en reell arbeidstid på bare 22 sekunder, og en median arbeidstid på kun 13 sekunder – en fjerdedel av tiden det tok for den raskeste engelsklæreren å gjenta oppgaven.

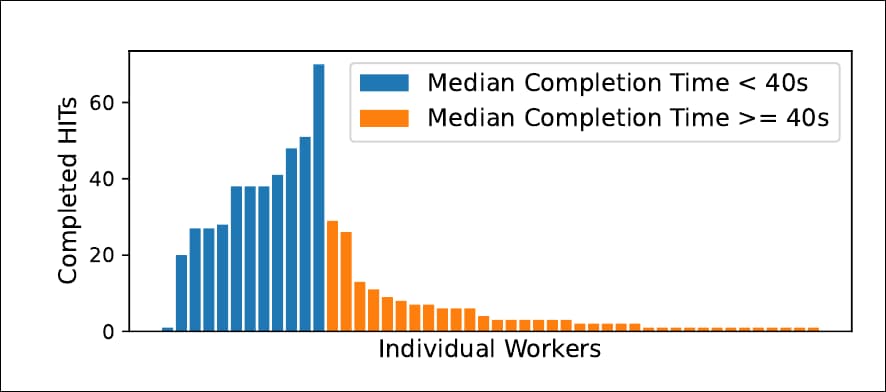

Fra dag 2 av studien: de enkelte arbeiderne (i oransje) brukte betydelig mindre tid på å evaluere hver oppgave enn de bedre betalte lærerne, og (senere) de enda bedre betalte Upwork-entrepreneur. Kilde: https://arxiv.org/pdf/2109.06835.pdf

Ettersom AMT ikke setter noen begrensning på antall Human Intelligence Tasks (HITs) en enkelt arbeider kan påta seg, har AMT “store treffere” oppstått, med (lønnsomme) rykter for å fullføre høye antall oppgaver per eksperiment. For å kompensere for aksepterte treff av samme arbeider, målte forskerne tiden mellom påfølgende innsendte HITs, sammenlignet start- og sluttiden for hver HIT. På denne måten kom underskuddet mellom AMTs rapporterte WorkTimeInSeconds og den faktiske tiden brukt på oppgaven i fokus.

Ettersom slikt arbeid ikke kan utføres i disse reduserte tidsrammene, måtte forskerne kompensere for dette:

‘Det er umulig å nøye lese en paragraf-lengde historie og vurdere alle fire egenskaper på så kort tid som 13 sekunder, så vi måler effekten på gjennomsnittsvurderinger når vi filtrerer ut arbeidere som bruker for lite tid per HIT…Spesifikt fjerner vi vurderinger fra arbeidere hvis median tid er under 40 sekunder (som er en lav terskel), og finner at i gjennomsnitt ca. 42% av våre vurderinger blir fjernet (varierende fra 20%-72% over alle eksperimenter).’

Artikkelen hevder at feilrapportert faktisk arbeidstid i AMT er ‘en stor sak’ som vanligvis oversees av forskere som bruker tjenestene.

Hånd-holding nødvendig

Funnene tyder videre på at AMT-arbeidere ikke kan pålitelig skille mellom tekst skrevet av en menneske og tekst skrevet av en maskin, med mindre de ser både tekstene side om side, noe som ville kompromittere en typisk evalueringsscenarie (hvor leseren skal kunne gjøre en vurdering basert på en enkelt tekstprøve, “ekte” eller kunstig generert).

Kasuell aksept av lavkvalitets kunstig tekst

AMT-arbeidere vurderer konsistent lavkvalitets GPT-basert kunstig tekst på lik linje med høykvalitets, kohesive tekst skrevet av mennesker, i motsetning til engelsklærerne, som lett kunne skille forskjellen i kvalitet.

Ingen forberedelsestid, null kontekst

Å gå inn i riktig sinnstemning for en så abstrakt oppgave som vurdering av autentisitet kommer ikke naturlig; engelsklærerne trengte 20 oppgaver for å kalibrere sine sanser til vurderingsmiljøet, mens AMT-arbeidere vanligvis får ingen “orienteringstid” i det hele tatt, noe som senker kvaliteten på deres input.

Gaming systemet

Rapporten hevder at den totale tiden AMT-arbeidere bruker på enkeltoppgaver er inflasjonert av arbeidere som aksepterer multiple oppgaver samtidig, og kjører gjennom oppgavene i forskjellige faner i nettleseren, i stedet for å konsentrere seg om en oppgave for den registrerte oppgavetiden.

Land av opphav er viktig

Standardinnstillingene til AMT filtrerer ikke arbeidere etter land av opphav, og rapporten bemerker tidligere arbeid som indikerer at AMT-arbeidere bruker VPN-er for å arbeide rundt geografiske begrensninger, og lar ikke-engelsktalende presentere seg som engelsktalende (i et system som, kanskje ganske naivt, liker en arbeiders morsmål med deres IP-baserte geografiske plassering).

Derfor gjorde forskerne om vurderingstestene på AMT med filtre som begrensede potensielle takerne til ikke-engelsktalende land, og fant at ‘arbeidere fra ikke-engelsktalende land vurderer kohesjon, relevans og grammatikk…signifikant lavere enn likviderte arbeidere fra engelsktalende land’.

Rapporten konkluderer:

‘[Ekspert] vurderere som lingvister eller språklærere burde brukes når det er mulig, da de allerede er trent til å evaluere skrevet tekst, og det er ikke mye dyrere…’

Publisert 16. september 2021 – Oppdatert 18. desember 2021: Lagt til kategorier