Andersons vinkel

‘Beskyttede’ bilder er enklere, ikke vanskeligere, å stjele med AI

Ny forskning tyder på at vannmerkingsverktøy som er ment å blokkere AI-bildeendringer, kan ha motsatt effekt. I stedet for å stoppe modeller som Stable Diffusion fra å gjøre endringer, kan noen beskyttelser faktisk hjelpe AI-en med å følge redigeringspromter nærmere, og gjøre uønskede manipulasjoner enda enklere.

Det finnes en merkbart og robust tråd i datavisjonslitteraturen som er viet til å beskytte opphavsrettslige bilder mot å bli trent inn i AI-modeller eller brukt i direkte bilde-til-bilde AI-prosesser. Systemer av denne typen er generelt rettet mot Latent Diffusion Models (LDMs) som Stable Diffusion og Flux, som bruker støybaserte prosedyrer for å kode og dekode bilde.

Ved å sette inn adversarial støy i ellers normale bilder, kan det være mulig å få bilde-detektorer til å gjette bildeinnhold feil, og hindre bilde-genererings-systemer fra å utnytte opphavsrettslige data:

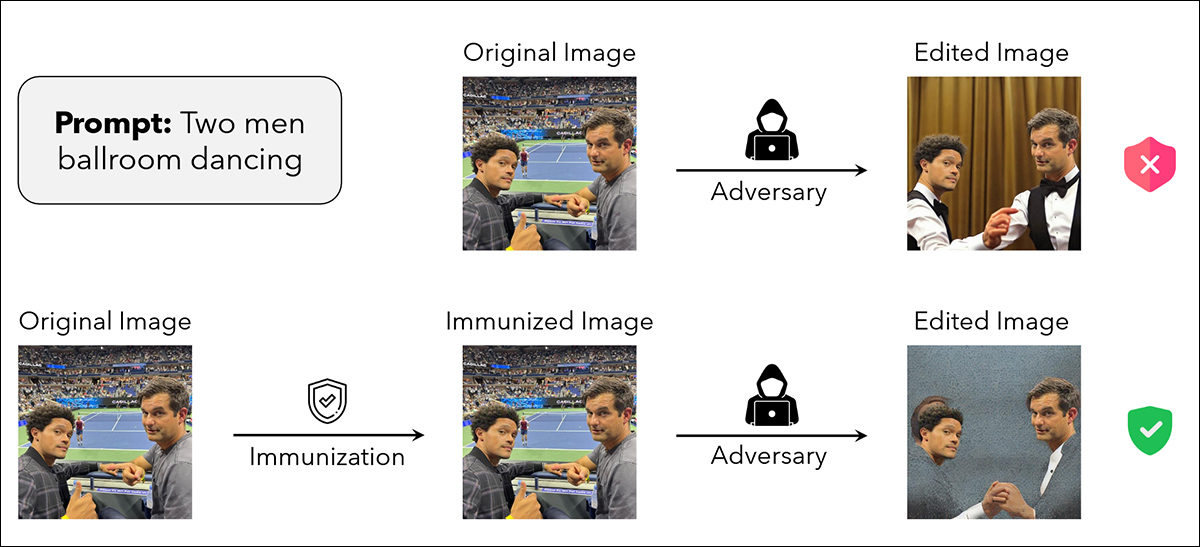

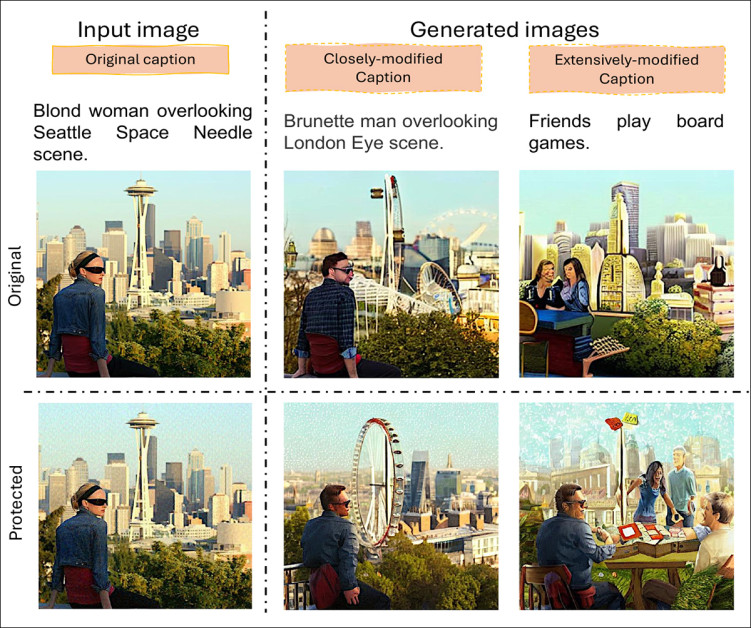

Fra MIT-papiret ‘Raising the Cost of Malicious AI-Powered Image Editing’, eksempler på en kildebilde ‘immunisert’ mot manipulasjon (nederste rad). Kilde: https://arxiv.org/pdf/2302.06588

Siden en kunstner-tilbakegang mot Stable Diffusions liberale bruk av web-skrapede bilder (inkludert opphavsrettslige bilder) i 2023, har forskningsscenen produsert flere variasjoner av samme tema – tanken om at bilder kan være usynlig ‘forgiftet’ mot å bli trent inn i AI-systemer eller sugt inn i generative AI-pipelines, uten å påvirke kvaliteten på bildet for den gjennomsnittlige seeren.

I alle tilfeller er det en direkte korrelasjon mellom intensiteten av den påførte perturbasjonen, omfanget av hvilken bilde deretter er beskyttet, og omfanget av hvilket bilde ikke ser helt så bra ut som det burde:

Selv om kvaliteten på forsknings-PDF-en ikke fullt ut illustrerer problemet, ofrer større mengder adversarial perturbasjon kvalitet for sikkerhet. Her ser vi variasjonen av kvalitetsforstyrrelser i 2020-prosjektet ‘Fawkes’ ledet av University of Chicago. Kilde: https://arxiv.org/pdf/2002.08327

Av særlig interesse for kunstnere som søker å beskytte sine stiler mot uautorisert appropriasjon, er evnen til slike systemer ikke bare å forkaste identitet og andre informasjoner, men å ‘overbevise’ en AI-treningprosess om at den ser noe annet enn det den faktisk ser, så at forbindelser ikke dannes mellom semantiske og visuelle domener for ‘beskyttet’ treningdata (dvs. en prompt som ‘I stilen til Paul Klee’).

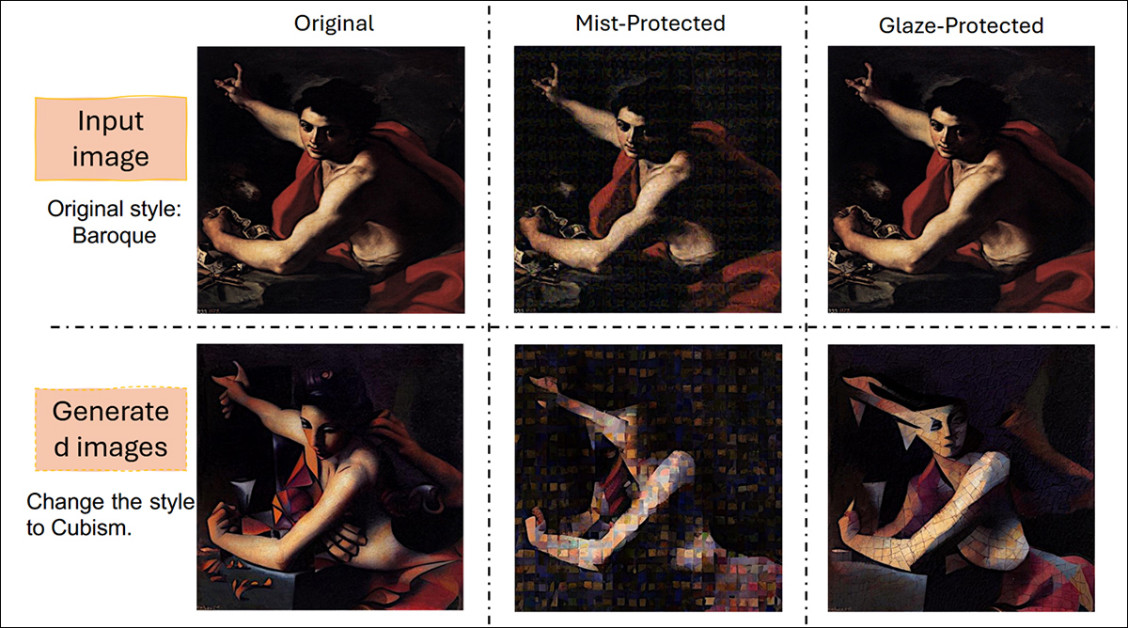

Mist og Glaze er to populære injeksjonsmetoder som kan forhindre, eller i det minste alvorlig hindre, forsøk på å bruke opphavsrettslige stiler i AI-arbeidsflyter og trening rutiner. Kilde: https://arxiv.org/pdf/2506.04394

Egen Mål

Nå har ny forskning fra USA funnet ikke bare at perturbasjoner kan feile å beskytte et bilde, men at å legge til perturbasjon kan faktisk forbedre bildets utnyttbarhet i alle AI-prosesser som perturbasjonen er ment å immunisere mot.

Papiret sier:

‘I våre eksperimenter med ulike perturbasjonsbaserte bildebeskyttelsesmetoder over flere domener (natur-scene bilder og kunstverk) og redigeringsoppgaver (bilde-til-bilde generering og stil-redigering), oppdager vi at slike beskyttelse ikke oppnår dette målet fullstendig.

‘I de fleste scenarier genererer diffusjonsbasert redigering av beskyttede bilder et ønsket utgangsbilde som adlyder nøyaktig guidingspromten.

‘Våre funn tyder på at å legge til støy til bilder kan paradoksalt øke deres assosiasjon med gitt tekstpromter under genereringsprosessen, og føre til uventede konsekvenser som better resulterende redigeringer.

‘Derfor argumenterer vi for at perturbasjonsbaserte metoder kanskje ikke gir en tilstrekkelig løsning for robust bildebeskyttelse mot diffusjonsbasert redigering.’

I tester ble de beskyttede bildene utsatt for to kjente AI-redigerings-scenarier: rett fremover bilde-til-bilde generering og stil-overføring. Disse prosessene reflekterer de vanlige måtene AI-modeller kan utnytte beskyttet innhold på, enten ved å endre et bilde direkte eller ved å låne dens stilistiske trekk for bruk andre steder.

De beskyttede bildene, hentet fra standardkilder av fotografi og kunstverk, ble kjørt gjennom disse pipelineene for å se om de tilføyde perturbasjonene kunne blokkere eller forringe redigeringene.

I stedet syntes tilstedeværelsen av beskyttelse ofte å skjerpe modellens alignering med promptene, og produserte rene, nøyaktige utganger hvor noen feil hadde vært forventet.

Forfatterne råder, i virkeligheten, at denne svært populære metoden for beskyttelse kan gi en falsk fornemmelse av sikkerhet, og at enhver slik perturbasjonsbasert immuniseringstiltak bør testes grundig mot forfatternes egne metoder.

Metode

Forfatterne kjørte eksperimenter som brukte tre beskyttelsesmetoder som anvender nøye designet adversarial perturbasjoner: PhotoGuard; Mist; og Glaze.

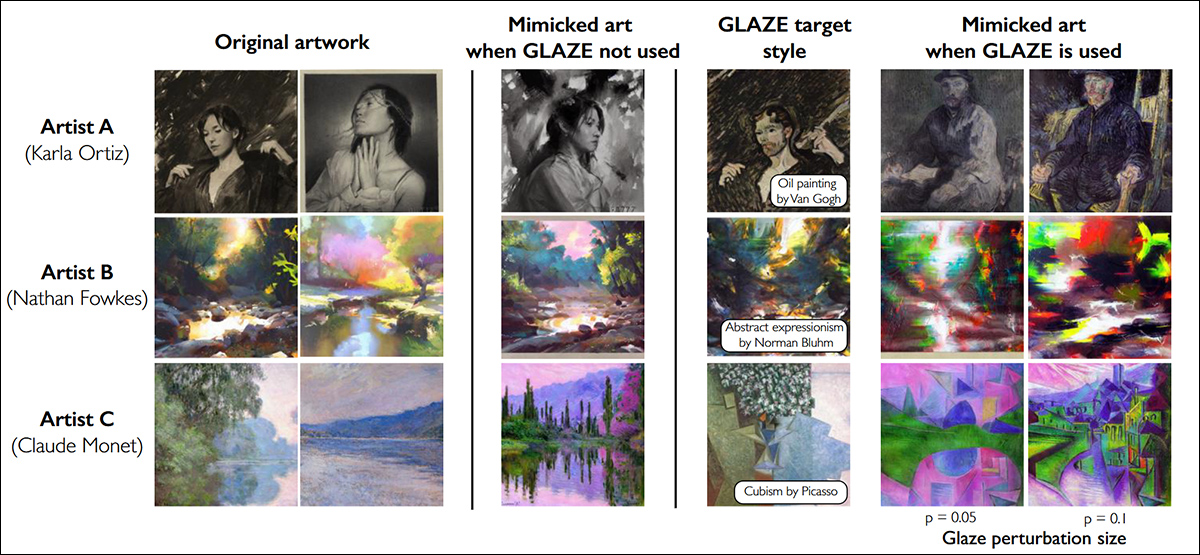

Glaze, en av rammeverkene testet av forfatterne, illustrerende Glaze-beskyttelseseksempler for tre kunstnere. De første to kolonnene viser de originale kunstverkene; den tredje kolonnen viser mimicry-resultater uten beskyttelse; den fjerde, stil-overførte versjoner brukt for cloak-optimisering, sammen med målstilnavnet. Den femte og sjette kolonnene viser mimicry-resultater med cloaking anvendt på perturbasjon-nivåer p = 0,05 og p = 0,1. Alle resultater bruker Stable Diffusion-modeller. https://arxiv.org/pdf/2302.04222

PhotoGuard ble anvendt på natur-scene bilder, mens Mist og Glaze ble brukt på kunstverk (dvs. ‘kunstnerisk-stilte’ domener).

Tester dekket både naturlige og kunstneriske bilder for å reflektere mulige virkelige anvendelser. Effektiviteten av hver metode ble vurdert ved å sjekke om en AI-modell fortsatt kunne produsere realistiske og prompt-relevante redigeringer når de arbeidet med beskyttede bilder; hvis de resulterende bildene så ut til å være overbevisende og matchet promptene, ble beskyttelsen dømt å ha feilet.

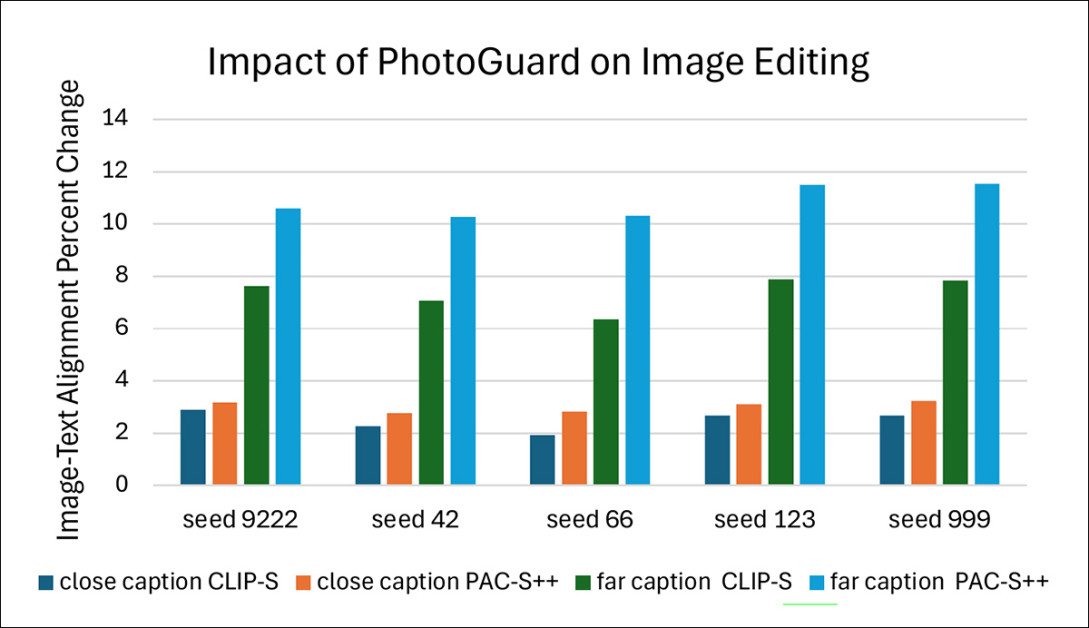

Stable Diffusion v1.5 ble brukt som forhånds-trening-bilde-generatoren for forskernes redigeringsoppgaver. Fem frø ble valgt for å sikre reproduserbarhet: 9222, 999, 123, 66 og 42. Alle andre genereringsinnstillinger, som guidingskala, styrke og totale skritt, fulgte standardverdiene brukt i PhotoGuard-eksperimentene.

PhotoGuard ble testet på natur-scene bilder ved å bruke Flickr8k-datasetten, som inneholder over 8 000 bilder parret med opptil fem undertekster hver.

Motstridende Tanker

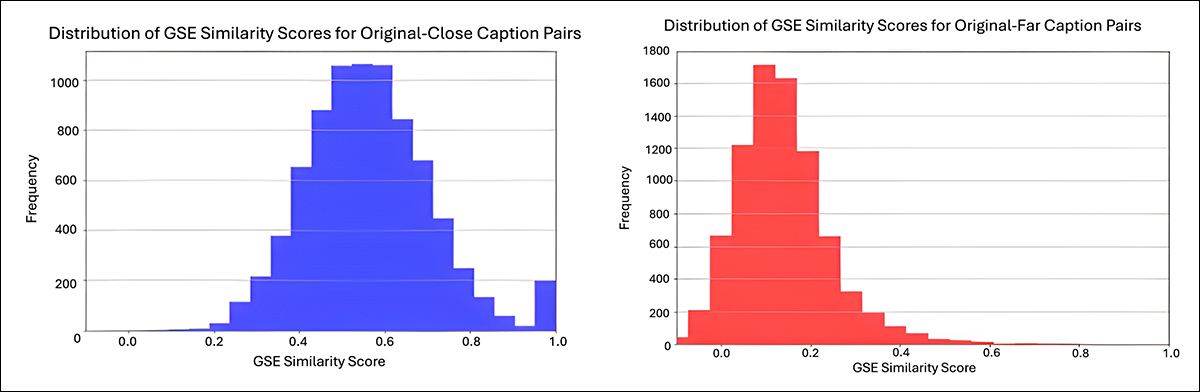

To sett med modifiserte undertekster ble laget fra den første underteksten av hvert bilde med hjelp av Claude Sonnet 3.5. Et sett inneholdt promter som var sammenhengende nær de originale undertekstene; det andre settet inneholdt promter som var sammenhengende fjernt.

For eksempel, fra den originale underteksten ‘En ung jente i en rosa kjole som går inn i en trehytte’, ville en nær prompt være ‘En ung gutt i en blå skjorte som går inn i en murhus’. I motsetning ville en fjern prompt være ‘To katter som lener seg på en sofa’.

Nære promter ble konstruert ved å erstatte substantiver og adjektiver med semantisk likeverdige termer; fjerne promter ble generert ved å instruere modellen til å lage undertekster som var sammenhengende svært forskjellige.

Alle genererte undertekster ble manuelt sjekket for kvalitet og semantisk relevans. Googles Universal Sentence Encoder ble brukt til å beregne semantiske likhetsskår mellom de originale og modifiserte undertekstene:

Fra supplementært materiale, semantiske likhetssfordelinger for de modifiserte undertekstene brukt i Flickr8k-tester. Grafen til venstre viser likhetsskårene for nært modifiserte undertekster, i gjennomsnitt rundt 0,6. Grafen til høyre viser de omfattende modifiserte undertekstene, i gjennomsnitt rundt 0,1, som reflekterer større semantisk avstand fra de originale undertekstene. Kilde: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Hver bilde, sammen med sin beskyttede versjon, ble redigert ved å bruke både nær og fjern promter. Den blinde/referanse-løse bilde-spatial kvalitets-evaluator (BRISQUE) ble brukt til å vurdere bildekvalitet:

Bilde-til-bilde genereringsresultater på naturlige fotografier beskyttet av PhotoGuard. Til tross for tilstedeværelsen av perturbasjoner, fulgte Stable Diffusion v1.5 promptene både små og store semantiske endringer i redigeringspromptene, og produserte realistiske utganger som matchet de nye instruksjonene.

De genererte bildene fikk en score på 17,88 på BRISQUE, med 17,82 for nær promter og 17,94 for fjern promter, mens de originale bildene fikk en score på 22,27. Dette viser at de redigerte bildene forble nære i kvalitet til de originale.

Mål

For å dømme hvor godt beskyttelsene forstyrret AI-redigering, målte forskerne hvor nært de endelige bildene matchet instruksjonene de ble gitt, ved å bruke sammenligningssystemer som sammenlignet bildeinnholdet med tekstprompten, for å se hvor godt de alignerte.

For dette formålet ble CLIP-S-metoden brukt, som anvender en modell som kan forstå både bilder og tekst for å sjekke hvor likt de er, mens PAC-S++ legger til ekstra prøver skapt av AI for å alignere sammenligningen nærmere en menneskelig estimat.

Disse Bilde-Tekst-Alignering (ITA)-skårene indikerer hvor nøyaktig AI-en fulgte instruksjonene når det redigerte et beskyttet bilde: hvis et beskyttet bilde fortsatt ledet til et høyt alignert utgangsbilde, betyr det at beskyttelsen ble dømt å ha feilet å blokkere redigeringen.

Effekten av beskyttelse på Flickr8k-datasettet over fem frø, ved å bruke både nær og fjern promter. Bilde-tekst-alignment ble målt ved å bruke CLIP-S- og PAC-S++-skårer.

Forskerne sammenlignet hvor godt AI-en fulgte promptene når det redigerte beskyttede bilder sammenlignet med ubeskyttede bilder. De så først på forskjellen mellom de to, kalt Reell Endring. Deretter ble forskjellen skalert for å lage en Prosentuell Endring, og gjøre det enklere å sammenligne resultater over mange tester.

Dette prosessen avslørte om beskyttelsene gjorde det vanskeligere eller enklere for AI-en å matche promptene. Testene ble gjentatt fem ganger ved å bruke forskjellige tilfeldige frø, og dekket både små og store endringer av de originale undertekstene.

Kunst Angrep

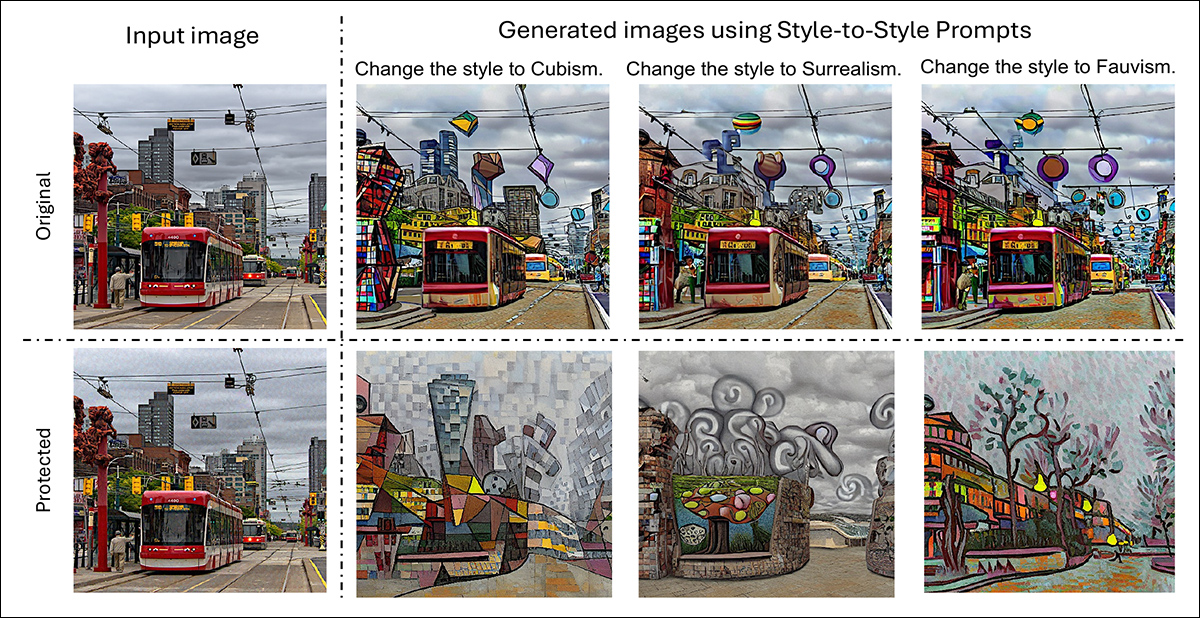

For testene på naturlige fotografier, ble Flickr1024-datasettet brukt, som inneholder over tusen høykvalitetsbilder. Hvert bilde ble redigert med promter som fulgte mønsteret: ‘Endre stilen til [V]’, hvor [V] representerte en av syv berømte kunststiler: Kubisme; Post-Impressionisme; Impressionisme; Surrealisme; Barokk; Fauvisme; og Renessanse.

Prosessen involverte å anvende PhotoGuard på de originale bildene, generere beskyttede versjoner, og deretter kjøre både beskyttede og ubeskyttede bilder gjennom samme sett av stil-overføringsredigeringer:

Originale og beskyttede versjoner av et naturlig scenarie-bilde, hver redigert for å anvende Kubisme, Surrealisme og Fauvisme-stiler.

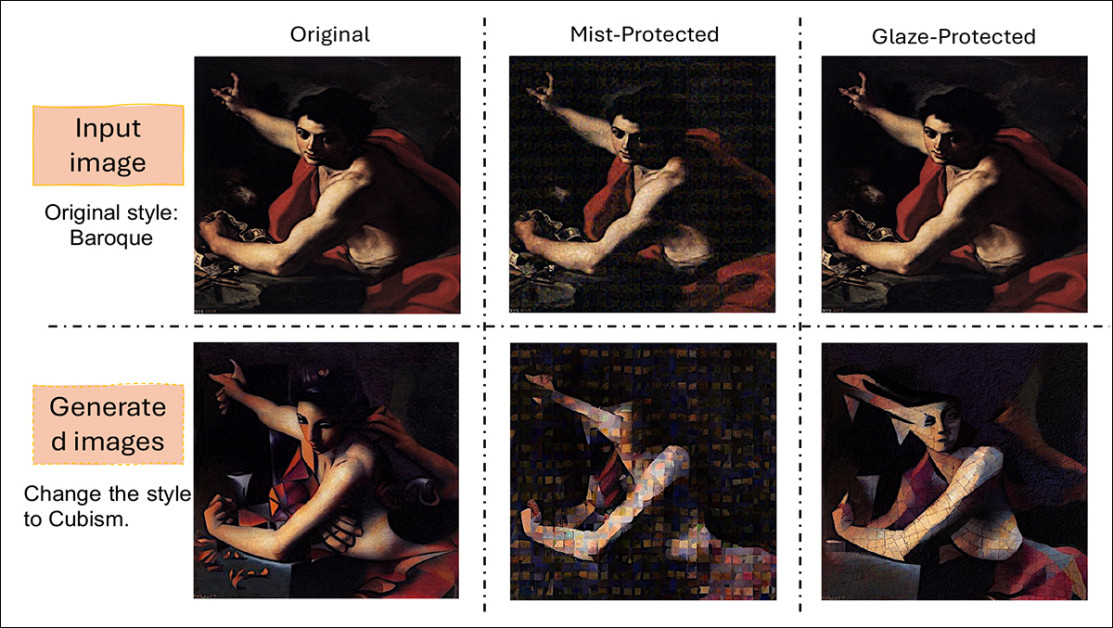

For å teste beskyttelsesmetoder på kunstverk, ble stil-overføring utført på bilder fra WikiArt-datasettet, som kuraterer en bred rekke av kunststiler. Redigeringspromptene fulgte samme format som før, og instruerte AI-en om å endre stilen til en tilfeldig valgt, uavhengig stil hentet fra WikiArt-merkene.

Både Glaze og Mist-beskyttelsesmetoder ble anvendt på bildene før redigeringene, og tillot forskerne å observere hvor godt hver forsvar kunne blokkere eller forstyrre stil-overføring-resultatene:

Eksempler på hvordan beskyttelsesmetoder påvirker stil-overføring på kunstverk. Det originale Barokk-bildet vises sammen med versjoner beskyttet av Mist og Glaze. Etter å ha anvendt Kubisme-stil-overføring, kan forskjellene i hvordan hver beskyttelse endrer den endelige utgangen sees.

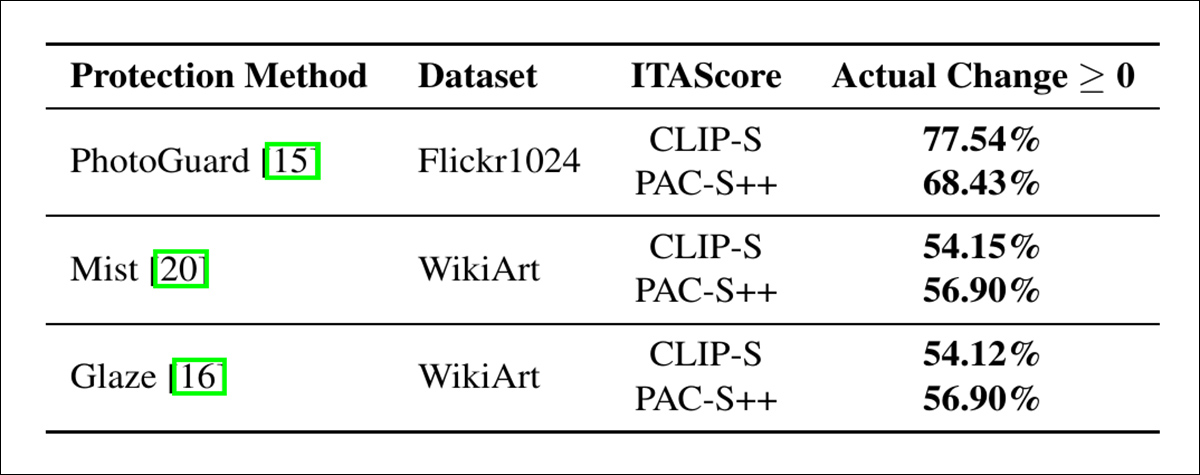

Forskerne testet sammenligningene kvantitativt også:

Endringer i bilde-tekst-alignment-skårer etter stil-overføring-redigeringer.

Av disse resultater kommenterte forfatterne:

‘Resultatene fremhever en betydelig begrensning av adversarial perturbasjoner for beskyttelse. I stedet for å hindre alignment, forsterker adversarial perturbasjoner ofte generativ modells respons på promter, og åpner uventede konsekvenser som better resulterende redigeringer.

‘De uventede konsekvensene av å bruke adversarial perturbasjoner avslører sårbarheter i eksisterende metoder og understreker det presserende behovet for mer effektive beskyttelsesmetoder.’

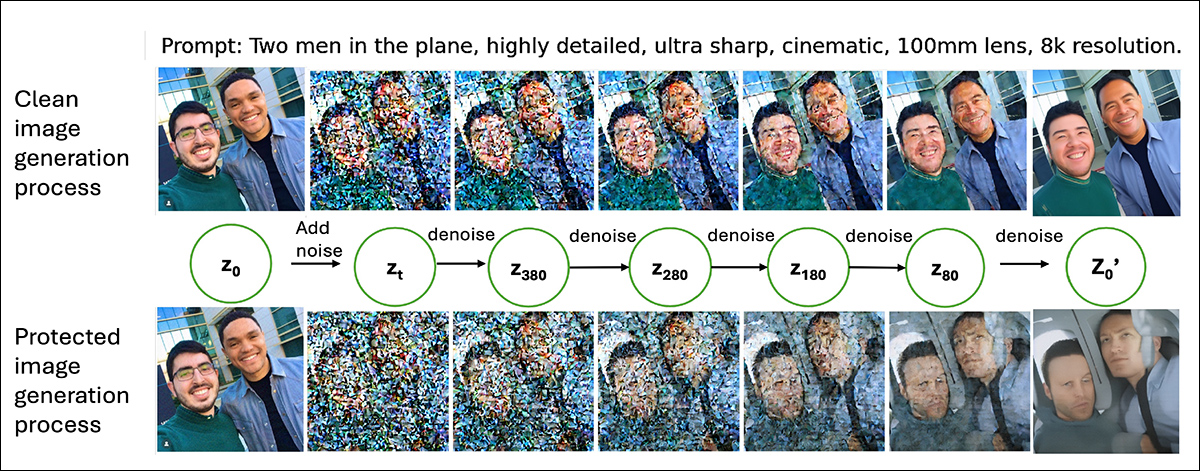

Forfatterne forklarer at de uventede resultene kan spores tilbake til hvordan diffusjonsmodeller fungerer: LDM-er redigerer bilder ved å først konvertere dem til en komprimert versjon kalt en latent; støy blir deretter lagt til denne latente gjennom mange steg, til dataene blir nesten tilfeldige.

Modellen reverserer denne prosessen under generering, og fjerner støyen steg for steg. På hvert trinn i denne reverseringen, hjelper tekstprompten med å guide hvordan støyen skal fjernes, og former bildet for å matche prompten:

Sammenligning mellom genereringer fra et ubeskyttet bilde og et PhotoGuard-beskyttet bilde, med mellomliggende latente tilstander konvertert tilbake til bilder for visualisering.

Beskyttelsesmetodene legger til små mengder ekstra støy til det originale bildet før det går inn i denne prosessen. Mens disse perturbasjonene er små i begynnelsen, akkumulerer de seg når modellen anvender sine egne lag med støy.

Dette byggingen etterlater flere deler av bildet ‘usikre’ når modellen begynner å fjerne støy. Med større usikkerhet, hviler modellen mer på tekstprompten for å fylle inn de manglende detaljene, og gir prompten endå mer innflytelse enn den ville hatt normalt.

I virkeligheten gjør beskyttelsene det enklere for AI-en å omforme bildet for å matche prompten, i stedet for å gjøre det vanskeligere.

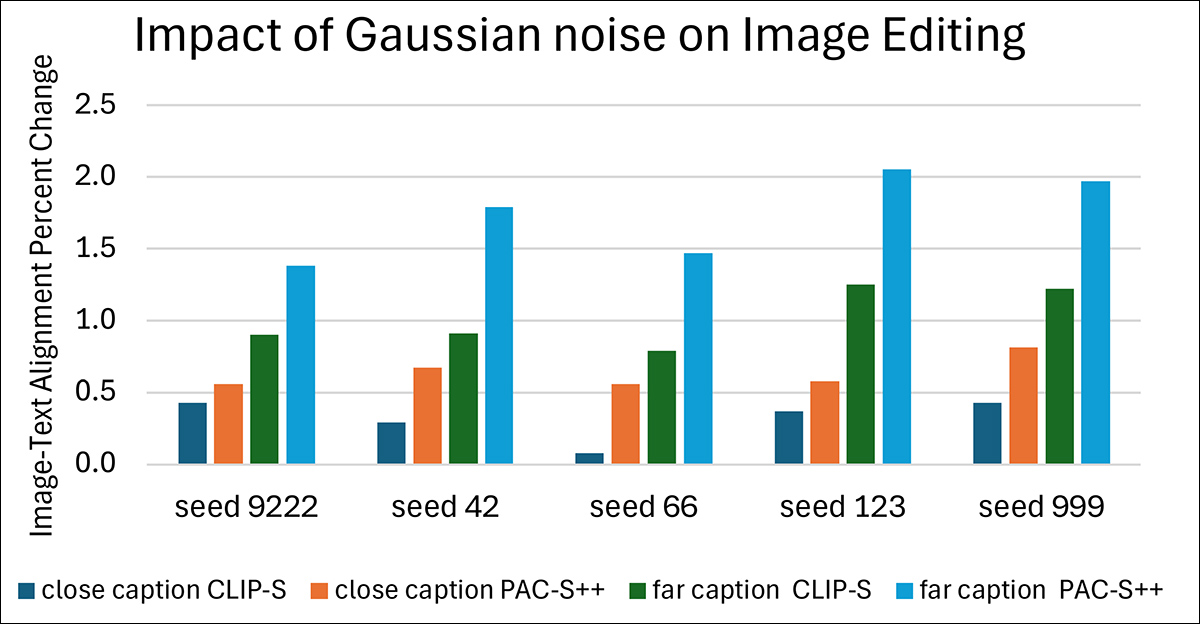

Til slutt utførte forfatterne en test som erstattet konstruerte perturbasjoner fra Raising the Cost of Malicious AI-Powered Image Editing papiret med ren Gaussisk støy.

Resultatene fulgte samme mønster som tidligere observert: over alle tester, forble Prosentuell Endring-verdiene positive. Selv denne tilfeldige, ustrukturerte støyen ledet til sterkere alignering mellom de genererte bildene og promptene.

Effekten av simuleringsbeskyttelse ved å bruke Gaussisk støy på Flickr8k-datasettet.

Dette støttet den underliggende forklaringen at all lagt til støy, uavhengig av dens design, skaper større usikkerhet for modellen under generering, og tillater tekstprompten å utøve enda mer kontroll over det endelige bildet.

Konklusjon

Forskingsscenen har vært i ferd med å fremme adversarial perturbasjon mot LDM-oppførselsproblemet i nesten like lenge som LDM-er har eksistert; men ingen robuste løsninger har kommet frem fra det ekstraordinære antallet papirer publisert på dette temaet.

Enten er de påførte forstyrrelsene for stor og reduserer kvaliteten på bildet, eller mønsterne viser seg å ikke være robuste mot manipulasjon og transformative prosesser.

Likevel er det en hard drøm å gi opp, siden alternativet ville synes å være tredjeparts-overvåking og proveniens-rammeverk som Adobe-ledede C2PA-scheme, som søker å opprettholde en kjede av besittelse for bilder fra kamera-sensoren og utover, men som ikke har noen innebygd forbindelse med det avbildede innholdet.

Uansett er det en vanskelig drøm å gi opp, siden alternativet ville synes å være tredjeparts-overvåking og proveniens-rammeverk som Adobe-ledede C2PA-scheme, som søker å opprettholde en kjede av besittelse for bilder fra kamera-sensoren og utover, men som ikke har noen innebygd forbindelse med det avbildede innholdet.

I alle tilfeller er det en vanskelig drøm å gi opp, siden alternativet ville synes å være tredjeparts-overvåking og proveniens-rammeverk som Adobe-ledede C2PA-scheme, som søker å opprettholde en kjede av besittelse for bilder fra kamera-sensoren og utover, men som ikke har noen innebygd forbindelse med det avbildede innholdet.

Først publisert mandag, 9. juni 2025