Kunstig intelligens

Neurale nettverk hjelper med å fjerne skyer fra luftbilder

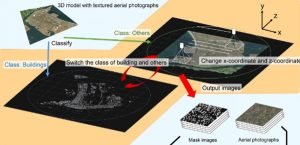

Forskere og vitenskapsmenn fra avdelingen for bærekraftig energi og miljøteknikk ved Osaka University kunne digitalt fjerne skyer fra luftbilder ved å bruke generative adversarial nettverk (GANs). Med de resulterende dataene kunne de automatisk generere nøyaktige datasett av bygning bildemasker.

Forskningen ble publisert i Advanced Engineering Informatics.

Teamet satte to kunstig intelligens (AI) nettverk mot hverandre for å forbedre datakvaliteten, og det krevde ikke tidligere merket bilder. Ifølge teamet kan disse nye utviklingene brukes i felt som sivilingeniør, der datavisjonsteknologi er viktig.

Maskinlæring for å reparere bilder

Maskinlæring brukes ofte til å reparere skjulte bilder, som luftbilder av bygninger skjult av skyer. Dette oppdraget kan gjøres manuelt, men det er tidskrevende og ikke like effektivt som maskinlæring salgoritmer. Selv de algoritmer som allerede er tilgjengelige, krever en stor mengde trening bilder, så det er avgjørende å fremme teknologien videre.

Dette er hva forskerne ved Osaka University gjorde da de anvendte generative adversarial nettverk. Et nettverk er “generativt nettverk”, og det foreslår rekonstruerte bilder uten skyer. Dette nettverket settes mot et “diskriminerende nettverk”, som avhenger av et konvolusjonsnevralt nettverk til å skille mellom de digitalt reparerte bildene og ekte bilder uten skyer.

Etterhvert som nettverkene går gjennom denne prosessen, blir de begge stadig bedre, noe som muliggjør å lage svært realistiske bilder med skyer digitalt slettet.

Kazunosuke Ikeno er første forfatter av artikkelen.

“Ved å trene det generative nettverket til å ‘narre’ det diskriminerende nettverket til å tro at et bilde er ekte, får vi rekonstruerte bilder som er mer selvkonsekvente,” sier Ikeno.

Bilde: 2021 Kazunosuke IKENO et al., Advanced Engineering Informatics

Å trene systemet

Teamet avhengte av 3D virtuelle modeller med fotografier fra en åpen kilde datasett, og dette ble brukt som inndata. Dette muliggjorde at systemet kunne automatisk generere digitale “masker” som lagde rekonstruerte bygninger over skyen.

Tomohiro Fukuda er seniorforfatter av forskningen.

“Denne metoden gjør det mulig å detektere bygninger i områder uten merket trening data,” sier Fukuda.

Det trente modellen kunne detektere bygninger med en “interseksjon over union” verdi på 0,651. Denne verdien er målet på hvor nøyaktig den rekonstruerte området korresponderer med det faktiske området.

Ifølge teamet kan denne metoden forbedre kvaliteten på andre datasett med bilder som er skjult, det trengs bare å utvides. Dette kan inkludere bilder i ulike felt, som helse, der det kan brukes til å forbedre medisinsk avbildning.