Kunstig intelligens

NeRF: Trening av droner i neurale lysmiljøer

Forskere fra Stanford University har utviklet en ny måte å trene droner til å navigere i fotorealistiske og svært nøyaktige miljøer, ved å utnytte den nylige interessen for Neural Radiance Fields (NeRF).

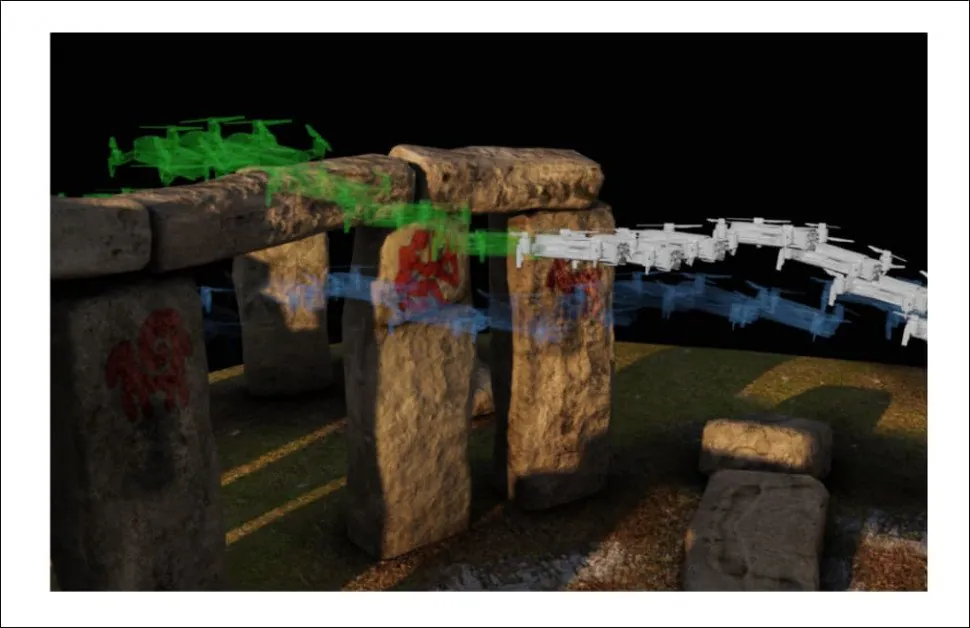

Droner kan trenes i virtuelle miljøer kartlagt direkte fra virkelige steder, uten behov for spesialisert 3D-scenerekonstruksjon. I dette bildet fra prosjektet, er vindforstyrrelse lagt til som en potensiell hindring for dronen, og vi kan se at dronen midlertidig avviker fra sin bane og kompenserer i siste øyeblikk for å unngå en potensiell hindring. Source: https://mikh3x4.github.io/nerf-navigation/

Metoden tilbyr muligheten for interaktiv trening av droner (eller andre typer objekter) i virtuelle scenarier som automatisk inkluderer voluminformasjon (for å beregne kollisjonsunngåelse), tekstur tegnet direkte fra virkelige fotos (for å hjelpe med å trene droners bilderekognitionnettverk på en mer realistisk måte), og virkelige lysforhold (for å sikre at en rekke lysforhold blir trent inn i nettverket, og unngå over-tilpasning eller over-optimisering til den opprinnelige snapshoten av scenen).

En couch-objekt navigerer en kompleks virtuell miljø som ville ha vært svært vanskelig å kartlegge ved hjelp av geometri-fangst og re-tekstur i tradisjonelle AR/VR-arbeidsflyter, men som ble rekonstruert automatisk i NeRF fra et begrenset antall fotos. Source: https://www.youtube.com/watch?v=5JjWpv9BaaE

Typiske NeRF-implementeringer inkluderer ikke banemekanismer, siden de fleste NeRF-prosjektene de siste 18 månedene har konsentrert seg om andre utfordringer, som scene-relighting, reflection-rendering, compositing og disentanglement av fanget elementer.

NeRF som VR/AR

Den nye artikkelen har tittelen Vision-Only Robot Navigation in a Neural Radiance World, og er et samarbeid mellom tre avdelinger ved Stanford University: Aeronautics and Astronautics, Mechanical Engineering og Computer Science.

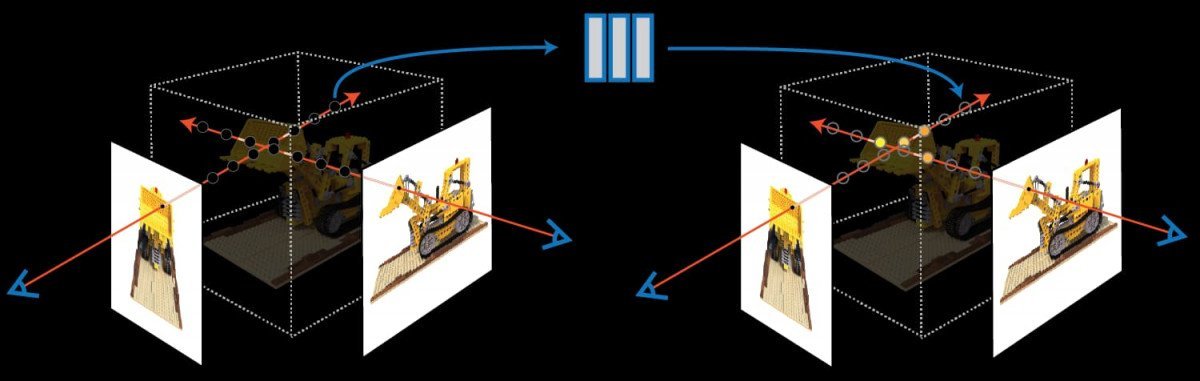

Arbeidet foreslår en navigasjonsramme som gir en robot en forhåndstrening NeRF-miljø, hvis volumtettlek avgrenser mulige baner for enheten. Det inkluderer også en filter for å anslå hvor roboten er inne i den virtuelle miljøet, basert på bilderekognition av robotens onboard RGB-kamera. På denne måten kan en drone eller robot “hallusinere” mer nøyaktig hva den kan forvente å se i en gitt miljø.

Prosjektets baneoptimerer navigerer gjennom en NeRF-modell av Stonehenge som ble generert gjennom fotogrammetri og bildefortolkning (i dette tilfelle, av mesh-modeller) inn i en Neural Radiance-miljø. Baneplanleggeren beregner en rekke mulige baner før den etablerer en optimal bane over buen.

Fordi en NeRF-miljø har fullt modellerte okklusjoner, kan dronen lære å beregne hindringer mer enkelt, siden neuralt nettverk bak NeRF kan kartlegge forholdet mellom okklusjoner og måten dronens onboard visjon-baserte navigasjonssystemer oppfatter miljøet. Den automatiske NeRF-genereringspipelinen tilbyr en relativt enkel metode for å lage hyper-realistiske treningsrom med bare noen få fotos.

Den online omplanleggingsrammen utviklet for Stanford-prosjektet muliggjør en resilient og fullstendig visjon-basert navigasjonspipeline.

Stanford-initiativet er blant de første som vurderer mulighetene for å utforske en NeRF-rom i sammenheng med en navigerbar og immersiv VR-liknende miljø. Neurale lysfelt er en fremvoksende teknologi, og er for tiden gjenstand for flere akademiske innsats for å optimalisere deres høye krav til beregningsressurser, samt å løse opp de fanget elementene.

NeRF er ikke (egentlig) CGI

Fordi en NeRF-miljø er en navigerbar 3D-scene, har det blitt en misforstått teknologi siden det oppstod i 2020, ofte bredt oppfattet som en metode for å automatisere skapelsen av mesh og teksturer, snarere enn å erstatte 3D-miljøer som er kjent for seere fra Hollywood VFX-avdelinger og de fantastiske scenene i Augmented Reality og Virtual Reality-miljøer.

NeRF trekker ut geometri- og teksturinformasjon fra et svært begrenset antall bildeperspektiver, og beregner forskjellen mellom bildene som voluminformasjon. Source: https://www.matthewtancik.com/nerf

I virkeligheten er NeRF-miljøet mer som et “live”-renderrrom, hvor en sammenslåing av piksel- og lysinformasjon blir beholdt og navigert i et aktivt og kjørende neuralt nettverk.

Nøkkelen til NeRFs potensiale er at det bare krever et begrenset antall bilder for å rekonstruere miljøer, og at de genererte miljøene inneholder all nødvendig informasjon for en høy-fidel rekonstruksjon, uten behov for tjenestene til modellører, teksturkunstnere, lysspesialister og de mange andre bidragsyterne til “tradisjonell” CGI.

Semantisk segmentering

Selv om NeRF i virkeligheten utgjør “Computer-Generated Imagery” (CGI), tilbyr det en helt annen metode, og en høyt automatisert pipeline. I tillegg kan NeRF isolere og “inkapsle” bevegelige deler av en scene, så de kan legges til, fjernes, akselereres og generelt operere som separate faseter i en virtuell miljø – en kapasitet som er langt utenfor den nåværende tilstanden for “Hollywood”-fortolkningen av hva CGI er.

En samarbeid fra Shanghai Tech University, utgitt sommeren 2021, tilbyr en metode for å individuere bevegelige NeRF-elementer til “limelige” faseter for en scene. Source: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativt er NeRFs arkitektur en slags “svart boks”; det er for tiden ikke mulig å trekke ut et objekt fra en NeRF-miljø og direkte manipulere det med tradisjonelle mesh-baserte og bilde-baserte verktøy, selv om flere forskningsinnsats begynner å gjøre gjennombrudd i å dekonstruere matrisen bak NeRFs neurale nettverks live-renderrmiljøer.

https://www.youtube.com/watch?v=5JjWpv9BaaE