Andersons vinkel

Jigsaw-pussler booster AI sin visuelle resonnering

Nye forskning indikerer at AI-modeller kan bli smartere på å se ved å løse jigsaw-pussler. Å omarrangere forvirrede bilder, videoer og 3D-scener hjelper dem å skjerpe sine visuelle ferdigheter uten behov for ekstra data, merker eller verktøy.

I den nåværende kampen for å skyve Multimodal Large Language Models (MLLMs) fremover, er det få enkle seiere og ingen gratis lunsjer.

Til tross for at mange av 2025s rekke av imponerende kinesiske FOSS-utgaver rapporteres å ha lavere utviklings- og driftskostnader, tenderer okkidentale utgaver å kaste mer på problemet: mer data-volum, mer inferens-kraft, mer elektrisitet (selv om ikke, som vi nylig noterte, mer faktiske menneskelige annotatorer, siden det er for dyrt selv for den $trillion+ skalaen gen-AI-revolusjonen).

I forskningslitteraturen tenderer de fleste såkalte ‘frie’ til Yak til utviklingen av AI-arkitekturer å tilby bare mindre inkrementelle forbedringer; eller også forbedringer i områder som ikke er de mest kritisk fulgte. Likevel er søket etter hittil uoppdagede ‘grunnleggende prinsipper’ som kunne akselerere utviklingstempoet for fristende å ikke oppgi.

Å plukke opp brikker

Mens ikke helt i den kategorien, hevder en ny akademisk samarbeid mellom kinesiske institusjoner å ha fastslått at å få VLMs å løse jigsaw-pussler forbedrer deres ytelse betydelig, selv om denne reinforcement learning-tilnærmingen tidligere har hatt dårligere resultater i dette området, og selv om det ikke krever noen ekstra systemer, hjelpe-modeller eller andre ‘bolt-on’-prosesser:

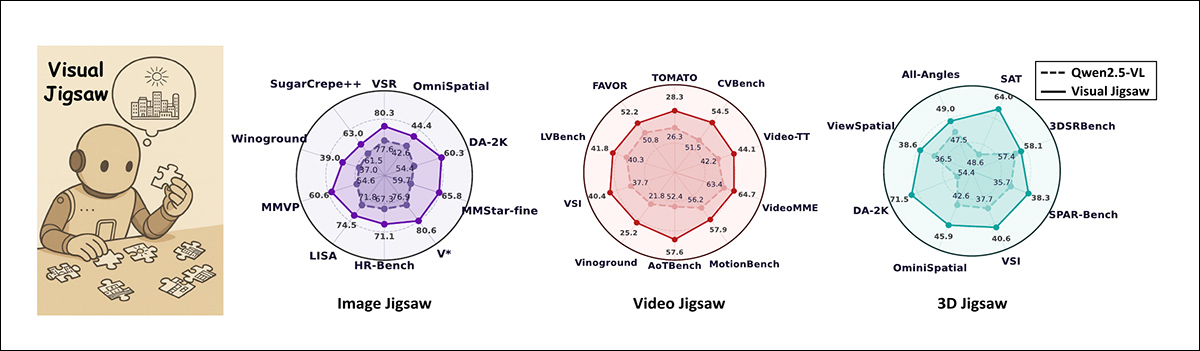

Visual Jigsaw er en selv-overvåket post-trening-ramme som forbedrer visjon-sentriske ferdigheter i multimodale store språk-modeller. Ved å trene på jigsaw-oppdrag på bilder, videoer og 3D-data, får modellene skarpe fine-grained, romlige og komposisjonelle persepsjoner i bilder, sterkere temporale resonnering i videoer og forbedret geometri-bevisst forståelse i 3D-scener. Radar-diagrammene i bildet over viser konsistente forbedringer over base Qwen2.5-VL, med verdi-skalaer justert for hver benchmark for klarhet. Kilde: https://arxiv.org/pdf/2509.25190

Systemet som er utviklet av forskerne, er tittelen Visual Jigsaw, og innebærer å trene eksisterende MLLMs på materiale som er fragmentert og tilfeldig spredt, som et jigsaw-pussel. Forfatterne utviklet tre modaliteter for denne tilnærmingen: bilde, video og 3D (dvs. CGI-stil mesh), og fant at en moderat tilpasning av samme prosess gav fordeler i alle tre domener:

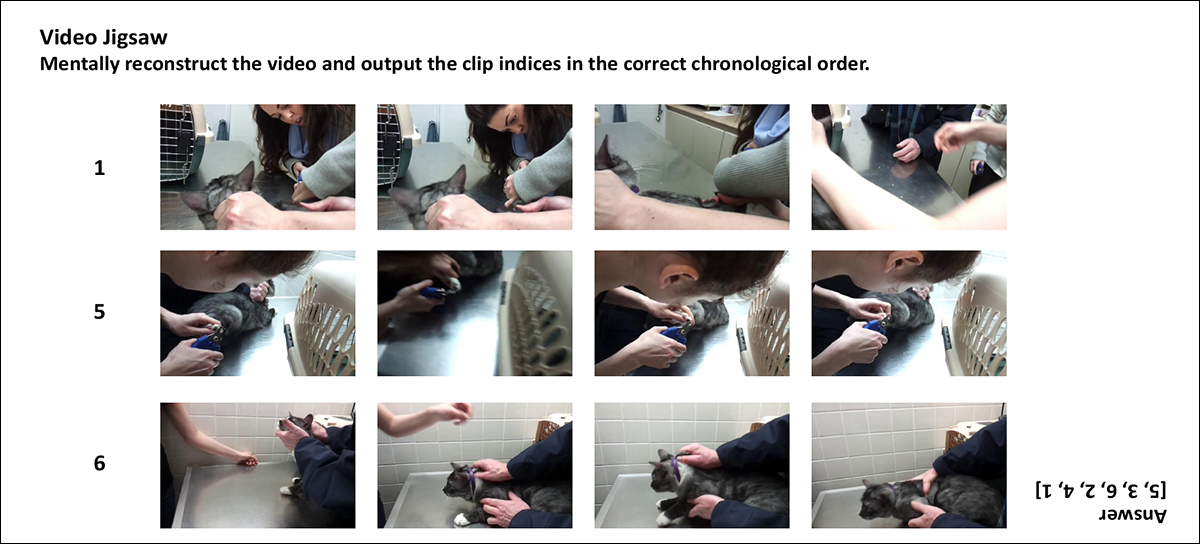

En representasjon av de tre Visual Jigsaw-oppdragene. I Image Jigsaw, deles et bilde inn i fliser, blandes og modellen predikerer den korrekte layouten; i Video Jigsaw, blandes klippene og modellen gjenopprettet deres rekkefølge i tid; i 3D Jigsaw, blandes punkter med forskjellige dybder og modellen rangerer dem fra nærmest til fjernest. Modell-utdata sammenlignes med grunn-sannhet, med delvis kreditt gitt for delvis korrekte løsninger.

Visual Jigsaw sin treningsmetode hjelper AI-modeller å forbedre seg i å forstå visuell informasjon ved å gjensamle disse forvirrede bildene, video-klippene eller 3D-data-punktene.

Prosessen er basert på ord fremfor bilder, og derfor er det ingen behov for modellen å generere bilder eller bruke noen ekstra visuelle komponenter. Denne metoden passer inn i et system kalt Reinforcement Learning from Verifiable Rewards (RLVR), hvor modellen får en belønning for korrekte svar basert på klare, automatiske regler; og hvor, derfor, ingen menneskelig merking er nødvendig.

Dette kritiske faktum er faktisk vanskelig å trekke ut av den nye artikkelen: at systemet samler puslet semantisk, gjennom beskrivelser, og ikke på den måten mennesker lærer å løse slike pusler:

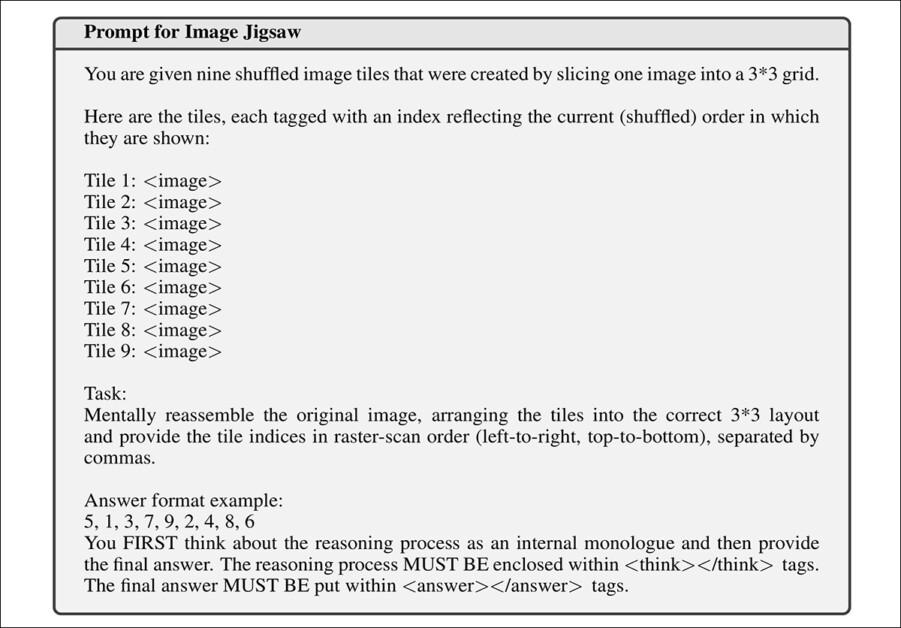

Fra den nye artikkelen sin supplerende materiale, et eksempel på RL-oppdrag som illustrerer den tekst-baserte naturen til denne tilleggs-læringsprosessen. Bildene som ville ha vært vist til MLLM, er ikke avbildet her.

Til tross for at MLLMs omfatter omfattende visjon-sentriske oppdrag, er de språk-baserte arkitekturer, ikke designet til å generere bilder, videoer eller form-representasjoner som 3D-mesh.

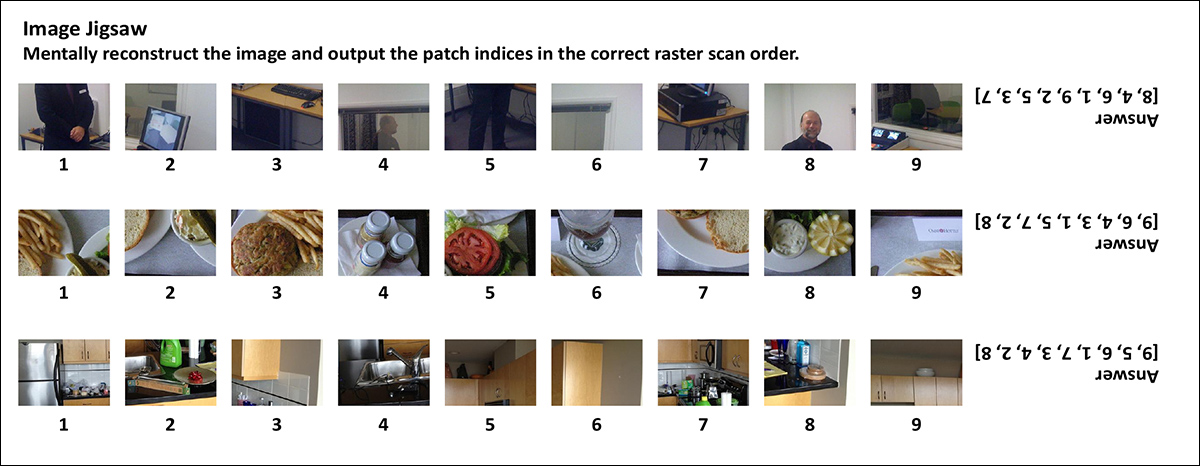

Eksempler fra image-jigsaw-oppdraget. Hver rad viser blandede fliser som modellen må gjenopprette til deres opprinnelige layout, med den korrekte arrangementen vist til høyre.

Uansett, denne type trening gjøres etter hoved-læringsfasen, når modellen allerede har noen evne til å forstå bilder.

Tidligere tilnærminger som den sveitsiske artikkelen fra 2017 Unsupervised Learning of Visual Representations by Solving Jigsaw Puzzles brukte denne typen forsterkningstilnærming med noe mindre suksess, på konvolusjonelle neurale nettverk (CNNs), en merkbart annen type arkitektur i sammenligning med en moderne MLLM.

Fra 2017-utgaven ‘Unsupervised Learning of Visual Representations by Solving Jigsaw Puzzles ‘, et tidlig eksempel på bruk av fragmentering som en belønning-basert utfordring for et neuralt system. Kilde: https://arxiv.org/pdf/1603.09246

I tester, ledet Visual Jigsaw til hva forfatterne hevder å være konsistente og målbare forbedringer på en rekke benchmarks: image-jigsaw-oppdraget forbedret fine-grained persepsjon, romlig layout-forståelse og komposisjonell resonnering; video-jigsaw-oppdraget forbedret modellens evne til å spore temporale sekvenser og resonere om hendelses-rekkefølge; og 3D-jigsaw-oppdraget styrket dybde-basert forståelse og romlig resonnering ved å bruke bare RGB-D-inndata.

Over alle tre modaliteter, gjentok artikkelen at den nye metoden overgikk flere konkurranse-baselines, til tross for at den ikke krevde noen arkitektoniske endringer, ekstra visuelle moduler eller ekstra overvåket data:

‘Omfattende eksperimenter demonstrerer betydelige forbedringer i fine-grained persepsjon, temporale resonnering og 3D-romlig forståelse. Våre funn understreker potensialet for selv-overvåkede visjon-sentriske oppdrag i post-trening av MLLMs og sikter til å inspirere videre forskning på visjon-sentriske pretext-designs.’

Den nye artikkelen er tittelen Visual Jigsaw Post-Training Improves MLLMs, og kommer fra seks forskere over Nanyang Technological University, Linköping University og SenseTime Research. Artikkelen følges av en prosjekt-side med live-demos (og du kan sogar laste ned ditt eget bilde i bilde-basert jigsaw-demo). Koden og vektene for prosjektet er blitt gjort generelt tilgjengelig,

Metode

Til tross for at vi skal se på måten informasjonen deles opp for å tilpasse de tre testede modalitetene, bør vi først vurdere belønning-designet for det nye systemet.

Visual Jigsaw-tilnærmingen scorer modell-respons ved hjelp av en gradert belønning, ikke bare en enkel pass eller feil. Hvis modellen predikerer den eksakte korrekte rekkefølgen av jigsaw-brikker, mottar den en full belønning; hvis svaret er nesten riktig, men ikke perfekt, mottar modellen delvis kreditt, skalert av en diskonteringsfaktor for å unngå å overvurdere nær-misser (dette forhindrer modellen fra å spille systemet ved å gjenta gjettinger som bare er delvis korrekte).

Ugyldige svar, som f.eks. ‘juks’ ved å bruke samme nummer på nytt, mottar en poengsum på null. For å oppmuntre konsistent formatering, må modellen plassere sin resonnering innen <think>-tagger og sin endelige svar innen <answer>-tagger. Den mottar en liten bonus hvis denne formaten brukes korrekt.

Bilder

For å lage et pusle-oppdrag for bilder-modaliteten, deles et bilde først inn i en grid av fliser ved å skjære det inn i like store blokker:

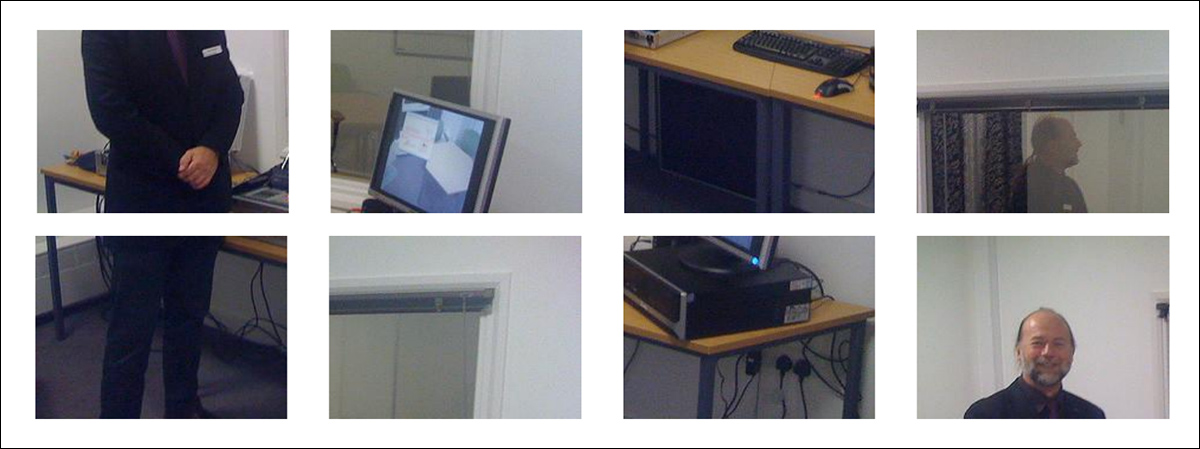

Eksempler på bilde-basert fliser for systemet å løse.

Flisene legges ut i en fast rekkefølge fra øverst-venstre til nederst-høyre, som med leserekkefølgen på en side, før de blandes med en tilfeldig shuffling. Modellen blir deretter eksponert for denne blandede mengden fliser, og må finne ut den opprinnelige rekkefølgen ved å predikere den korrekte permutasjon som gjenopprettet den opprinnelige layouten.

I trening, ble 118 000 bilder fra COCO-datasettet brukt, med hver bilde som ga ni fliser (dvs. ‘pusle-brikker’). Promten som ble gitt til systemet, vises tidligere i denne artikkelen (bildet over med underteksten som begynner ‘Fra den nye artikkelen sin supplerende materiale’).

Video

For video-jigsaw-oppdraget, deles en video inn i en sekvens av klipp ved å skjære den jevnt over tid, og deretter blandes klippene. Modellen blir deretter vist denne blandede sekvensen, og må finne ut deres korrekte, opprinnelige kronologiske rekkefølge.

Forkortede eksempler på video-pusle-utfordringen, fra artikkelen sin supplerende materiale.

Treningen for denne modaliteten brukte 100 000 videoer fra LLaVA-Video-datasettet, med hver video delt inn i seks klipp. For å forhindre modellen fra å utnytte åpenbare ramme-matching-koder ved klipp-grensene, ble 5 % av rammer på starten og slutten av hver klipp kuttet ut.

Klippene inneholdt ikke mer enn 12 ramer, hver med en maksimal oppløsning på 128x28x28 piksler. Videoer kortere enn 24 sekunder ble ekskludert.