Tankeledere

Autonome agenter trenger mer enn AI-observasjon

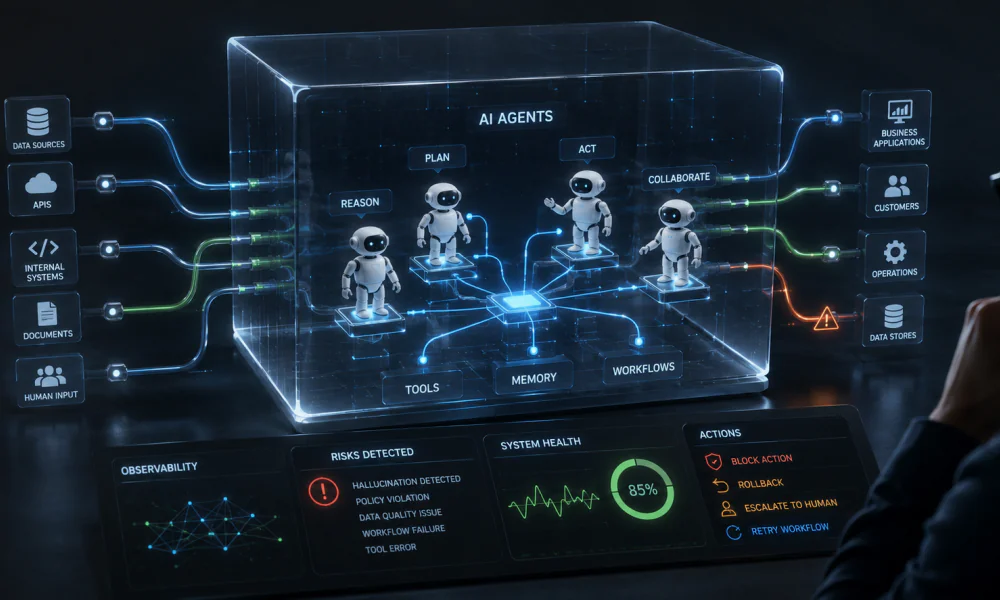

Etterhvert som bedrifter bruker AI-agenter til å tenke, handle og initiere arbeidsflyter, er det avgjørende å utvikle en plan for å overvåke og håndtere dem.

Når ulike komponenter i et AI-system begynner å fatte sine egne beslutninger, er observasjon alene ikke nok til å sikre at operasjonene forblir stabile, trygge eller pålitelige.

For å effektivt håndtere AI-agenter gjennom hele bedriften, må bedrifter lukke gapet mellom problemdeteksjon og handling. Dette går ut over å bare observere problemer; bedrifter må aktivt forhindre dem.

Oppblomstringen av autonome agenter

Den første bølgen av bedrifts-AI var promptbaserte systemer; en bruker stilte et spørsmål, modellen svarte og utvekslingen endte der. Selv om disse tidlige teknologiene i stor grad var reaktive, var de nyttige for søk, copiloter, innholdsskapning og sammenfatting.

Den påfølgende bølgen er annerledes. Ikke bare reagerer autonome AI-agenter, men de resonerer også over mål, velger verktøy, trekker ut informasjon, handler og initierer arbeidsflyter. De arbeider iblant sammen med andre agenter eller systemer og fungerer stadig oftere som operative spillere i bedriften, i stedet for å være et grensesnittlag for menneskelige instruksjoner.

Denne endringen er betydelig fordi den påvirker de operative egenskapene til AI. Teamene overvåker ikke lenger bare modellutdata. I stedet håndterer de dynamiske systemer som kan påvirke kunder, ansatte, infrastruktur, forretningsprosesser og andre applikasjoner umiddelbart.

Agentenes evner i dag

Agentenes talenter utvikler seg sammen med dem. Agenter kan velge hva de skal gjøre neste, bryte ned et mål i trinn og fullføre aktiviteter på ulike nivåer. Ved å kontakte API-er, spørre databaser, søke interne systemer, oppdatere poster og initiere nedstrøms handlinger, koordinerer de arbeidsflyter. Ved å integrere promter, minne, forretningsregler, hentet informasjon og sanntidsoperative signaler, kan agenter også fatter kontekstbaserte avgjørelser.

Mer avanserte agenter kan identifisere når en arbeidsflyt svikter, prøve igjen, eskalere problemer eller sende jobber til en menneskelig gjennomgåer. Innenfor CRM, billettbehandling, skyinfrastruktur, interne kunnskapsbaserte systemer, overvåkingsplattformer og forretningsapplikasjoner kan agenter fungere uavhengig. Vi forventer at disse ferdighetene vil fortsette å utvikle seg raskt.

Hvordan bedrifter integrerer autonome AI-agenter

Agenter blir inkorporert i en økende rekke organisatoriske operasjoner, og de kommer nærmere operative prosesser hvor hastighet, nøyaktighet, sikkerhet og styring er viktige. Noen av disse operasjonene inkluderer: kundeservice og sakshåndtering, hendelsesrespons og IT-drift, arbeidsflyter for DevOps og nettstedstabilitet, kodefeilretting og programvareutvikling, operativ og leverandørkjedeplanlegging, og mer.

Fremvoksende operative trusler

Imidlertid må bedrifter, ettersom agenter blir stadig mer uavhengige, håndtere en ny type operativ risiko.

- Dårlige valg er ikke bare anbefalt; de blir ofte utført

- Små feil kan raskt spre seg til andre koblete systemer

- Sanntids handlinger kan utløses av hallusinasjoner

- Agenter kan avvike fra forretningshensikt, politikk eller overholdelse

- Interaksjoner mellom flere komponenter kan føre til feil

- Automatisert beslutningstaking kan fatte beslutninger raskere enn menneskelig evaluering

Mens teamene kan observere symptomer, må de også kunne forstå årsakene bak systemets atferd. Bedrifts-AI trenger pålitelighetskontroller i tillegg til synlighet.

AI-systemers kompleksitet

I dag er AI-drevne systemer sjelden et enkelt modell. De er distribuerte, lagdelte systemer bestående av mange samspillende komponenter som inkluderer:

- Grunnleggende modeller (LLM-er)

- Fine-tuned eller oppgave-spesifikke små språkmodeller (SLM-er)

- Innbredningsmodeller

- Vektor-databaser

- Henting-pipelines og RAG-komponenter

- Prompt-mal og prompt-koordineringslag

- Trenings- og evaluering-datasett

- Sikkerhetsforanstaltninger og politiske lag

- Agenter og arbeidsflyter

- Verktøy-kallesystemer

- Telemetri (også kjent som logger, målinger og spor)

- Menneske-i-løkken-godkjenningssjekkpunkter

Deres risiko

Hver komponent legger til en annen feilmodus, og måten de samspiller på, legger til ytterligere kompleksitet. Selv om et system ser sterkt ut på infrastrukturnivå, kan det likevel fatte dårlige beslutninger og produsere tilfredsstillende resultater; samtidig som det bygger opp operativ risiko under overflaten.

Noen av de tilknyttede risikoene inkluderer: innføring av dårlige eller korrumperte inndata fra datapipelines, infrastruktur-bottlenecks som reduserer pålitelighet, skadelige eller feilaktige resultater, og operative bottlenecks i respons til menneskelig gjennomgang. Ytterligere kompliserende problemer, systemer med flere agenter eller trinn kan feile på måter som ikke er umiddelbart åpenbare.

AI-overvåkning

Tradisjonell overvåking er utilstrekkelig for å forstå prompt-atferd, henting-kvalitet, modell-drift, agent-eksekusjonskanaler eller sammenhengen mellom AI-atferd og nedstrøms forretnings- eller operativ påvirkning.

Dette er der AI-overvåkning kommer inn. AI-overvåkning muliggjør at teamene forstår hvordan AI-systemer fungerer i produksjon ved å samle inn, korrelere og evaluere inndata og utdata, ønskede atferd og beslutningssignaler generert av disse systemene. Dette er essensielt, fordi AI-systemer er spredt, ikke-deterministiske og ekstremt kontekst-sensitive.

AI-overvåkning tilbyr hel-dekkende innsikt i AI-arbeidsflyter, så teamene som bruker det kan forstå hvordan promter, modeller, henting-lag, verktøy og nedstrøms systemer samspiller under eksekvering.

AI-overvåkning muliggjør overvåking av ytelse og atferd, inkludert latency, kostnad, token-bruk, gjennomstrømming, feilrater, modell-atferd og utgangskvalitetsindikatorer. Den sporer og analyserer eksekverings-stier i komplekse agent-arbeidsflyter og demonstrerer hvordan resultater oppnås over flere trinn og avhengigheter.

AI-overvåkning finner også anomalier over operasjonelle og AI-signaler ved å avdekke anomalt atferd i modeller, pipelines, infrastruktur eller bruker-orienterte resultater før teamene oppdager dem manuelt. Den akselerer diagnostikk når noe går galt og gjør rotårsaks-undersøkelser enklere ved å inkludere AI-spesifikke operasjoner i system-telemetri (logger, målinger, spor og hendelser).

Overvåkning alene er ikke nok

Til tross for å være en essensiell forretningspraksis, har AI-overvåkning innebygde begrensninger.

Overvåkning er diagnostisk snarere enn forebyggende; teamene kan lære hva som gikk galt, men ikke nødvendigvis hvordan de kan forhindre det fra å skje igjen. Det er viktig å forstå at kunnskap om en agents tidligere handlinger ikke automatisk oversettes til kontroll over agentens fremtidige handlinger.

Når det gjelder komplekse, ikke-deterministiske systemer, kan overvåkning ofte overvelde teamene med data som fører til usikkerhet. I stedet for å tilby en operativ løsning, ender overvåkning ofte på en forklaring. Selv om teamene er klar over et problem, kan de likevel ikke ha automatiseringen, sikkerhetstiltakene og kontroll-løkene nødvendige for å iverksette korrektive tiltak.

Dette skaper et operativt gap. Bedrifter kan kanskje spore drift, dårlige resultater, farlig atferd eller redusert produktivitet, men de kan likevel ikke stoppe det fra å skje igjen, mildne effektene eller opprettholde autonome systemer innen trygge driftsparametre.

Dette betyr at teamene fortsetter å operere reaktivt. De bruker manuell inngripen når noe feiler, undersøker hendelser etter at de har skjedd, og avhenger av menneskelig arbeid for å kompensere for systemer som blir raskere og mer autonome.

Oversikt over AI-pålitelighet

AI-pålitelighet går ut over å bare observere problemer. Det er disiplinen som sikrer at AI-systemer fungerer trygt, konsekvent, forutsigbart og suksessfullt i sanntids produksjonsmiljøer. AI-pålitelighet forstår og håndterer det komplette systemet av systemer rundt AI. Den lukker løkken mellom deteksjon og handling.

AI-pålitelighet fokuserer på om hele AI-drevne systemet kan fungere innen rimelige operative begrensninger over tid, i stedet for bare å se om en modell ga en nøyaktig respons. Kvalitet, sikkerhet, motstandskraft, forklarbarhet, politisk overholdelse, kostnadseffektivitet og operativ stabilitet er alle en del av ligningen.

Overgangen fra deteksjon til forebygging

AI-pålitelighet reduserer tiden mellom å gjenkjenne et problem og å håndtere dets løsning. Den flytter samtalen fra “hva gikk galt?” til “hvor raskt vil vår AI forbedre seg?” Å bruke følgende teknikker flytter overvåkning fra passiv observasjon til proaktiv forebygging:

- Korrelere signaler over modeller, data og infrastruktur for å identifisere problemer

- Proaktiv problemdeteksjon før påvirkning

- Verifisere alle inndata og utdata i sannsynlig AI-systemer for å spore subtile atferdsendringer

- Opprette en tilbakemeldingsløkke mellom å detektere uønskede utdata i produksjon og å bruke det til å generere finjusteringsdata som forbedrer nøyaktigheten av underliggende modeller

- Flere agent-arbeidsflyt-sporing for å sikre at du kan koble punktene på hvordan og hvorfor data utviklet seg til å informere komplekse handlinger

- Definerte menneske-i-løkken-agenter-arbeidsflyter for trygg respons og automatisert remediering

Lukke gapet mellom kontroll og observasjon

Bedrifter kan dra nytte av rammer som integrerer synlighet og kontroll og krever mer enn bare et overvåkingslag på toppen av generativ AI. I både deterministiske og ikke-deterministiske systemer kan en pålitelighetsplattform identifisere, forutse, forklare og assistere i å kontrollere problemer.

Følgende bør inkluderes i en livskraftig ramme for pålitelige AI-operasjoner:

- Integrert telemetri for både IT-systemer og AI-systemer

- Hel-dekkende agent-arbeidsflyt- og system-avhengighets-sporing

- AI-spesifik atferd og kvalitets-sporing (promter og evalueringer)

- Avansert anomali-deteksjon, uavhengig av kilde

- Årsaks-ressonnering og rotårsaks-analyse

- Varsling som automatisk tilpasser seg din miljø og ikke krever manuell terskel

- Politikk-gjennomføring og sikkerhetsforanstaltninger

- Menneske-i-løkken-evaluering av sensitive eller betydelige handlinger

- Automatisering av arbeidsflyter og koordinering av remediering

- Bruk av prediktiv analyse for å forhindre problemer fra å oppstå

- Tilbakemeldingsløkker som kobler anomali-deteksjon med forbedret AI-modellkvalitet

Fasilitere AI-funksjoner

AI-systemer avhenger av infrastruktur, tjenester, datapipelines og operative rutiner; de feiler ikke på egen hånd. Teamene får det komplette bildet når både AI- og IT-pålitelighet kombineres.

En tynn LLM-omhulling bør ikke være grunnlaget for en pålitelig plattform. For å identifisere og fikse problemer som andre generative AI-verktøy overseer, bør en rekke AI-teknikker vurderes, inkludert usupervisert AI, prediktiv AI, årsaks-AI og generativ AI. Denne blandingen av teknikker er vanligvis kjent som “sammensatt AI”.

Generativ AI er god til å sammenfatte naturlig språk. Den er best egnet for situasjoner som krever resonnement gjennom ustrukturert data eller når det samhandler med mennesker. Men det passer ikke formen på de fleste pålitelighetsproblemer i produksjon.

Prediktiv AI fokuserer på å identifisere tidlige signaler før de blir nedbrudd, dårlige kundeopplevelser eller dyre feil ved å bruke anomali-deteksjonsalgoritmer.

Årsaks-AI hjelper å bestemme sanne årsaker for å avdekke om henting-kvalitet, modell-atferd, infrastruktur-senkhet eller nedstrøms systemfeil var årsaken til en ytelsesnedgang.

Usupervisert AI avdekker skjulte mønster, strukturer eller anomalier i data uten menneskelig veiledning. Den overgår generativ AI for pålitelighet fordi den fokuserer på å finne skjulte strukturer innen komplekse, uklassifiserte data for å gruppere lignende elementer eller finne relasjoner.

Når risiko, usikkerhet eller forretningsvirkninger er betydelige, må operative AI-agenter kunne automatisere reaksjon samtidig som de opprettholder menneskelig involvering for pålitelige operasjoner.

AI-modellens forståelse av den spesifikke forretningskonteksten kan forbedres i hver enkelt møte ved å bruke forsterkning-læring fra faktiske brukerdata i produksjon.

Selv de mest avanserte systemene går ut over å varsle; lukket remediering-løkke lærer av hver hendelse over tid, automatiserer gjenkjente reaksjoner og initierer trygge tiltak.

Forberedelse til autonome AI-systemer

Bedrifter kan forberede seg til autonome AI-systemer på flere måter. Først bør agenter sees på som operative systemer snarere enn som instrumenter for produktivitet. Så snart en agent har evnen til å handle, blir den en integrert del av bedriftens operasjoner og bør regulere det på en passende måte.

Teamene kan umiddelbart registrere signaler fra modeller, promter, verktøy, arbeidsflyter, infrastruktur og brukerresultater ved å instrumentere agenter. Denne grunnleggende overvåkningen kan ikke og bør ikke utsettes til agenter blir essensielle for bedriften.

Etablering av pålitelighetsstandarder før omfattende utrulling av agenter er også avgjørende. I stedet for å bli introdusert etterpå, bør akseptable terskler for sikkerhet, latency, feilrater, hallusinasjonsrisiko, politisk overholdelse og forretningsvirkning inkorporeres i deres design.

Å koble AI-atferd til de underliggende systemene og prosessene som støtter det, lar bedrifter integrere AI- og IT-operasjoner. Å bruke ulike verktøy for infrastruktur og modell-overvåkning skaper blindsoner.

Plattform-utvikling, SRE, sikkerhet, data-team, AI-team og forretnings-eiere må samarbeide for å tilby pålitelige AI-operasjoner, og autonome systemer går ut over konvensjonelle siloer.

Hver hendelse, anomali og nesten-uhell vil forbedre systemet ved å inkorporere tilbakemeldingsløkker i operasjoner, og lar bedrifter lære kontinuerlig fra produksjonsatferd.

Til slutt er det kritisk å velge plattformer som er ment for kontroll snarere enn bare overvåkning. Bedrifter vil dra nytte av systemer som integrerer overvåkning, prediksjon, forklaring og handling når AI-agenter blir mer autonome. Organisasjoner som vellykker å gå over fra å identifisere problemer til å trygt kontrollere resultater, vil være vinnerne.

Bunnpunktet

AI i bedrifter er nå et operativt system i bedriftsmiljøer snarere enn et verktøy. I sanntids produksjonsmiljøer garanterer tilføyelse av pålitelighet til AI-systemer trygge, konsekvente, forutsigbare og effektive operasjoner.