Kunstmatige intelligentie

Waarom kunnen generatieve videosystemen geen complete films maken?

De komst en vooruitgang van generatieve AI-video heeft veel incidentele waarnemers ertoe aangezet om te voorspellen dat machine learning het einde van de filmindustrie zoals we die kennen, zal betekenen – in plaats daarvan kunnen enkele creators Hollywood-achtige blockbusters thuis maken, op lokale of cloud-gebaseerde GPU-systemen.

Is dit mogelijk? Zelfs als het mogelijk is, is het imminent, zoals zo veel mensen geloven?

Dat individuen uiteindelijk in staat zullen zijn om films te maken, in de vorm die we kennen, met consistente personages, narratieve continuïteit en totale fotorealisme, is heel goed mogelijk – en misschien zelfs onvermijdelijk.

Er zijn echter verschillende fundamentele redenen waarom dit niet waarschijnlijk zal gebeuren met videosystemen op basis van Latent Diffusion Models.

Dit laatste feit is belangrijk omdat, op dit moment, deze categorie elke populaire text-to-video (T2) en image-to-video (I2V) systeem omvat die beschikbaar is, waaronder Minimax, Kling, Sora, Imagen, Luma, Amazon Video Generator, Runway ML, Kaiber (en, voor zover we kunnen zien, Adobe Firefly’s aankomende videofunctionaliteit); onder veel anderen.

Hier overwegen we de mogelijkheid van echte auteur full-length gen-AI-producties, gemaakt door individuen, met consistente personages, cinematografie en visuele effecten die minstens gelijk zijn aan de huidige stand van de techniek in Hollywood.

Laten we eens kijken naar enkele van de grootste praktische obstakels voor de uitdagingen die hierbij komen kijken.

1: Je kunt geen nauwkeurige follow-on shot maken

Narratieve inconsistentie is de grootste van deze obstakels. Het feit is dat geen enkel momenteel beschikbaar videosysteem een echt nauwkeurige ‘follow on’ shot* kan maken.

Dit komt omdat het denoising diffusion model in het hart van deze systemen afhankelijk is van random noise, en dit kernprincipe is niet vatbaar voor het opnieuw interpreteren van exact dezelfde inhoud twee keer (d.w.z. vanuit verschillende hoeken, of door de vorige shot te ontwikkelen tot een follow-on shot die consistent is met de vorige shot).

Waar tekstprompts worden gebruikt, alleen of samen met geüploade ‘seed’ afbeeldingen (multimodaal invoer), zullen de tokens die zijn afgeleid van de prompt semantisch geschikte inhoud oproepen uit de getrainde latent space van het model.

Echter, verder gehinderd door het ‘random noise’ factor, zal het nooit op dezelfde manier doen.

Dit betekent dat de identiteiten van personen in de video geneigd zijn te verschuiven, en objecten en omgevingen zullen niet overeenkomen met de initiële shot.

Dit is waarom virale clips die buitengewone visuals en Hollywood-niveau output laten zien, meestal enkelvoudige shots zijn, of een ‘showcase montage’ van de mogelijkheden van het systeem, waar elke shot verschillende personages en omgevingen heeft.

Uit een generatieve AI-montage van Marco van Hylckama Vlieg – bron: https://www.linkedin.com/posts/marcovhv_thanks-to-generative-ai-we-are-all-filmmakers-activity-7240024800906076160-nEXZ/

De implicatie in deze verzamelingen van ad hoc video-generaties (die in het geval van commerciële systemen onoprecht kunnen zijn) is dat het onderliggende systeem kan continue en consistente verhalen creëren.

De analogie die hier wordt uitgebuit, is een filmtrailer, die slechts een minuut of twee beeldmateriaal uit de film laat zien, maar de kijker reden geeft om te geloven dat de hele film bestaat.

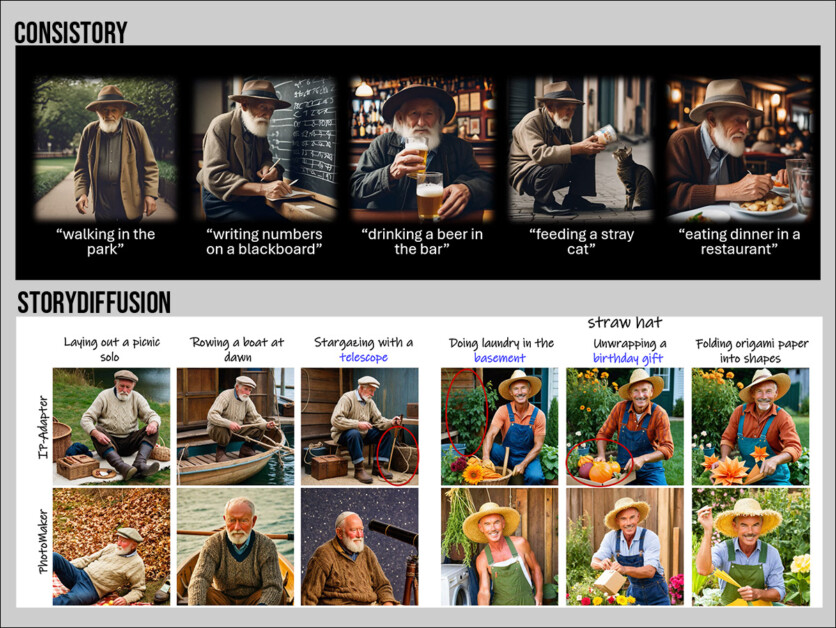

De enige systemen die momenteel narratieve consistentie bieden in een diffusiemodel, zijn die welke stilbeelden produceren. Deze omvatten NVIDIA’s ConsiStory, en diverse projecten in de wetenschappelijke literatuur, zoals TheaterGen, DreamStory, en StoryDiffusion.

Twee voorbeelden van ‘statische’ narratieve consistentie, van recente modellen:: Bronnen: https://research.nvidia.com/labs/par/consistory/ en https://arxiv.org/pdf/2405.01434

In theorie zou je een betere versie van dergelijke systemen (geen van de bovenstaande zijn echt consistent) kunnen gebruiken om een reeks image-to-video shots te creëren, die kunnen worden samengesteld tot een sequens.

Op het huidige niveau van de techniek produceert deze benadering geen plausibele follow-on shots; en, in elk geval, zijn we al afgedwaald van de auteur droom door een laag complexiteit toe te voegen.

We kunnen bovendien Low Rank Adaptation (LoRA) modellen gebruiken, specifiek getraind op personages, dingen of omgevingen, om betere consistentie over shots te behouden.

Echter, als een personage in een nieuwe jurk wil verschijnen, moet er meestal een geheel nieuw LoRA worden getraind dat het personage in die jurk belichaamt (hoewel sub-concepten zoals ‘rode jurk’ kunnen worden getraind in individuele LoRAs, samen met passende afbeeldingen, zijn ze niet altijd gemakkelijk te werken).

Dit voegt aanzienlijke complexiteit toe, zelfs aan een openingscène in een film, waar een persoon uit bed komt, een ochtendjas aantrekt, gaapt, uit het slaapkamerraam kijkt en naar de badkamer gaat om zijn tanden te poetsen.

Een dergelijke scène, die ongeveer 4-8 shots bevat, kan in één ochtend worden gefilmd met conventionele filmmethoden; op het huidige niveau van de techniek in generatieve AI, kan dit potentieel weken van werk vertegenwoordigen, meerdere getrainde LoRAs (of andere adjunctsystemen) en een aanzienlijke hoeveelheid post-productie

Als alternatief kan video-naar-video worden gebruikt, waarbij alledaagse of CGI-beelden worden getransformeerd door tekstprompts in alternatieve interpretaties. Runway biedt een dergelijk systeem, bijvoorbeeld.

CGI (links) uit Blender, geïnterpreteerd in een tekst-geassisteerde Runway video-naar-video-experiment door Mathieu Visnjevec – Bron: https://www.linkedin.com/feed/update/urn:li:activity:7240525965309726721/