Kunstmatige intelligentie

De Ontwijkbare Definitie van ‘Deepfake’

Een overtuigende nieuwe studie uit Duitsland bekritiseert de EU AI Act’s definitie van de term ‘deepfake’ als te vaag, vooral in de context van digitale beeldmanipulatie. De auteurs betogen dat de nadruk van de Act op inhoud die lijkt op echte personen of gebeurtenissen – maar mogelijk lijkt nep – een gebrek aan duidelijkheid vertoont.

Ze benadrukken ook dat de uitzonderingen van de Act voor ‘standaard bewerking’ (d.w.z. vermeend kleine AI-geassisteerde wijzigingen in afbeeldingen) geen rekening houden met zowel de alomtegenwoordige invloed van AI in consumententoepassingen als de subjectieve aard van artistieke conventies die voorafgaan aan de komst van AI.

Onnauwkeurige wetgeving op deze kwesties leidt tot twee belangrijke risico’s: een ‘verkoelend effect’, waarbij de wetgeving de innovatie en de adoptie van nieuwe systemen remt vanwege de brede interpretatieve reikwijdte; en een ‘scofflaw-effect’, waarbij de wetgeving wordt genegeerd omdat deze als te verregaand of irrelevant wordt beschouwd.

In beide gevallen verschuift de verantwoordelijkheid voor het vaststellen van praktische juridische definities effectief naar toekomstige rechterlijke uitspraken – een voorzichtige en risicomijdende benadering van wetgeving.

AI-gebaseerde beeldmanipulatietechnologieën blijven opvallend voorop lopen op de capaciteit van de wetgeving om deze aan te pakken, lijkt het. Zo is een opvallend voorbeeld van de groeiende elasticiteit van het concept van AI-gedreven ‘automatische’ nabewerking, zoals de paper opmerkt, de ‘Scene Optimizer’-functie in recente Samsung-camera’s, die gebruikersafbeeldingen van de maan (een uitdagend onderwerp) kan vervangen door een AI-gegenereerde, ‘geraffineerde’ afbeelding:

Top left, an example from the new paper of a real user-taken image of the moon, to the left of a Samsung-enhanced version automatically created with Scene Optimizer; Right, Samsung’s official illustration of the process behind this; lower left, examples from the Reddit user u/ibreakphotos, showing (left) a deliberately blurred image of the moon and (right), Samsung’s re-imagining of this image – even though the source photo was a picture of a monitor, and not the real moon. Sources (clockwise from top-left): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the-moon/; https:/reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

In de onderste linkerhoek van de afbeelding hierboven zien we twee afbeeldingen van de maan. De linker is een foto genomen door een Reddit-gebruiker. Hier is de afbeelding door de gebruiker expres vaag en verkleind.

Rechts zien we een foto van dezelfde gedegradeerde afbeelding genomen met een Samsung-camera met AI-geassisteerde nabewerking ingeschakeld. De camera heeft de herkende ‘maan’-object automatisch ‘verrijkt’, zelfs als het geen echte maan was.

Het paper richt diepere kritiek op de Best Take-functie die is geïntegreerd in Google’s recente smartphones – een omstreden AI-functie die de ‘beste’ delen van een groepsfoto samenstelt, waarbij meerdere seconden van een fotografische sequentie worden gescand, zodat glimlachen naar voren of naar achteren in de tijd worden geschoven als nodig – en niemand wordt getoond in het midden van een knipperen.

Het paper stelt dat dit soort samengestelde proces het potentieel heeft om gebeurtenissen verkeerd weer te geven:

‘[In] een typische groepsfotosetting zou een gemiddelde kijker waarschijnlijk nog steeds de resulterende foto als authentiek beschouwen. De glimlach die wordt ingevoegd, bestond binnen een paar seconden van de rest van de foto die werd genomen.

‘Aan de andere kant is de tien seconden tijdspanne van de best take-functie voldoende voor een stemmingverandering. Iemand kan hebben opgehouden met glimlachen terwijl de rest van de groep lacht om een grap ten koste van hem.

‘Als gevolg daarvan gaan we ervan uit dat zo’n groepsfoto goed een deep fake kan vormen.’

De nieuwe paper heeft als titel Wat is een Deep Fake? De vage grens tussen legitieme verwerking en manipulatie onder de EU AI Act, en komt van twee onderzoekers aan het Computational Law Lab van de Universiteit van Tübingen en de Saarland Universiteit.

Oude trucs

Het manipuleren van tijd in de fotografie is veel ouder dan consumenten-AI. De auteurs van het nieuwe paper wijzen op het bestaan van veel oudere technieken die als ‘onecht’ kunnen worden beschouwd, zoals de concatenatie van meerdere opeenvolgende afbeeldingen in een High Dynamic Range (HDR)-foto, of een ‘genaaide’ panoramafoto.

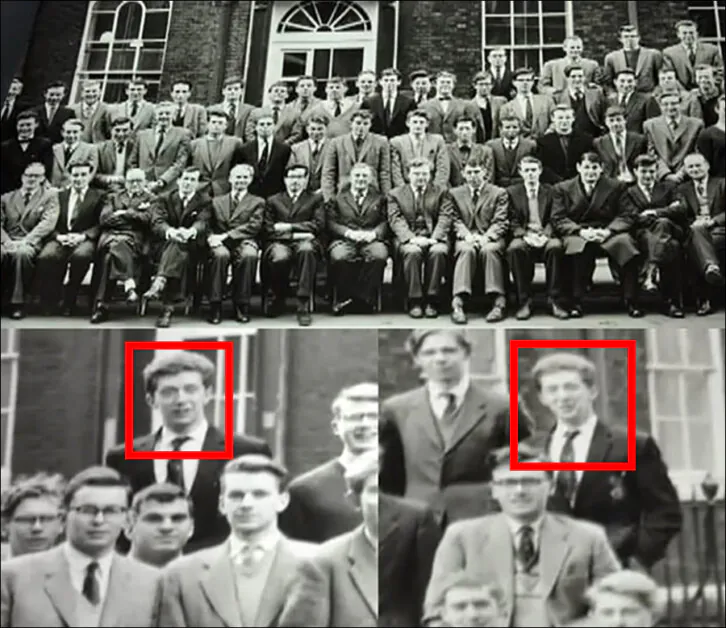

In feite waren enkele van de oudste en meest amusante fotografische vervalsingen traditioneel gemaakt door schoolkinderen die van het ene einde van een schoolgroep naar het andere renden, voor de baan van de speciale panoramische camera’s die vroeger werden gebruikt voor sport- en schoolgroepsfotografie – waardoor de leerling tweemaal in dezelfde afbeelding kon verschijnen:

De verleiding om panoramische camera’s tijdens groepsfotografie te bedriegen was te groot voor veel studenten, die bereid waren om een slechte sessie bij het hoofd van de school te riskeren om zichzelf in schoolfoto’s te ‘klonen’. Source: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Tenzij je een foto maakt in RAW-modus, die in wezen de camerlenssensor dump naar een zeer groot bestand zonder enige vorm van interpretatie, is het waarschijnlijk dat je digitale foto’s niet volledig authentiek zijn. Camerasystemen passen routinematig ‘verbeteringsalgoritmen’ toe, zoals beeldscherpte en witbalans, standaard – en hebben dit gedaan sinds de oorsprong van consumentenfotografie op niveau.

De auteurs van het nieuwe paper betogen dat zelfs deze oudere soorten digitale foto-augmentatie niet ‘realiteit’ vertegenwoordigen, aangezien dergelijke methoden zijn ontworpen om foto’s aantrekkelijker te maken, niet ‘echter’.

De studie suggereert dat de EU AI Act, zelfs met latere amendementen zoals recitals 123–27, alle fotografische output binnen een bewijs-kader plaatst dat niet geschikt is voor de context waarin foto’s tegenwoordig worden geproduceerd, in tegenstelling tot de (nominale objectiviteit) van beveiligingscamera-beelden of forensische fotografie. De meeste afbeeldingen die door de AI Act worden behandeld, zijn waarschijnlijker afkomstig uit contexten waarin fabrikanten en online platforms actief creatieve foto-interpretatie promoten, inclusief het gebruik van AI.

De onderzoekers suggereren dat foto’s ‘nooit een objectieve weergave van de realiteit’ zijn. Overwegingen zoals de locatie van de camera, de diepte van het veld dat is gekozen, en lichtkeuzes, dragen allemaal bij aan het maken van een foto diep subjectief.

Het paper merkt op dat routine ‘opruimtaken’ – zoals het verwijderen van sensordust of ongewenste powerlines uit een anders goed samengestelde scène – alleen half-geautomatiseerd waren voordat de opkomst van AI: gebruikers moesten handmatig een gebied selecteren of een proces initiëren om hun gewenste resultaat te bereiken.

Vandaag de dag worden deze bewerkingen vaak getriggerd door tekstprompts van een gebruiker, meestal in tools zoals Photoshop. Op consumentenniveau worden dergelijke functies steeds vaker geautomatiseerd zonder gebruikersinvoer – een resultaat dat blijkbaar door fabrikanten en platforms als ‘vanzelfsprekend wenselijk’ wordt beschouwd.

De verwaterde betekenis van ‘Deepfake’

Een centrale uitdaging voor wetgeving rond AI-gealtereerde en AI-gegenereerde beelden is de ambiguïteit van de term ‘deepfake’, die de afgelopen twee jaar aanzienlijk is uitgebreid.

Oorspronkelijk werden de termen alleen toegepast op video-uitvoer van autoencoder-gebaseerde systemen zoals DeepFaceLab en FaceSwap, beide afgeleid van anonieme code die eind 2017 op Reddit werd gepost.

Vanaf 2022 kwam de komst van Latent Diffusion Models (LDM’s) zoals Stable Diffusion en Flux, evenals tekst-naar-video-systemen zoals Sora, waardoor identiteitsuitwisseling en aanpassing mogelijk werden, met verbeterde resolutie, veelzijdigheid en geloofwaardigheid. Nu was het mogelijk om diffusie-gebaseerde modellen te maken die bekende personen en politici konden weergeven. Aangezien de term ‘deepfake’ al een kopstuk-garnerende schat voor mediaproducenten was, werd deze uitgebreid om deze systemen te omvatten.

Later, zowel in de media als in de onderzoeksliteratuur, kwam de term ook te omvatten tekstgebaseerde impersonatie. Op dat moment was de oorspronkelijke betekenis van ‘deepfake’ zo goed als verloren gegaan, terwijl de uitgebreide betekenis constant evolueerde en steeds meer verwaterde.

Maar aangezien het woord zo ontvlambaar en galvaniserend was, en nu een krachtige politieke en media-aandachttrekker was, bleek het onmogelijk om het op te geven. Het trok lezers naar websites, financiering voor onderzoekers en aandacht voor politici. Deze lexicale ambiguïteit is de belangrijkste focus van het nieuwe onderzoek.

Zoals de auteurs opmerken, schetst artikel 3(60) van de EU AI Act vier voorwaarden die een ‘deepfake’ definiëren.

1: Ware Maan

Ten eerste moet de inhoud gegenereerd of gemanipuleerd zijn, d.w.z. hetzij van scratch gemaakt met AI (generatie) of gewijzigd van bestaande gegevens (manipulatie). Het paper benadrukt de moeilijkheid om ‘acceptabele’ beeldbewerkingsresultaten en manipulatieve deepfakes te onderscheiden, gezien digitale foto’s sowieso nooit ware weergaven van de realiteit zijn.

Het paper stelt dat een door Samsung gegenereerde maan argumentatief authentiek is, aangezien de maan onwaarschijnlijk van uiterlijk zal veranderen, en aangezien de door AI gegenereerde inhoud, getraind op echte maanbeelden, waarschijnlijk nauwkeurig is.

Echter, de auteurs stellen ook dat aangezien het Samsung-systeem is aangetoond om een ‘verfijnde’ afbeelding van de maan te genereren in een geval waarin de bronafbeelding niet de maan zelf was, dit een ‘deepfake’ zou zijn.

Het zou onpraktisch zijn om een uitgebreide lijst van verschillende use-cases rond deze soort ad hoc-functionaliteit op te stellen. Daarom lijkt de verantwoordelijkheid voor de definitie opnieuw bij de rechtbanken te liggen.

2: TekstFakes

Ten tweede moet de inhoud in de vorm van beeld, audio of video zijn. Tekstinhoud, hoewel onderworpen aan andere transparantie-verplichtingen, wordt niet beschouwd als een deepfake onder de AI Act. Dit wordt niet in detail behandeld in de nieuwe studie, hoewel het een aanzienlijke invloed kan hebben op de effectiviteit van visuele deepfakes (zie hieronder).

3: Echte Wereldproblemen

Ten derde moet de inhoud lijken op bestaande personen, objecten, plaatsen, entiteiten of gebeurtenissen. Deze voorwaarde vestigt een verbinding met de echte wereld, wat betekent dat zuiver gefabriceerde beelden, zelfs als ze fotorealistisch zijn, niet in aanmerking komen als deepfakes. Recital 134 van de EU AI Act benadrukt het ‘gelijkenis’-aspect door het woord ‘merkbaar’ (een schijnbare verwijzing naar latere juridische oordelen) toe te voegen.

De auteurs, die verwijzen naar eerder werk, overwegen of een AI-gegenereerd gezicht moet behoren tot een echt persoon, of dat het alleen maar voldoende gelijk moet zijn aan een echt persoon, om aan deze definitie te voldoen.

Bijvoorbeeld, hoe kan men bepalen of een reeks van fotorealistische afbeeldingen die de politicus Donald Trump weergeven, de intentie heeft om te imiteren, als de afbeeldingen (of toegevoegde teksten) hem niet specifiek noemen? Gezichtsherkenning? Gebruikersonderzoeken? Een rechtersdefinitie van ‘gezond verstand’?

Terugkerend naar het ‘TekstFakes’-probleem (zie hierboven), vormen woorden vaak een aanzienlijk deel van de visuele deepfake. Bijvoorbeeld, het is mogelijk om een (ongewijzigde) afbeelding of video van ‘persoon a’ te nemen en in een onderschrift of een socialemediabericht te zeggen dat de afbeelding van ‘persoon b’ is (onder de voorwaarde dat de twee personen op elkaar lijken).

In een dergelijk geval is geen AI nodig, en het resultaat kan opvallend effectief zijn – maar vormt zo’n laagtechnologische benadering ook een ‘deepfake’?

4: Retoucheer, Remodel

Ten slotte moet de inhoud authentiek of waarheidsgetrouw lijken voor een persoon. Deze voorwaarde benadrukt de perceptie van menselijke kijkers. Inhoud die alleen wordt herkend als een weergave van een echt persoon of object door een algoritme, zou niet als een deepfake worden beschouwd.

Van alle voorwaarden in 3(60) is dit de meest voor de hand liggende verwijzing naar het latere oordeel van een rechtbank, aangezien het geen interpretatie via technische of gemechaniseerde middelen toelaat.

Er zijn duidelijk enkele inherente moeilijkheden om overeenstemming te bereiken over zo’n subjectieve stipulatie. De auteurs merken bijvoorbeeld op dat verschillende mensen, en verschillende soorten mensen (zoals kinderen en volwassenen), verschillend geneigd kunnen zijn om in een bepaalde deepfake te geloven.

De auteurs merken verder op dat de geavanceerde AI-mogelijkheden van tools zoals Photoshop de traditionele definities van ‘deepfake’ uitdagen. Terwijl deze systemen mogelijk basisbescherming bieden tegen omstreden of verboden inhoud, breiden ze het concept van ‘retoucheren’ aanzienlijk uit. Gebruikers kunnen nu objecten toevoegen of verwijderen in een overtuigende, fotorealistische manier, waardoor een professioneel niveau van authenticiteit wordt bereikt dat de grenzen van beeldmanipulatie herdefinieert.

De auteurs stellen:

‘We betogen dat de huidige definitie van deep fakes in de AI Act en de corresponderende verplichtingen niet voldoende zijn gespecificeerd om de uitdagingen die door deep fakes worden gesteld aan te pakken. Door de levenscyclus van een digitale foto van de camerasensor tot de digitale bewerkingsfuncties te analyseren, komen we tot de conclusie dat:

‘(1.) Deep fakes zijn slecht gedefinieerd in de EU AI Act. De definitie laat te veel ruimte voor wat een deep fake is.

‘(2.) Het is onduidelijk hoe bewerkingsfuncties zoals Google’s “best take”-functie kunnen worden beschouwd als een uitzondering op transparantie-verplichtingen.

‘(3.) De uitzondering voor in wezen bewerkte inhoud roept vragen op over wat substantiële bewerking van inhoud inhoudt en of deze bewerking voor een natuurlijk persoon waarneembaar moet zijn.’

Uitzonderingen

De EU AI Act bevat uitzonderingen die, zoals de auteurs betogen, zeer permissief kunnen zijn. Artikel 50(2), stellen zij, biedt een uitzondering in gevallen waarin de meerderheid van een originele bronafbeelding niet wordt gewijzigd. De auteurs merken op:

‘Wat kan worden beschouwd als inhoud in de zin van Artikel 50(2) in gevallen van digitale audio, afbeeldingen en video’s? Bijvoorbeeld, in het geval van afbeeldingen, moeten we de pixelruimte of de zichtbare ruimte die voor mensen waarneembaar is, overwegen? Wezenlijke manipulaties in de pixelruimte kunnen de menselijke perceptie niet veranderen, en aan de andere kant kunnen kleine perturbaties in de pixelruimte de perceptie dramatisch veranderen.’

De onderzoekers geven het voorbeeld van het toevoegen van een handvuurwapen aan de foto van een persoon die naar iemand wijst. Door het vuurwapen toe te voegen, verandert men zo weinig als 5% van de afbeelding; echter is de semantische betekenis van het gewijzigde gedeelte opvallend.

Daarom lijkt deze uitzondering geen rekening te houden met enig ‘gezond verstand’-begrip van het effect dat een klein detail kan hebben op de algehele betekenis van een afbeelding.

Section 50(2) biedt ook uitzonderingen voor een ‘assistiefunctie voor standaard bewerking’. Aangezien de Act niet definieert wat ‘standaard bewerking’ betekent, lijkt zelfs een post-processingfunctie als Google’s Best Take beschermd te worden door deze uitzondering, merken de auteurs op.

Conclusie

De vermelde bedoeling van het nieuwe werk is om interdisciplinaire studie rond de regulering van deepfakes aan te moedigen en als startpunt te dienen voor nieuwe dialogen tussen computerwetenschappers en juridische geleerden.

Echter, het paper zelf komt op verschillende punten tot een tautologie: het gebruikt de term ‘deepfake’ vaak alsof de betekenis vanzelfsprekend is, terwijl het de EU AI Act bekritiseert voor het niet definiëren van wat een deepfake werkelijk is.

First published Monday, December 16, 2024