Thought leaders

Een praktische playbook voor verdedigbare LLM-uitvoer

Er gaat een stilzwijgende veronderstelling door de meeste enterprise GenAI-implementaties heen: als de uitvoer er goed uitziet, is hij goed. In omgevingen met lage risico’s is dat een redelijke shortcut. In gereguleerde industrieën, zoals de gezondheidszorg, financiën, farmacie en kwaliteitsborging, is het een aansprakelijkheid die op de loer ligt.

Het moment dat een LLM-uitvoer een klinische beslissing, een financieel verslag of een compliance-document beïnvloedt, stopt de vlotheid met een proxy voor betrouwbaarheid te zijn. En wanneer een auditor, toezichthouder of juridisch team vraagt welke gegevens zijn gebruikt, welke regels zijn toegepast en wie het heeft goedgekeurd, is “het model zei het zo” geen antwoord dat iemand kan ondertekenen.

Dit is de accountability-kloof die de meeste GenAI-teams niet ontwerpen. Hier is hoe je hem kunt dichten.

Waarom “er goed uitziet” de verkeerde standaard is

Traditionele AI-evaluatie richt zich op nauwkeurigheid, latentie en kosten. Dat zijn belangrijke factoren. Maar gereguleerde omgevingen introduceren een vierde as die de anderen niet kan vervangen: auditability.

De EU AI Act, die nu van kracht is, vereist dat high-risk AI-systemen technische documentatie, traceability logs en bewijs van menselijke toezicht gedurende hun hele levenscyclus bijhouden. De FDA’s eerste conceptrichtsnoer voor AI in de ontwikkeling van geneesmiddelen en biologische producten geeft dezelfde richting aan voor de life sciences. Deze kaders beoordelen niet op vlotheid. Ze vereisen systemen die kunnen worden gereconstrueerd, geïnspecteerd en verdedigd.

Een verdedigbare LLM-uitvoer is een die kan worden teruggespoord via een verifieerbare keten van bewijs: welke gegevens hij heeft gebruikt, welke beperkingen hem hebben gevormd, wie hem heeft beoordeeld en wat is behouden voor toekomstige inspectie. Zonder die keten is zelfs een correcte uitvoer onverdedigbaar.

Dit herdefinieert wat “productieklare” AI in gereguleerde omgevingen werkelijk betekent.

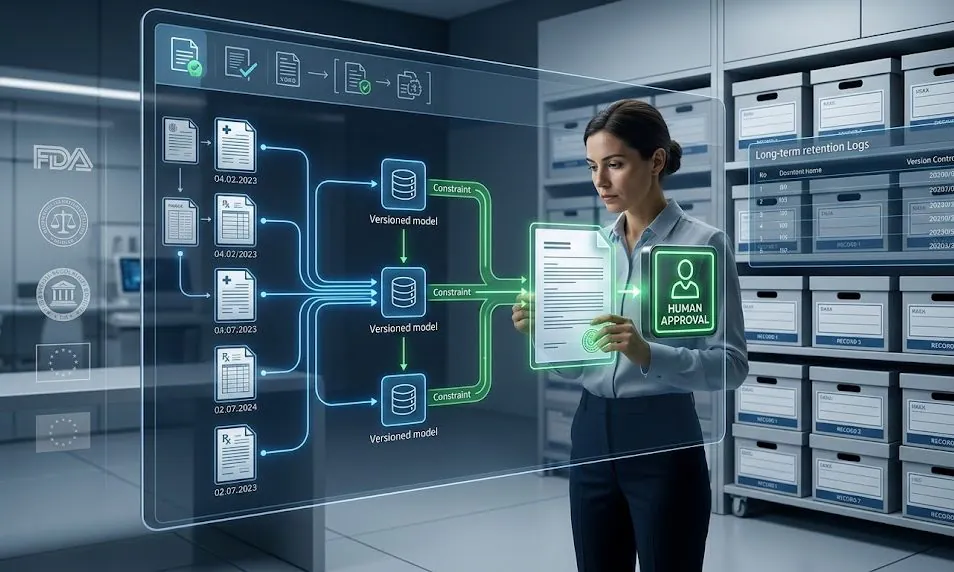

De vier pijlers van audit-ready GenAI

Het bouwen van verdedigbare LLM-systemen komt neer op vier technische vereisten. Ze zijn geen abstracte principes – ze zijn infrastructuurbeslissingen die bepalen of je systeem een audit kan doorstaan.

1. Provenance: controleer waar het model zijn informatie vandaan haalt

De meest voorkomende foutmodus in enterprise AI is ook de minst zichtbare: modellen die putten uit algemene kennis of losjes gedefinieerde gegevensbronnen. Wanneer er geen gecontroleerde kennisgrens is, kunnen uitvoeren niet worden teruggespoord naar een auditeerbare bron, en reconstructie wordt onmogelijk.

Een praktische oplossing is om een goedgekeurde kennisgrens te vestigen: versiebeheerde, eigendomsdocumenten en datasets waar het systeem expliciet toestemming heeft om te gebruiken. Elk antwoord moet een minimale bewijsset meedragen: een bronidentificatie met versie en ingangsdatum, een opzoeklog die aangeeft wat is opgevraagd en geselecteerd, en inline citaten. Een nuttige werkbare regel: geen citaat, geen claim.

Dit converteert het systeem van geheugen-gebaseerde generatie naar evidence-gebaseerde redenering. Het onderscheid wordt kritisch wanneer iemand een specifieke uitvoer moet reconstrueren weken of maanden nadat hij is gegenereerd.

2. Beperkingen: vervang improvisatie met gecontroleerd gedrag

LLM’s zijn gebouwd om overtuigend te zijn. Zonder beperkingen optimaliseren ze voor plausibiliteit, en plausibiliteit in een gereguleerde context is waar risico leeft.

Beperkingen zijn het mechanisme dat een probabilistische tekstgenerator omzet in een begrensde uitvoercomponent. In de praktijk betekent dit:

- Bron-gebonden generatie: elk claim vereist een goedgekeurde, versiebeheerde bron. Geen bron betekent geen antwoord — alleen weigering of escalatie.

- Gestructureerde uitvoerschema’s: antwoorden volgen gedefinieerde formaten die machines en auditors kunnen valideren, niet alleen lezen.

- Vertrouwensgrens-handhaving: opgehaalde inhoud wordt behandeld als invoer, waarmee prompt-injectierisico’s die zowel de beveiliging als de auditability kunnen ondermijnen, rechtstreeks worden aangepakt.

- Minimale toegangsrechten: het model interacteert alleen met de gegevens en tools die het echt nodig heeft, waardoor audit-trails schoon blijven.

Beperkingen zijn geen compliance-vinkje. Ze zijn de architectonische beslissing die bepaalt of je systeem überhaupt kan worden geauditeerd.

3. Beoordeling: maak menselijke toezicht een formeel controlelaag

In gereguleerde AI kan menselijke beoordeling niet ad hoc zijn. Het moet risicogestuurd zijn (hogere risico’s uitvoeren triggeren striktere validatie) en gebeurtenis-gestuurd, geactiveerd wanneer modelvertrouwen laag is, bronnen ontbreken of afwijkingen worden gedetecteerd.

De EU AI Act vereist expliciet dat mensen in staat moeten zijn om AI-gestuurde beslissingen in high-risk use cases te interpreteren, te overrulen en te stoppen. Het voldoen aan die vereiste betekent dat beoordelingsrecords moeten vastleggen wie een uitvoer heeft goedgekeurd, onder welke voorwaarden en met welk niveau van scrupule. “Iemand heeft het gecontroleerd” is geen controle. Een gedocumenteerd, getijdstempleerd beoordelingsrecord is.

Dit verheft beoordeling van handmatige QA naar een formeel governance-laag, wat precies is hoe toezichthouders het beginnen te behandelen.

4. Bewaring: maak aansprakelijkheid duurzaam

Zonder logs is er geen audit-trail. Zonder een audit-trail is aansprakelijkheid theoretisch.

Tegelijkertijd creëert het bewaren van alles zijn eigen risico’s, vooral waar gevoelige gezondheids- of financiële gegevens onderworpen zijn aan minimisatievereisten onder kaders als GDPR of HIPAA.

De praktische aanpak is een gestructureerd model. Bewaar altijd model- en versie-metadata, bronidentificaties, beleidsbeslissingen en tijdstempels. Bewaar interactie-inhoud (prompts, uitvoeren en volledige sporen) selectief, op basis van risicoclassificatie, met passende redactie en toegangscontrole. Het doel is om reconstructie van elke uitvoer mogelijk te maken zonder te veel gegevens te verzamelen die downstream-exposure creëren.

Hoe dit er in de praktijk uitziet

Overweeg hoe dit van toepassing is in de life sciences, waar CFR 21 Part 11 vereist dat elektronische records toewijsbaar, leesbaar, contemporain, oorspronkelijk en nauwkeurig zijn. Een LLM die reglementaire documentatie genereert, moet alle vijf criteria vervullen – niet alleen leesbare tekst produceren.

In deze context zijn de vier pijlers geen optionele verbeteringen. Ze zijn de minimale bar voor een compliant systeem. Provenance zorgt ervoor dat de uitvoer toewijsbaar en oorspronkelijk is. Beperkingen zorgen ervoor dat hij binnen gedefinieerde grenzen blijft. Beoordeling zorgt ervoor dat hij contemporain is met menselijke toezicht. Bewaring zorgt ervoor dat hij leesbaar en inspecteerbaar is.

Dezelfde logica geldt in financiële diensten, waar MiFID II records van beslissingen en de redenering erachter vereist, en in de gezondheidszorg, waar klinische beslissingsondersteunende systemen steeds meer onder vuur liggen vanwege verklarende en bias.

De grotere verschuiving

GenAI verplaatst zich van experimentatie naar operationele infrastructuur. Die overgang verhoogt de standaard voor wat acceptabele systemen lijken.

Een nuttige uitvoer is niet langer voldoende. Organisaties hebben uitvoeren nodig die kunnen worden verklaard, teruggespoord en verdedigd onder scrupule, omdat AI wordt gevraagd om dingen te doen die echte consequenties met zich meebrengen.

De teams die vanaf het begin ontwerpen voor verdedigbaarheid, zullen in staat zijn om AI op een veilige manier te schalen en reglementaire vertrouwen te behouden. Diegenen die dat niet doen, zullen uiteindelijk hetzelfde moment bereiken: een audit, een eenvoudige vraag over een specifieke uitvoer, en niets om te laten zien.

Het bouwen van audit-ready AI is niet over het vertragen. Het is over het bouwen van iets dat kan blijven bestaan.