Andersons hoek

Streaming AI-avatars alsof het 1999 is

Nieuw onderzoek presenteert een manier om levendige 3D-avatars te streamen die bijna onmiddellijk verschijnen en in real-time scherper worden, in plaats van gebruikers te dwingen te wachten tot massive downloads zijn voltooid.

Op veel manieren hebben de enorme resource-eisen van generatieve AI en AI-geassisteerde renderingsystemen de consumentenklaarheid teruggebracht tot twintig jaar geleden of meer. Alleen al in 2023 leek een 64GB RAM-toewijzing in een laptop of desktop PC overbodig; nu, met de groeiende populariteit van RAM en/of CPU offloading, is 64GB vrij bescheiden voor lokale AI-behoeften; en deze vroeger saaie en betaalbare onderdelen van PCs blijven in prijs stijgen omdat bedrijven worstelen om de vraag naar AI-diensten te vervullen.

De omvang en gulzigheid van AI en zijn processen en omgevingen overtreffen meestal consumentenniveau-hardware, en zelfs het uitvoeren van ‘afgeslankte’ lokale modellen als GGUF-versies zal meestal de gemiddelde systeem belasten.

Zelfs tekstgebaseerde AI-diensten zoals ChatGPT zijn onderhevig aan aanzienlijke belasting zowel op client- als serverniveau. Daarom, zodra AI de taak krijgt om online multimedia-ervaringen in real-time te leveren, kunnen we redelijkerwijs enkele zeer ernstige compromissen in latentie en/of kwaliteit verwachten – vergelijkbaar met de vroege strijd van het internet met streamingmedia, en de veel gehate geanimeerde ‘buffering’-icoontjes van RealPlayer en QuickTime.

De laatste keer dat multimedia en netwerkproblemen wrijving in de gebruikerservaring creëerden, was consumentenniveau-hardware nog in ontwikkeling via Moore’s Law, bijna exponentieel beter elk jaar, zelfs terwijl besturingssystemen, netwerken en andere ondersteunende infrastructuur evolueerden om de vraag te vervullen; en voor de afgelopen tien jaar, meer of minder, hebben de mogelijkheden van consumententechnologie de multimediavragen overtroffen (misschien zelfs tot het punt waarop verandering nodig was om verkoop te stimuleren).

Maar die overvloed aan lokale capaciteit kan binnenkort ten einde komen, aangezien lokale hardware lager gespecificeerd en duurder wordt, en aangezien AI-gebaseerde diensten hogere serverzijde- en lokale bronnen vereisen.

Een voorsprong

Terug in de pre-breedbandperiode, zelfs vóór de vroegste bruikbare streamingvideo, waren webgebruikers gewend aan afbeeldingen die langzaam scherp werden, aangezien progressive JPEG’s de bandwidth-gebrekkige gebruiker in staat stelden om de downloadende afbeelding te zien vormen, soms pijnlijk langzaam, naarmate meer van de afbeeldingsgegevens lokaal werden geladen.

Nu lijkt het erop dat we een soortgelijke ervaring kunnen krijgen met AI-geassisteerde Gaussian Splat-avatars:

Klik om af te spelen. Van het nieuwe ProgressiveAvatars-project, een vergelijking van streaming Gaussian-avatars. Links, het oude GaussianAvatars-project krijgt langzaam nieuwe gegevens maar ziet er vreselijk uit terwijl de gegevens opbouwen; rechts, de Progressive Avatars-versie bouwt detail langzaam op, maar doet dit op een intelligente manier die een basis menselijke gelijkenis recht vanaf het begin geeft. Bron

Boven zien we twee versies van een Gaussian Splat-gebaseerde (GSplat) Avatar – een menselijke representatie die gedeeltelijk wordt mogelijk gemaakt door een niet-AI-renderingtechniek die teruggaat tot de vroege jaren negentig, en ook door moderne methoden, zoals de FLAME parametrische menselijke model, en AI-gebaseerde trainingsbenaderingen:

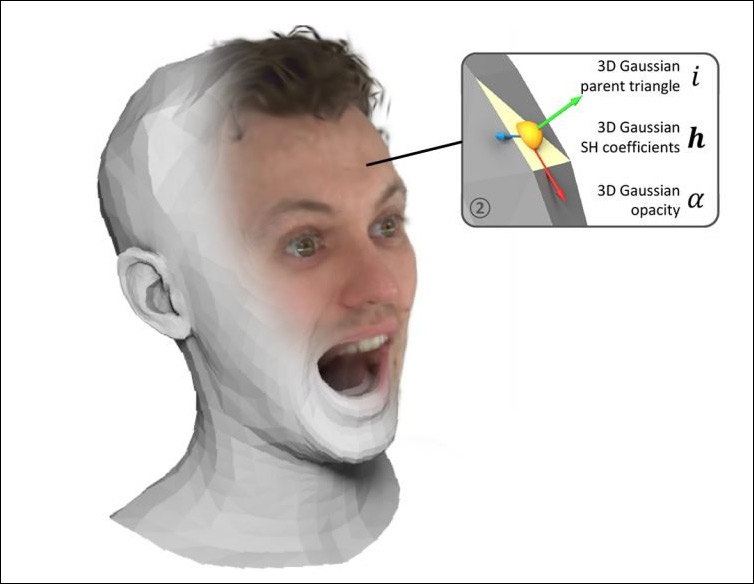

Gaussian Splatting gebruikt een Gaussian-representatie van kleur en 3D-informatie in plaats van een pixel of voxel, en kaart deze ultra-realistische tekstuur op een meer traditionele soort CGI-mesh, die op zichzelf wordt gefaciliteerd door een ‘parametrische mens’, een CGI-gezicht en/of lichaam, in systemen zoals FLAME en STAR. Bron

Links in de video boven kunnen we zien dat een traditionele implementatie van een Gaussian splat avatar er vrij afschuwelijk uitziet terwijl we wachten tot de gegevens zijn geladen. Rechts, een nieuwe implementatie uit China, genaamd ProgressiveAvatars, kan zich veel eleganter ontwikkelen terwijl de gegevens worden geladen, en presenteert een niet-alarmistisch menselijk beeld vanaf het begin.

De auteurs claimen dat hun methode de eerste is die echt ‘streamt’ een Gaussian avatar, en zeker de eerste die dit op een progressieve manier doet, waarbij het beeld elegant opbouwt, en de meest belangrijke gebieden – zoals ogen en lippen – kunnen worden geprioriteerd, zodat de avatar conversational kan worden, zelfs als deze alleen gedeeltelijk is geladen:

Click to play. Van de ProgressiveAvatars-projectsite, een illustratie van attention-aware loading.

Vóór dit, is een ‘level of detail’ (LOD) benadering gebruikt in eerdere pogingen om ‘GSplat’ avatars af te slanken, vergelijkbaar met video-game-optimalisaties, waarbij successievelijk meer gedetailleerde versies van een persoon worden geladen op basis van of ze genoeg van de viewport of de aandacht van de kijker innemen om de moeite waard te zijn.

Natuurlijk houdt dit een ernstige hoeveelheid redundante ‘spare’ avatars in, en de auteurs kaderen hun benadering als een meer rationeel systeem. Door implicatie, staat een methode van deze soort ook toe dat veranderingen worden aangebracht in een GSplat-figuur (d.w.z. aanpassing) zonder dat dergelijke veranderingen door een keten van verschillende LOD ‘twins’ hoeven te worden doorgevoerd.

Een emergente domein

Als dit een niche-probleem lijkt, nou, zo was streamingvideo ook, terug in de dagen toen het krijgen van de vroegste plugins om te werken werd uitbesteed aan de dichtstbijzijnde beschikbare nerd. Verder, het potentieel voor AI-gebaseerde streamingrepresentaties gaat verder dan menselijke avatars, en omvat stadsgeneratie, games, en 3D-gebaseerde* versies van praktisch elk online domein – zoals Virtual Try-On, voor kledingwinkelen:

Klik om af te spelen. Van een 2024-project, een ruwe blik op de toekomst van online ‘try-on’. Andere projecten proberen beweging en interactie toe te voegen – veeleisende facetten om te streamen en te beheren. Bron

Net zoals LOD-gebaseerde benaderingen tot nu toe voornamelijk door video-games zijn gebruikt, zullen veel andere overwegingen die ooit het exclusieve domein van game-ontwikkeling waren, waarschijnlijk doordringen in splat-gebaseerde representaties. Bijvoorbeeld, de meeste van deze vroege GSplat-uitstapjes laten een enkele mens zien die grimast en poseert, of misschien praat; maar veel situaties zullen nodig zijn die meerdere mensen, evenals omgevingskenmerken en sfeer, omvatten – een scenario waarin zeer performante ‘triage’-systemen moeten bepalen waar de gestreamde gegevens moeten worden geprioriteerd, om de kijker in het moment te houden.

De nieuwe paper heeft als titel ProgressiveAvatars: Progressive Animatable 3D Gaussian Avatars, en komt van drie onderzoekers aan de Universiteit van Wetenschap en Technologie van China in Hefei.

Methode

De benadering maakt initieel gebruik van video van iemands hoofd. Voor elk frame, wordt een standaard FLAME parametrisch gezichtsmodel aangepast, zodat de vorm en expressie veranderen over tijd, terwijl de onderliggende meshstructuur vast blijft. Omdat de basis-topologie niet verandert, kan een stabiele FLAME-sjabloon opnieuw worden gebruikt en verfijnd in plaats van van scratch opnieuw te worden opgebouwd bij elke gelegenheid, zoals in soortgelijke eerdere werken:

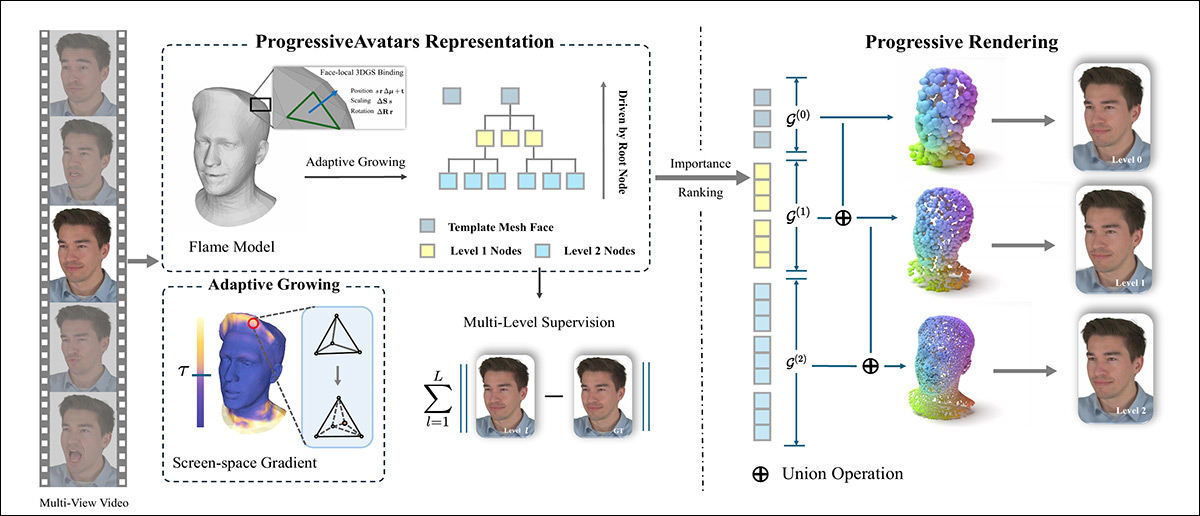

Headvideo wordt eerst aangepast met een getrackte FLAME-mesh, waarna 3D-Gaussians aan elk gezicht worden bevestigd en hiërarchisch worden gegroeid waar schermruimtegradiënten ontbrekende details aangeven. Tijdens de training bouwt deze adaptieve subdivisie een multi-level-representatie op onder multi-view-supervisie, en bij inferentie bepalen per-gezicht-importscores welke Gaussians het eerst worden gestreamd, waardoor de avatar snel kan verschijnen en progressief kan worden verfijnd terwijl hogere detailniveaus worden toegevoegd.

Over deze basisstructuur wordt detail toegevoegd in lagen; het oppervlak wordt impliciet onderverdeeld in een hiërarchie, en kleine driedimensionale Gaussians worden aan de gezichten op elk detailniveau bevestigd.

Hoewel de initiële grovere lagen de algehele hoofdvorm en beweging vangen, bieden de daaropvolgende fijnere lagen rimpels, subtiele vervormingen en hoge frequentietekstuur. Afbeeldingen worden vervolgens gerenderd vanuit deze Gaussians met behulp van een differentieerbare Gaussian rasterizer en getraind tegen multi-view-grondwaarheidsbeelden, zodat de avatar leert de verschijning van de echte persoon te reproduceren.

Tijdens de training groeit deze hiërarchie automatisch: gebieden die meer detail nodig hebben, worden verder onderverdeeld, geleid door schermruimtesignalen, zodat de computationele inspanning zich concentreert waar de kijker het meest waarschijnlijk fouten zal opmerken.

Tijdens inferentie maakt deze hiërarchie progressieve streaming mogelijk, waarbij een ruwe versie van een avatar eerst kan worden weergegeven, en, naarmate meer lagen worden geladen, nieuwe Gaussians kunnen worden toegevoegd zonder dat wat al wordt weergegeven verandert, waardoor een animabele hoofdavatar kan verschijnen die snel verschijnt en scherper en gedetailleerder wordt naarmate meer gegevens arriveren.

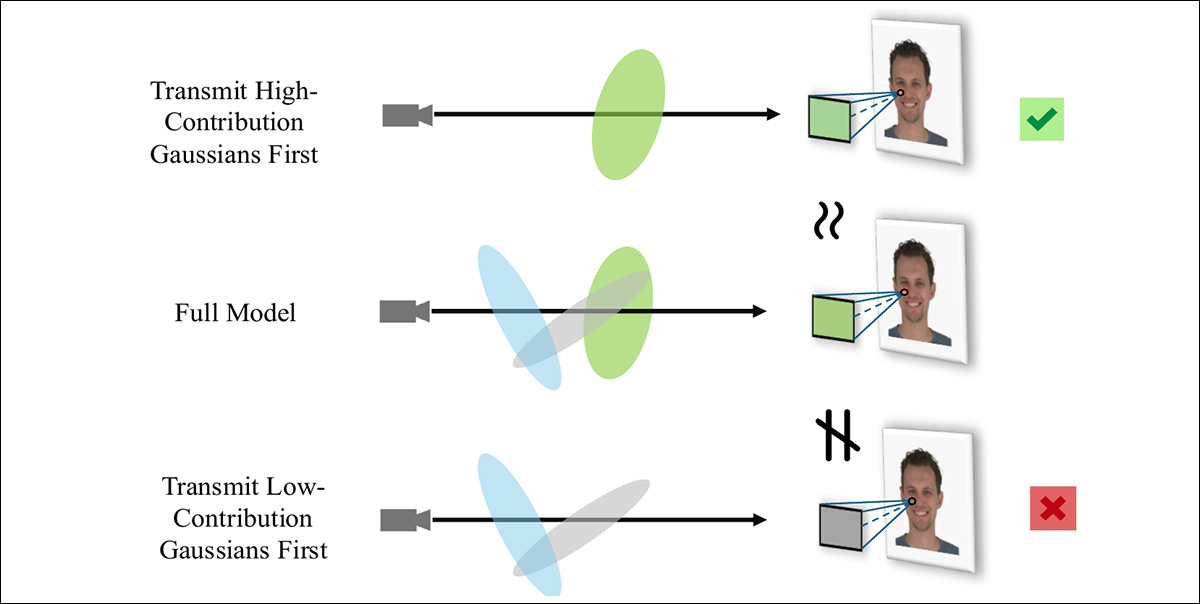

De auteurs merken op dat het hele systeem draait om de prioritering van inkomende gegevens:

Wanneer alle Gaussians op een bepaald niveau beschikbaar zijn, wordt het volledige model met maximale geloofwaardigheid gerenderd; maar tijdens het streamen, het verzenden van de hoogste-bijdrage Gaussians eerst, stelt vroege gedeeltelijke resultaten in staat om dicht bij het uiteindelijke beeld te komen, terwijl het verzenden van lage-bijdrage Gaussians eerst de kleurbalans verstoort en kleine componenten benadrukt.

Gegevens en tests

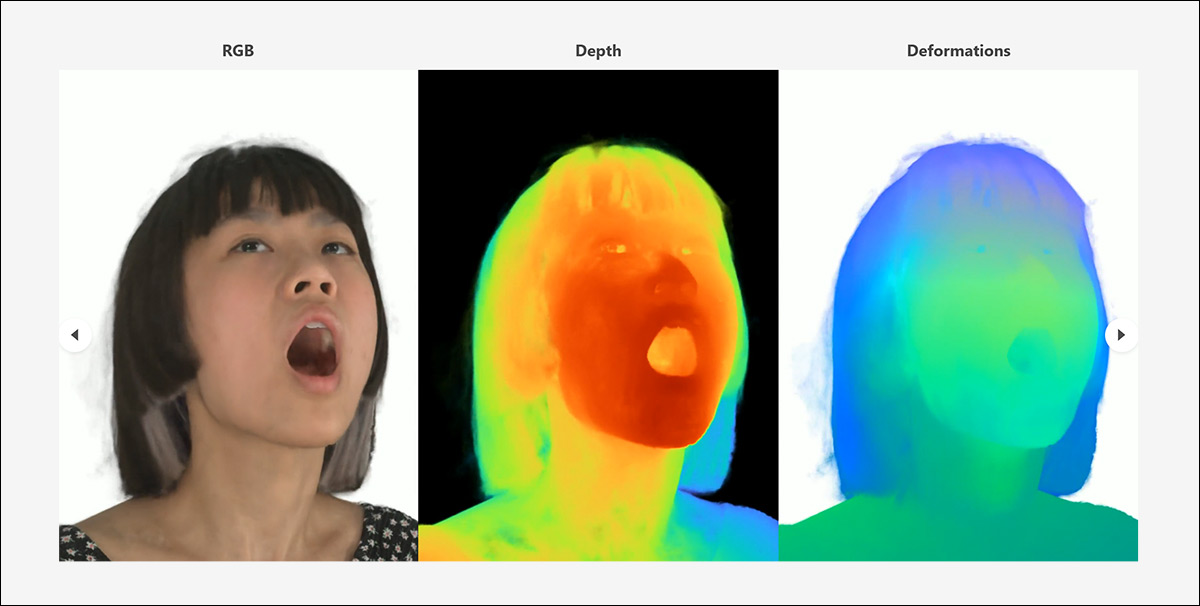

Voor tests, werd de nieuwe methode geëvalueerd op de NeRSemble dataset, die bestaat uit multi-view-video’s voor elk onderwerp, met gekalibreerde parameters over alle views:

Voorbeelden van diverse interpretaties van onderwerpen opgenomen in de NeRSemble-dataset die in tests voor ProgressiveAvatars wordt gebruikt. Bron

In overeenstemming met de oorspronkelijke GaussianAvatars methodologie, werden afbeeldingen naar beneden gesampled naar 802x550px, een voorgrondmasker gegenereerd, en de oorspronkelijke projecttraining/test split aangenomen.

De Adam optimizer werd gebruikt voor parameterupdates, met een leer tempo van 1×10-2 op alle barycentrische coördinaten. Training liep voor 60.000 iteraties, met de hiërarchie automatisch uitgebreid elke 2.000 iteraties.

Aanvankelijk testten de auteurs voor reconstructie en animatie – de taak van het omzetten van platte video in een 3D-bewust (x/y/x) systeem, met behulp van FLAME’s canon CGI-representatie als de anker-mesh. Voor dit doel werden alle baselines van scratch getraind, en de rivaliserende frameworks getest waren de eerder genoemde GaussianAvatars, en PointAvatar.

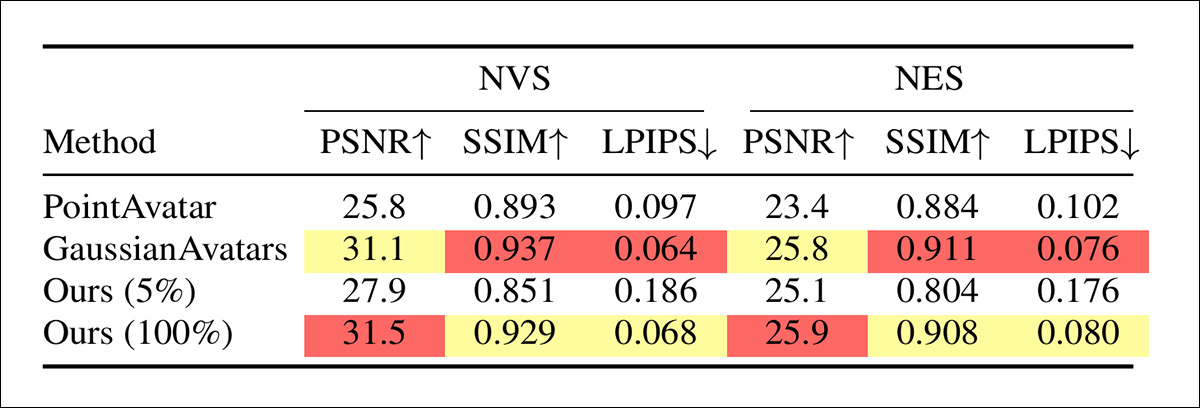

Voor deze tests werden de volgende metrics gebruikt: Peak Signal-to-Noise Ratio (PSNR), Structural Similarity Index (SSIM), en Learned Perceptual Image Patch Similarity (LPIPS):

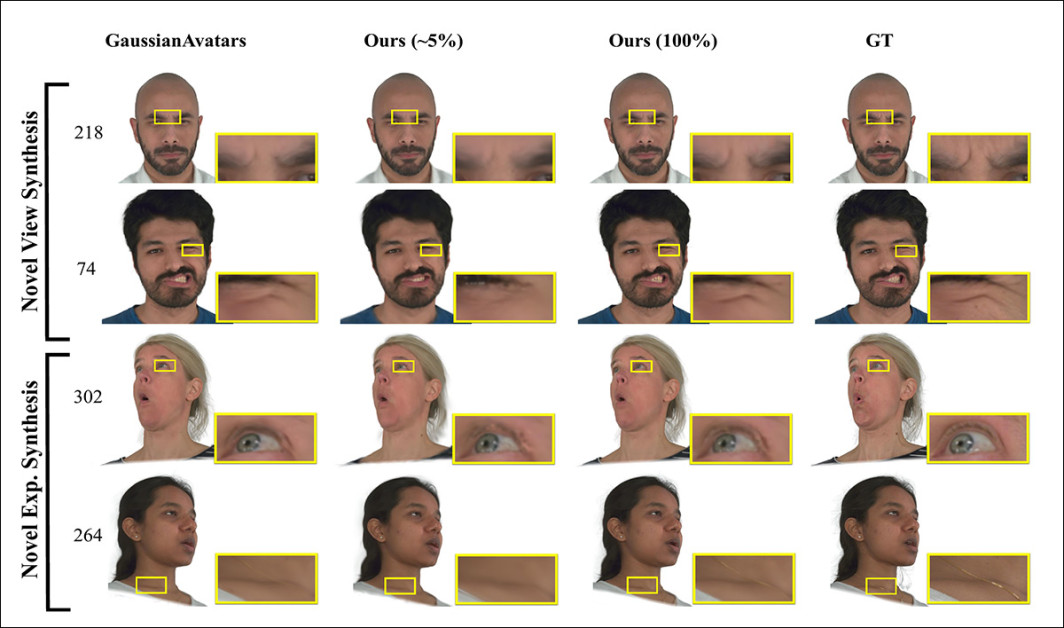

Kwalitatieve vergelijking op novel-view en novel-expression synthese. De baseline GaussianAvatars worstelt met fijne details rond de ogen, rimpels en huidtextuur, terwijl de voorgestelde methode al de belangrijkste gezichtsstructuur behoudt bij ongeveer vijf procent van de overgedragen gegevens en convergeert naar de grondwaarheid terwijl meer Gaussians worden gestreamd, en dicht bij het volledige model en referentiebeelden (grondwaarheid) komt.

Met betrekking tot deze resultaten, beweren de auteurs:

‘[Onze] methode reconstrueert scherpere details in verschillende regio’s, met name rond de nek, schouders en kleding. Deze gebieden zijn relatief grof getesselleerd in de FLAME-sjabloon in vergelijking met hoge-saliency gezichtsgebieden (bijv. de peri-oculaire regio).

‘Als gevolg daarvan alloceren eerdere methoden vaak te weinig 3D-Gaussians aan deze gebieden om hun fijne details trouw te kunnen reproduceren. In tegenstelling tot onze adaptieve groeistrategie, verhoogt het aantal Gaussians en verfijnt de hiërarchie alleen waar nodig, waardoor de allocatie ongevoelig wordt voor FLAME’s niet-uniforme tessellatie.’

De auteurs merken verder op dat hun benadering op gelijke hoogte staat met state-of-the-art methoden, en een werkbaar avatar oplevert met een triviale 5% bandbreedte-toelage:

Kwantitatieve vergelijking op novel view synthese en novel expression synthese met behulp van PSNR, SSIM en LPIPS. Bij volledige transmissie bereikt de voorgestelde methode de hoogste PSNR op beide taken en blijft concurrerend met GaussianAvatars op perceptuele metrics, terwijl de 5%-instelling de kwaliteitsverandering onder extreme bandbreedtebeperkingen illustreert.

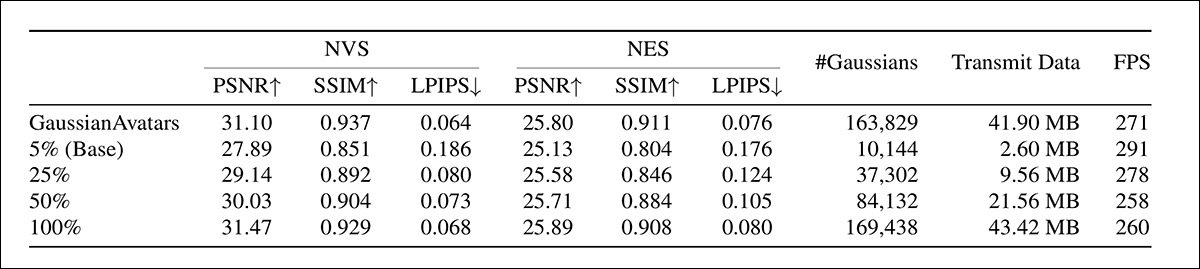

Vervolgens testten de onderzoekers de progressieve rendering zelf. Dit werd uitgevoerd op een NVIDIA RTX 4090, met 24Gb van VRAM, bij een resolutie van 550x802px. In dit scenario merken de auteurs op dat een 25% budget alle ‘level 1’ Gaussians zou gebruiken, evenals een subset van level 2 Gaussians, wat een ruwe schets geeft van de manier waarop de Gaussian-groepen detail in de hogere nummerniveaus opbouwen, en dat de lagere nummerniveaus in wezen de basis-canvas bouwen:

Prestaties onder verschillende transmissiebudgetten voor novel view en novel expression synthese, waaruit blijkt dat de kwaliteit gestaag de GaussianAvatars benadert of overtreft terwijl meer Gaussians en gegevens worden gestreamd, terwijl real-time snelheden worden behouden, op een RTX 4090.

De auteurs merken op:

‘Met slechts 2,60 MB overgedragen (5% budget), heeft de avatar al een redelijke kwaliteit bereikt. Terwijl hogere-niveau Gaussians worden gestreamd, worden fijne structuren zoals knopen op een shirt, tanden en haar geleidelijk scherper, terwijl temporale stabiliteit wordt behouden.

‘Bij 100% transmissie bereikt onze benadering een renderkwaliteit die vergelijkbaar is met SOTA-methoden. Opvallend genoeg dalen de frame rates niet significant, waarschijnlijk omdat de 3DGS-werklast de GPU nog niet heeft verzadigd.’

Echter, de auteurs merken op dat in multi-user VR-scenario’s, het aantal 3D-Gaussians snel zal groeien tot een punt waarop GPU-rasterisatie een bottleneck wordt. In die zwaardere scenario’s biedt de voorgestelde benadering een voordeel door de mogelijkheid te bieden om het aantal primitieven te ruilen tegen visuele kwaliteit, waardoor de belasting wordt verlicht zonder de render te laten instorten.

Hoewel het artikel dit niet specificeert, bevat de projectsite aanvullende testvergelijkingen, eveneens met de MeGA Hybrid mesh-Gaussian avatar project:

Klik om af te spelen. Een van een reeks aanvullende video’s van de projectsite van het artikel, deze vergelijkt de nieuwe benadering in termen van novel view synthese.

Conclusie

Gaussian Splatting mag of mag niet blijven bestaan, of zelfs worden herinnerd meer dan RealPlayer nu is, met betrekking tot de dageraad van interactieve streaming: AI-gedreven of AI-geassisteerde 3D-bewuste representatieve ervaringen, inclusief videochat, virtuele winkelen, route-navigatie en diverse entertainment-toepassingen. Het kan zijn dat alternatieve technologieën of benaderingen winnen, of dat GSplat bewijst de meest betrouwbare AI-video-representatie.

Als niets anders, kondigt dit interessante nieuwe artikel een klein deel aan van het bereik van dit nieuwe domein, en herinnert ons, misschien nostalgisch, aan de bandbreedte-gebrekkige internet van weleer.

* Door ‘3D’ bedoel ik niet het soort ervaring dat speciale bril vereist, maar eerder ervaringen waarbij de multimediainhoud een soort begrip heeft van X/Y/Z-coördinaten.

First published woensdag, 18 maart 2026