Andersons hoek

Onbeleefde Vragen Kunnen Enterprise ChatGPT-kosten Laten Stijgen

ChatGPT-antwoorden verbruiken meer tokens wanneer je onbeleefd tegen het bent, waardoor je enterprise-rekening toeneemt; maar ‘alsjeblieft’ zeggen kan je kosten verlagen.

Het wordt gezegd dat beleefdheid niets kost; maar wat kost onbeleefdheid? Wat betreft het betalen voor ChatGPT, behoorlijk veel, volgens een nieuwe studie uit de VS. Het nieuwe onderzoek, van de University of Iowa, toont aan dat onbeleefd zijn tegen ChatGPT de kosten van antwoorden verhoogt – zelfs als de antwoorden hetzelfde zijn voor beleefde en onbeleefde vragen.

De auteurs stellen:

‘[De prijs van] output-tokens is $12 per 1M output-tokens voor GPT4. We vinden dat onbeleefde prompts meer dan 14 extra tokens opleveren, wat equivalent is aan $0,000168 extra kosten per prompt gemiddeld. De gemiddelde dagelijkse queries aan OpenAI’s API overschrijden 2,2 miljard.

‘In vergelijking met een scenario waarin alle prompts beleefd zijn, wanneer prompts in plaats daarvan onbeleefd zijn, genereert dit een extra $369.000 aan inkomsten per dag, alleen vanwege de toename in tokens die onbeleefde prompts in de uitvoer genereren.’

Hoewel het resultaat op zichzelf interessant is, benadrukken de auteurs dat dit ongebruikelijke gedrag een variëteit aan nog onbekende eigenaardigheden in de menselijke/AI-configuratie kan aanduiden, waarvan sommige of alle mogelijk ook financiële gevolgen hebben. Wat betreft de reden waarom onbeleefdheid klanten extra tokens kost, speculeren de auteurs niet.

Om de juistheid van het syndroom te bevestigen, herschreven ze echte ChatGPT-prompts, waarbij de beleefdheidswaarden afwisselend werden, terwijl de betekenis behouden bleef. Beide versies werden vervolgens in GPT-4-Turbo ingevoerd via separate API-aanroepen, en de verschillen werden gemeten in het aantal output-tokens dat voor antwoorden werd gebruikt.

De conclusies zijn een scherp contrast met koppengebeurtenissen eerder dit jaar, waar Sam Altman klagde dat beleefdheid OpenAI mogelijk ‘tientallen miljoenen‘ dollars kostte in termen van verwerking van beleefdheidsgerelateerde tokens (zoals ‘alsjeblieft’). Onderzoek dat in dezelfde periode werd gepubliceerd, gaf ook aan dat beleefdheid geen waarde had in termen van het verkrijgen van betere antwoorden (hoewel het geen commentaar gaf over goedkopere antwoorden).

Als de conclusies van het nieuwe onderzoek correct zijn, zouden alle enterprise-gebruikers van ChatGPT die deze lijn van denken volgden, in 2025 meer hebben uitgegeven aan ChatGPT-inferentie dan gebruikers die een minimum aan beleefdheid boden in ChatGPT-uitwisselingen.

De auteurs suggereren dat een mogelijke oplossing zou zijn om een tokenlimiet in te stellen voor antwoorden, hoewel dit geen aanpak is die LLM-systemen gemakkelijk kunnen implementeren. Ze merken op dat prompting een zwak hulpmiddel is voor kostenbeheersing, omdat LLM’s moeite hebben om expliciete lengte-instructies te gehoorzamen. In de meeste gevallen zou deze ‘beperkende’ richtlijn niet worden opgevolgd; bovendien zou het antwoord mogelijk worden afgekapt, omdat LLM’s van dit type eigenlijk raden naar het volgende waarschijnlijke woord in een zin/alinea, en dus niet weten hoe het verhaal eindigt – of waar het verhaal eindigt – totdat de verwerking is voltooid. Ze hebben dus een beperkte mogelijkheid om enige machinaties in gang te zetten op aanvraag.

Zonder een exacte oplossing – hoewel er wordt gesuggereerd dat meer transparante prijsbenaderingen moeten worden afgedwongen in gevallen als deze – concluderen de auteurs:

‘Conventionele wijsheid suggereert dat promptbeleefdheid onnodig is bij interactie met LLM’s.

‘In tegenstelling tot onze werk toont aan dat onbeleefde prompts meer output-tokens genereren, waardoor extra kosten ontstaan voor enterprise-AI-gebruikers.’

Het nieuwe onderzoek heet KostenTransparantie van Enterprise AI-adoptie, en komt van drie onderzoekers aan de University of Iowa.

Methode

Gegevens voor het systeem werden ontleend aan de WildChat-dataset, die bestaat uit een verzameling van 1 miljoen gebruiker-ChatGPT-conversaties, en meer dan 2,5 miljoen interactie-omwentelingen:

Van een ondersteunende site voor het WildChat-project, doorzoekbare voorbeelden van ChatGPT-interacties. Bron

De auteurs merken op dat WildChat een grotere hoeveelheid natuurlijke interacties bevat dan in sommige meer gecurateerde sets.

Ze kozen 20.000 Engelse prompts uit de collectie van GPT-4-uitwisselingen, waarbij de output in elk geval werd verwijderd (aangezien de bedoeling was om de prompts opnieuw in te voeren voor nieuwe antwoorden). Alleen de eerste interactie werd geselecteerd, zelfs uit langere uitwisselingen,

Het resulterende set werd gefilterd in beleefd of onbeleefd categorieën, met alle prompts geclassificeerd door GPT-4-Turbo. De onderzoekers gebruikten het model zelf om te bepalen of een prompt beleefd was of niet, omdat het model zijn eigen perceptie van beleefdheid centraal stond in het experiment.

Prompts die als beleefd waren gelabeld, konden duidelijke aanwijzingen bevatten zoals het woord ‘alsjeblieft’, of konden op een meer indirecte manier beleefd zijn. Alles wat niet als beleefd werd herkend, werd geclassificeerd als onbeleefd, zelfs als de woording neutraal was in plaats van antagonistisch.

Om te bestuderen hoe het model reageerde op beleefdheid, konden standaardmethoden (d.w.z. die tekst behandelen als een set meetbare kenmerken) niet worden gebruikt: aangezien beleefdheid ingebed was in de woording zelf, zou het samenvatten van een prompt als een lijst met kenmerken belangrijke context verliezen.

In plaats daarvan werd elke prompt herschreven om de toon om te keren, waarbij alle andere elementen zo veel mogelijk gelijk bleven, waardoor een vergelijking mogelijk was tussen paren die alleen in beleefdheid verschilden:

Voorbeelden van hoe beleefde en onbeleefde prompts werden getransformeerd in hun counterfactual-versies, waarbij semantische betekenis behouden bleef. Bron

Tests

Elke oorspronkelijke prompt werd gepaard met een herschreven versie die alleen in beleefdheidsniveau verschilde, en beide versies werden ingevoerd in hetzelfde GPT-4-Turbo-model via separate API-aanroepen. Het aantal tokens dat in reactie op elke versie werd gegenereerd, werd opgenomen, en het verschil ertussen werd behandeld als de maatstaf voor hoe toon (token-)kosten beïnvloedde.

Temperatuur werd constant gehouden om willekeurige variatie te voorkomen, en prompt-paren werden alleen behouden wanneer de herschrijving de invoer veranderde met niet meer dan vijf tokens. Dit zorgde ervoor dat het effect dat werd bestudeerd, voortkwam uit toon, in plaats van enige bredere veranderingen in formulering:

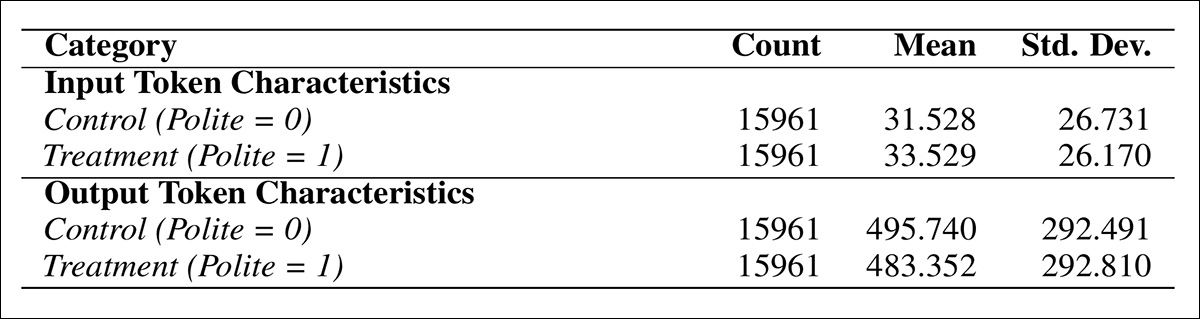

Samenvattingsstatistieken die aantonen dat beleefde prompts gemiddeld minder output-tokens opleverden dan onbeleefde prompts, ondanks het feit dat ze iets meer invoer-tokens hadden.

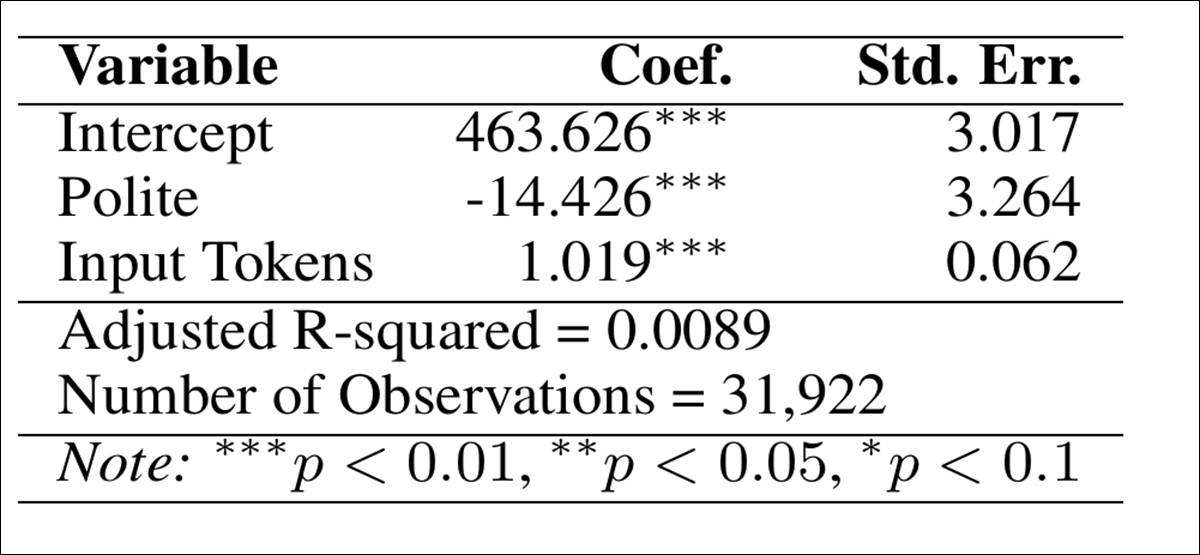

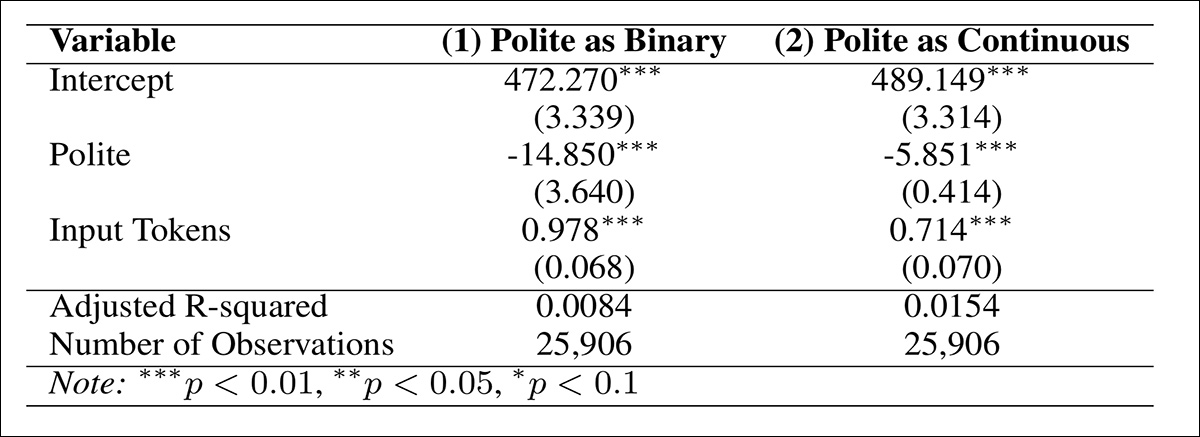

De belangrijkste resultaten voor de eerste ronde tests gaven aan dat het gebruik van een beleefde prompt de token-uitvoerlengte met 14,426 tokens vermindert:

Schattingresultaten die de invloed van beleefde promptformulering op de gegenereerde outputlengte (tokens) aantonen.

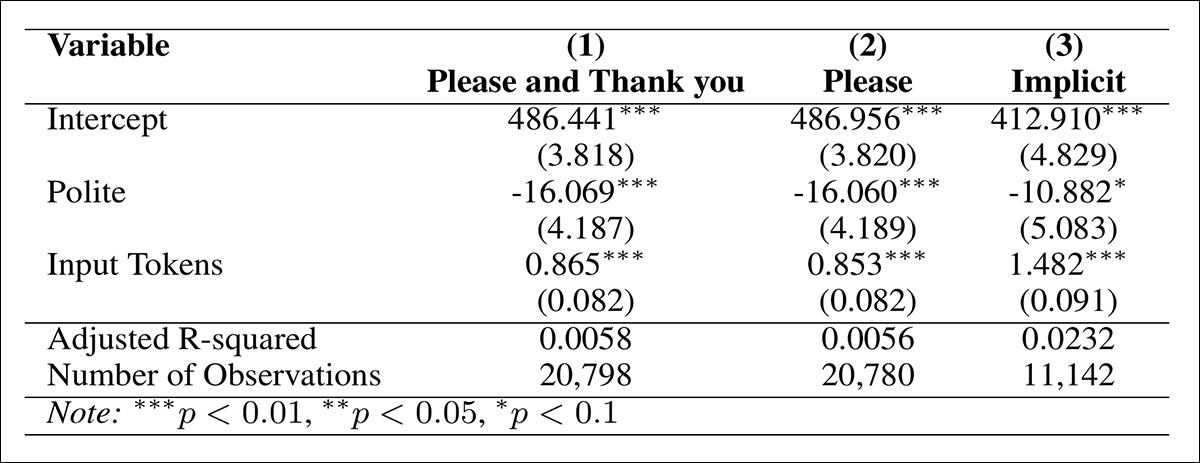

De analyse werd herhaald over drie subsets van beleefde prompts om robuustheid te testen: prompts die expliciete markers gebruikten zoals ‘alsjeblieft’ of ‘dank je’; die alleen ‘alsjeblieft’ gebruikten; en die impliciete beleefdheid hadden, zoals ‘kun je’ of ‘zou je’:

Schattingresultaten op basis van typen beleefdheid.

Om de robuustheid van de belangrijkste bevindingen te valideren, werd een secundaire classificatie van promptbeleefdheid uitgevoerd met behulp van de LIWC-raamwerk, dat een deterministische en herhaalbare score voor linguïstische kenmerken biedt.

In tegenstelling tot GPT’s probabilistische classificatie kan LIWC een stabiele beleefdheidsscore toewijzen aan elke prompt, waardoor consistentie kan worden beoordeeld over diverse methoden. In dit deel van de tests werden prompts gelabeld als beleefd als hun LIWC-beleefdheidsscore groter was dan nul, en als onbeleefd anders.

Toen de overeenstemming tussen LIWC- en GPT-classificaties werd gemeten, werd een overeenstemmingspercentage van 81% waargenomen. Hoewel dit geen maatstaf is voor nauwkeurigheid, bood deze overeenstemming ondersteuning voor consistentie tussen systemen.

Toen alleen prompts met overeenkomstige GPT- en LIWC-beleefdheidslabels werden geanalyseerd, leidden beleefde prompts nog steeds tot 14 minder output-tokens; en toen beleefdheid op een schaal van 1 tot 10 werd gemeten, verminderde elke stap omhoog in beleefdheid de output met vijf tokens gemiddeld:

Tokenbesparingen van beleefdheid bleven behouden toen opnieuw geclassificeerd met LIWC, zowel als binaire label als continue score.

Robuustheid

Om te beoordelen of het effect van beleefdheid varieerde over verschillende typen prompts, werd elke prompt toegewezen aan een van de vooraf gedefinieerde taakcategorieën: informatie zoeken; tekst genereren; editen en herschrijven; classificatie; samenvatting; en technische taken.

Elke prompt werd een taaklabel toegewezen door de embedding ervan te vergelijken met die van vooraf gedefinieerde taakbeschrijvingen, met behulp van de all-MiniLM-L6-v2 Sentence Transformers-model.

Cosinusgelijkheidscores werden berekend tussen elke prompt en de set van taakdefinities, en het label met de hoogste gelijkheid werd toegewezen.

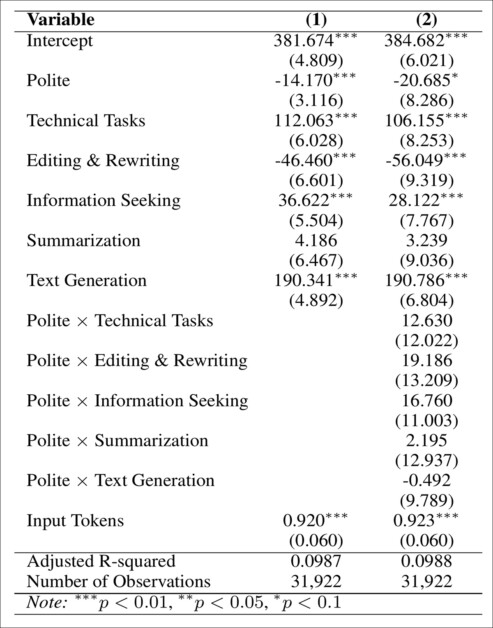

De taaktypen werden vervolgens hergebruikt als controlevariabelen in de regressie, om te testen of het effect van beleefdheid varieerde met promptcategorie, en interactietermen tussen taak en behandeling werden ook geïntroduceerd, om te controleren op differentiële effecten.

In beide gevallen produceerden beleefde prompts consistent kortere uitvoer, en werd geen significante variatie over taaktypen gevonden:

Regressieresultaten die aantonen dat beleefde prompts de outputlengte verminderten over alle taaktypen, zonder significante interactie-effecten.

Om te testen of kortere antwoorden van beleefde prompts weerspiegelden een verlies aan kwaliteit, werden de uitvoer van oorspronkelijke en counterfactual-prompts vergeleken voor semantische gelijkheid. Met behulp van het all-MiniLM-L6-v2-model werd elke reactie ingebed in een semantische vectorruimte, en werd cosinusgelijkheid berekend tussen elk paar, waardoor een gemiddelde gelijkheid van 0,78 ontstond, wat een sterke overeenstemming in betekenis aangaf, en suggereerde dat de inhoud consistent bleef, zelfs wanneer de toon veranderde.

Stopwoorden

Om te begrijpen welke soorten inhoud worden vermindert in kortere uitvoer, werden de meest frequent gedropte woorden onderzocht. Deze werden gevonden te zijn algemene stopwoorden zoals ‘heb’, ‘meer’, ‘waar’, en ‘in’, d.w.z. termen die grammaticale in plaats van semantische rollen dienen.

Om te bevestigen dat tokenreductie niet werd gedreven door verlies van betekenisvolle inhoud, werden stopwoorden verwijderd, en werden zinnen van maximaal vier woorden geanalyseerd op systematische verdwijning; echter werden geen consistente of semantisch belangrijke patronen gevonden, wat suggereerde dat reducties van beleefde formulering geen betekenisvolle of nuttige inhoud verwijderden.

Het leek dus nog steeds dat meer tokens werden uitgegeven aan antwoorden op onbeleefde vragen dan beleefde vragen – als een soort ‘belasting’ op bruuskheid.

Menselijke studie

Om te testen of de kwaliteit van de uitvoer werd beïnvloed door prompttoon, werd ook een menselijke evaluatie uitgevoerd, met behulp van een willekeurige steekproef van twintig beleefde en twintig onbeleefde promptparen.

Na het uitsluiten van prompts over gevoelige of technische onderwerpen, werden antwoorden beoordeeld door 401 deelnemers op een schaal van 1 tot 7. Elke deelnemer zag alleen één antwoord, afkomstig uit een van de vier condities: beleefd of onbeleefd, en hetzij oorspronkelijk of counterfactual.

Geen significante verschillen werden gevonden in de waargenomen kwaliteit over enige van deze condities. Beleefde en onbeleefde uitvoer kregen bijna identieke scores, evenals oorspronkelijke en counterfactual versies.

De auteurs beweren dat deze resultaten aantonen dat de reductie in output-tokens niet werd veroorzaakt door enig verlies aan kwaliteit, maar in plaats daarvan door herformulering, of door structurele verschuivingen die de betekenis behielden.

Het kostenverschil dat werd waargenomen in enterprise-prompting is daarom onwaarschijnlijk het gevolg van veranderingen in nut of duidelijkheid, en de ‘belasting’ is nog steeds operationeel.

Conclusie

Hoewel het nieuwe onderzoek zich concentreert op enterprise-gebruik van ChatGPT, worden ook lagere gebruikers getroffen door dit syndroom, aangezien zelfs de twee basisniveaus gebruikslimieten hebben; en – vermoedelijk – ChatGPT onbeleefd behandelen zal de gemiddelde gebruiker sneller naar de afvoer van de dagelijkse toewijzing van tokens brengen.

Het nieuwe onderzoek richt zich op een koppengebeurtenis en een veel bestudeerde open vraag in menselijke/AI-interacties; maar de auteurs benadrukken dat kwesties rond beleefdheid moeten worden beschouwd als indicatoren van een mogelijke veel diepere put van linguïstische eigenaardigheden, die nog moeten worden ontdekt en die mogelijk financiële gevolgen hebben.

Eerst gepubliceerd op woensdag 19 november 2025