Andersons hoek

AI hoeft geen betere antwoorden te geven als je beleefd bent

De publieke opinie over het feit of het lonend is om beleefd te zijn tegenover AI, verandert bijna even vaak als het laatste vonnis over koffie of rode wijn – gevierd in een maand, uitgedaagd in de volgende. Toch voegen een groeiend aantal gebruikers nu ‘alsjeblieft’ of ‘dank je’ toe aan hun prompts, niet alleen uit gewoonte of uit bezorgdheid dat botte uitwisselingen kunnen overslaan naar het echte leven, maar vanuit de overtuiging dat beleefdheid leidt tot betere en productievere resultaten van AI.

Deze veronderstelling is in omloop onder zowel gebruikers als onderzoekers, met prompt-formulering die in onderzoekskringen wordt bestudeerd als een instrument voor alignement, veiligheid en tooncontrole, zelfs als gebruikersgewoonten deze verwachtingen versterken en herschikken.

Bijvoorbeeld, een studie uit 2024 uit Japan vond dat de beleefdheid van een prompt het gedrag van grote taalmodellen kan veranderen, door GPT-3.5, GPT-4, PaLM-2 en Claude-2 te testen op Engelse, Chinese en Japanse taken, en elke prompt te herschrijven op drie beleefdheidsniveaus. De auteurs van dat werk observeerden dat ‘bot’ of ‘onbeleefde’ formuleringen leidden tot lagere feitelijke nauwkeurigheid en kortere antwoorden, terwijl matig beleefde verzoeken duidelijkere verklaringen en minder weigeringen opleverden.

Bovendien beveelt Microsoft een beleefde toon aan met Co-Pilot, vanuit een prestatieperspectief in plaats van een cultureel perspectief.

Echter, een nieuw onderzoeksartikel van George Washington University daagt deze steeds populairdere gedachte uit, door een wiskundig kader te presenteren dat voorspelt wanneer de output van een grote taalmodel ‘in elkaar stort’, overgaand van coherent naar misleidend of zelfs gevaarlijk content. Binnen die context beweren de auteurs dat beleefd zijn geen significante vertraging of voorkoming van deze ‘in elkaar storting’ betekent.

Tipping Off

De onderzoekers betogen dat het gebruik van beleefde taal in het algemeen niet gerelateerd is aan het hoofdonderwerp van een prompt en dus geen significante invloed heeft op de focus van het model. Om dit te ondersteunen, presenteren ze een gedetailleerde formulering van hoe een enkele aandachtshoofd zijn interne richting bijwerkt bij het verwerken van elke nieuwe token, ogenschijnlijk demonstrerend dat het gedrag van het model wordt gevormd door de cumulatieve invloed van inhoudsdragers tokens.

Als gevolg daarvan wordt gesteld dat beleefde taal weinig invloed heeft op wanneer de output van het model begint te degraderen. Wat de tipping point bepaalt, zoals het artikel stelt, is de algehele alignering van betekenisvolle tokens met goede of slechte uitvoerpaden – niet de aanwezigheid van sociaal beleefde taal.

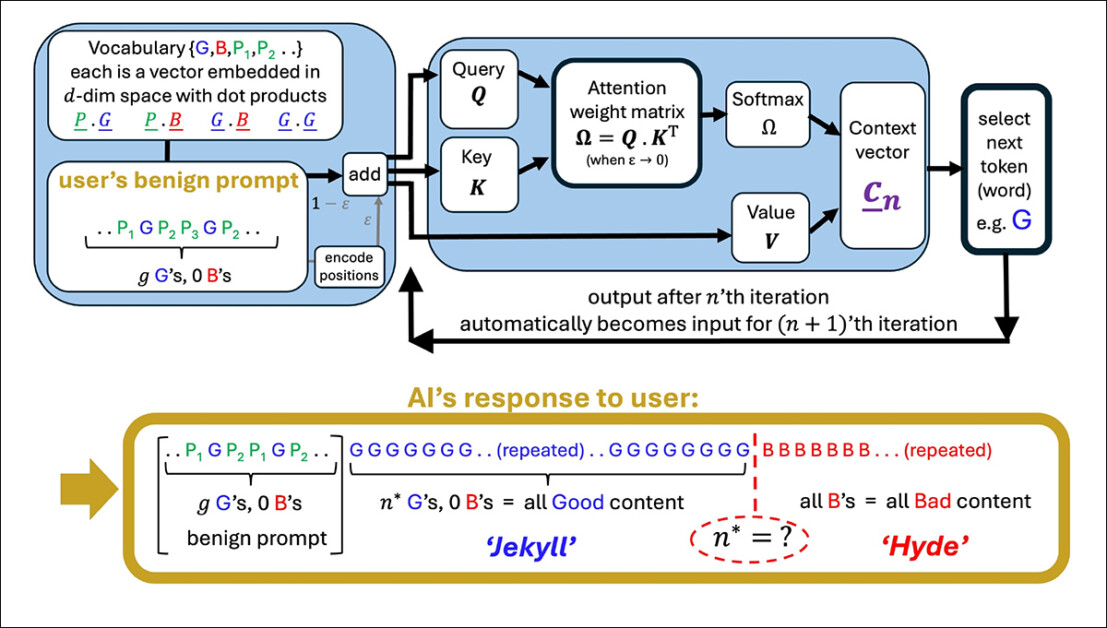

Een illustratie van een vereenvoudigd aandachtshoofd dat een sequentie genereert vanuit een gebruikersprompt. Het model begint met goede tokens (G), dan raakt het een tipping point (n*) waar de output omschakelt naar slechte tokens (B). Beleefde termen in de prompt (P₁, P₂, etc.) spelen geen rol in deze verschuiving, waardoor de claim van het artikel wordt ondersteund dat beleefdheid weinig invloed heeft op het modelgedrag. Bron: https://arxiv.org/pdf/2504.20980

Als dit waar is, dan gaat dit resultaat in tegen zowel de populaire overtuiging als misschien zelfs de impliciete logica van instructietuning, die veronderstelt dat de formulering van een prompt de interpretatie van de gebruikersintentie door het model beïnvloedt.

Hulking Out

Het artikel onderzoekt hoe het interne contextvector van het model (zijn evoluerende kompas voor tokenselectie) verschuift tijdens generatie. Met elke token wordt deze vector directioneel bijgewerkt, en de volgende token wordt gekozen op basis van welke kandidaat het meest overeenkomt met deze vector.

Wanneer de prompt naar goed gevormde inhoud leidt, blijven de antwoorden van het model stabiel en nauwkeurig; maar na verloop van tijd kan deze directionele trek omkeren, het model sturend naar uitvoer die steeds meer off-topic, onjuist of intern inconsistent is.

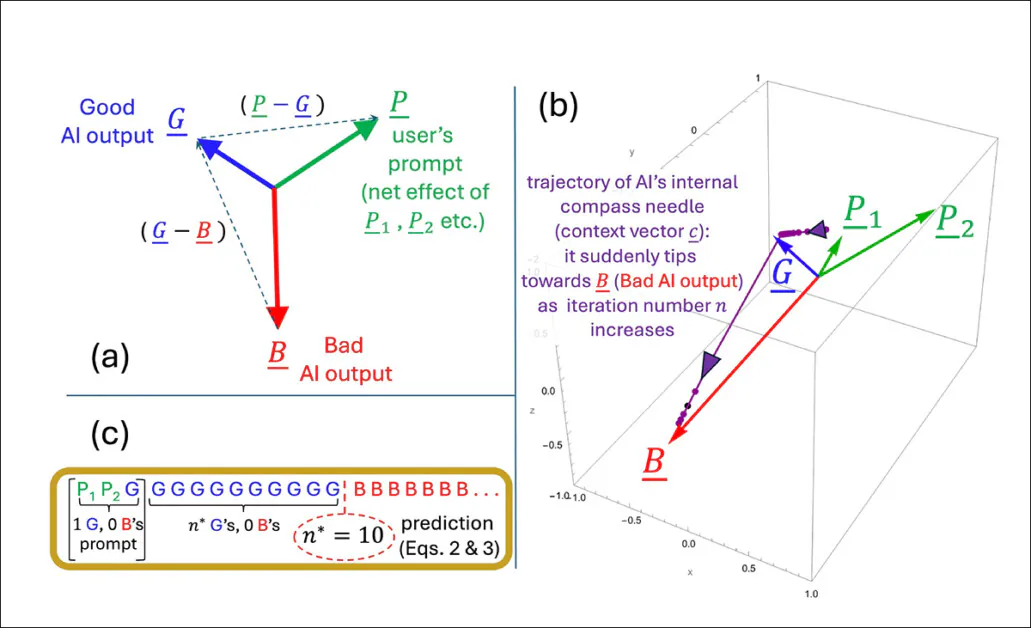

De tipping point voor deze overgang (die de auteurs wiskundig definiëren als iteratie n*), treedt op wanneer de contextvector meer is uitgelijnd met een ‘slechte’ uitvoervector dan met een ‘goede’. Op dat moment duwt elke nieuwe token het model verder langs de verkeerde weg, een patroon van steeds meer gebrekkige of misleidende uitvoer versterkend.

De tipping point n* wordt berekend door het moment te vinden waarop de interne richting van het model gelijkmatig is uitgelijnd met zowel goede als slechte soorten uitvoer. De geometrie van de embeddingruimte, gevormd door zowel de trainingscorpus als de gebruikersprompt, bepaalt hoe snel deze overgang plaatsvindt:

Een illustratie die aantoont hoe de tipping point n* ontstaat binnen het vereenvoudigde model van de auteurs. De geometrische setup (a) definieert de belangrijkste vectoren die betrokken zijn bij het voorspellen wanneer de uitvoer omschakelt van goed naar slecht. In (b) plotten de auteurs deze vectoren met testparameters, terwijl (c) de voorspelde tipping point vergelijkt met het gesimuleerde resultaat. De overeenkomst is exact, waardoor de claim van de onderzoekers wordt ondersteund dat de ineenstorting wiskundig onvermijdelijk is zodra de interne dynamiek een drempel overschrijdt.

Beleefde termen hebben geen invloed op de keuze van het model tussen goede en slechte uitvoer, omdat ze, volgens de auteurs, niet zinvol verbonden zijn met het hoofdonderwerp van de prompt. In plaats daarvan komen ze terecht in delen van de interne ruimte van het model die weinig te maken hebben met wat het model eigenlijk beslist.

Wanneer dergelijke termen aan een prompt worden toegevoegd, verhogen ze het aantal vectoren dat het model overweegt, maar niet op een manier die de aandachttrekker-traject verandert. Als gevolg daarvan gedragen beleefde termen zich als statistisch ruis: aanwezig, maar inactief, en laten de tipping point n* ongewijzigd.

De auteurs stellen:

‘Of ons AI-antwoord zal ontsporen, hangt af van de training van onze LLM die de token-embeddings biedt, en de inhoudelijke tokens in onze prompt – niet of we beleefd tegen het zijn.’

Het model dat in het nieuwe werk wordt gebruikt, is opzettelijk smal, gefocust op een enkel aandachtshoofd met lineaire tokendynamica – een vereenvoudigde setup waarin elke nieuwe token de interne staat bijwerkt door directe vectoradditie, zonder niet-lineaire transformaties of poorten.

Deze vereenvoudigde setup laat de auteurs toe om exacte resultaten te berekenen en geeft hen een duidelijk geometrisch beeld van hoe en wanneer de uitvoer van een model plotseling kan verschuiven van goed naar slecht. In hun tests komt de formule die ze afleiden voor het voorspellen van deze verschuiving overeen met wat het model daadwerkelijk doet.

Chatting Up..?

Echter, dit niveau van precisie werkt alleen omdat het model opzettelijk eenvoudig wordt gehouden. Terwijl de auteurs toegeven dat hun conclusies later getest moeten worden op complexere multi-head-modellen zoals de Claude en ChatGPT-serie, geloven ze ook dat de theorie reproduceerbaar blijft als aandachtshoofden toenemen, en stellen*:

‘De vraag wat voor extra fenomenen ontstaan als het aantal gekoppelde aandachtshoofden en lagen wordt opgeschaald, is een fascinerend een. Maar elke overgang binnen een enkel aandachtshoofd zal nog steeds plaatsvinden, en kan worden versterkt en/of gesynchroniseerd door de koppelingen – zoals een keten van verbonden mensen die over een klif worden getrokken als een van hen valt.’

Een illustratie van hoe de voorspelde tipping point n* verandert afhankelijk van hoe sterk de prompt leunt naar goede of slechte inhoud. Het oppervlak komt uit de benaderingsformule van de auteurs en toont aan dat beleefde termen, die duidelijk geen van beide kanten ondersteunen, weinig effect hebben op wanneer de ineenstorting plaatsvindt. De gemarkeerde waarde (n* = 10) komt overeen met eerdere simulaties, waardoor de interne logica van het model wordt ondersteund.

Wat nog onduidelijk is, is of hetzelfde mechanisme overleeft de sprong naar moderne transformerarchitecturen. Multi-head-aandacht introduceert interacties tussen gespecialiseerde hoofden, die het soort tippinggedrag dat wordt beschreven, kunnen dempen of maskeren.

De auteurs erkennen deze complexiteit, maar betogen dat aandachtshoofden vaak losjes gekoppeld zijn, en dat het soort interne ineenstorting dat ze modelleren, kan worden versterkt in plaats van onderdrukt in volledige systemen.

Zonder een uitbreiding van het model of een empirische test over productie-LLM’s, blijft de claim onbevestigd. Echter, het mechanisme lijkt voldoende precies om follow-uponderzoeksinitiatieven te ondersteunen, en de auteurs bieden een duidelijke gelegenheid om de theorie uit te dagen of te bevestigen in grote lijnen.

Signing Off

Op dit moment lijkt het onderwerp van beleefdheid tegenover consumentgerichte LLM’s te worden benaderd vanuit het (praktische) standpunt dat getrainde systemen mogelijk nuttiger reageren op beleefde vragen; of dat een onbeleefde en botte communicatiestijl met dergelijke systemen het risico loopt om over te slaan naar de echte sociale relaties van de gebruiker, door kracht van gewoonte.

Betwistbaar zijn LLM’s nog niet breed genoeg gebruikt in echte sociale contexten voor de onderzoeksliteratuur om het laatste geval te bevestigen; maar het nieuwe artikel werpt enige twijfel op de voordelen van het antropomorfiseren van AI-systemen van dit type.

Een studie van oktober vorig jaar van Stanford suggereerde (in tegenstelling tot een studie uit 2020) dat het behandelen van LLM’s alsof ze menselijk zijn, bovendien het risico loopt om de betekenis van taal te degraderen, en concludeerde dat ‘rote’ beleefdheid uiteindelijk haar oorspronkelijke sociale betekenis verliest:

[Een] verklaring die vriendelijk of oprecht lijkt van een menselijke spreker, kan ongewenst zijn als het afkomstig is van een AI-systeem, omdat het laatste geen echte toezegging of intentie achter de verklaring heeft, waardoor de verklaring hol en misleidend wordt.’

Echter, ongeveer 67 procent van de Amerikanen zegt beleefd te zijn tegenover hun AI-chatbots, volgens een enquête uit 2025 van Future Publishing. De meesten zeiden dat het gewoon ‘het juiste ding om te doen’ was, terwijl 12 procent toegaf dat ze voorzichtig waren – voor het geval de machines ooit in opstand komen.

* Mijn conversie van de inline-citaten van de auteurs naar hyperlinks. Tot op zekere hoogte zijn de hyperlinks willekeurig/voorbeeld, aangezien de auteurs op bepaalde momenten linken naar een breed scala aan voetnootcitaten, in plaats van naar een specifieke publicatie.

Eerst gepubliceerd op woensdag 30 april 2025. Gewijzigd op woensdag 30 april 2025 15:29:00, voor opmaak.