Kunstmatige intelligentie

Mensbeeldsynthese uit gereflecteerde radiogolven

Onderzoekers uit China hebben een methode ontwikkeld om near-fotorealistische beelden van mensen te synthetiseren zonder camera’s, door radiogolven en Generative Adversarial Networks (GANs) te gebruiken. Het systeem dat ze hebben ontwikkeld, is getraind op echte beelden die in goed licht zijn genomen, maar kan relatief authentieke ‘snapshots’ van mensen maken, zelfs wanneer de omstandigheden donker zijn – en zelfs door grote obstakels die mensen voor conventionele camera’s zouden verbergen.

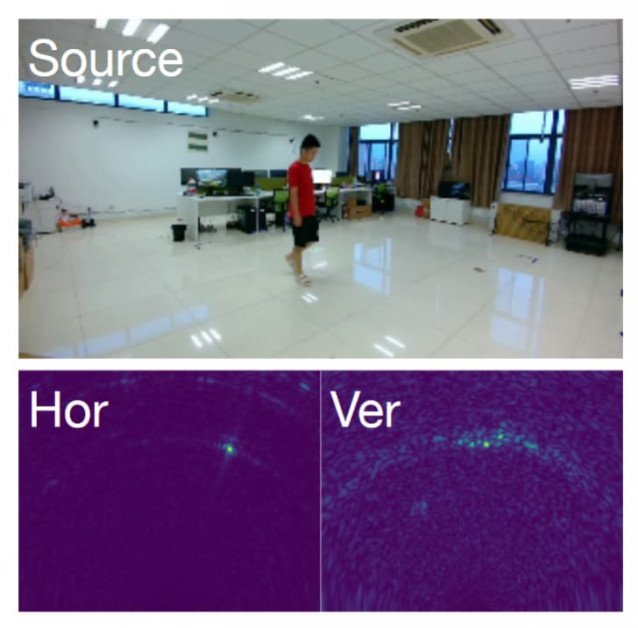

De beelden zijn afhankelijk van ‘heat maps’ van twee radianten, een die gegevens van het plafond naar beneden verzamelt, en een andere die radiogolfstoornissen van een ‘staande’ positie opneemt.

De resulterende foto’s van de proof-of-concept-experimenten van de onderzoekers hebben een gezichtsloos, ‘J-Horror’-aspect:

RFGAN is getraind op beelden van echte mensen in gecontroleerde omgevingen en op radiogolfheatmaps die menselijke activiteit opnemen. Nadat het kenmerken uit de gegevens heeft geleerd, kan RFGAN vervolgens snapshots genereren op basis van nieuwe RF-gegevens. Het resulterende beeld is een benadering, gebaseerd op de beperkte resolutie van de lagefrequente RF-signalen die beschikbaar zijn. Dit proces werkt zelfs in verduisterde omgevingen en door een variëteit aan potentiële obstakels. Bron: https://arxiv.org/pdf/2112.03727.pdf

Om de GAN te trainen, die RFGAN wordt genoemd, gebruikten de onderzoekers overeenkomende gegevens van een standaard RGB-camera en van de geconcateneerde overeenkomstige radiogolfheatmaps die op het exacte moment van opname werden geproduceerd. Beelden van gesynthetiseerde mensen in het nieuwe project zijn vaak wazig op een manier die lijkt op vroege Daguerreotype-fotografie, omdat de resolutie van de gebruikte radiogolven zeer laag is, met een diepte-resolutie van 7,5 cm en een hoekresolutie van ongeveer 1,3 graden.

Boven, het beeld dat aan het GAN-netwerk wordt gevoerd – onder, de twee heatmaps, horizontaal en verticaal, die de persoon in de kamer karakteriseren en die zelf worden gesynthetiseerd binnen de architectuur tot een 3D-weergave van de verstoorde gegevens.

Het nieuwe artikel, getiteld RFGAN: RF-Gebaseerde Mensensynthese, komt van zes onderzoekers van de Universiteit van Elektronica en Informatietechnologie van China.

Gegevens en Architectuur

Vanwege het ontbreken van enig eerder onderzoek of projecten met een vergelijkbare omvang, en het feit dat RF-signalen nooit eerder zijn gebruikt in een GAN-beeldsyntheseframework, moesten de onderzoekers nieuwe methodologieën ontwikkelen.

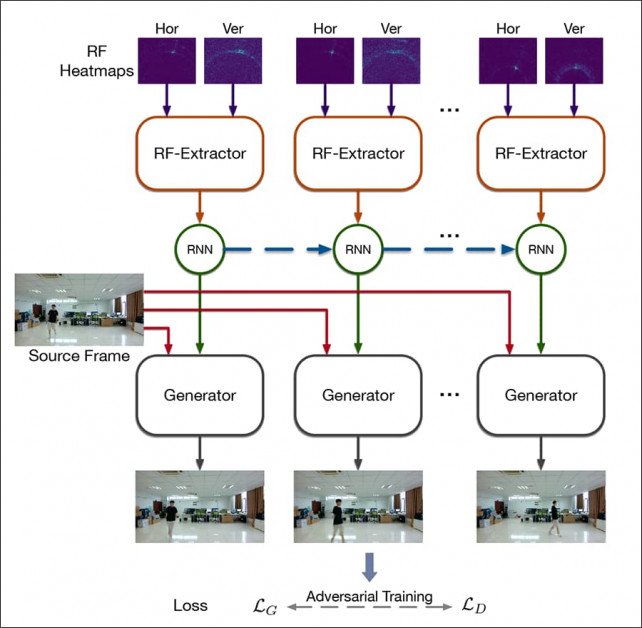

De kernarchitectuur van RFGAN.

Adaptieve normalisatie werd gebruikt om de tweeling heatmap-afbeeldingen tijdens de training te interpreteren, zodat ze ruimtelijk overeenkomen met de opgenomen beeldgegevens.

De RF-opnameapparaten waren millimetergolfradars die waren geconfigureerd als twee antenne-arrays, horizontaal en verticaal. Frequentiegemoduleerde Continue Golf (FMCW) en lineaire antennes werden gebruikt voor transceiving.

De Generator ontvangt een bronframe als invoerlaag, met de RF-gefuseerde (heatmap-)weergave die het netwerk orkestreert via normalisatie op het niveau van de convolutionele lagen.

Gegevens

De gegevens werden verzameld van RF-signaalreflecties van de mmWave-antenne bij een frequentie van slechts 20 Hz, met gelijktijdige menselijke videocapture bij een zeer lage 10 fps. Negen binnen-scenes werden opgenomen, met zes vrijwilligers, elk met verschillende kleding voor verschillende sessies van de gegevensverzameling.

Het resultaat was twee afzonderlijke datasets, RF-Activity en RF-Walk, waarvan de eerste 68.860 beelden van mensen in verschillende posities (zoals kruk en lopen) bevatte, samen met 137.760 overeenkomstige heatmap-frames; en de laatste bevatte 67.860 menselijke willekeurige loopframes, samen met 135.720 paren van geassocieerde heatmaps.

De gegevens werden, volgens conventie, onevenredig gesplitst tussen training en testen, met 55.225 beeldframes en 110.450 heatmap-paren die werden gebruikt voor training, en de rest werd achtergehouden voor testen. RGB-captureframes werden omgezet naar 320×180, en heatmaps werden omgezet naar 201×160.

Het model werd vervolgens getraind met Adam bij een consistent leer tempo van 0,0002 voor zowel de generator als de discriminator, bij een epoch van 80 en een (zeer schaarse) batchgrootte van 2. Training vond plaats via PyTorch op een consumentenniveau sole GTX-1080 GPU, waarvan 8 GB VRAM over het algemeen zou worden beschouwd als vrij bescheiden voor een dergelijke taak (wat de lage batchgrootte verklaart).

Hoewel de onderzoekers enkele conventionele metrieken hebben aangepast voor het testen van de realisme van de uitvoer (gedetailleerd in het artikel), en de gebruikelijke ablatietests hebben uitgevoerd, was er geen equivalent voorgaand onderzoek waarop de prestaties van RFGAN konden worden gemeten.

Open Interesse in Geheime Signalen

RFGAN is niet het eerste project dat heeft geprobeerd radiogolven te gebruiken om een volumetrisch beeld te maken van wat er in een kamer gebeurt. In 2019 ontwikkelden onderzoekers van MIT CSAIL een architectuur genaamd RF-Avatar, die in staat was om 3D-mensen te reconstrueren op basis van radiogolfsignalen in het Wi-Fi-bereik, onder zware omstandigheden van occlusie.

In het MIT CSAIL-project van 2019 werden radiogolven gebruikt om occlusies te verwijderen, zelfs inclusief muren en kleding, om gevangen onderwerpen te reconstrueren in een meer traditionele CGI-gebaseerde workflow. Bron: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

De onderzoekers van het nieuwe artikel erkennen ook losjes verwant eerder onderzoek naar omgevingskaarten met radiogolven (geen van hen probeert fotorealistische mensen te reconstrueren), dat heeft geprobeerd menselijke snelheid te schatten; zie door muren met Wi-Fi; menselijke poses evalueren; en zelfs menselijke gebaren herkennen, onder andere doelen.

Overdrachtbaarheid en Breder Toepasbaarheid

De onderzoekers hebben vervolgens geprobeerd te zien of hun ontdekking was over-gefokt op de initiële opnameomgeving en trainingsomstandigheden, hoewel het artikel weinig details over deze fase van het experiment biedt. Ze beweren:

‘Om ons model in een nieuwe scène te implementeren, hoeven we het hele model niet opnieuw te trainen. We kunnen het voorgetrainde RFGAN fijn afstemmen met heel weinig gegevens (ongeveer 40s gegevens) om soortgelijke resultaten te krijgen.’