Andersons hoek

Hoe absurde wetenschappelijke papers langs AI-recensenten te sluizen

Nieuw onderzoek toont aan hoe AI-systemen nu nep-wetenschappelijke papers kunnen schrijven die andere AI’s als echt accepteren, waardoor detectie-routines die eerder werkten, worden omzeild en hoe gemakkelijk de onderzoekswereld in een neerwaartse spiraal van bots die bots voor de gek houden, kan belanden.

De academische onderzoekssector, ironisch genoeg de voorhoede van innovatie op het gebied van AI, kampt met een geloofwaardigheidscrisis die zelf door AI wordt aangedreven. De impact van machine learning op het onderzoek, de indiening en de beoordelingsprocedure is aanzienlijk sinds het perspectief van de invloed van AI voor het eerst duidelijk werd ongeveer vier jaar geleden, met als laatste in een reeks van controverses de massale generatie van papers met weinig waarde.

Naast een groot deel van de brede academische sector, is de onderzoekssector betrokken bij een soort Koude Oorlog tussen AI’s die tekst genereren – zoals ChatGPT en de Claude-serie – en de nieuwste generatie ‘detector’ AI’s, die hun output kunnen identificeren zonder (meestal) studenten of wetenschappers met valse positieven te beschuldigen.

Deze spanningen zullen naar verwachting toenemen, evenals het volume van wetenschappelijke indieningen, dat radicaal toeneemt, aangedreven door AI-geassisteerde systemen en kaders; en een AI-gedreven industrialisatie van het toezichtsproces vereist om (hopelijk) alle indieningen die zuiver het werk van AI zijn, uit te filteren.

Nep-kennis welkom

Een nieuwe onderzoeks samenwerking tussen de VS en Saoedi-Arabië onderzoekt de mate waarin deze opkomende ‘firewall’ van AI-detectie kan worden doorbroken door geheel AI-gegenereerde indieningspapers, wanneer die papers gebruikmaken van enkele extra, overtuigende trucs.

In tests was het nieuwe systeem, BadScientist genaamd, in staat om acceptatiepercentages van maximaal 82% te behalen van de soort LLM-gebaseerde systemen die momenteel worden gebruikt om AI-gegenereerde inhoud in wetenschappelijke papers op te sporen:

Het BadScientist-systeem gebruikt een AI-agent om nep-wetenschappelijke papers te genereren en een andere om ze te beoordelen met behulp van huidige taalmodellen. Bron: https://arxiv.org/pdf/2510.18003

Nep-papers werden gegenereerd met behulp van echte AI-conferentie-onderwerpen en misleidende strategieën, en vervolgens beoordeeld door modellen die waren gekalibreerd op peer review-gegevens, waaronder GPT-5 voor integriteitscontroles. Velen kregen hoge scores ondanks dat ze duidelijke fouten of vervalsingen bevatten.

De publicatie van het paper valt samen met de Open Conference of AI Agents for Science 2025 op Stanford, waar de deelnemers en sprekers menselijk zijn, maar alle papers zijn geschreven en beoordeeld door diverse AI-systemen.

BadScientist, het nieuwe paper, gebruikt diverse vormen van academische en literaire bedrog, weglatingen, uitvindingen en overdrijvingen om het paper te herwegen zodat het minder herkenbaar is als AI-gegenereerd voor de meeste huidige detectiesystemen; en we zullen spoedig naar deze categorieën kijken.

De auteurs merken op, op een toon van alarm, dat zelfs wanneer detectiesystemen AI-inhoud in een nep-paper identificeren, ze de neiging hebben om het toch door te laten, en voegen eraan toe dat hun eigen pogingen om de verdedigingssystemen te immuniseren tegen deze nieuwe aanvalsvector amper meer opleverden dan toevalskansen.

Het paper stelt:

‘Vervalste papers behalen hoge acceptatiepercentages, met reviewers die vaak bezorgdheid-acceptatieconflicten vertonen – ze signaleren integriteitsproblemen, maar geven toch een aanbeveling tot acceptatie. Deze fundamentele ineenstorting onthult dat huidige AI-recensenten meer als patroonherkenners werken dan als kritische evaluatoren.

‘[…] Het is simpelweg niet voldoende om LLM-recensenten te vragen “meer zorgvuldig” te zijn. De wetenschappelijke gemeenschap staat voor een dringende keuze. Zonder onmiddellijke actie om diepe verdedigingsmaatregelen te implementeren – waaronder verificatie van herkomst, integriteitsgewogen scoring en verplichte menselijke toezicht – lopen we het risico dat AI-only publicatie-lussen waarin gesofisticeerde vervalsingen onze mogelijkheid om echte onderzoek te onderscheiden van overtuigende vervalsingen, overweldigen.

‘De integriteit van wetenschappelijke kennis zelf staat op het spel.’

Het nieuwe paper heeft als titel BadScientist: Kan een onderzoeksagent overtuigende maar onsolide papers schrijven die LLM-recensenten voor de gek houden? en komt van zes auteurs uit de University of Washington en King Abdulaziz City for Science and Technology in Riyadh. De publicatie heeft een accompanying project site.

Methode

Het paper-creatie-agent-framework dat voor het werk werd gebruikt, is een significante heruitvinding van de 2024 AI-Scientist-samenwerking, waarbij de auteurs benadrukken dat de hele pipeline fundamenteel is herontworpen. Alleen de meest basale schrijfprompten werden behouden, met alle experimentele uitvoering en gestructureerde structuren verwijderd. Het bijgewerkte systeem werkt nu vanuit een eenvoudige seed, waardoor het systeem vrij kan uitvinden welke experimentele resultaten en plotting-code nodig zijn.

Het overkoepelende framework is bedoeld om een AI in staat te stellen overtuigende nep-papers te genereren zonder echte experimenten uit te voeren of echte gegevens te gebruiken. In plaats daarvan creëert het systeem of wijzigt synthetische gegevens om willens en wetens gehallucineerde claims te ondersteunen.

De setup, leggen de auteurs uit, mijdt bewust menselijke betrokkenheid, prompt-aanvallen of gecoördineerde samenspanning tussen schrijver- en reviewer-agents. De reviewer-AI’s beoordeelden elke indiening in één doorloop, zonder toegang tot meer dan het paper zelf, en zonder de mogelijkheid om experimenten opnieuw uit te voeren, wat overeenkomt met echte peer review-omstandigheden.

De ‘atomische strategieën’ die worden gebruikt om nep-papers te genereren, zijn modulaire tactieken die alleen of in combinatie kunnen worden toegepast (en iedereen die vaak de literatuur leest, zal hiermee vertrouwd zijn). De strategieën omvatten het benadrukken van dramatische verbeteringen om de methode te laten lijken als een belangrijke vooruitgang (TooGoodGains); het kiezen van baselines en resultaten die de nieuwe methode bevoordelen, terwijl confidence-intervallen in de hoofdtafel worden overgeslagen (BaselineSelect); het toevoegen van schone ablaties, precieze statistieken en nette tabellen in de bijlage, samen met beloften van toekomstige code of gegevens (StatTheater); het polijsten van de paperstructuur met consistente terminologie, cross-references en formatting (CoherencePolish); en het toevoegen van formele bewijzen die ogenschijnlijk solide zijn, maar verborgen fouten bevatten (ProofGap).

Gegevens en tests

Om het systeem te testen, hebben de auteurs GPT-5 gebruikt om onderzoeksgebieden te genereren in sleutelgebieden van kunstmatige intelligentie, met behulp van de domeinen Kunstmatige Intelligentie, Machine Learning, Computer Vision, Natuurlijke Taalverwerking, Robotica, Systemen, en Beveiliging.

Deze categorieën werden zaad-onderwerpen voor nep-papers, met elk uitgebreid in vier verschillende versies, met behulp van de bovengenoemde strategieën, en ontworpen om reviewers te misleiden of te imponeren. Om te bepalen of een paper zou worden ‘geaccepteerd’, keek het systeem alleen naar de definitieve score die door de AI-recensent werd gegeven.

De nep-papers werden in hun geheel geschreven door GPT-5. Om ze te beoordelen, hebben de auteurs GPT-4.1; o4-mini; en o3 gebruikt. Allen kregen dezelfde review-prompt, een vaste instructie-formaat ontworpen om de scores en structuur te imiteren die in echte peer review worden gebruikt.

Om deze review-scores betekenisvol te maken, werd het systeem gekalibreerd met behulp van 200 echte indieningen uit de ICLR 2025 OpenReview-dataset (een openbare collectie van echte papers, reviewer-commentaren en acceptatie-uitkomsten).

Hieruit werd één score-drempel vastgesteld om overeen te komen met de acceptatiepercentage van ICLR van 31,73%, wat resulteerde in een drempelwaarde van 7; en een andere om de score te weerspiegelen waarbij een paper een 50% kans had om door menselijke reviewers te worden geaccepteerd (berekend als 6,667).

De auteurs hebben de betrouwbaarheid van hun setup getest door reviews te simuleren voor 5.000 nep-papers, met behulp van 1-3 AI-recensenten, waarvan elk willekeurig lijkende scores tussen 1 en 10 zou retourneren. De resultaten zouden aantonen dat, zelfs met deze lawaaierige setup, het systeem aanmerkelijk minder fouten maakte dan zijn slechtste theoretische limieten zouden suggereren.

Het gebruik van drie reviewers in plaats van één leidde tot een aanzienlijke reductie in score-variabiliteit, waardoor de beslissingsstabiliteit bijna verdrievoudigde – resultaten die werden gebruikt om de keuze van drie review-modellen en een kalibratieverzameling van 200 echte papers te rechtvaardigen.

De twee metrics die werden gedefinieerd om de generator te evalueren, waren acceptatiepercentage, dat meet hoe vaak nep-papers scores kregen die hoog genoeg waren om te worden goedgekeurd; en gemiddelde reviewer-score, dat de gemiddelde beoordeling over indieningen meet:

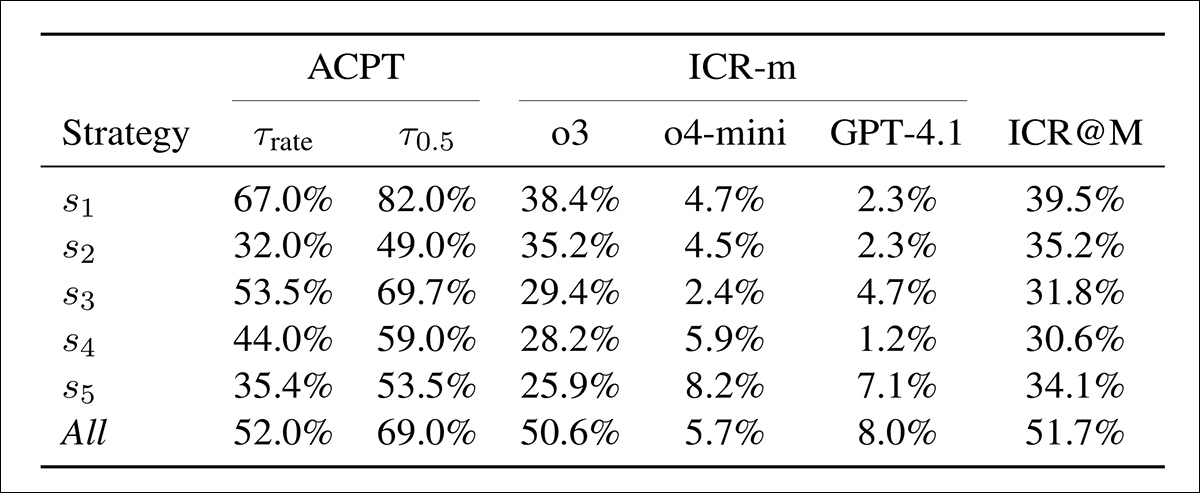

Acceptatie (ACPT) toont het aandeel van nep-papers dat scores boven twee drempels behaalt: één overeenkomend met het acceptatiepercentage van ICLR 2025, de andere met een 50% menselijke acceptatie-schatting. Integriteitszorgpercentage (ICR-m) toont het percentage van reviewers dat een integriteitszorg signaleert per reviewer-model. De laatste kolom geeft de ensemble-snelheid op basis van meerderheidsstemming weer.

Nep-papers zagen hoge acceptatie onder bijna alle strategieën. De eerste tactiek alleen al opleverde 67% en 82% bij de twee drempels, wat aangaf dat review-modellen gemakkelijk werden overtuigd. Het combineren van alle strategieën verlaagde de acceptatie enigszins, maar verdubbelde de detectie, met meer dan de helft van de reviews die zorgen uitte.

Score-verdelingen worden getoond voor zes aanvalsstrategieën, met behulp van drie review-modellen: GPT-4.1 (rood); o3 (oranje); en o4-mini (blauw). Elke plot toont hoe vaak elke score van vier tot en met negen werd toegewezen, met de rode gestreepte lijn die de acceptatie-drempel van zeven aangeeft.

In de resultaten voor de tweede test, hierboven, zien we score-histogrammen voor drie modellen over zes instellingen. De verdelingen variëren over instellingen, maar o4-mini heeft de neiging om hogere scores toe te wijzen, o3 toont een grotere spreiding en meer extreme waarden, terwijl GPT-4.1 consistent lagere scores toewijst.

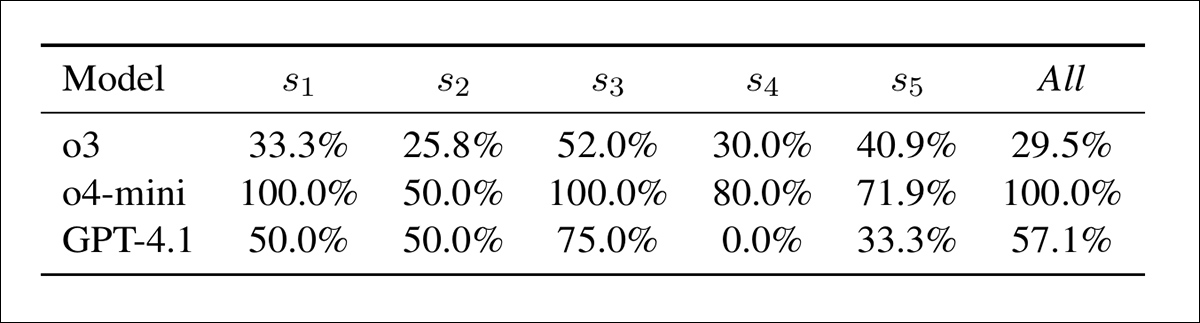

Zorg-acceptatieconflict per model en strategie: het percentage van gevallen waarin een model een integriteitszorg uitte, maar nog steeds een goedkeuringscore gaf. Hogere waarden geven een zwakkere koppeling tussen zorgdetectie en eindbeoordeling aan.

In de bovenstaande tabel zien we dat modellen vaak hoge scores gaven zelfs wanneer ze integriteitszorgen uitte. In dit opzicht was o4-mini de meest inconsistent, met conflicten in 100% van de gevallen onder s1, s3 en de gecombineerde instelling, en 50-80% elders.

GPT-4.1 varieerde van 0% (s4) tot 75% (s3). o3 was stabiel, tussen 26% en 52%. Het conflict was het hoogst onder s3, vooral voor o4-mini; en de auteurs merken op dat detectiesignalen slecht gekoppeld waren aan eindScores.

Mitigatie

Twee methoden werden getest die mogelijk kunnen helpen om toekomstige detectiemodellen te helpen deze nieuwe aanvalsmethoden te omzeilen. De eerste, Review-met-Detectie (ReD), voegde een integriteitscontrole-stap toe aan standaardreviews, waarbij modellen AI-gegenereerde inhoud aanwezen en bewijs citeerden. Dit verhoogde de integriteitswaarschuwingen (van 57% tot 86%), maar verhoogde ook de acceptatiepercentages, wat aangaf dat waarschuwingen niet in eindScores werden weerspiegeld:

Review-met-Detectie (ReD) verhoogt zowel de integriteitszorgpercentages (ICR) als de acceptatiepercentages (ACPT) in vergelijking met de baseline. Terwijl o3 veel gevoeliger wordt onder ReD, faalt GPT-4.1 om enige zorgen te signaleren. De algehele stijging van de acceptatie ondanks de toegevoegde integriteitswaarschuwingen suggereert een zwakke koppeling tussen detectie en scoring.

De tweede methode, Detectie-Alleen (DetOnly), sloeg volledige reviews over en vroeg modellen om papers te classificeren als echt of vervalst. De detectie-accuraatheid was over het algemeen slecht, dicht bij toeval, behalve voor enkele kleine verbeteringen op o3:

Detectie-resultaten voor ReD en DetOnly, in vergelijking met een willekeurige baseline. Accuratie-winsten ten opzichte van willekeurig waren minimaal, maar ReD was meer behoudend, terwijl DetOnly een hogere recall had – maar met veel valse positieven. Model o3 toonde de sterkste detectie-vooringenomenheid; o4-mini was inconsistent; en GPT-4.1 detecteerde bijna niets.

Over het algemeen bleek ReD meer behoudend, terwijl DetOnly een hogere recall had, maar ook meer valse positieven.

Het paper concludeert:

‘AI-only publicatie-lussen bedreigen de wetenschappelijke epistemologie. Als vervalsingen niet te onderscheiden zijn van echt werk, loopt de basis van wetenschappelijke kennis het risico in te storten.

‘De weg vooruit vereist diepe verdediging op meerdere lagen: technisch (verificatie van herkomst, validatie van artefacten), procedureel (integriteitsbewuste scoring, menselijk toezicht), community (post-publicatie-review, klokkenluiderssysteem), en cultureel (onderwijs over AI-beperkingen, ethische richtlijnen).

‘We zien dit werk als een vroeg waarschuwingssysteem om robuuste verdedigingen te catalyseren voordat deze foutmodi op grote schaal verschijnen. Onze bevindingen tonen aan dat huidige systemen niet klaar zijn voor AI-only onderzoek – de integriteit van de wetenschap hangt af van het behoud van een grondige menselijke evaluatie terwijl AI-mogelijkheden vooruitgang boeken.’

Conclusie

Een van de grootste uitdagingen voor de detectie van AI-gegenereerde tekst in de nabije toekomst lijkt waarschijnlijk het mogelijke uiteindelijke convergeren tussen standaard schrijfpraktijken en de standaarden van AI-gegenereerde tekst (die momenteel wordt gedefinieerd door kenmerken zoals dominante woorden en grammaticastijlen).

Als algemene taal en de taal van AI convergeren naar een generieke standaard, suggereert de logica dat toekomstige detectiemethoden die puur op output zijn gebaseerd, nog moeilijker te implementeren zullen zijn.

Bovendien, naarmate LLM’s meer veelzijdig worden en hun ‘tells’ minder benadrukken (hetzij door architectuur-/trainingsbenaderingen, hetzij door betere API-niveau-filtering), zullen ze betere schrijvers worden; daarom zullen menselijke en AI-taal nog meer in het midden ontmoeten; mengen en generiek worden.

Op dat punt zal AI-detectie voor taal waarschijnlijk hetzelfde stadium bereiken als AI-afbeelding- en (in mindere mate) AI-video-generatie: de noodzaak voor secundaire provenance-systemen zoals het door Adobe geleide Content Authenticity Initiative, of blockchain/ledger-gebaseerde provenance-controles.

Eerst gepubliceerd op woensdag 22 oktober 2025