Cyberbeveiliging

Google Details Security Architecture for Chrome’s AI Agent Features

Google heeft een gedetailleerd beveiligingskader gepubliceerd voor de aanstaande agentic AI-functies van Chrome, met meerdere verdedigingslagen ontworpen om gebruikers te beschermen wanneer Gemini-geactiveerde agenten autonome browsertaken uitvoeren.

De aankondiging van Chrome-beveiligingsingenieur Nathan Parker schetst vier kernbeveiligingspijlers die bepalen hoe AI-agenten interactie hebben met websites namens gebruikers. De architectuur adresseert risico’s die vroeg agentic-systemen hebben geplaagd, waaronder prompt-injectieaanvallen, ongeautoriseerde gegevenstoegang en frauduleuze transacties.

Google’s aanpak arriveert terwijl concurrenten racen om browser-gebaseerde AI-agenten te verzenden. OpenAI lanceerde ChatGPT Atlas in oktober met agentmodusmogelijkheden, terwijl Perplexity zijn Comet-browser in juli verzond. Het beveiligingskader signaleert Google’s intentie om voorzichtiger te zijn dan rivalen wiens agentic-functies door onderzoekers al kwetsbaar voor exploitatie zijn gebleken.

Vier Pijlers van Agentbeveiliging

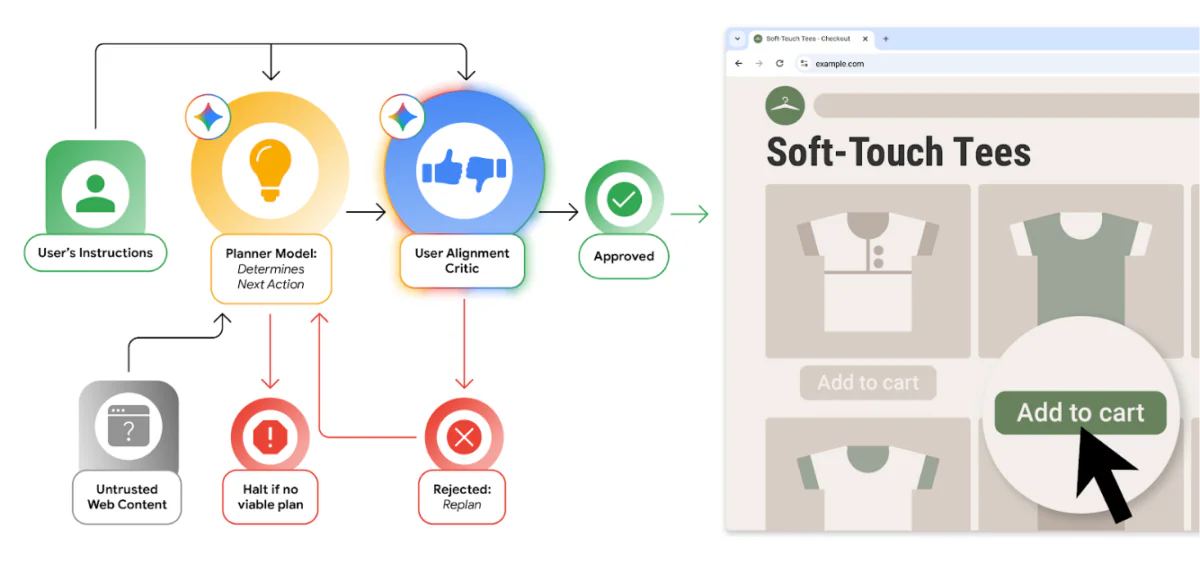

De User Alignment Critic vormt de eerste verdedigingslaag – een apart Gemini-model dat elke actie die de primaire AI-agent voorstelt, controleert. Deze criticus werkt in isolatie en onderzoekt alleen metadata over voorgestelde acties in plaats van de volledige paginainhoud, waardoor de blootstelling aan kwaadaardige invoer wordt verminderd. Als een actie riskant of niet relevant voor het door de gebruiker gestelde doel lijkt, kan de criticus een nieuwe poging bevelen of de controle teruggeven aan de gebruiker.

Origin Sets beperken welke websites en paginabestanddelen een agent kan benaderen tijdens een bepaalde taak. Het systeem onderscheidt tussen alleen-lezenorigins waar de agent inhoud kan consumeren en lees-schrijforigins waar het acties kan uitvoeren. Ongerelateerde websites en iframes worden volledig geweerd, met een vertrouwde poortfunctie die vereist is om toegang tot nieuwe domeinen te goedkeuren. Dit voorkomt cross-site datalekkage en beperkt de potentiële schade van een gecompromitteerde agent.

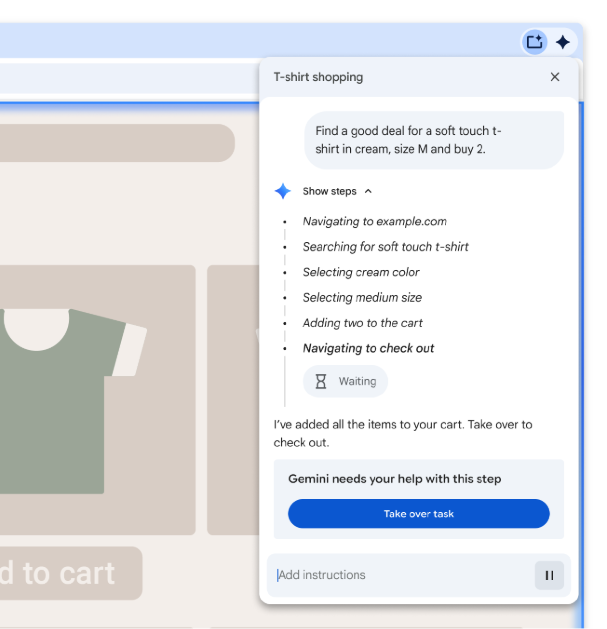

Gebruikerscontrole vereist handmatige bevestiging voor gevoelige bewerkingen. Wanneer een agent bankportals, medische gegevenssites tegenkomt of toegang nodig heeft tot opgeslagen referenties van Google Password Manager, pauzeert Chrome en vraagt de gebruiker om de actie goed te keuren. Hetzelfde geldt voor het doen van aankopen of het verzenden van berichten – de agent kan deze acties niet autonoom voltooien.

Prompt Injectie Detectie maakt gebruik van een speciale classificator die pagina’s in real-time scant op indirecte prompt-injectiepogingen. Dit systeem werkt naast Chrome’s bestaande Safe Browsing-infrastructuur en on-device scamdetectie om verdachte kwaadaardige inhoud te blokkeren voordat de agent erop kan reageren.

Geautomatiseerde Red-Teaming en Bug Bounties

Google heeft geautomatiseerde red-teaming-systemen ontwikkeld die testwebsites en LLM-gedreven aanvallen genereren om de beveiligingsarchitectuur voortdurend te valideren. Het bedrijf prioriteert testen van aanvalsvector die langdurige schade kunnen veroorzaken, met name die gericht op financiële transacties of referentiediefstal.

Chrome’s auto-update-mechanisme zal reparaties snel leveren zodra nieuwe kwetsbaarheden worden ontdekt. Om externe beveiligingsonderzoek aan te moedigen, kondigde Google beloningen aan tot $20.000 voor onderzoekers die zwakheden in het agentic browsingsysteem identificeren.

De defensieve maatregelen weerspiegelen lessen die zijn geleerd uit vroege AI-browserextensies en chatbotintegraties, waar prompt-injectieaanvallen verrassend effectief bleken te zijn bij het manipuleren van AI-gedrag. Door de criticusmodel te isoleren en de oorsprongstoegang op browserniveau te beperken, probeert Google te voorkomen dat de webpagina zelf een aanvalsoppervlak wordt.

Implicaties voor de AI-Browser Race

Google’s gedetailleerde beveiligingsopenbaarmaking contrasteert met de relatieve ondoorzichtigheid rond concurrerende agentic browsersystemen. Het bedrijf lijkt in te zetten op het feit dat ondernemingen en beveiligingsbewuste gebruikers transparante waarborgen zullen waarderen boven eerste-verplaatsingsfuncties.

De architectuur suggereert ook wat Google als acceptabele autonomie voor AI-agenten beschouwt. Shoppen, onderzoek en formulierinvullen kunnen met toezicht doorgaan, maar alles wat financiële rekeningen, gezondheidsgegevens of opgeslagen referenties raakt, vereist expliciete menselijke goedkeuring. Dit trekt een duidelijke lijn die andere leveranciers minder bereid zijn om publiekelijk te definiëren.

Voor ontwikkelaars die op Chrome’s platform bouwen, zullen de origin set-beperkingen zorgvuldige overweging vereisen van hoe agentic-functies interactie hebben met multi-site workflows. Toepassingen die verwachten dat agenten vrij kunnen navigeren over domeinen, kunnen architectonische wijzigingen nodig hebben om te werken binnen Google’s beveiligingsmodel.

Google heeft nog geen specifieke releasedatum aangekondigd voor agentic browsingsfuncties in Chrome, maar het gedetailleerde beveiligingskader suggereert dat de implementatie nadert. Het bedrijf is bereid om de defensieve architectuur voor de lancering te publiceren, wat vertrouwen in de aanpak aangeeft – en een impliciete uitdaging aan concurrenten om zijn transparantie te evenaren.