Kunstmatige intelligentie

Betere AI-video genereren vanuit slechts twee afbeeldingen

Video frame interpolatie (VFI) is een open probleem in generatieve video-onderzoek. De uitdaging is om tussenliggende frames te genereren tussen twee bestaande frames in een video-sequence.

Klik om af te spelen. Het FILM-raamwerk, een samenwerking tussen Google en de University of Washington, heeft een effectieve frame-interpolatiemethode voorgesteld die nog steeds populair is in hobbyist- en professionele kringen. Aan de linkerkant kunnen we de twee afzonderlijke en verschillende frames zien die zijn gesuperponeerd; in het midden, het ‘eindframe’; en aan de rechterkant, de finale synthese tussen de frames. Bronnen: https://film-net.github.io/ en https://arxiv.org/pdf/2202.04901

In het algemeen gesproken, dateert deze techniek van meer dan een eeuw geleden en is het gebruikt in traditionele animatie sindsdien. In die context zouden meester ‘keyframes’ worden gegenereerd door een hoofdanimatiekunstenaar, terwijl het werk van ‘tussenliggende frames’ zou worden uitgevoerd door andere medewerkers, als een meer ondergeschikte taak.

Vóór de opkomst van generatieve AI, werd frame-interpolatie gebruikt in projecten zoals Real-Time Intermediate Flow Estimation (RIFE), Depth-Aware Video Frame Interpolation (DAIN), en Google’s Frame Interpolation for Large Motion (FILM – zie boven) voor doeleinden van het verhogen van de frame-rate van een bestaande video, of het mogelijk maken van kunstmatig gegenereerde slow-motion-effecten. Dit wordt bereikt door de bestaande frames van een clip te splitsen en geschatte tussenliggende frames te genereren.

VFI wordt ook gebruikt in de ontwikkeling van betere video-codecs en, meer in het algemeen, in optical flow-gebaseerde systemen (inclusief generatieve systemen), die gebruikmaken van voorafgaande kennis van komende keyframes om de interstitiële inhoud die eraan voorafgaat te optimaliseren en te vormen.

Eindframes in generatieve videosystemen

Moderne generatieve systemen zoals Luma en Kling laten gebruikers toe om een start- en eindframe te specificeren en kunnen deze taak uitvoeren door keypoints in de twee afbeeldingen te analyseren en een traject te schatten tussen de twee afbeeldingen.

Zoals we kunnen zien in de onderstaande voorbeelden, biedt het verstrekken van een ‘sluitend’ keyframe de generatieve videosystemen (in dit geval, Kling) beter de mogelijkheid om aspecten zoals identiteit te behouden, zelfs als de resultaten niet perfect zijn (vooral bij grote bewegingen).

Klik om af te spelen. Kling is een van de groeiende aantal video-generatoren, inclusief Runway en Luma, die de gebruiker toelaten om een eindframe te specificeren. In de meeste gevallen leidt minimale beweging tot de meest realistische en minst-gebrekkige resultaten. Bron: https://www.youtube.com/watch?v=8oylqODAaH8

In het bovenstaande voorbeeld is de identiteit van de persoon consistent tussen de twee door de gebruiker verstrekte keyframes, wat leidt tot een relatief consistente videogeneratie.

Wanneer alleen het startframe wordt verstrekt, is het venster van aandacht van de generatieve systemen meestal niet groot genoeg om te ‘onthouden’ hoe de persoon eruitzag aan het begin van de video. In plaats daarvan is de identiteit waarschijnlijk om te schakelen met elke frame, totdat alle gelijkenis verloren gaat. In het onderstaande voorbeeld werd een startafbeelding geüpload en de beweging van de persoon werd geleid door een tekstprompt:

Klik om af te spelen. Met geen eindframe, heeft Kling alleen een kleine groep onmiddellijk voorafgaande frames om de generatie van de volgende frames te leiden. In gevallen waarin enige significante beweging nodig is, wordt deze atrofie van identiteit ernstig.

We kunnen zien dat de gelijkenis van de acteur niet bestand is tegen de instructies, aangezien het generatieve systeem niet weet hoe hij eruit zou zien als hij zou glimlachen, en hij glimlacht niet in het zaadbeeld (de enige beschikbare referentie).

De meerderheid van de virale generatieve clips zijn zorgvuldig gecureerd om deze tekortkomingen te bagatelliseren. Echter, de vooruitgang van temporeel consistente generatieve videosystemen kan afhankelijk zijn van nieuwe ontwikkelingen uit het onderzoekssector met betrekking tot frame-interpolatie, aangezien de enige mogelijke alternatief een afhankelijkheid is van traditionele CGI als een ‘guide’-video (en zelfs in dit geval zijn consistentie van textuur en verlichting momenteel moeilijk te bereiken).

Bovendien maakt de langzaam-iteratieve aard van het afleiden van een nieuw frame uit een kleine groep recente frames het zeer moeilijk om grote en moedige bewegingen te bereiken. Dit komt doordat een object dat snel over een frame beweegt, van de ene kant naar de andere kant kan gaan in de ruimte van een enkel frame, in tegenstelling tot de meer geleidelijke bewegingen waarop het systeem waarschijnlijk is getraind.

Evenzo kan een significante en moedige verandering van houding niet alleen leiden tot identiteitsverschuiving, maar ook tot levendige niet-overeenkomsten:

Klik om af te spelen. In dit voorbeeld van Luma, lijkt de gevraagde beweging niet goed te worden weergegeven in de trainingsgegevens.

Framer

Dit brengt ons bij een interessant recent artikel uit China, dat beweert een nieuwe staat-van-de-kunst te hebben bereikt in authenticerende frame-interpolatie – en dat is de eerste van zijn soort die drag-gebaseerde gebruikersinteractie biedt.

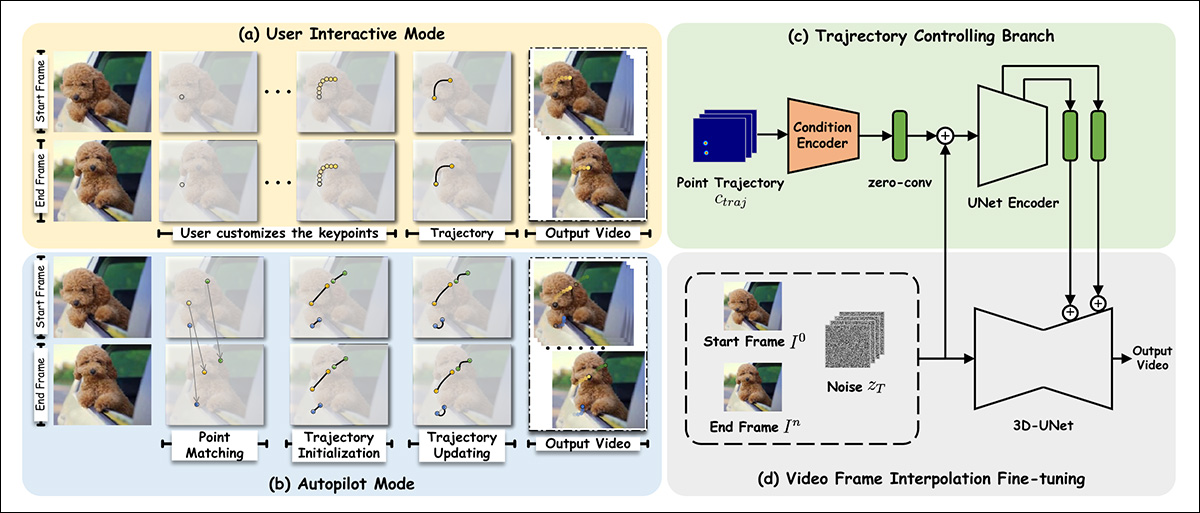

Framer laat de gebruiker toe om beweging te sturen met een intuïtieve drag-gebaseerde interface, hoewel het ook een ‘automatische’ modus heeft. Bron: https://www.youtube.com/watch?v=4MPGKgn7jRc

Drag-gecentreerde toepassingen zijn frequent in de literatuur de laatste tijd, aangezien de onderzoekssector worstelt om instrumenten te bieden voor generatieve systemen die niet zijn gebaseerd op de vrij grove resultaten die worden verkregen met tekstprompts.

Het nieuwe systeem, getiteld Framer, kan niet alleen de gebruiker-geleide drag volgen, maar heeft ook een meer conventionele ‘autopilot’-modus. Naast conventionele tweening, is het systeem in staat om tijd-lapse-simulaties, evenals morphing en nieuwe weergaven van de invoerafbeelding te produceren.

Interstitial frames gegenereerd voor een tijd-lapse-simulatie in Framer. Bron: https://arxiv.org/pdf/2410.18978

Met betrekking tot de productie van nieuwe weergaven, gaat Framer een beetje over in het gebied van Neural Radiance Fields (NeRF) – hoewel het slechts twee afbeeldingen vereist, terwijl NeRF meestal zes of meer beeldinvoerweergaven vereist.

In tests, Framer, dat is gebaseerd op Stability.ai’s Stable Video Diffusion latent diffusion generatieve video-model, was in staat om de benaderde rivale benaderingen te overtreffen, in een gebruikersstudie.

Op het moment van schrijven, is de code gepland om te worden vrijgegeven op GitHub. Video-voorbeelden (waarvan de bovenstaande afbeeldingen zijn afgeleid) zijn beschikbaar op de projectsite, en de onderzoekers hebben ook een YouTube-video vrijgegeven.

Het nieuwe artikel is getiteld Framer: Interactieve Frame Interpolatie, en komt van negen onderzoekers uit Zhejiang University en de Alibaba-gebackte Ant Group.

Methode

Framer gebruikt keypoint-gebaseerde interpolatie in een van zijn twee modaliteiten, waarin de invoerafbeelding wordt geëvalueerd voor basis-topologie, en ‘beweegbare’ punten worden toegewezen waar nodig. In feite zijn deze punten equivalent aan gezichtskenmerken in ID-gebaseerde systemen, maar generaliseren naar elk oppervlak.

De onderzoekers fine-tuned Stable Video Diffusion (SVD) op de OpenVid-1M dataset, met een extra laatste frame-synthese-capaciteit toegevoegd. Dit faciliteert een traject-controle-mechanisme (boven rechts in schema-afbeelding hieronder) dat een pad naar het eindframe (of terug) kan evalueren.

Schema voor Framer.

Met betrekking tot de toevoeging van laatste frame-conditie, verklaren de auteurs:

‘Om de visuele prior van de vooraf getrainde SVD zo veel mogelijk te behouden, volgen we het conditie-paradigma van SVD en injecteren we eindframe-voorwaarden in de latent-ruimte en semantische ruimte, respectievelijk.

‘Specifiek concatenaten we de VAE-gecodeerde latent-functie van de eerste [frame] met de noisy latent van de eerste frame, zoals in SVD. Bovendien concatenaten we de latent-functie van de laatste frame, zn, met de noisy latent van het eindframe, onder de voorwaarde dat de voorwaarden en de corresponderende noisy latents ruimtelijk zijn uitgelijnd.

‘Bovendien extraheren we de CLIP-afbeeldingsembed van de eerste en laatste frames afzonderlijk en concatenaten we ze voor cross-attention-functie-injectie.’

Voor drag-gebaseerde functionaliteit, maakt de traject-module gebruik van de Meta Ai-geleide CoTracker framework, die een overvloed aan mogelijke paden vooruit evalueert. Deze worden afgeslankt tot tussen 1-10 mogelijke trajecten.

De verkregen puntcoördinaten worden vervolgens getransformeerd door een methodologie geïnspireerd door de DragNUWA en DragAnything architectuur. Dit verkrijgt een Gaussian heatmap, die de doelgebieden voor beweging individueert.

Vervolgens wordt de data gevoed aan de conditie-mechanisme van ControlNet, een hulp-conformiteitssysteem oorspronkelijk ontworpen voor Stable Diffusion, en sindsdien aangepast aan andere architecturen.

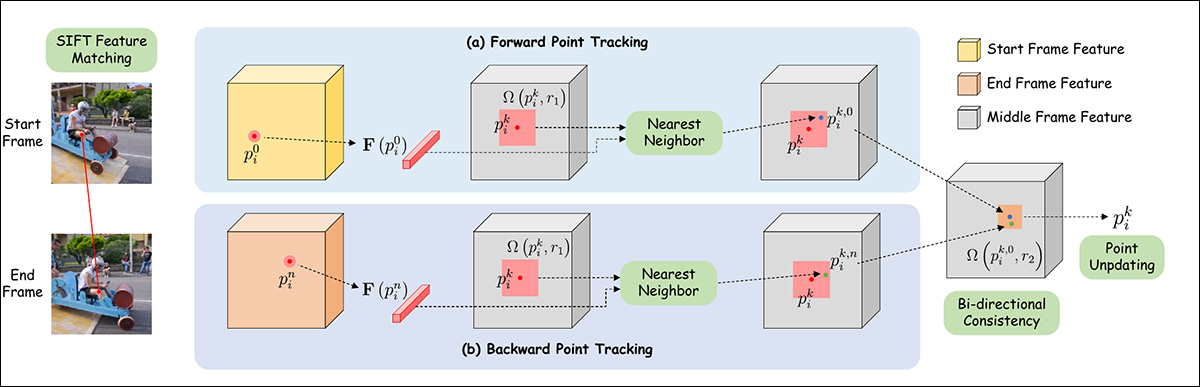

Voor autopilot-modus, wordt functie-matching aanvankelijk uitgevoerd via SIFT, die een traject evalueert dat vervolgens kan worden doorgegeven aan een auto-updating mechanisme geïnspireerd door DragGAN en DragDiffusion.

Schema voor punt-traject-schatting in Framer.

Gegevens en tests

Voor de fine-tuning van Framer, werden de spatiale aandacht en resterende blokken bevroren, en werden alleen de temporele aandacht-lagen en resterende blokken beïnvloed.

Het model werd getraind voor 10.000 iteraties onder AdamW, bij een leer tempo van 1e-4, en een batch grootte van 16. Training vond plaats over 16 NVIDIA A100 GPU’s.

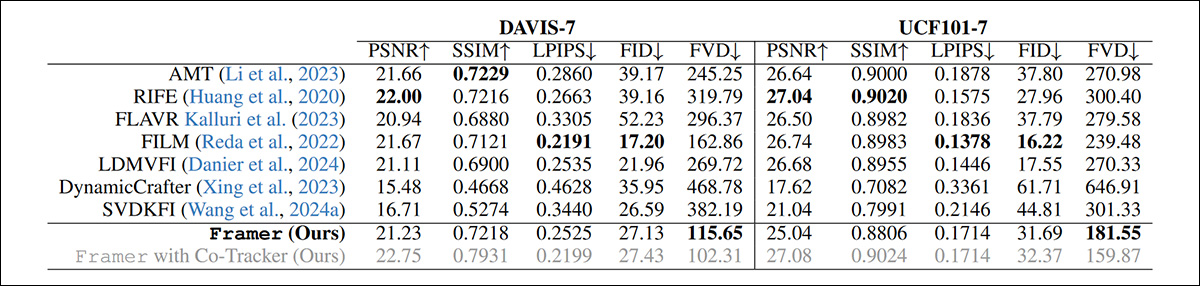

Aangezien eerdere benaderingen van het probleem geen drag-gebaseerde bewerking bieden, kozen de onderzoekers ervoor om de autopilot-modus van Framer te vergelijken met de standaardfunctionaliteit van oudere aanbiedingen.

De frameworks getest voor de categorie van huidige diffusie-gebaseerde video-generatie-systemen waren LDMVFI; Dynamic Crafter; en SVDKFI. Voor ‘traditionele’ video-systemen waren de rivaliserende frameworks AMT; RIFE; FLAVR; en de eerder genoemde FILM.

Naast de gebruikersstudie, werden tests uitgevoerd over de DAVIS en UCF101 datasets.

Kwalitatieve tests kunnen alleen worden beoordeeld door de objectieve faculteiten van het onderzoeksteam en door gebruikersstudies. Echter, merkt het artikel op, traditionele kwantitatieve metrics zijn grotendeels ongeschikt voor de voorstelling in kwestie:

‘[Reconstructie] metrics zoals PSNR, SSIM en LPIPS falen om de kwaliteit van geïnterpoleerde frames nauwkeurig te meten, aangezien ze andere plausibele interpolatie-resultaten bestraffen die niet pixel-uitgelijnd zijn met de oorspronkelijke video.

‘Terwijl generatie-metrics zoals FID enige verbetering bieden, schieten ze nog steeds tekort, aangezien ze geen rekening houden met temporele consistentie en evalueren frames in isolatie.’

Ondanks dit, voerden de onderzoekers kwalitatieve tests uit met verschillende populaire metrics:

Kwantitatieve resultaten voor Framer vs. rivaliserende systemen.

De auteurs merken op dat ondanks het feit dat de kansen tegen hen zijn, Framer nog steeds de beste FVD-score behaalt onder de geteste methoden.

Hieronder staan de voorbeelden van het artikel voor een kwalitatieve vergelijking:

Kwalitatieve vergelijking met eerdere benaderingen. Verwijzen naar het artikel voor een betere resolutie, evenals video-resultaten op https://www.youtube.com/watch?v=4MPGKgn7jRc.

De auteurs merken op:

‘[Onze] methode produceert significant duidelijkere texturen en natuurlijke beweging in vergelijking met bestaande interpolatietechnieken. Het presteert vooral goed in scenario’s met aanzienlijke verschillen tussen de invoerframes, waar traditionele methoden vaak falen om inhoud nauwkeurig te interpoleren.

‘In vergelijking met andere diffusie-gebaseerde methoden zoals LDMVFI en SVDKFI, toont Framer een superieure aanpasbaarheid aan uitdagende gevallen en biedt het betere controle.’

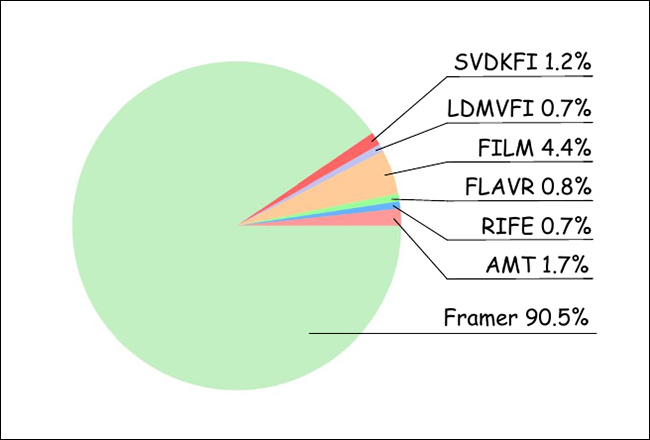

Voor de gebruikersstudie, verzamelden de onderzoekers 20 deelnemers, die 100 willekeurig geordende video-resultaten van de geteste methoden beoordeelden. Zo werden 1000 beoordelingen verkregen, die de meest ‘realistische’ aanbiedingen evalueerden:

Resultaten van de gebruikersstudie.

Zoals te zien is in de grafiek hierboven, gaven gebruikers overweldigend de voorkeur aan resultaten van Framer.

Het project dat bij het artikel hoort, YouTube-video, schetst enkele van de potentiële andere toepassingen voor Framer, waaronder morphing en cartoon-tussenin-beelding – waar het hele concept begon.

Conclusie

Het is moeilijk om te benadrukken hoe belangrijk deze uitdaging momenteel is voor de taak van AI-gebaseerde video-generatie. Tot nu toe, zijn oudere oplossingen zoals FILM en de (niet-AI) EbSynth gebruikt door zowel amateur- als professionele gemeenschappen voor tweening tussen frames; maar deze oplossingen komen met opvallende beperkingen.

Door de oneerlijke curatie van officiële voorbeeldvideo’s voor nieuwe T2V-frameworks, is er een brede openbare misvatting dat machine learning-systemen nauwkeurig kunnen afleiden van geometrie in beweging zonder terug te vallen op leidende mechanismen zoals 3D-morphable modellen (3DMM’s), of andere hulp-mechanismen, zoals LoRAs.

Om eerlijk te zijn, is tweening zelfs, zelfs als het perfect kon worden uitgevoerd, slechts een ‘hack’ of een truc voor dit probleem. Niettemin, aangezien het vaak gemakkelijker is om twee goed-uitgelijnde frame-afbeeldingen te produceren dan om leiding te geven via tekstprompts of de huidige reeks alternatieven, is het goed om iteratieve vooruitgang te zien op een AI-gebaseerde versie van deze oudere methode.

Eerst gepubliceerd op dinsdag, 29 oktober 2024