Kunstmatige intelligentie

AnomalyGPT: Detectie van industriële anomalieën met behulp van LVLM’s

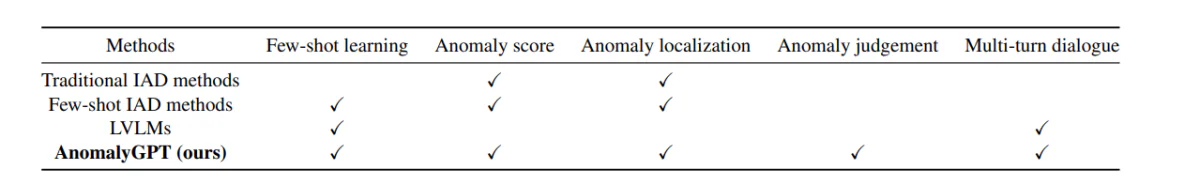

Onlangs hebben Large Vision Language Models (LVLM’s) zoals LLava en MiniGPT-4 hun vermogen aangetoond om afbeeldingen te begrijpen en hoge nauwkeurigheid en efficiëntie te bereiken in verschillende visuele taken. Terwijl LVLM’s uitblinken in het herkennen van gewone objecten vanwege hun uitgebreide trainingsdatasets, ontbreekt het hen aan specifieke domeinkennis en hebben ze een beperkt begrip van gelokaliseerde details binnen afbeeldingen. Dit beperkt hun effectiviteit in taken voor industriële anomaliedetectie (IAD). Aan de andere kant kunnen bestaande IAD-kaders alleen de bronnen van anomalieën identificeren en vereisen ze handmatige drempelinstellingen om normale en abnormale monsters te onderscheiden, waardoor hun praktische implementatie wordt beperkt.

Het primaire doel van een IAD-kader is om anomalieën in industriële scenario’s en productafbeeldingen te detecteren en te lokaliseren. Echter, vanwege de onvoorspelbaarheid en zeldzaamheid van echte afbeeldingen in de praktijk, worden modellen meestal alleen getraind op normale gegevens. Ze onderscheiden abnormale monsters van normale op basis van afwijkingen van de typische monsters. Momenteel bieden IAD-kaders en -modellen voornamelijk anomaliewaarden voor testmonsters. Bovendien is het onderscheiden tussen normale en abnormale instanties voor elke artikelklasse het handmatig specificeren van drempels nodig, waardoor ze ongeschikt zijn voor praktische toepassingen.

Om de toepassing en implementatie van Large Vision Language Models te onderzoeken bij het aanpakken van de uitdagingen die door IAD-kaders worden gesteld, werd AnomalyGPT geïntroduceerd, een novaal IAD-benadering op basis van LVLM. AnomalyGPT kan anomalieën detecteren en lokaliseren zonder de noodzaak van handmatige drempelinstellingen. Bovendien kan AnomalyGPT ook relevante informatie over de afbeelding bieden om interactief met gebruikers te communiceren, waardoor ze follow-upvragen kunnen stellen op basis van de anomalie of hun specifieke behoeften.

Industriële anomaliedetectie en Large Vision Language Models

Bestaande IAD-kaders kunnen in twee categorieën worden onderverdeeld.

- Reconstructie-gebaseerde IAD.

- Feature Embedding-gebaseerde IAD.

In een reconstructie-gebaseerd IAD-kader is het primaire doel om anomalimonsters te reconstrueren naar hun respectieve normale tegenhangermonsters en anomalieën te detecteren door reconstructiefouten te berekenen. SCADN, RIAD, AnoDDPM en InTra maken gebruik van verschillende reconstructiekaders, van Generative Adversarial Networks (GAN) en autoencoders tot diffusiemodellen en transformatoren.

Aan de andere kant is in een Feature Embedding-gebaseerd IAD-kader het primaire doel om zich te richten op het modelleren van de feature-embedding van normale gegevens. Methoden zoals PatchSSVD proberen een hypersfeer te vinden die normale monsters strak kan omvatten, terwijl kaders zoals PyramidFlow en Cfl normale monsters projecteren op een Gaussian-verdeling met behulp van normaliserende stromen. CFA- en PatchCore-kaders hebben een geheugenslot voor normale monsters van patch-embeddings ingesteld en gebruiken de afstand tussen de testmonster-embedding en de normale embedding om anomalieën te detecteren.

Beide methoden volgen het “one class one model”-leerparadigma, dat een grote hoeveelheid normale monsters vereist om de verdelingen van elke objectklasse te leren. De vereiste van een grote hoeveelheid normale monsters maakt het onpraktisch voor nieuwe objectcategorieën en heeft beperkte toepassingen in dynamische productomgevingen. Aan de andere kant maakt het AnomalyGPT-kader gebruik van een in-context leerparadigma voor objectcategorieën, waardoor het kan interfereren met slechts een handvol normale monsters.

Verdergaand hebben we Large Vision Language Models of LVLM’s. LLM’s of Large Language Models hebben enorm succes geboekt in de NLP-industrie en worden nu onderzocht op hun toepassingen in visuele taken. Het BLIP-2-kader maakt gebruik van Q-former om visuele functies van Vision Transformer in het Flan-T5-model in te voeren. Bovendien verbindt het MiniGPT-kader het beeldsegment van het BLIP-2-kader en het Vicuna-model met een lineaire laag en voert een tweestaps fijnaftuningproces uit met behulp van beeld-tekstgegevens. Deze benaderingen geven aan dat LLM-kaders mogelijk enkele toepassingen voor visuele taken hebben. Echter, deze modellen zijn getraind op algemene gegevens en ontbreken de vereiste domeinspecifieke expertise voor brede toepassingen.

Hoe werkt AnomalyGPT?

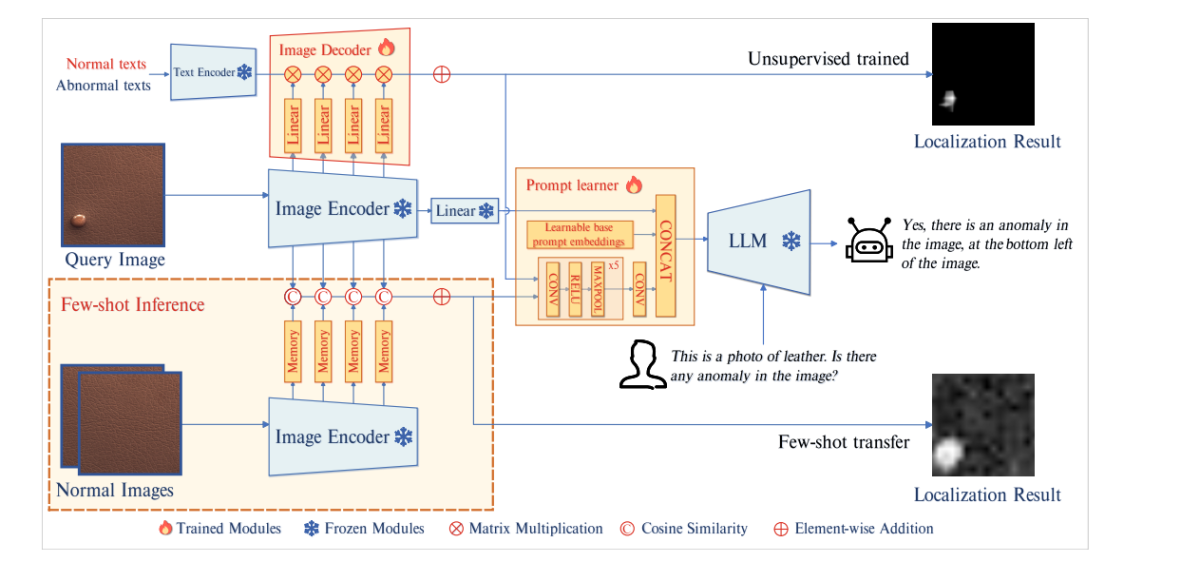

AnomalyGPT is in zijn kern een novaal conversational IAD-large vision language model ontworpen voor het detecteren van industriële anomalieën en het lokaliseren van hun exacte locatie met behulp van afbeeldingen. Het AnomalyGPT-kader maakt gebruik van een LLM en een vooraf getrainde beeldencoder om afbeeldingen te aligneren met hun overeenkomstige tekstuele beschrijvingen met behulp van gestimuleerde anomaliegegevens. Het model introduceert een decodermodule en een prompt learner-module om de prestaties van de IAD-systemen te verbeteren en pixelniveau-lokaliseringsuitvoer te bereiken.

Modelarchitectuur

De bovenstaande afbeelding toont de architectuur van AnomalyGPT. Het model voert de queryafbeelding eerst uit naar de bevroren beeldencoder. Het model extracteert vervolgens patchniveau-functies uit de tussenliggende lagen en voert deze functies uit naar een beelddecoder om hun overeenkomst te berekenen met abnormale en normale teksten om de resultaten voor lokaliseren te verkrijgen. De prompt learner zet deze vervolgens om in prompt-embeddings die geschikt zijn om te worden gebruikt als invoer in de LLM naast de door de gebruiker verstrekte tekstuele invoer. Het LLM-model maakt vervolgens gebruik van de prompt-embeddings, beeldinvoer en door de gebruiker verstrekte tekstuele invoer om anomalieën te detecteren, hun locatie te lokaliseren en eindantwoorden voor de gebruiker te creëren.

Decoder

Om pixelniveau-anomalie-lokaliseren te bereiken, maakt het AnomalyGPT-model gebruik van een lichtgewicht functie-matching-gebaseerde beelddecoder die zowel few-shot IAD-kaders als onge-superviseerde IAD-kaders ondersteunt. Het ontwerp van de decoder die in AnomalyGPT wordt gebruikt, is geïnspireerd door WinCLIP-, PatchCore- en APRIL-GAN-kaders. Het model deelt de beeldencoder in 4 fasen in en extracteert de tussenliggende patchniveau-functies bij elke fase.

Echter, deze tussenliggende functies zijn niet door de finale beeld-tekstalignering gegaan, waardoor ze niet direct kunnen worden vergeleken met functies. Om dit probleem aan te pakken, introduceert het AnomalyGPT-model extra lagen om tussenliggende functies te projecteren en ze uit te lijnen met tekstfuncties die normale en abnormale semantiek vertegenwoordigen.

Prompt Learner

Het AnomalyGPT-kader introduceert een prompt learner die de lokaliseringsresultaten omzet in prompt-embeddings om fijne semantiek van afbeeldingen te benutten en ook de semantische consistentie tussen de decoder- en LLM-uitvoer te behouden. Bovendien voegt het model leerbare prompt-embeddings toe, ongerelateerd aan decoderuitvoer, in de prompt learner om extra informatie voor de IAD-taak te bieden. Ten slotte voert het model de embeddings en oorspronkelijke beeldinformatie uit naar de LLM.

De prompt learner bestaat uit leerbare basisprompt-embeddings en een convolutioneel neuronaal netwerk. Het netwerk zet de lokaliseringsresultaten om in prompt-embeddings en vormt een set prompt-embeddings die vervolgens worden gecombineerd met de beeldembeddings in de LLM.

Anomalie-simulatie

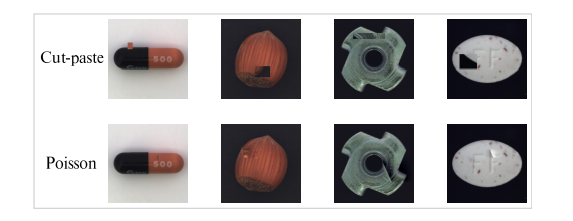

Het AnomalyGPT-model gebruikt de NSA-methode om abnormale gegevens te simuleren. De NSA-methode gebruikt de Cut-paste-techniek met behulp van de Poisson-afbeeldingsbewerking om de discontinuïteit die wordt geïntroduceerd door het plakken van beeldsegmenten te verlichten. Cut-paste is een veelgebruikte techniek in IAD-kaders om gesimuleerde anomalie-afbeeldingen te genereren.

De Cut-paste-methode omvat het bijsnijden van een blokregio uit een afbeelding en deze in een willekeurige locatie in een andere afbeelding te plakken, waardoor een deel van een gesimuleerde anomalie wordt gecreëerd. Deze gesimuleerde anomalie-monsters kunnen de prestaties van IAD-modellen verbeteren, maar er is een nadeel, omdat ze vaak opvallende discontinuïteiten kunnen produceren. De Poisson-bewerking heeft als doel om een object naadloos te klonen van de ene afbeelding naar de andere door de Poisson-partial differentiaalvergelijkingen op te lossen.

De bovenstaande afbeelding toont de vergelijking tussen Poisson en Cut-paste-afbeeldingsbewerking. Zoals te zien is, zijn er zichtbare discontinuïteiten in de Cut-paste-methode, terwijl de resultaten van de Poisson-bewerking natuurlijker lijken.

Vraag en antwoordinhoud

Om prompt-tuning uit te voeren op het Large Vision Language Model, genereert het AnomalyGPT-model een overeenkomstige tekstuele query op basis van de anomalie-afbeelding. Elke query bestaat uit twee belangrijke onderdelen. Het eerste deel van de query bestaat uit een beschrijving van de invoerbeeld die informatie biedt over de objecten in de afbeelding, samen met hun verwachte attributen. Het tweede deel van de query is om de aanwezigheid van anomalieën binnen het object te detecteren of om te controleren of er een anomalie in de afbeelding is.

Het LVLM-model reageert eerst op de query of er een anomalie in de afbeelding is. Als het model anomalieën detecteert, specificeert het vervolgens de locatie en het aantal abnormale gebieden. Het model deelt de afbeelding in in een 3×3-rooster van afzonderlijke regio’s om het LVLM toe te staan om de positie van de anomalieën mondeling aan te geven, zoals weergegeven in de onderstaande afbeelding.

Het LVLM-model wordt gevoed met de beschrijvende kennis van de invoer met basiskennis van de invoerbeeld die de begrip van de afbeeldingscomponenten van het model verbetert.

Datasets en evaluatiemetrics

Het model voert zijn experimenten voornamelijk uit op de VisA- en MVTec-AD-datasets. De MVTech-AD-dataset bestaat uit 3629 afbeeldingen voor trainingsdoeleinden en 1725 afbeeldingen voor testdoeleinden, verdeeld over 15 verschillende categorieën, waardoor het een van de meest populaire datasets is voor IAD-kaders. De trainingsafbeeldingen bevatten alleen normale afbeeldingen, terwijl de testafbeeldingen zowel normale als abnormale afbeeldingen bevatten. Aan de andere kant bestaat de VisA-dataset uit 9621 normale afbeeldingen en ongeveer 1200 abnormale afbeeldingen, verdeeld over 12 verschillende categorieën.

Verder maakt het AnomalyGPT-model, net als bestaande IAD-kaders, gebruik van de AUC of het gebied onder de receiver operating characteristics als evaluatiemetric, met pixelniveau- en afbeeldingsniveau-AUC om de prestaties van anomalie-lokaliseren en anomalie-detectie te beoordelen. Echter, het model maakt ook gebruik van afbeeldingsniveau-accuraatheid om de prestaties van de voorgestelde benadering te evalueren, omdat het uniek de mogelijkheid biedt om de aanwezigheid van anomalieën te bepalen zonder de noodzaak van handmatige drempelinstellingen.

Resultaten

Kwantitatieve resultaten

Few-Shot Industrial Anomaly Detection

Het AnomalyGPT-model vergelijkt zijn resultaten met eerder few-shot IAD-kaders, waaronder PaDiM, SPADE, WinCLIP en PatchCore als basismodellen.

De bovenstaande afbeelding toont de resultaten van het AnomalyGPT-model in vergelijking met few-shot IAD-kaders. Over beide datasets presteert de door AnomalyGPT gevolgde methode beter dan de benaderingen van eerdere modellen in termen van afbeeldingsniveau-AUC en levert het ook goede nauwkeurigheid.

Onge-superviseerde Industrial Anomaly Detection

In een onge-superviseerde trainingsinstelling met een grote hoeveelheid normale monsters, traint AnomalyGPT een enkel model op monsters die zijn verkregen uit alle klassen binnen een dataset. De ontwikkelaars van AnomalyGPT hebben ervoor gekozen om het UniAD-kader te gebruiken, omdat het wordt getraind in dezelfde instelling en zal fungeren als een basismodel voor vergelijking. Bovendien vergelijkt het model ook met JNLD- en PaDim-kaders met behulp van dezelfde geünificeerde instelling.

De bovenstaande afbeelding toont de prestaties van AnomalyGPT in vergelijking met andere kaders.

Kwalitatieve resultaten

De bovenstaande afbeelding toont de prestaties van het AnomalyGPT-model in onge-superviseerde anomaliedetectie, terwijl de onderstaande afbeelding de prestaties van het model in 1-shot in-context learning toont.

Het AnomalyGPT-model is in staat om de aanwezigheid van anomalieën aan te geven, hun locatie te markeren en pixelniveau-lokaliseringsresultaten te bieden. Wanneer het model in 1-shot in-context learning is, is de lokaliseringsprestatie van het model iets lager in vergelijking met onge-superviseerde learning vanwege het ontbreken van training.

Conclusie

AnomalyGPT is een novaal conversational IAD-vision language model ontworpen om de krachtige mogelijkheden van large vision language models te benutten. Het kan niet alleen anomalieën in een afbeelding detecteren, maar ook hun exacte locatie lokaliseren. Bovendien faciliteert AnomalyGPT meerdere gespreksronden gericht op anomaliedetectie en toont uitstekende prestaties in few-shot in-context learning. AnomalyGPT verkent de potentiële toepassingen van LVLM’s in anomaliedetectie, introduceert nieuwe ideeën en mogelijkheden voor de IAD-industrie.