Thought leaders

Van Code tot Genezing: De Volgende AI-Revolutie Heeft een Hand (En Ogen) Nodig

Hoe agentic systemen, XR slimme glazen en robotica mensen zullen empoweren – en niet vervangen

We leven in een paradox in kunstmatige intelligentie.

Op schermen is AI supermenselijk. Grote taalmodellen schrijven functionele Python-code in seconden. Generatieve systemen produceren fotorealistische afbeeldingen en video’s in minuten. Nobelprijswinnende systemen zoals AlphaFold hebben de structuren van bijna alle bekende eiwitten voorspeld. De digitale overwinningen stapelen zich op.

Yet in de fysieke wereld van biomedisch onderzoek, blijft het proces van ontdekking pijnlijk handmatig. We voelen AI niet versnellen van wetenschap of geneeskunde, tenminste nog niet. De cijfers onthullen de diepte van het probleem. Een baanbrekend onderzoek van Nature onder meer dan 1.500 wetenschappers vond dat meer dan 70% heeft geprobeerd en gefaald om een onderzoeker’s experimenten te reproduceren. Nog meer verontrustend: meer dan de helft kon hun eigen werk niet reproduceren. In de kankerbiologie specifiek, vond een achtjarig reproducerend project dat alleen 40% van de hoog-impact bevindingen konden worden gereproduceerd en 68% van de experimenten ontbrak voldoende documentatie om zelfs maar een poging tot reproduceren te doen.

Dit is het vuile geheim van de moderne wetenschap: we hebben een kennis-capture-probleem, niet alleen een ontdekkingsprobleem. Critische experimentele details leven in onderzoekers’ hoofden, niet in papers. Protocollen drijven af. Tacit kennis loopt de deur uit wanneer trainees afstuderen. AI-systemen getraind op gepubliceerde literatuur erven al deze gaten.

Het fundamentele probleem is dat terwijl een AI een nieuw eiwit voor kankertherapie kan ontwerpen in een digitale simulatie, het geen pipet kan oppakken om het te testen. Het kan de rommelige, onvoorspelbare realiteit van een natte lab niet navigeren om zijn eigen hypothese te valideren. Het kan niet naar een ervaren wetenschapper’s handen kijken en leren van de subtiele technieken die experimenten doen werken.

Deze “uitvoeringskloof” is de enige grootste bottleneck die de AI-revolutie verhindert om een medische revolutie te worden. Terwijl de meeste robotica-bedrijven nog steeds bezig zijn met het leren van machines om was te vouwen of vaat te laden, blijven ze achter op de echt transformatieve mogelijkheden van deze vooruitgang in domeinen zoals geneeskunde.

Om dit op te lossen, moeten we verder gaan dan chatbots en naar AI Co-Wetenschappers, agentic systemen die de digitale en fysieke wereld verbinden, verder gaan dan plannen en coderen en naar echte uitvoering. Aan Stanford, ontwikkelen we LabOS, een digitaal-fysieke AI-raamwerk dat demonstreert hoe AI-agenten, Extended Reality (XR) slimme glazen en collaboratieve robotica kunnen verenigen om deze lus te sluiten, wetenschappelijke experimenten transformeren in een collaboratieve conversatie tussen mens en machine, terwijl automatisch de kennis vastleggen die momenteel verloren gaat.

De Grote Kloof: Waarom AI “Ogen” en “Handen” Nodig Heeft

Veel van de meest zichtbare AI-wins zijn gebeurd waar de omgeving volledig digitaal is: code-repositories, gecuratede datasets of gesimuleerde benchmarks (waar AI concurreert om een virtueel bedrijf te runnen of digitaal te beleggen in aandelen).

Natte labs zijn anders. Biologie, en in het algemeen, wetenschappelijke ontdekking, is een zeer lawaaierig proces. Instrumenten drijven af, operators improviseren, en “het protocol” leeft vaak gedeeltelijk in mensen’s hoofden. Het verschil tussen een schoon resultaat en een mislukte run kan een pipetteringshoek zijn, een vortexpatroon, een reagenssubstitutie, of een incubatie die 10 minuten lang liep. Deze contextuele details komen zelden in een paper en zijn exact wat een AI-model nodig heeft als het generaliseren wil buiten een dataset.

Dat is waarom lab-kwaliteit AI “ogen” (om te zien wat er gebeurt in context) en “handen” (om te standaardiseren en veilig te automatiseren van high-variance stappen) en geheugen (om op te nemen wat er werkelijk gebeurde) nodig heeft. Zonder deze mogelijkheden, kunnen modellen aanbevelen wat te doen, maar kunnen ze niet betrouwbaar vertalen in gevalideerde fysieke uitvoering of verklaren falen wanneer realiteit afwijkt van plan.

Verder dan Chatbots: Van Copilots tot Co-Wetenschappers

De term “agentic AI” wordt soms losjes gebruikt. In biomedische settings, zou het iets precies moeten betekenen: een systeem dat een doel kan nemen (bijvoorbeeld “optimaliseer CRISPR-gene-editing efficiëntie terwijl off-targets minimaliseren”), decomponeren in een reeks taken, taken uitvoeren over tools, resultaten evalueren en het plan aanpassen onder beperkingen en met auditable besluitvorming.

Dit is belangrijk omdat onderzoeksworkflows niet één modelaanroep zijn. Ze zijn end-to-end pipelines die hypotheseformulering, experimenteel ontwerp, gegevensverwerking, statistische testing en interpretatie omvatten. Recent denken in drugontdekking is begonnen met het benadrukken van agentic systemen die deze pipelines kunnen schalen in plaats van alleen individuele stappen te versnellen (bijvoorbeeld Unite.AI’s discussie over agenten in small-molecule discovery).

In software engineering, hebben we al vroeg empirisch bewijs gezien dat AI-copilots de doorstroming van ontwikkelaars kunnen verhogen. In biomedische wetenschap, is de analoge kans niet alleen code schrijven, maar protocollen schrijven en valideren, gegevens structureren, uitvoering monitoren en de lus sluiten tussen voorspelling en meting, verbinden van AI met menselijke wetenschappers in labs.

LabOS: Wanneer AI Werkt op een Besturingssysteem voor de Labs van Morgen

In ons werk aan Stanford op AI4Science, dat gene-editing copilots zoals CRISPR-GPT en AI-XR co-execution systemen zoals LabOS dat wetenschappers in biomedische en materiaalwetenschappelijke labs helpen, hebben we een architecturale verschuiving verkend:

1. Ontwerpen van een end-to-end “lab-besturingssysteem” dat een digitale (droge) lab koppelt aan een fysieke (natte) lab.

De premisse is eenvoudig: als een lab-notitieboek het geheugen van wetenschap is, dan zou een lab-OS het uitvoeringslaag moeten zijn, intent, vertalen in acties, observeren van resultaten en elke run omzetten in gestructureerde kennis.

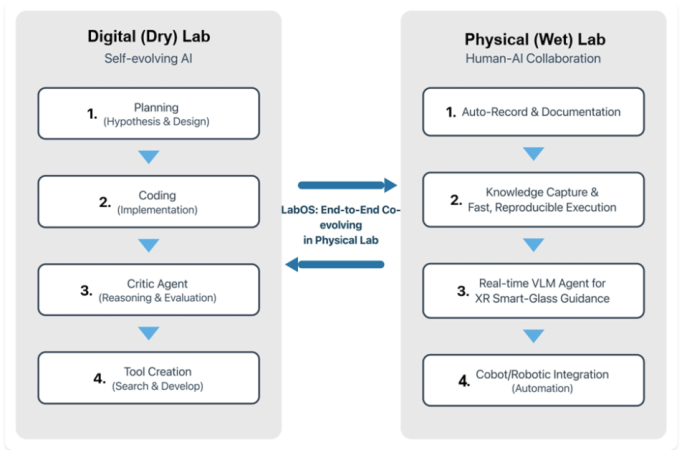

Figuur. Een conceptueel overzicht van LabOS dat een zelf-evoluerende digitale lab-lus (planning, coding, kritiek, tool-creatie) verbindt met een mens-AI natte-lab-lus (auto-documentatie, kennis-capture, XR-guidance en robot-integratie).

2. AI in de Digitale Lab – Zelf-Evoluerende Planning en Tool-Bouw

In de digitale (droge) lab, kunnen we AI laten doen wat het al goed doet: zoeken, synthetiseren en voorstellen. Maar we willen ook dat het zelf-verbeterend is. Niet door “nieuwe wetenschap te hallucineren”, maar door betere tools en workflows te leren van feedback.

Een praktische digitale-lab-lus kan worden gekaderd als vier terugkerende fasen:

- Planning (hypotheek + ontwerp): hypothesen voorstellen, experimentele variabelen selecteren, anticiperen van confounders en specificeren van meetbare eindpunten.

- Coding (implementatie): genereren of aanpassen van analyse-scripts, simulatie-pipelines en instrument-controle-templates waar nodig.

- Critic agent (redenering + evaluatie): aannames testen, statistische macht controleren, controles voorstellen en waarschijnlijke foutmodi markeren.

- Tool-creatie (zoeken + ontwikkelen): wanneer de workflow een component ontbreekt (een parser, een QC-routine, een dashboard), bouw het en voeg het terug toe aan de toolkit.

3. AI in de Fysieke Lab – AI Met “Ogen” (XR glazen) en “Handen” (Robotica)

De fysieke (natte) lab is waar het systeem het vertrouwen verdient – of verliest. Het doel is niet om de wetenschapper te vervangen, maar om wrijving en fouten te verminderen en observabiliteit te verhogen.

We zien de fysieke-lab-lus als vier complementaire mogelijkheden:

- Auto-record en documentatie: acties, tijdstempels, instrument-instellingen en afwijkingen automatisch vastleggen, zodat documentatie geen afterthought is.

- Kennis-capture voor snelle, reproduceerbare uitvoering: runs omzetten in gestructureerde, doorzoekbare artefacten (protocol-versies, parameter-sets, QC-resultaten) afgestemd op data-stewardship-principes zoals FAIR.

- Real-time visueel-taal-guidance via XR slimme glazen: gebruik multimodale modellen om de scène te interpreteren (wat de operator doet, welk reagens in de hand is) en stap-voor-stap-guidance en veiligheidscontroles bieden. AR/XR heeft al waarde aangetoond in high-stakes fysieke workflows zoals experimentele guidance (LabOS, Stanford, Princeton, in samenwerking met NVIDIA).

- Cobot/robot-integratie voor automatisering: standaardiseren van repetitieve stappen, veilige overdrachten mogelijk maken en variabiliteit reduceren. Platforms voor simulatie-naar-reële workflows (bijvoorbeeld NVIDIA Isaac) en real-time AI-verwerking op de rand zoals de slimme glazen live-streaming en mens-AI-interactie in LabOS zijn belangrijke ondersteunende lagen.

Deze architectuur is in overeenstemming met een bredere richting in het veld: “zelfrijdende” of autonome laboratoria die automatisering combineren met machine learning om het volgende experiment te plannen. Wat LabOS toevoegt, is een strakkere menselijke interface-laag, zodat autonomie niet ten koste gaat van transparantie.

Waarom Lab-Kwaliteit AI Niet Alleen “AI op een Dataset” Is

AI-systemen voor biomedische/wetenschappelijke superintelligentie zien er vaak indrukwekkend uit in retrospectieve evaluatie of bij het afleggen van examens, en presteren dan ondermaats in de fysieke lab. De reden is zelden één enkele bug. Het is meestal een mismatch tussen de modellen’s aannamen en de lab’s realiteit.

Drie gaten komen herhaaldelijk voor:

- Context-gat: datasets omvatten typisch de contextuele variabelen die operators weten dat ertoe doen (temperatuur-uitstapjes, reagens-lotnummers, subtiele protocol-afwijkingen).

- Actie-gat: veel AI-systemen kunnen aanbevelen wat te doen, maar kunnen niet betrouwbaar vertalen in gevalideerde fysieke stappen.

- Feedback-gat: zonder gestructureerde, hoogwaardige feedback van uitvoering, kunnen modellen niet leren waar ze falen – en wetenschappers kunnen niet auditen waarom.

Het sluiten van deze gaten is minder over het uitvinden van een nieuwe neurale netwerkarchitectuur, maar meer over het bouwen van de instrumentatie, interfaces en data-contracten die het laboratorium leesbaar maken voor machines, en AI laten zien en werken met mensen.

Vertrouwen door Ontwerp: Veiligheid en Governance voor AI die Kan Handelen

Agentic AI in onderzoeksresearch roept niet alleen bekende zorgen op over nauwkeurigheid. Het introduceert nieuwe foutmodi omdat het kan handelen. In een lab, betekent actie het potentieel voor verspilling, schade of misleidende conclusies, vooral wanneer experimenten voeren naar klinische hypothesen.

Een nuttige mindset is om een AI-geactiveerd lab-stack te behandelen als een socio-technisch systeem dat assurance nodig heeft. Verschillende bestaande kaders helpen, maar ze moeten worden vertaald naar lab-reality:

- Risicobeheer als een continue praktijk: NIST’s AI-risicobeheerkader (AI RMF 1.0) biedt een praktische vocabulaire voor kaarten, meten en beheren van AI-risico’s over de levenscyclus.

- Regelgevende alignering voor medisch-gerelateerde AI: de FDA’s AI/ML Software as a Medical Device (SaMD) werk, inclusief zijn Actieplan en gerelateerde richtlijnen, biedt een concreet overzicht van wat “goede praktijk” lijkt wanneer AI patiëntzorg beïnvloedt.

Voor gen-editing en andere high-consequence domeinen, is governance al een wereldwijd gesprek. Aanbevelingen worden besproken over humane genoom-editing, om de noodzaak van passende toezichtmechanismen en verantwoorde governance te benadrukken, zoals die voorgesteld door de American Society for Gene and Cell Therapy, of ASGCT. Systemen zoals LabOS zouden moeten worden ontworpen om compliance te vergemakkelijken, niet moeilijker te maken.

Controlelijst: Controles voor Veilige AI Co-Wetenschappers voor Wetenschappelijke Ontdekking

In ons oordeel, zou een veiligheidsbewuste lab-OS ten minste de volgende ontwerpen moeten implementeren:

- Provenance by default: elke dataset, protocol-versie en model-uitvoer zou traceerbaar moeten zijn naar inputs en tijdstempels.

- Gebonden autonomie: het systeem zou expliciete toestemmingen moeten hebben (wat het kan doen zonder bevestiging) en escalatie-regels (wanneer het moet vragen).

- Menselijke override en gracieuze degradatie: wanneer sensoren of data-stromen falen, of onzekerheid hoog is, zou het systeem moeten terugvallen naar een veiligere, eenvoudigere modus.

- Continue validatie: in-silico-voorspellingen zouden moeten worden gekoppeld aan fysieke-lab-validatie; fysieke-lab-runs zouden QC-poorten moeten omvatten voordat conclusies downstream terug naar de AI-modellen/agenten in de digitale wereld worden gepropageerd.

- Beveiliging en dual-use-bewustzijn: lab-infrastructuur beschermen tegen manipulatie.

Empower Humans Everywhere: Kan AI Co-Wetenschappers het Speelveld Levelen?

Een van de meest overtuigende beloften van een AI-XR “co-wetenschapper” is niet alleen snelheid voor elite-instituten, maar toegankelijkheid voor iedereen. Overweeg wat momenteel kleinere labs, startups en afgelegen/klinische/regionale klinieken beperkt:

- Beperkte toegang tot gespecialiseerde expertise voor goud-standaard protocollen en instrumenten.

- Hogere relatieve kosten van training, fouten en herwerken.

- Fragmenteerde tooling: notitieboeken, spreadsheets, instrument-logboeken en analyse-scripts verbinden zelden schoon.

Een systeem dat uitvoering in context kan leiden (via XR-glazen), kan vastleggen wat er gebeurde automatisch en kan het volgende beste stap voorstellen op basis van eerdere runs, kan geavanceerde assays meer reproduceerbaar maken over sites. In principe, kan het ook ondersteunen voor gedistribueerd klinisch onderzoek waar protocollen consistent moeten worden uitgevoerd, zelfs wanneer middelen variëren.

Tijdlijn: Wanneer Krijgt elke Wetenschapper en Klinicus een Co-Wetenschapper?

Kort samengevat, zijn we dichter bij dan veel denken voor sommige high-value, high-frequentietaken (zoals het produceren van een geneesmiddel betrouwbaar in het lab) en verder weg dan de meeste demos impliceren voor anderen (zoals AI die grote problemen zoals kanker of Alzheimer’s volledig oplost). Een realistische roadmap ziet er zo uit:

- Korte termijn (binnen 1 jaar): Workflow-copilots die administratieve last verminderen: protocol-ontwerp, literatuur-synthese, analyse-sjablonen en geautomatiseerde QC-rapporten. De beperkende factor is integratie, niet model-capaciteit.

- Middellange termijn (1-2 jaar): Co-execution systemen in het lab: XR-glazen-guidance, geautomatiseerde documentatie en selectieve robotica voor high-variance-stappen. Vertrouwen zal afhangen van audit-trails en strakke mens-in-de-lus-ontwerp.

- Langere termijn (3+ jaar): Cross-domein co-onderzoekers die ontdekking koppelen aan vertaling: koppelen van lab-gegevens aan klinische eindpunten, monitoren van veiligheidssignalen en helpen bij het ontwerpen van trials – terwijl voldoet aan regelgevende en ethische verwachtingen.

Van Code tot Genezing: De Weg Vooruit naar 1000x Wetenschappelijke Ontdekking

LabOS is een poging om een eenvoudige vraag te beantwoorden: wat als een experiment kon worden uitgevoerd als een conversatie, waar intent, uitvoering en bewijs zijn verbonden van begin tot einde? Als we deze systemen goed bouwen, kunnen ze helpen bij het oplossen van de vertaalgap die biomedische wetenschap en veel fysieke wetenschappelijke disciplines (bijv. materiaalwetenschap) vertraagt. Als we ze slecht bouwen, zullen ze irreproduceerbaarheid verhogen en nieuwe veiligheidsrisico’s creëren.

Het meest belangrijke werk in de komende jaren zal fundamenteler zijn: gestandaardiseerde data- en apparaatinterfaces via het bouwen van het besturingssysteem (net zoals iOS alle soorten apps uitvoert), het bouwen van AI-benchmarks die uitvoering en onzekerheid omvatten (zoals de LabSuperVisie-benchmark in LabOS), en starten met implementatie in de echte wereld die innovatie stimuleren terwijl patiënten en onderzoeksintegriteit worden beschermd.

Voor onderzoekers en klinici is de vraag niet of AI het lab zal binnentreden. Het is al binnen. De vraag is of we het zullen integreren als een verzameling losse tools of als een betrouwbaar, auditeerbaar systeem ontworpen voor de realiteit van biomedische wetenschap.

Voorgestelde lees- en bronnen

- Reproduceerbaarheidsonderzoek (Nature, 2016): https://www.nature.com/articles/533452a

- CRISPR-GPT peer-reviewed artikel (Nature Biomedical Engineering): https://www.nature.com/articles/s41551-025-01463-z

- Stanford Medicine nieuws over CRISPR-GPT (2025): https://med.stanford.edu/news/all-news/2025/09/ai-crispr-gene-therapy.html

- LabOS preprint (arXiv): https://arxiv.org/abs/2510.14861

- LabOS en LabSuperVisie-benchmark-website: https://ai4lab.stanford.edu

- NIST AI-risicobeheerkader (AI RMF 1.0): https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf

- FDA-overzicht van AI/ML Software as a Medical Device: https://www.fda.gov/medical-devices/software-medical-device-samd/artificial-intelligence-software-medical-device

- FAIR data-principes (Scientific Data, 2016): https://doi.org/10.1038/sdata.2016.18

- Unite.AI over bottlenecks in small-molecule drug discovery: https://www.unite.ai/how-ai-is-breaking-down-the-bottlenecks-in-small-molecule-drug-discovery/

- Unite.AI over AI en robotische chirurgie: https://www.unite.ai/how-ai-is-ushering-in-a-new-era-of-robotic-surgery/