Andersons hoek

AI-gegenereerd schrijven ‘vermoeit’ nooit en onthult zichzelf dus

ChatGPT-achtige AI onthult zichzelf door de consistentie te vergroten, terwijl het schrijven van mensen onregelmatig blijft.

De beperkte contextwindow van de meeste consumentgerichte Large Language Models (LLM’s) is een van de factoren die ertoe kunnen leiden dat ze eerder onderdelen van gebruikersgesprekken vergeten of onjuist terugroepen – herinneringsfouten die geleidelijk aan tot complete onzin kunnen leiden – of, erger nog, misleidende coherent lijkende tekst die subtiele fouten bevat.

Aangezien deze omstandigheden leiden tot hallucinaties, en aangezien hallucinaties nog steeds de grootste hindernis vormen voor de totale marktontwikkeling van AI, is veel onderzoeksinspanning geleverd om generatieve AI-systemen te creëren die langere, maar veel consistentere delen tekst kunnen produceren.

Feitelijk wordt zoveel vooruitgang geboekt dat het herkennen van langere AI-inhoud (d.w.z. inhoud die volledig door AI is gegenereerd, met – vermoedelijk – minimale of geen menselijke nazorg) wordt beschouwd als een groeiend probleem.

AI-filibuster doorbreken

Desondanks stellen recente empirische studies dat de meer output die AI-tekstgeneratoren in één keer produceren, hoe gemakkelijker het is om te bepalen of die tekst door een mens is geschreven; maar de algemene wijsheid met betrekking tot deze detectie-‘anker’ heeft aangenomen dat AI kan worden onderscheiden omdat wat het ook doet dat anders is dan mensen, het de kans krijgt vaker te doen in langere delen.

Er worden geen veronderstellingen gedaan over de verdeling van deze ‘tekenen’ in de tekst zelf.

Om dit uit te dagen en het probleem uit te breiden, biedt een interessante recente onderzoeksstudie uit China een novate methode om de nieuwe generatie langere AI-inhoudsgeneratoren te onderscheiden van echte menselijke auteurs. De onderzoekers achter het werk claimen dat de token-voor-token aard van de AI-tekstgeneratie ertoe leidt dat deze meer consistent wordt met grotere lengte, terwijl de eigenaardigheden van mensen niet afnemen met de lengte.

Op deze manier suggereren de auteurs dat hun inzicht een potentieel nieuwe meetwaarde biedt voor AI-tekstdetectiesystemen*:

‘AI-gegenereerde tokens in het laatste deel van de tekst vertonen kleinere en stabielere probabilistische fluctuaties naarmate de voorspellingen van het model steeds consistenter worden als de context accumuleert.

‘We noemen dit patroon Laatste Volatiliteitsafname. Dit fenomeen weerspiegelt het inherente gedrag van autoregressieve generatie: naarmate meer context beschikbaar komt, wordt de voorspellingsverdeling van het model scherper, waardoor de variabiliteit in token-niveau-statistieken afneemt.

‘Menselijk schrijven, daarentegen, blijft onverwachte lexicale keuzes introduceren en behoudt een hogere volatiliteit in de loop van de tijd.’

Om deze vreemde ‘gladheid’ die zich in AI-tekst ophoopt naar het einde, definiëren de onderzoekers twee eenvoudige kenmerken: de eerste meet hoeveel de statistische gedrag van het schrijven ‘springt’ tussen tokens; de tweede controleert hoe stabiel alles blijft over korte delen van de tekst.

Beide worden alleen berekend uit de tweede helft van de output, waar AI opvallend regelmatiger wordt en menselijk schrijven niet. De auteurs merken op dat terwijl deze signalen goed werken op zichzelf, ze nog effectiever zijn wanneer ze worden gecombineerd met oudere detectiemethoden die bredere patronen scannen. Ze merken ook op dat deze benadering het beste werkt op langere teksten, waar het contrast meer evident kan worden.

Het nieuwe papier biedt een methode voor het testen van ‘AI-ness’ via tweede-helft-temporele functie-analyse, zonder extra training of fijnafstemming, of voorrechten toegang tot het model.

Het nieuwe werk heeft als titel Wanneer AI zich settelt: Laatste Volatiliteitsafname als handtekening van AI-gegenereerde Tekstdetectie, en komt van vier auteurs aan de Westlake Universiteit in Hangzhou.

Methode

Om de groeiende gladheid in AI-gegenereerde tekst te vangen, ontwierpen de onderzoekers twee metingen die alleen op de tweede helft van een passage focussen. Deze zijn gebaseerd op log-waarschijnlijkheidsscores van een standaardtaalmodel en vereisen geen fijnafstemming, hertraining of extra monsters:

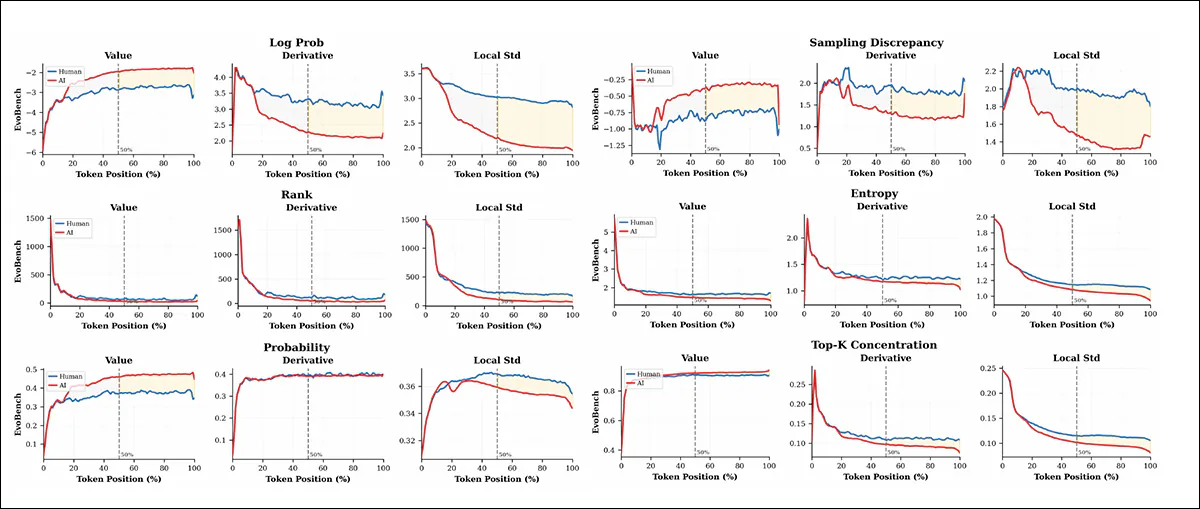

Uit het nieuwe papier – elke rij toont het gedrag van een basismetriek van EvoBench over de tokensequentie: brute waarde (links), absolute afgeleide (midden), en lokale standaarddeviatie (rechts). Menselijke en AI-lijnen worden getoond in blauw en rood. De meeste divergentie verschijnt in de tweede helft van de tekst, vooral voor Log-waarschijnlijkheid en Steekproefdiscrepantie, die een stijgende scheiding en gladere AI-uitvoer tonen. Entropie en Top-K-concentratie tonen weinig verandering in de loop van de tijd. Bron – https://arxiv.org/pdf/2601.04833

De eerste maat, genaamd Afgeleide Dispersie (DD), volgt hoe scherp de vertrouwen van het model verandert van het ene woord naar het andere. AI-tekst heeft de neiging om in een ritme te komen, dus deze veranderingen worden kleiner en voorspelbaarder in de tweede helft. In tegenstelling tot menselijk schrijven, dat ‘oneven’ blijft.

De tweede maat, Lokale Volatiliteit (LV), kijkt naar hoeveel de vertrouwen van het model ‘springt’ binnen een kleine venster van tekst. Opnieuw, AI heeft de neiging om steeds stabiler te worden in de loop van de tijd, terwijl menselijke keuzes meer verrassend en minder consistent zijn:

AI-tekst wordt gladder naarmate het vordert, terwijl menselijk schrijven onregelmatig blijft. Deze grafieken volgen hoe het vertrouwen van het model verandert in de loop van een passage, waarbij zowel de scherpte van de verandering tussen opeenvolgende woorden als de hoeveelheid variatie binnen lokale delen van de tekst wordt weergegeven. In beide opzichten is de daling veel steiler in machinegegenereerde output, met het contrast dat meer evident wordt na het middenpunt. De gele dozen benadrukken deze groeiende kloof in de tweede helft, waar AI-schrijven tot 32% meer stabiliteit bereikt dan menselijk schrijven.

Opnieuw worden beide metrieken alleen berekend uit de late helft van de tekst, waar het verschil tussen menselijk en machine-schrijven het meest evident is. Deze worden vervolgens geïntegreerd in een enkele waarde genaamd de Temporele Stabiliteitsdetectie (TSD)-score – die geneigd is om te stijgen als het schrijven ‘gladder’ wordt (en dus waarschijnlijker door AI gegenereerd). Een eenvoudige drempelwaarde wordt vervolgens gebruikt om te beslissen of een bepaalde passage waarschijnlijk door een machine is geschreven.

Omdat deze kenmerken focussen op wanneer een patroon verschijnt, in plaats van alleen wat dat patroon lijkt, worden ze aangevuld door oudere methoden die statistische ongewoonheden over de hele passage zoeken. Het toevoegen van de TSD-score aan de output van de late 2024-offering Fast‑DetectGPT (ook in samenwerking met Westlake) biedt een aanvullende verbetering van de resultaten (vooral voor langere inhoud waar het late-stage-gladheidseffect het sterkst is).

Gegevens en tests

De auteurs voerden tests uit op twee verwante benchmarkdatasets: EvoBench bevat 32.000 menselijke/AI-tekstparen die zijn gegenereerd over zeven model-families, waaronder GPT-4; GPT-4o; Claude; Google Gemini; LLaMA-3; en Qwen, met in totaal 29 modelversies.

Het andere kader was MAGE, dat 30.000 testparen biedt over acht model-families, waaronder (maar niet beperkt tot) de GPT-serie van OpenAI, en de LLaMA, OPT, en FLAN-T5-families.

Deelnemers

De nieuwe methode werd getest tegen een reeks zero-shot-detectors met hetzelfde surrogaatmodel. Waarschijnlijkheid, Entropie, Rang, en Log-Rang (DetectGPT) maten token-niveau-statistieken over de hele passage; LLR (DetectLLM) paste normalisatie toe om directe vergelijking tussen modellen mogelijk te maken; en Fast-Detect schatte lokale kromming door middel van steekproef-gebaseerde perturbaties.

Lastde analyseerde discriminatieve subsequenties in het probabiliteitsignaal, terwijl FourierGPT opereerde in het frequentiedomein. Diveye ving verschuivingen in ‘verrassing’-diversiteit over de sequentie.

Ten slotte UCE evalueerde het onzekerheidsprofiel van token-voorspellingen, om onnatuurlijke vertrouwenspatronen te identificeren.

Implementatie en resultaten

Alle detectiemethoden werden uitgevoerd met Llama-3-8B-Instruct als gedeeld surrogaatmodel, met invoersequenties beperkt tot 512 tokens. Temporele kenmerken werden alleen geëxtraheerd uit de tweede helft van elke passage, met een schuifvenster van 20 tokens om volatiliteit te meten. Een gefuseerde versie van de methode, genaamd TSD+, combineerde het voorgestelde signaal met Fast-DetectGPT.

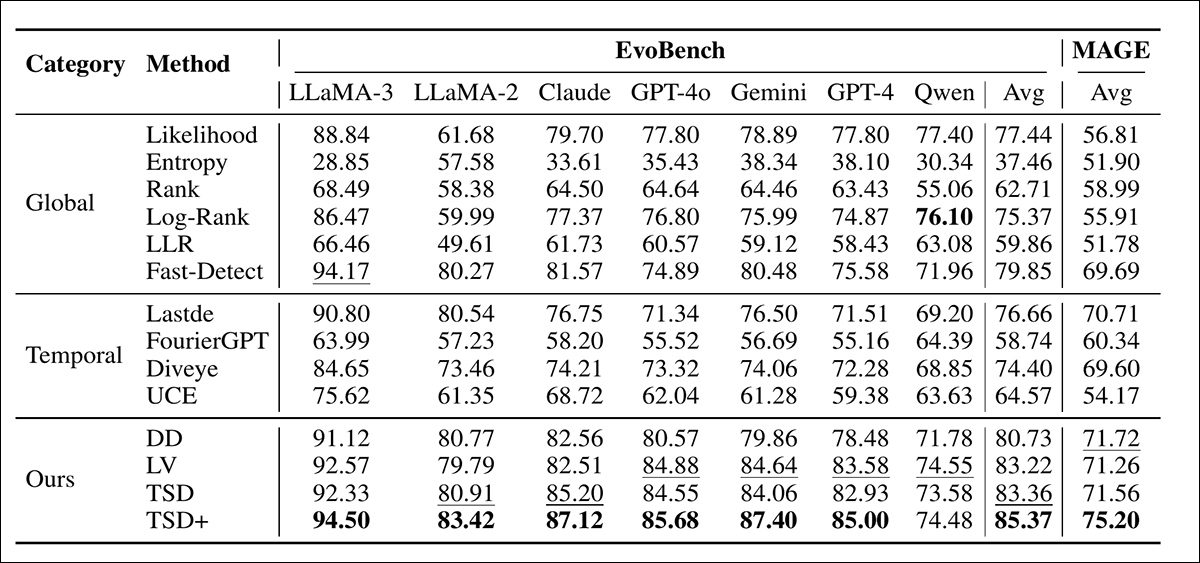

Het gebied onder de ontvangeroperatiekarakteristieke curve (AUROC) was de primaire evaluatiemethode†:

Uiteenlopende prestaties onder de verschillende geteste methoden tegen AI-gegenereerde tekst. Detectie-accuraatheid wordt getoond over twee benchmarks: EvoBench, die meerdere hooggeplaatste LLM’s dekt, en MAGE, een aanvullende dataset. Metrieken zijn gegroepeerd per methode-type: globale statistieken, temporele kenmerken en voorgestelde varianten. Gemiddelde AUROC-scores worden gegeven in de laatste kolommen. Resultaten van de varianten van de auteursmethode presteren consistent beter dan eerdere baselines, met TSD+ die de hoogste scores oplevert in bijna elke modelinstelling.

Van deze initiële resultaten stellen de auteurs:

‘Onze eenvoudige temporele kenmerken bereiken een staat-van-de-kunst-prestatie onder standalone-methoden, met TSD die 83,36% op EvoBench en 71,56% op MAGE bereikt, en alle baselines overtreft, waaronder Fast-DetectGPT.

‘Dit is opmerkelijk, gezien de eenvoud van onze methode: we berekenen alleen tweede-orde-statistieken uit de tweede helft van de sequenties, zonder perturbatie-steekproeven of frequentie-domeintransformaties.’

De nieuwe methode werkte vooral goed op nieuwere AI-modellen zoals GPT-4 en GPT-4o, en identificeerde AI-gegenereerde tekst meer nauwkeurig dan de dichtstbijzijnde leidende detector, met een prestatieverschil van maximaal 9,66%. Hoewel nieuwere geavanceerde modellen minder voor de hand liggende ‘consistente’ tekst produceren, die sommige tekenen van automatisering verbergt, zijn bepaalde subtiele tijdpatronen nog steeds zichtbaar bij het einde.

Concurrerende benaderingen die zich richten op bredere structurele kenmerken faalden om deze late-stage-patronen te detecteren. Door een globale detector te integreren, herstelt het hybride systeem blijkbaar de gemiste signalen en verbetert de prestatie, vooral op benchmarks waar kortere AI-uitvoer tijdelijke signalen kan verzwakken.

Conclusie

Een aspect dat niet direct wordt aangesproken in het nieuwe werk is de neiging van menselijke schrijvers om hun werk te itereren door middel van ontwerpen en verschillende lagen van toezicht – soms met inbegrip van externe toezicht, zoals de input van redacteuren en proofreaders, evenals mogelijke voorgestelde wijzigingen van juridische afdelingen, afhankelijk van de context.

De multiple stakeholders die betrokken zijn bij documenten als eenvoudig als een goed verborgen krantenartikel, kunnen alle eigenaardigheden die het nieuwe voorgestelde systeem waarneemt, bijna volledig uitwissen, en vormen in feite een soort ‘analoge versie’ van een AI-geassisteerd ontwerpproces.

Bovendien hebben de systemen die onder studie staan, zelf getraind op dergelijke werken, en – aangezien trainingsdata steeds vaker in autoriteit wordt gerangschikt tijdens de training – de meest ‘gewogen’ of gerespecteerde bronnen mogelijk de minst ‘natuurlijke’ zijn; tenminste, in vergelijking met iemand die snel een informele e-mail aan een collega samenstelt, in plaats van een jaarverslag voor een Algemene Vergadering samen te stellen.

Een verdere en tegenstrijdige overweging is dat tekstinhoud waaraan meerdere personen hebben bijgedragen, ook onder de meest gefragmenteerde, gebrekkige en herhalende stukken proza kan zijn die een dataset binnenkomen, omdat ze vaak niet het voordeel hebben gehad van een finale unificerende stem, waardoor de piecemeal-aard van hun ontwikkeling zichtbaar is in de proza.

* Originele tekststijl van de auteurs, gereproduceerd uit het papier; niet mijn nadruk.

† De auteurs stellen ‘primaire’, terwijl ze geen andere evaluatiemethode noemen.

Eerst gepubliceerd op maandag 26 januari 2026