인공지능

반사된 라디오파를 이용한 인간 이미지 합성

중국의 연구자들은 라디오파와 생성적 적대적 신경망(GANs)을 사용하여 카메라 없이 사람의 사진을 합성하는 방법을 개발했습니다. 그들이 고안한 시스템은 좋은 조명에서 실제 이미지로 훈련되지만 어두운 조건에서도 상대적으로 실제적인 사람의 ‘스냅샷’을 캡처할 수 있습니다. 또한 전통적인 카메라로 사람을 감추는 주요 장애물에서도 작동합니다.

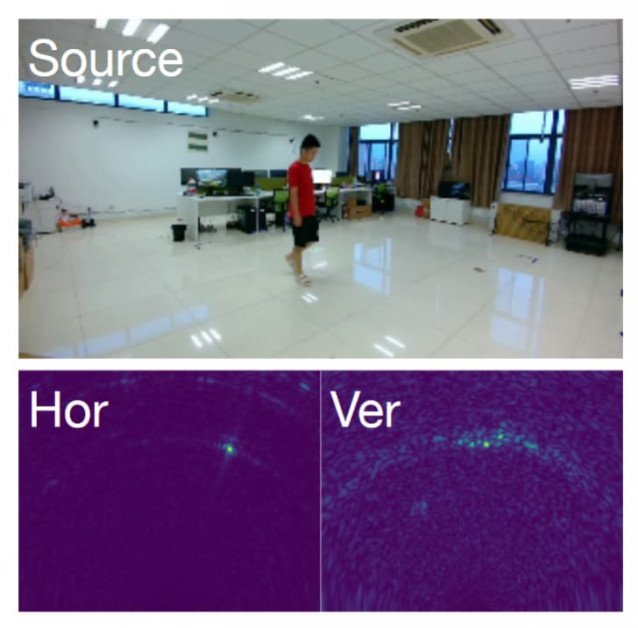

이미지는 두 개의 라디오 안테나에서 얻은 ‘히트맵’에 의존합니다. 하나는 천장에서 데이터를 캡처하고, 다른 하나는 ‘서 있는’ 위치에서 라디오파의 섭동을 기록합니다.

연구자들의 실험 결과는 얼굴이 없는 ‘J-호러’와 같은 특징을 가지고 있습니다.

RFGAN은 실제 이미지와 라디오파 히트맵을 사용하여 훈련되며, 새로운 RF 데이터를 사용하여 스냅샷을 생성할 수 있습니다. 결과 이미지는 저주파 RF 신호의 제한된 해상도에 기반한 근사값입니다. 이 과정은 어두운 환경에서도 작동하며, 다양한 장애물에서도 작동합니다. 출처: https://arxiv.org/pdf/2112.03727.pdf

GAN을 훈련시키기 위해, 연구자들은 표준 RGB 카메라와 라디오 히트맵의 일치하는 데이터를 사용했습니다. 새로운 프로젝트에서 합성된 사람의 이미지들은 초기 다구레오タイプ 사진과 같은 방식으로 흐릿한데, 이는 사용된 라디오파의 해상도가 매우 낮기 때문입니다. 깊이 해상도는 7.5cm, 각도 해상도는 약 1.3도입니다.

위에 있는 이미지와 아래에 있는 두 개의 히트맵은 사람을 특성화하며, GAN 네트워크 내에서 3D 표현으로 합성됩니다.

新的 논문은 중국의 전자과학 기술대학의 6명의 연구자에 의해 작성되었습니다.

데이터와 아키텍처

이전에는 이러한 범위의 데이터셋이나 프로젝트가不存在했으며, RF 신호가 GAN 이미지 합성 프레임워크에서 사용된 적이 없기 때문에, 연구자들은 새로운 방법론을 개발해야 했습니다.

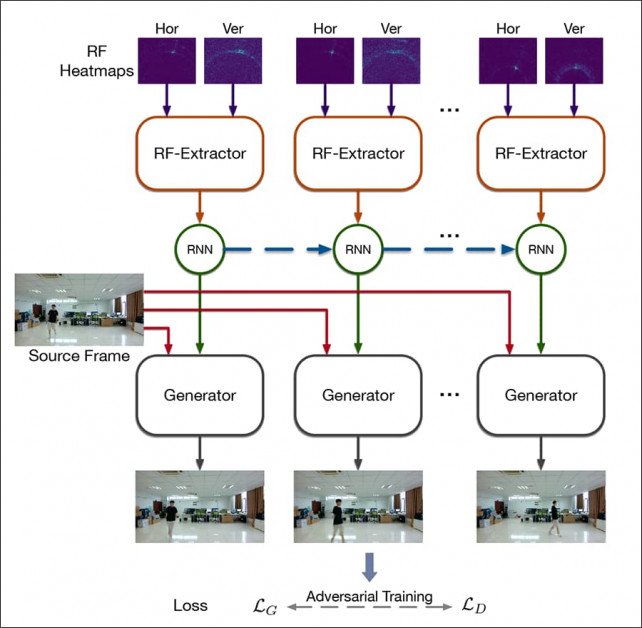

RFGAN의 핵심 아키텍처

적응적 정규화를 사용하여 훈련 중에 쌍의 히트맵 이미지를 해석하여 캡처된 이미지 데이터와 공간적으로 일치시킵니다.

RF 캡처 장치는 수평과 수직으로 구성된 안테나 어레이로 구성된 밀리미터파(mmWave) 레이더입니다. 주파수 변조 연속파(FMCW)와 선형 안테나를 사용하여 송수신했습니다.

제너레이터는 입력 레이어로 소스 프레임을 받으며, RF 융합(히트맵) 표현이 정규화를 통해 컨볼루셔널 레이어의 수준에서 네트워크를 조직합니다.

데이터

데이터는 mmWave 안테나에서 20Hz의 RF 신호 반사에서 수집되었으며, 동시에 사람의 비디오가 매우 낮은 10fps에서 캡처되었습니다. 6명의 자원봉사자가 참여한 9개의 실내 장면이 캡처되었으며, 각 자원봉사자는 다양한 세션에서 다른 옷을 입었습니다.

결과는 두 개의 별도 데이터셋, RF-Activity와 RF-Walk를 생성했습니다. 전자는 68,860개의 사람 이미지를 포함하며, 다양한 위치(예: 스쿼트와 걷기)에서 137,760개의 히트맵 프레임이 있습니다. 후자는 67,860개의 사람 랜덤 워크 프레임을 포함하며, 135,720개의 히트맵 쌍이 있습니다.

데이터는 규칙에 따라 훈련과 테스트를 위해 불균일하게 분할되었습니다. 55,225개의 이미지 프레임과 110,450개의 히트맵 쌍을 훈련에 사용하고, 나머지는 테스트에 사용했습니다. RGB 캡처 프레임은 320×180으로, 히트맵은 201×160으로 리사이즈되었습니다.

모델은 Adam을 사용하여 일관된 학습률 0.0002에서 훈련되었으며, 80개의 에포크와 매우 적은 배치 크기(2)를 사용했습니다. 훈련은 PyTorch를 사용하여 소비자 수준의 단일 GTX-1080 GPU에서 수행되었습니다. 8GB의 VRAM은 이러한 작업에 대해 khá MODEST로 간주됩니다( 낮은 배치 크기 설명).

개방적 관심과 비밀 신호

RFGAN은 라디오 주파수를 사용하여 방의 볼륨적 이미지를 구축하려는 첫 번째 프로젝트가 아닙니다. 2019년 MIT CSAIL의 연구자들은 Wi-Fi 범위의 라디오 주파수 신호를 사용하여 3D 사람을 재구성할 수 있는 아키텍처인 RF-Avatar를 개발했습니다.

MIT CSAIL 프로젝트에서 라디오파를 사용하여 벽이나 옷과 같은 장애물을 제거하여 전통적인 CGI 기반 워크플로우에서 캡처된 주제를 재구성했습니다. 출처: https://people.csail.mit.edu/mingmin/papers/rf-avatar.pdf

新的 논문은 또한 라디오파를 사용하여 환경을 매핑하는 이전 연구(사람의 사진을 재구성하려고 시도하지 않은)를 인식합니다. 이는 사람의 속도 추정; 벽을 통해 Wi-Fi로; 사람의 姿勢 평가; 그리고 sogar 사람의 제스처 인식을 포함합니다.

이전성과 더 넓은 적용 가능성

연구자들은 초기 캡처 환경과 훈련 상황에 대한 발견이 과도하게 적합한지 여부를 확인하기 위해 실험을 수행했습니다. 논문은 이 실험의 자세한 내용을 제공하지 않습니다. 그들은 주장합니다:

‘새로운 장면에서 모델을 배포하려면 모델 전체를 처음부터 다시 훈련할 필요가 없습니다. 미리 훈련된 RFGAN을 아주 적은 데이터(약 40초 데이터)로 미세 조정하여 유사한 결과를 얻을 수 있습니다.’

그리고 계속합니다:

‘손실 함수와 하이퍼파라미터는 훈련 단계와 동일합니다. 정량적 결과에서, 미리 훈련된 RFGAN 모델이 새로운 장면에서 아주 적은 데이터로 미세 조정하여 원하는 사람 활동 프레임을 생성할 수 있음을 발견했습니다. 이는 우리의 제안 모델이 널리 사용될 수 있는 잠재력을 가지고 있음을 의미합니다.’

이 새로운 기술의 적용에 대한 논문의 세부 사항에 따르면, 연구자들이 생성한 네트워크가 원래 주제에만 ‘적합하게’ 훈련되었는지, 또는 RF-히트맵이 의류의 색상과 같은 세부 사항을 유추할 수 있는지 명확하지 않습니다. 이는 광학 및 라디오 캡처 방법에涉한 두 가지 다른 유형의 주파수가 있습니다.

어떤 경우에든, RFGAN은 생성적 적대적 신경망의 모방과 대표 능력을 사용하여 새로운 형태의 감시를 생성하는 방법입니다. 이는 어둠과 벽을 통해 작동할 수 있으며, 최근의 노력과 비교하여 더 인상적인 성능을 발휘할 수 있습니다.

2021년 12월 8일 (최초 출판일), 20:04 GMT+2 – 반복되는 단어를 제거했습니다. – MA